Вештачка интелигенција

Промена на емоциите во видео снимките со вештачка интелигенција

Истражувачите од Грција и Обединетото Кралство развија нов пристап за длабоко учење за менување на изразите и очигледното расположение на луѓето во видео снимките, притоа зачувувајќи ја верноста на нивните движења на усните на оригиналното аудио на начин на кој претходните обиди не беа во можност да се совпаднат. .

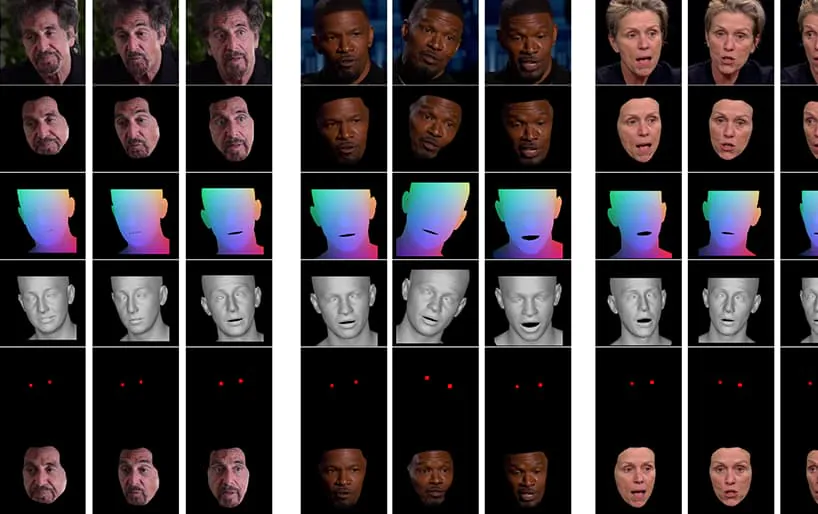

Од видеото што го придружува трудот (вградено на крајот од овој напис), краток клип на актерот Ал Пачино кој неговиот израз е суптилно изменет од NED, врз основа на семантички концепти на високо ниво што ги дефинираат индивидуалните изрази на лицето и нивната поврзана емоција. Методот „Водено од референца“ на десната страна ги зема интерпретираните емоции/и од изворното видео и го применува на целината на видео секвенца. Извор: https://www.youtube.com/watch?v=Li6W8pRDMJQ

Ова особено поле спаѓа во растечката категорија на длабоко лажни емоции, каде што е зачуван идентитетот на оригиналниот говорник, но нивните изрази и микроизрази се изменети. Како што созрева оваа конкретна технологија за вештачка интелигенција, таа нуди можност за филмските и ТВ продукциите да прават суптилни измени во изразот на актерите - но исто така отвора прилично нова категорија на „длабоки фејкови“ на видеа „променети со емоции“.

Промена на лица

Изразите на лицето за јавни личности, како што се политичарите, се ригорозно курирани; во 2016 година дојдоа изразите на лицето на Хилари Клинтон под интензивен медиумски лупа за нивното потенцијално негативно влијание врз нејзините изборни перспективи; изразите на лицето, се чини, се исто така а тема од интерес до ФБИ; и тие се а критичен индикатор во интервјуата за работа, правејќи ја (далечната) перспектива за филтер за „контрола на изразување“ во живо пожелен развој за оние што бараат работа кои се обидуваат да поминат пред екранот на Zoom.

Студија од 2005 година од ОК го потврди тој изглед на лицето влијае на одлуките за гласање, додека функцијата на Вашингтон пост од 2019 година го испитуваше употреба на споделување видео клипови „надвор од контекст“., што во моментов е најблиската работа што ја имаат поборниците за лажни вести за да можат всушност да го променат начинот на кој се чини дека јавната личност се однесува, реагира или чувствува.

Кон манипулација со невронски израз

Во моментов, состојбата на уметноста во манипулирањето со афектот на лицето е прилично рудиментирана, бидејќи вклучува справување со расплеткување на концепти на високо ниво (како тажни, лути, среќни, насмеани) од вистинска видео содржина. Иако традиционалните длабоки фејк архитектури се чини дека доста добро го постигнуваат ова расплеткување, пресликувањето на емоциите низ различни идентитети сè уште бара две обуки за лица да содржат соодветни изрази за секој идентитет.

Типични примери на слики од лица во сетови на податоци што се користат за обука на длабоки фејкови. Во моментов, можете да манипулирате само со изразот на лицето на една личност со создавање на специфични изрази за ИД<>патеки за изразување во длабока лажна невронска мрежа. Софтверот за длабок фејк од 2017 година нема внатрешно, семантичко разбирање за „насмевката“ - тој само ги мапира-и-совпаѓа согледаните промени во геометријата на лицето кај двата субјекти.

Она што е пожелно, а сè уште не е совршено постигнато, е да се препознае како субјектот Б (на пример) се насмевнува и едноставно да се создаде 'насмевка' префрлете ја архитектурата, без потреба да ја мапирате на еквивалентна слика на насмеан предмет А.

на нова хартија е насловен Директор на нервни емоции: Семантичка контрола на изразите на лицето за зачувување на говорот во видеата „во дивината“и доаѓа од истражувачи на Факултетот за електротехничко и компјутерско инженерство на Националниот технички универзитет во Атина, Институтот за компјутерски науки при Фондацијата за истражување и технологија Хелас (FORTH) и Колеџот за инженерство, математика и физички науки на Универзитетот во Ексетер во Велика Британија.

Тимот разви рамка наречена Директор за нервни емоции (NED), инкорпорирајќи мрежа за превод на емоции базирана на 3D, 3D-базиран манипулатор со емоции.

NED зема добиена низа од параметри на изразување и ги преведува во целниот домен. Тој е обучен на неспоредливи податоци, што значи дека не е неопходно да се тренира на сетови на податоци каде што секој идентитет има соодветни изрази на лицето.

Видеото, прикажано на крајот од овој напис, поминува низ серија тестови каде што NED наметнува очигледна емоционална состојба на снимката од базата на податоци на YouTube.

Авторите тврдат дека НЕД е првиот метод базиран на видео за „насочување“ на актерите во случајни и непредвидливи ситуации и го направија кодот достапен на НЕД. страница на проектот.

Метод и архитектура

Системот е обучен на две големи сетови на видео податоци кои се означени со етикети „емоција“.

Излезот е овозможен со видео рендерер на лице што ја прикажува саканата емоција на видеото користејќи традиционални техники за синтеза на слики на лицето, вклучувајќи сегментација на лицето, усогласување и мешање на обележјата на лицето, каде што се синтетизира само областа на лицето, а потоа се наметнува на оригиналната снимка.

Архитектурата за цевководот на детекторот за нервни емоции (NED). Извор: https://arxiv.org/pdf/2112.00585.pdf

Првично, системот добива 3D обновување на лицето и наметнува порамнувања на обележјата на лицето на влезните рамки со цел да се идентификува изразот. После ова, овие повратени параметри на изразот се пренесуваат на 3D-базиран манипулатор на емоции и стилски вектор се пресметува со помош на семантичка ознака (како „среќен“) или со референтна датотека.

Референтна датотека е видео кое прикажува одреден препознаен израз/емоција, кој потоа се наметнува на целото целно видео, заменувајќи го оригиналниот израз.

Конечниот генериран 3D облик на лице потоа се поврзува со Нормализираната средна координата на лице (NMFC) и сликите на очите (црвените точки на сликата погоре) и се пренесува на нервниот рендерер, кој ја врши последната манипулација.

Резултати

Истражувачите спроведоа обемни студии, вклучително и студии за корисници и аблација, за да ја оценат ефективноста на методот во однос на претходната работа, и открија дека во повеќето категории, NED ја надминува моменталната состојба на уметноста во овој потсектор на манипулација со нервни лица.

Авторите на трудот предвидуваат дека подоцнежните имплементации на оваа работа, и алатките од слична природа, ќе бидат корисни првенствено во ТВ и филмската индустрија, наведувајќи:

„Нашиот метод отвора плејада нови можности за корисни апликации на технологии за невронско рендерирање, почнувајќи од постпродукција на филмови и видео игри до фото-реалистични афективни аватари.

Ова е рана работа на терен, но едно од првите што се обиде да го реконструира лицето со видео, а не со фотографии. Иако видеата во суштина се многу неподвижни слики кои се комбинираат многу брзо, постојат временски размислувања кои ги прават претходните апликации за пренос на емоции помалку ефективни. Во придружното видео и примерите во трудот, авторите вклучуваат визуелни споредби на излезот на NED со други споредливи неодамнешни методи.

Подетални споредби и многу повеќе примери на НЕД, може да се најдат во целото видео подолу:

3 декември 2021 година, 18:30 GMT+2 – На барање на еден од авторите на трудот, направени се корекции во однос на „референтната датотека“, за која погрешно наведов дека е неподвижна фотографија (кога всушност е видео клип). Исто така, дополнување на името на Институтот за компјутерски науки при Фондацијата за истражување и технологија.

3 декември 2021 година, 20:50 GMT+2 – Второ барање од еден од авторите на трудот за натамошно дополнување на името на горенаведената институција.