Anderson 视角

人工智能正在将网络搜索分裂为三个不同的现实

新研究发现,Google 现在在其搜索帝国内部使用三个不同的信息系统,包括常规搜索、AI 概述和 Gemini,每个系统都偏爱不同的来源、排名和内容。

简化主义占主导地位。在过去的十二个月里,‘让我为你谷歌一下’ 表情包 已被一个新的 ‘让我为你总结谷歌搜索结果’ 趋势所取代,其中 AI 概述 在搜索结果中越来越多地为读者节省了点击搜索链接的麻烦(可以说,这样做减少了对源网站的资金支持),通过将整个搜索结果浓缩成几段生成的段落。

人们可能会认为,核心知识和选择的网站将在所有三种最流行的搜索互联网信息方法中相对相似:传统的 网络搜索;AI 概述(AIOs),现在头部显示大多数网络搜索结果;以及通过 越来越多地使用 LLMs,如 ChatGPT,作为网络神谕(无论是否有 外部 RAG 调用)。

然而,最近的美国研究表明,这种情况远非如此;即使在 Google 自己的三位一体神谕中——SERPS*、AI 概述和直接与 Gemini LLM 系列 交互——每条路线似乎都存在着显著且有趣的差异。

三分法

在一篇清晰而详尽的 新论文 中,题为 生成式 AI 如何破坏搜索:对 Google 搜索、Gemini 和 AI 概述的实证研究,六位来自新泽西理工学院的研究人员概述了这三种搜索方法的差异,并提供了一些可能的理论来解释这些裂痕。

论文指出:

‘首先,我们发现 51.5% 的代表性、真实用户查询会生成 AIO,并且在有机搜索结果上方显示。有争议的问题经常会导致 AIO。

‘第二,我们发现每个搜索引擎检索的来源在很大程度上是不同的(平均 Jaccard 相似度小于 0.2)。传统的 Google 搜索更有可能检索来自流行或机构网站的信息,例如政府或教育机构,而生成式搜索引擎更有可能检索 Google 自有的内容。 ‘

‘第三,我们观察到阻止 Google AI 爬虫的网站不太可能被 AIO 检索,尽管它们可以访问内容。’

由于这篇论文是对令人着迷的见解的全面介绍,而不是遵循通常的线性和方法驱动的工作流程,我们将更详细地研究这些以及其他一些最令人惊讶和启发性的见解。

旧的“二合一”

研究中最有趣的发现之一表明,Google 的 AI 概述往往会在突发新闻事件中被抑制,因为最早和最容易获取的来源可能不是最准确的。

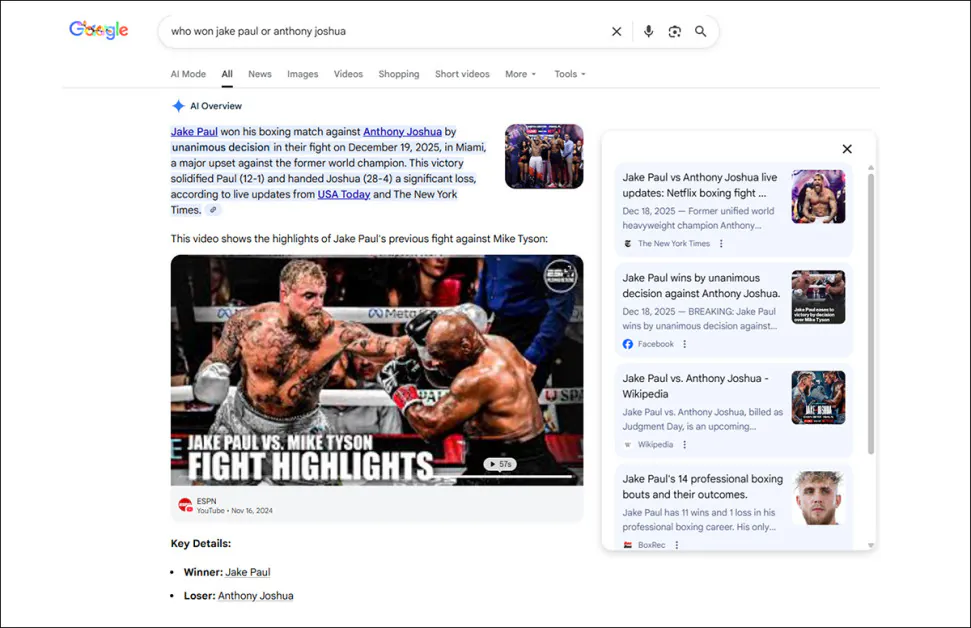

这种系统并不总是有效:研究人员指出,Google AI 概述中关于一场拳击比赛的结果将胜利归因于错误的拳击手,即使唯一宣称(不正确)结果的来源是一个在 Facebook 上的讽刺性体育节目。

Google 的 AI 概述避免时间临界总结的原因之一是早期信息可能不完整或完全不准确。在这种情况下,拳击手 Jake Paul 实际上输掉了比赛。 来源

作者指出,AIO 倾向于在事件至少五天后出现,这使得这种情况成为一个异常——但尽管如此,研究人员还是轻松地找到了它。

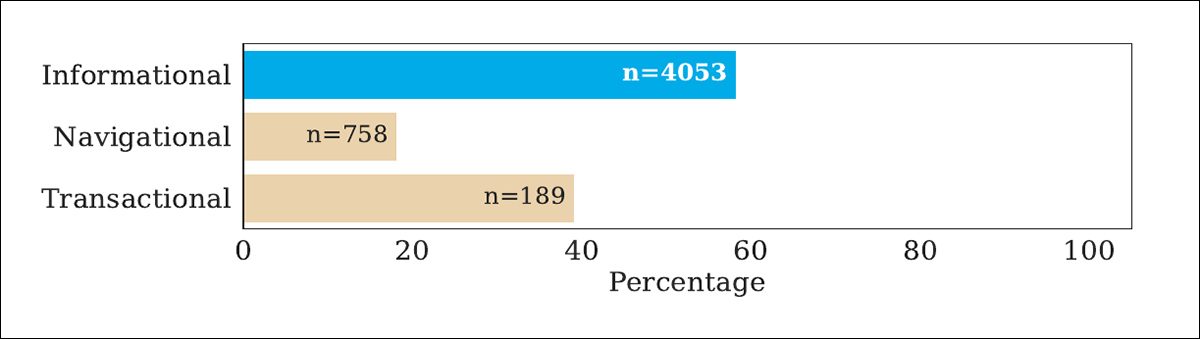

AIO 更有可能在查询以问号结尾时生成,并且 查询意图 是一个决定是否显示 AIO 的因素:

在研究人员的一轮测试中,AI 搜索摘要生成的事件百分比。这里,’信息’ 表示直接问题,这种类型的交互往往会产生比其他类型更多的 AIO。

此外,论文指出,更长 的查询更有可能产生 AI 概述而不是直接搜索结果,尽管作者尚未提出理论来解释这一点。

分裂的王国

新研究中最令人惊讶的结果之一是 Google 自己的三个搜索平台之间的结果质量/类型重叠相对较小。

论文反复表明,常规 Google 搜索、AI 概述和 Gemini(LLM)检索相同查询的不同来源,重叠评分足够低,表明一个公司内部有三个 竞争的检索逻辑,而用户可能会认为 Google 有一个权威的索引和一个排名哲学:

即使在 Google 自己的生态系统中,传统搜索、AI 概述和 Gemini 之间的重叠也出乎意料地小,相同的查询经常会根据处理请求的 Google 系统的不同而产生大不相同的来源列表。在此比较中,我们可以看到这三个系统在成千上万个搜索查询中彼此匹配的程度,从购物和辩论主题到本地搜索和一般知识问题,评分越低,所选来源之间的协议越少。

关于他们分析的这一部分,作者指出:

‘上表显示了 AIO、Gemini 和传统 SERP 为每个查询检索的来源列表之间的平均相似度。’

‘主要结论是,无论查询子集如何,哪些搜索引擎被比较,检索的列表都不同,尽管所有三个都是由 Google 开发的。’

研究人员进一步指出,没有一个搜索方法的检索偏差重叠(RBO)超过 0.27,这是一个非常低的评分。他们还指出,Amazon Retail 和本地查询(即 ‘我附近的商店’)在搜索方法之间的相似度最低。

他们将低协议归因于搜索引擎之间的 ‘不一致性’,并指出随机性或其他明显因素都不能解释这种脱节。

一种直观的解释,可能是,训练数据点的排名方式与 Google 在过去二十年中为 PageRank 和其后继者开发的方法非常不同。此外,如果 Google 搜索算法有一个 秘密议程,这种干预或“游戏”在基于扩散的 AI(如 Gemini)中更难以一致地实施,即使通过过滤、系统提示和商业模型上强加的各种其他协调方法。

自助服务..?

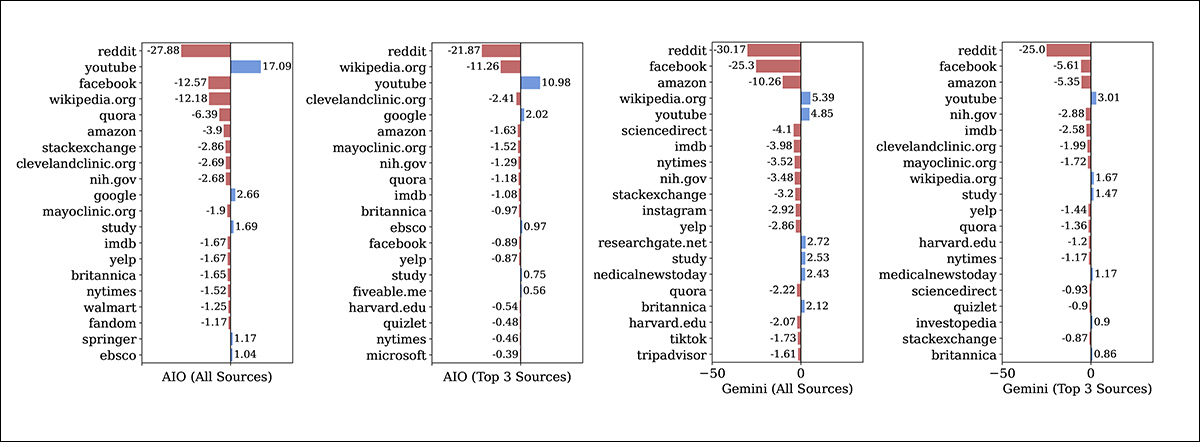

某些网站或网站类别似乎受到 AI 概述的出现和基于 LLM 的搜索进入传统搜索空间的影响——无论是积极还是消极地影响:

与传统 Google 搜索相比,AI 概述和 Gemini 都减少了对许多大型网站的引用,同时增加了对少数特定域名的可见性。YouTube 在这两个系统中都成为最大受益者之一,而 Reddit、维基百科、Facebook 和许多机构来源在 AI 生成的检索中出现的频率较低。

作者指出,在测试中出现了一些意外的偏好:

‘我们从上面的图表中得出三个主要结论。首先,大型和知名网站受到的影响最大(无论是积极还是消极)。这是合理的,因为大型网站具有声誉和内容多样性,可以与许多不同的查询相关。’

‘第二,绝大多数这些网站在生成式搜索引擎中获得的引用总数和前三名引用数都减少了(如上图的红色条和负数所示)。这表明生成式搜索往往从比传统搜索引擎更小众的来源获取信息。 ‘

‘第三,Google 的 AIO 倾向于偏爱 Google 网站(即 google.com 和 youtube.com 域名)。 ‘

‘Gemini 也偏爱 YouTube,与传统 Google 搜索相比,但绝对差异较小。’

任何“阻塞者”..?

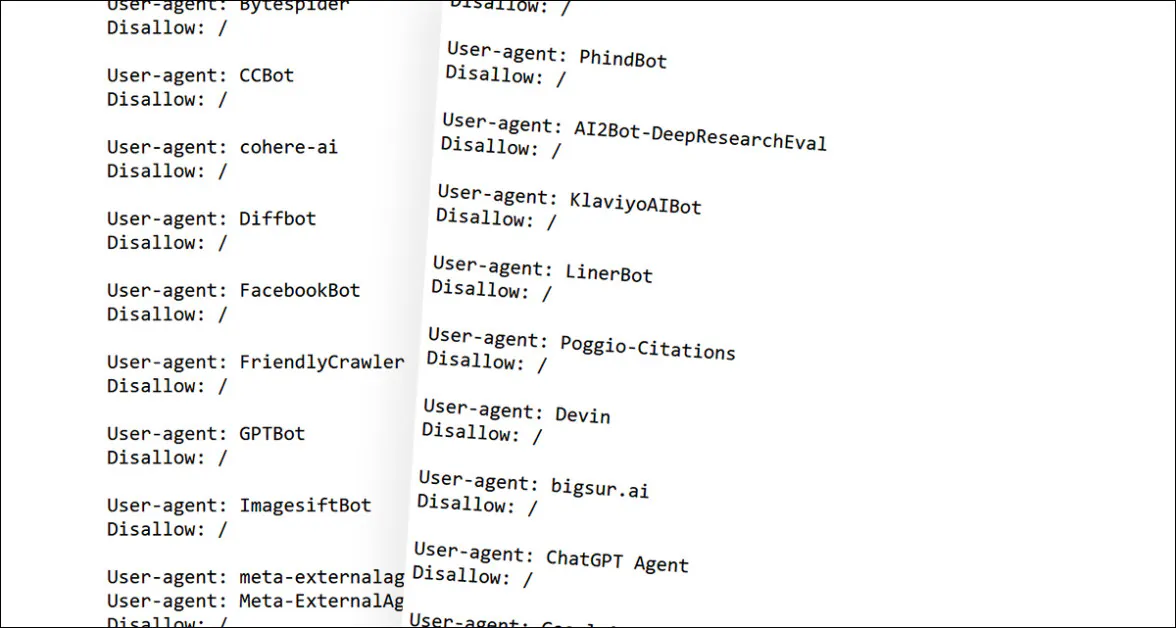

该研究还发现,阻止 Google 的 AI 网络爬虫 的出版商——即阻止自动网络机器人从其网站抓取数据的出版商,除非使用 robots.txt 文件——往往不会出现在 AI 概述中。

这似乎是一种自找的伤害,但事实上,Google 公开声明,阻止 AI 爬虫的内容 不会被阻止出现在 AI 概述中;相反,出版商只会阻止其数据被抓取、策划成集合并用于 Gemini 和其他 Google AI 项目的下一轮 AI 训练。

然而,这并不是新论文的研究人员得出的结论,他们发现,流行的 AI 禁止出版商很少被 Gemini 引用,无论是在 LLM 还是简化和更敏捷的搜索结果版本中。论文指出,实际上被“禁止”的出版商包括 NYTimes、CNN、BBC、ScienceDirect、Reuters、Wiley、Nature、ESPN、Business Insider、CNBC、NPR、WIRED、USA Today、NBC News、Genius、National Geographic、The Conversation、U.S. News & World Report、Scientific American、Consumer Reports 和 STAT。

上述部分出版商实施的 robots.txt AI 抓取禁止。但这是否导致了 Google 更广泛的谴责?

作者指出:

‘在我们分析中,最受影响的域名中,我们发现 21 个流行的出版商(由 Google Search 和 AIOs 检索的至少 20 个唯一查询)从未被 Gemini 引用。 ‘

‘Facebook、Instagram、Tiktok 和 IMDb、Yelp、Tripadvisor 等社交媒体和评论网站也从未被 Gemini 引用。在进一步调查后,我们发现所有这些网站都在其 robots.txt 文件中阻止了 Google-Extended 机器人。’

如果这一发现被其他地方验证并持续下去,人们可能会推测这些公司可能正在被 Google 迫使通过部分取消列出来配合其 AI 操作。乍一看,结果似乎很惩罚,但研究的发现更像是混乱而不是预谋;因此,唯一合理的评论是,这些结果看起来表面上很“刻薄”,无论是什么原因造成的。

结论

意见 这是一篇清晰的 zip-bomb 式的论文,其十个主要页面展开成一场几乎让人难以承受的发现风暴。由于我们只涵盖了这些发现中的一小部分,因此我建议即使是普通读者也阅读原始 PDF(这是一个罕见的事件)。

虽然“黄色”倾向可能会对作者的发现做出很多负面解读,但这项工作可能最好被视为全球技术领导者在 AI 搜索领域中尝试获得和保持全球领先地位的尝试,使用具有鲜明对比的平台,这些平台是在非常不同的情况下和时代中发展起来的。

虽然这篇论文研究了三种搜索方法,但真正的争论是传统搜索引擎结果和数据分布式选择方法之间的争论,这种方法在 AI 训练中占主导地位。

人工智能就像 1999

在 Google 出现之前,可以通过纯粹的数量来“操纵”搜索结果,并通过这种方式,人们经常可以通过最少的(通常是自动化的)努力来实现首页 SERPS 排名。这种“数字游戏”大约在 2002 年被 Google 更加复杂和保密的搜索排名算法所终结。但是,由于利益很大,高容量和低质量的内容从未在任何意义上消失。

因此,到像 Common Crawl 这样的超大规模集合为现代 AI 革命奠定基础时,数据的突出地位注定会受到自动化过程过滤和排名传入数据质量的影响程度的支配,以及(不太可能)有多少钱可以支付给人们来排名这些数据。

这些巨大而不加区别的集合中有很多 糟糕或低质量的数据,这些数据可能不包含裸露、亵渎、种族主义的陈词滥调或其他相对容易从训练数据集中过滤掉的东西,但它们仍然是自私的和庞大的,就像 1999-2001 年左右的互联网搜索结果一样。

因为这些数据的感知过程 仍然不够好,即使对于 Google 来说,也很难让 AI 以商业方式行事,因为 Gemini 的 PageRank 风格的决策是由对超大规模数据转化为数据分布和潜在嵌入的不完善的理解所支配的,而不是由 Google 的政策工程师决定的。

* 搜索引擎结果页。

† 作者的强调,而不是我的。然而,我用粗体替换了斜体,因为斜体强调在已经主要是斜体的引语中不起作用。

首次发表于 2026 年 5 月 13 日星期三