人工智能

是否低度策展的超大规模 AI 数据集比互联网本身更糟糕?

爱尔兰、英国和美国的研究人员警告说,超大规模 AI 训练数据集的增长威胁到传播其互联网来源的最糟糕方面,他们认为最近发布的学术数据集包含 ‘令人烦恼和明确的图像和文本对,包括强奸、色情、恶意刻板印象、种族和民族侮辱以及其他极具问题的内容’。

研究人员认为,新的大量未经策展或过滤的多模态(例如图像和图片)数据集可能更具破坏力,因为这些数据集保留了可能已经从在线平台中删除的图像和其他内容,可能是通过用户投诉、当地审查或算法删除的。

他们进一步观察到,解决长期存在的数据集内容投诉可能需要数年时间——在强大的 ImageNet 数据集的情况下,整整十年——而这些后续修订并不总是反映在从它们派生的新数据集中。

该 论文 由爱尔兰大学学院都柏林和 Lero 的研究人员、爱丁堡大学和 UnifyID 身份验证平台的首席科学家撰写,题为 多模态数据集:厌女、色情和恶意刻板印象。

虽然这项工作关注于最近发布的 CLIP 过滤的 LAION-400M 数据集,但作者们反对将越来越多的数据扔给机器学习框架(如神经语言模型 GPT-3)的趋势,并认为这种专注于结果的推动力正在导致对有害数据源的滥用,缺乏对版权的监督;可能造成伤害;以及不仅能传播可能已经从公共领域消失的非法数据,还能将此类数据的道德模型纳入下游 AI 实现中。

LAION-400M

上个月,LAION-400M 数据集被发布,增加了依赖 Common Crawl 存储库的多模态语言数据集的数量,该存储库无差别地抓取互联网,并将过滤和策展的责任转嫁给使用它的项目。派生的数据集包含 4 亿个文本/图像对。

LAION-400M 是 Google AI 的封闭式 WIT(WebImageText)数据集 的开源变体,该数据集于 2021 年 3 月发布,包含文本-图像对,其中数据库中的图像已与伴随的明确或元数据文本(例如网页画廊中的图像的 alt 文本)关联。这使用户能够执行基于文本的图像检索,揭示底层 AI 关于这些域(例如 ‘动物’、‘自行车’、‘人’、‘男人’、‘女人’)的关联。

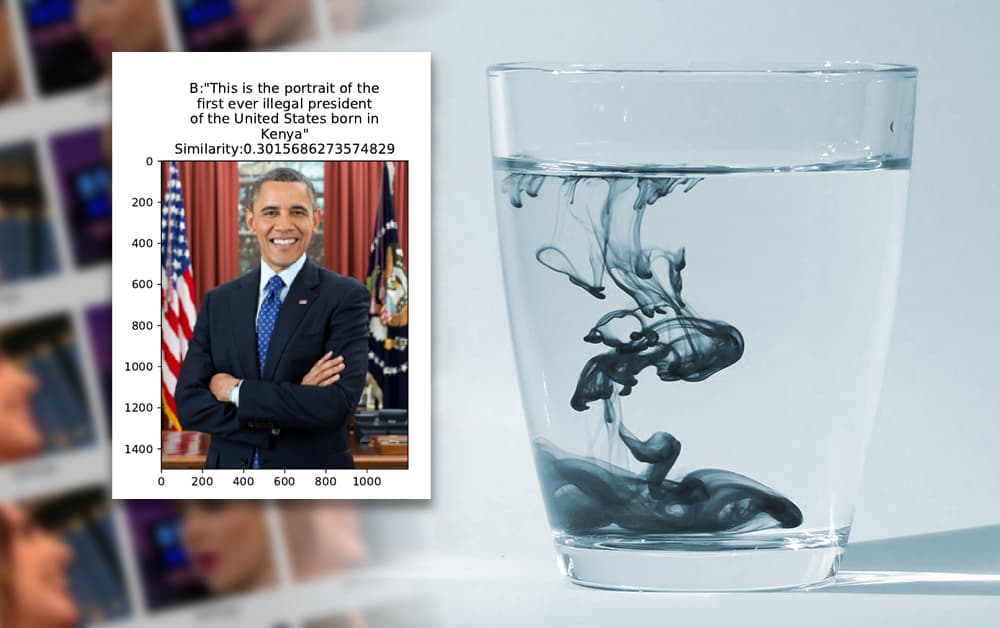

图像和文本之间的关系,以及可以将偏见嵌入查询结果的余弦相似度,是论文呼吁改进方法的核心,因为对 LAION-400M 数据库的非常简单的查询可以揭示偏见。

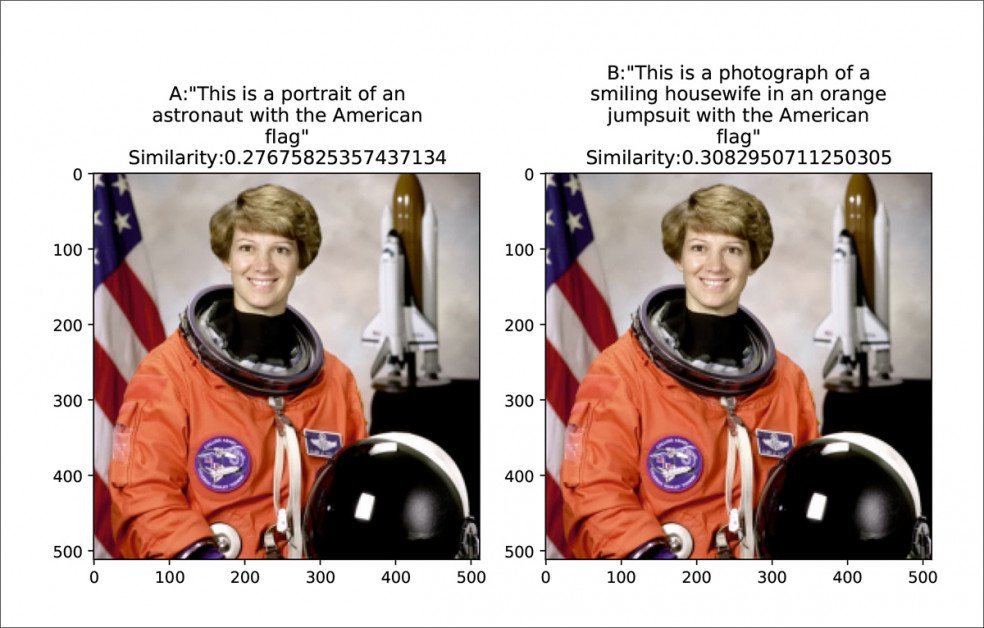

例如,scitkit-image 库中埃琳·柯林斯(Eileen Collins)的图像在 LAION-400M 中检索出两个关联的字幕:‘这是一个带有美国国旗的宇航员肖像’ 和 ‘这是一个穿着橙色连身服的微笑的家庭主妇的照片,带有美国国旗’。

美国宇航员埃琳·柯林斯在 LAION-400M 下获得了她在太空中取得的成就的两种非常不同的解读。 来源:https://arxiv.org/pdf/2110.01963.pdf

报告的余弦相似度使得两个字幕都可能被认为是适用的,而且作者认为,这种接近度会使使用 LAION-400M 的 AI 系统更有可能将任意一个字幕呈现出来。

色情内容再次浮现

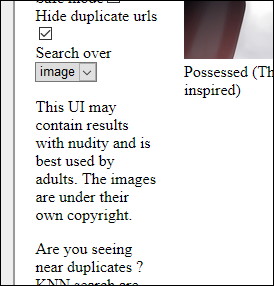

LAION-400M 提供了一个可搜索的界面 可用,取消“安全搜索”按钮后,可以看到色情图像和文本关联在标签和类别中占据主导地位。例如,在数据库中搜索 “修女”(如果您随后禁用安全模式,则不适合工作场所)将返回与恐怖、角色扮演和服装相关的结果,真正的修女很少。

在同一搜索中关闭安全模式,会显示出大量与“修女”相关的色情图像,这些图像将任何非色情图像推到搜索结果页面的底部,揭示了 LAION-400M 为在线来源中“修女”一词的色情图像分配了更大的权重。

默认启用安全模式在在线搜索界面中具有欺骗性,因为它代表了一个 UI 怪癖,即一个过滤器,它不仅可能不会在派生的 AI 系统中启用,而且已经被一般化到“修女”域中,这种方式在算法使用中不容易过滤或与(相对)安全的结果区分开来。

论文在末尾的补充材料中以模糊的形式呈现了各种搜索词的示例,但由于伴随模糊照片的文本语言,无法在此处呈现。研究人员指出,审查和模糊图像对他们(以及帮助他们的同事)的影响,并承认大型数据库的人工策展面临的挑战:

‘我们(以及帮助我们的同事)在探索数据集的过程中经历了不同程度的不适、恶心和头痛。另外,这种工作在学术 AI 领域中会遇到大量的负面批评,这不仅为已经很艰巨的任务增加了情感上的负担,而且还阻碍了类似的未来工作,对 AI 领域和整个社会都有害。’

研究人员认为,虽然人工策展很昂贵,并且有个人成本,但旨在删除或处理此类材料的自动过滤系统显然不适合此任务,因为 NLP 系统在隔离或忽略占据数据集主导地位的攻击性材料方面存在困难,并且可能由于纯粹的体积而被认为是重要的。

固化被禁止的内容并剥夺版权保护

该论文认为,这种类型的数据集很可能延续对弱势个体的剥削,并解决了类似的开源数据项目是否有权在道德或法律上将对材料的责任转嫁给最终用户的问题:

‘个人可能会从网站中删除他们的数据,并假设它永远消失,但它可能仍然存在于几家研究人员和组织的服务器上。谁负责从数据集中删除该数据?对于 LAION-400M,创建者已经将此任务委托给了数据集用户。考虑到这些过程故意复杂化,并且普通用户缺乏删除其数据的技术知识,这是一种合理的方法吗?’

他们进一步认为,LAION-400M 可能不适合在其采用的 Creative Common CC-BY 4.0 许可证模型下发布,尽管大规模数据集的民主化可能带来好处,之前这些数据集仅限于像 Google 和 OpenAI 这样拥有大量资金的公司。

LAION-400M 域声明该数据集的图像“属于他们自己的版权”- 这是一种“传递”机制,主要是由近年来的法院判决和政府指南所允许的网络抓取用于研究目的。 来源:https://rom1504.github.io/clip-retrieval/

作者建议,草根(即众包志愿者)可以解决一些数据集问题,并且研究人员可以开发更好的过滤技术。

‘尽管如此,数据主体的权利仍然没有得到解决。低估大规模数据集中的危害是鲁莽和危险的,并且鼓励在工业和商业环境中使用它们。数据集提供的许可方案下的责任完全落在数据集的创建者身上。’

民主化超大规模数据的问题

该论文认为,像 LAION-400M 这样大的视听数据集以前在大型科技公司和拥有资源来收集、策展和处理它们的少数研究机构之外是不可用的。他们赞扬了新发布的精神,同时批评了其执行。

作者认为,应用于开源超大规模数据集的“民主化”的公认定义过于狭隘,并且 ‘未能考虑到弱势个体和社区的权利、福祉和利益,他们可能会最严重地受到该数据集和在其上训练的模型的下游影响’。

由于 GPT-3 规模的开源模型的开发最终旨在向全球数百万用户(甚至可能数十亿用户)分发,并且研究项目可能会在数据集被修改甚至删除之前采用这些数据集,作者认为,粗心发布的未经策展的数据集不应成为开源机器学习的常见特征。

把精灵放回瓶子里

一些数据集由于对人权组织的担忧而被压制,尽管其内容可能已经通过长期的 AI 项目传递,例如杜克 MTMC(多目标、多摄像头)数据集,最终由于中国当局的使用而被撤回;Microsoft Celeb(MS-Celeb-1M),一个包含 1,000 万张“名人”面部图像的数据集,发现其中包括记者、活动家、政策制定者和作家,他们的生物识别数据曝光受到严厉批评;以及 Tiny Images 数据集,该数据集于 2020 年因“偏见、攻击性和歧视性图像以及贬损性术语”而被撤回。

关于那些在受到批评后被修改而不是撤回的数据集,例子包括非常流行的 ImageNet 数据集,研究人员指出,花了十年(2009-2019 年)才对围绕隐私和非图像类的批评做出回应。

该论文指出,LAION-400M 实际上通过“基本上忽略”ImageNet 中的修订来使这些进步倒退,并且在这一点上看到了更广泛的趋势:

‘这在更大的数据集的出现中得到了体现,例如 Tencent ML-Images 数据集(2020 年 2 月),它包含大部分这些 不可图像化类,ImageNet-21k 全面数据集在存储库(如 TF-hub)中仍然可用,最新的 SotA 模型(如 Google 的最新 EfficientNetV2 和 CoAtNet 模型)继续使用未过滤的 ImageNet-21k,并且像 LVIS 挑战 2021 这样的声誉良好的比赛中明确允许使用未过滤的 ImageNet-21k 进行预训练。 ‘

‘我们强调这一关键观察:ImageNet 团队难以处理少于 1,500 万张图像的去毒工作。 ‘

‘彻底去毒如此庞大的多模态数据集以及在此数据集上训练的下游模型所需的谨慎努力的规模将是不可否认的天文数字。 ‘