Künstliche Intelligenz

Den „Zwischenraum“ im generativen Video überbrücken

Neue Forschungen aus China bieten eine verbesserte Methode zur interpolieren die Lücke zwischen zwei zeitlich auseinanderliegenden Videobildern – eine der entscheidendsten Herausforderungen im aktuellen Wettlauf um Realismus für generatives KI-Video sowie für Video Codec Kompression.

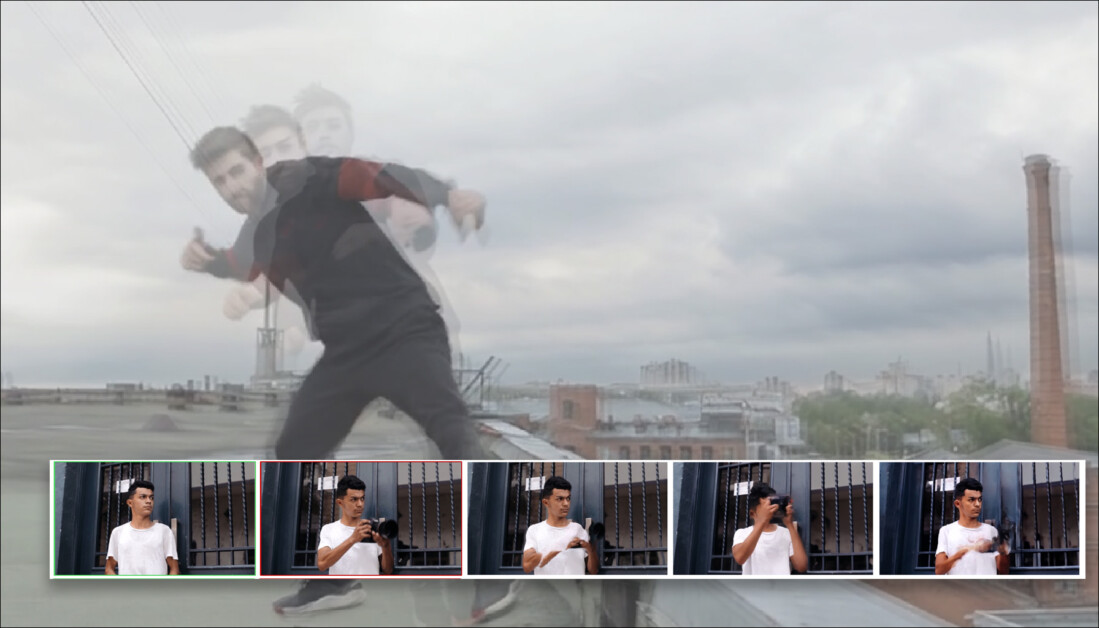

Im Beispielvideo unten sehen wir in der linken Spalte ein Startbild (oben links) und ein Endbild (unten links). Die Aufgabe der konkurrierenden Systeme besteht darin, zu erraten, wie das Motiv in den beiden Bildern von Bild A zu Bild B gelangt. In der Animation nennt man diesen Prozess Tweening, und erinnert an die Stummfilmära.

Anklicken um abzuspielen. In der ersten Spalte ganz links sehen wir das vorgeschlagene Start- und Endbild. In der mittleren Spalte und oben in der dritten Spalte (ganz rechts) sehen wir drei frühere Ansätze für diese Herausforderung. Unten rechts sehen wir, dass die neue Methode bei der Bereitstellung der Zwischenbilder ein weitaus überzeugenderes Ergebnis erzielt. Quelle: https://fcvg-inbetween.github.io/

Die neue Methode der chinesischen Forscher heißt Frameweise, bedingungsgesteuerte Videogenerierung (FCVG), und die Ergebnisse sind unten rechts im obigen Video zu sehen. Sie sorgen für einen reibungslosen und logischen Übergang von einem Standbild zum nächsten.

Im Gegensatz dazu können wir sehen, dass eines der bekanntesten Frameworks für Videointerpolation, Googles Frame-Interpolation für große Bewegungen (FILM) Projekt, kämpft, als viele ähnliche Ausflüge kämpfen, mit der Interpretation großer und kühner Bewegungen.

Die beiden anderen konkurrierenden Frameworks, die im Video visualisiert werden, Zeitumkehrfusion (TRF) und Generatives Inbetweening (GI) bieten eine weniger verzerrte Interpretation, haben jedoch frenetische und sogar komische Tanzbewegungen geschaffen, von denen keine die implizite Logik der beiden bereitgestellten Frames respektiert.

Anklicken um abzuspielen. Zwei unvollkommene Lösungen für das Tweening-Problem. Links behandelt FILM die beiden Frames als einfache Morph-Ziele. Rechts weiß TRF, dass eine Art Tanz eingefügt werden muss, schlägt aber eine undurchführbare Lösung vor, die anatomische Anomalien aufweist.

Oben links können wir uns genauer ansehen, wie FILM das Problem angeht. Obwohl FILM für die Verarbeitung großer Bewegungen konzipiert wurde, im Gegensatz zu früheren Ansätzen, die auf optischer Fluss, es fehlt immer noch ein semantisches Verständnis dessen, was zwischen den beiden bereitgestellten Keyframes passieren soll, und es führt einfach einen Morph im Stil der 1980er/90er Jahre zwischen den Frames durch. FILM hat keine semantische Architektur, wie z. B. eine Latentes Diffusionsmodell Google Trends, Amazons Bestseller Stable Diffusion , um beim Erstellen einer geeigneten Brücke zwischen den Rahmen zu helfen.

Rechts im Video oben sehen wir die Bemühungen von TRF, wo Stabile Videoverbreitung (SVD) wird verwendet, um intelligenter zu „erraten“, wie eine Tanzbewegung aussehen könnte, die zu den beiden vom Benutzer bereitgestellten Frames passt – es hat jedoch eine kühne und unplausible Annäherung vorgenommen.

Mit FCVG (siehe unten) lassen sich die Bewegung und der Inhalt zwischen den beiden Frames besser erraten:

Anklicken um abzuspielen. FCVG verbessert frühere Ansätze, ist aber bei weitem nicht perfekt.

Es treten zwar immer noch Artefakte auf, wie etwa eine unerwünschte Verwandlung der Hände oder der Gesichtsidentität, doch diese Version ist oberflächlich betrachtet die plausibelste – und jede Verbesserung gegenüber dem aktuellen Stand der Technik muss im Hinblick auf den enormen Schwierigkeitsgrad dieser Aufgabe und das große Hindernis, das diese Herausforderung für die Zukunft KI-generierter Videos darstellt, abgewogen werden.

Warum Interpolation wichtig ist

Da wir vorher hingewiesen, ist die Fähigkeit, Videoinhalte plausibel zwischen zwei benutzerdefinierten Frames einzufügen, eine der besten Möglichkeiten, zeitliche Konsistenz im generativen Video, da zwei reale und aufeinanderfolgende Fotos derselben Person natürlich konsistente Elemente wie Kleidung, Haare und Umgebung enthalten.

Wenn nur ein Single Startframe verwendet wird, begrenztes Aufmerksamkeitsfenster eines generativen Systems, das oft nur benachbarte Einzelbilder berücksichtigt, tendiert dazu, Facetten des Themas schrittweise zu „entwickeln“, bis (zum Beispiel) ein Mann zu einem anderen Mann (oder einer Frau) wird oder sich herausstellt, dass seine Kleidung „veränderlich“ ist – neben vielen anderen Ablenkungen, die üblicherweise in Open-Source-T2V-Systemen und in den meisten kostenpflichtigen Lösungen wie Kling generiert werden:

Anklicken um abzuspielen. Das Einspeisen der beiden (echten) Quellbilder des neuen Dokuments in Kling mit der Eingabeaufforderung „Ein Mann tanzt auf einem Dach“ führte nicht zu einer idealen Lösung. Obwohl Kling 1.6 zum Zeitpunkt der Erstellung verfügbar war, ist V1.5 die neueste Version, die vom Benutzer eingegebene Start- und Endbilder unterstützt. Quelle: https://klingai.com/

Ist das Problem bereits gelöst?

Im Gegensatz dazu scheinen einige kommerzielle, Closed-Source- und proprietäre Systeme mit dem Problem besser zurechtzukommen – insbesondere RunwayML, das in der Lage war, sehr plausible Zwischenbilder zwischen den beiden Quellbildern zu erstellen:

Anklicken um abzuspielen. Die diffusionsbasierte Interpolation von RunwayML ist sehr effektiv. Quelle: https://app.runwayml.com/

Durch Wiederholung der Übung erzielte RunwayML ein zweites, ebenso glaubwürdiges Ergebnis:

Anklicken um abzuspielen. Der zweite Durchlauf der RunwayML-Sequenz.

Ein Problem dabei ist, dass wir von einem proprietären System weder etwas über die damit verbundenen Herausforderungen lernen noch den Open-Source-Stand der Technik voranbringen können. Wir können nicht wissen, ob diese überlegene Darstellung durch einzigartige Architekturansätze, durch Daten (oder Datenkuratierungsmethoden wie Filterung und Annotation) oder durch eine Kombination dieser und anderer möglicher Forschungsinnovationen erreicht wurde.

Zweitens können sich kleinere Unternehmen, wie etwa Visual Effects-Unternehmen, auf lange Sicht nicht auf API-gesteuerte B2B-Dienste verlassen, die ihre logistische Planung durch eine einzige Preiserhöhung potenziell untergraben könnten – insbesondere dann, wenn ein Dienst den Markt dominieren und daher eher zu Preiserhöhungen neigen würde.

Wenn die Rechte im Unrecht sind

Viel wichtiger ist jedoch, dass, wenn ein gut funktionierendes kommerzielles Modell mit nicht lizenzierten Daten trainiert wird, wie es bei RunwayML der Fall zu sein scheint, jedes Unternehmen, das solche Dienste nutzt, könnte später rechtliche Konsequenzen nach sich ziehen.

Da Gesetze (und einige Gerichtsverfahren) länger Bestand haben als Präsidenten und da der entscheidende US-Markt zu den prozessfreudigsten der WeltDer aktuelle Trend zu einer stärkeren gesetzlichen Kontrolle von KI-Trainingsdaten dürfte anhalten die „leichte Berührung“ der nächsten Amtszeit von Donald Trump als Präsident.

Der Computer Vision-Forschungssektor muss sich daher diesem Problem auf die harte Tour stellen, damit die entstehenden Lösungen langfristig Bestand haben.

FCVG

Vorgestellt wird die neue Methode aus China in einem Krepppapier betitelt Generatives Inbetweening durch rahmenweise, zustandsgesteuerte Videogenerierungund stammt von fünf Forschern des Harbin Institute of Technology und der Tianjin University.

FCVG löst das Problem der Mehrdeutigkeit bei der Interpolationsaufgabe durch die Verwendung von Rahmenweise Bedingungen, zusammen mit einem Rahmen, der beschreibt Kanten in den vom Benutzer bereitgestellten Start- und Endbildern, wodurch der Prozess die Übergänge zwischen den einzelnen Bildern und auch den Gesamteffekt konsistenter verfolgen kann.

Bei der Frame-weisen Konditionierung wird die Erstellung von Zwischenframes in Unteraufgaben unterteilt, anstatt zu versuchen, ein sehr großes semantisches Vakuum zwischen zwei Frames zu füllen (und je länger die angeforderte Videoausgabe ist, desto größer ist diese semantische Distanz).

In der folgenden Grafik aus dem Artikel vergleichen die Autoren die oben erwähnte Zeitumkehrmethode (TRF) mit ihrer eigenen. TRF erstellt zwei Videogenerierungspfade mithilfe eines vortrainierten Bild-zu-Video-Modells (SVD). Einer ist ein Vorwärtspfad, der auf dem Startbild basiert, und der andere ein Rückwärtspfad, der auf dem Endbild basiert. Beide Pfade beginnen am selben zufälliges GeräuschDies wird links im folgenden Bild veranschaulicht:

Vergleich bisheriger Ansätze zum FCVG. Quelle: https://arxiv.org/pdf/2412.11755

Die Autoren behaupten, dass FCVG eine Verbesserung gegenüber Zeitumkehrmethoden darstellt, da es die Mehrdeutigkeit bei der Videogenerierung reduziert, indem es jedem Frame seinen eigenen expliziten Zustand gibt, was zu einer stabileren und konsistenteren Ausgabe führt.

Zeitumkehrmethoden wie TRF können, so heißt es in dem Artikel, zu Mehrdeutigkeiten führen, da die Vorwärts- und Rückwärtserzeugungspfade auseinanderlaufen können, was zu Fehlausrichtungen oder Inkonsistenzen führt. FCVG behebt dieses Problem, indem es bildweise Bedingungen verwendet, die aus übereinstimmenden Linien zwischen den Start- und Endbildern (unten rechts im Bild oben) abgeleitet werden und den Erzeugungsprozess steuern.

Klicken Sie aufo spielen. Ein weiterer Vergleich von der FCVG-Projektseite.

Die Zeitumkehr ermöglicht die Verwendung vorab trainierter Videogenerierungsmodelle für das Inbetweening, hat aber einige Nachteile. Die von I2V-Modellen erzeugte Bewegung ist verschieden anstatt stabil. Dies ist zwar für reine Bild-zu-Video-Aufgaben (I2V) nützlich, führt jedoch zu Mehrdeutigkeiten und falsch ausgerichteten oder inkonsistenten Videopfaden.

Die Zeitumkehr erfordert außerdem eine aufwändige Abstimmung der Hyperparameter, wie etwa die Bildrate für jedes generierte Video. Darüber hinaus verlangsamen einige der Techniken zur Zeitumkehr zur Reduzierung von Mehrdeutigkeiten die Inferenz erheblich und erhöhen die Verarbeitungszeiten.

Methodik

Die Autoren stellen fest, dass, wenn das erste dieser Probleme (Vielfalt vs. Stabilität) gelöst werden kann, sich alle anderen nachfolgenden Probleme wahrscheinlich von selbst lösen werden. Dies wurde in früheren Veröffentlichungen wie dem oben erwähnten GI versucht, und auch ViBiDSampler.

Das Papier sagt:

"Dennoch besteht zwischen diesen Pfaden immer noch eine beträchtliche Stochastizität, was die Wirksamkeit dieser Methoden bei der Handhabung von Szenarien mit großen Bewegungen wie schnellen Änderungen der menschlichen Körperhaltung einschränkt. Die Mehrdeutigkeit des Interpolationspfads ergibt sich hauptsächlich aus unzureichenden Bedingungen für Zwischenbilder, da zwei Eingabebilder nur Bedingungen für Start- und Endbilder liefern.

„Daher schlagen wir vor, für jeden Frame eine explizite Bedingung anzubieten, die die Mehrdeutigkeit des Interpolationspfads erheblich verringert.“

Im folgenden Schema können wir die Kernkonzepte von FCVG in Aktion sehen. FCVG generiert eine Sequenz von Videobildern, die konsistent mit zwei Eingabebildern beginnen und enden. Dadurch wird sichergestellt, dass die Bilder zeitlich stabil sind, indem bildspezifische Bedingungen für den Videogenerierungsprozess bereitgestellt werden.

Schema zur Inferenz von FCVG.

Bei dieser Neuinterpretation des Zeitumkehransatzes kombiniert die Methode Informationen aus Vorwärts- und Rückwärtsrichtung und mischt sie, um sanfte Übergänge zu erzeugen. In einem iterativen Prozess verfeinert das Modell nach und nach verrauschte Eingaben, bis der endgültige Satz Zwischenbilder erstellt ist.

Der nächste Schritt besteht in der Verwendung der vorab trainierten Klebestift Line-Matching-Modell, das Korrespondenzen zwischen den beiden berechneten Start- und Endbildern erstellt, mit der optionalen Verwendung von Skelettposen zur Führung des Modells über das Stable Video Diffusion-Modell.

GlueStick leitet Linien aus interpretierten Formen ab. Diese Linien bieten passende Anker zwischen Start- und Endbildern in FCVG*.

Die Autoren bemerken:

„Wir haben empirisch herausgefunden, dass eine lineare Interpolation in den meisten Fällen ausreicht, um die zeitliche Stabilität in Zwischenvideos zu gewährleisten, und unsere Methode ermöglicht es Benutzern, nichtlineare Interpolationspfade zum Generieren der gewünschten [Videos] anzugeben.“

Der Workflow zum Festlegen von Vorwärts- und Rückwärtsbedingungen für einzelne Frames. Wir können die übereinstimmenden Farben sehen, die den Inhalt während der Entwicklung der Animation konsistent halten.

Um die erhaltenen Rahmenbedingungen in SVD einzuspeisen, verwendet FCVG die für die 2024 entwickelte Methode ControlNeXt Initiative. Dabei werden die Kontrollbedingungen zunächst durch mehrere ResNet Blöcke, vor der Kreuznormalisierung zwischen den Bedingungs- und SVD-Zweigen des Workflows.

Eine kleine Anzahl von Videos wird verwendet für Feintuning das SVD-Modell, wobei die meisten Parameter des Modells eingefroren.

„Die [vorgenannten Einschränkungen] wurden in FCVG weitgehend behoben: (i) Durch die explizite Angabe der Bedingung für jeden Frame wird die Mehrdeutigkeit zwischen Vorwärts- und Rückwärtspfaden erheblich verringert; (ii) Nur ein einstellbarer [Parameter wird eingeführt], während Hyperparameter in SVD als Standard beibehalten werden, was in den meisten Szenarien zu günstigen Ergebnissen führt; (iii) Eine einfache Durchschnittsfusion ohne erneute Rauscheinspeisung ist in FCVG ausreichend und die Inferenzschritte können im Vergleich zu [GI] erheblich um 50 % reduziert werden.“

Allgemeines Schema zum Einfügen von Frame-weisen Bedingungen in Stable Video Diffusion für FCVG.

Daten und Tests

Um das System zu testen, stellten die Forscher einen Datensatz zusammen, der verschiedene Szenen enthält, darunter Außenumgebungen, menschliche Posen und Innenräume, einschließlich Bewegungen wie Kamerabewegungen, Tanzaktionen und Gesichtsausdrücke, um nur einige zu nennen. Die ausgewählten 524 Clips stammen aus dem DAVIS und Immobilien10k Datensätze. Diese Sammlung wurde durch Videos mit hoher Bildrate von Pexels ergänzt. Das kuratierte Set war gespalten 4:1 zwischen Feinabstimmung und Testen.

Verwendete Metriken waren Erlernte Wahrnehmungsähnlichkeitsmetriken (LPIPS); Fréchet-Anfangsdistanz (FID); Fréchet Video Entfernung (FVD); VBencheschriebenen Art und Weise; und Fréchet Video Motion Distance.

Die Autoren weisen darauf hin, dass keine dieser Metriken gut geeignet ist, um die zeitliche Stabilität abzuschätzen, und verweisen auf die Videos auf der Projektseite von FCVG.

Neben der Verwendung von GlueStick für die Linienanpassung, DWPose wurde zur Schätzung menschlicher Körperhaltungen verwendet.

Feinabstimmungswerkzeug für 70,000 Iterationen unter dem AdamW Optimierer auf einer NVIDIA A800 GPU, mit einer Lernrate von 1×10-6, mit auf 512 × 320 Patches zugeschnittenen Frames.

Zuvor getestete konkurrierende Frameworks waren FILM, GI, TRF und DynamiCrafter.

Zur quantitativen Auswertung wurden zwischen 12 und 23 Frame-Lücken behoben.

Quantitative Ergebnisse im Vergleich zu früheren Rahmenbedingungen.

Zu diesen Ergebnissen stellt das Papier fest:

„[Unsere] Methode erzielt unter den vier generativen Ansätzen die beste Leistung in allen Metriken. Beim LPIPS-Vergleich mit FILM ist unser FCVG geringfügig unterlegen, zeigt aber in anderen Metriken eine bessere Leistung. Angesichts des Fehlens zeitlicher Informationen in LPIPS ist es möglicherweise angemessener, anderen Metriken und visueller Beobachtung den Vorzug zu geben.

„Darüber hinaus zeigt ein Vergleich der Ergebnisse bei unterschiedlichen Bildabständen, dass FILM bei kleinen Abständen gut funktioniert, während generative Methoden für große Abstände besser geeignet sind. Unter diesen generativen Methoden ist unser FCVG aufgrund seiner expliziten bildweisen Bedingungen deutlich überlegen.“

Für qualitative Tests haben die Autoren die Videos erstellt, die auf der Projektseite zu sehen sind (einige davon sind in diesen Artikel eingebettet), sowie statische und animierte† Ergebnisse im PDF-Dokument,

Beispiele für statische Ergebnisse aus dem Dokument. Für eine bessere Auflösung verweisen wir auf das Quell-PDF. Beachten Sie, dass das PDF Animationen enthält, die in Anwendungen abgespielt werden können, die diese Funktion unterstützen.

Die Autoren kommentieren:

„Während FILM bei kleinen Bewegungsszenarien glatte Interpolationsergebnisse liefert, hat es bei großen Bewegungen aufgrund inhärenter Einschränkungen des optischen Flusses Probleme, was zu sichtbaren Artefakten wie Hintergrund- und Handbewegungen (im ersten Fall) führt.“

„Generative Modelle wie TRF und GI leiden unter Mehrdeutigkeiten in den Fusionspfaden, die zu instabilen Zwischenbewegungen führen, was insbesondere in komplexen Szenen mit Menschen- und Objektbewegungen deutlich wird.“

Im Gegensatz dazu liefert unsere Methode in verschiedenen Szenarien durchweg zufriedenstellende Ergebnisse. „Selbst bei erheblicher Okklusion (im zweiten und sechsten Fall) kann unsere Methode immer noch sinnvolle Bewegungen erfassen. Darüber hinaus ist unser Ansatz robust gegenüber komplexen menschlichen Handlungen (im letzten Fall).“

Die Autoren stellten außerdem fest, dass sich FCVG ungewöhnlich gut auf Animationsvideos übertragen lässt:

Anklicken um abzuspielen. FCVG liefert sehr überzeugende Ergebnisse bei Animationen im Cartoon-Stil.

Fazit

FCVG stellt zumindest eine inkrementelle Verbesserung des Stands der Technik in der Frame-Interpolation in einem nicht-proprietären Kontext dar. Die Autoren haben den Code für die Arbeit verfügbar auf GitHub, obwohl der zugehörige Datensatz zum Zeitpunkt des Schreibens noch nicht veröffentlicht wurde.

Wenn proprietäre kommerzielle Lösungen Open-Source-Bemühungen durch die Verwendung von nicht lizenzierten, aus dem Web Scraping gewonnenen Daten übertreffen, scheint dieser Ansatz zumindest für die kommerzielle Nutzung nur eine begrenzte oder gar keine Zukunft zu haben; die Risiken sind schlicht zu groß.

Auch wenn die Open-Source-Szene also hinter den beeindruckenden Leistungen der derzeitigen Marktführer zurückbleibt, ist sie wohl die Schildkröte, die den Hasen über die Ziellinie jagen könnte.

* Quelle: https://openaccess.thecvf.com/content/ICCV2023/papers/Pautrat_GlueStick_Robust_Image_Matching_by_Sticking_Points_and_Lines_Together_ICCV_2023_paper.pdf

† Erfordert Acrobat Reader, Okular oder einen anderen PDF-Reader, der eingebettete PDF-Animationen wiedergeben kann.

Erstveröffentlichung Freitag, 20. Dezember 2024