Künstliche Intelligenz

Bessere KI-Videos aus nur zwei Bildern generieren

Video Frame Interpolation (VFI) ist ein offenes Problem in der generativen Video-Forschung. Die Herausforderung besteht darin, Zwischenframes zwischen zwei bestehenden Frames in einer Video-Sequenz zu generieren.

Bitte klicken, um abzuspielen. Das FILM-Framework, eine Zusammenarbeit zwischen Google und der University of Washington, schlägt eine effektive Frame-Interpolationsmethode vor, die in Hobbyist- und professionellen Kreisen beliebt ist. Auf der linken Seite können wir die zwei getrennten und unterschiedlichen Frames überlagert sehen; in der Mitte den ‘Endframe’; und auf der rechten Seite die endgültige Synthese zwischen den Frames. Quellen: https://film-net.github.io/ und https://arxiv.org/pdf/2202.04901

Im Allgemeinen geht diese Technik auf über ein Jahrhundert zurück und wurde in der traditionellen Animation seitdem verwendet. In diesem Zusammenhang wurden Master-‘Keyframes’ von einem Haupt-Animationskünstler erstellt, während die Arbeit der ‘Tweening’-Zwischenframes von anderen Mitarbeitern als eher untergeordnete Aufgabe durchgeführt wurde.

Vor dem Aufkommen von generativer KI wurde Frame-Interpolation in Projekten wie Real-Time Intermediate Flow Estimation (RIFE), Depth-Aware Video Frame Interpolation (DAIN) und Googles Frame Interpolation for Large Motion (FILM – siehe oben) für die Zwecke der Erhöhung der Bildfrequenz eines bestehenden Videos oder zur Erzeugung künstlich generierter Zeitlupeneffekte verwendet. Dies wird erreicht, indem die bestehenden Frames eines Clips aufgeteilt und geschätzte Zwischenframes generiert werden.

VFI wird auch bei der Entwicklung besserer Video-Codecs und allgemeiner in optical flow-basierten Systemen (einschließlich generativer Systeme) verwendet, die im Voraus Kenntnisse über kommende Keyframes nutzen, um den Zwischeninhalt zu optimieren und zu formen, der ihnen vorausgeht.

Endframes in generativen Video-Systemen

Moderne generative Systeme wie Luma und Kling ermöglichen es Benutzern, einen Start- und einen Endframe zu spezifizieren und können diese Aufgabe durch die Analyse von Schlüsselpunkten in den beiden Bildern und die Schätzung einer Traektorie zwischen den beiden Bildern ausführen.

Wie wir in den folgenden Beispielen sehen können, ermöglicht die Bereitstellung eines ‘abschließenden’ Keyframes dem generativen Video-System (in diesem Fall Kling) besser, Aspekte wie Identität beizubehalten, auch wenn die Ergebnisse nicht perfekt sind (insbesondere bei großen Bewegungen).

Bitte klicken, um abzuspielen. Kling ist eines von vielen Video-Generatoren, darunter Runway und Luma, die es dem Benutzer ermöglichen, einen Endframe zu spezifizieren. In den meisten Fällen führt minimale Bewegung zu den realistischsten und wenigsten fehlerhaften Ergebnissen. Quelle: https://www.youtube.com/watch?v=8oylqODAaH8

In dem obigen Beispiel ist die Identität der Person zwischen den beiden vom Benutzer bereitgestellten Keyframes konsistent, was zu einer relativ konsistenten Video-Generierung führt.

Wenn nur der Startframe bereitgestellt wird, ist das Fenster der Aufmerksamkeit des generativen Systems normalerweise nicht groß genug, um sich zu ‘erinnern’, wie die Person am Anfang des Videos aussah. Stattdessen ist die Identität wahrscheinlich ein wenig mit jedem Frame zu verschwimmen, bis alle Ähnlichkeit verloren geht. In dem folgenden Beispiel wurde ein Startbild hochgeladen und die Bewegung der Person durch einen Text-Prompt gesteuert:

Bitte klicken, um abzuspielen. Ohne Endframe hat Kling nur eine kleine Gruppe von direkt vorherigen Frames, um die Generierung der nächsten Frames zu leiten. In Fällen, in denen eine signifikante Bewegung erforderlich ist, wird diese Atrophie der Identität stark.

Wir können sehen, dass die Ähnlichkeit des Schauspielers nicht widerstandsfähig gegenüber den Anweisungen ist, da das generative System nicht weiß, wie er aussehen würde, wenn er lächeln würde, und er in dem Saatbild (der einzigen verfügbaren Referenz) nicht lächelt.

Die Mehrheit der viralen generativen Clips ist sorgfältig kuratiert, um diese Mängel herunterzuspielen. Die Fortschritte bei temporally konsistenten generativen Video-Systemen hängen jedoch möglicherweise von neuen Entwicklungen im Forschungsbereich im Hinblick auf Frame-Interpolation ab, da die einzige mögliche Alternative eine Abhängigkeit von traditioneller CGI als ‘Leit’-Video (und sogar in diesem Fall sind Konsistenz von Textur und Beleuchtung derzeit schwer zu erreichen) ist.

Darüber hinaus macht die schrittweise Natur der Ableitung eines neuen Frames aus einer kleinen Gruppe von kürzlich erstellten Frames es sehr schwierig, große und kühne Bewegungen zu erreichen. Dies liegt daran, dass ein Objekt, das sich schnell über einen Frame bewegt, von einer Seite zur anderen in dem Raum von einem einzigen Frame conträr zu den allmählicheren Bewegungen sein kann, auf denen das System wahrscheinlich trainiert wurde.

Ebenso kann eine signifikante und kühne Änderung der Pose nicht nur zu einer Identitätsverschiebung, sondern auch zu lebhaften Unstimmigkeiten führen:

Bitte klicken, um abzuspielen. In diesem Beispiel von Luma scheint die angeforderte Bewegung nicht gut in den Trainingsdaten vertreten zu sein.

Framer

Dies bringt uns zu einem interessanten aktuellen Paper aus China, das behauptet, einen neuen Stand der Technik in authentisch aussehender Frame-Interpolation erreicht zu haben – und das als erstes seiner Art eine drag-basierte Benutzeroberfläche bietet.

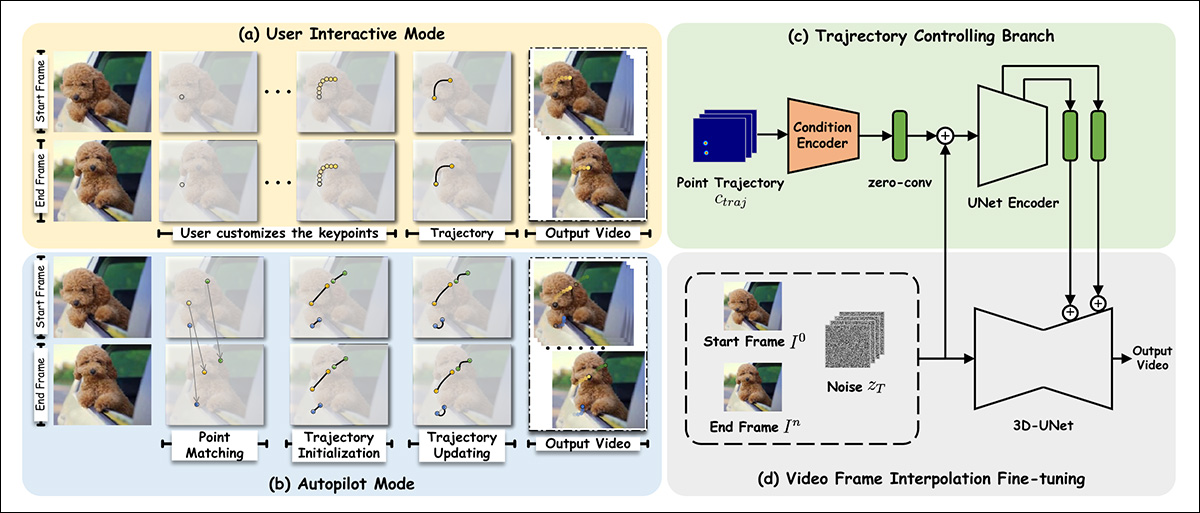

Framer ermöglicht es dem Benutzer, die Bewegung mithilfe einer intuitiven drag-basierten Oberfläche zu steuern, obwohl es auch einen ‘Automatik’-Modus gibt. Quelle: https://www.youtube.com/watch?v=4MPGKgn7jRc

Drag-zentrierte Anwendungen sind häufig in der Literatur in letzter Zeit, da der Forschungsbereich versucht, Instrumentalitäten für generative Systeme bereitzustellen, die nicht auf den ziemlich groben Ergebnissen basieren, die durch Text-Prompts erhalten werden.

Das neue System, betitelt Framer, kann nicht nur der benutzergeführten Drag-Funktion folgen, sondern verfügt auch über einen herkömmlicheren ‘Autopilot’-Modus. Neben der konventionellen Tweening ist das System in der Lage, Zeitraffer-Simulationen, Morphing und neue Ansichten des Eingabebildes zu produzieren.

Zwischenframes, die für eine Zeitraffer-Simulation in Framer generiert wurden. Quelle: https://arxiv.org/pdf/2410.18978

In Bezug auf die Erzeugung neuer Ansichten überschneidet sich Framer ein wenig mit dem Gebiet der Neuralen Radiance-Felder (NeRF) – obwohl nur zwei Bilder erforderlich sind, während NeRF normalerweise sechs oder mehr Bild-Eingangsansichten erfordert.

In Tests konnte Framer, das auf Stability.ai’s Stable Video Diffusion latenter Diffusions-generatives Video-Modell basiert, rivalisierende Ansätze überbieten, in einer Benutzerstudie.

Zum Zeitpunkt des Schreibens ist der Code zum Veröffentlichen auf GitHub geplant. Video-Beispiele (von denen die oben genannten Bilder abgeleitet sind) sind auf der Projekt-Website verfügbar, und die Forscher haben auch ein YouTube-Video veröffentlicht.

Das neue Paper ist betitelt Framer: Interaktive Frame-Interpolation und stammt von neun Forschern aus der Zhejiang-Universität und der Alibaba-gestützten Ant-Gruppe.

Methode

Framer verwendet keypoint-basierte Interpolation in einer seiner beiden Modalitäten, wobei das Eingabebild auf seine grundlegende Topologie ausgewertet wird und ‘bewegliche’ Punkte zugewiesen werden, wo notwendig. Im Wesentlichen sind diese Punkte äquivalent zu Gesichts-Landmarken in ID-basierten Systemen, aber verallgemeinern sich auf jede Oberfläche.

Die Forscher feinabgestimmt Stable Video Diffusion (SVD) auf dem OpenVid-1M-Dataset, mit einer zusätzlichen letzten Frame-Synthese-Fähigkeit. Dies ermöglicht einen Traektorie-Steuermechanismus (oben rechts im Schema-Bild unten), der einen Pfad zur Endframe (oder zurück) auswerten kann.

Schema für Framer.

In Bezug auf die Hinzufügung der letzten Frame-Bedingung erklären die Autoren:

‘Um die visuelle Vorgabe des vorgefertigten SVD so weit wie möglich zu bewahren, folgen wir dem Konditionierungsparadigma von SVD und injizieren Endframe-Bedingungen im latenten Raum und semantischen Raum.’

‘Insbesondere konkateneren wir das VAE-codierte latente Merkmal des ersten [Frames] mit dem verrauschten latenten des ersten Frames, wie in SVD. Zusätzlich konkateneren wir das latente Merkmal des letzten Frames, zn, mit dem verrauschten latenten des Endframes, unter Berücksichtigung, dass die Bedingungen und die entsprechenden verrauschten Latente räumlich ausgerichtet sind. ‘

‘Darüber hinaus extrahieren wir die CLIP-Bild-Einbettung des ersten und letzten Frames getrennt und konkateneren sie für die Kreuz-Aufmerksamkeits-Feature-Injektion.’

Für die drag-basierte Funktionalität nutzt das Traektorie-Modul den Meta Ai-geführten CoTracker-Rahmen, der eine Vielzahl von möglichen Pfaden auswertet. Diese werden auf 1-10 mögliche Traektorien reduziert.

Die erhaltenen Punktkoordinaten werden dann durch eine Methodik transformiert, die von den DragNUWA– und DragAnything-Architekturen inspiriert ist. Dies ergibt eine Gauß-Heatmap, die die Zielbereiche für die Bewegung individuiert.

Anschließend werden die Daten an die Konditionierungsmechanismen von ControlNet gefüttert, einem Hilfs-Konformitätssystem, das ursprünglich für Stable Diffusion entwickelt und seitdem an andere Architekturen angepasst wurde.

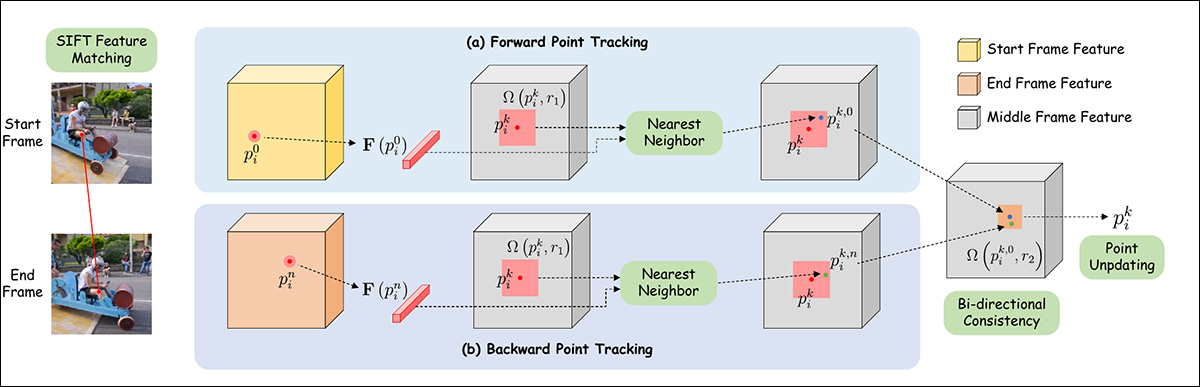

Für den Autopilot-Modus wird die Feature-Übereinstimmung zunächst durch SIFT erreicht, das eine Traektorie interpretiert, die dann an einen auto-aktualisierenden Mechanismus weitergegeben werden kann, der von DragGAN und DragDiffusion inspiriert ist.

Schema für die Punktraektorie-Schätzung in Framer.

Daten und Tests

Für die Feinabstimmung von Framer wurden die räumliche Aufmerksamkeit und die Restblöcke eingefroren, und nur die temporalen Aufmerksamkeitsschichten und Restblöcke wurden beeinflusst.

Das Modell wurde für 10.000 Iterationen unter AdamW trainiert, bei einer Lernrate von 1e-4 und einer Batch-Größe von 16. Die Trainingszeit fand auf 16 NVIDIA A100-GPUs statt.

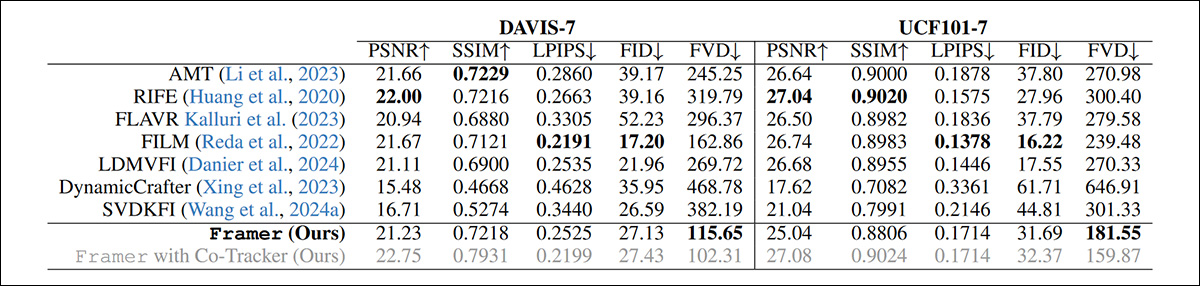

Da vorherige Ansätze für das Problem keine drag-basierte Bearbeitung bieten, entschieden sich die Forscher, den Autopilot-Modus von Framer mit der Standardfunktion älterer Angebote zu vergleichen.

Die getesteten Frameworks für die Kategorie der aktuellen diffusionsbasierten Video-Generierungssysteme waren LDMVFI; Dynamic Crafter; und SVDKFI. Für ‘traditionelle’ Video-Systeme waren die rivalisierenden Frameworks AMT; RIFE; FLAVR; und das oben erwähnte FILM.

Neben der Benutzerstudie wurden Tests auf den DAVIS– und UCF101-Datasets durchgeführt.

Qualitative Tests können nur durch die objektiven Fähigkeiten des Forschungsteams und durch Benutzerstudien bewertet werden. Die Arbeit vermerkt jedoch, dass traditionelle quantitative Metriken größtenteils nicht geeignet sind, um die Qualität der interpolierten Frames genau zu erfassen:

‘[Rekonstruktions-]Metriken wie PSNR, SSIM und LPIPS bestrafen andere plausible Interpolations-Ergebnisse, die nicht pixelgenau mit dem Original-Video übereinstimmen, und erfassen somit die Qualität der interpolierten Frames nicht genau.’

‘Während Generierungs-Metriken wie FID einige Verbesserungen bieten, sind sie immer noch unzureichend, da sie die zeitliche Konsistenz nicht berücksichtigen und Frames isoliert bewerten.’

Trotzdem führten die Forscher qualitative Tests mit mehreren beliebten Metriken durch:

Quantitative Ergebnisse für Framer im Vergleich zu rivalisierenden Systemen.

Die Autoren bemerken, dass Framer trotz der ungünstigen Umstände den besten FVD-Score unter den getesteten Methoden erzielt.

Unten finden Sie die Beispiele der Arbeit für einen qualitativen Vergleich:

Qualitativer Vergleich mit früheren Ansätzen. Bitte beachten Sie, dass Sie sich auf das Paper beziehen sollten, um eine bessere Auflösung sowie Video-Ergebnisse unter https://www.youtube.com/watch?v=4MPGKgn7jRc zu erhalten.