Andersons Blickwinkel

Mit KI verbessern von echten Fotos, bevor sie gemacht werden

Statt GenAI zu verwenden, um Fotos nach dem Shooting zu korrigieren, haben Forscher ein System trainiert, das Ihnen sagt, wie Sie sich bewegen, posieren und den Schuss vorher einstellen sollen, unter Verwendung von studiertem Wissen darüber, was Fotos unvergesslich macht.

Das Korrigieren von Fotos nachträglich ist bereits seit geraumer Zeit einfacher geworden, da Hersteller und Technologieplattformen zunehmend eine Kamera-Editierung in der Kamera anbieten, die es Benutzern ermöglicht, Bilder sofort nach dem Aufnehmen zu ändern. Beliebte Systeme dieser Art umfassen Google’s konversationale Editierung und Samsung’s generative Editierung sowie andere.

Allerdings könnte eine neue Trendwende, die “Authentizität” über AI-verbesserte Ergebnisse bevorzugt, dazu führen, dass viele der Verbraucher, auf die sich solche Systeme richten, “veränderte” Fotos als AI-Slop ansehen.

Vielleicht ist dies der Grund, warum Google einen AI-gestützten “Kamera-Coach” entwickelt hat, der von Gemini informiert wird und in der Lage ist, direkte Anweisungen zur Verbesserung eines Fotos während des Aufnahmeprozesses zu geben:

Google’s Camera Coach sagt dem Benutzer, wie er ein Foto neu einstellen soll, sowie andere grundlegende Ratschläge. Quelle

Als proprietäres System und mit praktisch keiner Informationen online in Bezug auf es, scheint Camera Coach Gemini zu nutzen, um Benutzern zu helfen, die Einstellung (siehe Bild oben) oder kleine Änderungen in der Haltung (wie z.B. näher zusammenzustehen oder direkt in die Kamera zu schauen) vorzunehmen.

So weit wie irgendjemand sagen kann, drängt das Produkt die Komposition in Richtung Median, vermutlich basierend auf Millionen von hochgeladenen Datenpunkten, die wahrscheinlich zur Trainingsdaten von Gemini beigetragen haben. In diesem Sinne haben die hochladenden Benutzer die Kalibrierung der KI durch Ablehnen unzureichender Aufnahmen und Hochladen derjenigen, die sie mögen, erstellt – eine effektive (und kostenlose) Form der Datensatzkuratierung!

Das gesagt, Fotos, die ausgemittelt sind, was die Komposition betrifft, besitzen nicht unbedingt dieselben ästhetischen Werte oder die gleiche Wirkung auf den Betrachter wie Fotos, die unvergesslich sind.

Jenseits von “Cheese!” und dem Drittel-Regel

In diesem Zusammenhang und für ein System, das über Plattformen hinweg zugänglicher ist, bietet eine neue Forschung aus Italien ein Coach-ähnliches System, das auf vorherigem Wissen darüber basiert, was Fotos im Gedächtnis haften lässt:

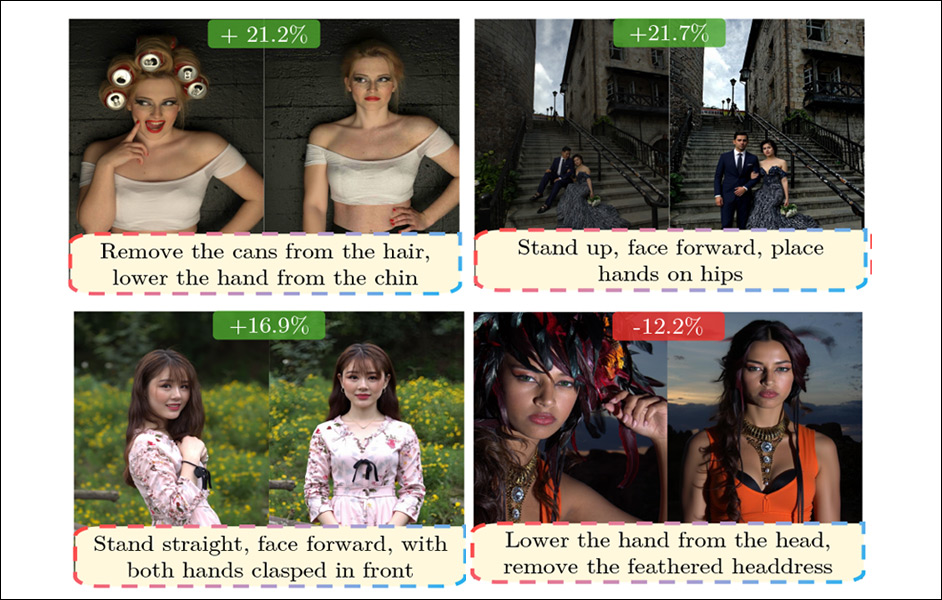

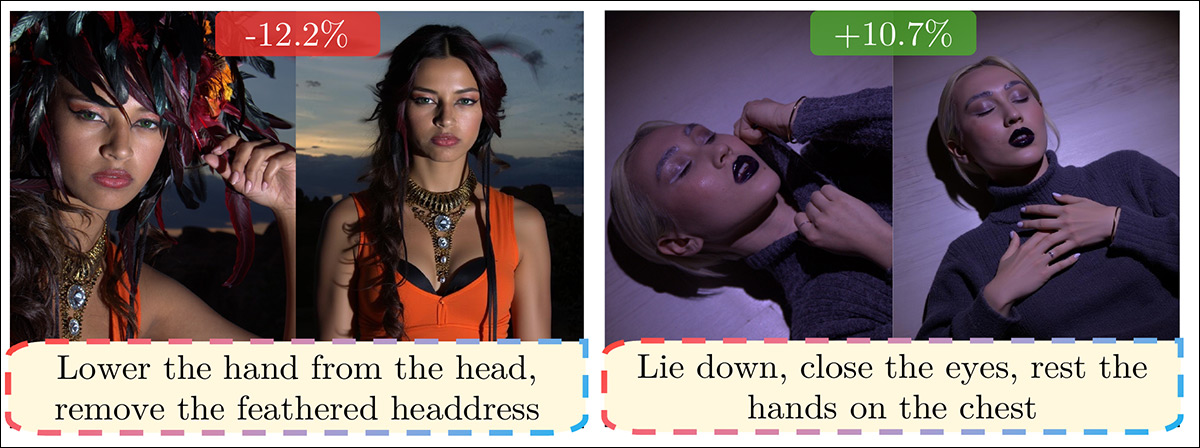

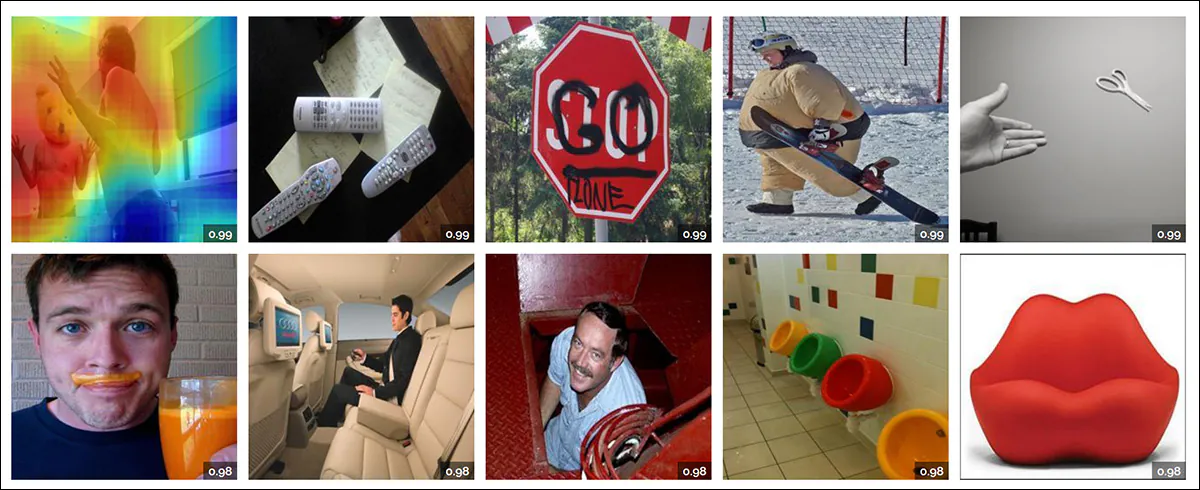

Weitreichende Beispiele für Ratschläge aus dem neuen System. Quelle

In den obigen Beispielen sehen wir Ratschläge, die von den Autoren des neuen Systems – genannt MemCoach – gegeben werden, die es schwer vorstellbar ist, dass ein kompositionszentrierter KI wie Camera Coach sie liefern könnte. Im ersten (links) Fall ist der Ratschlag, den Kopfschmuck zu entfernen, besonders spezifisch; im zweiten Bild ist es schwer vorstellbar, was ein konventioneller Kontext für eine “künstlerische” Aufnahme einer jungen Frau, die auf dem Boden liegt und die Augen geschlossen hat, sein könnte.

Das Kernverständnis über Erinnerungswert in der Fotografie, das zur Entwicklung des dreiteiligen italienischen Systems verwendet wurde, stammt aus verschiedenen vorherigen Arbeiten, einschließlich der 2015 Veröffentlichung Was macht ein Objekt erinnerungswert? und der 2013 Veröffentlichung Was macht ein Foto erinnerungswert?.

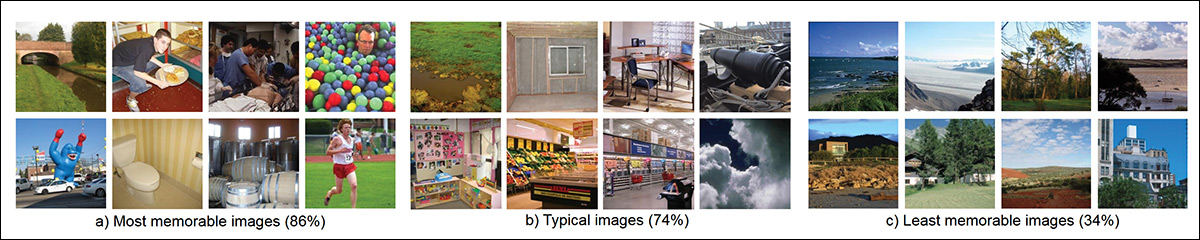

Aus der 2013er Veröffentlichung What makes a photograph memorable?, repräsentative Beispiele für gute, mittlere und schlechte Fotos im Hinblick auf Erinnerungswert. Quelle

Jeder, wie ich, mit einem negativen Unix-Geburtsdatum, wird wahrscheinlich das Template für “am wenigsten erinnerungswerte Bilder” (oben rechts im Bild) von den endlosen Dia-Abenden wiedererkennen, die unsere Kindheit verflucht haben. Wie die Autoren angeben*:

‘Diese Arbeiten identifizierten wichtige intrinsische Faktoren wie die Anwesenheit von Menschen, Innenraumszenen oder emotionale Ausdrücke, anstatt Objekte und panoramatische Ansichten, sowie extrinsische Faktoren, einschließlich Kontext und Beobachter. ‘

Das Projekt konzentriert sich auf “Erinnerungswert-Rückmeldung” (MemFeed), die im MemCoach-Tutoren-Anwendung ausgedrückt wird, und eine Benchmark (mit dem Titel MemBench) basierend auf dem PPR10K-Datensatz.

Aus der Veröffentlichung PPR10K: A Large-Scale Portrait Photo Retouching Dataset with Human-Region Mask and Group-Level Consistency, diverse Beispiele aus dem Datensatz. Die oberste Zeile zeigt die ursprünglichen Bilder, die unterste Zeile zeigt die von Experten retuschierten Versionen zusammen mit den entsprechenden Human-Region-Masken. Die ursprünglichen Fotos variieren stark in Blickwinkel, Hintergrund, Beleuchtung und Kameraeinstellungen, während die retuschierten Ergebnisse eine verbesserte visuelle Qualität und eine stärkere Konsistenz innerhalb jeder Gruppe zeigen. Quelle

Die Veröffentlichung beobachtet, dass Erinnerungswert in Fotos quantifizierbar ist, anstatt ein Register subjektiver Urteile zu sein, und die Autoren bemerken weiter, dass diese Eigenschaft sowohl für Fotos (in verschiedenen Arbeiten) als auch für Videos (in verschiedenen anderen) identifiziert wurde.

Die neue Veröffentlichung trägt den Titel Wie macht man ein erinnerungswertes Foto? Benutzer mit handlungsfähiger Rückmeldung befähigen und stammt von vier Forschern der Universität Trento, der Universität Pisa und der Fondazione Bruno Kessler. Die begleitende Projektseite legt nahe, dass GitHub-Code und Hugging-Face-gehostete Daten nächsten Monat (März 2026) verfügbar sein werden.

Methode

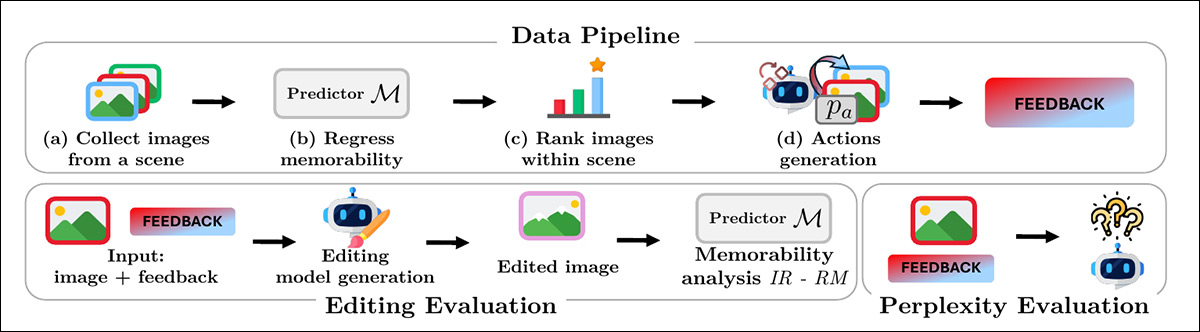

Um den MemBench-Datensatz aus dem Quell-PPR10K-Porträt-Datensatz zu kuratieren, gruppieren die Forscher Fotos aus der gleichen Szene und bewerten jedes Bild nach Erinnerungswert mithilfe eines trainierten Prädiktors, der auf CLIP Funktionen basiert. Sie ordnen dann die Fotos innerhalb jeder Szene von weniger zu mehr erinnerungswert und paaren sie entsprechend:

Überblick über die Konstruktion und Bewertung von MemBench. Die oberste Zeile zeigt die Datenpipeline, von der Gruppierung von Bildern nach Szene und der Vorhersage von Erinnerungswert bis zur Rangordnung von Fotos und der Generierung von erinnerungswertorientierter Handlungsanweisung. Die unterste Zeile zeigt die Bewertung, bei der die Qualität der Handlungsanweisung durch editierungsbezogene Erinnerungsgewinne und Perplexitätsscores gemessen wird.

Für jedes Paar werden natürliche Sprachbeschreibungen mit dem InternVL3.5-Modell generiert, um die sichtbaren Unterschiede zwischen der weniger erinnerungswerten Version und der erinnerungswertigeren Version zu erklären; und diese Beschreibungen würden das Trainingsignal für das erinnerungswertorientierte Feedback-System bilden.

Im Gegensatz zur Art von Logik, die die Grundlage von Google’s Camera Coach bildet, suchten die Forscher nach einer subtileren Interpretation†:

‘Im Gegensatz zu computergestützten Fotokorrekturen, die sich auf nachträgliche Korrekturen konzentrieren (z.B. “Machen Sie das Bild heller”), konzentrieren wir uns auf semantische Aktionen, die ein Benutzer auf-the-fly für einen besseren Schuss ausführen kann, z.B. “Blicken Sie sich an”.’

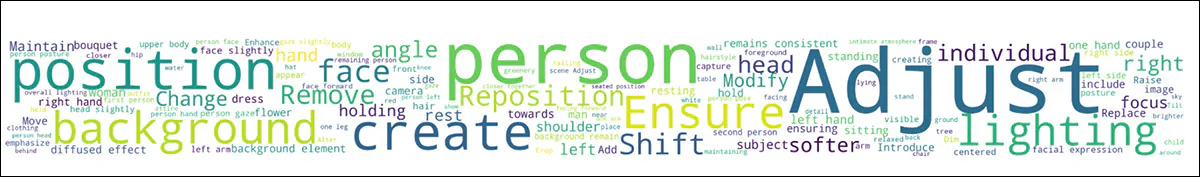

Die endgültige MemBench-Sammlung umfasst etwa 10.000 Bilder, die in 1.570 Szenen gruppiert sind, mit durchschnittlich 6,5 Bildern pro Szene. Die Wortwolke, die die Autoren generiert haben (siehe Bild unten), legt nahe, dass es eine breite Palette semantischer Kategorien im Datensatz gibt:

Eine Wortwolke der häufigsten Begriffe in MemBench.

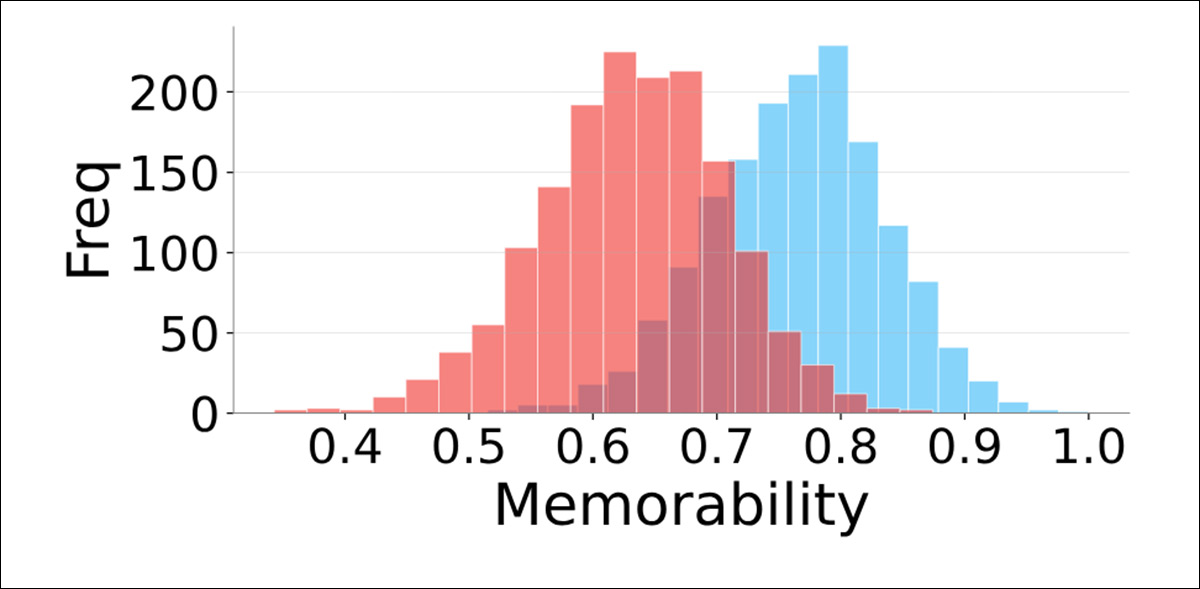

Die Quellbilder hatten im Durchschnitt einen Erinnerungswert von 0,63, während die erinnerungswertigsten Aufnahmen aus der gleichen Szene von 0,51 bis 1,0 reichten, mit deutlicher Überlappung zwischen den beiden Gruppen:

Verteilung der Erinnerungswert-Scores bei Vergleich der am wenigsten und erinnerungswertigsten Bilder innerhalb jeder Szene.

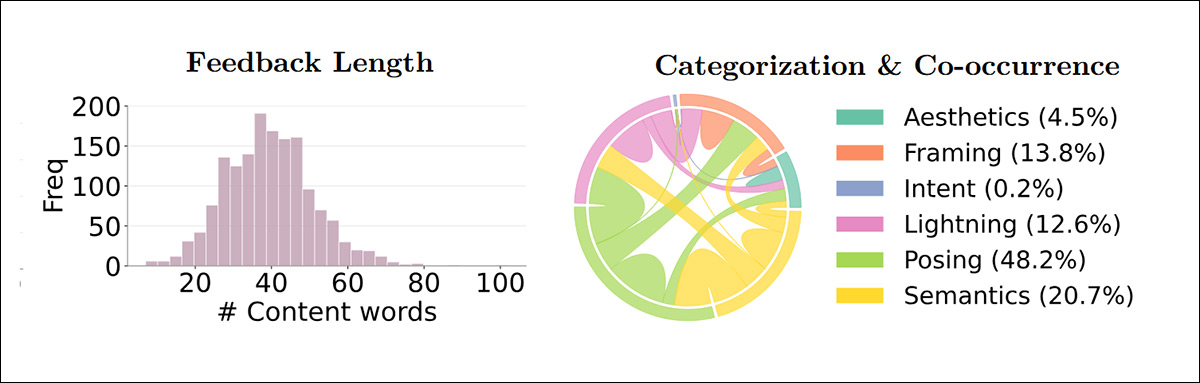

Die Rückmeldung selbst reichte von kurzen sieben-Wort-Notizen bis hin zu bemerkenswert längeren Anweisungen (links im Bild unten). Jeder Ratschlag wurde dann in kleine Aktionstypen unterteilt, indem GPT-5 Mini verwendet wurde (rechts im Bild unten):

Verteilung der Länge der Rückmeldungen in Inhaltswörtern und Kategorisierung von atomaren Teilaktionen mit Akkordbreiten, die die Häufigkeit der Koexistenz zwischen Kategorien anzeigen.

Die Autoren bemerken, dass die meisten Vorschläge sich auf die Pose des Subjekts konzentrierten, gefolgt von Änderungen der Bedeutung oder des Szeneninhalt, wobei die Einstellung oft mit der Pose und die Beleuchtungsanpassungen häufig mit semantischen Änderungen verknüpft waren.

Flux-Kapazitor

Um zu bewerten, ob die Erinnerungswert durch die Rückmeldung erhöht wurde, wurde die Benutzerkonformität durch die Verwendung des FLUX.1 Kontext-Modells simuliert, als Proxy für den Fotografen. Für jedes Quellbild und eine textuelle Rückmeldung wurde eine bearbeitete Version durch Flux generiert, die die vorgeschlagenen Änderungen simuliert:

Die Bilder links sind echt, aus dem Datensatz, und die Bilder rechts (in jedem Fall) sind durch Flux erstellt, basierend auf dem Prompt (in Gelb, unten). Auf diese Weise konnte die Wirksamkeit der Prompts ohne umfangreiche menschliche Beteiligung bewertet werden. Diese Kenntnisse würden letztendlich in das MemCoach-Framework einfließen und stellen tatsächlich einen Arbeitsablauf dar, der ein System dieser Art (d.h. letztendlich mit realen und nicht mit Flux-Beispielen) iterativ verbessern könnte.

Sowohl das Original- als auch das bearbeitete Bild wurden dann durch einen Erinnerungswert-Prädiktor geleitet, um zu messen, wie oft die bearbeitete Version einen höheren Score erreichte – bezeichnet als Verbesserungsverhältnis – und wie groß der Gewinn im Vergleich zum Ausgangsbild war, bezeichnet als Relativer Erinnerungswert.

Die Ähnlichkeit mit erinnerungswertorientierter Referenzrückmeldung wurde auch durch Berechnung der Perplexität gegen die Ground-Truth-Beschreibungen gemessen, und eine 80–20-Aufteilung wurde auf Szeneebene angewendet, so dass die Tests nur auf Szenen durchgeführt wurden, die nicht während des Trainings verwendet wurden.

Stand der Technik

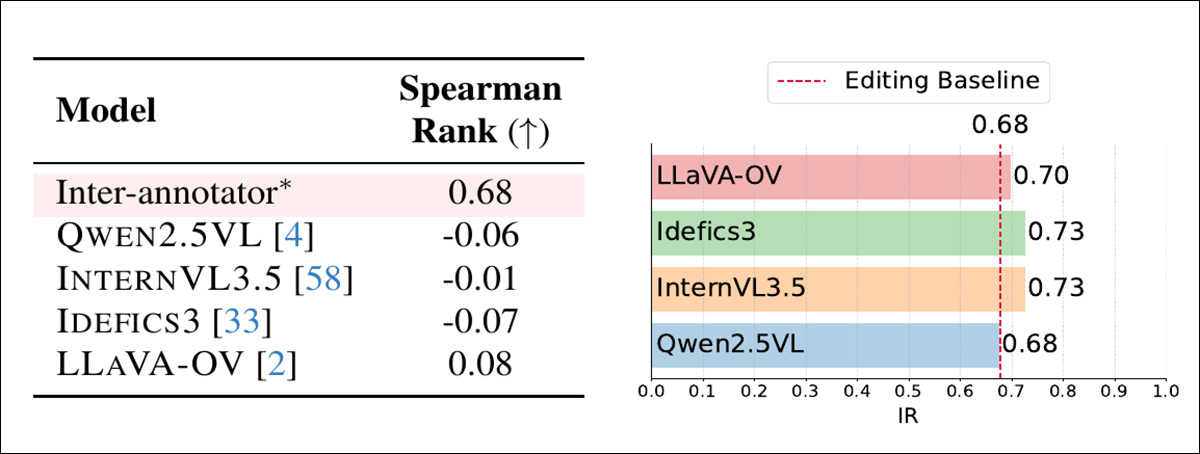

Die Erinnerungswert-Awareness aktueller multimodaler Großsprachmodelle wurde getestet. Bilder aus dem LaMem-Datensatz wurden mehreren führenden Modellen gezeigt, die gefragt wurden, ob das Bild erinnerungswert ist. Die Schätzung der Modellzuversicht wurde dann mit den Scores verglichen, die von menschlichen Betrachtern in der ursprünglichen Studie zugewiesen wurden:

Tests, die zeigen, dass Basismodelle multimodaler Sprachmodelle den Erinnerungswert nicht erfassen. Links, Spearman-Rangkorrelation zwischen Modellprädiktionen und LaMem-Ground-Truth-Scores, mit Interannotator-Übereinstimmung aus LaMem als Referenz. Rechts, Verbesserungsverhältnis, das durch Zero-Shot-Rückmeldung im Vergleich zur Editierungsgrundlinie erreicht wird, mit nur marginalen Gewinnen.

Es wurde fast keine bedeutungsvolle Korrelation mit menschlichen Urteilen gefunden, und trotz großer Vortrainings behaupten die Autoren, dass die Modelle nicht das verfolgten, was Menschen konsistent merken.

Beispiele aus dem LaMem-Datensatz. Oben links sehen wir auch eine Heatmap für dieses Bild. Quelle

MemCoach

MemCoach konzentriert sich auf semantische, auf-the-fly-Anweisungen, die vor dem Drücken des Auslösers durchgeführt werden können – zum Beispiel, die Pose anzupassen, die Interaktionen zwischen Subjekten zu ändern oder Szenenelemente zu modifizieren. Die Rückmeldung, die von MemCoach bereitgestellt wird, variiert von 7 bis 102 Inhaltswörtern. Erinnerungswert, so die Veröffentlichung, scheint mehr von der Konfiguration des Subjekts und narrativen Hinweisen als von einfachen kompositorischen Anpassungen angetrieben zu werden:

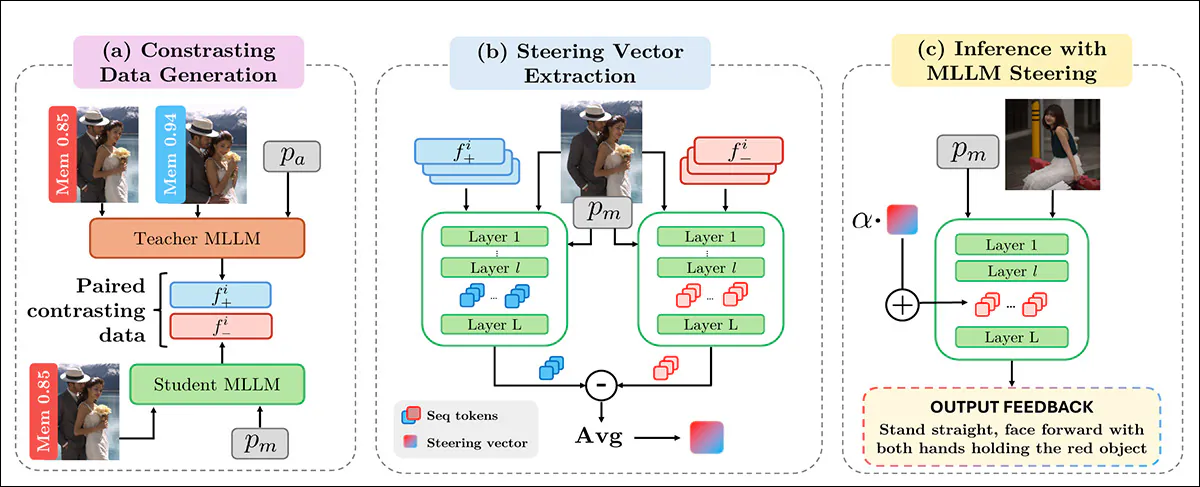

Überblick über die MemCoach-Pipeline, bei der erinnerungswertorientierte Anweisungen von einem Lehrer-MLLM mit neutralen Schülerantworten kombiniert werden, um kontrastierende Daten zu bilden; Aktivierungsunterschiede über Schichten werden gemittelt, um einen Erinnerungswert-Lenkvektor abzuleiten; und dieser Vektor wird bei der Inferenz injiziert, um die Schüleraktivierungen in Richtung der Produktion von verbesserten, erinnerungswertorientierten Rückmeldungen, ohne zusätzliches Training, zu verschieben.

Tests

Sieben multimodale Großsprachmodelle (MLLMs) wurden in der Testphase für das neue System verwendet: Qwen2.5V.L; InternVL3_5-8B; Idefics3-8B; und LLaVA-OneVision-1.5. Zusätzlich wurde GPT-5 Mini als Repräsentant für proprietäre, geschlossene Modelle einbezogen, zusammen mit dem ästhetikspezialisierten Q-Instruct und AesExpert-Modell. Die MLLMs operierten verschieden als Zero-Shot- und Lehrer-Orakel.

InternVL3.5 wurde sowohl für das Lehrer- als auch für das Schülermodell verwendet, wobei der MemBench-Trainingsaufteilung verwendet wurde, um kontrastierende Beispiele zu erstellen:

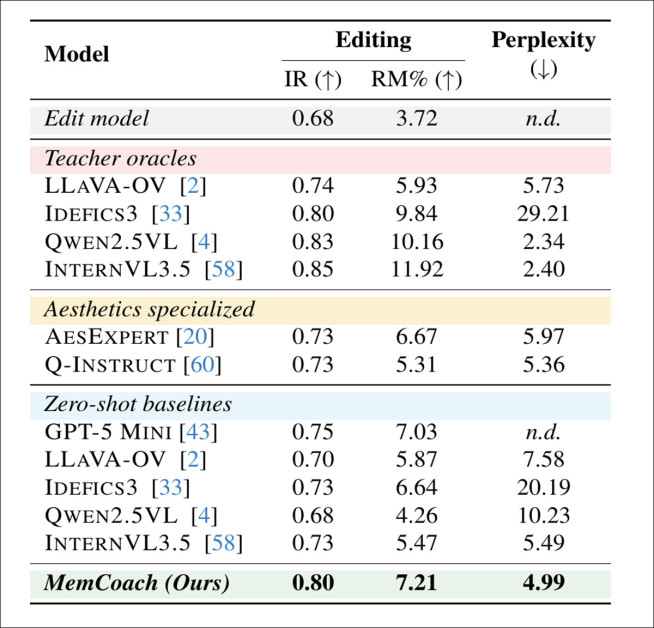

MemCoach-Leistung im Vergleich zu State-of-the-Art-MLLMs über Lehrer-Orakel, ästhetikspezialisierte Modelle und Zero-Shot-Grundlinien, mit höherem Verbesserungsverhältnis und wettbewerbsfähigem relativen Erinnerungswert sowie der niedrigsten Perplexität, was konsistentere und erinnerungswertorientiertere Rückmeldungen anzeigt.

In der Tabelle für den ersten Test (oben) sehen wir, dass MemCoach anscheinend effektivere erinnerungswertorientierte Rückmeldungen liefert als jedes der Vergleichsmodelle – und das gesteuerte InternVL3.5-Modell erhöht den Erinnerungswert öfter und um einen größeren Betrag, mit einem 5-prozentigen Verbesserungsverhältnis-Gewinn gegenüber GPT-5 Mini und einem 31,81-prozentigen Sprung im relativen Erinnerungswert gegenüber seiner ungesteuerten Version.

Es übertrifft auch ästhetikspezialisierte Systeme, obwohl es keine zusätzliche Schulung erfordert. Eine geringere Perplexität, so die Veröffentlichung, legt nahe, dass seine Rückmeldungen den gleichen sprachlichen Mustern folgen, die menschliche Erinnerungswert-Urteile tendenziell belohnen:

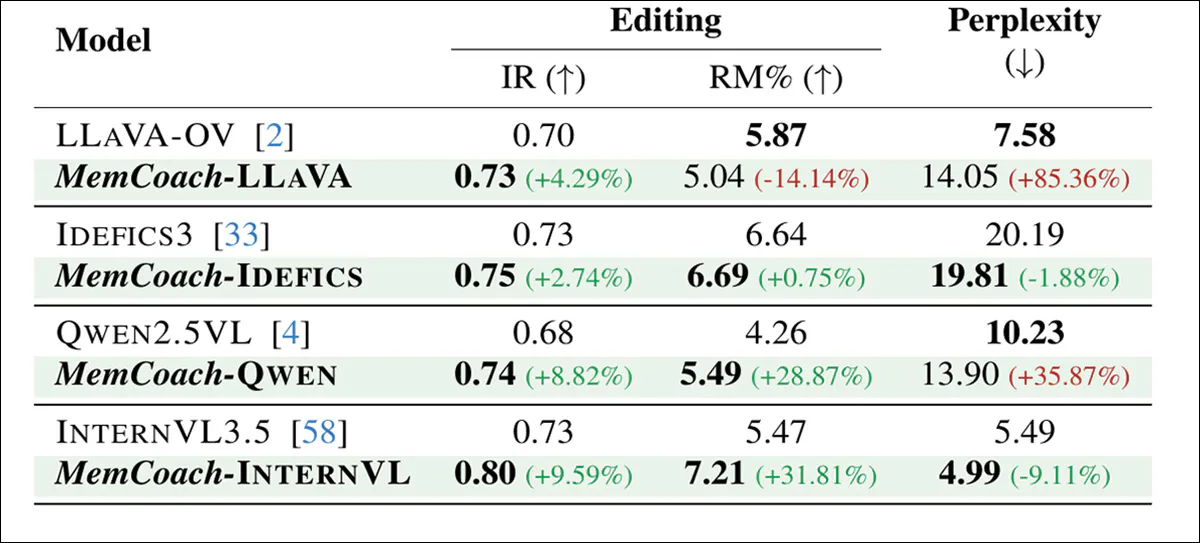

Generalisierungsresultate, die zeigen, dass MemCoach erinnerungswertorientierte Rückmeldungen über mehrere multimodale Grundlagen hinweg verbessert, indem es konsistent das Verbesserungsverhältnis und den relativen Erinnerungswert erhöht und die Perplexität für die meisten Modelle reduziert.

Ein weiterer Test (siehe Tabelle oben) zeigt, dass die Hinzufügung von MemCoach die erinnerungswertorientierte Rückmeldung über jede getestete multimodale Grundlage hinweg verbesserte, mit konsistenten Gewinnen im Verbesserungsverhältnis und den größten Sprüngen, die für Qwen2.5VL und LLaVA-OV auftraten.

Eine qualitative Bewertung wurde dann durchgeführt, bei der Beispiele von MemCoach-Rückmeldungen analysiert wurden, in denen das Quellbild, die natürliche Sprachvorschlag und das imaginierte verbesserte Ergebnis Seite an Seite untersucht wurden:

Qualitative Beispiele für erinnerungswertorientierte Rückmeldungen, die von MemCoach generiert wurden. Jedes Tripel zeigt das Quellbild, die natürliche Sprachanweisung und das resultierende bearbeitete Bild, mit relativer Erinnerungswert (RM), der die gemessene Änderung anzeigt. Die Anweisungen reichen von Pose- und Blickanpassungen bis hin zu semantischen Eingriffen wie der Entfernung von Objekten, was sowohl erfolgreiche Gewinne als auch Fälle zeigt, in denen die Entfernung ungewöhnlicher Elemente den Erinnerungswert verringert.

Von diesen Ergebnissen sagen die Autoren:

‘Die Beispiele zeigen die Vielfalt der Vorschläge, die das Modell macht, von feinen kompositorischen Anpassungen, wie der Änderung der Blickrichtung, Pose oder Handposition, bis hin zu semantischen Eingriffen, die die Entfernung von Objekten oder die Änderung von Gesichtsausdrücken beinhalten. ‘

‘Die Rückmeldungen sind natürlich interpretierbar und handlungsfähig, ausgedrückt in knappen textuellen Anweisungen (meist mit Verben “Bringen”, “Stehen”, “Entfernen”), die direkt umgesetzt werden können, was effektiv verbalisiert, wie man ein erinnerungswertes Foto macht.’

Schlussfolgerung

Es wäre sehr interessant, die Methodik von Google’s geschlossener Ansatz mit dem MemBench-Projekt zu vergleichen – nicht zuletzt, um zu wissen, welche zentralen Standards, Referenzen und Datenbanken Google verwendet hat, um die ästhetischen Standards des Systems zu definieren.

Der negative Aspekt von Systemen dieser Art, ob offen oder geschlossen, ist, dass sie im großen Maßstab einheitliche Standards durchsetzen, die dazu bestimmt sind, als Memes und Klischees zu enden – eine Art visuelles Äquivalent der AI-Strichdebatten, bei denen das “korrekte” Verfahren etwas verflucht in der alltäglichen Verwendung ist.

* Meine Umwandlung der inline-Zitate der Autoren in Hyperlinks, wenn der Link nicht anderswo im Artikel präsentiert wird.

† Die Veröffentlichung bezieht sich hier, wie an mehreren anderen Stellen, auf “zusätzliche Materialien”, die ich weder aus der Veröffentlichung noch aus der Kern-ArXiv-Liste oder der Projektseite finden kann.

Erstveröffentlicht am Donnerstag, 26. Februar 2026