Andersons Blickwinkel

AI-Generierte Bilder Mit HDR Ins Licht Bringen

AI-Bilder und -Videos mögen beeindruckend sein, aber sie sind nicht von “professionellem” Standard – ein Problem, das ein neues Forschungsprojekt ansprechen will.

In der professionellen Audio-Visuellen-Gemeinschaft ist einer der häufigsten Einwände gegen den Einzug von KI, der derzeitige Mangel an professionellen Standards für die Bild- und Video-Wiedergabe. Nicht zuletzt davon ist die Fähigkeit, mit High Dynamic Range (HDR)-Bildern und -Videos zu arbeiten.

HDR-Bilder sind das moderne Äquivalent einer im 19. und 20. Jahrhundert praktizierten fotografischen Technik, die Bracketing genannt wird, bei der das gleiche Bild mehrmals mit zunehmenden Mengen an Licht aufgenommen wird, die auf das Filmmaterial fallen:

Oben, eine kurze Bracketing-Sequenz. Unten, der hohe Dynamikbereich, der aus diesen Fotos in ein einzelnes Bild extrahiert werden kann. Quelle

In der traditionellen Fotografie resultierte dies in mehreren Bildern, die mit einigem Fachwissen und Aufwand zu einem einzelnen Druck kombiniert werden konnten, der von all den verschiedenen Details profitierte, die im Bereich der Belichtungen verfügbar waren. Aber es war kein trivialer oder einfacher Prozess.

Heute kann eine ‘auto-bracketed’ Bildsequenz entweder mehrere Bilder erzeugen oder in ein einzelnes HDR-Bild kombiniert werden – effektiv eine Vielzahl von Belichtungen in einem Bild, das HDR-fähige Bildbearbeitungsanwendungen wie Photoshop durchlaufen und dem Fotografen ermöglichen, es in ein ideales Ausgabebild zu orchestrieren.

Wenn Sie sich fragen, warum Sie sich darum kümmern sollten oder wie sich diese Art von Technik auf Ihre eigene Fotografie auswirkt, soll die Illustration für diesen Artikel dies auf eine vertraute Weise demonstrieren:

Oben, auf der linken Seite sehen wir ein typisches Beispiel für ein sRGB (d. h. nicht-HDR)-Bild. Wenn man es nur aufhellt (rechts), zeigt es den Monster im Schrank nicht an, weil dieses Detail weggeworfen wurde, als der Fotograf und die automatischen Prozesse der Kamera entschieden, was in dem Foto priorisiert werden sollte:

Unten ist ein Hinweis (links) darauf, wie “ausgewaschen” der Vordergrund zum Zeitpunkt der Belichtung sein müsste, um den Schrank-Monster in einem Nicht-HDR-Foto zu registrieren, und (rechts) wie der Monster in Dunkelheit getaucht wird, wenn die Belichtung für die gut beleuchteten Vordergrund-Objekte geeignet gemacht wird:

Unten sehen wir die Art von Detail, das aus einem HDR-Bild oder Bildsequenz “gerettet” werden kann. In diesem Fall “versteckte” sich der Monster in den untersten visuellen Registern der HDR-Sequenz, in einem Bereich, in dem der Rest des Inhalts “ausgebrannt” in fast-Weiß gewesen wäre (oben, links). Durch die Angabe, dass ein breiter Bereich von Helligkeitsstufen selektiv in demselben Bild ausgedrückt werden sollte, können diese dissonanten Elemente in ein rationales Bild komponiert werden:

Ein Nicht-HDR-Bild wird als display-referred Bild bezeichnet, und ein High-Gamut-HDR-Bild wird als scene-referred Bild bezeichnet.

HDR-Video ist auch eine Sache, und diese Art von tonaler Vielseitigkeit und Duktilität gibt Filmemachern einige Freiheiten, um Footage in einer Reihe von kreativen und konsistenten Weisen zu retten, zu gradieren und zu interpretieren; es ist daher nicht überraschend, dass Kreative zögern, mit dem “abgeflachten” sRGB-Ausgang zu arbeiten, der typisch für die meisten generativen KI-Rahmenwerke ist.

HDR in KI

Natürlich ist die Forschungsszene daran interessiert, KI-generierte Rahmenwerke in die HDR-Ära zu bringen. Es ist jedoch keine triviale Aufgabe, sowohl wegen der grundlegenden Architektur von Diffusions-basierten generativen Systemen als auch weil gute HDR-Daten viel Festplattenspeicherplatz benötigen, was zu unhandlichen Sammlungen führt; folglich sind Daten, die für die Aufgabe geeignet sind, rar.

Trotzdem bietet eine Zusammenarbeit zwischen einer Universität in Singapur und Adobe Research eine Methode zur Erzeugung von HDR-Bildsequenzen, in einer Methodik, die theoretisch auf Video sowie auf Stillbilder angewendet werden kann:

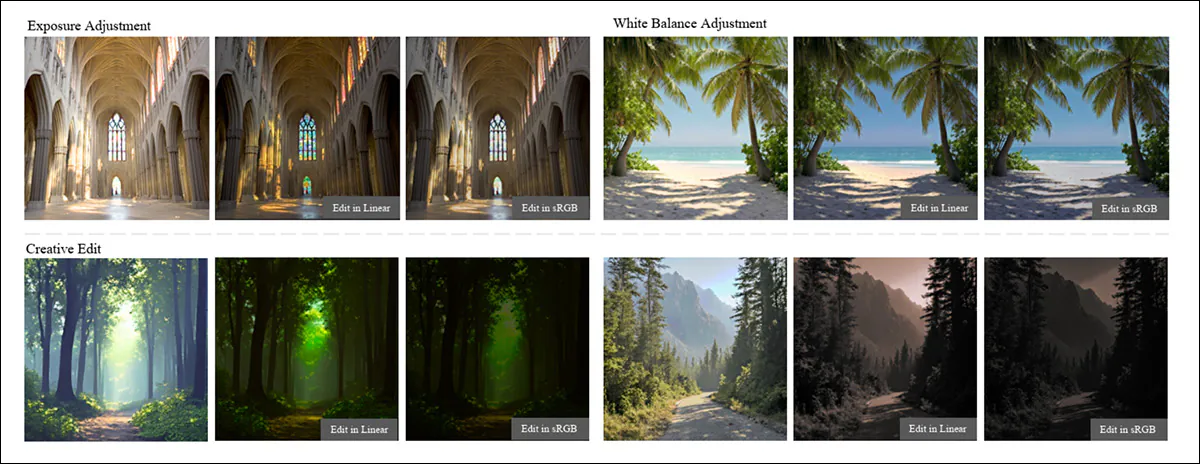

Vom Projekt-Website für die neue Arbeit, Beispiele für ‘gekoppelte’ Text-Bild-Ausgaben. Quelle

Das neue System erzeugt mehrere ausgerichtete Versionen desselben Bildes bei verschiedenen Helligkeitsstufen und lernt, wie hell die Szene wirklich war, und kombiniert diese dann in ein einzelnes Ergebnis, das Details in beiden Schatten und Highlights beibehält, und ermöglicht späteren Bearbeitungen von Belichtung oder Farbe, die sich wie Anpassungen an eine echte Kameraaufnahme verhalten, anstatt wie fragile Anpassungen an ein vollständig verarbeitetes Bild.

Das System nutzt eine Vielzahl von verschiedenen Modellen für die Aufgabe, einschließlich Varianten von Qwen und Flux:

Beispiele aus dem neuen Papier, die zeigen, wie das System mehrere Belichtungsversionen der gleichen Szene erzeugen kann, während die zugrunde liegende Struktur beibehalten wird. Ausgehend von einer einfachen Kantenkarte erzeugt das Modell konsistente Bilder über sehr dunkle bis sehr helle Einstellungen, egal ob der Prompt Mondlicht, Sonnenlicht, Sonnenuntergang oder sogar ein kleines Objekt wie einen Ballon beschreibt, wobei das Thema und die Komposition stabil bleiben, während nur die Beleuchtung geändert wird. Die Methode kann Helligkeit in einer kontrollierten, kamera-ähnlichen Weise variieren, anstatt zu drifteten oder neuen Inhalt zu erfinden, wenn die Belichtung geändert wird. Quelle

Die Autoren erklären:

‘Das Erzeugen von linearen Bildern ist herausfordernd, da vorgefertigte VAEs in latenten Diffusionsmodellen Schwierigkeiten haben, extreme Highlights und Schatten gleichzeitig zu erhalten, aufgrund des höheren Dynamikbereichs und der höheren Bit-Tiefe.

‘Deshalb stellen wir ein lineares Bild als eine Sequenz von Belichtungsbracketing dar, jede davon einen bestimmten Teil des Dynamikbereichs erfassend, und schlagen eine DiT-basierte Flow-Matching-Architektur für text-konditioniertes Belichtungsbracketing vor.

‘Wir demonstrieren weiterhin Downstream-Anwendungen, einschließlich text-gesteuerter linearer Bildbearbeitung und struktur-konditionierter Generierung via ControlNet.’

Die neue Arbeit trägt den Titel Lineares Bildgenerierung durch Synthese von Belichtungsbracketing und stammt von vier Autoren aus S-Lab an der Nanyang Technological University, Adobe NextCam und Adobe Research. Neben der oben genannten Projekt-Website und dem YouTube-Video, das die Veröffentlichung begleitet, gibt es auch ein (derzeit spärliches) GitHub-Repo und das Versprechen einer Daten-Veröffentlichung.

Obwohl die Autoren viele Beispiele für die Ausgabe des Systems auf der zugehörigen Projekt-Website liefern, benötigen Betrachter ein HDR-fähiges Display, um die Merkmale der HDR-Ausgabe wirklich zu unterscheiden. Dennoch finden Sie die YouTube-Übersicht der Forscher am Ende dieses Artikels – beachten Sie jedoch, dass die Unterschiede zwischen den gezeigten Beispielen auf einem Nicht-HDR-Display möglicherweise nicht klar zu erkennen sind.

Methode und Daten

Die Autoren betonen den Umfang, in dem Datensammlung eine Herausforderung in diesem speziellen Vorhaben darstellt:

‘Das Sammeln einer großen Anzahl von linearen Bildern ist extrem herausfordernd in der Praxis. Darüber hinaus sind die meisten öffentlichen HDR-Datensätze entweder panoramisch (und konzentrieren sich fast ausschließlich auf großformatigen Szeneninhalt) oder liefern keine echten linearen Bilder, was sie für unsere Zwecke untauglich macht.

‘Deshalb verwenden wir hauptsächlich RAW-Bild-Datensätze als Grundlage für die Ausbildung.’

Die Forscher machten kreative Nutzung der wenigen Optionen, die ihnen zur Verfügung standen, indem sie den RAISE-Datensatz als tatsächliche Trainingsdaten nutzten und den MIT-Adobe FiveK-Datensatz als Auswertungsdaten*.

Um verwendbare HDR-Trainingsdaten zu erstellen, verarbeiteten die Forscher die RAW-Kamera-Dateien durch eine standardisierte Pipeline, um kamera-spezifische Eigenheiten zu entfernen, und konvertierten die Bilder in ein konsistentes, szene-referenziertes lineares Format:

Schema für den Arbeitsablauf der Autoren: Das System startet von Rauschen, das vier Belichtungsebenen der gleichen Szene darstellt, zusammen mit einem Text-Prompt und einem Helligkeitstoken. Dies wird dann durch gestapelte Transformer-Blöcke verarbeitet, die die verschiedenen Belichtungen ausrichten, während sie die Beleuchtung anpassen. Das System prognostiziert dann sowohl die Menge der Belichtungsbilder als auch eine Gesamthelligkeitsskala und dekodiert und kombiniert sie anschließend in ein einzelnes szene-referenziertes Bild, das Details in beiden Schatten und Highlights beibehält.

Dies umfasste die Rekonstruktion von vollständigem RGB aus Sensordaten, die Anwendung von Farbkorrektur, die Normalisierung der Weißabgleichs und eine kurze Verschiebung in einen wahrnehmungsbezogenen Farbraum für Rauschunterdrückung, bevor es zu einem sauberen linearen Signal zurückkehrte. Die tatsächliche Helligkeit in der Szene wurde dann mithilfe der Kamera-Expositions-Einstellungen wiederhergestellt, so dass jedes Pixel die tatsächliche Helligkeit widerspiegeln würde, anstatt eine display-fertige Approximation.

Da solche Werte stark variieren können, wurde das Datenmaterial dann stabilisiert, indem jedes Bild anhand seiner eigenen Helligkeitsverteilung skaliert wurde, wobei Mittelwert- und Highlight-Statistiken verwendet wurden, um sowohl ausgewaschene Bilder als auch überbelichtete Highlights zu vermeiden, und schließlich ein normales lineares Bild erhielt, das den wahren Bereich von Licht in der Szene beibehielt, während es stabil genug für die Ausbildung blieb.

Text-Labels für die Bilder wurden dann mit dem Qwen2.5-VL 7B-Modell erstellt, wobei Prompts so gestaltet wurden, dass sie den Eigenschaften des Flux-Modells entsprachen, das zur Generierungszeit verwendet werden würde.

Jedes Bild wurde in Belichtungs-“Scheiben” unterteilt und durch einen gemeinsamen VAE-Encoder verarbeitet, der alle Belichtungen in einen gemeinsamen latenten Raum konvertierte, der darauf ausgelegt war, den vollen Helligkeitsbereich zu erfassen. Die Latenten wurden dann aus Rauschen raffiniert und zurück in Bilder dekodiert, was eine konsistente Rekonstruktion über dunkle und helle Regionen ermöglichte, ohne dass sie in eine einzige “abgeflachte” Belichtung kollabierten.

LoRA-Feinabstimmung wurde verwendet, um den vorgefertigten Flux-Rumpf an lineare Bild-Daten mit minimalen zusätzlichen Parametern anzupassen, was half, das Single-Diffusion-Transformator-Modell (Single-DiT) stabil zu halten, auch wenn die Helligkeit über die Belichtungsbracketing variierte.

Exposure-Modulation-Self-Attention (mittlere Spalte in der Schema-Illustration oben) wurde eingeführt, um alle Bracketing gemeinsam zu verarbeiten, wodurch die Helligkeit pro Belichtung angepasst werden konnte, während Struktur und feine Details ausgerichtet blieben.

3D-Rotary-Positional-Embedding (3D-R[o]PE) wurde verwendet, um sowohl räumliche Position als auch Belichtungsidentität zu kodieren, so dass das Modell erkennen konnte, welches Bracketing jedes Token gehörte, während die räumliche Konsistenz erhalten blieb, was eine saubere Trennung von Helligkeitsvariation von Szeneninhalt ermöglichte.

Eine Übersicht über den Datensatz, der in der Studie verwendet wird, zeigt, wie Bilder über Inhaltstypen und Innen- bzw. Außenszenen verteilt sind, zusammen mit der Verteilung der Helligkeitswerte in den verarbeiteten Daten. Die Histogramme zeigen die Leuchtdichte und die Strahlungs-Skala in Log-Raum, was zeigt, wie stark die tatsächliche Helligkeit variieren kann, wobei höhere Strahlungswerte physisch helleren Szenen entsprechen und den starken Dynamikbereich hervorheben, den das Modell trainiert, um zu handhaben.

Tests

Die Forscher verwendeten Flux-dev als generatives Framework, wobei die Ausbildung auf vier NVIDIA A100-GPUs mit jeweils 80 GB VRAM erfolgte. Die Batch-Größe wurde auf 4 (pro GPU) über 10.000 Iterationen festgelegt.

LoRA-Feinabstimmung verwendete einen Rang von 64. Der AdamW-Optimizer wurde mit einer Lernrate von 2×102 (für den Belichtungsmodulationsaspekt) verwendet.

Die Autoren weisen darauf hin, dass es zwei vorherige Arbeiten gibt, die in Umfang ähnlich sind, aber keine offensichtlichen Kandidaten für eine Testphase darstellen. Die von Max Planck geleitete Veröffentlichung von 2022 GlowGAN ist auf die Generierung spezifischer Bildkategorien beschränkt, während Bracket Diffusion (erneut vom Max-Planck-Institut geleitet) nur ein HDR-Bild bei 256x256px erzeugen kann und mehrere Minuten dafür benötigt.

Aus dem ursprünglichen GlowGAN-Papier, typische Beispiele für niedrige Dynamikbereiche (LDR)-Bilder, die Details in Schatten und Highlights verlieren, während das Modell lernt, HDR-Versionen zu erzeugen, die Details über Helligkeitsstufen hinweg beibehalten und die Wiederherstellung gesättigter Bereiche durch inverse Tonkarten ermöglichen. Quelle

Deshalb verglichen die Autoren ihre Methode mit adaptierten Versionen starker bestehender Modelle, anstatt speziell entwickelter Alternativen.

Ein Satz von Experimenten (‘T2I Fine-Tuning’) feinabstimmte das Text-Bild-Diffusionsmodell Flux mithilfe von LoRA, trainierte es, lineare Bilder direkt zu erzeugen, und bewertete, wie ein State-of-the-Art-T2I-Modell sich an diesen Bereich anpasste.

Ein zweiter Vergleich (‘T2V Fine-Tuning’) verwendete das Text-Video-Modell Wan 2.1, dessen VAE mehrere Frames in eine gemeinsame latente Repräsentation komprimiert; in dieser Einrichtung wurden vier Belichtungsbracketing in eine einzelne latente Repräsentation kodiert und dann dekodiert, um zu testen, ob eine Video-ähnliche Pipeline Belichtungsvariation modellieren kann.

Der dritte Satz von Experimenten (‘T2I Model Inflation’) verglich mit CameraCtrl und Generative Photography, die beide Bild-Diffusionsmodelle über temporale Module erweitern, um Multi-Frame-Ausgaben zu produzieren. Diese wurden ebenfalls auf den gleichen Daten feinabgestimmt, um einen konsistenten Vergleich zu ermöglichen.

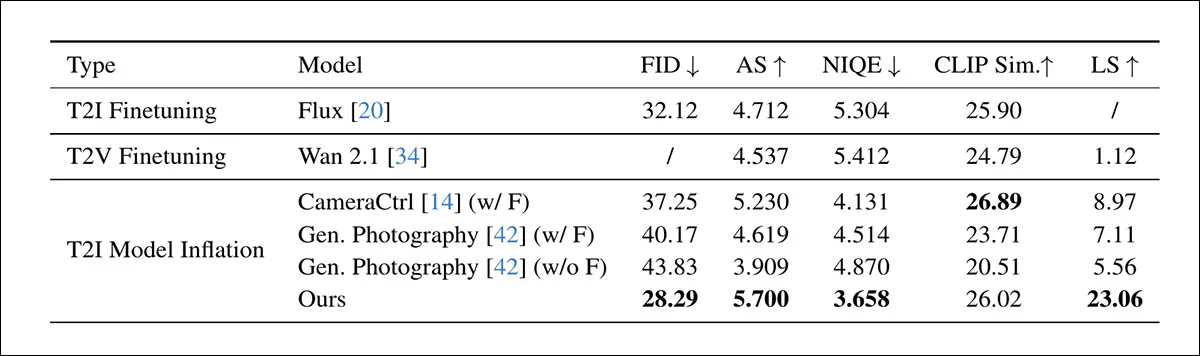

Die verwendeten Metriken waren Fréchet-Inception-Distanz (FID); Ästhetik-Score (AS); Naturalness Image Quality Evaluator (NIQUE); CLIP Sim-Score; und Leuchtdichtähnlichkeit (LS):

Ein Vergleich der Methode der Autoren mit mehreren adaptierten Baselines für die Generierung linearer, szene-referenzieller Bilder. Text-Bild- (Flux) und Text-Video- (Wan 2.1) Modelle werden mit LoRA feinabgestimmt, um zu testen, wie gut bestehende generative Systeme diesen Bereich handhaben, während CameraCtrl und Generative Photography Diffusionsmodelle mit temporalen Komponenten erweitern. Einige Scores fehlen, da bestimmte Modelle nicht in der Lage sind, konsistente Belichtungsbracketing zu erzeugen, die für die Wiederherstellung des vollen Dynamikbereichs erforderlich sind. Über die berichteten Metriken hinweg erzielt die neue Methode die stärksten Gesamtergebnisse, insbesondere bei Maßen, die mit Bildqualität und genauer Helligkeitsrekonstruktion verbunden sind.

In Bezug auf diese Ergebnisse erklären die Autoren:

‘Aufgrund der weiten Verteilung linearer Bilder ist es schwierig, direkt ein T2I-Modell auf linearen Daten feinzujustieren, da es schwierig ist, Schatten- und Highlight-Details auszugleichen. T2I-Modell-Inflationsmethoden leiden unter begrenztem Dynamikbereich und signifikanter Bildqualitätsverschlechterung, selbst nach der Feinjustierung.

‘Für T2V-Feinjustierung verursacht Wan 2.1s 4-fache zeitliche Downsampling die Verbindung der 4 Belichtungsbracketing in eine einzelne latente Repräsentation, was zu einem starken Verteilungsmissverhältnis führt, das durch Feinjustierung allein nicht behoben werden kann.

‘Indem wir szene-referenzielle Eigenschaften direkt mithilfe von Belichtungsbracketing modellieren, erzielt unsere Methode überlegenere visuelle Qualität und Dynamikbereich im Vergleich zu allen Baselines.’

Ein Vergleich mit LoRA-adaptiertem Flux und Wan 2.1, der zeigt, wie jede Methode Belichtungsänderungen über die gleichen Szenen handhabt. Konkurrierende Ansätze neigen dazu, Details in sehr dunklen oder sehr hellen Bereichen zu verlieren, während die vorgeschlagene Methode konsistente Struktur beibehält und verwertbares Detail über den gesamten Bereich der Belichtungen hinweg wiederherstellt. Bitte besuchen Sie die Quell-Website und die Projekt-Website für bessere Beispiele.

Bitte beziehen Sie sich auf den erweiterten Experimenten- und Anhangsabschnitt des Quellpapiers für weitere Tests.

Schlussfolgerung

Für Medienprofis, wie z.B. diejenigen, die in Film- und Fernsehproduktionen arbeiten, hat die gleiche Ausgabe, die die Welt (und zunehmend den Unmut) erfasst hat, sie unbeeindruckt gelassen, da fast alle ihre Pipelines auf irgendeine Weise von HDR-Aufnahmen abhängig sind.

Daher ist dies ein zeitgemäßes Projekt, das eine Einrichtung darstellt, die man hoffen würde, dass sie zu einem optionalen Standard über neue Rahmenwerke werden würde – obwohl es sicherlich mindestens doppelt so lange dauern wird, um zu rendern; klar ist auch, dass die Latenz ernsthaft angegangen werden muss, wenn HDR-KI-Inhalte nicht in die “in post” anstatt der “in-camera”-Kategorie fallen sollen.

* Normalerweise würden wir Beispiele zeigen, aber da der Leser möglicherweise kein HDR-fähiges Display hat, lassen wir diese in diesem Fall aus.

Erstveröffentlicht am Sonntag, 26. April 2026