Andersons Blickwinkel

Zensur von KI-Modellen funktioniert nicht gut, Studie zeigt

Die Versuche, KI-Bildgeneratoren durch das Löschen von verbotenem Inhalt (wie Pornografie, Gewalt oder urheberrechtlich geschützten Stilen) aus den trainierten Modellen zu zensieren, sind nicht erfolgreich: Eine neue Studie zeigt, dass die aktuellen Methoden zur Konzeptlöschung es “verbotenen” Attributen ermöglichen, in nicht verwandte Bilder zu sickern, und auch nicht verhindern, dass eng verwandte Versionen des vermeintlich “gelöschten” Inhalts erscheinen.

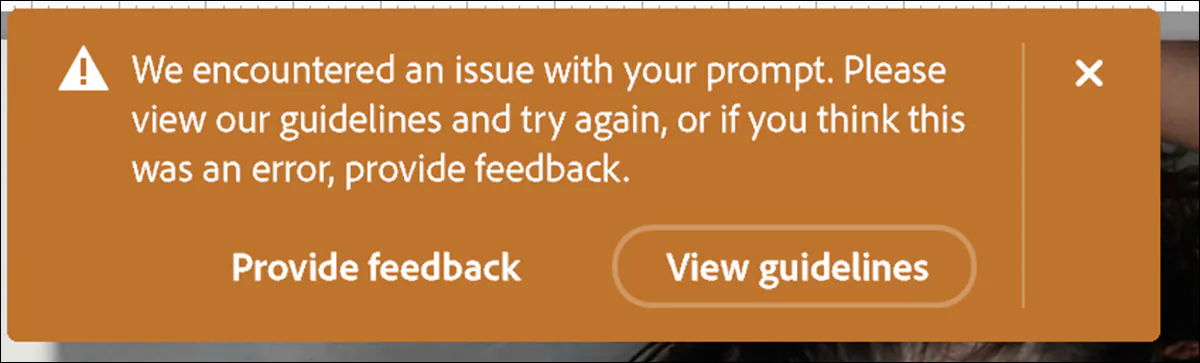

Wenn Unternehmen, die grundlegende KI-Modelle produzieren, nicht verhindern können, dass diese missbräuchlich verwendet werden, um unangemessene oder illegale Materialien zu produzieren, riskieren sie, verklagt oder geschlossen zu werden. Andererseits können Anbieter, die ihre Modelle nur über eine API bereitstellen, wie z.B. Adobe’s Firefly-Generierungsmotor, sich keine Sorgen machen, was ihre Modelle möglicherweise erstellen, da sowohl die Benutzereingabe als auch die resultierende Ausgabe überprüft und gesäubert werden:

Adobes Firefly-System, das in Tools wie Photoshop verwendet wird, weigert sich manchmal sofort, eine generative Anfrage zu bearbeiten, indem es die Eingabe vor der Erstellung blockiert. Manchmal generiert es das Bild, aber dann blockiert es das Ergebnis nach der Überprüfung. Diese Art von Unterbrechung kann auch in ChatGPT auftreten, wenn das Modell eine Antwort beginnt, aber nach Erkennung eines Richtlinienverstoßes abbricht – und manchmal kann man das abgebrochene Bild während dieses Prozesses kurz sehen.

Allerdings können solche API-Filter in der Regel von Benutzern auf lokal installierten Modellen neutralisiert werden, einschließlich Vision-Language-Modellen (VLMs), die der Benutzer möglicherweise durch lokale Schulung auf benutzerdefinierten Daten anpassen möchte.

In den meisten Fällen ist die Deaktivierung solcher Operationen trivial und erfordert lediglich das Auskommentieren eines Funktionsaufrufs in Python (obwohl solche Hacks in der Regel nach Framework-Updates wiederholt oder neu erfunden werden müssen).

Aus geschäftlicher Sicht ist es schwierig zu verstehen, wie dies ein Problem sein könnte, da ein API-Ansatz die corporate Kontrolle über den Benutzer-Workflow maximiert. Aus der Sicht des Benutzers jedoch wird die Kombination aus den Kosten für API-Only-Modelle und dem Risiko fehlerhafter oder übermäßiger Zensur wahrscheinlich dazu führen, dass sie lokale Installationen von Open-Source-Alternativen herunterladen und anpassen – zumindest, wenn die FOSS-Lizenzierung günstig ist.

Das letzte bedeutende Modell, das ohne jeden Versuch, Selbstzensur zu verankern, veröffentlicht wurde, war Stable Diffusion V1.5, fast drei Jahre ago. Später führte die Enthüllung, dass seine Trainingskorpora CSAM-Daten enthielten, zu wachsenden Forderungen nach seinem Verbot und seiner Entfernung aus dem Hugging Face-Repository im Jahr 2024.

Schneiden Sie es aus!

Zyniker behaupten, dass das Interesse eines Unternehmens an der Zensur lokaler KI-Modelle ausschließlich auf Bedenken hinsichtlich der rechtlichen Haftung beruht, falls ihre Frameworks für die Erstellung unangemessener oder illegaler Inhalte bekannt werden.

Tatsächlich sind einige “lokal-freundliche” Open-Source-Modelle nicht so schwer zu entsperren (wie Stable Diffusion 1.5 und DeepSeek R1).

Im Gegensatz dazu wurde die jüngste Veröffentlichung von Black Forest Lab’s Flux Kontext-Modellreihe durch das Engagement des Unternehmens gekennzeichnet, die gesamte Kontext-Reihe zu zensieren. Dies wurde durch sorgfältige Datenkuratierung und gezielte Feinabstimmung nach der Schulung erreicht, um alle verbleibenden Tendenzen zu unangemessenen oder verbotenen Inhalten zu entfernen.

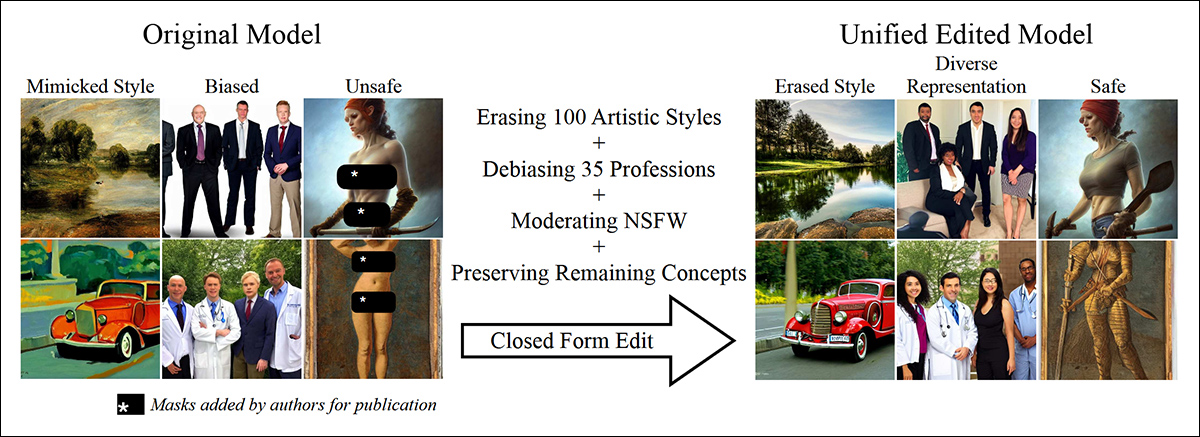

Dies ist der Ort, an dem die Forschungsszene in den letzten 2-3 Jahren aktiv war: mit einem Schwerpunkt auf der Nachbearbeitung von Modellen mit unzureichend kuratierten Daten. Angebote dieser Art umfassen Unified Concept Editing in Diffusion Models (UCE); Reliable and Efficient Concept Erasure of Text-to-Image Diffusion Models (RECE); Mass Concept Erasure in Diffusion Models (MACE); und concept-Semi-Permeable structure is injected as a Membrane (SPM):

Das 2024-Papier ‘Unified Concept Editing in Diffusion Models’ bot geschlossene Formulierungen für Aufmerksamkeitsgewichte, die eine effiziente Bearbeitung mehrerer Konzepte in Text-Bild-Modellen ermöglichten. Aber hält die Methode einer Überprüfung stand? Quelle: https://arxiv.org/pdf/2308.14761

Obwohl dies ein effizienter Ansatz ist (Hyperscale-Sammlungen wie LAION sind viel zu groß, um manuell kuratiert zu werden), ist es nicht unbedingt ein effektiver: Laut einer neuen US-Studie funktionieren keine der oben genannten Bearbeitungsverfahren – die den aktuellen Stand der Technik bei der Nachbearbeitung von KI-Modellen darstellen – besonders gut.

Die Autoren fanden heraus, dass diese Konzeptlöschtechniken (CETs) in der Regel leicht umgangen werden können und dass selbst dort, wo sie effektiv sind, sie erhebliche Nebenwirkungen haben:

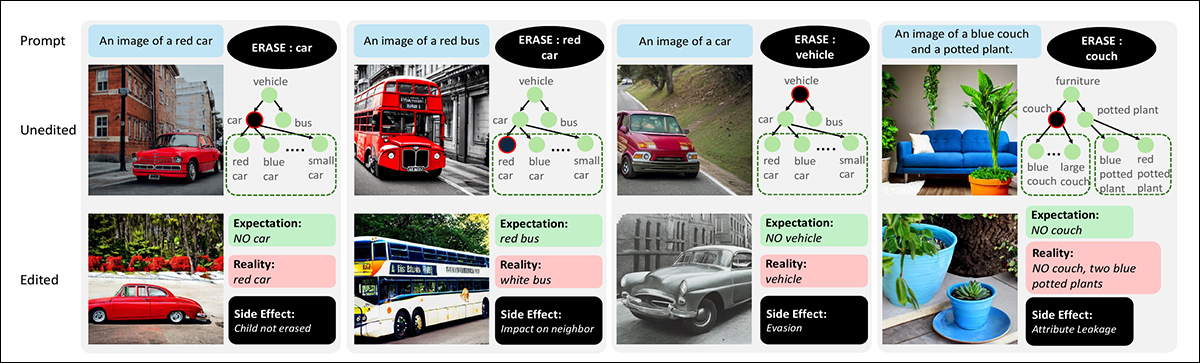

Effekte der Konzeptlöschung auf Text-Bild-Modelle. Jede Spalte zeigt eine Eingabe und das Konzept, das für die Löschung markiert ist, zusammen mit den generierten Ausgaben vor und nach der Bearbeitung. Hierarchien zeigen Eltern-Kind-Beziehungen zwischen Konzepten. Die Beispiele zeigen häufige Nebenwirkungen, einschließlich des Versagens, Kindkonzepte zu löschen, der Unterdrückung benachbarter Konzepte, der Umgehung durch Umformulierung und der Übertragung gelöschter Attribute auf nicht verwandte Objekte. Quelle: https://arxiv.org/pdf/2508.15124

Die Autoren fanden heraus, dass die führenden aktuellen Konzeptlöschtechniken nicht in der Lage sind, kompositionale Prompts zu blockieren (z.B. roter Wagen oder kleiner Holzstuhl); oft lassen sie Subklassen auch nach der Löschung einer Elternkategorie durch (z.B. Auto oder Bus erscheinen weiterhin, nachdem Fahrzeug entfernt wurde); und führen neue Probleme wie Attribut-Leckage ein (wenn z.B. das Löschen von blauem Sofa dazu führt, dass das Modell ein blaues Stuhl generiert).

In über 80% der Testfälle führte das Löschen eines breiten Konzepts wie Fahrzeug nicht dazu, dass das Modell aufhörte, spezifische Fahrzeug-Instanzen wie Autos oder Busse zu generieren.

Die Bearbeitung, so bemerkt das Papier, führt auch dazu, dass Aufmerksamkeitskarten (die Teile des Modells, die entscheiden, wo im Bild zu fokussieren ist) zerstreut werden, was die Ausgabqualität schwächt.

Interessanterweise findet die Studie heraus, dass das Löschen verwandter trainierter Konzepte einzeln besser funktioniert als der Versuch, sie alle auf einmal zu entfernen – obwohl es nicht alle Mängel der untersuchten Bearbeitungsmethoden beseitigt:

Vergleich von progressiver und gleichzeitiger Löschung. Wenn alle Varianten von ‘Teddybär’ gleichzeitig gelöscht werden, generiert das Modell weiterhin bärähnliche Objekte. Das Löschen der Varianten schrittweise ist effektiver und führt dazu, dass das Modell das Zielkonzept zuverlässiger unterdrückt.

Obwohl die Forscher derzeit keine Lösung für die Probleme anbieten können, die das Papier aufzeigt, haben sie ein neues Dataset und eine Benchmark entwickelt, die möglicherweise späteren Forschungsprojekten helfen können, zu verstehen, ob ihre eigenen “zensierten” Modelle wie erwartet funktionieren.