Andersons Blickwinkel

Visuelle Analogien in KI einführen

Aktuelle KI-Modelle erkennen keine ‘relationalen’ Bildähnlichkeiten, wie etwa die Ähnlichkeit zwischen den Schichten der Erde und einem Pfirsich, und verpassen damit einen wichtigen Aspekt der menschlichen Wahrnehmung von Bildern.

Obwohl es viele Computer-Vision-Modelle gibt, die in der Lage sind, Bilder zu vergleichen und Ähnlichkeiten zwischen ihnen zu finden, haben die aktuellen Vergleichssysteme derzeit nur wenig oder keine imaginative Fähigkeit. Betrachten Sie einige der Textzeilen des klassischen Liedes der 1960er Jahre, Windmills of Your Mind:

Wie ein Karussell, das sich dreht, Ringe um den Mond laufen

Wie eine Uhr, deren Zeiger über das Zifferblatt huschen

Und die Welt ist wie ein Apfel, der still im Weltraum schwebt

Vergleiche dieser Art stellen ein Gebiet poetischer Anspielung dar, die für Menschen in einer Weise bedeutsam ist, die weit über die künstlerische Ausdrucksform hinausgeht; vielmehr ist sie eng mit der Entwicklung unserer Wahrnehmungssysteme verbunden; wenn wir unsere ‘Objekt’-Domäne erstellen, entwickeln wir eine Fähigkeit zur visuellen Ähnlichkeit, sodass wir beispielsweise Querschnitte, die einen Pfirsich und die Erde darstellen, oder fraktale Rekursionen wie Kaffeespiralen und Galaxienzweige als analog erkennen.

In dieser Weise können wir Verbindungen zwischen scheinbar unverbundenen Objekten und Objekttypen herstellen und Systeme ableiten (wie Schwerkraft, Impuls und Oberflächenhaftung), die auf verschiedene Domänen in verschiedenen Maßstäben angewendet werden können.

Das Sehen

Even die neueste Generation von Bildvergleichs-KI-Systemen, wie Learned Perceptual Image Patch Similarity (LPIPS) und DINO, die durch menschliches Feedback informiert werden, führen nur buchstäbliche Oberflächenvergleiche durch.

Ihre Fähigkeit, Gesichter zu finden, wo keine existieren – d. h. Pareidolie – stellt nicht die Art von visueller Ähnlichkeitsmechanismus dar, den Menschen entwickeln, sondern tritt auf, weil Gesichtssuch-Algorithmen low-level-Gesichtsstruktur-Merkmale verwenden, die manchmal mit zufälligen Objekten übereinstimmen:

Beispiele für Falschpositiv-Ergebnisse bei der Gesichtserkennung im ‘Faces with Things’-Dataset. Quelle

Um zu bestimmen, ob Maschinen wirklich unsere imaginative Fähigkeit entwickeln können, visuelle Ähnlichkeit über Domänen hinweg zu erkennen, haben Forscher in den USA eine Studie zu Relationaler visueller Ähnlichkeit durchgeführt, bei der ein neues Dataset kuratiert und trainiert wurde, das darauf abzielt, abstrakte Beziehungen zwischen verschiedenen Objekten zu bilden, die dennoch durch eine abstrakte Beziehung verbunden sind:

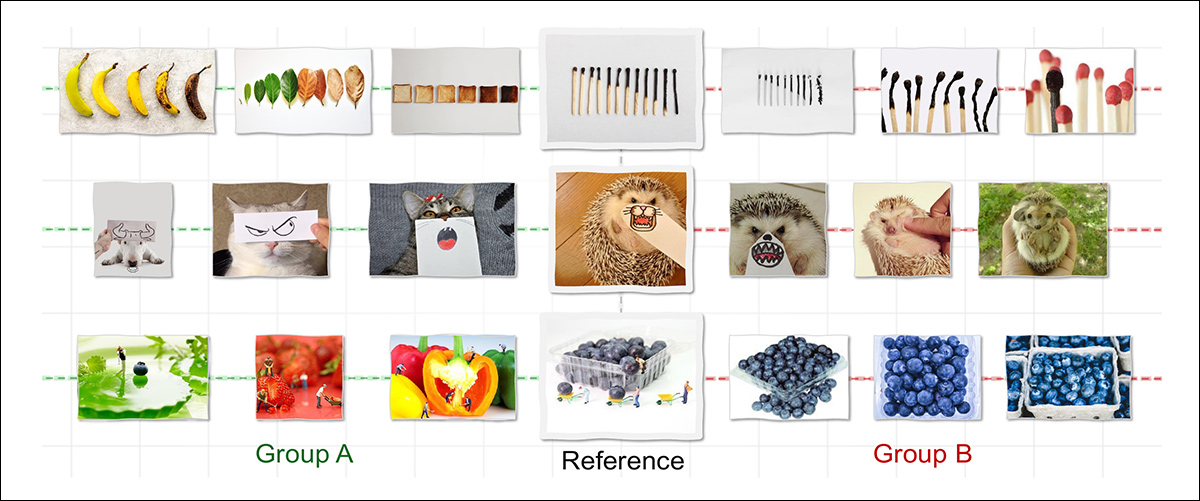

Die meisten KI-Modelle erkennen Ähnlichkeit nur, wenn Bilder Oberflächenmerkmale wie Form oder Farbe teilen, weshalb sie nur Gruppe B (oben) mit dem Referenzbild verbinden. Menschen hingegen sehen auch Gruppe A als ähnlich – nicht, weil die Bilder gleich aussehen, sondern weil sie der gleichen zugrunde liegenden Logik folgen, wie z. B. einer Transformation über die Zeit. Die neue Arbeit versucht, diese Art von struktureller oder relationaler Ähnlichkeit zu reproduzieren, um maschinelles Sehen menschlicherem Denken näher zu bringen. Quelle: https://arxiv.org/pdf/2512.07833

Das entwickelte Beschriftungssystem für das Dataset ermöglicht ungewöhnlich abstrakte Annotationen, die darauf abzielen, KI-Systeme dazu zu bringen, sich auf Basismerkmale statt auf spezifische lokale Details zu konzentrieren:

Die vorhergesagten ‘anonymen’ Beschriftungen, die zum ‘relsim’-Maß der Autoren beitragen.

Die kuratierte Sammlung und der ungewöhnliche Beschriftungsstil treiben das neue vorgeschlagene Maß relsim der Autoren an, das die Autoren in ein fein abgestimmtes Bild-Sprach-Modell (VLM) einpassen.

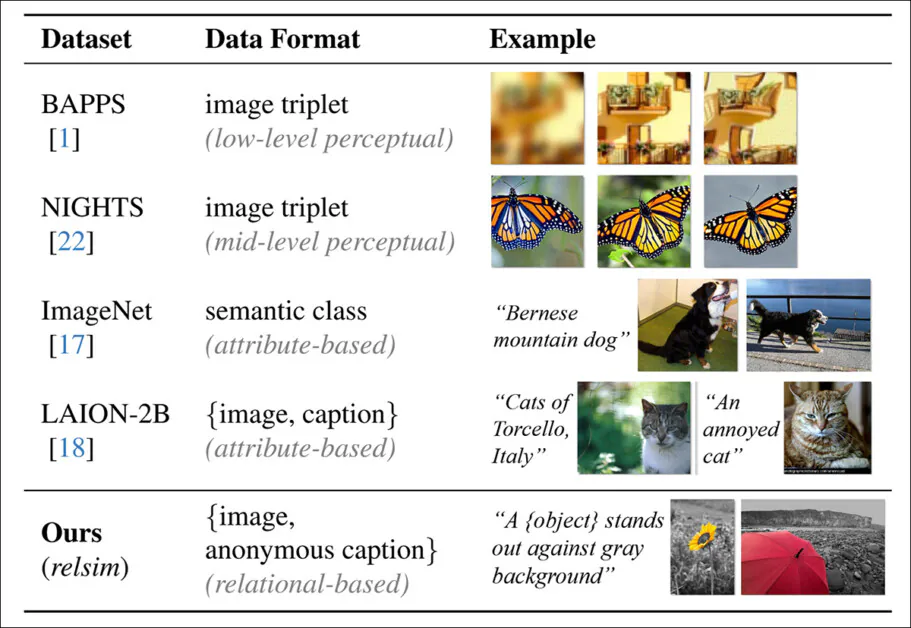

Ein Vergleich zwischen dem Beschriftungsstil typischer Datensätze, der auf Attributähnlichkeit fokussiert ist, während der relsim-Ansatz (untere Zeile) relationale Ähnlichkeit betont.

Der neue Ansatz stützt sich auf Methoden aus der Kognitionsforschung, insbesondere auf Dedre Gentners Struktur-Abbild-Theorie (eine Studie zur Analogie) und Amos Tverskys Definition relationaler Ähnlichkeit und Attributähnlichkeit.

Vom zugehörigen Projekt-Website, ein Beispiel für relationale Ähnlichkeit. Quelle

Die Autoren stellen fest:

‘[Menschen] verarbeiten Attributähnlichkeit wahrnehmungsbezogen, aber relationale Ähnlichkeit erfordert konzeptuelle Abstraktion, oft unterstützt durch Sprache oder Vorwissen. Dies legt nahe, dass das Erkennen relationaler Ähnlichkeit zuerst das Verständnis des Bildes erfordert, das Aufgreifen von Wissen und die Abstraktion seiner zugrunde liegenden Struktur.’

Das neue Papier trägt den Titel Relationale visuelle Ähnlichkeit und ist mit einer Projekt-Website (siehe Video am Ende dieses Artikels) verbunden.

Methode

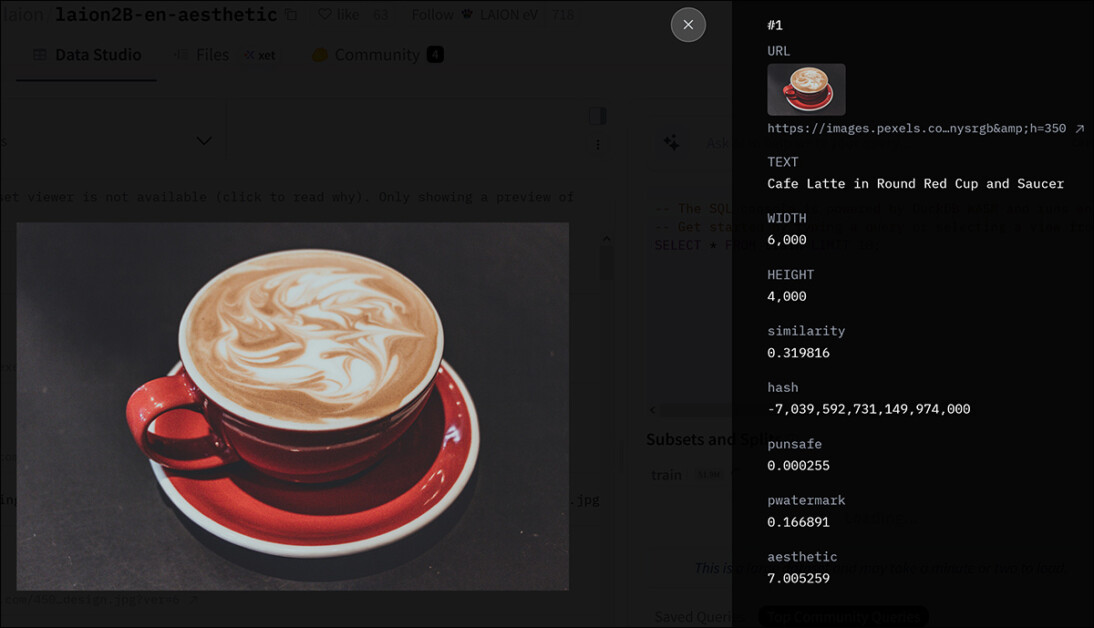

Die Forscher verwendeten eines der bekanntesten Hyperscale-Datensätze als Ausgangspunkt für ihre eigene Sammlung – LAION-2B:

Metadaten für einen Eintrag in der LAION-2B-Sammlung. Quelle

114.000 Bilder, die wahrscheinlich elastische relationale Strukturen enthalten, wurden aus LAION-2B extrahiert, wobei die Filterung der vielen schlechten Bilder, die in dem minimal kuratierten Datensatz vorhanden sind, erforderlich war.

Um eine Pipeline für diesen Auswahlprozess zu erstellen, verwendeten die Autoren Qwen2.5-VL-7B, wobei 1.300 positive und 11.000 negative menschlich beschriftete Beispiele genutzt wurden:

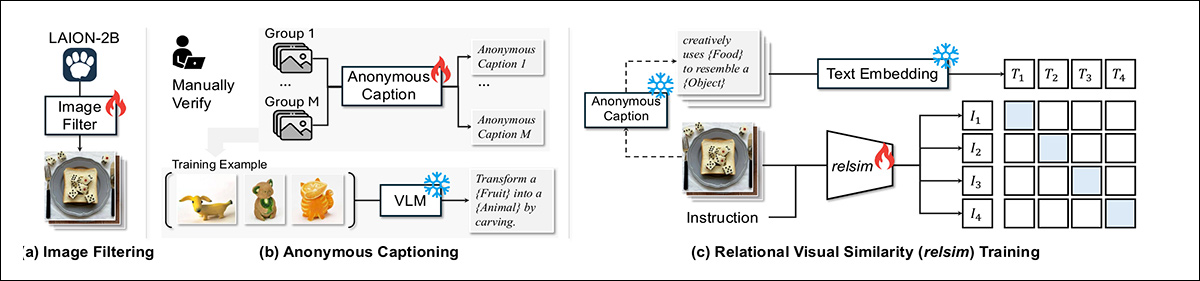

Das relsim-System wird in drei Stufen trainiert: Filtern von Bildern aus LAION-2B für relationale Inhalte; Zuweisung jeder Gruppe einer gemeinsamen anonymen Beschriftung, die die zugrunde liegende Logik erfasst; und Lernen, Bilder mit diesen Beschriftungen unter Verwendung eines kontrastiven Verlusts zu verbinden.

Das Papier besagt:

‘Die Annotatoren wurden angewiesen: „Können Sie in diesem Bild ein relationales Muster, eine Logik oder Struktur erkennen, die zur Erstellung oder Verbindung zu einem anderen Bild nützlich sein könnte?“ Das fein abgestimmte Modell erreicht 93 % Übereinstimmung mit menschlichen Urteilen und wenn es auf LAION-2B angewendet wird, ergibt es N = 114k Bilder, die als relational interessant identifiziert werden.’

Um relationale Labels zu generieren, wurden die Forscher aufgefordert, die Qwen-Modell zu verwenden, um die gemeinsame Logik hinter Bildsätzen zu beschreiben, ohne spezifische Objekte zu nennen. Diese Abstraktion war schwierig zu erhalten, wenn das Modell nur ein Bild sah, aber wurde machbar, wenn mehrere Beispiele das zugrunde liegende Muster demonstrierten.

Die resultierenden Gruppen-Beschriftungen ersetzten spezifische Begriffe durch Platzhalter wie ‘{Subjekt}’ oder ‘{Art der Bewegung}’, was sie allgemein anwendbar machte.

Nach menschlicher Überprüfung wurde jede Beschriftung mit allen Bildern in ihrer Gruppe gepaart. Mehr als 500 solcher Gruppen wurden verwendet, um das Modell zu trainieren, das dann auf die 114.000 gefilterten Bilder angewendet wurde, um eine große Menge abstrakter, relational annotierter Beispiele zu produzieren.

Daten und Tests

Nach der Extraktion relationaler Merkmale mit Qwen2.5-VL-7B wurde ein Modell mit LoRA auf den Daten fein abgestimmt, für 15.000 Schritte, via acht A100-GPUs*. Für die Textseite wurden relationale Beschriftungen mit all-MiniLM-L6-v2 aus der Sentence-Transformers-Bibliothek eingebettet.

Das Dataset von 114.000 beschrifteten Bildern wurde geteilt in 100.000 für das Training und 14.000 für die Auswertung. Um das System zu testen, wurde ein Retrieval-Setup verwendet: Gegeben ein Abfragebild, musste das Modell ein anderes Bild aus einem Pool von 28.000 Elementen finden, das die gleiche relationale Idee ausdrückt. Der Retrieval-Pool enthielt 14.000 Auswertungsbilder und 14.000 zusätzliche Beispiele aus LAION-2B, wobei 1.000 Abfragen zufällig aus dem Auswertungssatz für die Benchmarking-Auswertung ausgewählt wurden.

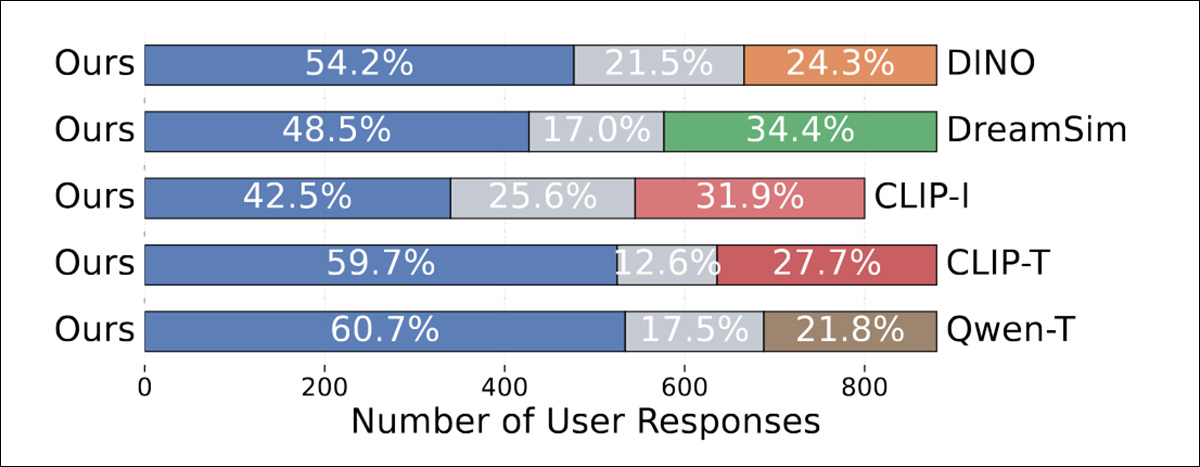

Um die Qualität des Retrievals zu bewerten, wurde GPT-4o verwendet, um die relationale Ähnlichkeit zwischen jeder Abfrage und dem abgerufenen Bild auf einer Skala von 0 bis 10 zu bewerten. Eine separate menschliche Studie wurde auch durchgeführt, um die Benutzerpräferenz zu messen (siehe unten).

Jeder Teilnehmer wurde ein anonymisiertes Abfragebild mit zwei Kandidaten gezeigt, einem, der durch die vorgeschlagene Methode abgerufen wurde, und einem anderen, der durch einen Baseline-Algorithmus abgerufen wurde. Die Teilnehmer wurden gefragt, welches Bild relational ähnlicher zum Abfragebild war oder ob beide gleich nah waren. Für jeden Baseline-Algorithmus wurden 300 Triplett-Sätze erstellt und von mindestens drei Personen bewertet, was etwa 900 Antworten ergab.

Der relsim-Ansatz wurde mit mehreren etablierten Bild-zu-Bild-Ähnlichkeitsmethoden verglichen, einschließlich des oben genannten LPIPS und DINO, sowie dreamsim und CLIP-I. Neben Baseline-Algorithmen, die direkte Ähnlichkeitswerte zwischen Bildpaaren berechnen, wie LPIPS, DINO, dreamsim und CLIP-I, testeten die Autoren auch Beschriftungsbasierte Methoden, bei denen Qwen verwendet wurde, um eine anonyme oder abstrakte Beschriftung für jedes Bild zu generieren; diese diente dann als Abfrage für das Retrieval.

Zwei Retrieval-Varianten wurden ausgewertet, wobei CLIP-basiertes Text-zu-Bild-Retrieval (CLIP-T) für Text-zu-Bild-Retrieval verwendet wurde und Qwen-T Text-zu-Text-Retrieval verwendete. Beide Beschriftungsbasierten Baseline-Algorithmen verwendeten das ursprüngliche vorgebildete Qwen-Modell und nicht die Version, die auf relationale Logik fein abgestimmt wurde. Dies ermöglichte es den Autoren, die Wirkung der gruppenbasierten Schulung zu isolieren, da das fein abgestimmte Modell Bildsätzen und nicht isolierten Beispielen ausgesetzt war.

Bestehende Metriken und relationale Ähnlichkeit

Die Autoren testeten zunächst, ob bestehende Metriken relationale Ähnlichkeit erfassen könnten:

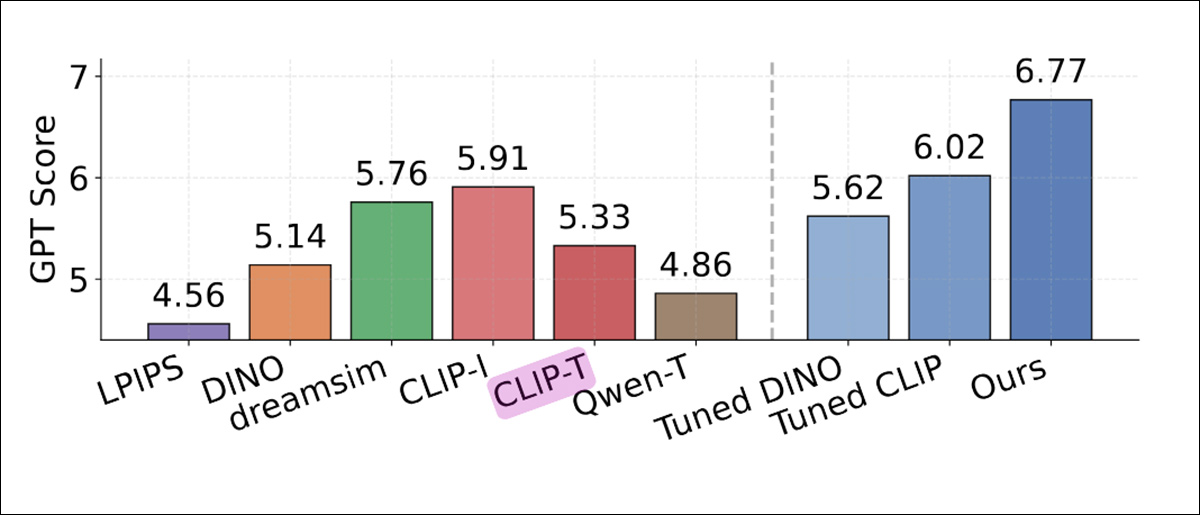

Vergleich des Retrieval-Verhaltens, bewertet durch GPT-4o, mit dem Durchschnittswert der relationalen Ähnlichkeit für jede Methode. Konventionelle Ähnlichkeitsmetriken wie LPIPS, DINO und CLIP-I erzielten niedrigere Werte. Beschriftungsbasierte Baseline-Algorithmen Qwen-T und CLIP-T unterboten ebenfalls. Der höchste Wert wurde durch relsim (6,77, rechte blaue Spalte) erzielt, was darauf hinweist, dass die Feinabstimmung auf gruppenbasierte relationale Muster die Übereinstimmung mit den Bewertungen von GPT-4o verbesserte.

In Bezug auf diese Ergebnisse stellen die Autoren fest**:

‘[LPIPS], das sich ausschließlich auf wahrnehmungsbezogene Ähnlichkeit konzentriert, erzielt den niedrigsten Wert (4,56). [DINO] führt nur slightly besser auf (5,14), wahrscheinlich, weil es ausschließlich selbstüberwacht auf Bilddaten trainiert wird. [CLIP-I] liefert die stärksten Ergebnisse unter den Baseline-Algorithmen (5,91), vermutlich, weil manchmal Abstraktion in Bildbeschriftungen vorhanden ist.

‘Jedoch unterbietet CLIP-I unsere Methode, da das Erzielen eines besseren Wertes möglicherweise die Fähigkeit erfordert, noch höhere Abstraktionsebenen zu erreichen, wie z. B. die in anonymen Beschriftungen.’

In der menschlichen Studie bevorzugten die Menschen konsequent den relsim-Ansatz gegenüber allen Baseline-Algorithmen:

Relationale Ähnlichkeitswerte, die durch GPT-4o für jede Methode zugewiesen werden. Standard-Ähnlichkeitsmetriken wie LPIPS, DINO und CLIP-I erzielten niedrigere Werte, und beschriftungsbasierte Varianten Qwen-T und CLIP-T führten nur slightly besser auf. Sogar justierte Versionen von DINO und CLIP schlossen die Lücke nicht. Der höchste Wert, 6,77, wurde durch das relsim-Modell erzielt, das mit gruppenbasierter Aufsicht trainiert wurde.

Die Autoren stellen fest:

‘Dies ist sehr ermutigend, da es nicht nur zeigt, dass unser Modell, relsim, erfolgreich relationale Bilder abrufen kann, sondern auch bestätigt, dass Menschen relationale Ähnlichkeit – und nicht nur Attributähnlichkeit – wahrnehmen!’

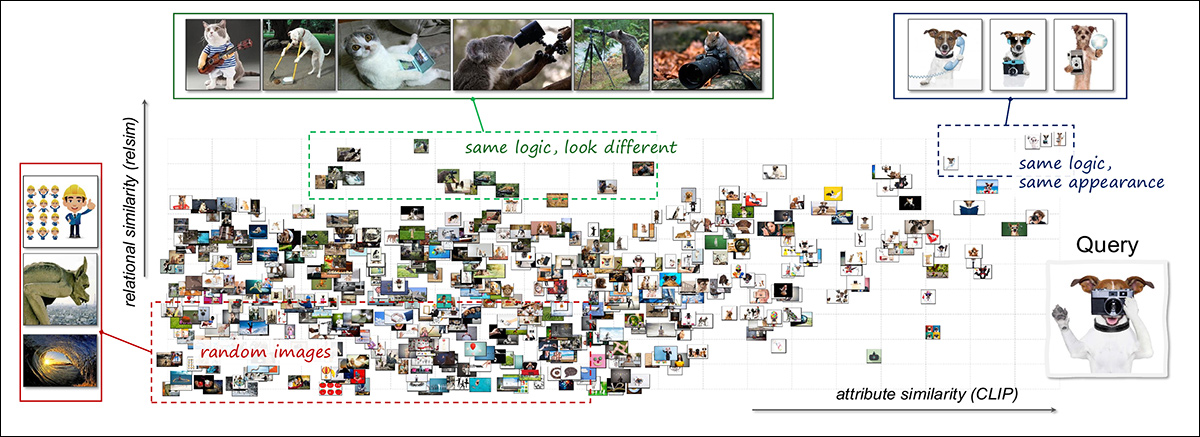

Um zu untersuchen, wie relationale und Attributähnlichkeit einander ergänzen könnten, verwendeten die Forscher eine kombinierte Visualisierungsmethode. Ein einzelnes Abfragebild (‘Ein Hund, der eine Kamera hält’) wurde mit 3.000 zufälligen Bildern verglichen, und die Ähnlichkeit wurde unter Verwendung beider relationaler und attributbasierter Modelle berechnet:

Gemeinsame Visualisierung des visuellen Ähnlichkeitsraums unter Verwendung relationaler und attributbasierter Achsen. Ein einzelnes Abfragebild, das einen Hund zeigt, der eine Kamera benutzt, wurde mit 3.000 anderen verglichen. Die Ergebnisse wurden nach relationaler Ähnlichkeit (vertikal) und Attributähnlichkeit (horizontal) organisiert. Die obere rechte Region enthält Bilder, die dem Abfragebild in Logik und Erscheinungsbild ähnlich sind, wie z. B. andere Hunde, die Werkzeuge benutzen. Die obere linke Region enthält semantisch verwandte, aber visuell unterschiedliche Fälle, wie z. B. verschiedene Tiere, die Kamera-aktionen ausführen. Die meisten verbleibenden Beispiele gruppieren sich tiefer im Raum, was schwächere Ähnlichkeit widerspiegelt. Die Anordnung zeigt, wie relationale und attributbasierte Modelle komplementäre Aspekte visueller Daten hervorheben. Bitte beachten Sie die Quelle für eine bessere Auflösung.

Die Ergebnisse zeigten Cluster, die verschiedenen Ähnlichkeitstypen entsprachen: Einige Bilder waren sowohl relational als auch visuell ähnlich, wie z. B. andere Hunde in menschlichen Posen; andere teilten relationale Logik, aber nicht Erscheinungsbild, wie z. B. verschiedene Tiere, die menschliche Aktionen nachahmen; der Rest zeigte weder.

Anwendungsfälle

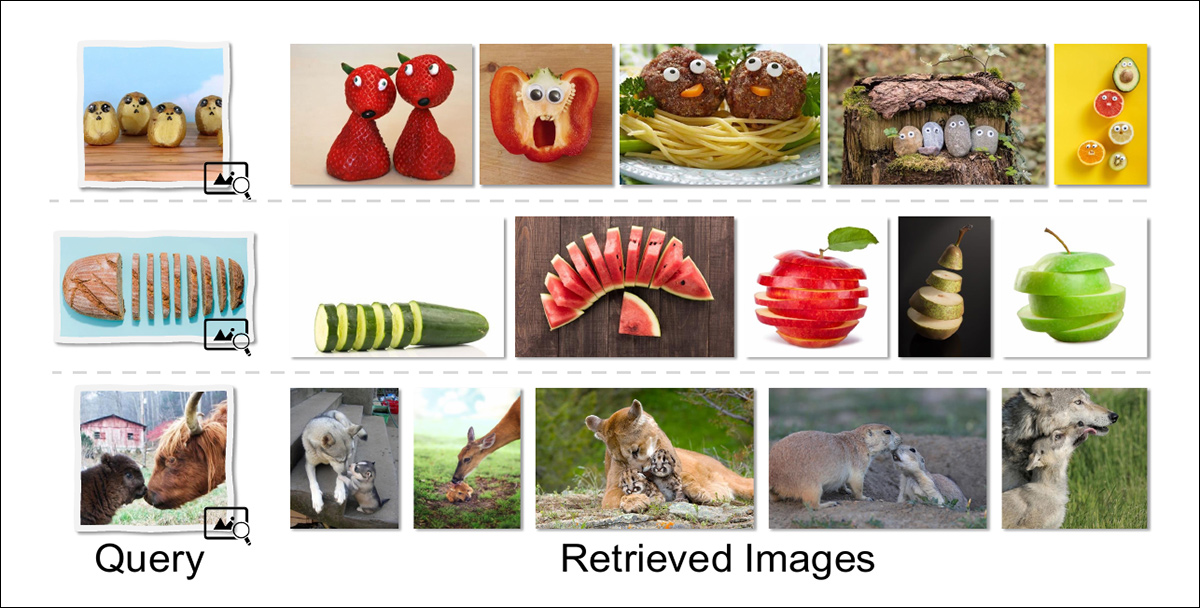

Das Papier erforscht auch einige mögliche Endanwendungsfälle für relationale Ähnlichkeit, einschließlich relationaler Bildsuche, die eine Bildsuche ermöglicht, die mehr mit der kreativen Art und Weise übereinstimmt, wie Menschen die Welt betrachten:

Relationale Suche gibt Bilder zurück, die eine tiefere konzeptuelle Struktur mit dem Abfragebild teilen, anstatt Oberflächenmerkmale zu entsprechen. Zum Beispiel gibt ein Nahrungsmittel, das einem Gesicht ähnelt, andere anthropomorphe Mahlzeiten zurück; ein geschnittenes Objekt gibt andere geschnittene Formen zurück; und Szenen von Erwachsenen-Kind-Interaktionen geben Bilder mit ähnlichen relationalen Rollen zurück, auch wenn die Arten und die Zusammensetzung unterschiedlich sind.

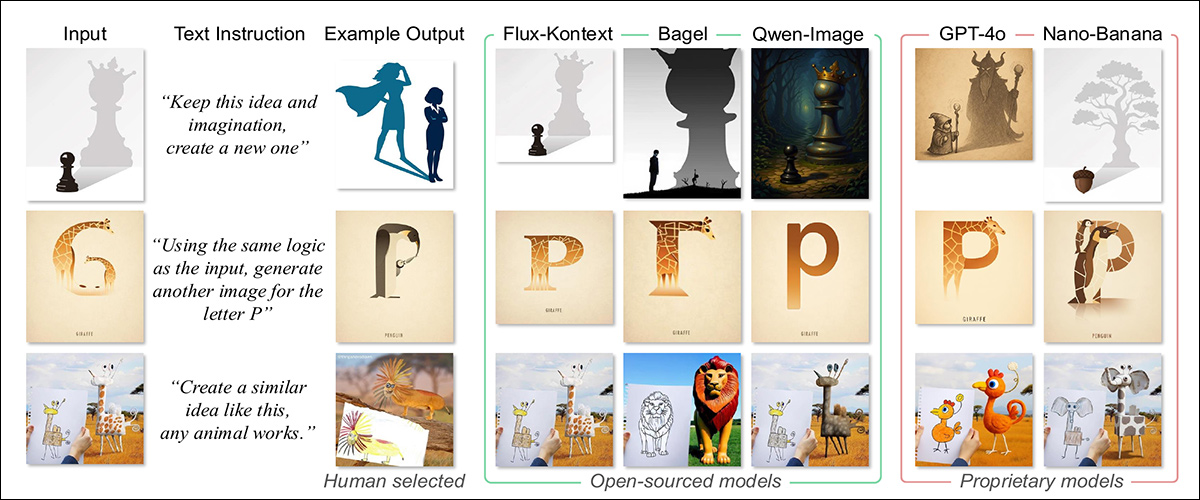

Eine weitere Möglichkeit ist analoge Bildgenerierung, die die Synthese von Abfragen ermöglichen würde, die relationale Strukturen anstelle von direkten Beschreibungen verwenden. Im Vergleich der Ergebnisse, die mit der aktuellen Generation von State-of-the-Art-Text-zu-Bild-Modellen erzielt wurden, ist es wahrscheinlich, dass die Ergebnisse eines solchen Ansatzes vielfältiger sind:

Gegeben ein Eingabebild und ein relationales Prompt, wurden die Modelle aufgefordert, ein neues Bild zu generieren, das das gleiche zugrunde liegende Konzept ausdrückt. Proprietäre Modelle produzierten treue Analogien, die strukturelle Logik über große Formänderungen hinweg bewahrten, während Open-Source-Modelle dazu neigten, auf buchstäbliche oder stilistische Übereinstimmungen zurückzugreifen, was dazu führte, dass sie die tieferen Ideen nicht übertrugen. Die Ausgaben wurden mit menschlich kuratierten Analogien verglichen, die die beabsichtigte Transformation veranschaulichten.

Schlussfolgerung

Generative KI-Systeme würden, wie es scheint, erheblich von der Fähigkeit profitieren, abstrakte Repräsentation in ihre Konzepte zu integrieren. Wie es derzeit steht, neigen Abfragen nach konzeptbasierten Bildern wie ‘Wut’ oder ‘Glück’ dazu, Bilder zurückzugeben, die aus den populärsten oder häufigsten Bildern in der Datenbank, die diese Assoziationen haben, gestylt sind; was Memorisation anstelle von Abstraktion ist.

Vermutlich könnte dieses Prinzip noch nützlicher sein, wenn es auf generative Schreibweise – insbesondere analytische, spekulative oder fiktive Ausgaben – angewendet werden könnte.

Drücken Sie zum Abspielen. Quelle

* Ein A100 kann 40Gb oder 80GB VRAM haben; dies wird im Papier nicht spezifiziert.

** Zitate der Autoren redundant und ausgeschlossen.

Erstveröffentlicht am Dienstag, den 16. Dezember 2025