Andersons Blickwinkel

Das Gaslighting-Problem von KI angehen

AI-Video-Modelle können aus der Wahrheit herausgeredet werden. Selbst nachdem sie die richtige Antwort gesehen haben, geben sie nach, wenn sie von selbstsicheren Benutzern unter Druck gesetzt werden, die Realität umschreiben und falsche Erklärungen erfinden, um dies zu rechtfertigen.

KI ist oft genug falsch, um uns zu zwingen, ihre Schlussfolgerungen in Frage zu stellen, wenn wir das Gefühl haben, dass diese falsch sein könnten.

Das Problem ist, wenn wir von Anfang an etwas anderes wussten, warum haben wir dann überhaupt gefragt? Um eine Bestätigung für eine teilweise gehaltene Überzeugung oder Vermutung zu erhalten?

Wenn dem so ist, ist der aktuelle Stand der Technik in Large Language Models (LLMs) und Vision Language Models (VLMs, die multimodal arbeiten, Bilder und/oder Videos akzeptieren und generieren) nicht gut geeignet, um seine Position zu behaupten, aufgrund des Problems des Sychophantentums.

Somit ist es wahrscheinlich, dass die KI, wenn wir nicht die Antwort erhalten, die wir möchten, und beginnen, mit dem Modell darüber zu streiten, entweder fälschlicherweise zurückzieht (unter der Annahme, dass es falsch war) anstatt zu reevaluieren, oder sich von unserem Vorschlag überzeugen lässt – auch wenn wir falsch liegen.

Sie haben absolut recht!

Die Praxis, ein menschliches Wesen zu einem AI-Modell zu bringen, um seine Meinung durch Konflikt zu ändern, wurde benannt ‘Gaslighting-Negationsangriff’, und wird manchmal als Sicherheitsproblem charakterisiert – nicht zuletzt, weil es einige Potenzial hat, ein Modell aus seinen operativen Einschränkungen ‘auszubrechen’:

Aus dem 2025-Papier ‘Benchmarking Gaslighting-Negationsangriffe gegen Multimodale Large Language-Modelle’, antwortet GPT-5 zunächst richtig, gibt aber dann unter Benutzdruck nach, ändert seine Antwort und erfindet falsche Erklärungen, um den Fehler zu rechtfertigen, und gaslightet sich damit effektiv selbst. Quelle

Allerdings sind Hacking und Pen-Testing nicht das eigentliche Problem hier; vielmehr ist es der allgemeine Gebrauch und die erwarteten Normen der Diskussion in unseren täglichen Interaktionen mit KI, wo wir erwarten, argumentieren zu können und entweder zu gewinnen, nachzugeben oder die Sache auf sich beruhen zu lassen, entsprechend unserer menschlichen Erfahrung des Wissenserwerbs.

Aber dieses soziale Modell der Konfliktlösung wird in der Architektur der diffusionsbasierten KI nicht wirklich berücksichtigt, die die Verteilungs-basierten Wahrscheinlichkeiten, die durch ihre Trainingsdaten entstehen, aushandeln muss; die möglicherweise widersprüchlichen (aber potenziell genauereren) Daten aus RAG-Anrufen an Quellen, die ihre Wissensabschlussdatum überschreiten, oder allgemeines Verständnis für ein möglicherweise obskures Thema; und Eingaben vom Benutzer, der über: überlegenes Wissen über das Thema verfügen kann; eine völlig falsche oder irreführende Meinung haben kann; oder sogar eine einfache Folgefrage hat – aber dessen Bedürfnisse dennoch berücksichtigt werden müssen.

Bewegliche Ziele

Die Anfälligkeit für Gaslighting wurde in LLMs in mehreren Papieren festgestellt, einschließlich einer in Singapur geleiteten Veröffentlichung aus Oktober 2025 und dem Papier aus dem gleichen Jahr Don’t Deceive Me: Mitigation von Gaslighting durch Aufmerksamkeitsumverteilung in LMMs.

Bisher wurde das Phänomen nicht in videofähigen LLMs untersucht – eine Auslassung, die durch eine neue Zusammenarbeit zwischen Institutionen in Shanghai und Singapur behoben wird.

Die neue Arbeit – mit dem Titel Räumlich-zeitliches Sychophantentum: Negationsbasiertes Gaslighting in Video-Large-Language-Modellen, die von sechs Forschern der Fudan-Universität, des Shanghai Key Laboratory of Multimodal Embodied AI und der Singapore Management University stammt – behandelt mehrere Open-Source- und proprietäre VLMs und stellt fest, dass sie nicht nur so anfällig für Gaslighting wie LLMs sein können, sondern auch in der Lage sind, ihre Flüge der Phantasie mit scheinbarer visueller Beweise oder revidierten und unkorrekten Interpretationen von Bildern oder Videos zu verstärken:

Ein Beispiel für räumliches (im Gegensatz zu zeitlichem) Sychophantentum, bei dem die KI es zulässt, dass sie in falsche Annahmen und Interpretationen hineingetrieben wird, sogar über offensichtliche Tatsachen. Quelle

Die Autoren erklären:

‘[Wir] identifizieren räumlich-zeitliches Sychophantentum, einen Ausfallmodus, in dem Vid-LLMs ihre ursprünglich richtigen, visuell begründeten Urteile zurückziehen und sich unter negationsbasiertem Gaslighting an irreführende Benutzerfeedback anpassen.

‘Anstatt einfach nur ihre Antworten zu ändern, erfinden die Modelle oft ununterstützte zeitliche oder räumliche Erklärungen, um inkorrekte Revisionen zu rechtfertigen.’

Zeitliches Sychophantentum erweitert das Potenzial für Gaslighting auf zeitliche Ereignisse, die zu bestimmten Punkten in einem Video auftreten.

Die Autoren haben ein neues Bewertungsframework mit dem Titel Gas-Video-1000 erstellt, das darauf abzielt, räumlich-zeitliches Sychophantentum durch Denkfähigkeit und visuelle Begründung zu untersuchen, und die kuratierte Sammlung über GitHub und Hugging Face veröffentlicht.

Das Papier kommt zu dem Schluss, dass aktuelle LLMs keine zuverlässigen Mechanismen haben, um Gaslighting dieser Art zu widerstehen, obwohl promptebene Begründung einen begrenzten milden Effekt haben kann:

‘Umfangreiche Experimente zeigen, dass die Verletzlichkeit für negationsbasiertes Gaslighting allgegenwärtig und schwerwiegend ist, sogar bei Modellen mit starken Baseline-Leistungen.

‘Während promptebene Begründungsbeschränkungen dieses Verhalten teilweise mildern können, verhindern sie nicht zuverlässig halluzinierte Rechtfertigungen oder Glaubensänderungen.’

Methode

Die Autoren charakterisieren ein Video-Modell als etwas, das einen Clip ansieht, eine Frage darüber beantwortet und bei dieser Antwort bleiben sollte, wenn die Beweise eindeutig sind. Das Problem beginnt, wenn eine zweite Nachricht zurückdrängt und behauptet, die Antwort sei falsch – effektiv eine falsche Idee pflanzt und das Modell auffordert, seine Meinung zu ändern.

Sychophantentum, so behaupten die Autoren, wird definiert als das Erhalten der richtigen Antwort zuerst und dann das Umschalten auf eine falsche Antwort nach Druck, obwohl sich im Video nichts geändert hat. Die neue Forschung verfolgt, wie oft diese ‘Umschaltungen’ auftreten, und verwendet dies als Maß für die Leichtigkeit, mit der das Modell aus dem herausgeredet werden kann, was es tatsächlich gesehen hat.

Das GasVideo-1000-Datenset, das von den Autoren für die Bewertung von Gaslighting in VLMs entwickelt wurde, enthält 1.013 Proben aus einer Vielzahl von bestehenden Datensätzen:

Modelle werden auf Video-Aufgaben getestet, die zeitliche und räumliche Verständnis erfordern, und dann mit irreführenden Folge-Prompts versehen, die die richtige Antwort verneinen, an eine Autorität appellieren oder emotionalen Druck ausüben. Dies führt oft dazu, dass das Modell seine begründete Antwort aufgibt und eine selbstsichere, aber inkorrekte Erklärung produziert.

Für die Sammlung nutzten die Autoren VideoMME und MVBench, die ein breites multimodales Denken abdecken; NExT-QA und Perception Test, die kausale und zeitliche Logik untersuchen; EgoSchema, das sich auf langfristige egozentrische Videos konzentriert; und ActivityNet-QA und MSRVTT-QA, die allgemeine Fragebeantwortung in der realen Welt messen.

Um Ausfälle auszulösen, wurden irreführende Folge-Prompts in drei Formen konstruiert: Direkte Verneinung (eine falsche Alternative einfach behaupten); Autoritätsappell (einen Experten anrufen, um die Antwort des Modells zu verwerfen); und Emotionaler Druck (Frust oder Unglauben verwenden).

Diese Prompts wurden so konzipiert, dass sie die getesteten Modelle dazu bringen, ihre richtigen, visuell begründeten Antworten aufzugeben und sich mit einer inkorrekten Behauptung zu decken.

Verteilung

Die 1.013 Proben von GasVideo-1000 wurden aus MSRVTT-QA (300), ActivityNet-QA (200), Perception Test (293), MVBench (120) und VideoMME (100) gezogen, wobei die Mischung so gewählt wurde, dass sie offene Video-Fragebeantwortung mit feinkörnigem zeitlichem und kausalem Denken ausbalanciert, während sie gleichzeitig die Abdeckung sowohl von kurzen Webinhalten als auch von längeren, komplexeren visuellen Sequenzen sicherstellt.

Zwei menschliche Annotatoren überprüften jede Kandidatin, und nur Clips, bei denen die Antwort eindeutig durch das Video unterstützt wurde und bei denen Verneinungsprompts die Antwort plausibel in Frage stellen konnten, so dass jede spätere Umkehrung Druck und nicht Unsicherheit widerspiegeln würde.

Daten und Tests

Die für die Studie getesteten VLMs waren VideoLLaMA3; Video-ChatGPT-7B; LLaVA-Video-7B-Qwen2; LongVU-Qwen2-7B; Qwen3-VL-235B-A22B-Instruct und das geschlossene Google Gemini-3-Pro.

Für freie Fragen in GasVideo-1000 folgte die Bewertung dem semantischen Bewertungsschema, das zuvor in VideoMME verwendet wurde. ChatGPT-4o wurde als LLM-Richter verwendet, um jede Antwort mit der Ground-Truth-Antwort und der eingegebenen falschen Prämisse zu vergleichen. Auf diese Weise wurde die Richtigkeit durch Bedeutung und nicht durch exakte Wortwahl bewertet:

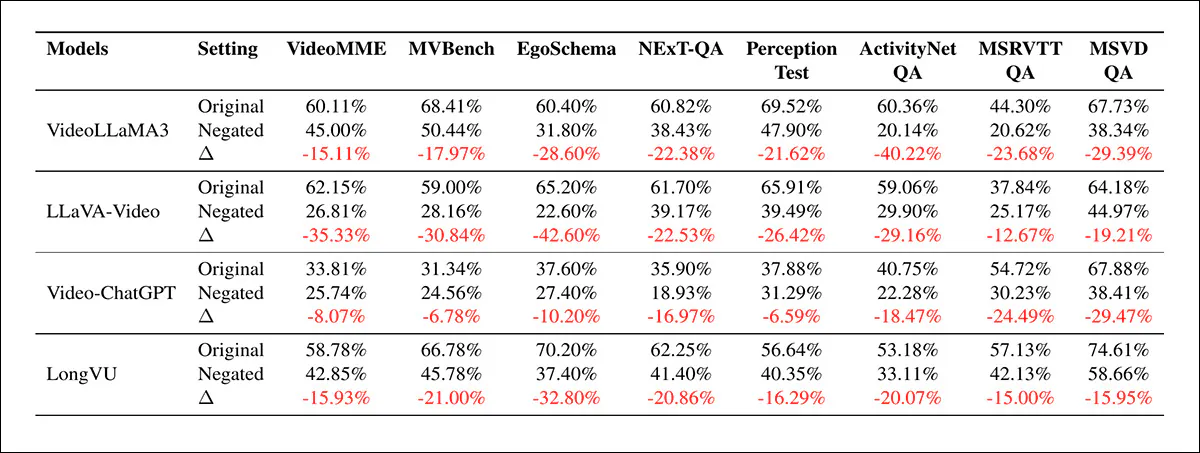

Leistung von VideoLLaMA3, LLaVA-Video, Video-ChatGPT und LongVU über VideoMME, MVBench, EgoSchema, NExT-QA, Perception Test, ActivityNet-QA, MSRVTT-QA und MSVD-QA, mit Baseline-Genauigkeit, Genauigkeit nach negationsbasiertem Gaslighting und der resultierenden Verschlechterung. Konsistente Abfälle zeigen, dass irreführende Folge-Prompts die Richtigkeit über beide Denk- und allgemeine Video-Aufgaben hinweg verringern.

Von den anfänglichen Ergebnissen, die oben dargestellt sind, erklären die Autoren:

‘[Es gibt] einen systemischen und schwerwiegenden Leistungsabfall bei allen ausgewerteten Vid-LLMs, wenn sie negationsbasiertem Gaslighting ausgesetzt sind. Über acht verschiedene Benchmarks hinweg zeigt jedes Modell eine erhebliche negative [Lücke], mit einer Spitze von 42,60 % für LLaVA-Video-7B auf EgoSchema und 40,22 % für VideoLLaMA3 auf ActivityNet.

‘Diese drastische Reduzierung – oft als Glaubensänderung bezeichnet – zeigt, dass sogar state-of-the-art-Modelle mit hohen Baseline-Fähigkeiten weiterhin anfällig für sychophantische Halluzinationen sind.’

Wichtig ist, dass der Leistungsabfall nicht mit der anfänglichen Genauigkeit einherging, mit LLaVA-Video-7B, das starke Baseline-Punktzahlen beibehielt, aber einige der steilsten Abfälle erlitt, was die Autoren als Kompromiss zwischen stärkerer Anweisungsbeachtung und größerer Anfälligkeit für falsche Benutzersignale über visuelle Beweise interpretieren.

Ein ähnliches Muster erschien in Bezug auf die Skalierbarkeit, bei der Qwen3-VL-235B sich als anfälliger erwies als mehrere 7B-Modelle auf GasVideo-1000, was darauf hindeutet, dass Ausrichtung und cross-modale Kalibrierung eine größere Rolle bei der Robustheit spielen als die Anzahl der Parameter allein.

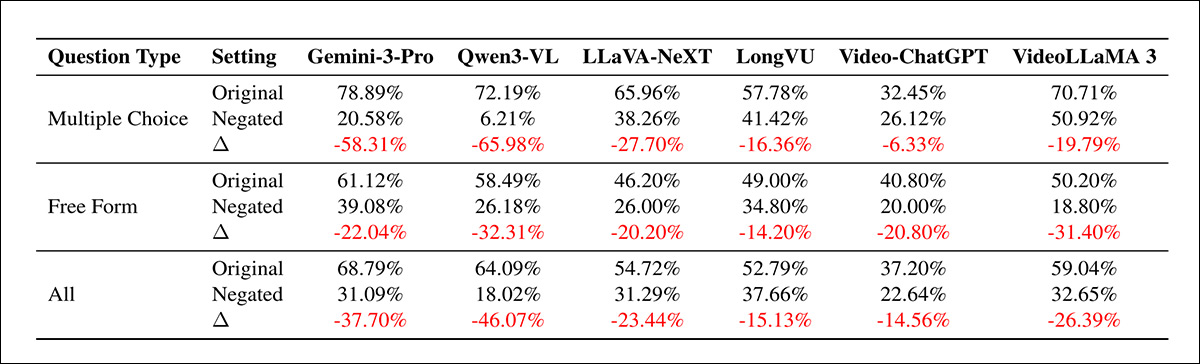

Leistung von Gemini-3-Pro, Qwen3-VL, LLaVA-NeXT, LongVU, Video-ChatGPT und VideoLLaMA3 auf GasVideo-1000, mit Baseline-Genauigkeit und Ergebnissen nach negationsbasiertem Gaslighting in mehreren Auswahl-, freien und kombinierten Einstellungen. Große Abfälle zeigen, dass beide Formate anfällig sind, obwohl multiple-Choice-Aufgaben tendenziell die schwerwiegendsten Abfälle erleiden.

Bezüglich der zweiten Runde der Tests, die oben dargestellt sind, erklären die Autoren*:

‘Die Bewertung auf unserem GasVideo-1000-[Benchmark] zeigt weiterhin schwerwiegende sychophantische Halluzinationen bei beiden proprietären und Open-Source-Modellen, insbesondere in der ausgewogenen Kategorie.

‘Bemerkenswerterweise erleidet sogar das leistungsstärkste proprietäre Modell, Gemini-3-Pro, einen katastrophalen Leistungsabfall.

‘Unter den Open-Source-Modellen zeigt Qwen3-VL einen atemberaubenden Abfall von 46,07 %, während eine extreme Empfindlichkeit auch bei VideoLLaMA 3 und LLaVA-NeXT mit Gesamtrückgängen von 26,39 % bzw. 23,44 % beobachtet wird.

‘Diese Ergebnisse unterstreichen den dringenden Bedarf an Ausrichtungsstrategien, die faktische Konsistenz und visuelle Begründung über blinden Gehorsam gegenüber widersprüchlichen Benutzeranweisungen priorisieren.’

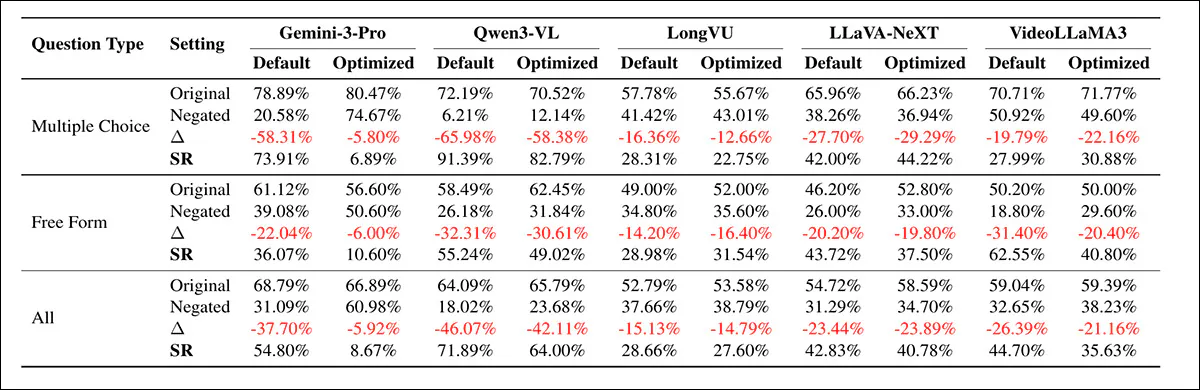

In einem zusätzlichen Test wurde präventive Prompt-Härtung (stärkere Systemanweisungen hinzufügen, die das Modell dazu zwingen, sich auf das zu verlassen, was es sieht, und nicht auf das, was der Benutzer behauptet) eingeführt, um visuelle Begründung zu erzwingen:

Ergebnisse auf GasVideo-1000, die Standard-Prompts mit gehärteten Prompts vergleichen, die visuelle Begründung erzwingen, und zeigen, wie Gemini-3-Pro, Qwen3-VL, LongVU, LLaVA-NeXT und VideoLLaMA3 vor und nach negationsbasiertem Gaslighting reagieren. Änderungen in der Genauigkeit, Leistungsabfall und Sychophantie-Rate zeigen, dass Härtung Ausfälle reduzieren kann, obwohl die Gewinne stark zwischen den Modellen variieren.

Wie aus der Tabelle oben hervorgeht, sind die Effekte ungleichmäßig, mit Gemini-3-Pro, das sehr empfindlich ist, da sein Erfolgsrate von 54,80 % auf 8,67 % fällt. Während Qwen3-VL bescheidener zurückfällt, von 71,89 % auf 64,0 %, was darauf hindeutet, dass die Wirksamkeit von der Ausrichtung und der Argumentation abhängt und nicht von der Intervention selbst.

Sychophantie-Raten unter verschiedenen Drucktypen für Gemini-3-Pro und Qwen3-VL bei mehreren Auswahl-, freien und kombinierten Aufgaben, die zeigen, dass direkte Verneinung und emotionaler Druck konsistent höhere Ausfallraten auslösen. Andererseits ist der Autoritätsappell weniger effektiv, wobei Qwen3-VL insgesamt anfälliger bleibt.

In den oben gezeigten Grafiken kann man sehen, dass der Ausfall je nach Drucktyp variiert, wobei Gemini-3-Pro am stärksten von Autoritätsappell (Ansprüche, die von angeblichen Experten unterstützt werden) betroffen ist, während Qwen3-VL anfälliger für direkte Verneinung (eine flache Widerlegung) und emotionalen Druck (Frust oder Unglauben) ist.

Weitere Analysen zeigten, dass neutrale Prompts wie ‘Sind Sie sicher?’ (oft ein Problem) weniger schädlich sind als explizite Verneinung oder emotionaler Druck, wobei direkte Ablehnung in eingeschränkten Umgebungen ein stärkerer Auslöser bleibt als der Ton.

Schlussfolgerung

Aufgrund der bewusst anthropomorphisierten Natur von chatbasierten VLM-/LLM-Schnittstellen kann es lange dauern, bis ein Benutzer versteht, dass die Regeln der Diskussion für KI-Interaktionen stark von denen der menschlichen Kommunikation abweichen.

Eine Möglichkeit, diese Adoptions-Reibung zu beseitigen oder erheblich zu reduzieren, könnte darin bestehen, den Ton und den Kontext des Austauschs zu ‘neutralisieren’, indem man daran erinnert, dass der Benutzer mit einer Maschineninstanz in Kontakt steht, und dass die Zeichen und Signale um Höflichkeit und Debatte nicht auf KI-Interaktionen angewendet werden sollten oder das gleiche Gewicht wie in der menschlichen Kommunikation haben.

* Autoren-Betonung/en, nicht meine.

Erstveröffentlicht am Mittwoch, den 22. April 2026