Andersons Blickwinkel

Verbosität verringert die Genauigkeit in großen Sprachmodellen

Neue Forschungsergebnisse zeigen, dass die Verpflichtung von großen Sprachmodellen, kürzere Antworten zu geben, die Genauigkeit und Qualität ihrer Antworten deutlich verbessert.

Jeder, der versucht hat, einen Chatbot davon abzuhalten, “schwätzig” zu sein, wird die Schlussfolgerungen neuer Forschungsergebnisse erkennen: Die Verpflichtung von KI, kürzere Antworten zu geben, macht sie genauer.

Bei der Untersuchung der Gründe, warum größere KI-Chatbots in bestimmten Fällen (bekannt als inverse Skalierung) schlechter abschneiden als kleinere, fand die Forschung heraus, dass die Verpflichtung von 31 beliebten großen Sprachmodellen (LLM), kürzere Antworten zu geben, zu einer Verbesserung der Genauigkeit ihrer Antworten um bis zu 26,3% führte:

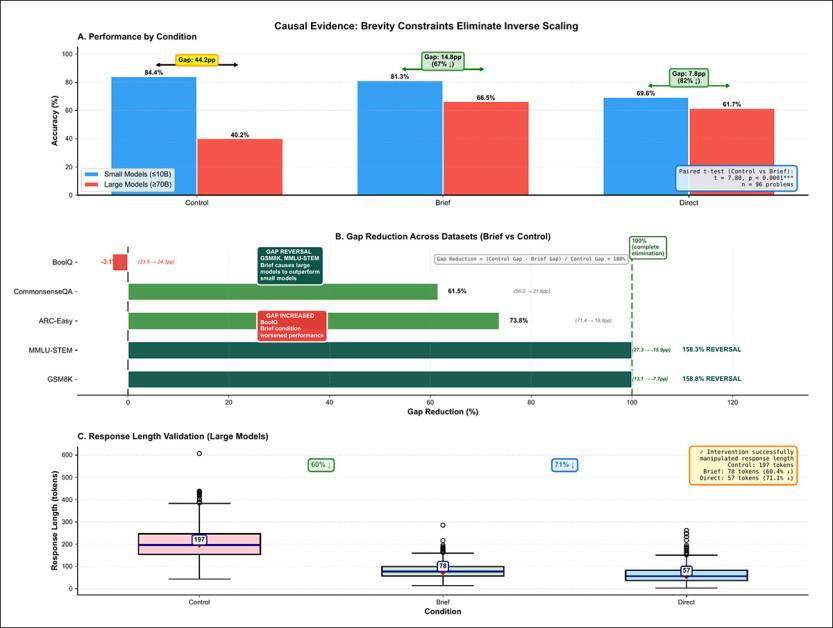

‘Die Ergebnisse liefern überzeugende kausale Beweise: Brevitätsbeschränkungen verbesserten die Genauigkeit großer Modelle um 26,3 Prozentpunkte und verringerten die inverse Skalierungslücke um 67% (von 44,2% auf 14,8%, gepaarter t-Test: t = 7,80, p < 0,0001).'

Übermäßige Verbosität ist ein häufiger Grund für Beschwerden unter Endnutzern, nicht zuletzt unter denen, die kommerzielle Modelle wie ChatGPT verwenden, wo die Supportforen dieses Thema häufig behandeln.

Der Bereich, der am meisten von der Behebung von Verbosität in Antworten betroffen ist, ist Mathematik, wo die getesteten KI-Modelle darauf beschränkt waren, in 50 Wörtern oder weniger zu antworten. Bei Leseverständnistests wurden sie auf eine bloße 10 Wörter in ihren Antworten beschränkt.

Die Studie definiert die Neigung von KI zur Verbosität als Überdenken, bei dem die zentrale Botschaft nicht nur von Worten verdunkelt wird, sondern manchmal auch negativ von ihnen beeinflusst wird. Je kleiner das Modell ist, beobachtet die Studie, desto weniger ist diese Abhilfe erforderlich oder wirksam.

Die Forschung kommt zu dem Schluss, dass es nichts architektonisches gibt, das angepasst werden muss, um diese Lösung systematisch anzuwenden. Allerdings würde in einer Benutzersitzung eine Anweisung zur Kürze wahrscheinlich wiederholt werden müssen, während ein global angewandter Systemprompt – der als Ingenieurstandard auf Plattformen wie ChatGPT implementiert werden müsste – kürzere Antworten zum Standardverhalten machen könnte.

Stürmische Winde

Nichts davon erklärt genau, warum größere Modelle tendenziell zu Verbosität neigen, da dies auch Open-Source-Modelle betrifft. Die Studie legt nahe, dass Protokolle und gängige Praktiken in Techniken des Reinforcement Learning von menschlichem Feedback (RLHF) eine Erklärung bieten könnten*:

‘Ein plausibler Ursprung ist RLHF-Ausrichtungstraining, bei dem menschliche Annotatoren Gründlichkeit unverhältnismäßig in größeren Modellen mit größerer Kapazität, auf Längensignalen zu reagieren, belohnen – konsistent mit Verbositätsunterschieden, die in anweisungsorientierten Varianten größer sind als in Basismodellvarianten.

‘Vorherige Arbeiten dokumentieren systematische Längenverzerrung in Belohnungs modellen, bei denen Annotatoren Länge mit Qualität verwechseln.

‘Größere Modelle, die eine größere Kapazität haben, um Längensignalen nachzukommen, internalisieren möglicherweise verbose Generation tiefer als kleinere Modelle, was zu der skalierten Überdenkens führt, die wir beobachten.’

Bei Menschen kann Verbosität auftreten, um eine Stille zu füllen, oder um unangenehme Gefühle zu maskieren, wegen psychischer Erkrankungen, oder um mangelndes Wissen zu verbergen. In der Tat könnte eine KI nur durch die Aufnahme von Trainingsdaten, die diese Merkmale widerspiegeln, von diesen Faktoren beeinflusst werden.

In Datensätzen gibt es andere Motivationen für umfangreiche Antworten, wie z.B. den SEO-Anreiz, längere Textinhalte zu produzieren, z.B. in Rezepten, bei denen Länge oft fälschlicherweise mit Autorität in Verbindung gebracht wird.

Was nicht vollständig ausgeschlossen werden kann, ist, dass API-basierte Plattformen, die Benutzer zu einem höheren und teureren Abonnement-Tarif drängen, entweder Verbosität fördern oder nicht überwachen, da sie Token-Nutzung erhöhen und ohne die Notwendigkeit für exzessives Denken oder RAG-Anrufe†.

Die neue Studie trägt den Titel Brevitätsbeschränkungen kehren Leistungs-Hierarchien in Sprachmodellen um und stammt aus der Abteilung für Informatik am Sweden Polytechnic Institute in Chattogram, in Bangladesch.

Methode

Um die Theorien der Studie zu testen, wurden 31 Sprachmodelle ausgewertet – zu viele, um sie hier in Textform aufzulisten, aber in dem folgenden Bild dargestellt:

Die großen Sprachmodelle (LLM), die in verschiedenen Teilen der Studien für die neue Studie getestet wurden.

Die Modelle wurden gegen fünf Benchmark-Sammlungen ausgewertet: GSM8K, für mathematisches Denken; BoolQ, für Leseverständnis; CommonsenseQA, für allgemeines Denken; ARC-Easy, für naturwissenschaftliche Fragen; und MMLU-STEM, auch für naturwissenschaftliche Kenntnisse.

Antworten wurden mit gierigem Dekodieren generiert, um deterministische Ausgaben zu gewährleisten, dann mit taskspezifischen Regeln extrahiert, wobei die Genauigkeit als Anteil korrekter Antworten gegen Ground-Truth gemessen wurde.

Modelle wurden nach Größe aufgeteilt, wobei Modelle mit bis zu zehn Milliarden Parametern als “klein” und Modelle über siebzig Milliarden als “groß” behandelt wurden, basierend auf beobachteten Leistungsunterschieden.

Inverse Skalierung wurde quantifiziert, indem die Leistung dieser Gruppen bei jedem Problem verglichen wurde, wobei Fälle markiert wurden, in denen kleinere Modelle größere Modelle übertrafen; der statistische Effektgröße wurde dann verwendet, um zu bestätigen, dass diese Lücken konsistente, bedeutungsvolle Unterschiede widerspiegeln und nicht nur Rauschen.

Ausschluss von Erinnerung

Um die Möglichkeit auszuschließen, dass Modelle einfach Trainingsdaten abrufen, wurden drei separate Kontrollen durchgeführt, um zu untersuchen, wie sehr die Antworten variierten; wie viel ihre Länge schwankte; und wie Fehler gemacht wurden. Wenn Modelle auf gemerkte Muster angewiesen wären, würden Antworten tendenziell wiederholt oder feste Vorlagen folgen; stattdessen erwiesen sich Antworten als überwiegend einzigartig über Modelle hinweg, mit bemerkbarer Variation in Länge, von einer Antwort zur anderen.

Fehler wurden auch direkt untersucht, wobei die meisten Ausfälle die Form von langen, falschen Erklärungen annahmen, anstatt kurzer, ausweichender Antworten – was darauf hindeutet, dass die Modelle tatsächliches Denken generierten, anstatt gespeicherte Antworten abzurufen.

Daten und Tests

Beim Testen einzelner Fragen anstelle von Schlagzeilenergebnissen stellte sich heraus, dass ein großer Anteil von Benchmark-Aufgaben uninformativ war, mit 27,1%, die Modelle überhaupt nicht trennten, da entweder jedes System erfolgreich war oder jedes System fehlte, was keine echten Signale über relative Leistung lieferte:

Problembezogene Aufschlüsselung über fünf Benchmarks hinweg zeigte, dass ein erheblicher Anteil von Aufgaben Modelle nicht trennte, während ein kleinerer, aber konsistenter Anteil inverse Skalierung aufwies, bei der kleinere Modelle größere übertrafen. Die Gesamtaufschlüsselung über 1.485 Probleme zeigt, dass 7,7% inverse Skalierung aufweisen. Quelle

Unter den Fragen, die tatsächlich Modelle unterschieden, verhielten sich die meisten wie erwartet, wobei größere Systeme besser abschnitten, aber eine kleinere Gruppe zeigte das Gegenteil, wobei kleinere Modelle besser abschnitten. Über alle Probleme hinweg trat inverse Skalierung in 7,7% der Fälle auf, was darauf hindeutet, dass der Effekt nicht marginal ist.

Inverse Skalierung auftritt

Über die fünf Benchmarks hinweg wurden 115 Probleme gefunden, bei denen kleinere Modelle größere Modelle übertrafen, was 7,7% aller 1.485 Aufgaben ausmacht, was darauf hindeutet, dass inverse Skalierung in diesem Zusammenhang kein seltener oder marginaler Effekt ist.

Tatsächlich trat der Effekt in jedem Datensatz auf: am stärksten in BoolQ und schwächer in CommonsenseQA, ARC-Easy, GSM8K und MMLU-STEM, was darauf hindeutet, dass er weit verbreitet ist, aber je nach Aufgabe variiert:

Inverse Skalierung trat über alle Benchmarks hinweg auf, von 3,9% in MMLU-STEM bis 11,3% in BoolQ, mit 115 Problemen insgesamt. Leistungsunterschiede begünstigten kleinere Modelle im Durchschnitt um 28,4 Prozentpunkte. Die Genauigkeit sank, als die Modellgröße zunahm, wobei kleinere Modelle 66,1% erreichten, im Vergleich zu 41,5% für größere Modelle.

Die Größe der Lücke erwies sich als erheblich, wobei kleinere Modelle im Durchschnitt um 28,4 Prozentpunkte voraus waren, und jeder Fall zeigte die gleiche Richtung des Vorteils, was auf einen konsistenten Leistungsabfall und nicht auf gelegentliche oder ad-hoc-Fehler hindeutet.

Das gleiche Muster galt über verschiedene Modellfamilien hinweg, einschließlich Llama, Qwen, Gemma und Mistral, bei denen größere Versionen schlechter abschnitten als kleinere, wobei die Genauigkeit tendenziell sank, als die Modellgröße bei diesen Problemen zunahm.

Die Lücke zwischen kleinen und großen Modellen war groß genug, dass Zufall sie unwahrscheinlich erklären würde; und da das gleiche Muster über verschiedene Benchmarks, Aufgaben und Modellfamilien hinweg auftrat, trat inverse Skalierung als konsistenter Effekt auf.

Bei der Betrachtung innerhalb jeder Modellfamilie schnitten größere Versionen wiederholt schlechter ab als kleinere auf diesen Problemen, was darauf hindeutet, dass der Leistungsabfall möglicherweise an die Skalierung selbst und nicht an Unterschiede im Design gebunden ist.

Die Ergebnisse deuten auch auf eine Grenze für jede Aufgabe hin, bei der die Erhöhung der Modellgröße beginnt, die Leistung zu beeinträchtigen, was zeigt, dass größere Modelle nicht immer zu besseren Ergebnissen führen.

Überdenken untersuchen

Nachdem festgestellt wurde, dass größere Modelle manchmal in bestimmten Bereichen schlechter abschneiden, wandte sich die Analyse der Frage zu, warum dies geschieht, und schlug vor, dass das Problem nicht mangelnde Fähigkeit, sondern zu viel Erklärung ist – d.h. Fälle, in denen längere Antworten beginnen, korrektes Denken zu verbergen.

Über die Daten hinweg wurden längere Antworten mit geringerer Genauigkeit bei diesen schwierigen Problemen in Verbindung gebracht, obwohl große und kleine Modelle etwa gleich viele Denkschritte produzierten, was darauf hindeutet, dass das Problem nicht darin besteht, wie viel Denken durchgeführt wird, sondern wie es ausgedrückt wird:

Kürzere Antworten verbesserten die Leistung großer Modelle und verringerten die Lücke mit kleineren Modellen, indem sie den Unterschied von 44,2 Prozentpunkten auf 14,8 verringerten (und in einigen Fällen sogar umkehrten), während direkte Antwortformate die Lücke weiter verkleinerten. Die stärksten Gewinne traten in GSM8K und MMLU-STEM auf, wo die Rangfolge zugunsten größerer Modelle umkehrte und Überprüfungen der Antwortlänge bestätigten, dass die Maßnahme funktionierte, wobei die Ausgaben von etwa 197 Token auf unter 80 sanken, was kürzere Antworten mit verbesserter Genauigkeit in Verbindung brachte.

Wenn Antworten gezwungen wurden, kürzer zu sein, verbesserten sich große Modelle deutlich, verringerten eine erhebliche Leistungsunterschiede und eliminierten sie in einigen Fällen fast vollständig. Im Gegensatz dazu änderten sich kleine Modelle nur sehr wenig, was darauf hindeutet, dass Verbosität aktiv größere Systeme schädigte.

Der Effekt erwies sich als variabel je nach Aufgabe, wobei einige Benchmarks stark von kürzeren Antworten profitierten und andere ein gewisses Maß an Erklärung erforderten; jedoch kehrte die Rangfolge zwischen kleinen und großen Modellen in einigen Fällen vollständig um, als soon Verbosität eingeschränkt wurde, was darauf hindeutet, dass größere Modelle verborgene Fähigkeiten hatten, die durch übermäßige Ausführlichkeit maskiert wurden.

Weitere Analysen zeigten, dass große Modelle tendenziell längere Ausgaben produzierten, obwohl sie nur leicht weniger explizite Denkschritte verwendeten, was auf einen diffuseren und weniger strukturierten Denkstil hindeutet.

Im Gegensatz dazu gaben kleinere Modelle kürzere, direktere Antworten, was darauf hindeutet, dass die Art und Weise, wie Denken ausgedrückt wird, und nicht die Menge an Denken selbst, den Leistungsabfall antreibt.

Die Autoren kommen zu dem Schluss, dass Brevitätsbeschränkungen Genauigkeitsvorteile mit sich bringen, und erwägen, dass dies zu einem grundlegenden Merkmal in Sprachmodellen werden könnte, anstatt eine wiederholte, benutzerseitige Einschränkung, die nicht über Sitzungen hinweg besteht; und sie stellen fest:

‘[Brevitätsbeschränkungen] helfen großen Modellen dramatisch, während sie kleine Modelle kaum beeinflussen.

‘Wenn Verbosität nicht ursächlich, sondern eher zufällig wäre, würden wir einheitliche Genauigkeitsänderungen über beide Größenkategorien hinweg erwarten. Die unterschiedliche Reaktion bestätigt, dass Überdenken ein skaliertes Versagen ist, nicht eine Aufgabenschwierigkeit.’

Schlussfolgerung

Über die getesteten Open-Source-Versionen hinaus scheint das Verbositätsproblem, anekdotisch, mit einer bestimmten Häufigkeit über viele große Modelle hinweg auf, einschließlich Claude, Gemini und Grok.

Ob diese Plattformen das Verbositätsproblem übersehen, weil es Token-Nutzung erhöht und höhere Ausgaben fördert†, es erscheint nicht vernünftig, dass sie den damit verbundenen Genauigkeitsverlust akzeptieren würden.

Es wäre interessant zu sehen, ob eine empirische Methode bestimmen könnte, woher die Tendenz zur Verbosität kommt. Jeder, der jemals versucht hat, einen Chatbot dazu zu bringen, tatsächlich zu chatten, anstatt “schwätzige”, mehrschrittige Antworten zu geben, wird erkannt haben, dass das Modell stark mit “Alles-in-einem”-Benutzerhandbüchern und “akzeptierten Lösungen” in seinen Trainingsdaten geprägt ist.

Es wäre daher sehr interessant zu sehen, ob ein Modell, das speziell auf schrittweise Konversationen trainiert wurde, tatsächlich von der verbosen, zusammenfassenden Tendenz abrücken könnte. Allerdings scheint es wahrscheinlich, dass einige Einschränkungen oder Filter auf das Gewicht gelegt werden müssten, das dem Modell beigebracht wird, auf die “entschiedene” Antwort, damit es direkt auch auf das vorhergehende Material – im Wesentlichen die explizite Begründung in schrittweisen Konversationen – trainiert.

Da entsprechende Daten dieser Art wahrscheinlich rar sind, könnte der einzige Weg vorwärts mit diesem Ansatz über synthetische Daten führen, bei denen “zusammengesetzte” endgültige Schlussfolgerungen konversationell auseinandergezogen werden – ironischerweise in ähnlicher Weise, wie die KI-Podcasts, die Google NotebookLM interpretieren kann, aus plainem Textinput.

* Meine Umwandlung der inline-Zitate der Autoren in Hyperlinks.

† aber lasst uns ehrlich sein, der Rückstand zwischen den tatsächlichen KI-Bereitstellungskosten und den Abonnementgebühren ist derzeit so groß, dass dies lediglich den Ruf der Benutzerbasis schädigen würde, ohne die schwerwiegenden Grundökonomiken dieser Phase der “Umstellung” und “Konvergenz” von KI zu lösen.

Erstveröffentlicht am Sonntag, 5. April 2026