Andersons Blickwinkel

Kleinere Deepfakes können eine größere Bedrohung darstellen

Conversational-AI-Tools wie ChatGPT und Google Gemini werden nun verwendet, um Deepfakes zu erstellen, die keine Gesichter austauschen, sondern auf subtile Weise die gesamte Geschichte innerhalb eines Bildes umschreiben. Durch die Änderung von Gesten, Requisiten und Hintergründen täuschen diese Bearbeitungen sowohl AI-Detektoren als auch Menschen, was die Einsätze für das Erkennen dessen, was online real ist, erhöht.

In der aktuellen Lage, insbesondere im Gefolge bedeutender Gesetze wie dem TAKE IT DOWN-Gesetz, assoziieren viele von uns Deepfakes und AI-gesteuerte Identitätssynthese mit nicht einvernehmlicher AI-Pornografie und politischer Manipulation – im Allgemeinen groben Verzerrungen der Wahrheit.

Dies gewöhnt uns daran, AI-manipulierte Bilder immer mit hochkarätigem Inhalt zu assoziieren, wo die Qualität der Darstellung und die Manipulation des Kontexts möglicherweise einen Glaubwürdigkeitscoup erreichen, zumindest auf kurze Sicht.

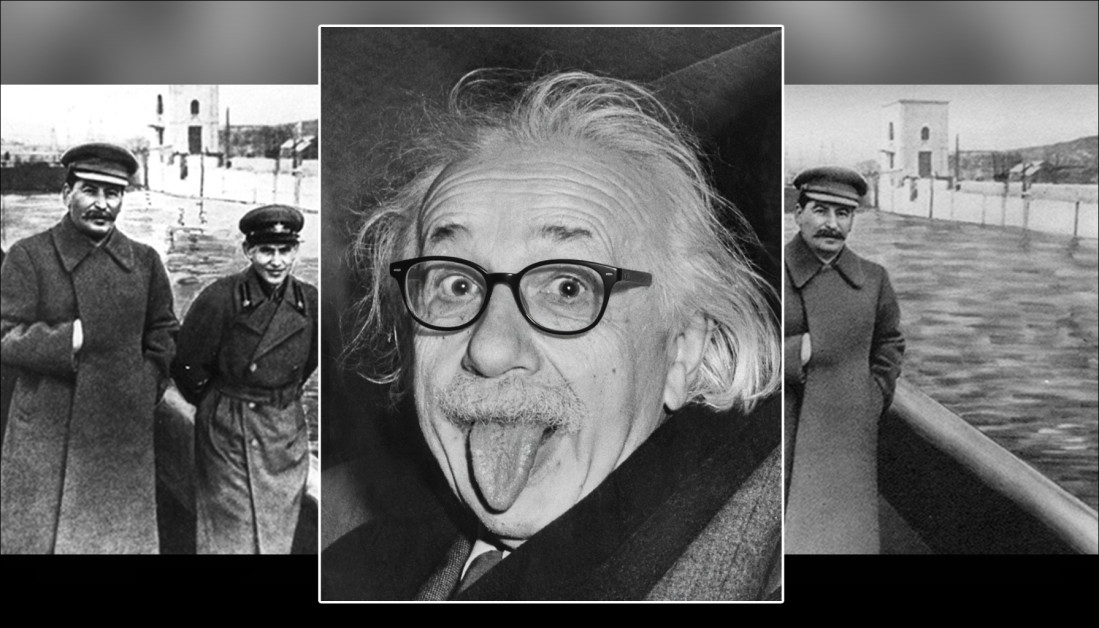

Historisch gesehen hatten jedoch viel subtilere Veränderungen oft eine sinistere und nachhaltigere Wirkung – wie die staatlich geförderte photographische Trickkunst, die es Stalin ermöglichte, diejenigen zu entfernen, die in Ungnade gefallen waren, aus dem photographischen Archiv, wie in dem George-Orwell-Roman Nineteen Eighty-Four satirisch dargestellt, in dem der Protagonist Winston Smith seine Tage damit verbringt, die Geschichte umzuschreiben und Fotos erstellen, zerstören und “korrigieren” zu lassen.

In dem folgenden Beispiel ist das Problem mit dem zweiten Bild, dass wir “nicht wissen, was wir nicht wissen” – dass der ehemalige Leiter von Stalins Geheimpolizei, Nikolai Jeschow, den Raum einnahm, wo jetzt nur noch eine Schutzbarriere ist:

Jetzt siehst du ihn, jetzt ist er… verdampft. Stalins photographische Manipulation entfernt ein aus der Gunst gefallenes Parteimitglied aus der Geschichte. Quelle: Public Domain, via https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

Strömungen dieser Art, die oft wiederholt werden, bestehen auf viele Weise; nicht nur kulturell, sondern auch in der Computer-Vision selbst, die Trends aus statistisch dominanten Themen und Motiven in Trainingsdatensätzen ableitet. Um ein Beispiel zu geben, bedeutet die Tatsache, dass Smartphones die Einstiegshürde gesenkt und massiv die Kosten der Fotografie gesenkt haben, dass ihre Ikonographie unvermeidlich mit vielen abstrakten Konzepten assoziiert wird, auch wenn dies nicht angebracht ist.

Wenn herkömmliches Deepfaking als ein Akt des “Angriffs” wahrgenommen werden kann, sind schädliche und anhaltende geringfügige Veränderungen in audiovisuellen Medien eher mit “Gaslighting” vergleichbar. Darüber hinaus macht die Fähigkeit dieser Art von Deepfaking, unbemerkt zu bleiben, es schwierig, sie mit Hilfe von State-of-the-Art-Deepfake-Erkennungssystemen (die nach groben Veränderungen suchen) zu identifizieren. Dieser Ansatz ist eher mit Wasser, das über einen längeren Zeitraum Felsen abträgt, als mit einem Felsen, der auf einen Kopf geworfen wird.

MultiFakeVerse

Forscher aus Australien haben einen Versuch unternommen, die mangelnde Aufmerksamkeit für “subtile” Deepfaking in der Literatur zu adressieren, indem sie einen umfangreichen neuen Datensatz von personenbezogenen Bildmanipulationen kuratierten, die Kontext, Emotion und Erzählung ohne Änderung der Kernidentität des Subjekts verändern:

Beispiele aus der neuen Sammlung, reale/falsche Paare, mit einigen Veränderungen, die subtiler sind als andere. Beachten Sie beispielsweise den Verlust von Autorität für die asiatische Frau, unten rechts, wenn ihr Arztestethoskop durch AI entfernt wird. Gleichzeitig hat die Ersetzung des Arzt-Blocks durch das Klemmbrett keinen offensichtlichen semantischen Winkel. Quelle: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

Mit dem Titel MultiFakeVerse besteht die Sammlung aus 845.826 Bildern, die über Vision-Sprachmodelle (VLMs) generiert wurden, die online zugänglich und mit Genehmigung heruntergeladen werden können.

Die Autoren erklären:

‘Dieser VLM-gesteuerte Ansatz ermöglicht semantische, kontextbewusste Veränderungen wie die Modifizierung von Aktionen, Szenen und menschlichen Objektinteraktionen, anstatt synthetischer oder niedrigstufiger Identitätsaustausch und regionsspezifischer Bearbeitungen, die in bestehenden Datensätzen üblich sind.’

‘Unsere Experimente zeigen, dass aktuelle State-of-the-Art-Deepfake-Erkennungsmodelle und menschliche Beobachter Schwierigkeiten haben, diese subtilen, aber bedeutungsvollen Manipulationen zu erkennen.’

Die Forscher testeten sowohl Menschen als auch führende Deepfake-Erkennungssysteme auf ihrem neuen Datensatz, um zu sehen, wie gut diese subtilen Manipulationen identifiziert werden konnten. Menschliche Teilnehmer hatten Schwierigkeiten, Bilder nur etwa 62 % der Zeit richtig als real oder falsch zu klassifizieren und hatten noch größere Schwierigkeiten, zu bestimmen, welche Teile des Bildes verändert worden waren.

Bestehende Deepfake-Detektoren, die hauptsächlich auf offensichtliche Gesichtsaustausch- oder Inpainting-Datensätze trainiert wurden, funktionierten ebenfalls schlecht und konnten oft nicht registrieren, dass eine Manipulation vorgenommen worden war. Selbst nach Feinabstimmung auf MultiFakeVerse blieben die Erkennungsraten niedrig, was zeigt, wie schlecht aktuelle Systeme diese subtilen, erzählungsgetriebenen Bearbeitungen handhaben.

Das neue Papier trägt den Titel Multiverse Through Deepfakes: Der MultiFakeVerse-Datensatz von personenbezogenen visuellen und konzeptuellen Manipulationen und stammt von fünf Forschern aus der Monash University in Melbourne und der Curtin University in Perth. Code und verwandte Daten wurden auf GitHub veröffentlicht, zusätzlich zur Hugging-Face-Veröffentlichung, die zuvor erwähnt wurde.

Methode

Der MultiFakeVerse-Datensatz wurde aus vier realen Bildsätzen erstellt, die Menschen in verschiedenen Situationen zeigen: EMOTIC; PISC, PIPA und PIC 2.0. Beginnend mit 86.952 Originalbildern produzierten die Forscher 758.041 manipulierte Versionen.

Die Gemini-2.0-Flash– und ChatGPT-4o-Framework wurden verwendet, um sechs minimale Bearbeitungen für jedes Bild vorzuschlagen – Bearbeitungen, die darauf ausgelegt waren, die Wahrnehmung der prominentesten Person im Bild subtil zu verändern.

Die Modelle wurden angewiesen, Veränderungen zu generieren, die das Subjekt naiv, stolz, reumütig, unerfahren oder nonchalant erscheinen lassen oder eine tatsächliche Änderung in der Szene vorzunehmen. Zusammen mit jeder Bearbeitung produzierten die Modelle auch einen Bezugsausdruck, um den Zielort der Bearbeitung in jedem Bild eindeutig zu identifizieren, was den nachfolgenden Bearbeitungsprozess ermöglichte, Änderungen am richtigen Menschen oder Objekt in jedem Bild vorzunehmen.

Die Autoren klären:

‘Beachten Sie, dass Bezugsausdruck ein weithin erforschtes Gebiet in der Gemeinschaft ist, das bedeutet, eine Phrase, die den Zielort in einem Bild eindeutig identifizieren kann, z. B. für ein Bild mit zwei Männern, die auf einem Schreibtisch sitzen, von denen einer am Telefon spricht und der andere durch Dokumente blättert, wäre ein geeigneter Bezugsausdruck für den Letzteren der Mann auf der linken Seite, der ein Stück Papier hält.’

Sobald die Bearbeitungen definiert waren, wurde die tatsächliche Bildbearbeitung von Vision-Sprachmodellen durchgeführt, die die spezifizierten Änderungen vornahmen, während der Rest der Szene intakt blieb. Die Forscher testeten drei Systeme für diese Aufgabe: GPT-Image-1; Gemini-2.0-Flash-Bildgenerierung; und ICEdit.

Nach der Generierung von 22.000 Beispielbildern erwies sich Gemini-2.0-Flash als das konsistenteste Verfahren, das Bearbeitungen produzierte, die sich natürlich in die Szene einfügten, ohne sichtbare Artefakte einzuführen; ICEdit produzierte oft offensichtlichere Fälschungen mit bemerkbaren Fehlern in den geänderten Bereichen; und GPT-Image-1 beeinflusste gelegentlich unbeabsichtigte Teile des Bildes, teilweise aufgrund seiner Konformität mit festen Ausgabe-Aspekt-Verhältnissen.

Bildanalyse

Jedes manipulierte Bild wurde mit seinem Original verglichen, um zu bestimmen, wie viel des Bildes geändert worden war. Die pixelweisen Unterschiede zwischen den beiden Versionen wurden berechnet, wobei kleiner zufälliger Rausch gefiltert wurde, um sich auf bedeutungsvolle Bearbeitungen zu konzentrieren. In einigen Bildern waren nur winzige Bereiche betroffen; in anderen wurde bis zu achtzig Prozent der Szene geändert.

Um zu bewerten, wie sehr die Bedeutung jedes Bildes im Lichte dieser Änderungen verschoben wurde, wurden Untertitel für sowohl das Original- als auch das manipulierte Bild mit dem ShareGPT-4V-Vision-Sprachmodell generiert.

Diese Untertitel wurden dann in Einbettungen mit Long-CLIP umgewandelt, was einen Vergleich ermöglichte, wie weit der Inhalt zwischen den Versionen abgewichen war. Die stärksten semantischen Änderungen wurden in Fällen gesehen, in denen Objekte in der Nähe oder direkt mit der Person in Verbindung stehend geändert worden waren, da diese kleinen Anpassungen die Interpretation des Bildes erheblich verändern konnten.

Gemini-2.0-Flash wurde dann verwendet, um die Art der Manipulation zu klassifizieren, die auf jedes Bild angewendet wurde, basierend auf der Art und Weise, wie die Bearbeitungen vorgenommen wurden. Manipulationen wurden in drei Kategorien unterteilt: personenbezogene Bearbeitungen umfassten Änderungen an der Gesichtsausdruck, Pose, Blick, Kleidung oder anderen persönlichen Merkmalen des Subjekts; objektbezogene Bearbeitungen betrafen Objekte, die mit der Person in Verbindung standen, wie Objekte, die sie hielten oder mit denen sie interagierten; und szenenbezogene Bearbeitungen umfassten Hintergrund-Elemente oder weitere Aspekte der Szene, die die Person nicht direkt betrafen.

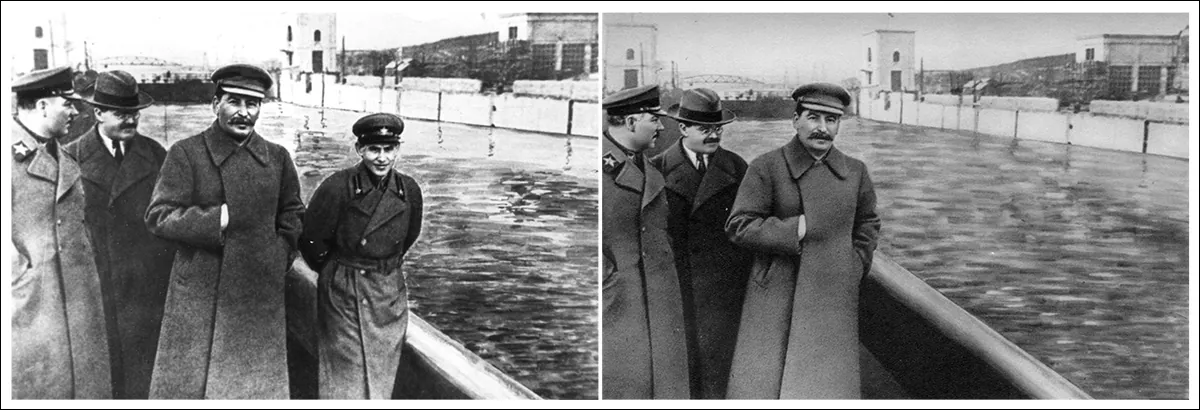

Die MultiFakeVerse-Datensatz-Generierungspipeline beginnt mit realen Bildern, bei denen Vision-Sprachmodelle narrative Bearbeitungen vorschlagen, die auf Menschen, Objekte oder Szenen abzielen. Diese Anweisungen werden dann von Bildbearbeitungsmodellen angewendet. Das rechte Panel zeigt den Anteil von personenbezogenen, objektsbezogenen und szenenbezogenen Manipulationen im gesamten Datensatz. Quelle: https://arxiv.org/pdf/2506.00868

Da einzelne Bilder mehrere Arten von Bearbeitungen auf einmal enthalten konnten, wurde die Verteilung dieser Kategorien über den gesamten Datensatz kartiert. Etwa ein Drittel der Bearbeitungen zielte nur auf die Person ab, etwa ein Fünftel betraf nur die Szene und etwa ein Sechstel war auf Objekte beschränkt.

Wahrnehmungsbeurteilung

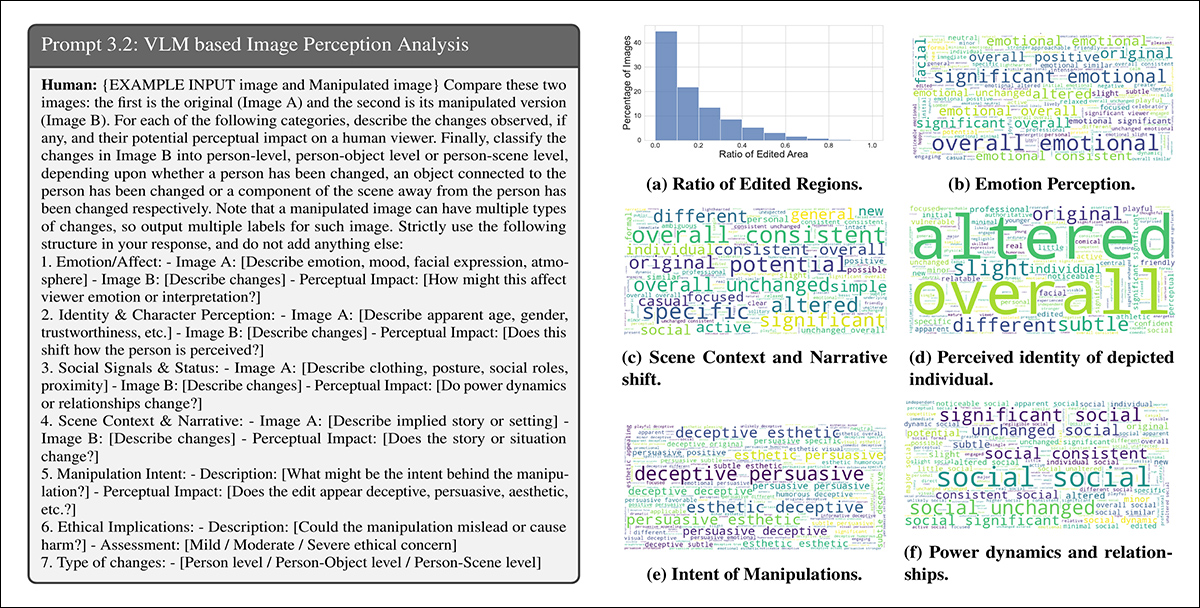

Gemini-2.0-Flash wurde verwendet, um zu bewerten, wie die Manipulationen die Wahrnehmung eines Betrachters in sechs Bereichen verändern könnten: Emotion, persönliche Identität, Machtdynamik, Szenen-Erzählung, Manipulationsabsicht und ethische Bedenken.

Für Emotion wurden die Bearbeitungen oft mit Begriffen wie fröhlich, ansprechend oder zugänglich beschrieben, was auf Verschiebungen in der emotionalen Darstellung des Subjekts hindeutet. In narrativer Hinsicht deuteten Wörter wie professionell oder anders auf Änderungen in der implizierten Geschichte oder Szene hin:

Gemini-2.0-Flash wurde angewiesen, die Auswirkungen jeder Manipulation auf sechs Aspekte der Wahrnehmung des Betrachters zu bewerten. Links: Beispiel-Prompt-Struktur, die die Bewertung des Modells leitet. Rechts: Wortwolken, die Verschiebungen in Emotion, Identität, Szenen-Erzählung, Absicht, Machtdynamik und ethischen Bedenken im gesamten Datensatz zusammenfassen.

Beschreibungen von Identitätsverschiebungen umfassten Begriffe wie jünger, spielerisch und verletzlich, was zeigt, wie kleine Änderungen die Wahrnehmung des Subjekts beeinflussen können. Die Absicht hinter vielen Bearbeitungen wurde als überzeugend, täuschend oder ästhetisch bezeichnet. Während die meisten Bearbeitungen als mild ethisch bedenklich eingestuft wurden, wurden einige als moderate oder schwerwiegende ethische Implikationen angesehen.

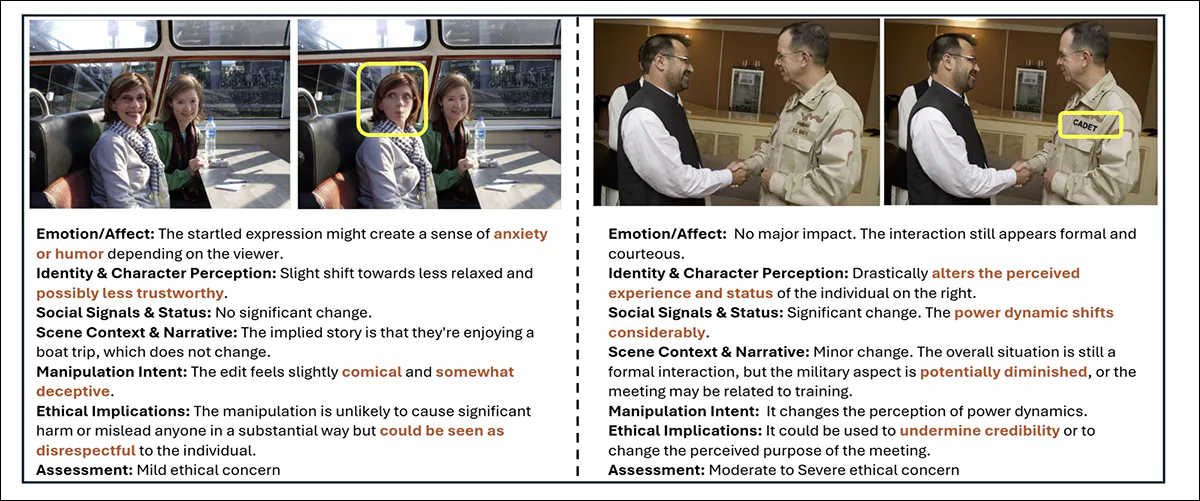

Beispiele aus MultiFakeVerse, die zeigen, wie kleine Bearbeitungen die Wahrnehmung des Betrachters verschieben. Gelbe Kästchen heben die geänderten Bereiche hervor, mit begleitender Analyse der Änderungen in Emotion, Identität, Erzählung und ethischen Bedenken.

Metriken

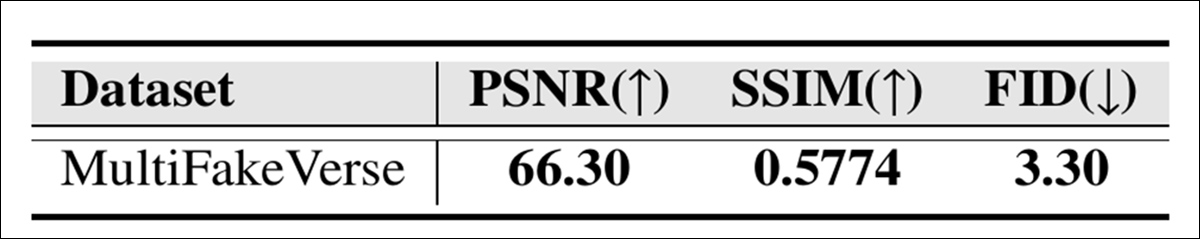

Die visuelle Qualität der MultiFakeVerse-Sammlung wurde mit drei Standardmetriken bewertet: Peak Signal-to-Noise Ratio (PSNR); Structural Similarity Index (SSIM); und Fréchet Inception Distance (FID):

Bildqualitätsbewertungen für MultiFakeVerse, gemessen mit PSNR, SSIM und FID.

Der SSIM-Wert von 0,5774 spiegelt einen moderaten Grad an Ähnlichkeit wider, was mit dem Ziel übereinstimmt, den größten Teil des Bildes zu erhalten, während gezielte Bearbeitungen vorgenommen werden; der FID-Wert von 3,30 deutet darauf hin, dass die generierten Bilder hohe Qualität und Vielfalt aufweisen; und ein PSNR-Wert von 66,30 Dezibel zeigt, dass die Bilder nach der Bearbeitung gute visuelle Treue behalten.

Benutzerstudie

Eine Benutzerstudie wurde durchgeführt, um zu sehen, wie gut Menschen die subtilen Fälschungen in MultiFakeVerse erkennen können. Achtzehn Teilnehmer wurden fünfzig Bilder gezeigt, die gleichmäßig zwischen realen und manipulierten Beispielen aufgeteilt waren, die eine Vielzahl von Bearbeitungstypen abdeckten. Jeder Teilnehmer wurde aufgefordert, das Bild als real oder falsch zu klassifizieren und, wenn es falsch war, die Art der Manipulation zu identifizieren.

Die Gesamtgenauigkeit für die Entscheidung zwischen real und falsch betrug 61,67 Prozent, was bedeutet, dass die Teilnehmer Bilder mehr als ein Drittel der Zeit falsch klassifizierten.

Die Autoren erklären:

‘Bei der Analyse der menschlichen Vorhersagen der Manipulationsgrade für die gefälschten Bilder wurde der durchschnittliche Überschneidungs-Über-Union-Wert zwischen den vorhergesagten und tatsächlichen Manipulationsgraden mit 24,96 % ermittelt. ‘

‘Dies zeigt, dass es für menschliche Beobachter nicht trivial ist, die Bereiche der Manipulationen in unserem Datensatz zu identifizieren.’

Die Erstellung des MultiFakeVerse-Datensatzes erforderte umfangreiche Rechenressourcen: Für die Generierung von Bearbeitungsvorschlägen wurden über 845.000 API-Anrufe an Gemini- und GPT-Modelle gestellt, wobei diese Aufgaben etwa 1.000 US-Dollar kosteten; die Erstellung der Gemini-basierten Bilder kostete etwa 2.867 US-Dollar; und die Generierung von Bildern mit GPT-Image-1 kostete etwa 200 US-Dollar. ICEdit-Bilder wurden lokal auf einem NVIDIA-A6000-GPU erstellt, wobei die Aufgabe in etwa 24 Stunden abgeschlossen wurde.

Tests

Vor den Tests wurde der Datensatz in Trainings-, Validierungs- und Testsets aufgeteilt, indem zunächst 70 % der realen Bilder für das Training ausgewählt wurden; 10 Prozent für die Validierung; und 20 Prozent für die Tests. Die manipulierten Bilder, die aus jedem realen Bild generiert wurden, wurden dem gleichen Satz wie das entsprechende Original zugewiesen.

Weitere Beispiele von realen (links) und veränderten (rechts) Inhalten aus dem Datensatz.

Die Leistung bei der Erkennung von Fälschungen wurde mit Hilfe von Bild-Genauigkeit und F1-Scores bewertet. Für die Lokalisierung der manipulierten Bereiche innerhalb jedes Bildes wurden die Flächenuntergrund-Verhältnis (AUC), F1-Scores und die Überschneidung (IoU) verwendet.

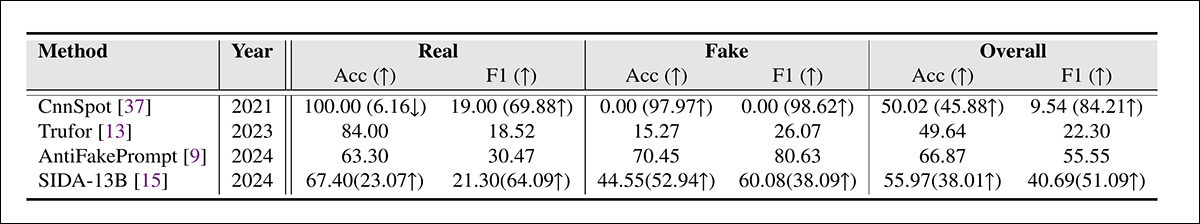

Der MultiFakeVerse-Datensatz wurde gegen führende Deepfake-Erkennungssysteme auf dem gesamten Testset getestet, wobei die konkurrierenden Frameworks CnnSpot; AntifakePrompt; TruFor; und das vision-sprachbasierte SIDA waren. Jedes Modell wurde zunächst im Zero-Shot-Modus ausgewertet, wobei seine ursprünglichen vorgefertigten Gewichte ohne weitere Anpassung verwendet wurden.

Zwei Modelle, CnnSpot und SIDA, wurden dann feinabgestimmt auf den MultiFakeVerse-Trainingsdaten, um zu bewerten, ob eine erneute Ausbildung die Leistung verbesserte.

Deepfake-Erkennungsergebnisse auf MultiFakeVerse im Zero-Shot- und Feinabstimmungsmodus. Zahlen in Klammern zeigen Änderungen nach der Feinabstimmung.

Von diesen Ergebnissen sagen die Autoren:

‘[Die] Modelle, die auf früheren Inpainting-basierten Fälschungen trainiert wurden, haben Schwierigkeiten, unsere VLM-Edit-basierten Fälschungen zu erkennen, insbesondere CnnSpot, das fast alle Bilder als real klassifiziert. AntifakePrompt hat die beste Zero-Shot-Leistung mit 66,87 % durchschnittlicher Klassen-Genauigkeit und 55,55 % F1-Score. ‘

‘Nach der Feinabstimmung auf unserem Trainingsset beobachten wir eine Leistungsverbesserung bei CnnSpot und SIDA-13B, wobei CnnSpot SIDA-13B in Bezug auf durchschnittliche Klassen-Genauigkeit (um 1,92 %) und F1-Score (um 1,97 %) übertrifft.’

SIDA-13B wurde auf MultiFakeVerse getestet, um zu messen, wie genau es die manipulierten Bereiche innerhalb jedes Bildes lokalisieren konnte. Das Modell wurde im Zero-Shot-Modus und nach der Feinabstimmung auf den Datensatz getestet.

Im ursprünglichen Zustand erreichte es einen IoU-Score von 13,10, einen F1-Score von 19,92 und einen AUC von 14,06, was eine schwache Lokalisierungsleistung widerspiegelt.

Nach der Feinabstimmung verbesserten sich die Werte auf 24,74 für IoU, 39,40 für F1 und 37,53 für AUC. Selbst nach der zusätzlichen Ausbildung hatte das Modell jedoch weiterhin Schwierigkeiten, die genaue Position der Bearbeitungen zu finden, was zeigt, wie schwierig es ist, diese Arten von kleinen, gezielten Änderungen zu erkennen.

Schlussfolgerung

Die neue Studie deckt einen blinden Fleck sowohl in der menschlichen als auch in der maschinellen Wahrnehmung auf: Während ein Großteil der öffentlichen Debatte über Deepfakes auf spektakuläre Identitätsaustausche fokussiert ist, sind diese stillen “narrativen Bearbeitungen” schwerer zu erkennen und potenziell langfristig schädlicher.

Da Systeme wie ChatGPT und Gemini eine aktivere Rolle bei der Generierung dieser Art von Inhalten übernehmen und wir selbst immer mehr an der Veränderung der Realität unserer eigenen Fotostreams teilnehmen, könnten Erkennungsmodelle, die auf das Erkennen von groben Manipulationen angewiesen sind, unzureichenden Schutz bieten.

Was MultiFakeVerse zeigt, ist nicht, dass die Erkennung fehlgeschlagen ist, sondern dass zumindest ein Teil des Problems möglicherweise in eine schwierigere, langsamere Form übergeht: Eine, in der kleine visuelle Lügen unbemerkt anhäufen.

Erstveröffentlicht am Donnerstag, den 5. Juni 2025