Andersons Blickwinkel

Auf dem Weg zur vollständigen Kontrolle in der AI-Videoerzeugung

Video-Grundmodell wie Hunyuan und Wan 2.1 sind zwar leistungsfähig, bieten den Benutzern jedoch nicht die Art von granularer Kontrolle, die in der Film- und Fernsehproduktion (insbesondere in der VFX-Produktion) gefordert wird.

In professionellen visuellen Effektstudios werden Open-Source-Modelle wie diese, zusammen mit früheren bildbasierten (und nicht videobasierten) Modellen wie Stable Diffusion, Kandinsky und Flux, typischerweise zusammen mit einer Reihe von unterstützenden Tools verwendet, die ihre Rohausgabe anpassen, um spezifische kreative Anforderungen zu erfüllen. Wenn ein Regisseur sagt: “Das sieht großartig aus, aber können wir es ein bisschen mehr [n] machen?” kann man nicht antworten, dass das Modell nicht präzise genug ist, um solche Anforderungen zu erfüllen.

Stattdessen wird ein AI-VFX-Team eine Reihe traditioneller CGI– und Kompositionstechniken verwenden, verbunden mit benutzerdefinierten Verfahren und Workflows, die über die Zeit entwickelt wurden, um die Grenzen der Videosynthese ein wenig weiter zu verschieben.

So ist ein Grundmodell für Videos in etwa wie eine Standardinstallation eines Web-Browsers wie Chrome; es kann viel aus der Box heraus, aber wenn Sie möchten, dass es sich an Ihre Bedürfnisse anpasst, anstatt umgekehrt, benötigen Sie einige Plugins.

Kontrollfreaks

In der Welt der diffusionsbasierten Bildsynthese ist das wichtigste solche Drittsystem ControlNet.

ControlNet ist eine Technik, um strukturierte Kontrolle über diffusionsbasierte generative Modelle zu ermöglichen, die es Benutzern ermöglicht, Bild- oder Videoerzeugung mit zusätzlichen Eingaben wie Kantenkarten, Tiefenkarten oder Poseninformationen zu steuern.

ControlNets verschiedene Methoden ermöglichen es, Tiefenbilder zu erstellen (obere Reihe), semantische Segmentierung zu Bildern (untere linke Ecke) und posegeführte Bildgenerierung von Menschen und Tieren (untere linke Ecke).

Anstatt sich ausschließlich auf Textprompts zu verlassen, führt ControlNet separate neuronale Netzwerkzweige oder Adapter ein, die diese Bedingungssignale verarbeiten, während die generativen Fähigkeiten des Grundmodells erhalten bleiben.

Dies ermöglicht fein abgestimmte Ausgaben, die den Benutzerspezifikationen näher kommen, was es besonders nützlich in Anwendungen macht, bei denen präzise Komposition, Struktur oder Bewegungskontrolle erforderlich ist:

Mit einer führenden Pose können verschiedene genaue Ausgabetypen über ControlNet erhalten werden. Quelle: https://arxiv.org/pdf/2302.05543

Allerdings haben Adapter-basierte Frameworks dieser Art mehrere Nachteile.

Zunächst werden Adapter unabhängig trainiert, was zu Verzweigungsconflikten führt, wenn mehrere Adapter kombiniert werden, was eine verringerte Generierungsqualität zur Folge haben kann.

Zweitens führen sie Parameterredundanz ein, was zusätzliche Berechnungen und Speicher für jeden Adapter erfordert, was das Skalieren ineffizient macht.

Drittens produzieren Adapter trotz ihrer Flexibilität oft suboptimale Ergebnisse im Vergleich zu Modellen, die vollständig für die multikonditionale Generierung fein abgestimmt wurden. Diese Probleme machen Adapter-basierte Methoden weniger effektiv für Aufgaben, die eine nahtlose Integration mehrerer Steuersignale erfordern.

Idealerweise würden die Fähigkeiten von ControlNet native in das Modell trainiert, auf eine modulare Weise, die später und viel erwartete offensichtliche Innovationen wie simultane Video-/Audio-Generierung oder native Lip-Sync-Fähigkeiten (für externes Audio) aufnehmen könnte.

Wie es steht, stellt jeder zusätzliche Funktionsumfang entweder eine Post-Produktionsaufgabe oder ein nicht natives Verfahren dar, das die eng gebundenen und empfindlichen Gewichte des jeweiligen Grundmodells navigieren muss.

FullDiT

In diese Pattsituation kommt ein neues Angebot aus China, das ein System vorschlägt, bei dem ControlNet-ähnliche Maßnahmen direkt in ein generatives Video-Modell während der Trainingszeit integriert werden, anstatt als Nachgedanke behandelt zu werden.

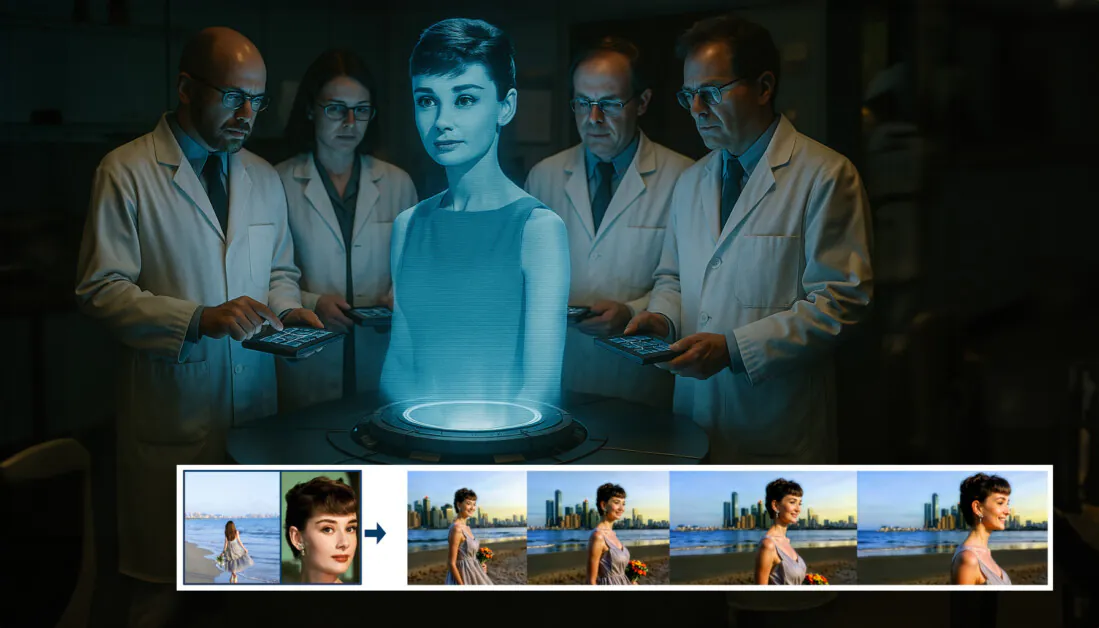

Aus dem neuen Papier: Der FullDiT-Ansatz kann Identitätsaufprägung, Tiefeninformationen und Kamerabewegungen in eine native Generierung aufnehmen und kann jede Kombination davon auf einmal abrufen. Quelle: https://arxiv.org/pdf/2503.19907

Der neue Ansatz, der FullDiT genannt wird, integriert mehrere Bedingungen wie Identitätsübertragung, Tiefenkartierung und Kamerabewegung in einen integrierten Teil eines trainierten generativen Video-Modells, für das die Autoren ein Prototyp-Modell und begleitende Video-Clips auf einer Projekt-Website erstellt haben.

In dem folgenden Beispiel sehen wir Generierungen, die Kamerabewegungen, Identitätsinformationen und Textinformationen (d. h. Benutzertextprompts) aufnehmen:

Bitte klicken Sie, um abzuspielen. Beispiele für ControlNet-ähnliche Benutzereingriffe mit nur einem nativ trainierten Grundmodell. Quelle: https://fulldit.github.io/

Es sollte beachtet werden, dass die Autoren ihr experimentelles trainiertes Modell nicht als funktionsfähiges Grundmodell vorschlagen, sondern als Beweis des Konzepts für native Text-zu-Video- (T2V) und Bild-zu-Video- (I2V) Modelle, die den Benutzern mehr Kontrolle bieten als nur ein Bildprompt oder ein Textprompt.

Da es noch keine ähnlichen Modelle dieser Art gibt, erstellten die Forscher einen neuen Benchmark mit dem Titel FullBench, für die Bewertung von Multi-Task-Videos, und behaupten, dass sie die beste Leistung in den wie-für-wie-Vergleichen erzielt haben, die sie entwickelt haben. Allerdings ist die Objektivität von FullBench, da es von den Autoren selbst entwickelt wurde, ungetestet, und ihr Datensatz von 1.400 Fällen kann für weiterreichende Schlussfolgerungen zu begrenzt sein.

Vielleicht ist der interessanteste Aspekt der Architektur, die das Papier vorlegt, sein Potenzial, neue Arten von Kontrolle zu integrieren. Die Autoren stellen fest:

‘In dieser Arbeit erforschen wir nur Kontrollbedingungen der Kamera, Identitäten und Tiefeninformationen. Wir haben nicht weiter andere Bedingungen und Modalitäten wie Audio, Sprache, Punktwolken, Objektbegrenzungsboxen, optischen Fluss usw. untersucht. Obwohl die Design von FullDiT andere Modalitäten mit minimalen Architekturmodifikationen nahtlos integrieren kann, bleibt es eine wichtige Frage, wie man bestehende Modelle schnell und kosteneffizient an neue Bedingungen und Modalitäten anpassen kann.’

Obwohl die Forscher FullDiT als einen Schritt vorwärts in der multiaufgabenorientierten Videoerzeugung präsentieren, sollte berücksichtigt werden, dass diese neue Arbeit auf bestehenden Architekturen aufbaut, anstatt ein grundlegend neues Paradigma einzuführen.

Trotzdem steht FullDiT derzeit (soweit ich weiß) als einziges Video-Grundmodell mit “harten” ControlNet-ähnlichen Einrichtungen da – und es ist gut zu sehen, dass die vorgeschlagene Architektur auch späteren Innovationen standhalten kann.

Bitte klicken Sie, um abzuspielen. Beispiele für benutzerkontrollierte Kamerabewegungen, von der Projekt-Website.

Das neue Papier trägt den Titel FullDiT: Multi-Task-Video-Generierungs-Grundmodell mit voller Aufmerksamkeit und stammt von neun Forschern aus Kuaishou Technology und der Chinesischen Universität Hongkong. Die Projekt-Website ist hier und der neue Benchmark-Datensatz ist hier zu finden.

Methode

Die Autoren behaupten, dass FullDiTs vereinheitlichtes Aufmerksamkeitsmechanismus ein stärkeres cross-modales Repräsentationslernen ermöglicht, indem es sowohl räumliche als auch zeitliche Beziehungen über Bedingungen hinweg erfasst:

Laut dem neuen Papier integriert FullDiT mehrere Eingabebedingungen durch vollständige Selbstaufmerksamkeit, indem es sie in eine vereinigte Sequenz umwandelt. Im Gegensatz dazu verwenden adapterbasierte Modelle (links) separate Module für jede Eingabe, was zu Redundanz, Konflikten und schwächerer Leistung führt.

Im Gegensatz zu adapterbasierten Einrichtungen, die jeden Eingabestrom separat verarbeiten, vermeidet diese gemeinsame Aufmerksamkeitsstruktur Verzweigungsconflikte und reduziert den Parameterüberkopplung. Sie behaupten auch, dass die Architektur auf neue Eingabetypen skaliert werden kann, ohne dass eine größere Neugestaltung erforderlich ist – und dass das Modellschema Anzeichen dafür zeigt, dass es sich auf Bedingungskombinationen verallgemeinern kann, die während des Trainings nicht gesehen wurden, wie z. B. die Verbindung von Kamerabewegungen mit Charakteridentitäten.

Bitte klicken Sie, um abzuspielen. Beispiele für Identitätsgenerierung von der Projekt-Website.

In FullDiTs Architektur werden alle Bedingungseingaben – wie Text, Kamerabewegung, Identität und Tiefeninformationen – zunächst in ein vereinheitlichtes Tokenformat umgewandelt. Diese Token werden dann zu einer einzigen langen Sequenz verkettet, die durch einen Stapel von Transformator-Schichten mit vollständiger Selbstaufmerksamkeit verarbeitet wird. Dieser Ansatz folgt vorherigen Arbeiten wie Open-Sora Plan und Movie Gen.

Dieses Design ermöglicht es dem Modell, zeitliche und räumliche Beziehungen über alle Bedingungen hinweg gemeinsam zu lernen. Jedes Transformator-Block operiert über die gesamte Sequenz, wodurch dynamische Interaktionen zwischen Modalitäten ermöglicht werden, ohne auf separate Module für jeden Eingabe angewiesen zu sein – und, wie wir bereits erwähnt haben, ist die Architektur so konzipiert, dass sie erweiterbar ist, was es viel einfacher macht, zusätzliche Steuersignale in der Zukunft zu integrieren, ohne größere strukturelle Änderungen vorzunehmen.

Die Macht der Drei

FullDiT wandelt jedes Steuersignal in ein standardisiertes Tokenformat um, damit alle Bedingungen gemeinsam in einem vereinheitlichten Aufmerksamkeitsrahmen verarbeitet werden können. Für Kamerabewegungen kodiert das Modell eine Sequenz von extrinsischen Parametern – wie Position und Orientierung – für jeden Rahmen. Diese Parameter werden zeitgestempelt und in Embedding-Vektoren projiziert, die die zeitliche Natur des Signals widerspiegeln.

Identitätsinformationen werden anders behandelt, da sie von Natur aus räumlich und nicht zeitlich sind. Das Modell verwendet Identitätskarten, die angeben, welche Charaktere in welchen Teilen jedes Rahmens vorhanden sind. Diese Karten werden in Patches unterteilt, wobei jeder Patch in ein Embedding projiziert wird, das räumliche Identitätsmerkmale aufnimmt, wodurch das Modell bestimmte Bereiche des Rahmens mit bestimmten Entitäten in Verbindung bringen kann.

Tiefeninformationen sind ein raumzeitliches Signal, und das Modell behandelt es, indem es Tiefenvideos in 3D-Patches unterteilt, die sowohl Raum als auch Zeit umspannen. Diese Patches werden dann so eingebettet, dass ihre Struktur über die Rahmen hinweg erhalten bleibt.

Sobald diese Bedingungstoken (Kamera, Identität und Tiefeninformationen) eingebettet sind, werden sie zu einer einzigen langen Sequenz verkettet, wodurch FullDiT sie gemeinsam mit vollständiger Selbstaufmerksamkeit verarbeiten kann. Diese gemeinsame Repräsentation ermöglicht es dem Modell, Interaktionen über Modalitäten und über die Zeit hinweg zu lernen, ohne auf isolierte Verarbeitungsströme angewiesen zu sein.

Daten und Tests

FullDiTs Trainingsansatz basierte auf selektiv annotierten Datensätzen, die für jeden Bedingungstyp zugeschnitten waren, anstatt zu fordern, dass alle Bedingungen gleichzeitig vorhanden sind.

Für textuelle Bedingungen folgte die Initiative dem strukturierten Ansatz für Untertitelung, wie er im MiraData-Projekt beschrieben wird.

Video-Sammlung und Annotations-Pipeline aus dem MiraData-Projekt. Quelle: https://arxiv.org/pdf/2407.06358

Für Kamerabewegungen war der RealEstate10K-Datensatz die primäre Datenquelle, aufgrund seiner hochwertigen Ground-Truth-Annotierungen von Kameraparametern.

Allerdings stellten die Autoren fest, dass das Training ausschließlich auf statischen Szenen-Kamera-Datensätzen wie RealEstate10K tendenziell die dynamischen Objekt- und menschlichen Bewegungen in den generierten Videos verringerte. Um dies zu kompensieren, führten sie zusätzliches Feinabstimmungstraining mit internen Datensätzen durch, die mehr dynamische Kamerabewegungen enthielten.

Identitäts-Annotierungen wurden mit der Pipeline erstellt, die für das ConceptMaster-Projekt entwickelt wurde, was eine effiziente Filterung und Extraktion von feinkörnigen Identitätsinformationen ermöglichte.

Das ConceptMaster-Framework ist darauf ausgelegt, Identitätsentkopplungsprobleme anzugehen, während die Konzepttreue in benutzerdefinierten Videos erhalten bleibt. Quelle: https://arxiv.org/pdf/2501.04698

Tiefen-Annotierungen wurden aus dem Panda-70M-Datensatz mit Depth Anything erhalten.

Optimierung durch Daten-Reihenfolge

Die Autoren implementierten auch einen progressiven Trainingsplan, indem sie anspruchsvollere Bedingungen früher im Training einführten, um sicherzustellen, dass das Modell robuste Repräsentationen erwarb, bevor einfachere Aufgaben hinzugefügt wurden. Die Trainingsreihenfolge verlief von Text zu Kamera-Bedingungen, dann Identitäten und schließlich Tiefen, wobei einfache Aufgaben im Allgemeinen später eingeführt und mit weniger Beispielen versehen wurden.