Andersons Blickwinkel

Objekte und Personen aus Videos mit KI löschen

Nein, das Kind bleibt nicht im Bild, wenn die KI etwas damit zu tun hat.

Das Entfernen von Personen und Objekten aus Bildern und Videos ist ein beliebter Teilbereich der Forschung in der VFX-orientierten KI-Literatur, mit einer wachsenden Anzahl von speziellen Datensätzen und Frameworks, die diese Herausforderung angehen. Der neueste davon, vom Institut für Big Data an der Fudan-Universität in China, ist EffectErase, ein ‘effektbewusstes’ Video-Objekt-Entfernungs-System, das, wie die Autoren behaupten, in Tests deutlich besser als der aktuelle Stand der Technik abschneidet:

Aus Material von der Projekt-Website erstellte Beispiele für die EffectErase-Methode (beachten Sie bitte, dass wir einen Link bereitstellen, aber die Quell-Website so viele hochauflösende und nicht optimierte Autoplay-Videos enthält, dass sie die Stabilität Ihres Web-Browsers beeinträchtigen kann. Das begleitende YouTube-Video ist eine einfachere und umfassendere Referenz und ist am Ende des Artikels eingebettet). Quelle

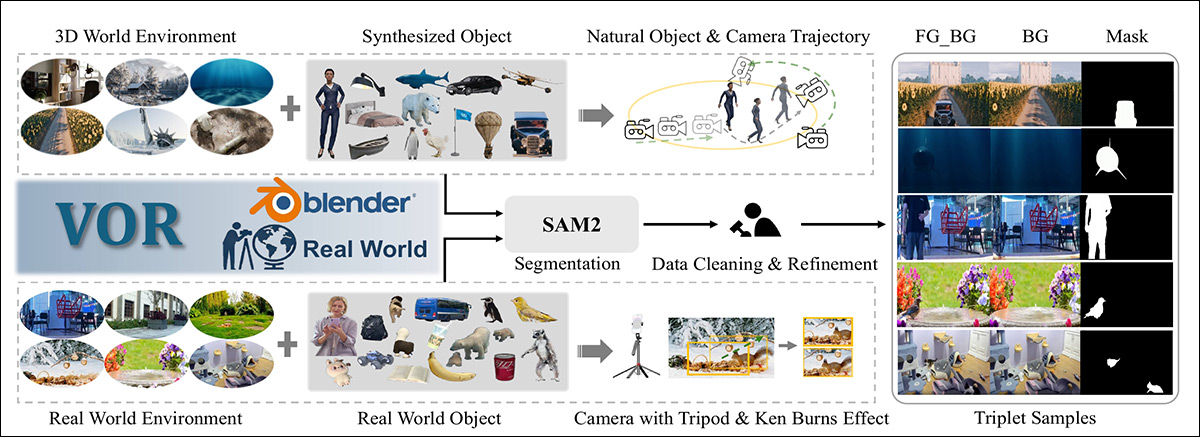

Die neue Arbeit umfasste die Erstellung/Kuration eines semi-neuen Datensatzes, der fast 350 Original-Szenen aus der realen Welt und auch synthetisierte Szenen (unter Verwendung von öffentlichen Repositories*) umfasst, die entweder mit spezieller Ausrüstung aufgenommen oder für einen Workflow auf der Grundlage des Open-Source-3D-Frameworks Blender erstellt und wiederverwendet wurden.

Der hybride Video-Objekt-Entfernungs-Datensatz (VOR) bildet die Grundlage für die EffectErase-Anwendung selbst, die auf dem Wan2.1-Video-Generierungssystem aufbaut. Das System definiert auch zwei neue verwandte Benchmarks: VOR-Eval und VOR-Wild – jeweils für Proben mit und ohne Ground-Truth.

(Obwohl die Arbeit eine begleitende Projekt-Website hat, ist sie ziemlich überlastet mit mehreren hochauflösenden Videos und schwer zu laden; daher bitten wir Sie, auf die von mir kuratierten Auszüge im oben eingebetteten Video zurückzugreifen, wenn Sie die Projekt-Website schwierig zu verwenden finden)

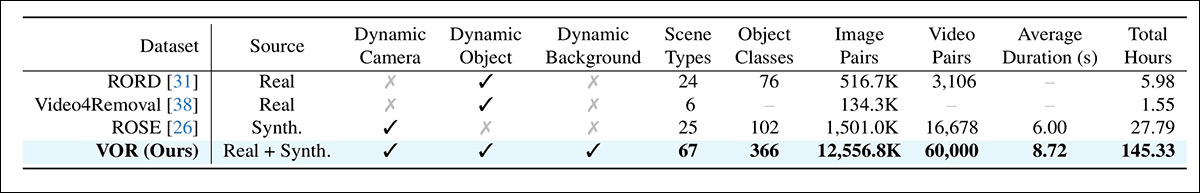

Ein Vergleich der Mengen über vergleichbare vorherige Datensätze, im Hinblick auf das neue Angebot. Quelle

Die Forscher behaupten, dass ihr Ansatz staatliche Leistungen sowohl in quantitativen Metriken als auch in qualitativen Ergebnissen erbringt, die durch eine menschliche Studie bewertet werden.

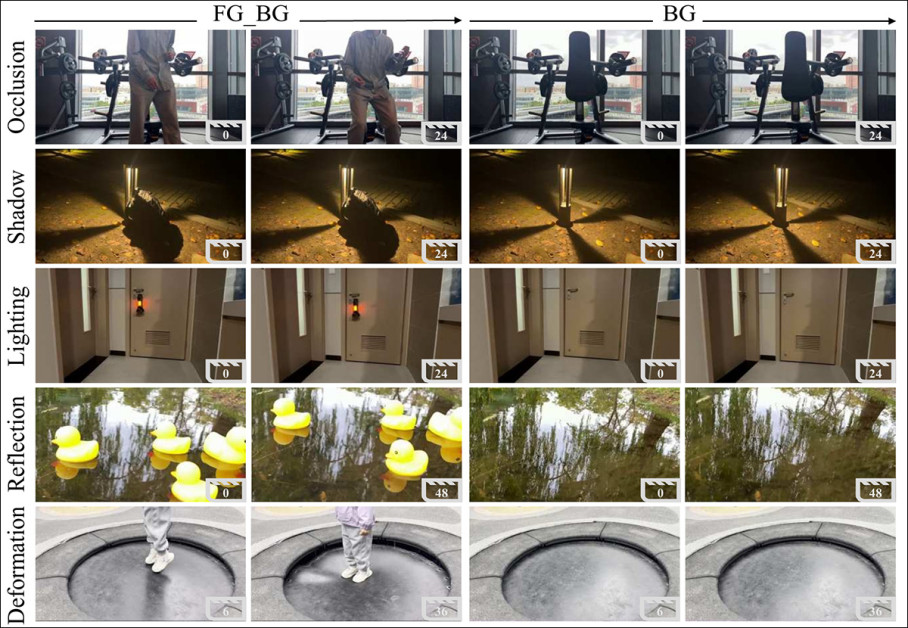

Sie weisen darauf hin, dass vorherige Arbeiten nicht immer erfolgreich waren, Nebeneffekte eines Objekts wie Schatten und Reflexionen zu entfernen, und dass ihr Datensatz sorgfältig erstellt wurde, um diese Lücke zu schließen:

Beispiele für das Versagen vorheriger Ansätze, über das Objekt hinauszugehen, das für die Entfernung gesucht wird, um sekundäre Hinweise wie Reflexionen und Schatten.

Das neue Papier trägt den Titel EffectErase: Joint Video Object Removal and Insertion for High-Quality Effect Erasing und stammt von vier Forschern der Fudan-Universität, College of Computer Science and Artificial Intelligence.

Methode

Der hybride VOR-Datensatz wurde so konzipiert, dass er eine breite Palette von Szenarien umfasst, um alle Auswirkungen des Entfernens einer Person oder eines Objekts aus einem Video abzudecken:

Paare von Frames aus dem VOR-Datensatz veranschaulichen, wie die Objektentfernung über das sichtbare Subjekt hinausgehen muss, um die induzierten Effekte zu berücksichtigen, mit Beispielen, die Okklusion, Schatten, Lichtverschiebungen, Reflexionen und physikalische Deformationen zeigen, jeweils als Eingabe (Objekt vorhanden) neben dem entsprechenden sauberen Hintergrund nach der Entfernung. Für weitere Beispiele siehe das begleitende YouTube-Video, das am Ende des Artikels eingebettet ist.

Die fünf repräsentativen Arten von ‘Störungen’, die angegangen werden müssen, werden von den Autoren als Okklusion definiert, einschließlich verschiedener Arten von Glas- und Rauchokklusion; Schatten; Licht (z. B. wenn ein zu entfernendes Objekt Lichtpfade erstellt oder ändert); Reflexion; und Deformation (z. B. die Spur eines Benutzers auf einem Kissen, die nicht überleben sollte, wenn die Person entfernt wird).

Datensatz-Konstruktions-Pipeline für VOR, die Blender-generierte synthetische Szenen mit realen Aufnahmen kombiniert, wobei synthetische Daten aus kuratierten 3D-Umgebungen, Objekten und Kamerabahnen erstellt werden und reale Aufnahmen über diverse Szenen aufgenommen und mit Ken-Burns-Bewegung ergänzt werden. SAM2-Segmentierung und manuelle Verfeinerung erzeugen dann ausgerichtete Vordergrund- und Hintergrund-Video-Tripletts mit entsprechenden Masken.

Für die realen Originaldaten verwendeten die Forscher feste Kameras, um ‘mit’ und ‘ohne’ Szenen aufzunehmen, die eine breite Palette von Umgebungen, Tageszeiten und Wetterbedingungen abdecken.

Für die synthetisierten Daten wurden multiple Blickwinkel gerendert und Multi-Objekt-Szenarien erstellt, die absichtlich komplexe und herausfordernde Arten von Kamerabewegungen aufwiesen, wie sie in realen Aufnahmen vorkommen könnten; und die Forscher bemerken, dass dieser Ansatz sophistizierter und aufwändiger ist als der, der für den ansonsten ähnlichen Remove Objects with Side Effects in Videos (ROSE)-Datensatz verwendet wurde.

Um die Bewegungsdiversität zu erhöhen, wurde der Ken-Burns-Effekt auf Kamera-aufgenommene Paare angewendet, wodurch kontrollierte Pans, Zooms und leichte Handbewegungen unter vierzehn vordefinierten Regeln hinzugefügt wurden, wobei fünf Bewegungsmuster pro Paar ausprobiert wurden, während der Crop innerhalb des ursprünglichen Rahmens blieb.

Skalierbarkeit und Vielfalt wurden weiter durch die Kombination von synthetischen Objekten mit mehreren Kamera-Setups erweitert. Masken wurden durch manuelle Punktprompts auf Schlüsselbildern generiert, die Segmentierung mit Segment Anything 2 (SAM2) propagiert, die Ergebnisse gereinigt und verfeinert und validierte Vordergrund-, Hintergrund- und Masken-Tripletts für die Ausbildung zusammengestellt.

Die endgültige Sammlung umfasst 145 Stunden Video über 60.000 paarige Videos, reale und synthetische, die 366 Objektklassen in 443 Szenen abdecken.

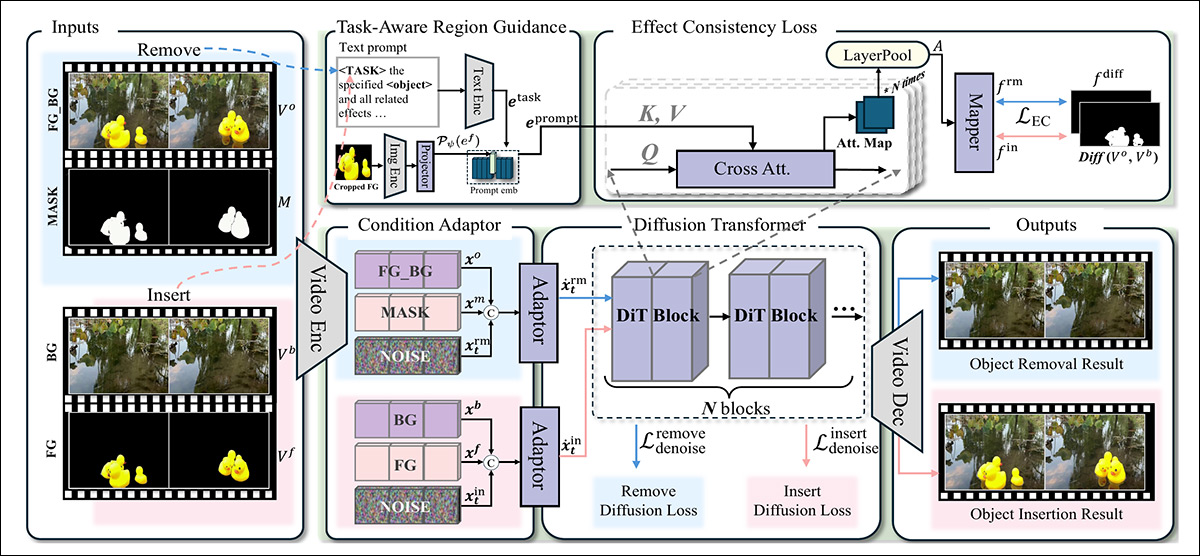

Das EffectErase-Netzwerk selbst verarbeitet Material über einen Variational Auto-Encoder (VAE†), wobei das latente Rauschen durch Wan2.1 behandelt wird. Über dieses Rückgrat arbeitet EffectErase Entfernung-Einfügung-Joint-Learning, das beide Aufgaben zusammen auf den gleichen Bereichen trainiert; Aufgaben-Aware-Region-Guidance (TARG), das Objekt- und Aufgaben-Tokens mit Cross-Attention verwendet, um räumliche und zeitliche Verbindungen zwischen Objekten und ihren Effekten zu modellieren und Aufgabenwechsel zu ermöglichen; und Effekt-Konsistenz-Verlust, der Effekt-Bereiche über Entfernung und Einfügungsaufgaben ausrichtet:

Schema für das EffectErase-Framework. Während des Trainings werden paarige Videos in einen gemeinsamen latenten Raum codiert, mit Rauschen fusioniert und von einem Diffusions-Transformer verarbeitet, der von Aufgaben-Aware-Cross-Attention geleitet wird, während ein Effekt-Konsistenz-Verlust Entfernung und Einfügungsbereiche ausrichtet, sodass beide Aufgaben auf den gleichen Bereich fokussieren.

An sich werden die Entfernung und Einfügung durch ein gemeinsames Diffusions-Backbone trainiert, sodass das Modell lernt, sich auf die gleichen betroffenen Bereiche und strukturellen Hinweise zu konzentrieren.

Videos mit Objekten, Hintergrund-Videos und Masken werden zuerst in einen latenten Raum codiert; dann wird Rauschen hinzugefügt, um die Diffusion zu trainieren, und das Modell lernt, saubere Darstellungen unter aufgaben-spezifischer Anleitung wiederherzustellen. Ein leichter Adapter fusioniert dann die rauschigen Merkmale mit Entfernung oder Einfügungsbedingungen, wodurch beide Aufgaben die Aufsicht teilen, während sie weiterhin steuerbar bleiben.

Aufgaben-Aware-Region-Guidance erzeugt ein aufgaben-spezifisches Signal, indem Sprach-Tokens mit visuellen Merkmalen kombiniert werden, die aus dem Vordergrund-Objekt extrahiert werden, unter Verwendung von CLIP, wobei ein generischer Objekt-Token durch eine aus dem tatsächlichen Bildinhalt abgeleitete Einbettung ersetzt wird. Diese fusionierte Darstellung wird durch Cross-Attention in das Rückgrat injiziert, wodurch das Modell lernen kann, wie ein Objekt und seine visuellen Effekte im Laufe der Zeit und des Raumes evolvieren, während es flexibles Wechseln zwischen Entfernung und Einfügung ermöglicht.

Effekt-Konsistenz-Verlust zwingt Entfernung und Einfügung, sich auf die gleichen geänderten Bereiche zu konzentrieren, da beide Aufgaben mit dem gleichen Objekt und seinen visuellen Effekten zu tun haben. Aufmerksamkeitskarten aus jedem Zweig werden dann zu weichen Regionenkarten kombiniert und mit einer Differenzkarte ausgerichtet, die aus den Objekt- und Hintergrund-Videos berechnet wird, sodass subtile Änderungen wie Licht und Schatten erhalten bleiben. Dieser zusätzliche Verlust hilft der Einfügung, die Entfernung zu leiten, und hält beide Aufgaben konsistent.

Daten und Tests

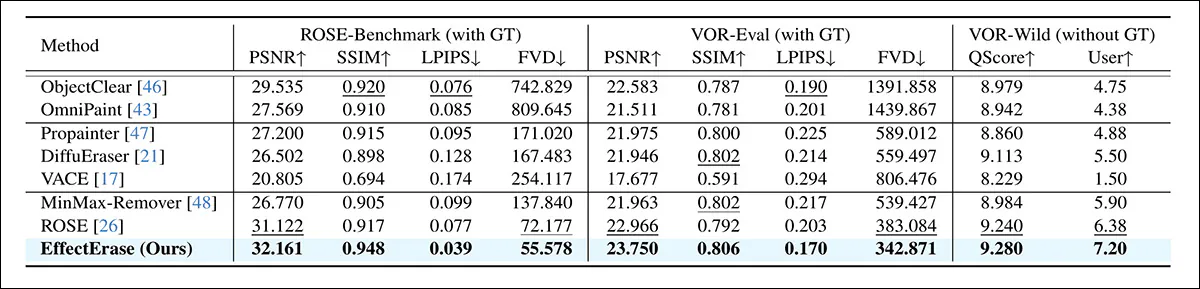

Die Forscher testeten ihren Ansatz gegen verschiedene Inpainting-, Video-Inpainting- und Objekt-Entfernungs-Methoden: OmniPaint; ObjectClear; VACE; DiffuEraser; ProPainter; ROSE; und MiniMax-Remover.

Wan2.1 wurde mit LoRA†† unter Verwendung des VOR-Datensatzes bei einer Auflösung von 832x480px fein abgestimmt. 81 aufeinanderfolgende Frames (die effektive Grenze für WAN, jenseits derer Fehler tendenziell auftreten) wurden zufällig für die Ausbildung ausgewählt, die 129.000 Iterationen bei einem Batch-Größe von 8 auf acht H100-GPUs mit jeweils 80 GB VRAM durchgeführt wurde. Die Lernrate wurde auf 1×102 gesetzt und der LoRA-Rang auf 256.

Der ROSE-Benchmark-Datensatz war der einzige externe Datensatz, der getestet wurde; die anderen beiden waren VOR-Eval, der VOR-Datensatz-Test-Split; und VOR-Wild, ein Test-Set, das aus 195 realen Videos besteht, die aus dem Internet gesammelt wurden und ‘dynamische Objekte’ enthalten.

Die verwendeten Metriken waren Peak Signal-to-Noise Ratio (PSNR); Structural Similarity Index (SSIM); Learned Perceptual Image Patch Similarity (LPIPS); und Fréchet Video Distance (FVD). Eine Benutzerstudie von 195 generierten Videos aus VOR-Wild wurde ebenfalls berücksichtigt, wobei die durchschnittlichen Bewertungen von 20 Freiwilligen berücksichtigt wurden.

Darüber hinaus entwickelten die Autoren QScore, eine Metrik, die das Qwen-VL-Multimodell-Modell nutzt, um die Qualität des Objekt-entfernten Video-Ausgangs zu bewerten, in Bezug auf verbleibende Artefakte oder nicht entfernte Umgebungs-Entfernungen, wie Schatten und Lichteffekte:

Quantitativer Vergleich auf ROSE- und VOR-Benchmarks, wobei die besten und zweitbesten Ergebnisse in fett und unterstrichen dargestellt werden.

In Bezug auf diese Ergebnisse bemerken die Autoren:

‘[Aktuelle] Bild-Inpainting-Methoden operieren auf einzelnen Frames unter Verwendung von 2D-Modellen ohne zeitliche Modellierung und können daher die zeitliche Konsistenz in Videos nicht aufrechterhalten.

Neue Video-Inpainting-[Methoden] modellieren die Nebeneffekte von Objekten nicht explizit, was zu unnatürlichen Entfernungs-Ergebnissen führt. Bestehende Video-Objekt-Entfernungs-[Methoden] fehlen die räumlich-zeitliche Korrelations-Modellierung zwischen dem Objekt und seinen Nebeneffekten und produzieren daher oft Artefakte und Restspuren der entfernten Objekte.

‘Insgesamt erreicht EffectErase staatliche Leistungen über alle Datensätze und Bewertungsmetriken hinweg. Es erhält die besten Punktzahlen auf der Video-Qualitäts-Metrik FVD, was eine überlegene zeitliche Glätte und Konsistenz der generierten Videos demonstriert.

‘Unsere Methode erreicht auch die höchsten QScore- und Benutzer-Feedback-Bewertungen, was ihre Effektivität bei der Erzeugung visuell überzeugender Entfernungs-Ergebnisse weiter unterstreicht.’

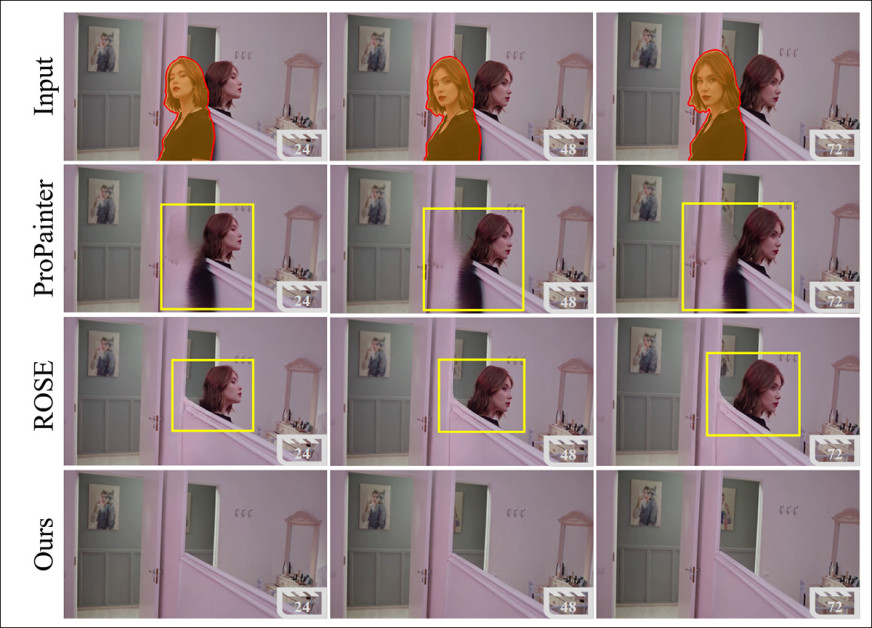

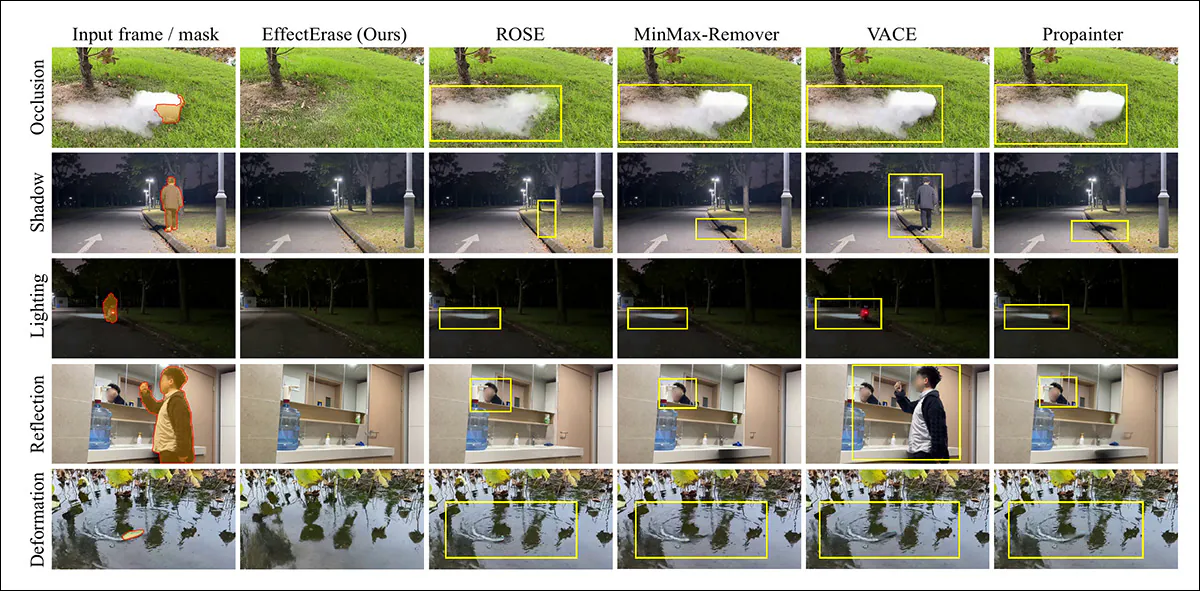

Für die qualitative Bewertung werden statische Ergebnisse im Papier (gezeigt) direkt unten angeboten, sowie bewegte Ergebnisse, die auf der Projekt-Website und im begleitenden YouTube-Video verfügbar sind:

Qualitativer Vergleich auf VOR-Eval über Okklusion, Schatten, Licht, Reflexion und Deformation hinweg. Inpainting-Methoden kämpfen darum, Effekte außerhalb der Maske zu entfernen, während Entfernungs-Modelle oft sichtbare Artefakte hinterlassen. EffectErase entfernt sowohl das Ziel-Objekt als auch seine zugehörigen Effekte sauberer. Bitte beachten Sie die Quell-Papier für bessere Auflösung und die Projekt-Website für Video-Beispiele.

Wir verweisen den Leser auch auf diverse verwandte Beispiele auf der Projekt-Website, die unten vorschauweise gezeigt werden, sowie das offizielle YouTube-Video, das am Ende des Artikels eingebettet ist:

Klicken Sie, um abzuspielen. Ein Beispielvergleich von der EffectErase-Projekt-Website. Bitte beachten Sie die Website für bessere Auflösung (mit den oben genannten Vorbehalten) und für weitere Beispiele.

Die Autoren bemerken:

‘Video-Inpainting-[Methoden] produzieren oft Artefakte in maskierten Bereichen und können die Nebeneffekte, die durch die entfernten Objekte verursacht werden, nicht vollständig entfernen. Frühere Objekt-Entfernungs-Ansätze, wie [ROSE] und [MinMax-Remover], funktionieren gut bei der Entfernung von Ziel-Objekten, aber kämpfen immer noch mit Nebeneffekten, insbesondere in Okklusion, Schatten, Licht, Reflexion und Deformationsszenarien.

‘Im Gegensatz dazu entfernt EffectErase sowohl Ziel-Objekte als auch ihre zugehörigen Effekte effektiv, was zu sauberen, kohärenten und hochwertigen Ergebnissen führt.’

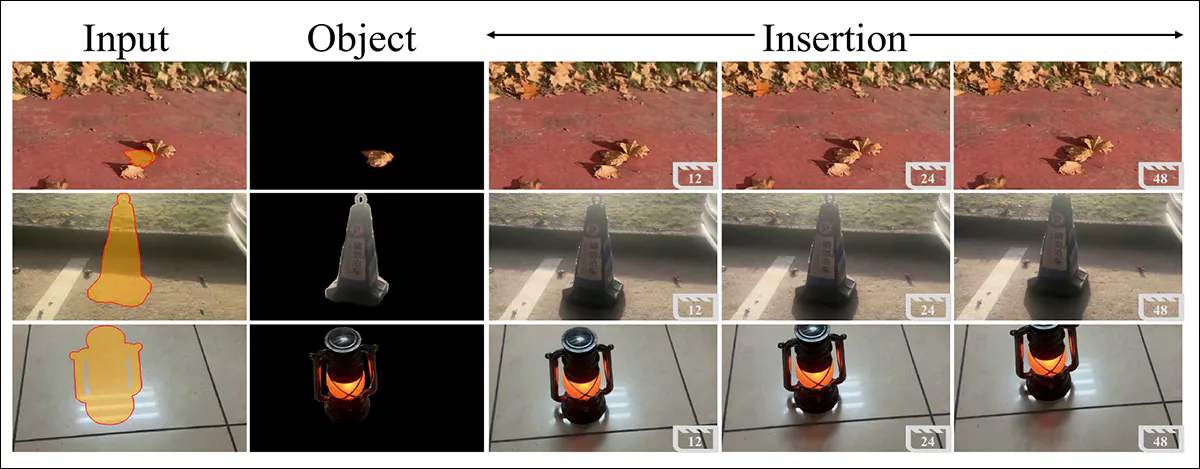

Zum Abschluss bemerken die Forscher, dass ihre Methode auch für Einfügungsaufgaben anstelle von Entfernungs-Aufgaben angepasst werden kann, ohne dass zusätzliches Training erforderlich ist:

Video-Objekt-Einfügungsergebnisse. EffectErase fügt Objekte ein, während es Hintergrund-Inhalte erhält und konsistente objektabhängige Effekte wie Schatten und Reflexionen über Frames hinweg erzeugt.

Video-Ergebnisse für die Einfügungsaufgabe können im (zeitlich spezifischen) YouTube-Video gesehen werden (auch ohne Zeitstempel am Ende des Artikels eingebettet).

Schlussfolgerung

Ein Blick auf ähnliche Projekte in der Literatur zeigt, dass viele immer noch hoffen, dass allgemeine VFX-Modelle diese Art von Funktionalität schließlich in ein allgemeines ‘Werkzeug’-Modell integrieren können, das für eine Reihe von Effekten und nicht nur für diese spezifische Aufgabe konzipiert ist.

Allerdings scheint es vernünftig anzunehmen, dass spezialisierte Systeme wie EffectErase ihre Überlegenheit über allgemeinere Ansätze beibehalten werden, mit der Einschränkung, dass die Lücke schließlich so eng werden könnte, dass der Unterschied nicht mehr der zusätzlichen Anstrengung wert ist, ein separates Modell zu trainieren.

* Man könnte hoffen, dass mit wachsenden Bedenken hinsichtlich IP-Provenienz-Problemen alle solchen Quellen zitiert werden; aber wenn die verfügbaren Materialien aus der neuen Arbeit die Quelle der 3D-Modelle auflisten, konnte ich diese Referenz nicht finden.

† Der bereitgestellte Verweis scheint ein generischer Erklärungstext von 2013 zu sein, wobei das spezifische VAE nicht detailliert ist.

†† Entnommen aus dem Papier, ist dies eine semantisch unklare Beschreibung, da Feinabstimmung und LoRA unterschiedliche Prozesse mit sehr unterschiedlichen Anforderungen sind.

Erstveröffentlicht am Samstag, 21. März 2026