Andersons Blickwinkel

Vibe-Coding leidet, wenn die Rolle von KI erweitert wird

Eine neue Studie zeigt, dass Vibe-Coding verbessert wird, wenn Menschen die Anweisungen geben, aber verschlechtert, wenn KI dies tut, wobei die beste hybride Einrichtung Menschen an erster Stelle hält, mit KI als Schiedsrichter oder Richter.

Neue Forschungsergebnisse aus den Vereinigten Staaten, die untersuchen, was passiert, wenn KI-Systeme erlaubt werden, Vibe-Coding zu steuern, anstatt einfach menschliche Anweisungen auszuführen, haben festgestellt, dass die Ergebnisse fast immer schlechter sind, wenn Large Language Models (LLMs) eine größere richtungsweisende Rolle übernehmen.

Obwohl die Forscher OpenAIs GPT-5 als Rahmen für ihre menschlichen/KI-Kollaborations-Experimente verwendet haben, bestätigten sie später, dass sowohl Anthropics Claude Opus 4.5 als auch Google Gemini 3 Pro dem gleichen Verschlechterungstrend unterlagen, als die Verantwortung wuchs, und erklärten, dass “sogar begrenzte menschliche Beteiligung die Leistung stetig verbessert”:

‘[Menschen] bieten einzigartig effektive hochrangige Anleitung über Iterationen hinweg, [während] KI-Anleitung oft zu Leistungsverlust führt. Außerdem finden wir, dass eine sorgfältige Rollenzuweisung, die Menschen für die Richtung verantwortlich macht und die Bewertung an KI auslagert, die hybride Leistung verbessern kann.’

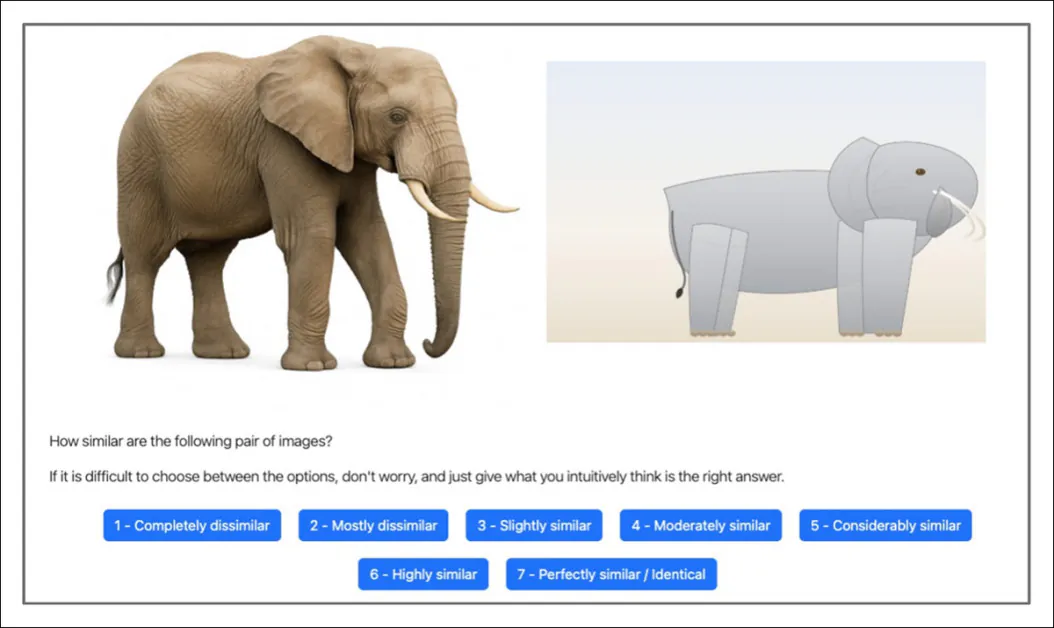

Um einen konsistenten Test zu ermöglichen, der sowohl von Menschen als auch von KI gleichwertig bewertet werden kann, wurde ein kontrolliertes experimentelles Framework um eine iterative Codierungsaufgabe herum aufgebaut, bei der ein Referenzbild – mit einem Foto von einer Katze, einem Hund, einem Tiger, einem Vogel, einem Elefanten, einem Pinguin, einem Hai, einem Zebra, einer Giraffe oder einem Panda – mithilfe von skalierbaren Vektorgrafiken (SVG) rekonstruiert werden musste und diese Rekonstruktion anhand des Fotos bewertet werden musste, aus dem sie abgeleitet wurde:

Sowohl menschliche als auch KI-Teilnehmer wurden ein fotografisches Referenzbild zusammen mit einer KI-generierten SVG-Rekonstruktion gezeigt und aufgefordert, zu bewerten, wie ähnlich die beiden auf einer siebenstufigen Skala sind. Quelle

In jeder Runde gab ein Agent hochrangige natürliche Sprachanweisungen, um einen Code-Generator zu steuern, und ein anderer entschied, ob die neue Version beibehalten oder zur vorherigen Version zurückgekehrt werden sollte – eine strukturierte Schleife, die reale Kollaborations-Workflows widerspiegelt.

Über 16 Experimente mit 604 Teilnehmern und Tausenden von API-Aufrufen wurden vollständig menschlich geführte Testrunden direkt mit vollständig KI-geführten Runden unter identischen Bedingungen verglichen.

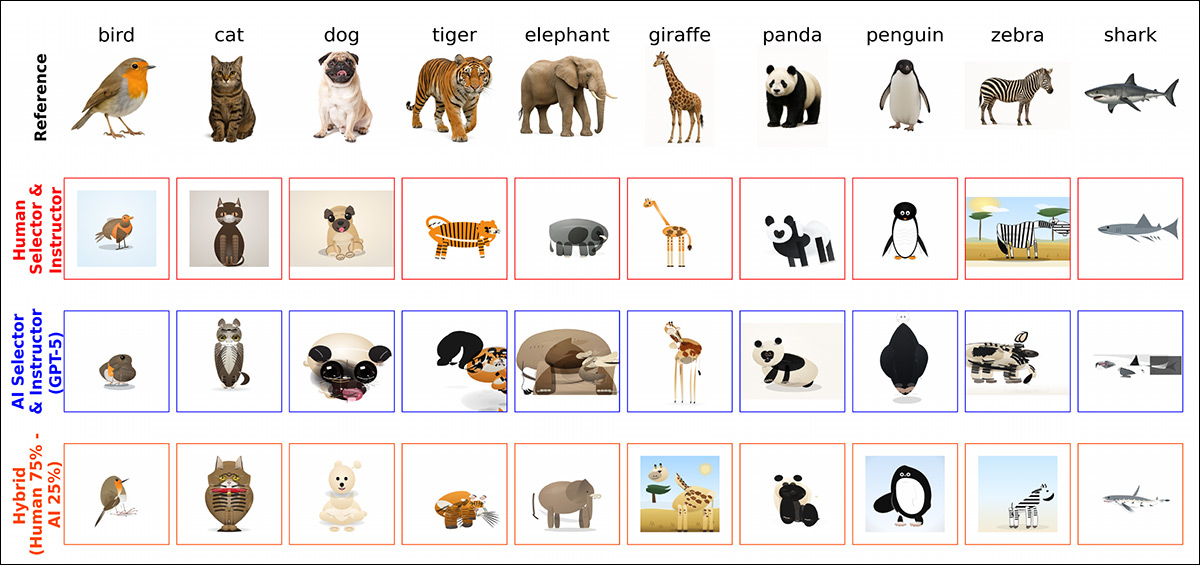

Einige der verschiedenen Lösungen, die durch verschiedene Kombinationen von menschlicher/KI-Kollaborations-Prozentsätzen und -Typen erreicht wurden (entnommen aus einer größeren Abbildung in der Quellenarbeit, auf die wir den Leser verweisen).

Obwohl Menschen und KI auf ähnlichem Niveau bei den Baseline-Tests begannen, divergierten ihre Trajektoren im Laufe der Zeit: Wenn Menschen die Anweisungen gaben und die Auswahlentscheidungen trafen, erhöhten sich die Ähnlichkeitsscores über die Iterationen hinweg, mit stetiger kumulativer Verbesserung; aber wenn KI-Systeme beide Rollen ausfüllten, zeigte die Leistung keine konsistenten Gewinne und verschlechterte sich häufig über die Runden hinweg – auch wenn das gleiche zugrunde liegende Modell für die Code-Generierung verwendet wurde und die KI Zugang zu den gleichen Informationen wie die menschlichen Teilnehmer hatte.

Der Prolixity-Effekt

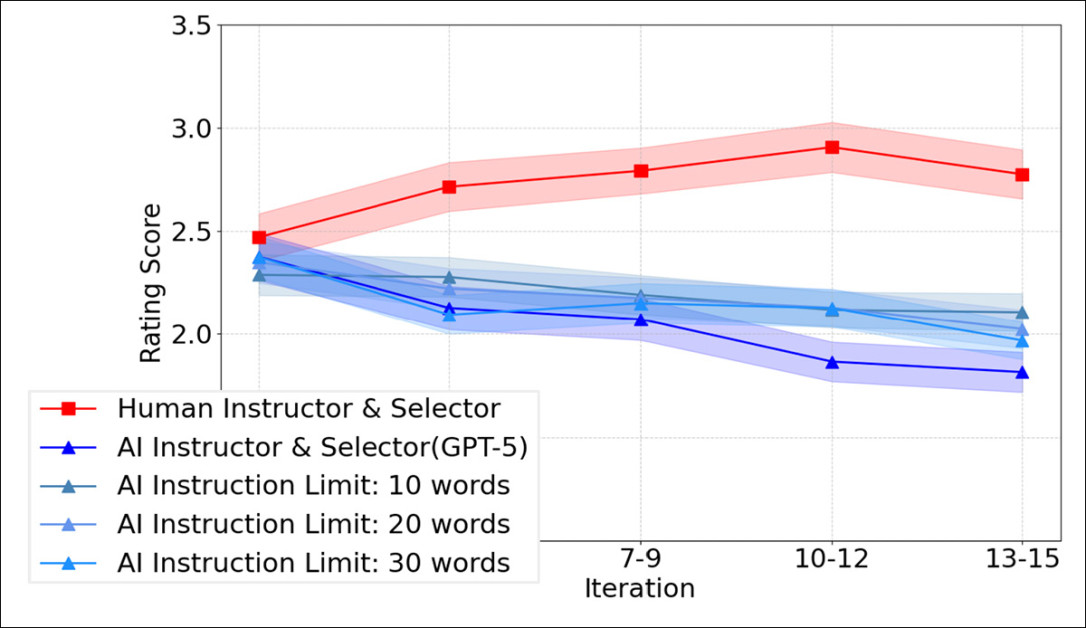

Die Ergebnisse zeigten auch, dass menschliche Anweisungen typischerweise kurz und handlungsorientiert waren, sich auf die Änderung des aktuellen Bildes konzentrierten; im Gegensatz dazu waren KI-Anweisungen viel länger und detaillierter (ein Faktor, der für GPT-5 parametriert wurde), beschrieben visuelle Attribute anstelle von inkrementalen Korrekturen.

Aber, wie im folgenden Graphen zu sehen ist, führte die strikte Begrenzung der KI-Anweisungen auf 10, 20 oder 30 Wörter nicht zu einer Umkehrung des Musters; auch wenn KI-geführte Ketten auf 10, 20 oder 30 Wörter beschränkt wurden, verbesserten sie sich nicht über die Zeit hinweg:

Ähnlichkeitsscores über Iterationen für menschlich geführte Runden im Vergleich zu vollständig KI-geführten Runden, die auf 10, 20 oder 30 Wörter beschränkt sind. Offensichtlich verhindert die Verkürzung von KI-Prompts den iterativen Leistungsabfall nicht, der beobachtet wird, wenn KI sowohl Anweisung als auch Auswahl leitet.

Hybride Experimente machten das Muster deutlicher, indem sie zeigten, dass die Hinzufügung von sogar einem kleinen Anteil menschlicher Beteiligung die Ergebnisse verbesserte, im Vergleich zu vollständig KI-geführten Einrichtungen; jedoch verschlechterte sich die Leistung in der Regel, wenn der Anteil der KI-Anleitung zunahm.

Wenn die Rollen getrennt wurden, konnte die Bewertung und Auswahl an KI mit relativ geringem Qualitätsverlust übertragen werden; aber die Ersetzung menschlicher hochrangiger Anweisungen durch KI-Anleitung führte zu bemerkbaren Leistungsabfällen, was darauf hindeutet, dass es nicht darauf ankommt, wer den Code generiert, sondern wer die Richtung setzt und aufrechterhält über die Iterationen hinweg.