Künstliche Intelligenz

Selbst-Aufmerksamkeits-Führung: Verbesserung der Stichprobenqualität von Diffusionsmodellen

Denoising-Diffusionsmodelle sind generative KI-Rahmenwerke, die Bilder aus Rauschen durch einen iterativen Entrauschungsprozess synthesieren. Sie werden für ihre außergewöhnlichen Bildgenerierungs-Fähigkeiten und Vielfalt gefeiert, die größtenteils auf text- oder klassenbedingte Führungsmethoden zurückzuführen sind, einschließlich Klassifizierungs-Führung und klassenfreier Führung. Diese Modelle haben sich als besonders erfolgreich bei der Erstellung vielfältiger, hochwertiger Bilder erwiesen. Jüngste Studien haben gezeigt, dass Führungs-Techniken wie Klassenzuschriften und -etiketten eine entscheidende Rolle bei der Verbesserung der Qualität der von diesen Modellen generierten Bilder spielen.

Allerdings stehen Diffusionsmodelle und Führungs-Methoden unter bestimmten externen Bedingungen vor Einschränkungen. Die Methode der Klassifizierungs-Freiheit (CFG), die Label-Dropping verwendet, fügt dem Trainingsprozess Komplexität hinzu, während die Klassifizierungs-Methode (CG) zusätzliches Klassifizierungs-Training erfordert. Beide Methoden sind in gewissem Maße durch ihre Abhängigkeit von hart erarbeiteten externen Bedingungen eingeschränkt, was ihre Potenziale begrenzt und sie auf bedingte Einstellungen beschränkt.

Um diese Einschränkungen zu überwinden, haben Entwickler einen allgemeineren Ansatz für Diffusions-Führung entwickelt, der als Selbst-Aufmerksamkeits-Führung (SAG) bekannt ist. Diese Methode nutzt Informationen aus Zwischen-Stichproben von Diffusions-Modellen, um Bilder zu generieren. Wir werden SAG in diesem Artikel untersuchen, indem wir seine Funktionsweise, Methodik und Ergebnisse im Vergleich zu aktuellen State-of-the-Art-Frameworks und -Pipelines diskutieren.

Self-Attention Guidance : Verbesserung der Stichprobenqualität von Diffusionsmodellen

Denoising-Diffusionsmodelle (DDMs) haben aufgrund ihrer Fähigkeit, Bilder aus Rauschen durch einen iterativen Entrauschungsprozess zu erstellen, an Popularität gewonnen. Die Bildsynthese-Fähigkeiten dieser Modelle sind größtenteils auf die eingesetzten Diffusions-Führungs-Methoden zurückzuführen. Trotz ihrer Stärken stehen Diffusionsmodelle und führungs-basierte Methoden vor Herausforderungen wie zusätzlicher Komplexität und erhöhten Rechenkosten.

Um die aktuellen Einschränkungen zu überwinden, haben Entwickler die Selbst-Aufmerksamkeits-Führungs-Methode eingeführt, eine allgemeinere Formulierung der Diffusions-Führung, die nicht auf externe Informationen von Diffusions-Führung angewiesen ist, sondern eine bedingungsfreie und flexible Herangehensweise an die Führung von Diffusions-Frameworks ermöglicht. Der Ansatz, den die Selbst-Aufmerksamkeits-Führung gewählt hat, hilft letztendlich dabei, die Anwendbarkeit der traditionellen Diffusions-Führungs-Methoden auf Fälle mit oder ohne externe Anforderungen zu verbessern.

Die Selbst-Aufmerksamkeits-Führung basiert auf dem einfachen Prinzip der verallgemeinerten Formulierung und der Annahme, dass interne Informationen, die in Zwischen-Stichproben enthalten sind, als Führung dienen können. Auf der Grundlage dieses Prinzips führt die SAG-Methode zunächst eine Blur-Führung ein, eine einfache und direkte Lösung, um die Stichprobenqualität zu verbessern. Die Blur-Führung zielt darauf ab, die benignen Eigenschaften des Gauss’schen Verschmierens auszunutzen, um feinskalige Details natürlicherweise durch die eliminierte Information als Ergebnis des Gauss’schen Verschmierens zu entfernen. Obwohl die Blur-Führung die Stichprobenqualität mit einem moderaten Führungsmaßstab verbessert, kann sie die Ergebnisse auf einem großen Führungsmaßstab nicht replizieren, da sie oft strukturelle Mehrdeutigkeit in ganzen Regionen einführt. Als Ergebnis hat die Blur-Führung Schwierigkeiten, die ursprüngliche Eingabe mit der Vorhersage der verschlechterten Eingabe in Einklang zu bringen. Um die Stabilität und Effektivität der Blur-Führung auf einem größeren Führungsmaßstab zu verbessern, versucht die Selbst-Aufmerksamkeits-Führung, den Selbst-Aufmerksamkeits-Mechanismus der Diffusions-Modelle auszunutzen, da moderne Diffusions-Modelle bereits einen Selbst-Aufmerksamkeits-Mechanismus in ihrer Architektur enthalten.

Mit der Annahme, dass Selbst-Aufmerksamkeit essentiell ist, um saliente Informationen zu erfassen, verwendet die Selbst-Aufmerksamkeits-Führungs-Methode Selbst-Aufmerksamkeits-Karten der Diffusions-Modelle, um die Regionen mit salienten Informationen feindlich zu verschmieren, und führt die Diffusions-Modelle mit den erforderlichen Rest-Informationen. Die Methode nutzt dann die Aufmerksamkeits-Karten während des umgekehrten Prozesses der Diffusions-Modelle, um die Qualität der Bilder zu verbessern und verwendet Selbst-Konditionierung, um Artefakte ohne zusätzliche Schulung oder externe Informationen zu reduzieren.

Zusammenfassend lässt sich sagen, dass die Selbst-Aufmerksamkeits-Führungs-Methode

- Ein neuer Ansatz ist, der interne Selbst-Aufmerksamkeits-Karten von Diffusions-Frameworks verwendet, um die generierte Stichproben-Bildqualität ohne zusätzliche Schulung oder externe Bedingungen zu verbessern.

- Die SAG-Methode versucht, konditionale Führungs-Methoden in eine bedingungsfreie Methode zu verallgemeinern, die in jedes Diffusions-Modell integriert werden kann, ohne zusätzliche Ressourcen oder externe Bedingungen zu erfordern, und damit die Anwendbarkeit von führungs-basierten Frameworks zu verbessern.

- Die SAG-Methode versucht auch, ihre orthogonale Fähigkeit zu bestehenden konditionalen Methoden und Frameworks zu demonstrieren, und damit eine Leistungssteigerung durch flexible Integration mit anderen Methoden und Modellen zu ermöglichen.

Weiterhin lernt die Selbst-Aufmerksamkeits-Führungs-Methode von den Erkenntnissen verwandter Frameworks, einschließlich Denoising-Diffusions-Modellen, Sampling-Führung, generativer KI-Selbst-Aufmerksamkeits-Methoden und internen Repräsentationen von Diffusions-Modellen. Allerdings implementiert die Selbst-Aufmerksamkeits-Führungs-Methode im Kern die Erkenntnisse von DDPM oder Denoising-Diffusions-Probabilistischen Modellen, Klassifizierungs-Führung, klassenfreier Führung und Selbst-Aufmerksamkeit in Diffusions-Frameworks. Wir werden darüber in den nächsten Abschnitten ausführlicher sprechen.

Self-Attention Guidance : Grundlagen, Methodik und Architektur

Denoising-Diffusions-Probabilistisches Modell oder DDPM

DDPM oder Denoising-Diffusions-Probabilistisches Modell ist ein Modell, das einen iterativen Entrauschungsprozess verwendet, um ein Bild aus weißem Rauschen zu rekonstruieren. Traditionell erhält ein DDPM-Modell eine Eingabe-Bild und eine Varianz-Zeitplanung zu einem Zeitpunkt, um das Bild mithilfe eines Vorwärts-Prozesses, bekannt als Markov-Prozess, zu erhalten.

Klassifizierungs- und Klassenfreie Führung mit GAN-Implementierung

GAN oder Generative Adversarial Networks besitzen einzigartige Trading-Diversität für Treue, und um diese Fähigkeit von GAN-Frameworks zu Diffusions-Modellen zu bringen, schlägt die Selbst-Aufmerksamkeits-Führungs-Methode vor, eine Klassifizierungs-Führungs-Methode zu verwenden, die eine zusätzliche Klassifizierung verwendet. Umgekehrt kann auch eine klassenfreie Führungs-Methode ohne die Verwendung einer zusätzlichen Klassifizierung implementiert werden, um die gleichen Ergebnisse zu erzielen. Obwohl die Methode die gewünschten Ergebnisse liefert, ist sie noch nicht rechnerisch tragbar, da sie zusätzliche Labels erfordert und das Framework auf bedingte Diffusions-Modelle beschränkt, die zusätzliche Bedingungen wie Text oder Klasse sowie zusätzliche Schulungsdetails erfordern, was die Komplexität des Modells erhöht.

Verallgemeinern von Diffusions-Führung

Obwohl Klassifizierungs- und klassenfreie Führungs-Methoden die gewünschten Ergebnisse liefern und bei der konditionalen Generierung in Diffusions-Modellen helfen, sind sie von zusätzlichen Eingaben abhängig. Für jeden gegebenen Zeitpunkt besteht die Eingabe für ein Diffusions-Modell aus einer verallgemeinerten Bedingung und einer gestörten Stichprobe ohne die verallgemeinerte Bedingung. Darüber hinaus umfasst die verallgemeinerte Bedingung interne Informationen innerhalb der gestörten Stichprobe oder eine externe Bedingung oder beides. Die resultierende Führung wird mit der Verwendung eines imaginären Regressors formuliert, unter der Annahme, dass es die verallgemeinerte Bedingung vorhersagen kann.

Verbesserung der Bildqualität mithilfe von Selbst-Aufmerksamkeits-Karten

Die verallgemeinerte Diffusions-Führung impliziert, dass es möglich ist, die umgekehrte Prozess von Diffusions-Modellen durch die Extraktion von salienten Informationen in der verallgemeinerten Bedingung, die in der gestörten Stichprobe enthalten ist, zu führen. Aufbauend auf diesem Prinzip erfasst die Selbst-Aufmerksamkeits-Führungs-Methode die salienten Informationen für umgekehrte Prozesse effektiv, während sie die Risiken, die durch außerhalb der Verteilung liegende Probleme in vorgebildeten Diffusions-Modellen entstehen, begrenzt.

Blur-Führung

Die Blur-Führung in der Selbst-Aufmerksamkeits-Führung basiert auf dem Gauss’schen Verschmieren, einer linearen Filtermethode, bei der das Eingabesignal mit einem Gauss-Filter konvolviert wird, um ein Ausgabesignal zu erzeugen. Mit zunehmender Standardabweichung reduziert das Gauss’sche Verschmieren die feinskaligen Details innerhalb der Eingabesignale und resultiert in lokal nicht unterscheidbaren Eingabesignalen, indem es sie auf einen konstanten Wert glättet. Darüber hinaus haben Experimente eine Informations-Asymmetrie zwischen dem Eingabesignal und dem Ausgabesignal des Gauss’schen Verschmierens gezeigt, wobei das Ausgabesignal mehr feinskalige Informationen enthält.

Auf der Grundlage dieser Erkenntnis führt die Selbst-Aufmerksamkeits-Führungs-Methode die Blur-Führung ein, eine Technik, die absichtlich die Informationen aus Zwischen-Rekonstruktionen während des Diffusions-Prozesses ausschließt und stattdessen diese Informationen verwendet, um ihre Vorhersagen in Richtung einer erhöhten Relevanz der Bilder für die Eingabe-Informationen zu führen. Die Blur-Führung verursacht letztendlich, dass die ursprüngliche Vorhersage mehr von der verschmierten Eingabe-Vorhersage abweicht. Darüber hinaus verhindert die benigne Eigenschaft des Gauss’schen Verschmierens, dass die Ausgabesignale sich von dem ursprünglichen Signal mit einem moderaten Abweichungswert unterscheiden. In einfachen Worten verschwimmen die Bilder natürlicherweise, was das Gauss’sche Verschmieren zu einer geeigneteren Methode für vorgebildete Diffusions-Modelle macht.

In der Selbst-Aufmerksamkeits-Führungs-Pipeline wird das Eingabesignal zunächst mit einem Gauss-Filter verschmiert und dann mit zusätzlichem Rauschen diffundiert, um das Ausgabesignal zu erzeugen. Durch diese Vorgehensweise mildert die SAG-Pipeline die Nebenwirkung des resultierenden Verschmierens, das die Gauss-Rauschen reduziert, und macht die Führung von Inhalten abhängig, anstatt von zufälligem Rauschen. Obwohl die Blur-Führung auf Frameworks mit moderatem Führungsmaßstab zufriedenstellende Ergebnisse liefert, kann sie die Ergebnisse auf bestehenden Modellen mit großem Führungsmaßstab nicht replizieren, da sie anfällig für die Erzeugung von verrauschten Ergebnissen ist, wie in der folgenden Abbildung gezeigt.

Diese Ergebnisse können das Ergebnis der strukturellen Mehrdeutigkeit sein, die durch das globale Verschmieren in das Framework eingeführt wird, was es der SAG-Pipeline schwer macht, die Vorhersagen der ursprünglichen Eingabe mit der verschlechterten Eingabe in Einklang zu bringen, was zu verrauschten Ausgaben führt.

Self-Attention-Mechanismus

Wie bereits erwähnt, enthalten Diffusions-Modelle normalerweise einen eingebauten Selbst-Aufmerksamkeits-Mechanismus, und es ist einer der wesentlichen Bestandteile in einem Diffusions-Modell-Framework. Der Selbst-Aufmerksamkeits-Mechanismus wird im Kern der Diffusions-Modelle implementiert und ermöglicht es dem Modell, während des generativen Prozesses auf die salienten Teile der Eingabe zu achten, wie in der folgenden Abbildung mit hochfrequenten Masken in der oberen Reihe und Selbst-Aufmerksamkeits-Masken in der unteren Reihe der endgültig generierten Bilder gezeigt.

Die vorgeschlagene Selbst-Aufmerksamkeits-Führungs-Methode baut auf dem gleichen Prinzip auf und nutzt die Fähigkeiten von Selbst-Aufmerksamkeits-Karten in Diffusions-Modellen. Insgesamt verschmiert die Selbst-Aufmerksamkeits-Führungs-Methode die selbst-achtenden Patches in der Eingabe-Signal oder in einfachen Worten, verdeckt die Information von Patches, die von den Diffusions-Modellen beachtet werden. Darüber hinaus enthalten die Ausgabesignale in der Selbst-Aufmerksamkeits-Führung intakte Regionen der Eingabesignale, was bedeutet, dass sie nicht zu struktureller Mehrdeutigkeit der Eingaben führen und das Problem des globalen Verschmierens lösen. Die Pipeline erhält dann die aggregierten Selbst-Aufmerksamkeits-Karten, indem sie eine globale Durchschnitts-Pooling (GAP) durchführt, um die Selbst-Aufmerksamkeits-Karten auf die Dimension zu aggregieren, und die nächste Nachbarn-Auflösung, um die Auflösung des Eingabesignals zu matchen.

Self-Attention Guidance : Experimente und Ergebnisse

Um ihre Leistung zu bewerten, wird die Selbst-Aufmerksamkeits-Führungs-Pipeline mit 8 Nvidia GeForce RTX 3090 GPUs beprobt und auf vorgebildeten IDDPM-, ADM- und Stable Diffusion-Frameworks aufgebaut.

Unbedingte Generierung mit Selbst-Aufmerksamkeits-Führung

Um die Effektivität der SAG-Pipeline auf unbedingten Modellen zu messen und ihre bedingungsfreie Eigenschaft zu demonstrieren, die nicht von Klassifizierungs-Führung und klassenfreier Führung besessen wird, wird die SAG-Pipeline auf unbedingt vorgebildeten Frameworks mit 50.000 Stichproben durchgeführt.

Wie zu beobachten ist, verbessert die Implementierung der SAG-Pipeline die FID-, sFID- und IS-Metriken der unbedingten Eingabe, während sie gleichzeitig den Recall-Wert senkt. Darüber hinaus ist die qualitative Verbesserung durch die Implementierung der SAG-Pipeline in den folgenden Bildern erkennbar, wo die Bilder oben Ergebnisse von ADM- und Stable Diffusion-Frameworks sind, während die Bilder unten Ergebnisse von ADM- und Stable Diffusion-Frameworks mit der SAG-Pipeline sind.

Bedingte Generierung mit SAG

Die Integration der SAG-Pipeline in bestehende Frameworks liefert außergewöhnliche Ergebnisse bei der unbedingten Generierung, und die SAG-Pipeline ist in der Lage, bedingungsagnostisch zu sein, was es ermöglicht, sie für bedingte Generierung zu implementieren.

Stable Diffusion mit Selbst-Aufmerksamkeits-Führung

Obwohl das ursprüngliche Stable Diffusion-Framework hochwertige Bilder generiert, kann die Integration des Stable Diffusion-Frameworks mit der Selbst-Aufmerksamkeits-Führungs-Pipeline die Ergebnisse drastisch verbessern. Um ihre Wirkung zu bewerten, verwenden Entwickler leere Prompts für Stable Diffusion mit zufälligem Seed für jedes Bildpaar und verwenden menschliche Bewertung auf 500 Bildpaaren mit und ohne Selbst-Aufmerksamkeits-Führung. Die Ergebnisse sind in der folgenden Abbildung dargestellt.

Darüber hinaus kann die Implementierung von SAG die Fähigkeiten des Stable Diffusion-Frameworks verbessern, da die Kombination von klassenfreier Führung mit Selbst-Aufmerksamkeits-Führung den Bereich der Stable Diffusion-Modelle auf Text-Bild-Synthese erweitern kann. Darüber hinaus sind die generierten Bilder aus dem Stable Diffusion-Modell mit Selbst-Aufmerksamkeits-Führung von höherer Qualität mit weniger Artefakten dank der Selbst-Konditionierungswirkung der SAG-Pipeline, wie in der folgenden Abbildung gezeigt.

Aktuelle Einschränkungen

Obwohl die Implementierung der Selbst-Aufmerksamkeits-Führungs-Pipeline die Qualität der generierten Bilder erheblich verbessern kann, hat sie einige Einschränkungen.

Eine der wichtigsten Einschränkungen ist die Orthogonalität mit Klassifizierungs-Führung und klassenfreier Führung. Wie in der folgenden Abbildung zu beobachten ist, verbessert die Implementierung von SAG die FID-Punktzahl und Vorhersage-Punktzahl, was bedeutet, dass die SAG-Pipeline einen orthogonalen Bestandteil enthält, der gleichzeitig mit traditionellen Führungs-Methoden verwendet werden kann.

Allerdings erfordert sie, dass Diffusions-Modelle auf eine bestimmte Weise trainiert werden, was die Komplexität und Rechenkosten erhöht.

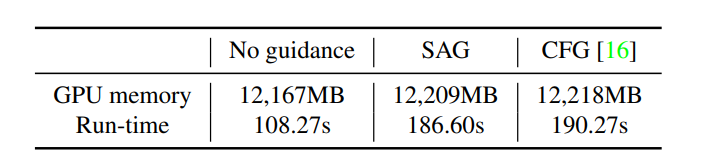

Darüber hinaus erhöht die Implementierung der Selbst-Aufmerksamkeits-Führung nicht den Speicher- oder Zeitverbrauch, ein Hinweis darauf, dass der Overhead, der durch Operationen wie Maskierung und Verschmieren in SAG entsteht, vernachlässigbar ist. Allerdings erhöht sie die Rechenkosten, da sie einen zusätzlichen Schritt im Vergleich zu Ansätzen ohne Führung beinhaltet.

Schlussgedanken

In diesem Artikel haben wir über Selbst-Aufmerksamkeits-Führung gesprochen, einer neuen und allgemeinen Formulierung der Führungs-Methode, die interne Informationen innerhalb der Diffusions-Modelle verwendet, um hochwertige Bilder zu generieren. Die Selbst-Aufmerksamkeits-Führung basiert auf dem einfachen Prinzip der verallgemeinerten Formulierung und der Annahme, dass interne Informationen, die in Zwischen-Stichproben enthalten sind, als Führung dienen können. Die Selbst-Aufmerksamkeits-Führungs-Pipeline ist eine bedingungsfreie und schulungsfreie Herangehensweise, die in verschiedene Diffusions-Modelle integriert werden kann, und verwendet Selbst-Konditionierung, um Artefakte in den generierten Bildern zu reduzieren und die Gesamtkualität zu verbessern.