Künstliche Intelligenz

Warum können generative Videosysteme keine vollständigen Filme erstellen?

Die Entwicklung und der Fortschritt von generativem AI-Video haben viele beiläufige Beobachter dazu veranlasst, vorherzusagen, dass maschinelles Lernen den Tod der Filmindustrie, wie wir sie kennen, bewirken wird – stattdessen werden einzelne Ersteller in der Lage sein, Hollywood-ähnliche Blockbuster zu Hause zu erstellen, entweder auf lokalen oder cloudbasierten GPU-Systemen.

Ist dies möglich? Selbst wenn es möglich ist, ist es unmittelbar, wie so viele glauben?

Dass Einzelpersonen letztendlich in der Lage sein werden, Filme zu erstellen, in der Form, die wir kennen, mit konsistenten Charakteren, narrativer Kontinuität und totaler Photorealismus, ist durchaus möglich – und vielleicht sogar unvermeidlich.

Es gibt jedoch mehrere grundlegende Gründe, warum dies nicht mit Videosystemen auf der Grundlage von Latent-Diffusionsmodellen geschehen wird.

Dieser letzte Punkt ist wichtig, weil zurzeit alle populären Text-zu-Video- (T2-) und Bild-zu-Video- (I2V-) Systeme, einschließlich Minimax, Kling, Sora, Imagen, Luma, Amazon Video Generator, Runway ML, Kaiber (und, soweit wir erkennen können, Adobe Fireflys bevorstehende Videofunktion); unter vielen anderen.

Hier betrachten wir die Aussicht auf wahre auteur-Vollproduktionen, erstellt von Einzelpersonen, mit konsistenten Charakteren, Kameraarbeit und visuellen Effekten, die mindestens auf dem gleichen Niveau wie der aktuelle Stand der Technik in Hollywood sind.

Lassen Sie uns einige der größten praktischen Hindernisse für die Herausforderungen betrachten.

1: Sie können kein genaues Nachfolgeshot erstellen

Narrative Inkonsistenz ist das größte dieser Hindernisse. Die Tatsache ist, dass kein derzeit verfügbares Videosystem ein wirklich genaues ‘Nachfolgeshot’ erstellen kann.

Dies liegt daran, dass das Denoising-Diffusionsmodell im Herzen dieser Systeme auf zufälligem Rauschen basiert, und dieses Kernprinzip ist nicht geeignet, um genau denselben Inhalt zweimal zu interpretieren (d. h. aus verschiedenen Perspektiven oder durch die Entwicklung des vorherigen Shots in ein Nachfolgeshot, das die Konsistenz mit dem vorherigen Shot aufrechterhält).

Wo Textprompts verwendet werden, allein oder zusammen mit hochgeladenen ‘Seed’-Bildern (multimodale Eingabe), werden die Token aus dem Prompt semantisch geeignete Inhalte aus dem trainierten latenten Raum des Modells hervorrufen.

Jedoch wird es durch den ‘zufälligen Rauschen’-Faktor weiter behindert, und es wird nicht auf die gleiche Weise zweimal.

Dies bedeutet, dass die Identitäten von Personen im Video tendenziell wechseln und Objekte und Umgebungen nicht mit dem ursprünglichen Shot übereinstimmen.

Dies ist der Grund, warum virale Clips, die außergewöhnliche visuelle Effekte und Hollywood-ähnliche Ausgaben zeigen, tendenziell entweder einzelne Shots oder eine ‘Showcase-Montage’ der Fähigkeiten des Systems sind, bei der jeder Shot unterschiedliche Charaktere und Umgebungen zeigt.

Ausschnitte aus einer generativen AI-Montage von Marco van Hylckama Vlieg – Quelle: https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ/

Die Implikation in diesen Sammlungen von ad hoc-Video-Generierungen (die im Falle kommerzieller Systeme vielleicht nicht ganz ehrlich sind) ist, dass das zugrunde liegende System in der Lage ist, kontinuierliche und konsistente Erzählungen zu erstellen.

Die Analogie, die hier ausgenutzt wird, ist ein Filmtrailer, der nur eine Minute oder zwei Filmmaterial zeigt, aber dem Publikum einen Grund gibt, zu glauben, dass der gesamte Film existiert.

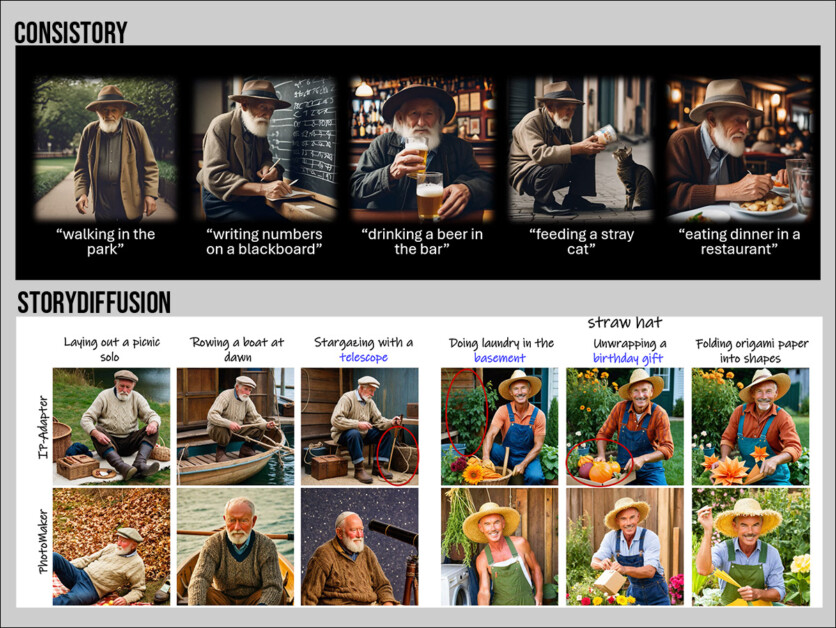

Die einzigen Systeme, die derzeit narrative Konsistenz in einem Diffusionsmodell bieten, sind die, die Stillbilder produzieren. Dazu gehören NVIDIAs ConsiStory und diverse Projekte in der wissenschaftlichen Literatur, wie TheaterGen, DreamStory und StoryDiffusion.

Zwei Beispiele für ‘statische’ narrative Kontinuität, von aktuellen Modellen:: Quellen: https://research.nvidia.com/labs/par/consistory/ und https://arxiv.org/pdf/2405.01434

Theoretisch könnte man ein besseres System dieser Art (keines der oben genannten ist wirklich konsistent) verwenden, um eine Reihe von Bild-zu-Video-Shots zu erstellen, die zu einer Sequenz zusammengefügt werden könnten.

Im aktuellen Stand der Technik produziert dieser Ansatz jedoch keine plausiblen Nachfolgeshots; und wir haben bereits von dem auteur-Traum abgewichen, indem wir eine Schicht von Komplexität hinzugefügt haben.

Wir können zusätzlich Low-Rank-Adaptation (LoRA)-Modelle verwenden, die speziell auf Charaktere, Dinge oder Umgebungen trainiert sind, um eine bessere Konsistenz über Shots hinweg zu gewährleisten.

Jedoch muss, wenn ein Charakter in einem neuen Kostüm erscheinen soll, in der Regel ein neues LoRA trainiert werden, das den Charakter in diesem Kostüm verkörpert (obwohl Subkonzepte wie ‘rotes Kleid’ in separate LoRAs trainiert werden können, zusammen mit geeigneten Bildern, sind sie nicht immer leicht zu handhaben).

Dies fügt erhebliche Komplexität hinzu, sogar zu einer Eröffnungsszene in einem Film, in der eine Person aus dem Bett steigt, einen Morgenmantel anzieht, gähnt, aus dem Schlafzimmerfenster schaut und ins Badezimmer geht, um sich die Zähne zu putzen.

Eine solche Szene, die etwa 4-8 Shots enthält, kann mit herkömmlichen Filmproduktionsverfahren an einem Morgen gedreht werden; im aktuellen Stand der Technik in generativer KI kann dies möglicherweise Wochen der Arbeit, mehrere trainierte LoRAs (oder andere Nebensysteme) und eine erhebliche Menge an Nachbearbeitung darstellen.

Alternativ kann Video-zu-Video verwendet werden, bei dem alltägliche oder CGI-Filmmaterial durch Textprompts in alternative Interpretationen umgewandelt wird. Runway bietet beispielsweise ein solches System.

CGI (links) aus Blender, interpretiert in einem textgestützten Runway-Video-zu-Video-Experiment von Mathieu Visnjevec – Quelle: https://www.linkedin.com/feed/update/urn:li:activity:7240525965309726721/