सर्वश्रेष्ठ

10 सर्वश्रेष्ठ मशीन लर्निंग एल्गोरिदम

हम जीपीयू-एक्सेलरेटेड मशीन लर्निंग में असाधारण नवाचार के समय से गुजर रहे हैं, लेकिन हाल के शोध पत्रों में अक्सर ऐसे एल्गोरिदम होते हैं जो दशकों पुराने हैं, और कुछ मामलों में 70 वर्ष पुराने हैं। कुछ लोग तर्क दे सकते हैं कि इन पुराने तरीकों में से कई ‘सांख्यिकीय विश्लेषण’ की श्रेणी में आते हैं, न कि मशीन लर्निंग, और इस क्षेत्र की उत्पत्ति को केवल 1957 तक ही मानते हैं, जब परसेप्ट्रॉन का आविष्कार हुआ था। हालांकि, यह देखते हुए कि ये पुराने एल्गोरिदम नवीनतम रुझानों और मशीन लर्निंग में हेडलाइन-ग्रैबिंग विकास का समर्थन करते हैं और उनमें जड़े हुए हैं, यह एक विवादास्पद रुख है। आइए कुछ ‘क्लासिक’ बिल्डिंग ब्लॉक्स पर एक नज़र डालें जो नवीनतम नवाचारों को आधार बनाते हैं, साथ ही कुछ नए प्रवेशी जो एआई हॉल ऑफ फ़ेम के लिए जल्दी बोली लगा रहे हैं।

1: ट्रांसफॉर्मर

2017 में, गूगल रिसर्च ने एक शोध सहयोग का नेतृत्व किया जिसमें पेपर अटेंशन इज ऑल यू नीड शामिल था। इस कार्य ने एक नए आर्किटेक्चर को रेखांकित किया जिसने अटेंशन मैकेनिज्म को एन्कोडर/डिकोडर और रिकरेंट नेटवर्क मॉडल में ‘पाइपिंग’ से एक केंद्रीय परिवर्तनकारी प्रौद्योगिकी में बढ़ावा दिया। इस दृष्टिकोण को ट्रांसफॉर्मर नाम दिया गया था, और यह प्राकृतिक भाषा प्रसंस्करण (एनएलपी) में एक क्रांतिकारी विधि बन गया है, जो कई अन्य उदाहरणों के बीच, स्व-रिग्रेसिव भाषा मॉडल और एआई पोस्टर-चाइल्ड जीपीटी-3 को शक्ति प्रदान करता है।

हाइपरस्केल ट्रांसफॉर्मर एनएलपी परियोजनाओं की एक समयरेखा。 स्रोत: माइक्रोसॉफ्ट

ट्रांसफॉर्मर आर्किटेक्चर एनएलपी से कंप्यूटर विजन में भी पारित हो गया है, जो एक नए पीढ़ी के इमेज सिंथेसिस फ्रेमवर्क को शक्ति प्रदान करता है जैसे कि ओपनएआई के सीएलआईपी और डीएलएल-ई, जो प्रशिक्षित डोमेन से अधूरी छवियों को पूरा करने और नए छवियों को सिंथेसाइज करने के लिए टेक्स्ट>इमेज डोमेन मैपिंग का उपयोग करते हैं, साथ ही साथ कई अन्य संबंधित अनुप्रयोगों में।

डीएलएल-ई एक आंशिक छवि को पूरा करने का प्रयास करता है。 स्रोत: https://openai.com/blog/dall-e/

2: जेनरेटिव एडवर्सेरियल नेटवर्क (GANs)

हालांकि ट्रांसफॉर्मर ने जीपीटी-3 की रिलीज़ और अपनाये जाने के माध्यम से असाधारण मीडिया कवरेज प्राप्त किया है, जेनरेटिव एडवर्सेरियल नेटवर्क (GAN) अपने आप में एक पहचानने योग्य ब्रांड बन गया है, और अंततः डीपफ़ेक के रूप में एक क्रिया बन सकता है। पहली बार 2014 में प्रस्तावित और मुख्य रूप से छवि सिंथेसिस के लिए उपयोग किया जाता है, एक जेनरेटिव एडवर्सेरियल नेटवर्क आर्किटेक्चर एक जेनरेटर और एक डिस्क्रिमिनेटर से बना होता है। जेनरेटर डेटासेट में हजारों छवियों के माध्यम से चक्र चलाता है, पुनरावृत्ति से उन्हें पुनर्निर्माण करने का प्रयास करता है। प्रत्येक प्रयास के लिए, डिस्क्रिमिनेटर जेनरेटर के काम को ग्रेड करता है, और जेनरेटर को बेहतर करने के लिए वापस भेजता है, लेकिन पिछले पुनर्निर्माण में कैसे त्रुटि हुई, इसका कोई अंतर्दृष्टि नहीं देता है।

स्रोत: https://developers.google.com/machine-learning/gan/gan_structure

यह जेनरेटर को कई मार्गों का अन्वेषण करने के लिए मजबूर करता है, बजाय इसके कि यह उन संभावित अंधे गलियारों का पालन करे जो तब होते अगर डिस्क्रिमिनेटर ने उसे बताया होता कि वह कहां गलत हो रहा था (नीचे #8 देखें)। प्रशिक्षण समाप्त होने तक, जेनरेटर के पास डेटासेट में बिंदुओं के बीच संबंधों का एक विस्तृत और व्यापक मानचित्र होता है।

पेपर इम्प्रूविंग जीएन एंड क्वालिब्रियम से: जीएन के लेटेंट स्पेस में एक नोवेल फ्रेमवर्क चक्र, एक इमेज सिंथेसिस आर्किटेक्चर के लिए प्रतिक्रियाशील इंस्ट्रूमेंटलिटी प्रदान करता है। स्रोत: https://genforce.github.io/eqgan/

यह एक ही चीज़ के बीच एक अंतर है – एक ही रूटीन कम्यूट को सीखना, या द नॉलेज हासिल करना। परिणाम जीएन के लेटेंट स्पेस में एक उच्च-स्तरीय संग्रह है। एक उच्च-स्तरीय विशेषता के लिए सेमेंटिक संकेतक ‘व्यक्ति’ हो सकता है, जबकि विशेषता से संबंधित विशिष्टता में उतरने से अन्य सीखी गई विशेषताएं जैसे ‘पुरुष’ और ‘महिला’ का पता चलता है। निचले स्तरों पर, उप-विशेषताएं ‘ब्लोंड’, ‘कॉकेशियन’, आदि में टूट जाती हैं। जीएन और एन्कोडर/डिकोडर फ्रेमवर्क में एंटैंग्लमेंट एक उल्लेखनीय मुद्दा है: क्या जीएन-जेनरेटेड महिला के चेहरे पर मुस्कान उसकी ‘पहचान’ की एक जुड़ी हुई विशेषता है या लेटेंट स्पेस में एक समानांतर शाखा है?

जीएन-जेनरेटेड चेहरे। स्रोत: https://this-person-does-not-exist.com/en

पिछले कुछ वर्षों में इस संबंध में कई नए शोध पहलों का उदय हुआ है, जो शायद जीएन के लेटेंट स्पेस के लिए फीचर-लेवल, फोटोशॉप-शैली के संपादन के लिए मार्ग प्रशस्त कर रहे हैं, लेकिन वर्तमान में अधिकांश परिवर्तन प्रभावी रूप से ‘ऑल-ऑर-नथिंग’ पैकेज हैं। विशेष रूप से, एनवीडिया की एडिटजीएन रिलीज़, जो देर से 2021 में हुई, सेमेंटिक सेगमेंटेशन मास्क का उपयोग करके जीएन के लेटेंट स्पेस में एक उच्च स्तर की व्याख्या प्राप्त करती है। लोकप्रिय उपयोग अपने (वास्तव में बहुत सीमित) डीपफ़ेक वीडियो में शामिल होने के अलावा, इमेज/वीडियो-केंद्रित जीएन ने पिछले चार वर्षों में शोधकर्ताओं और जनता को समान रूप से मोहित किया है। नए रिलीज़ की तेज़ दर और आवृत्ति के साथ तालमेल बिठाना एक चुनौती है, हालांकि गिटहब रिपॉजिटरी अवेसम गैन एप्लिकेशन एक व्यापक सूची प्रदान करने का प्रयास करता है। जेनरेटिव एडवर्सेरियल नेटवर्क सिद्धांत रूप से किसी भी अच्छी तरह से तैयार किए गए डोमेन से विशेषताएं निकाल सकते हैं, 包括 पाठ।

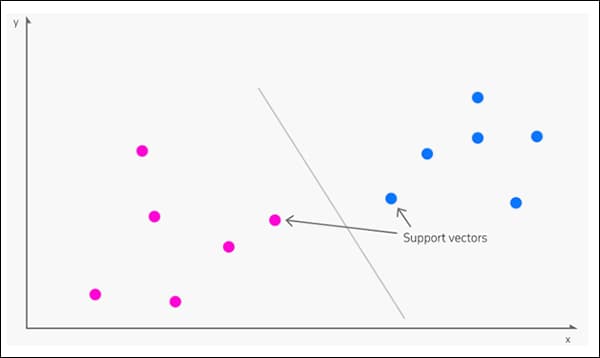

3: एसवीएम

1963 में उत्पन्न, सपोर्ट वेक्टर मशीन (एसवीएम) एक मूल एल्गोरिदम है जो अक्सर नए शोध में दिखाई देता है। एसवीएम के तहत, वेक्टर डेटासेट में डेटा बिंदुओं की सापेक्ष स्थिति को मैप करते हैं, जबकि सपोर्ट वेक्टर विभिन्न समूहों, विशेषताओं या विशेषताओं के बीच सीमाओं को परिभाषित करते हैं।

समूहों के बीच सीमाएं परिभाषित करने वाले सपोर्ट वेक्टर। स्रोत: https://www.kdnuggets.com/2016/07/support-vector-machines-simple-explanation.html

व्युत्पन्न सीमा को हाइपरप्लेन कहा जाता है। निम्न स्तर की विशेषताओं पर, एसवीएम दो-आयामी (ऊपर की छवि) है, लेकिन जहां समूहों या प्रकारों की एक उच्च संख्या मान्यता प्राप्त है, यह त्रि-आयामी हो जाता है।

एक गहरी श्रृंखला की बिंदुओं और समूहों के लिए एक त्रि-आयामी एसवीएम की आवश्यकता है। स्रोत: https://cml.rhul.ac.uk/svm.html

चूंकि सपोर्ट वेक्टर मशीन विभिन्न प्रकार के उच्च-आयामी डेटा को प्रभावी ढंग से और तटस्थ रूप से संबोधित कर सकती हैं, वे विभिन्न मशीन लर्निंग क्षेत्रों में व्यापक रूप से फैली हुई हैं, जिनमें डीपफ़ेक डिटेक्शन, छवि वर्गीकरण, नफ़रत भरा भाषण वर्गीकरण, डीएनए विश्लेषण और जनसंख्या संरचना पूर्वानुमान शामिल हैं, साथ ही कई अन्य।

4: के-मीन्स क्लस्टरिंग

क्लस्टरिंग一般 एक अनुप्रविष्ट शिक्षण दृष्टिकोण है जो घनत्व अनुमान के माध्यम से डेटा बिंदुओं को वर्गीकृत करने का प्रयास करता है, जो अध्ययन किए जा रहे डेटा के वितरण का एक मानचित्र बनाता है।

के-मीन्स क्लस्टरिंग डेटा में खंड, समूह और समुदायों को देखता है। स्रोत: https://aws.amazon.com/blogs/machine-learning/k-means-clustering-with-amazon-sagemaker/

इस दृष्टिकोण का सबसे लोकप्रिय कार्यान्वयन बन गया है, जो डेटा बिंदुओं को विशिष्ट ‘के समूह’ में मार्गदर्शन करता है, जो जनसांख्यिकीय क्षेत्र, ऑनलाइन समुदायों या रॉ सांख्यिकीय डेटा में छिपी हुई किसी भी संभावित संग्रह को इंगित कर सकते हैं।

के-मीन्स विश्लेषण में समूह बनते हैं। स्रोत: https://www.geeksforgeeks.org/ml-determine-the-optimal-value-of-k-in-k-means-clustering/

के मूल्य itself यह प्रक्रिया का निर्धारण कारक है, और एक क्लस्टर के लिए एक ऑप्टिमल मूल्य स्थापित करने में। शुरू में, के मूल्य यादृच्छिक रूप से सौंपा जाता है, और इसकी विशेषताओं और वेक्टर विशेषताओं को इसके पड़ोसियों के साथ तुलना की जाती है। वे पड़ोसी जो डेटा बिंदु के साथ सबसे अधिक मेल खाते हैं जिन्हें यादृच्छिक रूप से सौंपा गया है, उन्हें इसके क्लस्टर में सौंपा जाता है जब तक कि डेटा ने जितने समूहों की अनुमति देता है उन्हें पूरा नहीं कर लेता। समूहों के बीच भिन्न मूल्यों के लिए वर्गीकृत त्रुटि के लिए प्लॉट, या ‘लागत’ डेटा का खुलासा करेगा एक कोहनी बिंदु के लिए:

एक क्लस्टर ग्राफ में कोहनी बिंदु। स्रोत: https://www.scikit-yb.org/en/latest/api/cluster/elbow.html

कोहनी बिंदु एक प्रशिक्षण सत्र के अंत में हानि के समतल होने के तरीके के समान है, जब डेटा सेट के लिए एक मॉडल का प्रशिक्षण दिया जाता है। यह बिंदु का प्रतिनिधित्व करता है जहां समूहों के बीच कोई और भेदभाव स्पष्ट नहीं होगा, जिससे डेटा पाइपलाइन में अगले चरणों पर आगे बढ़ने या निष्कर्षों की रिपोर्ट करने का संकेत मिलता है। लोकप्रिय उपयोग के-मीन्स क्लस्टरिंग, स्पष्ट कारणों से, ग्राहक विश्लेषण में एक प्राथमिक प्रौद्योगिकी है, क्योंकि यह व्यावसायिक रिकॉर्ड को जनसांख्यिकीय अंतर्दृष्टि और ‘लीड’ में अनुवाद करने के लिए एक स्पष्ट और व्याख्या योग्य विधि प्रदान करता है। इसके अलावा, के-मीन्स क्लस्टरिंग भूस्खलन पूर्वानुमान, चिकित्सा छवि सेगमेंटेशन, जीएन के साथ छवि सिंथेसिस, दस्तावेज़ वर्गीकरण, और शहरी योजना के लिए भी नियोजित किया जाता है, साथ ही कई अन्य संभावित और वास्तविक उपयोगों के लिए।

5: रैंडम फॉरेस्ट

रैंडम फॉरेस्ट एक ensembl लर्निंग विधि है जो एक निर्णय पेड़ के सरणी से परिणाम को औसत करती है ताकि परिणाम के लिए एक समग्र पूर्वानुमान स्थापित किया जा सके।

स्रोत: https://www.tutorialandexample.com/wp-content/uploads/2019/10/Decision-Trees-Root-Node.png

यदि आपने इसे शोधा है, तो भी बैक टू द फ्यूचर त्रिलॉजी देखी है, तो एक निर्णय पेड़ स्वयं को संकल्पना करना काफी आसान है: कई मार्ग आपके सामने हैं, और प्रत्येक मार्ग एक नए परिणाम में शाखा करता है जिसमें आगे की संभावित मार्ग होते हैं। रिनफ़ोर्समेंट लर्निंग में, आप एक मार्ग से पीछे हट सकते हैं और एक पूर्व स्थिति से फिर से शुरू कर सकते हैं, जबकि निर्णय पेड़ अपनी यात्राओं के लिए प्रतिबद्ध हैं। इसलिए, रैंडम फॉरेस्ट एल्गोरिदम मूल रूप से निर्णयों के लिए स्प्रेड-बेटिंग है। एल्गोरिदम ‘यादृच्छिक’ कहा जाता है क्योंकि यह अध:चिकित्सा चयन और अवलोकन करता है ताकि निर्णय पेड़ की सरणी से परिणामों का मध्य योग प्राप्त किया जा सके। चूंकि यह कई कारकों को ध्यान में रखता है, रैंडम फॉरेस्ट दृष्टिकोण एक निर्णय पेड़ की तुलना में अधिक कठिन हो सकता है जो एक अर्थपूर्ण ग्राफ में परिवर्तित हो, लेकिन संभावित रूप से अधिक उत्पादक होने की संभावना है। निर्णय पेड़ ओवरफिटिंग के लिए अतिसंवेदनशील होते हैं, जहां प्राप्त परिणाम डेटा के लिए विशिष्ट होते हैं और सामान्य नहीं होने की संभावना है। रैंडम फॉरेस्ट का यादृच्छिक डेटा बिंदुओं का चयन इस प्रवृत्ति से लड़ता है।

निर्णय पेड़ रिग्रेशन। स्रोत: https://scikit-learn.org/stable/auto_examples/tree/plot_tree_regression.html

जैसा कि इस सूची में कई एल्गोरिदम के साथ है, रैंडम फॉरेस्ट आमतौर पर डेटा के ‘प्रारंभिक’ सॉर्टर और फिल्टर के रूप में कार्य करता है, और इसलिए नियमित रूप से नए शोध पत्रों में दिखाई देता है। रैंडम फॉरेस्ट के उपयोग के कुछ उदाहरणों में मैग्नेटिक रेजोनेंस इमेज सिंथेसिस, बिटकॉइन मूल्य पूर्वानुमान, जनगणना सेगमेंटेशन, पाठ वर्गीकरण और क्रेडिट कार्ड धोखाधड़ी का पता लगाना शामिल हैं। चूंकि रैंडम फॉरेस्ट एक कम-स्तरीय एल्गोरिदम है मशीन लर्निंग आर्किटेक्चर में, यह अन्य कम-स्तरीय विधियों के साथ-साथ दृश्यकरण एल्गोरिदम के प्रदर्शन में भी योगदान कर सकता है, जिनमें इंडक्टिव क्लस्टरिंग, फीचर ट्रांसफॉर्मेशन, स्पार्स फीचर का उपयोग करके पाठ दस्तावेज़ वर्गीकरण, और पाइपलाइन प्रदर्शन शामिल हैं।

6: नेव बायेस

घनत्व अनुमान (ऊपर 4 देखें) के साथ जोड़कर, एक नेव बायेस वर्गीकरणकर्ता एक शक्तिशाली लेकिन अपेक्षाकृत हल्का एल्गोरिदम है जो डेटा की गणना की गई विशेषताओं के आधार पर संभावनाओं का अनुमान लगाने में सक्षम है।

नेव बायेस वर्गीकरणकर्ता में विशेषता संबंध। स्रोत: https://www.sciencedirect.com/topics/computer-science/naive-bayes-model

‘नेव’ शब्द बायेस के सिद्धांत में संकल्पना को संदर्भित करता है कि विशेषताएं असंबंधित हैं, जिसे सशर्त स्वतंत्रता कहा जाता है। यदि आप इस दृष्टिकोण को अपनाते हैं, तो एक बतख की तरह चलना और बोलना यह स्थापित करने के लिए पर्याप्त नहीं है कि हम एक बतख के साथ व्यवहार कर रहे हैं, और कोई ‘स्पष्ट’ धारणाएं पहले से नहीं ली जाती हैं। यह स्तर की अकादमिक और जांचात्मक कठोरता वहां उपयोगी होगी जहां ‘सामान्य ज्ञान’ उपलब्ध है, लेकिन यह एक मूल्यवान मानक है जब मशीन लर्निंग डेटासेट में मौजूद कई अस्पष्टताओं और संभावित रूप से असंबंधित संबंधों को नेविगेट करता है। एक मूल बायेसियन नेटवर्क में, विशेषताएं स्कोरिंग फंक्शन के अधीन हैं, जिनमें न्यूनतम विवरण लंबाई और बायेसियन स्कोरिंग शामिल हैं, जो डेटा बिंदुओं के बीच अनुमानित संबंधों और इन संबंधों की दिशा में प्रतिबंध लगा सकते हैं जिसमें वे प्रवाहित होते हैं। एक नेव बायेस वर्गीकरणकर्ता, इसके विपरीत, काम करता है यह मानते हुए कि एक दिए गए वस्तु की विशेषताएं स्वतंत्र हैं, और फिर बायेस के सिद्धांत का उपयोग करके अपनी विशेषताओं के आधार पर एक दिए गए वस्तु की संभावना की गणना करता है। लोकप्रिय उपयोग नेव बायेस फिल्टर रोग पूर्वानुमान और दस्तावेज़ वर्गीकरण, स्पैम फिल्टरिंग, भावना वर्गीकरण, सिफारिश प्रणाली, और धोखाधड़ी का पता लगाना में अच्छी तरह से प्रतिनिधित्व किया जाता है, साथ ही अन्य अनुप्रयोगों में।

7: के-निकटतम पड़ोसी (केएनएन)

पहली बार 1951 में प्रस्तावित, और 20 वीं शताब्दी के मध्य के कंप्यूटिंग हार्डवेयर की स्थिति के अनुकूल होने के लिए, के-निकटतम पड़ोसी (केएनएन) एक पतला एल्गोरिदम है जो अभी भी शोध पत्रों और निजी क्षेत्र के मशीन लर्निंग शोध पहलों में प्रमुखता से प्रकट होता है। केएनएन को ‘लेज़ी लर्नर’ कहा जाता है, क्योंकि यह एक पूर्ण मशीन लर्निंग मॉडल को प्रशिक्षित करने की आवश्यकता के बिना एक डेटासेट को समग्र रूप से स्कैन करता है ताकि डेटा बिंदुओं के बीच संबंधों का मूल्यांकन किया जा सके।

एक केएनएन समूह। स्रोत: https://scikit-learn.org/stable/modules/neighbors.html

हालांकि केएनएन वास्तुकला रूप से पतला है, इसका व्यवस्थित दृष्टिकोण पढ़ने/लिखने के संचालन पर एक उल्लेखनीय मांग रखता है, और इसका उपयोग बहुत बड़े डेटासेट में प्रिंसिपल कंपोनेंट विश्लेषण (पीसीए) जैसी सहायक प्रौद्योगिकियों के बिना समस्याग्रस्त हो सकता है, जो जटिल और उच्च-वॉल्यूम डेटासेट को केएनएन द्वारा कम प्रयास से पार किए जा सकने वाले प्रतिनिधि समूहों में परिवर्तित कर सकता है। एक हाल के अध्ययन ने एक कर्मचारी के एक कंपनी छोड़ने की संभावना का अनुमान लगाने के लिए कई एल्गोरिदम की प्रभावशीलता और अर्थव्यवस्था का मूल्यांकन किया, यह पाया कि 70 वर्ष पुराना केएनएन आधुनिक प्रतिद्वंद्वियों की तुलना में सटीकता और पूर्वानुमान प्रभावशीलता के मामले में श्रेष्ठ था। लोकप्रिय उपयोग अपनी सरल अवधारणा और कार्यान्वयन के बावजूद, केएनएन विभिन्न अनुप्रयोगों में शामिल है, जिनमें ऑनलाइन हस्ताक्षर सत्यापन, छवि वर्गीकरण, पाठ खनन, फसल पूर्वानुमान, और चेहरा पहचान शामिल हैं।

प्रशिक्षण में एक केएनएन-आधारित चेहरा पहचान प्रणाली। स्रोत: https://pdfs.semanticscholar.org/6f3d/d4c5ffeb3ce74bf57342861686944490f513.pdf

8: मार्कोव निर्णय प्रक्रिया (एमडीपी)

1957 में अमेरिकी गणितज्ञ रिचर्ड बेलमैन द्वारा प्रस्तावित एक गणितीय ढांचा, मार्कोव निर्णय प्रक्रिया (एमडीपी) प्रबल प्रशिक्षण आर्किटेक्चर के सबसे बुनियादी ब्लॉक्स में से एक है। एक संकल्पनात्मक एल्गोरिदम अपने आप में, यह कई अन्य एल्गोरिदम में अनुकूलित किया गया है, और वर्तमान एआई/एमएल शोध में बार-बार दिखाई देता है। एमडीपी डेटा का अन्वेषण करने के लिए अपने वर्तमान राज्य (अर्थात डेटा में ‘कहां’ यह है) के मूल्यांकन का उपयोग करता है ताकि यह तय किया जा सके कि डेटा के किस नोड का अन्वेषण करना है।

स्रोत: https://www.sciencedirect.com/science/article/abs/pii/S0888613X18304420

एक बुनियादी मार्कोव निर्णय प्रक्रिया निकटवर्ती लाभ को दूरस्थ, अधिक वांछनीय दीर्घकालिक उद्देश्यों पर प्राथमिकता देगी। इस कारण से, यह आमतौर पर प्रबल प्रशिक्षण में एक अधिक व्यापक नीति आर्किटेक्चर के संदर्भ में एम्बेड किया जाता है, और अक्सर छूटे हुए पुरस्कार और अन्य संशोधित पर्यावरणीय चर जैसे सीमित कारकों के अधीन होता है जो इसे त्वरित लाभ की ओर दौड़ने से रोकेंगे बिना व्यापक वांछित परिणाम की परवाह किए। लोकप्रिय उपयोग एमडीपी की निम्न-स्तरीय संकल्पना मशीन लर्निंग में व्यापक रूप से फैली हुई है, साथ ही सक्रिय तैनाती में। यह आइओटी सुरक्षा रक्षा प्रणाली, मछली पकड़ने, और बाजार पूर्वानुमान के लिए प्रस्तावित किया गया है। इसके स्पष्ट अनुप्रयोग के अलावा सख्त क्रमिक खेलों जैसे शतरंज में, एमडीपी रोबोटिक्स प्रणालियों के प्रक्रियात्मक प्रशिक्षण के लिए एक प्राकृतिक दावेदार है, जैसा कि नीचे दिए गए वीडियो में देखा जा सकता है। https://www.youtube.com/watch?v=9JhIsKmoRUc

9: शब्द आवृत्ति-व्युत्क्रम दस्तावेज़ आवृत्ति

शब्द आवृत्ति (टीएफ) एक दस्तावेज़ में एक शब्द की आवृत्ति को उस दस्तावेज़ में शब्दों की कुल संख्या से विभाजित करता है। इसलिए, एक 1000-शब्द लेख में एक बार दिखाई देने वाला शब्द सील की शब्द आवृत्ति 0.001 है। अपने आप में, टीएफ शब्द महत्व के संकेतक के रूप में अधिकांश भाग के लिए कमजोर है, क्योंकि अर्थहीन लेख (जैसे एक, और, द, और यह) प्रभुत्व में हैं। व्युत्क्रम दस्तावेज़ आवृत्ति (आईडीएफ) एक शब्द की टीएफ को डेटासेट में कई दस्तावेजों में गणना करता है, बहुत उच्च-आवृत्ति स्टॉपवर्ड को कम रेटिंग देता है, जैसे कि लेख। परिणामी विशेषता वेक्टर सामान्य मूल्यों में सामान्यीकृत होते हैं, प्रत्येक शब्द को एक उपयुक्त भार सौंपा जाता है।

टीएफ-आईडीएफ कई दस्तावेजों में शब्दों की आवृत्ति के आधार पर शब्दों की प्रासंगिकता को भारित करता है, जिसमें दुर्लभ घटना एक संकेतक है। स्रोत: https://moz.com/blog/inverse-document-frequency-and-the-importance-of-uniqueness

हालांकि यह दृष्टिकोण सेमेंटिक रूप से महत्वपूर्ण शब्दों को आउटलियर के रूप में खो जाने से रोकता है, व्युत्क्रम आवृत्ति भार को इनवर्ट करना स्वचालित रूप से यह नहीं मान लेता है कि एक निम्न-आवृत्ति शब्द नहीं एक आउटलियर है। क्योंकि कुछ चीजें दुर्लभ और नगण्य हैं। इसलिए, एक निम्न-आवृत्ति शब्द को व्यापक आर्किटेक्चर संदर्भ में अपना मूल्य साबित करने की आवश्यकता होगी, यहां तक कि प्रति दस्तावेज़ कम आवृत्ति पर भी, डेटासेट में कई दस्तावेजों में सुविधा प्रदान करते हुए। इसकी आयु के बावजूद, टीएफ-आईडीएफ प्राकृतिक भाषा प्रसंस्करण फ्रेमवर्क में प्रारंभिक फिल्टर पास के लिए एक शक्तिशाली और लोकप्रिय विधि है। लोकप्रिय उपयोग टीएफ-आईडीएफ को गूगल के मुख्य रूप से गुप्त पेजरैंक एल्गोरिदम में पिछले बीस वर्षों में कम से कम कुछ हिस्से में शामिल किया गया है, यह बहुत व्यापक रूप से अपनाया गया है एक मैनिपुलेटिव एसईओ रणनीति के रूप में, जॉन म्यूलर के 2019 अस्वीकृति के बावजूद इसके महत्व के लिए खोज परिणाम। पेजरैंक के चारों ओर गोपनीयता के कारण, कोई स्पष्ट प्रमाण नहीं है कि टीएफ-आईडीएफ नहीं वर्तमान में खोज परिणामों में वृद्धि के लिए एक प्रभावी रणनीति है। आईटी पेशेवरों के बीच हाल की चर्चा संकेत देती है कि एक लोकप्रिय समझ है, सही या नहीं, कि शब्द दुरुपयोग अभी भी बेहतर एसईओ प्लेसमेंट (हालांकि अतिरिक्त एकाधिकार दुरुपयोग और अत्यधिक विज्ञापन इस सिद्धांत की सीमाओं को धुंधला करते हैं) का परिणाम हो सकता है।

10: स्टोकास्टिक ग्रेडिएंट डिसेंट

स्टोकास्टिक ग्रेडिएंट डिसेंट (एसजीडी) मशीन लर्निंग मॉडल के प्रशिक्षण के अनुकूलन के लिए एक बढ़ती लोकप्रियता वाली विधि है। ग्रेडिएंट डिसेंट स्वयं प्रशिक्षण के दौरान एक मॉडल द्वारा की जा रही सुधार को अनुकूलित और परिमाप करने का एक तरीका है। इस अर्थ में, ‘ग्रेडिएंट’ एक ढलान को इंगित करता है (रंग-आधारित ग्रेडेशन के बजाय, नीचे दी गई छवि देखें), जहां ‘पहाड़ी’ का उच्चतम बिंदु, बाएं, प्रशिक्षण प्रक्रिया की शुरुआत का प्रतिनिधित्व करता है। इस स्तर पर, मॉडल ने डेटा को एक बार भी नहीं देखा है, और डेटा संबंधों को प्रभावी रूप से मैप करने के लिए पर्याप्त नहीं सीखा है।

एक फेसस्वैप प्रशिक्षण सत्र पर ग्रेडिएंट डिसेंट। हम देख सकते हैं कि प्रशिक्षण ने दूसरे भाग में कुछ समय के लिए पठारित किया है, लेकिन अंततः एक स्वीकार्य अभिसरण की ओर ग्रेडिएंट के नीचे अपना रास्ता पुनः प्राप्त किया है।

निम्नतम बिंदु, दाएं, अभिसरण (बिंदु जिस पर मॉडल निर्धारित प्रतिबंधों और सेटिंग्स के तहत जितना प्रभावी हो सकता है) का प्रतिनिधित्व करता है। ग्रेडिएंट प्रशिक्षण के दौरान त्रुटि दर (मॉडल ने वर्तमान में डेटा संबंधों को कितनी सटीकता से मैप किया है) और वजन (सेटिंग्स जो प्रभावित करती हैं कि मॉडल कैसे सीखेगा) के बीच विचलन के लिए एक रिकॉर्ड और पूर्वानुमान के रूप में कार्य करता है। यह प्रगति रिकॉर्ड लर्निंग रेट शेड्यूल को सूचित करने के लिए उपयोग किया जा सकता है, एक स्वचालित प्रक्रिया जो वास्तुकला को बताती है कि प्रशिक्षण के शुरुआती अस्पष्ट विवरणों को स्पष्ट संबंधों और मैपिंग में परिवर्तित होने के रूप में अधिक विस्तृत और सटीक होने के लिए। प्रभाव में, ग्रेडिएंट हानि प्रशिक्षण के अगले चरण के लिए एक न्यूनतम समय मानचित्र प्रदान करता है, और यह कैसे आगे बढ़ना है। एसजीडी का नवाचार यह है कि यह प्रत्येक प्रशिक्षण उदाहरण प्रति पुनरावृत्ति पर मॉडल के पैरामीटर को अपडेट करता है, जो आमतौर पर अभिसरण तक की यात्रा को तेज करता है। हाल के वर्षों में हाइपरस्केल डेटासेट के आगमन के कारण, एसजीडी ने हाल ही में डेटा के लॉजिस्टिक मुद्दों को संबोधित करने के एक संभावित तरीके के रूप में लोकप्रियता हासिल की है। दूसरी ओर, एसजीडी के नकारात्मक निहितार्थ हैं विशेषता स्केलिंग के लिए, और इसे एक ही परिणाम प्राप्त करने के लिए अधिक पुनरावृत्तियों की आवश्यकता हो सकती है, जिसमें नियमित ग्रेडिएंट डिसेंट की तुलना में अतिरिक्त योजना और अतिरिक्त पैरामीटर शामिल हैं। लोकप्रिय उपयोग अपनी कॉन्फ़िगरेबिलिटी के बावजूद, और इसकी कमियों के बावजूद, एसजीडी न्यूरल नेटवर्क को फिट करने के लिए सबसे लोकप्रिय अनुकूलन एल्गोरिदम बन गया है। एसजीडी की एक कॉन्फ़िगरेशन जो नए एआई/एमएल शोध पत्रों में प्रमुख हो रही है वह एडेप्टिव मोमेंट एस्टीमेशन (एडम, 2015 में प्रस्तावित) ऑप्टिमाइज़र का चयन है। एडम प्रत्येक पैरामीटर के लिए गतिशील रूप से (‘अनुकूलन लर्निंग रेट’) सीखने की दर को अनुकूलित करता है, साथ ही बाद के कॉन्फ़िगरेशन में पिछले अपडेट से परिणामों को शामिल करता है (‘मोमेंटम’)। इसके अतिरिक्त, यह बाद की नवाचारों का उपयोग करने के लिए कॉन्फ़िगर किया जा सकता है, जैसे कि नेस्टरोव मोमेंटम। हालांकि, कुछ का तर्क है कि मोमेंटम का उपयोग एडम (और समान एल्गोरिदम) को एक उप-ऑप्टिमल निष्कर्ष तक तेजी से ले जा सकता है। जैसा कि मशीन लर्निंग शोध क्षेत्र के रक्तप्रवाह के साथ होता है, एसजीडी एक कार्य प्रगति पर है। पहली बार 10 फरवरी 2022 को प्रकाशित। 10 फरवरी 20.05 ईईटी – प्रारूपण में संशोधित।