कृत्रिम बुद्धिमत्ता

डिसेंटैंग्लमेंट है अगली डीपफेक रिवोल्यूशन

सीजीआई डेटा ऑगमेंटेशन का उपयोग एक नए प्रोजेक्ट में डीपफेक इमेजरी पर अधिक नियंत्रण प्राप्त करने के लिए किया जा रहा है। हालांकि आप अभी भी प्रभावी ढंग से सीजीआई हेड्स का उपयोग डीपफेक फेसियल डेटासेट में缺失 गैप को भरने के लिए नहीं कर सकते हैं, एक नए शोध की लहर पहचान को संदर्भ से अलग करने का अर्थ है कि जल्द ही, आपको ऐसा करने की आवश्यकता नहीं हो सकती है।

डीपफेक वीडियो के निर्माता जो पिछले कुछ वर्षों में सबसे सफल वायरल डीपफेक वीडियो बनाने में सफल रहे हैं, वे अपने स्रोत वीडियो का बहुत सावधानी से चयन करते हैं, सस्टेन्ड प्रोफाइल शॉट्स (यानी, पुलिस गिरफ्तारी प्रक्रियाओं द्वारा लोकप्रिय बनाए गए प्रकार के साइड-ऑन मुगशॉट्स) , तीव्र कोण और असामान्य या अतिरंजित अभिव्यक्तियों से बचते हैं। बढ़ती हुई, वायरल डीपफेकर्स द्वारा उत्पादित प्रदर्शन वीडियो संपादित संकलन हैं जो ‘सबसे आसान’ कोण और अभिव्यक्तियों का चयन करते हैं जिन्हें डीपफेक किया जा सकता है।

वास्तव में, जिस लक्ष्य वीडियो में एक डीपफेक सेलिब्रिटी को डाला जा सकता है, वह वह है जहां मूल व्यक्ति (जिसकी पहचान डीपफेक द्वारा मिटा दी जाएगी) सीधे कैमरे की ओर देख रहा है, न्यूनतम अभिव्यक्तियों के साथ।

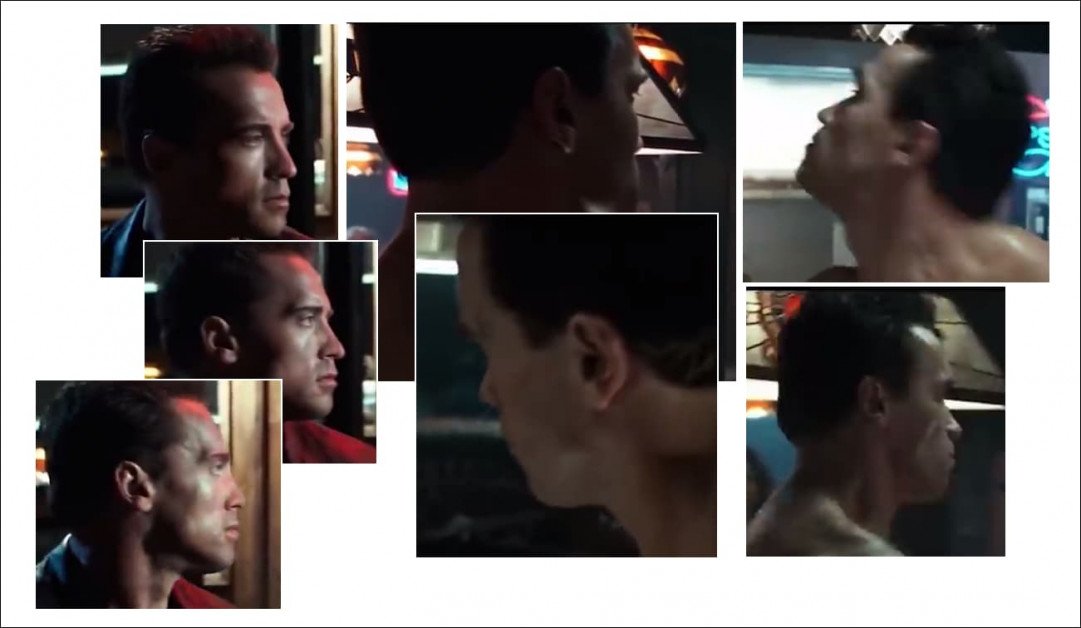

<img class="wp-image-178727 size-full" src="https://www.unite.ai/wp-content/uploads/2021/11/easier-deepfakes.jpg" alt="पिछले वर्षों के अधिकांश लोकप्रिय डीपफेक्स ने विषयों को सीधे कैमरे की ओर देखते हुए दिखाया है, और या तो लोकप्रिय अभिव्यक्तियों (जैसे कि मुस्कराते हुए) को ही धारण किया है, जिन्हें लाल कालीन पपराज़ी आउटपुट से आसानी से निकाला जा सकता है, या (जैसे कि 2019 में सिल्वेस्टर स्टैलोन के टर्मिनेटर के रूप में), वास्तव में कोई अभिव्यक्ति नहीं है, क्योंकि तटस्थ अभिव्यक्तियां बहुत सामान्य हैं, जो उन्हें डीपफेक मॉडल में शामिल करना आसान बनाती हैं।

क्योंकि डीपफेक तकनीकें जैसे कि DeepFaceLab और FaceSwap इन सरल स्वैप्स को बहुत अच्छी तरह से करती हैं, हम उनके द्वारा की जाने वाली चीजों से इतने अधिक प्रभावित होते हैं कि हमें यह नहीं दिखाई देता कि वे क्या करने में असमर्थ हैं, और – अक्सर – नहीं भी कोशिश करते हैं:

एक प्रसिद्ध डीपफेक वीडियो से ग्रैब्स जहां अर्नोल्ड श्वार्ज़नेगर को सिल्वेस्टर स्टैलोन में बदल दिया जाता है – जब तक कि कोण बहुत मुश्किल न हों। प्रोफाइल वर्तमान डीपफेक दृष्टिकोणों के साथ एक दीर्घकालिक समस्या बनी हुई है, आंशिक रूप से इसलिए क्योंकि डीपफेक फ्रेमवर्क में चेहरे की मुद्रा को परिभाषित करने के लिए उपयोग किया जाने वाला ओपन-सोर्स सॉफ्टवेयर साइड-व्यू के लिए अनुकूलित नहीं है, लेकिन मुख्य रूप से इसलिए क्योंकि आवश्यक डेटासेट में से एक या दोनों में उपयुक्त स्रोत सामग्री की कमी है।

इज़राइल से नई शोध एक नए तरीके का प्रस्ताव करती है जिसमें सिंथेटिक डेटा का उपयोग करके डीपफेकिंग को वास्तव में अलग करने के लिए किया जाता है, जैसे कि सीजीआई हेड्स, चेहरे की पहचान (यानी, ‘टॉम क्रूज़’ की मूल चेहरे की विशेषताएं) को उनके संदर्भ (यानी, ऊपर देखते हुए, पक्ष में देखते हुए, मुस्कराते हुए, मुस्कराते हुए अंधेरे में, भौंहें सिकोड़ते हुए, आँखें बंद, आदि) से अलग करने के लिए।

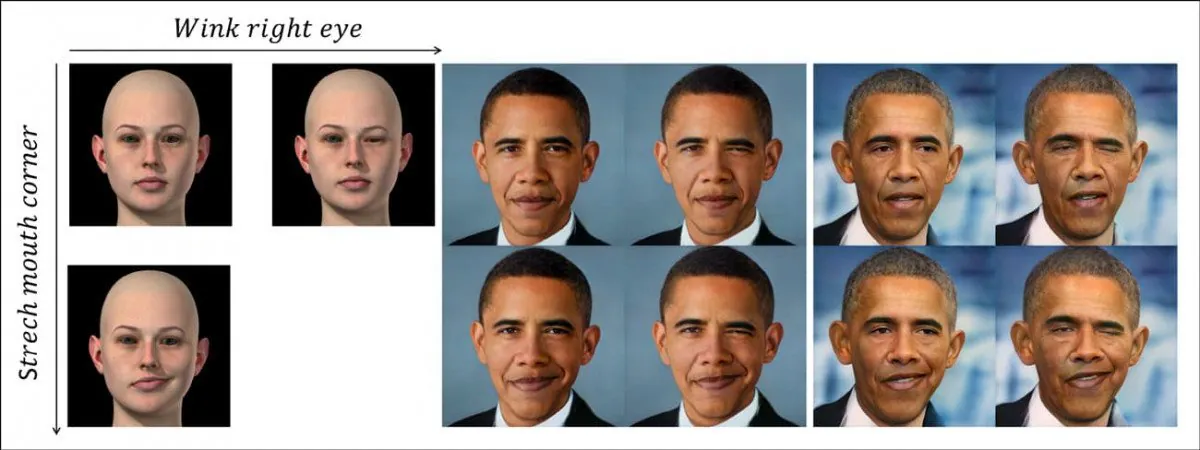

नया सिस्टम व्यक्ति की पहचान के एन्कोडिंग से मुद्रा और संदर्भ (यानी, एक आँख को झपकाना) को विच्छिन्न रूप से अलग करता है, असंबंधित सिंथेटिक चेहरे के डेटा (बाएं चित्र) का उपयोग करता है। ऊपरी पंक्ति में, हम देखते हैं कि एक ‘झपक’ को बराक ओबामा की पहचान में स्थानांतरित किया जाता है, जीएनए के लेटेंट स्पेस के गैर-रेखीय पथ द्वारा सीखा जाता है, जो बाएं चित्र में सीजीआई छवि द्वारा प्रस्तुत किया जाता है। नीचे की पंक्ति में, हम देखते हैं कि मुंह के कोने के फेसेट को फैलाया जाता है और पूर्व राष्ट्रपति पर लागू किया जाता है। नीचे दाईं ओर, हम दोनों विशेषताओं को एक साथ लागू करते हैं। स्रोत: https://arxiv.org/pdf/2111.08419.pdf

यह केवल डीपफेक हेड-पपेट्री नहीं है, एक तकनीक जो अवतार और आंशिक-चेहरे लिप-सिंक्रोनाइजेशन के लिए अधिक उपयुक्त है, और जिसकी पूर्ण विकसित डीपफेक वीडियो परिवर्तनों के लिए सीमित क्षमता है।

इसके बजाय, यह एक साधन की मूलभूत अलगाव का प्रतिनिधित्व करता है (जैसे कि ‘सिर के कोण को बदलें’, ‘एक मुस्कराहट बनाएं’) पहचान से, एक उच्च-स्तरीय छवि संश्लेषण-आधारित डीपफेक फ्रेमवर्क के लिए एक मार्ग प्रदान करता है।

नया पेपर डेल्टा-जीएन-एनकोडर: एक्सप्लिसिट इमेज एडिटिंग के लिए सेमेंटिक परिवर्तनों को एन्कोड करना, कुछ सिंथेटिक नमूनों का उपयोग करके शीर्षक से है, और यह तकनीकी-इज़राइल प्रौद्योगिकी संस्थान में शोधकर्ताओं से आता है।

इस शोध का क्या अर्थ है, यह समझने के लिए, आइए देखें कि डीपफेक्स कैसे वर्तमान में उत्पादित किए जाते हैं, चाहे वह डीपफेक पोर्न साइटों पर हो या इंडस्ट्रियल लाइट एंड मैजिक (चूंकि डीपफेसलैब ओपन सोर्स रिपॉजिटरी वर्तमान में ‘अमेच्योर’ और पेशेवर दोनों डीपफेकिंग में प्रमुख है)।

वर्तमान डीपफेक प्रौद्योगिकी को क्या रोक रहा है?

वर्तमान में डीपफेक्स का निर्माण दो फोल्डरों में चेहरे की छवियों पर एक एन्कोडर/डिकोडर मशीन लर्निंग मॉडल को प्रशिक्षित करके किया जाता है – जिस व्यक्ति को आप ‘पेंट ओवर’ करना चाहते हैं (पिछले उदाहरण में, यह अर्नी है) और जिस व्यक्ति को आप फुटेज में सुपरिम्पोज़ करना चाहते हैं (स्ली है)।

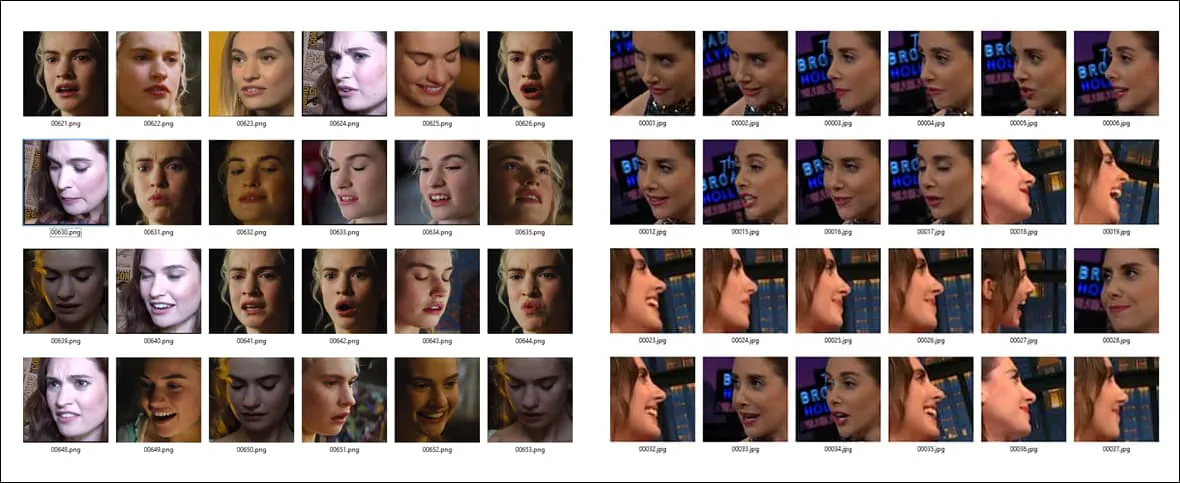

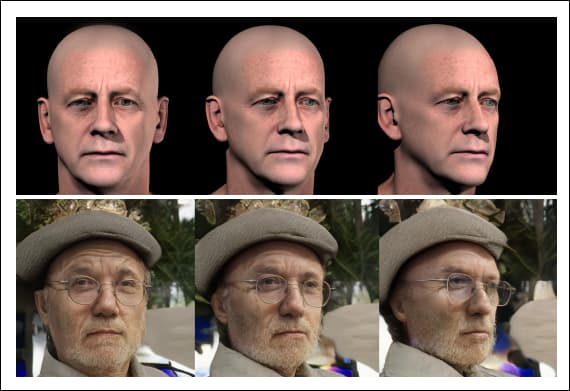

दो अलग-अलग चेहरे के सेटों में मुद्रा और प्रकाश व्यवस्था की स्थिति में भिन्नता। नोट कि तीसरी पंक्ति के अंत में कॉलम ए में विशिष्ट अभिव्यक्ति, जो दूसरे डेटासेट में एक करीबी समकक्ष होने की संभावना नहीं है।

फिर एन्कोडर/डिकोडर सिस्टम प्रत्येक फोल्डर में प्रत्येक छवि की तुलना दूसरे के साथ करता है, इस ऑपरेशन को सैकड़ों हजारों पुनरावृत्तियों (अक्सर एक सप्ताह तक) के लिए बनाए रखता है, जब तक कि यह दोनों पहचानों की मूल विशेषताओं को पर्याप्त रूप से समझने में सक्षम न हो जाए कि वे इच्छानुसार उन्हें स्वैप कर सकें।

प्रत्येक व्यक्ति के लिए जो प्रक्रिया में शामिल है, जिस पहचान के बारे में डीपफेक आर्किटेक्चर सीखता है वह संदर्भ के साथ जुड़ा हुआ है। यह किसी भी पहचान के लिए एक सामान्य मुद्रा ‘के लिए सीखने और लागू करने में सक्षम नहीं है, लेकिन इसके लिए प्रशिक्षण डेटासेट में प्रत्येक पहचान के लिए उस विशिष्ट मुद्रा के कई उदाहरणों की आवश्यकता होती है।

इसलिए, यदि आप दो पहचानों को स्वैप करना चाहते हैं जो कुछ और असामान्य कर रहे हैं, तो आपको बहुत सारे उदाहरणों की आवश्यकता होगी कि वह विशिष्ट मुद्रा दोनों चेहरे के सेटों में है:

चूंकि चेहरे की पहचान और मुद्रा की विशेषताएं वर्तमान में इतनी जुड़ी हुई हैं, डीपफेसलैब जैसे सिस्टम पर एक प्रभावी डीपफेक मॉडल को प्रशिक्षित करने के लिए दो चेहरे के डेटासेट में अभिव्यक्ति, सिर की मुद्रा और (कम से कम) प्रकाश व्यवस्था की एक व्यापक समानता की आवश्यकता होती है। यदि एक विशिष्ट कॉन्फ़िगरेशन (जैसे ‘प्रोफाइल/मुस्कराते हुए/सूरज की रोशनी में’) दोनों चेहरे के सेटों में इतना नहीं है, तो यह एक डीपफेक वीडियो में उतनी सटीकता से प्रस्तुत नहीं होगा, यदि इसकी आवश्यकता है।

यदि सेट ए में असामान्य मुद्रा है, लेकिन सेट बी में इसका अभाव है, तो आप बहुत बुरी स्थिति में हैं; चाहे आप मॉडल को कितना भी प्रशिक्षित कर लें, यह उस मुद्रा को दोनों पहचानों के बीच अच्छी तरह से पुनरुत्पादित नहीं कर पाएगा, क्योंकि यह प्रशिक्षण के दौरान आवश्यक जानकारी का केवल आधा हिस्सा था।

यहां तक कि अगर आपके पास मेल खाने वाली छवियां हैं, तो यह पर्याप्त नहीं हो सकता है: यदि सेट ए में मेल खाने वाली मुद्रा है, लेकिन तीव्र पक्ष प्रकाश व्यवस्था के साथ, इसकी तुलना दूसरे चेहरे के सेट में समतल प्रकाश व्यवस्था वाली समकक्ष मुद्रा से की जाती है, तो स्वैप की गुणवत्ता उतनी अच्छी नहीं होगी जितनी होगी यदि प्रत्येक में सामान्य प्रकाश विशेषताएं हों।

डेटा की कमी क्यों है

जब तक आप नियमित रूप से गिरफ्तार नहीं होते हैं, तो आपके पास शायद अपने बारे में बहुत सारे प्रोफाइल शॉट नहीं होंगे। जो कोई भी आया, आप शायद उसे फेंक देते हैं। चूंकि पिक्चर एजेंसियां भी ऐसा ही करती हैं, प्रोफाइल फेस शॉट मिलना मुश्किल हो जाता है।

डीपफेकर अक्सर एक पहचान के लिए जो सीमित प्रोफाइल डेटा है, उसे अपने फेस-सेट में कई बार शामिल करते हैं, बस इसलिए कि मुद्रा प्रशिक्षण के दौरान कम से कम थोड़ा ध्यान और समय प्राप्त करती है, इसके बजाय एक आउटलियर के रूप में छूट जाती है।

लेकिन एक पहचान के लिए संभावित प्रोफाइल चेहरे की तस्वीरों की तुलना में बहुत अधिक प्रकार हैं जो एक डेटासेट में शामिल किए जा सकते हैं – मुस्कराते हुए, मुंह बनाते हुए, चीखते हुए, रोते हुए, अंधेरे में, तिरस्कारपूर्ण, उदासीन, प्रसन्न, फ्लैश-लिट, ऊपर देखते हुए, नीचे देखते हुए, आँखें खुली, आँखें बंद… और इतने पर। इनमें से कोई भी मुद्रा या अभिव्यक्ति एक लक्ष्य डीपफेक वीडियो में आवश्यक हो सकती है।

और यह केवल प्रोफाइल है। आपके पास खुद को सीधे ऊपर देखते हुए कितनी तस्वीरें हैं? क्या आपके पास अपने आप को उसी मुद्रा में देखते हुए पर्याप्त तस्वीरें हैं जो 10,000 संभावित अभिव्यक्तियों को कवर करती हैं जो आप उसी मुद्रा में धारण कर सकते हैं, जो उसी कैमरा कोण से, कम से कम एक मिलियन संभावित प्रकाश वातावरण में से कुछ को कवर करते हैं?

यह संभावना है कि आपके पास खुद को ऊपर देखते हुए एक तस्वीर भी नहीं है। और यह केवल दो कोण हैं जिनमें से सैकड़ों की आवश्यकता होती है जो पूर्ण कवरेज के लिए आवश्यक होते हैं।

यहां तक कि अगर यह संभव हो कि एक चेहरे का पूर्ण कवरेज सभी कोणों से और विभिन्न प्रकाश स्थितियों के तहत प्राप्त किया जा सकता है, तो परिणामी डेटासेट प्रशिक्षण के लिए बहुत बड़ा होगा, सैकड़ों हजारों चित्रों के क्रम में; और यहां तक कि अगर यह प्रशिक्षित भी किया जा सकता है, तो प्रशिक्षण प्रक्रिया की प्रकृति वर्तमान डीपफेक फ्रेमवर्क के लिए अधिकांश अतिरिक्त डेटा को छोड़ देगी, क्योंकि वर्तमान फ्रेमवर्क कम हैं और बहुत स्केलेबल नहीं हैं।

सिंथेटिक प्रतिस्थापन

डीपफेक्स के उदय से, डीपफेकर्स ने उन ‘गुम’ मुद्राओं को प्राप्त करने के लिए सीजीआई-शैली की छवियों का उपयोग करने के लिए प्रयोग किया है, जैसे कि सिनेमा4डी और माया जैसे 3डी अनुप्रयोगों में बनाए गए सिर।

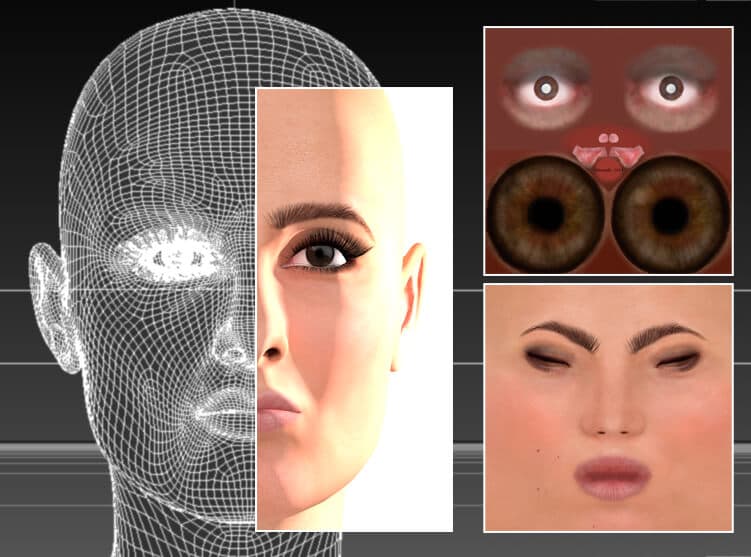

कोई एआई आवश्यक नहीं; एक अभिनेत्री को पारंपरिक सीजीआई प्रोग्राम, सिनेमा4डी में पुनर्निर्मित किया जाता है, जिसमें जाल और बिटमैपेड टेक्सचर का उपयोग किया जाता है – जो तकनीक 1960 के दशक से है, हालांकि 1990 के दशक से व्यापक उपयोग में आया। सिद्धांत रूप में, इस चेहरे के मॉडल का उपयोग असामान्य मुद्राओं, प्रकाश शैलियों और चेहरे की अभिव्यक्तियों के लिए डीपफेक स्रोत डेटा उत्पन्न करने के लिए किया जा सकता है। वास्तव में, यह डीपफेकिंग में उपयोगी साबित नहीं हुआ है, क्योंकि स्वैप वीडियो में सीजीआई रेंडर्स की ‘नकली’ दिखाई देने वाली उपस्थिति फैल जाती है। स्रोत: इस लेखक की छवि https://rossdawson.com/futurist/implications-of-ai/comprehensive-guide-ai-artificial-intelligence-visual-effects-vfx/ पर

यह विधि आमतौर पर नए डीपफेक प्रैक्टिशनर्स द्वारा जल्दी से छोड़ दी जाती है, क्योंकि हालांकि यह उन मुद्राओं और अभिव्यक्तियों को प्रदान कर सकती है जो अन्यथा उपलब्ध नहीं हैं, सीजीआई चेहरों की सिंथेटिक उपस्थिति आमतौर पर संदर्भ और सेमेंटिक/संदर्भ जानकारी के साथ पहचान के जुड़ाव के कारण स्वैप में फैल जाती है।

यह एक विश्वसनीय डीपफेक वीडियो में अचानक ‘असामान्य घाटी’ चेहरों के फ्लैश का कारण बन सकता है, क्योंकि एल्गोरिदम एक असामान्य मुद्रा या अभिव्यक्ति के लिए अपनी एकमात्र उपलब्ध डेटा पर आकर्षित होना शुरू कर देता है – स्पष्ट रूप से नकली चेहरे।

डीपफेकर्स के लिए सबसे लोकप्रिय विषयों में से एक, ऑस्ट्रेलियाई अभिनेत्री मार्गोट रॉबी के लिए एक 3डी डीपफेक एल्गोरिदम डीपफेसलाइव के डिफ़ॉल्ट संस्करण में शामिल है, जो एक लाइव-स्ट्रीम में डीपफेक्स कर सकता है, जैसे कि एक वेबकैम सत्र। एक सीजीआई संस्करण, जैसा कि ऊपर दिखाया गया है, डीपफेक डेटासेट में ‘गुम’ कोण प्राप्त करने के लिए उपयोग किया जा सकता है। स्रोत: https://sketchfab.com/3d-models/margot-robbie-bust-for-full-color-3d-printing-98d15fe0403b4e64902332be9cfb0ace

सीजीआई चेहरे के रूप में एक अलग, संकल्पनात्मक मार्गदर्शिका

इसके बजाय, इज़राइली शोधकर्ताओं की नई डेल्टा-जीएन-एनकोडर (डीजीई) विधि अधिक प्रभावी है, क्योंकि सीजीआई छवियों से मुद्रा और संदर्भ की जानकारी लक्ष्य से पूरी तरह से अलग हो गई है।

हम इस सिद्धांत को नीचे दी गई छवि में कार्रवाई में देख सकते हैं, जहां विभिन्न सिर अभिविन्यास सीजीआई छवियों का उपयोग करके प्राप्त किए गए हैं। चूंकि पहचान की विशेषताएं संदर्भ की विशेषताओं से संबंधित नहीं हैं, इसलिए न तो सीजीआई चेहरे की ‘नकली’ उपस्थिति और न ही उसमें चित्रित पहचान का रिसाव होता है:

नया तरीका आपको तीन अलग-अलग वास्तविक जीवन की तस्वीरों की आवश्यकता नहीं है ताकि विभिन्न कोणों से एक डीपफेक को पूरा किया जा सके – आप सिर्फ सीजीआई सिर को घुमा सकते हैं, जिसकी उच्च-स्तरीय अमूर्त विशेषताएं पहचान पर थोपी जाती हैं बिना किसी पहचान जानकारी के रिसाव के।

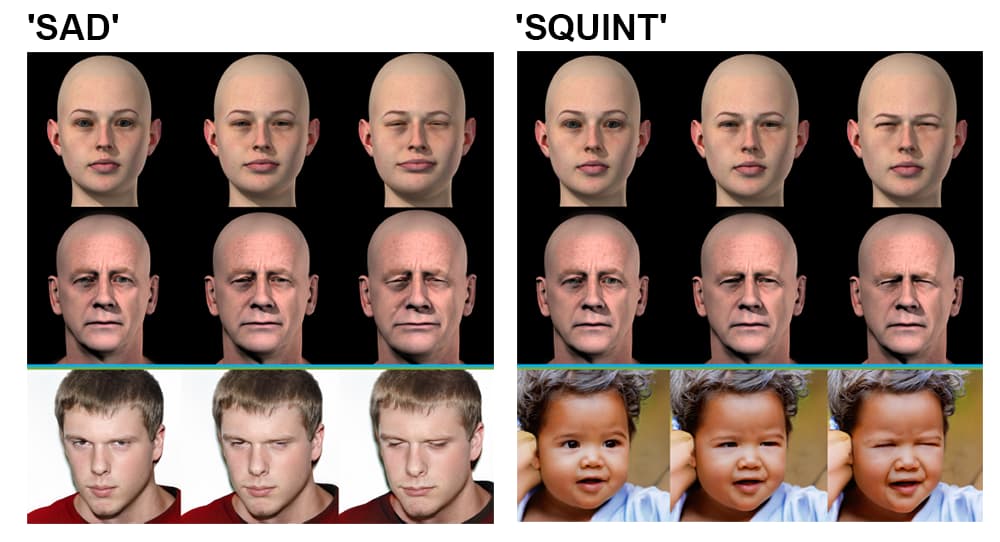

डेल्टा-जीएन-एनकोडर। ऊपरी बाएं समूह: स्रोत छवि के कोण को एक सेकंड में बदला जा सकता है ताकि एक नई स्रोत छवि प्रस्तुत की जा सके, जो आउटपुट में परिलक्षित होती है; दाएं ऊपरी समूह: प्रकाश व्यवस्था भी पहचान से अलग हो जाती है, जिससे प्रकाश शैलियों का सुपरइम्पोज़िशन संभव हो जाता है; नीचे बाएं समूह: कई चेहरे की विशेषताएं बदल दी जाती हैं ताकि एक ‘उदास’ अभिव्यक्ति बनाई जा सके; नीचे दाएं समूह: एक ही चेहरे की अभिव्यक्ति विशेषता बदल दी जाती है, ताकि आंखें झपक जाती हैं। स्रोत: https://arxiv.org/pdf/2111.08419.pdf

यह पहचान और संदर्भ का पृथक्करण प्रशिक्षण चरण में प्राप्त किया जाता है। नए डीपफेक आर्किटेक्चर के लिए पाइपलाइन एक पूर्व-प्रशिक्षित जेनरेटिव एडवर्सेरियल नेटवर्क (जीएन) में लेटेंट वेक्टर की तलाश करती है जो छवि को बदलने के लिए मेल खाती है – एक सिम2रियल तरीका जो 2018 में आईबीएम के एआई रिसर्च सेक्शन से एक प्रोजेक्ट पर आधारित है।

शोधकर्ता टिप्पणी करते हैं:

‘केवल कुछ नमूनों के साथ, जो एक विशिष्ट विशेषता से भिन्न होते हैं, किसी पूर्व-प्रशिक्षित जुड़े हुए जेनरेटिव मॉडल के विच्छिन्न व्यवहार को सीखा जा सकता है। इसके लिए वास्तविक दुनिया के नमूनों की आवश्यकता नहीं है, जो आवश्यक रूप से संभव नहीं है। ‘

‘गैर-वास्तविक डेटा नमूनों का उपयोग करके同 लक्ष्य प्राप्त किया जा सकता है, सीखे हुए एन्कोडेड लेटेंट वेक्टर्स के सेमेंटिक्स का लाभ उठाकर। मौजूदा डेटा नमूनों पर वांछित परिवर्तन लागू करना किसी भी लेटेंट स्पेस व्यवहार अन्वेषण के बिना किया जा सकता है।’

शोधकर्ता उम्मीद करते हैं कि परियोजना में अन्वेषित विच्छिन्नता के मूल सिद्धांतों को अन्य डोमेन में स्थानांतरित किया जा सकता है, जैसे कि आंतरिक वास्तुकला सिमुलेशन, और यह कि डेल्टा-जीएन-एनकोडर के लिए अपनाए गए सिम2रियल विधि अंततः केवल स्केच के आधार पर डीपफेक साधनों को सक्षम कर सकती है, न कि सीजीआई-शैली के इनपुट के आधार पर।

यह तर्क दिया जा सकता है कि नई इज़राइली प्रणाली डीपफेक वीडियो को संश्लेषित करने में कितनी सक्षम हो सकती है या नहीं हो सकती है, इसकी तुलना में बहुत कम महत्वपूर्ण है कि शोध ने पहचान को संदर्भ से अलग करने में कितनी प्रगति की है, जीएन के लेटेंट स्पेस पर अधिक नियंत्रण प्राप्त करते हुए।

विच्छिन्नता छवि संश्लेषण में एक सक्रिय अनुसंधान क्षेत्र है; जनवरी 2021 में, एक अमेज़न के नेतृत्व वाले शोध पेपर ने समान मुद्रा नियंत्रण और विच्छिन्नता का प्रदर्शन किया, और 2018 में, चीनी अकादमी ऑफ साइंसेज में शेन्ज़ेन इंस्टीट्यूट ऑफ एडवांस्ड टेक्नोलॉजी से एक पेपर ने जीएन में मनमाने दृष्टिकोण उत्पन्न करने में प्रगति की।