Andersons Blickwinkel

Die Zukunft der RAG-erweiterten Bildgenerierung

Generative Diffusionsmodelle wie Stable Diffusion, Flux und Video-Modelle wie Hunyuan basieren auf Wissen, das während einer einzigen, ressourcenintensiven Trainingsphase mit einem festen Datensatz erworben wurde. Alle Konzepte, die nach dieser Trainingsphase eingeführt werden – als Wissensabschnitt bezeichnet – fehlen im Modell, es sei denn, sie werden durch Feinabstimmung oder externe Anpassungstechniken wie Low Rank Adaptation (LoRA) ergänzt.

Es wäre daher ideal, wenn ein generatives System, das Bilder oder Videos ausgibt, auf Online-Quellen zugreifen und diese bei Bedarf in den Generierungsprozess einbeziehen könnte. Auf diese Weise könnte beispielsweise ein Diffusionsmodell, das nichts über die neuesten Apple- oder Tesla-Modelle weiß, dennoch Bilder mit diesen neuen Produkten erzeugen.

In Bezug auf Sprachmodelle sind uns die meisten von Systemen wie Perplexity, Notebook LM und ChatGPT-4o vertraut, die neuere externe Informationen in einem Retrieval-Augmented-Generation- (RAG-) Modell einbeziehen können.

RAG-Prozesse machen ChatGPT 4o’s Antworten relevanter. Quelle: https://chatgpt.com/

Allerdings ist dies eine ungewöhnliche Funktion, wenn es um die Generierung von Bildern geht, und ChatGPT wird seine eigenen Einschränkungen in dieser Hinsicht zugeben:

ChatGPT 4o hat eine gute Vermutung über die Visualisierung einer brandneuen Uhrenveröffentlichung gemacht, basierend auf der allgemeinen Linie und den Beschreibungen, die es interpretiert hat; aber es kann keine neuen Bilder in eine DALL-E-basierte Generierung aufnehmen.

Die Einbeziehung externer Daten in eine generierte Bild ist herausfordernd, da das eingehende Bild zunächst in Token und Embeddings zerlegt werden muss, die dann auf das nächste trainierte Domänenwissen des Modells abgebildet werden.

Während dieser Prozess bei post-trainings-Tools wie ControlNet effektiv funktioniert, bleiben solche Manipulationen größtenteils oberflächlich und leiten das abgerufene Bild lediglich durch eine Render-Pipeline, ohne es tief in die interne Repräsentation des Modells zu integrieren.

Infolgedessen fehlt dem Modell die Fähigkeit, neue Perspektiven zu generieren, wie es neuronale Render-Systeme wie NeRF können, die Szenen mit wahrem räumlichem und strukturellem Verständnis konstruieren.

Reifes Logik

Eine ähnliche Einschränkung gilt für RAG-basierte Abfragen in Large Language Models (LLMs) wie Perplexity. Wenn ein Modell dieser Art extern abgerufene Daten verarbeitet, funktioniert es ähnlich wie ein Erwachsener, der auf ein Leben voller Wissen zurückgreift, um Wahrscheinlichkeiten über ein Thema abzuleiten.

Allerdings kann ein Mensch nicht rückwirkend neue Informationen in das kognitive Framework integrieren, das seine grundlegende Weltanschauung geprägt hat – als seine Vorurteile und Vorannahmen noch gebildet wurden –, und ein LLM kann neue Kenntnisse nicht nahtlos in seine vorgebildete Struktur integrieren.

Stattdessen kann es nur “aufprallen” oder die neuen Daten gegen sein vorhandenes internalisiertes Wissen setzen, um gelernte Prinzipien zu analysieren und zu vermuten, anstatt auf fundamentaler Ebene zu synthetisieren.

Dieses Defizit an Äquivalenz zwischen gegenübergestellter und internalisierter Generation ist wahrscheinlich in einer generierten Bild mehr deutlich als in einer sprachbasierten Generation: Die tiefere Netzwerkverbindung und die erhöhte Kreativität der “nativen” (und nicht RAG-basierten) Generation wurde in verschiedenen Studien etabliert.

Versteckte Risiken der RAG-fähigen Bildgenerierung

Selbst wenn es technisch möglich wäre, abgerufene Internet-Bilder nahtlos in neu synthetisierte Bilder einzubeziehen, würden sicherheitsbezogene Einschränkungen eine zusätzliche Herausforderung darstellen.

Viele Datensätze, die für die Ausbildung generativer Modelle verwendet werden, wurden so kuratiert, dass sie explizite, rassistische oder gewalttätige Inhalte minimieren, unter anderem sensible Kategorien. Allerdings ist dieser Prozess unvollkommen, und residuale Assoziationen können bestehen bleiben. Um dies zu mildern, verlassen sich Systeme wie DALL·E und Adobe Firefly auf sekundäre Filtermechanismen, die sowohl Eingabe-Prompts als auch generierte Ausgaben auf verbotene Inhalte überprüfen.

Infolgedessen wäre ein einfacher NSFW-Filter – der hauptsächlich explizite Inhalte blockiert – unzureichend, um die Akzeptabilität abgerufener RAG-basierter Daten zu bewerten. Solche Inhalte könnten immer noch anstößig oder schädlich sein, auf Arten, die außerhalb der vordefinierten Moderationsparameter des Modells liegen, und potenziell Material einführen, das die künstliche Intelligenz nicht richtig bewerten kann.

Die Entdeckung einer jüngsten Verwundbarkeit in der von der CCP produzierten DeepSeek, die darauf abzielt, Diskussionen über verbotene politische Inhalte zu unterdrücken, hat gezeigt, wie alternative Eingabewege ausgenutzt werden können, um die ethischen Schutzmechanismen eines Modells zu umgehen; dies gilt möglicherweise auch für willkürliche neue Daten, die aus dem Internet abgerufen werden, wenn sie in eine neue Bildgenerierung eingebunden werden sollen.

RAG für Bildgenerierung

Trotz dieser Herausforderungen und politischen Aspekte sind eine Reihe von Projekten entstanden, die versuchen, RAG-basierte Methoden zur Einbeziehung neuer Daten in visuelle Generationen zu verwenden.

ReDi

Das 2023er Retrieval-basierte Diffusion-Projekt (ReDi) ist ein lernfreies Framework, das die Diffusionsmodell-Schätzung beschleunigt, indem es ähnliche Pfade aus einer vorkomputierten Wissensbasis abruft.

Werte aus einem Datensatz können in ReDi “ausgeliehen” werden, um eine neue Generation zu erstellen. Quelle: https://arxiv.org/pdf/2302.02285

Im Kontext von Diffusionsmodellen ist ein Pfad der schrittweise Weg, den das Modell nimmt, um ein Bild aus reinem Rauschen zu erzeugen. Normalerweise geschieht dieser Prozess allmählich über viele Schritte, wobei jeder Schritt das Bild ein wenig mehr verfeinert.

ReDi beschleunigt dies, indem es eine Reihe dieser Schritte überspringt. Anstatt jeden einzelnen Schritt zu berechnen, ruft es einen ähnlichen vorherigen Pfad aus einer Datenbank ab und springt zu einem späteren Punkt im Prozess. Dies reduziert die Anzahl der erforderlichen Berechnungen und macht die Diffusions-basierte Bildgenerierung viel schneller, während die Qualität erhalten bleibt.

ReDi modifiziert die Gewichte des Diffusionsmodells nicht, sondern verwendet die Wissensbasis, um Zwischenschritte zu überspringen, wodurch die Anzahl der für die Stichprobenbewertung erforderlichen Funktionsabschätzungen reduziert wird.

Natürlich ist dies nicht dasselbe wie die Einbeziehung spezifischer Bilder nach Belieben in eine Generierungsanfrage; aber es steht in Zusammenhang mit ähnlichen Arten der Generation.

Veröffentlicht im Jahr 2022, dem Jahr, in dem latente Diffusionsmodelle die öffentliche Vorstellungskraft eroberten, scheint ReDi einer der frühesten diffusionsbasierten Ansätze zu sein, der auf eine RAG-Methodik setzt.

Allerdings sollte erwähnt werden, dass Facebook Research im Jahr 2021 Instance-Conditioned GAN veröffentlichte, das darauf abzielte, GAN-Bilder auf neue Bild-Eingaben zu konditionieren, diese Art von Projektion in den latenten Raum ist extrem häufig in der Literatur, sowohl für GANs als auch für Diffusionsmodelle; die Herausforderung besteht darin, einen solchen Prozess lernfrei und in Echtzeit funktionsfähig zu machen, wie RAG-Methoden, die auf LLMs fokussiert sind.

RDM

Ein weiterer früher Vorstoß in die RAG-erweiterte Bildgenerierung ist das Retrieval-Augmented Diffusion Model (RDM), das einen semi-parametrischen Ansatz zur generativen Bildsynthese einführt. Während traditionelle Diffusionsmodelle alle gelernten visuellen Kenntnisse innerhalb ihrer neuronalen Netzwerkparameter speichern, verlässt sich RDM auf eine externe Bild-Datenbank:

Abgerufene nächste Nachbarn in einer illustrierenden Pseudo-Abfrage in RDM*.

Während der Trainingsphase ruft das Modell nächste Nachbarn (visuell oder semantisch ähnliche Bilder) aus der externen Datenbank ab, um den Generierungsprozess zu leiten. Dies ermöglicht es dem Modell, seine Ausgaben auf reale visuelle Instanzen zu konditionieren.

Der Abrufprozess wird von CLIP-Embeddings angetrieben, die so konzipiert sind, dass die abgerufenen Bilder bedeutsame Ähnlichkeiten mit der Abfrage aufweisen und auch neue Informationen zur Verbesserung der Generation liefern.

Dies reduziert die Abhängigkeit von Parametern und ermöglicht kleinere Modelle, die wettbewerbsfähige Ergebnisse ohne umfangreiche Trainingsdatensätze erzielen.

Der RDM-Ansatz unterstützt post-hoc-Modifikationen: Forscher können die Datenbank zur Inferenzzeit austauschen, was eine Null-Shot-Anpassung an neue Stile, Domänen oder sogar völlig andere Aufgaben wie Stilisierung oder klassenbedingte Synthese ermöglicht.

In den unteren Reihen sehen wir die nächste Nachbarn, die in den Diffusionsprozess in RDM* einbezogen werden.

Ein wichtiger Vorteil von RDM ist seine Fähigkeit, die Bildgenerierung zu verbessern, ohne das Modell neu trainieren zu müssen. Durch die einfache Änderung der Abruf-Datenbank kann das Modell sich auf neue Konzepte verallgemeinern, auf die es nicht explizit trainiert wurde. Dies ist besonders nützlich für Anwendungen, bei denen Domänenverschiebungen auftreten, wie z. B. die Generierung medizinischer Bilder auf der Grundlage sich entwickelnder Datensätze oder die Anpassung von Text-Bild-Modellen für kreative Anwendungen.

Negativ bleibt, dass retrieval-basierte Methoden dieser Art von der Qualität und Relevanz der externen Datenbank abhängen, was die Datenkuratierung zu einem wichtigen Faktor für die Erzielung hochwertiger Generationen macht; und dieser Ansatz bleibt weit von einer Bildsynthese-Äquivalent der Art von RAG-basierten Interaktionen entfernt, die in kommerziellen LLMs typisch sind.

ReMoDiffuse

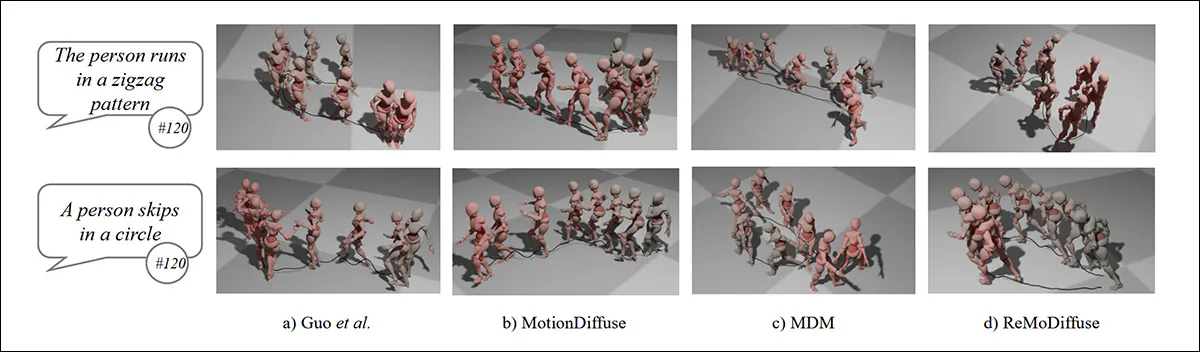

ReMoDiffuse ist ein retrieval-augmentierter Bewegungs-Diffusionsmodell, das für die 3D-Mensch-Bewegungsgenerierung konzipiert ist. Im Gegensatz zu traditionellen Bewegungs-Generierungsmodellen, die sich rein auf gelernte Repräsentationen verlassen, ruft ReMoDiffuse relevante Bewegungsmuster aus einer großen Bewegungsdatenbank ab und integriert sie in den Entstörungsprozess, in einem Schema ähnlich wie RDM (siehe oben).

Vergleich des RAG-erweiterten ReMoDiffuse (rechts) mit vorherigen Methoden. Quelle: https://arxiv.org/pdf/2304.01116

Dies ermöglicht es dem Modell, Bewegungssequenzen zu generieren, die natürlicher und vielfältiger sind und semantisch treuer zu den Text-Prompts des Benutzers sind.

ReMoDiffuse verwendet einen innovativen hybriden Abrufmechanismus, der Bewegungssequenzen basierend auf sowohl semantischen als auch kinematischen Ähnlichkeiten auswählt, mit dem Ziel, sicherzustellen, dass die abgerufenen Bewegungen nicht nur thematisch relevant, sondern auch physiologisch plausibel sind, wenn sie in die neue Generation integriert werden.

Das Modell verfeinert diese abgerufenen Muster dann mithilfe eines Semantik-modulierten Transformers, der selektiv Wissen aus den abgerufenen Bewegungen einbezieht, während die charakteristischen Eigenschaften der generierten Sequenz erhalten bleiben:

Schema für ReMoDiffuse’s Pipeline.

Die Condition-Mixture-Technik des Projekts verbessert die Fähigkeit des Modells, sich über verschiedene Prompts und Abrufbedingungen hinweg zu verallgemeinern, indem es abgerufene Bewegungsmuster mit Text-Prompts während der Generation ausgleicht und anpasst, wie viel Gewicht jede Quelle bei jedem Schritt erhält.

Dies kann helfen, unrealistische oder repetitive Ausgaben zu vermeiden, auch für seltene Prompts. Es geht auch auf das Skalierungs-Sensitivitätsproblem ein, das oft in den classifier-free-Guidance-Techniken auftritt, die in Diffusionsmodellen häufig verwendet werden.

RA-CM3

Stanfords 2023er Papier Retrieval-Augmented Multimodal Language Modeling (RA-CM3) ermöglicht es dem System, auf Echtzeit-Informationen zuzugreifen:

Stanfords Retrieval-Augmented Multimodal Language Modeling (RA-CM3)-Modell verwendet internet-abgerufene Bilder, um den Generierungsprozess zu erweitern, bleibt aber ein Prototyp ohne öffentlichen Zugang. Quelle: https://cs.stanford.edu/~myasu/files/RACM3_slides.pdf

RA-CM3 integriert abgerufene Texte und Bilder in die Generierungspipeline, wodurch sowohl Text-Bild- als auch Bild-Text-Synthese verbessert werden. Durch die Verwendung von CLIP für den Abruf und einem Transformer als Generator bezieht sich das Modell auf relevante multimodale Dokumente, bevor es eine Ausgabe komponiert.

Benchmarks auf MS-COCO zeigen bemerkenswerte Verbesserungen gegenüber DALL-E und ähnlichen Systemen, mit einer 12-Punkte-Fréchet-Inception-Distanz-Reduktion, bei deutlich geringerem Rechenaufwand.

Allerdings wird, wie bei anderen retrieval-augmentierten Ansätzen, das abgerufene Wissen nicht nahtlos internalisiert. Stattdessen wird es auf das vorgebildete Netzwerk überlagert, ähnlich wie ein LLM, das Antworten mit Suchergebnissen ergänzt. Obwohl diese Methode die faktische Genauigkeit verbessern kann, ersetzt sie nicht die Notwendigkeit von Trainings-Updates in Domänen, in denen tiefe Synthese erforderlich ist.

Darüber hinaus scheint eine praktische Implementierung dieses Systems nicht verfügbar zu sein, nicht einmal auf einer API-basierten Plattform.

RealRAG

Eine neue Veröffentlichung aus China, und die, die uns zu diesem Blick auf RAG-erweiterte generative Bildsysteme veranlasst hat, ist das sogenannte Retrieval-Augmented Realistic Image Generation (RealRAG).

Externe Bilder, die in RealRAG (untere Mitte) einbezogen werden. Quelle: https://arxiv.o7rg/pdf/2502.00848

RealRAG ruft tatsächliche Bilder relevanter Objekte aus einer Datenbank ab, die aus öffentlich verfügbaren Datensätzen wie ImageNet, Stanford Cars, Stanford Dogs und Oxford Flowers kuratiert wurde. Es integriert diese abgerufenen Bilder dann in den Generierungsprozess, um Wissenslücken im Modell zu schließen.

Ein wichtiger Bestandteil von RealRAG ist selbstreflektives kontrastives Lernen, das ein Abrufmodell trainiert, um informative Referenzbilder zu finden, anstatt nur visuell ähnliche auszuwählen.