Das Beste

10 Beste Machine-Learning-Algorithmen

Obwohl wir in einer Zeit außergewöhnlicher Innovation im Bereich des GPU-beschleunigten Machine Learning leben, werden in den aktuellen Forschungsarbeiten häufig (und prominent) Algorithmen vorgestellt, die Jahrzehnte, in einigen Fällen sogar 70 Jahre alt sind.

Einige mögen argumentieren, dass viele dieser älteren Methoden eher der statistischen Analyse als dem Machine Learning zuzurechnen sind und den Beginn des Sektors nur bis 1957 mit der Erfindung des Perceptrons zurückdatieren.

Angesichts des Ausmaßes, in dem diese älteren Algorithmen die neuesten Trends und bahnbrechenden Entwicklungen im Machine Learning unterstützen und verflochten sind, ist dies eine umstrittene Position. Lassen Sie uns also einige der “klassischen” Bausteine betrachten, die die neuesten Innovationen untermauern, sowie einige neue Einträge, die frühzeitig um einen Platz im AI-Hall of Fame buhlen.

1: Transformer

Im Jahr 2017 leitete Google Research eine Forschungskooperation, die in dem Paper Aufmerksamkeit ist alles, was Sie benötigen mündete. Die Arbeit skizzierte eine neuartige Architektur, die Aufmerksamkeitsmechanismen von “Piping” in Encoder/Decoder- und rekurrenten Netzmodellen zu einer zentralen Transformations-Technologie in ihrem eigenen Recht beförderte.

Der Ansatz wurde Transformer genannt und ist seitdem zu einer revolutionären Methodik im Bereich der Natural Language Processing (NLP) geworden, die unter anderem das autoregressive Sprachmodell und das AI-Flaggschiff GPT-3 antreibt.

Transformer lösten das Problem der Sequenztransduktion , auch “Transformation” genannt, das mit der Verarbeitung von Eingabesequenzen in Ausgabesequenzen befasst ist. Ein Transformer erhält und verarbeitet auch Daten auf kontinuierliche Weise, anstatt in sequenziellen Batches, was eine “Beharrlichkeit des Gedächtnisses” ermöglicht, die RNN-Architekturen nicht erreichen können. Für eine detailliertere Übersicht über Transformer siehe unser Referenzartikel.

Im Gegensatz zu den rekurrenten neuronalen Netzen (RNNs), die in der CUDA-Ära begonnen hatten, die ML-Forschung zu dominieren, konnte die Transformer-Architektur auch leicht parallelisiert werden, was den Weg frei machte, um eine viel größere Menge an Daten als RNNs produktiv zu bearbeiten.

Beliebte Verwendung

Transformer haben die öffentliche Vorstellungskraft im Jahr 2020 mit der Veröffentlichung von OpenAI’s GPT-3 erobert, das einen damaligen Rekord von 175 Milliarden Parametern aufstellte. Diese offensichtlich atemberaubende Leistung wurde später von anderen Projekten wie der Veröffentlichung von Microsofts Megatron-Turing NLG 530B im Jahr 2021 übertroffen, das (wie der Name bereits andeutet) über 530 Milliarden Parameter verfügt.

Eine Zeitleiste von Hyperscale-Transformer-NLP-Projekten. Quelle: Microsoft

Die Transformer-Architektur hat auch den Übergang von NLP zur Computer-Vision gemacht und treibt eine neue Generation von Bildsynthese-Frameworks wie OpenAI’s CLIP und DALL-E an, die Text-Bild-Domänen-Mapping verwenden, um unvollständige Bilder zu vervollständigen und neue Bilder aus trainierten Domänen zu synthetisieren, neben einer wachsenden Anzahl von verwandten Anwendungen.

DALL-E versucht, ein teilweises Bild eines Plato-Büsten zu vervollständigen. Quelle: https://openai.com/blog/dall-e/

2: Generative Adversarial Networks (GANs)

Obwohl Transformer außergewöhnliche Medienberichterstattung durch die Veröffentlichung und Adoption von GPT-3 erhalten haben, ist das Generative Adversarial Network (GAN) zu einer anerkannten Marke in seinem eigenen Recht geworden und könnte schließlich Deepfake als Verb beitreten.

Zuerst vorgeschlagen im Jahr 2014 und hauptsächlich für Bildsynthese verwendet, besteht eine Generative Adversarial Network Architektur aus einem Generator und einem Discriminator. Der Generator durchläuft Tausende von Bildern in einem Datensatz, versucht iterativ, sie zu rekonstruieren. Für jeden Versuch bewertet der Discriminator die Arbeit des Generators und schickt den Generator zurück, um besser zu machen, ohne jedoch Einblick in die Art und Weise zu geben, wie die vorherige Rekonstruktion fehlgeschlagen ist.

Quelle: https://developers.google.com/machine-learning/gan/gan_structure

Dies zwingt den Generator, eine Vielzahl von Wegen zu erkunden, anstatt einem potenziellen toten Winkel zu folgen, der entstanden wäre, wenn der Discriminator ihm gesagt hätte, wo er falsch lag (siehe #8 unten). Wenn die Ausbildung abgeschlossen ist, hat der Generator eine detaillierte und umfassende Karte der Beziehungen zwischen Punkten im Datensatz.

Aus dem Paper Verbesserung der GAN-Gleichgewicht durch Erhöhung der räumlichen Wahrnehmung: Ein neues Framework durchläuft den sometimes-mysteriösen latenten Raum eines GAN, bietet eine responsive Instrumentalität für eine Bildsynthese-Architektur. Quelle: https://genforce.github.io/eqgan/

Durch Analogie ist dies der Unterschied zwischen dem Lernen einer einzigen langweiligen Fahrt in die Innenstadt von London oder dem mühsamen Erwerb von The Knowledge.

Das Ergebnis ist eine hochrangige Sammlung von Funktionen im latenten Raum des trainierten Modells. Der semantische Indikator für eine hochrangige Funktion könnte ‘Person’ sein, während ein Abstieg durch Spezifität im Zusammenhang mit der Funktion andere erlernte Merkmale wie ‘männlich’ und ‘weiblich’ aufdecken kann. Auf niedrigeren Ebenen können die Submerkmale in ‘blond’, ‘kaukasisch’ usw. zerfallen.

Verflechtung ist ein bemerkenswertes Problem im latenten Raum von GANs und Encoder/Decoder-Frameworks: Ist das Lächeln auf einem GAN-generierten weiblichen Gesicht ein verflochtenes Merkmal ihrer ‘Identität’ im latenten Raum oder ein paralleler Zweig?

GAN-generierte Gesichter von thispersondoesnotexist. Quelle: https://this-person-does-not-exist.com/en

Die letzten paar Jahre haben eine wachsende Anzahl neuer Forschungsinitiativen in dieser Hinsicht hervorgebracht, die möglicherweise den Weg für eine merkmalsbasierte, Photoshop-ähnliche Bearbeitung des latenten Raums eines GAN ebnen, aber im Moment sind viele Transformationen effektiv ‘Alles-oder-Nichts’-Pakete. Bemerkenswerterweise erreicht NVIDIA’s EditGAN-Veröffentlichung von Ende 2021 ein hohes Maß an Interpretierbarkeit im latenten Raum durch die Verwendung semantischer Segmentierungsmasken.

Beliebte Verwendung

Neben ihrer (tatsächlich ziemlich begrenzten) Beteiligung an populären Deepfake-Videos haben Bild-/Video-zentrierte GANs in den letzten vier Jahren Forscher und die Öffentlichkeit begeistert. Es ist eine Herausforderung, mit der atemberaubenden Rate und Häufigkeit neuer Veröffentlichungen Schritt zu halten, obwohl das GitHub-Repository Awesome GAN Applications versucht, eine umfassende Liste zu bieten.

Generative Adversarial Networks können theoretisch Merkmale aus jedem gut strukturierten Bereich ableiten, einschließlich Text.

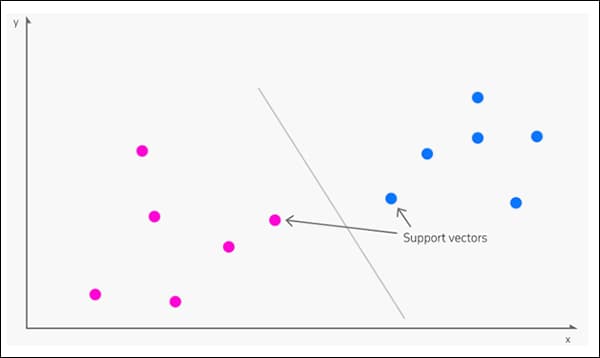

3: SVM

Ursprünglich im Jahr 1963 entstanden, ist Support Vector Machine (SVM) ein grundlegender Algorithmus, der häufig in neuen Forschungsarbeiten auftaucht. Unter SVM kartieren Vektoren die relative Disposition von Datenpunkten in einem Datensatz, während Support-Vektoren die Grenzen zwischen verschiedenen Gruppen, Funktionen oder Merkmalen abstecken.

Support-Vektoren definieren die Grenzen zwischen Gruppen. Quelle: https://www.kdnuggets.com/2016/07/support-vector-machines-simple-explanation.html

Die abgeleitete Grenze wird als Hyperplane bezeichnet.

Bei niedrigen Funktionsniveaus ist die SVM zweidimensional (Bild oben), aber wenn es eine höhere Anzahl von Gruppen oder Typen gibt, wird sie dreidimensional.

Eine tiefere Anordnung von Punkten und Gruppen erfordert eine dreidimensionale SVM. Quelle: https://cml.rhul.ac.uk/svm.html

Beliebte Verwendung

Da Support-Vektoren effektiv und agnostisch eine Vielzahl von Daten bearbeiten können, tauchen sie in verschiedenen maschinellen Lernsektoren auf, einschließlich Deepfake-Erkennung, Bildklassifizierung, Hasssprachenerkennung, DNA-Analyse und Populationsstrukturvorhersage, neben vielen anderen.

4: K-Means-Clustering

Clustering im Allgemeinen ist ein unüberwachtes Lernen, das versucht, Datenpunkte durch Dichteschätzung zu kategorisieren und eine Karte der Verteilung der zu untersuchenden Daten zu erstellen.

K-Means-Clustering diviniert Segmente, Gruppen und Gemeinschaften in Daten. Quelle: https://aws.amazon.com/blogs/machine-learning/k-means-clustering-with-amazon-sagemaker/

K-Means-Clustering ist die beliebteste Implementierung dieses Ansatzes und führt Datenpunkte in verschiedene ‘K-Gruppen’, die demografische Sektoren, Online-Gemeinschaften oder jede andere mögliche geheime Aggregation darstellen können, die in rohen statistischen Daten entdeckt werden kann.

Cluster bilden sich in der K-Means-Analyse. Quelle: https://www.geeksforgeeks.org/ml-determine-the-optimal-value-of-k-in-k-means-clustering/

Der K-Wert selbst ist der entscheidende Faktor bei der Nützlichkeit des Prozesses und bei der Festlegung eines optimalen Werts für einen Cluster. Anfangs wird der K-Wert zufällig zugewiesen, und seine Funktionen und Vektormerkmale werden mit seinen Nachbarn verglichen. Die Nachbarn, die dem Datenpunkt mit dem zufällig zugewiesenen Wert am nächsten kommen, werden seinem Cluster iterativ zugewiesen, bis die Daten alle Gruppierungen freigegeben haben, die der Prozess zulässt.

Die Grafik für den quadrierten Fehler oder die ‘Kosten’ der unterschiedlichen Werte zwischen den Clustern wird einen Ellbogpunkt für die Daten aufdecken:

Der ‘Ellbogpunkt’ in einer Cluster-Grafik. Quelle: https://www.scikit-yb.org/en/latest/api/cluster/elbow.html

Der Ellbogpunkt ist ähnlich wie die Art und Weise, wie der Verlust bei einem Trainingssitz für einen Datensatz abflacht und zu vernachlässigbaren Renditen führt. Er stellt den Punkt dar, an dem keine weiteren Unterschiede zwischen Gruppen offensichtlich werden, was darauf hinweist, dass es Zeit ist, zu den nächsten Phasen in der Datenpipeline überzugehen oder die Ergebnisse zu melden.

Beliebte Verwendung

K-Means-Clustering ist aufgrund seiner offensichtlichen Gründe eine primäre Technologie in der Kundenanalyse, da es eine klare und erklärbare Methodik bietet, um große Mengen an kommerziellen Aufzeichnungen in demografische Erkenntnisse und ‘Leads’ zu übersetzen.

Außerhalb dieser Anwendung wird K-Means-Clustering auch für Erdrutschvorhersage, medizinische Bildsegmentierung, Bildsynthese mit GANs, Dokumentenklassifizierung und Stadtplanung eingesetzt, neben vielen anderen möglichen und tatsächlichen Anwendungen.

5: Random Forest

Random Forest ist eine Ensemble-Lernmethode, die das Ergebnis aus einem Array von Entscheidungsbäumen mittelt, um eine Gesamtvorhersage für das Ergebnis zu erstellen.

Quelle: https://www.tutorialandexample.com/wp-content/uploads/2019/10/Decision-Trees-Root-Node.png

Wenn Sie es auch nur so weit erforscht haben, wie das Ansehen der Zurück in die Zukunft-Trilogie, ist ein Entscheidungsbaum selbst ziemlich einfach zu konzeptualisieren: Eine Reihe von Wegen liegt vor Ihnen, und jeder Weg verzweigt sich in ein neues Ergebnis, das wiederum weitere mögliche Wege enthält.

In Verstärkendem Lernen können Sie sich von einem Weg zurückziehen und von einem früheren Standpunkt aus erneut beginnen, während Entscheidungsbäume ihre Reisen festlegen.

Der Random-Forest-Algorithmus ist im Wesentlichen ein Streuverhalten bei Entscheidungen. Der Algorithmus wird ‘zufällig’ genannt, weil er ad hoc-Auswahlen und Beobachtungen trifft, um die Median-Summe der Ergebnisse aus dem Entscheidungsbaum-Array zu verstehen.

Da er eine Vielzahl von Faktoren berücksichtigt, kann ein Random-Forest-Ansatz schwieriger in bedeutsame Grafiken umzuwandeln sein als ein Entscheidungsbaum, aber er ist wahrscheinlich bemerkenswerter produktiv.

Entscheidungsbäume sind anfällig für Überanpassung, bei der die Ergebnisse datenspezifisch sind und sich nicht verallgemeinern lassen. Die willkürliche Auswahl von Datenpunkten durch Random Forest bekämpft diese Tendenz und bohrt sich durch zu bedeutsamen und nützlichen repräsentativen Trends in den Daten.

Entscheidungsbaum-Regression. Quelle: https://scikit-learn.org/stable/auto_examples/tree/plot_tree_regression.html

Beliebte Verwendung

Wie bei vielen Algorithmen in dieser Liste operiert Random Forest typischerweise als ‘früher’ Sortier- und Filterprozess für Daten und taucht daher konsistent in neuen Forschungspapieren auf. Einige Beispiele für die Verwendung von Random Forest sind Magnetresonanzbildsynthese, Bitcoin-Preisvorhersage, Kundensegmentierung, Textklassifizierung und Kreditkartenbetrugsdetektion.

Da Random Forest ein niedriges Algorithmus-Level in maschinellen Lernarchitekturen ist, kann es auch zur Leistung anderer niedriger Algorithmus-Methoden beitragen, sowie Visualisierungsalgorithmen, einschließlich induktives Clustering, Funktionstransformationen, Klassifizierung von Textdokumenten unter Verwendung von Sparse-Funktionen und Anzeige von Pipelines.

6: Naive Bayes

Kombiniert mit Dichteschätzung (siehe 4 oben), ist ein Naive-Bayes-Klassifizierer ein leistungsstarkes, aber relativ leichtes Algorithmus, der in der Lage ist, Wahrscheinlichkeiten auf der Grundlage der berechneten Funktionen von Daten zu schätzen.

Funktionsbeziehungen in einem Naive-Bayes-Klassifizierer. Quelle: https://www.sciencedirect.com/topics/computer-science/naive-bayes-model

Der Begriff ‘naiv’ bezieht sich auf die Annahme in Bayes’ Theorem, dass Funktionen nicht miteinander in Beziehung stehen, bekannt als bedingte Unabhängigkeit. Wenn Sie diese Standpunkt einnehmen, sind das Gehen und Sprechen wie eine Ente nicht ausreichend, um zu bestimmen, ob es sich um eine Ente handelt, und keine ‘offensichtlichen’ Annahmen werden vorzeitig angenommen.

Dieses Maß an akademischer und investigativer Strenge wäre übertrieben, wenn ‘gesunder Menschenverstand’ verfügbar ist, aber es ist ein wertvoller Standard, wenn man die vielen Unklarheiten und potenziell nicht zusammenhängenden Korrelationen durchquert, die in einem maschinellen Lern-Datensatz existieren können.

In einem ursprünglichen bayesschen Netzwerk sind Funktionen Bewertungsfunktionen unterworfen, einschließlich minimaler Beschreibungslänge und Bayesscher Bewertung, die Einschränkungen auf die Daten in Bezug auf die geschätzten Verbindungen zwischen den Datenpunkten und die Richtung, in der diese Verbindungen fließen, auferlegen können.

Ein Naive-Bayes-Klassifizierer hingegen operiert, indem er annimmt, dass die Funktionen eines gegebenen Objekts unabhängig sind, und verwendet Bayes’ Theorem, um die Wahrscheinlichkeit eines gegebenen Objekts auf der Grundlage seiner Funktionen zu berechnen.

Beliebte Verwendung

Naive-Bayes-Filter sind in Krankheitsvorhersage und Dokumentenkategorisierung, Spam-Filterung, Stimmungsanalyse, Empfehlungssysteme und Betrugsdetektion gut vertreten, neben anderen Anwendungen.

7: K-Nearest Neighbors (KNN)

Erstmalig vorgeschlagen von der US Air Force School of Aviation Medicine im Jahr 1951 und an die State-of-the-Art-Hardware des 20. Jahrhunderts angepasst, ist K-Nearest Neighbors (KNN) ein schlanker Algorithmus, der immer noch prominent in akademischen Papieren und privaten maschinellen Lern-Forschungsinitiativen auftritt.

KNN wird als ‘fauler Lerner’ bezeichnet, da es den gesamten Datensatz auswertet, um die Beziehungen zwischen Datenpunkten zu bewerten, anstatt das Training eines vollständigen maschinellen Lernmodells zu erfordern.

Eine KNN-Gruppierung. Quelle: https://scikit-learn.org/stable/modules/neighbors.html

Obwohl KNN architektonisch schmal ist, stellt sein systematischer Ansatz eine bemerkenswerte Nachfrage an Lese- und Schreiboperationen, und seine Verwendung in sehr großen Datensätzen kann ohne zusätzliche Technologien wie Hauptkomponentenanalyse (PCA) problematisch sein, die komplexe und hochvolumige Datensätze in repräsentative Gruppierungen umwandeln kann, die KNN mit weniger Aufwand durchlaufen kann.

Ein jüngste Studie bewertete die Effektivität und Wirtschaftlichkeit einer Reihe von Algorithmen, die damit beauftragt wurden, vorherzusagen, ob ein Mitarbeiter ein Unternehmen verlassen wird, und stellte fest, dass der siebzigjährige KNN immer noch anderen modernen Konkurrenten in Bezug auf Genauigkeit und Vorhersageeffektivität überlegen war.

Beliebte Verwendung

Trotz seiner einfachen Konzeption ist KNN nicht im Jahr 1950 stecken geblieben – es wurde in einem Vorschlag von 2018 von der Pennsylvania State University in einen DNN-orientierten Ansatz adaptiert und bleibt ein zentraler früher Prozess (oder postprozessuale Analyse-Tool) in vielen komplexeren maschinellen Lern-Frameworks.

In verschiedenen Konfigurationen wurde KNN für Online-Signaturüberprüfung, Bildklassifizierung, Textmining, Erntevorhersage und Gesichtserkennung eingesetzt, neben anderen Anwendungen und Einbindung.

8: Markov-Entscheidungsprozess (MDP)

Ein mathematischer Rahmen, der vom amerikanischen Mathematiker Richard Bellman im Jahr 1957 eingeführt wurde, ist der Markov-Entscheidungsprozess (MDP) einer der grundlegendsten Bausteine von Verstärkendem Lernen-Architekturen. Ein konzeptioneller Algorithmus in seinem eigenen Recht, wurde er in eine Vielzahl von anderen Algorithmen adaptiert und taucht häufig in der aktuellen AI/ML-Forschung auf.

MDP erkundet eine Datenumgebung, indem es seine Bewertung des aktuellen Zustands (d. h. ‘wo’ es sich in den Daten befindet) verwendet, um zu entscheiden, welchen Knoten der Daten es als Nächstes erkunden soll.

Quelle: https://www.sciencedirect.com/science/article/abs/pii/S0888613X18304420

Ein grundlegender Markov-Entscheidungsprozess priorisiert kurzfristige Vorteile gegenüber langfristigen Zielen. Aus diesem Grund wird er normalerweise in den Kontext einer umfassenderen Richtlinien-Architektur in Verstärkendem Lernen eingebettet und unterliegt häufig begrenzenden Faktoren wie abgezogener Belohnung und anderen modifizierenden Umweltvariablen, die verhindern, dass es zu einem sofortigen Ziel eilt, ohne die breiteren gewünschten Ergebnisse zu berücksichtigen.

Beliebte Verwendung

MDP ist in Forschung und aktiven maschinellen Lern-Einsätzen weit verbreitet. Es wurde für IoT-Sicherheitsverteidigungssysteme, Fischfang und Marktprognose vorgeschlagen.

Neben seiner offensichtlichen Anwendbarkeit auf Schach und andere streng sequenzielle Spiele ist MDP auch ein natürlicher Kandidat für die prozedurale Ausbildung von Robotiksystemen, wie wir im folgenden Video sehen können.

https://www.youtube.com/watch?v=9JhIsKmoRUc

9: Term Frequency-Inverse Document Frequency

Term Frequency (TF) teilt die Anzahl der Male, die ein Wort in einem Dokument vorkommt, durch die Gesamtzahl der Wörter in diesem Dokument. So hat das Wort Robbe, das einmal in einem tausend Wörter umfassenden Artikel vorkommt, eine Termfrequenz von 0,001. Allein ist TF jedoch weitgehend nutzlos als Indikator für die Bedeutung eines Terms, da sinnlose Artikel (wie a, und, die und es) dominieren.

Um einen sinnvollen Wert für einen Term zu erhalten, berechnet die Inverse Document Frequency (IDF) die TF eines Wortes über mehrere Dokumente in einem Datensatz und weist eine niedrige Bewertung sehr häufigen Stoppwörtern zu, wie z. B. Artikeln. Die resultierenden Funktionsvektoren werden auf ganze Werte normalisiert, und jedem Wort wird ein entsprechendes Gewicht zugewiesen.

TF-IDF gewichtet die Relevanz von Termen basierend auf der Häufigkeit über eine Reihe von Dokumenten, wobei seltene Vorkommen ein Indikator für Salienz sind. Quelle: https://moz.com/blog/inverse-document-frequency-and-the-importance-of-uniqueness

Obwohl dieser Ansatz verhindert, dass semantisch wichtige Wörter als Ausreißer verloren gehen, bedeutet das Umkehren der Häufigkeitsgewichtung nicht automatisch, dass ein niedrigfrequentes Term nicht ein Ausreißer ist, da einige Dinge selten und wertlos sind. Daher muss ein niedrigfrequenter Term seinen Wert im breiteren architektonischen Kontext unter Beweis stellen, indem er (auch bei niedriger Frequenz pro Dokument) in einer Reihe von Dokumenten im Datensatz auftritt.

Trotz seines Alters ist TF-IDF eine leistungsstarke und beliebte Methode für die anfängliche Filterung in Natural Language Processing-Frameworks.

Beliebte Verwendung

Da TF-IDF zumindest teilweise an der Entwicklung von Googles weitgehend okkulter PageRank-Algorithmen in den letzten zwanzig Jahren beteiligt war, ist es sehr weit verbreitet als manipulative SEO-Taktik angenommen worden, trotz John Muellers Ablehnung seiner Bedeutung für Suchergebnisse im Jahr 2019.

Aufgrund der Geheimhaltung um PageRank gibt es keine klaren Beweise dafür, dass TF-IDF nicht derzeit eine effektive Taktik für eine bessere SEO-Platzierung ist. Kontroversen unter IT-Experten lassen kürzlich darauf schließen, dass eine populäre Auffassung, richtig oder falsch, besteht, dass Term-Missbrauch immer noch zu einer verbesserten SEO-Platzierung führen kann (obwohl zusätzliche Anschuldigungen von Monopolmissbrauch und exzessiver Werbung die Grenzen dieser Theorie verwischen).

10: Stochastischer Gradientenabstieg

Stochastischer Gradientenabstieg (SGD) ist eine zunehmend beliebte Methode für die Optimierung des Trainings von maschinellen Lernmodellen.

Gradientenabstieg selbst ist eine Methode zur Optimierung und anschließenden Quantifizierung der Verbesserung, die ein Modell während des Trainings macht.

In diesem Sinne zeigt ‘Gradient’ eine Abnahme (und nicht eine Farbverläufe, siehe Bild unten), wo der höchste Punkt des ‘Hügels’, auf der linken Seite, den Beginn des Trainingsprozesses darstellt. Zu diesem Zeitpunkt hat das Modell den gesamten Datensatz noch nicht einmal gesehen und hat nicht genug über die Beziehungen zwischen den Daten gelernt, um effektive Transformationen zu produzieren.

Ein Gradientenabstieg auf einer FaceSwap-Trainings-Session. Wir können sehen, dass das Training für einige Zeit in der zweiten Hälfte plateauartig verläuft, aber schließlich seinen Weg den Gradienten hinunter zur akzeptablen Konvergenz wieder aufnimmt.

Der niedrigste Punkt, auf der rechten Seite, stellt die Konvergenz (den Punkt, an dem das Modell so effektiv ist, wie es unter den auferlegten Einschränkungen und Einstellungen jemals sein wird) dar.

Der Gradient dient als Aufzeichnung und Vorhersage für die Diskrepanz zwischen der Fehlerrate (wie genau das Modell die Datenbeziehungen derzeit kartiert) und den Gewichten (die Einstellungen, die die Art und Weise beeinflussen, wie das Modell lernen wird).

Diese Aufzeichnung des Fortschritts kann verwendet werden, um einen Lernrate-Zeitplan zu informieren, ein automatischer Prozess, der der Architektur sagt, granularer und präziser zu werden, wenn die frühen vagen Details in klare Beziehungen und Zuordnungen umgewandelt werden. Der Gradientenverlust bietet im Wesentlichen eine Just-in-Time-Karte, wohin das Training als Nächstes gehen soll und wie es vorgehen soll.

Die Innovation des Stochastischen Gradientenabstiegs besteht darin, dass er die Modellparameter bei jedem Trainingsbeispiel pro Iteration aktualisiert, was im Allgemeinen den Weg zur Konvergenz beschleunigt. Aufgrund des Auftretens von Hyperscale-Datensätzen in den letzten Jahren ist SGD in letzter Zeit als eine mögliche Methode zur Bewältigung der daraus resultierenden logistischen Probleme an Popularität gewonnen.

Andererseits hat SGD negative Auswirkungen auf die Merkmalsskalierung und kann mehr Iterationen erfordern, um das gleiche Ergebnis zu erzielen, was zusätzliche Planung und zusätzliche Parameter erfordert, im Vergleich zu regulärem Gradientenabstieg.

Beliebte Verwendung

Aufgrund seiner Konfigurierbarkeit und trotz seiner Mängel ist SGD zum beliebtesten Optimierungsalgorithmus für die Anpassung von neuronalen Netzen geworden. Eine Konfiguration von SGD, die in neuen AI/ML-Forschungspapieren dominant wird, ist die Wahl des adaptiven Momentenschätzers (ADAM, eingeführt im Jahr 2015) Optimierer.

ADAM passt die Lernrate für jeden Parameter dynamisch (‘adaptive Lernrate’) an und integriert Ergebnisse aus vorherigen Updates in die nachfolgende Konfiguration (‘Impuls’). Darüber hinaus kann es für spätere Innovationen wie Nesterov-Impuls konfiguriert werden.

Allerdings behaupten einige, dass die Verwendung von Impuls ADAM (und ähnliche Algorithmen) auch zu einer suboptimalen Schlussfolgerung führen kann. Wie bei den meisten Blutungen im maschinellen Lern-Forschungssektor ist SGD ein laufendes Werk.

Erstveröffentlicht am 10. Februar 2022. Geändert am 10. Februar 20.05 EET – Formatierung.