Künstliche Intelligenz

Eine persönliche Einschätzung der Trends in der Computer-Vision-Literatur 2024

Ich habe die Computer-Vision- (CV-) und Bildsyntheseforschungsszene auf Arxiv und anderswo über fünf Jahre hinweg kontinuierlich verfolgt, sodass Trends im Laufe der Zeit offensichtlich werden und sich jedes Jahr in neue Richtungen verlagern.

Daher dachte ich, als 2024 zu Ende geht, es sei angebracht, einen Blick auf einige neue oder sich entwickelnde Merkmale in den Arxiv-Einreichungen im Bereich Computer-Vision und Mustererkennung Abschnitt zu werfen. Diese Beobachtungen, obwohl sie durch hunderte von Stunden des Studiums der Szene informiert sind, sind streng genommen anekdotisch.

Der anhaltende Aufstieg Ostasiens

Bis Ende 2023 hatte ich bemerkt, dass die Mehrheit der Literatur in der Kategorie “Stimmsynthese” aus China und anderen Regionen in Ostasien stammte. Ende 2024 muss ich feststellen (anekdotisch), dass dies nun auch auf die Bild- und Videosyntheseforschung zutrifft.

Dies bedeutet nicht, dass China und angrenzende Länder unbedingt immer die beste Arbeit leisten (tatsächlich gibt es Beweise für das Gegenteil); noch berücksichtigt es die hohe Wahrscheinlichkeit in China (wie im Westen), dass einige der interessantesten und leistungsfähigsten neuen Systeme, die entwickelt werden, proprietär sind und aus der Forschungsliteratur ausgeschlossen sind.

Aber es deutet darauf hin, dass Ostasien den Westen in dieser Hinsicht bei der Menge übertrifft. Was das wert ist, hängt von dem Ausmaß ab, in dem Sie an die Wirksamkeit von Edison-Style-Persistenz glauben, die normalerweise unwirksam angesichts unüberwindlicher Hindernisse ist.

Es gibt viele solche Straßenblockaden in generativer KI, und es ist nicht leicht zu wissen, welche durch die Bearbeitung bestehender Architekturen gelöst werden können und welche von vorne neu betrachtet werden müssen.

Obwohl Forscher aus Ostasien anscheinend eine größere Anzahl von Computer-Vision-Papieren produzieren, habe ich eine Zunahme der Häufigkeit von “Frankenstein”-ähnlichen Projekten festgestellt – Initiativen, die eine Kombination aus vorherigen Arbeiten darstellen, während sie begrenzte architektonische Neuheit (oder möglicherweise nur eine andere Art von Daten) hinzufügen.

In diesem Jahr schienen eine größere Anzahl von ostasiatischen (in erster Linie chinesischen oder chinesisch-beteiligten Kollaborationen) Einreichungen eher quotengetrieben als leistungsgetrieben zu sein, was das Signal-Rausch-Verhältnis in einem bereits überabonnierten Bereich erheblich erhöhte.

Gleichzeitig haben auch eine größere Anzahl von ostasiatischen Papieren meine Aufmerksamkeit und Bewunderung im Jahr 2024 auf sich gezogen. Wenn dies also ein Zahlen-Spiel ist, funktioniert es nicht – aber es ist auch nicht billig.

Zunehmende Anzahl von Einreichungen

Die Anzahl der Papiere, aus allen Herkunftsländern, ist offensichtlich im Jahr 2024 gestiegen.

Der beliebteste Publikationstag verschiebt sich im Laufe des Jahres; derzeit ist es Dienstag, wenn die Anzahl der Einreichungen im Computer-Vision- und Mustererkennungs-Abschnitt oft um 300-350 in einem einzigen Tag liegt, in den “Hochzeiten” (Mai-August und Oktober-Dezember, d. h. Konferenzsaison und “Jahresquoten-Deadline”-Saison).

Jenseits meiner eigenen Erfahrung berichtet Arxiv selbst über eine Rekordzahl an Einreichungen im Oktober 2024, mit 6000 neuen Einreichungen, und der Computer-Vision-Abschnitt ist die zweitmeist eingereichte Kategorie nach Machine Learning.

Allerdings wird der Machine-Learning-Abschnitt auf Arxiv oft als “zusätzliche” oder aggregierte Super-Kategorie verwendet, was dafür spricht, dass Computer-Vision und Mustererkennung tatsächlich die meist eingereichte Arxiv-Kategorie sind.

Die eigenen Statistiken von Arxiv zeigen deutlich, dass die Informatik der klare Leader bei den Einreichungen ist:

Informatik (CS) dominiert die Einreichungsstatistiken auf Arxiv über die letzten fünf Jahre. Quelle: https://info.arxiv.org/about/reports/submission_category_by_year.html

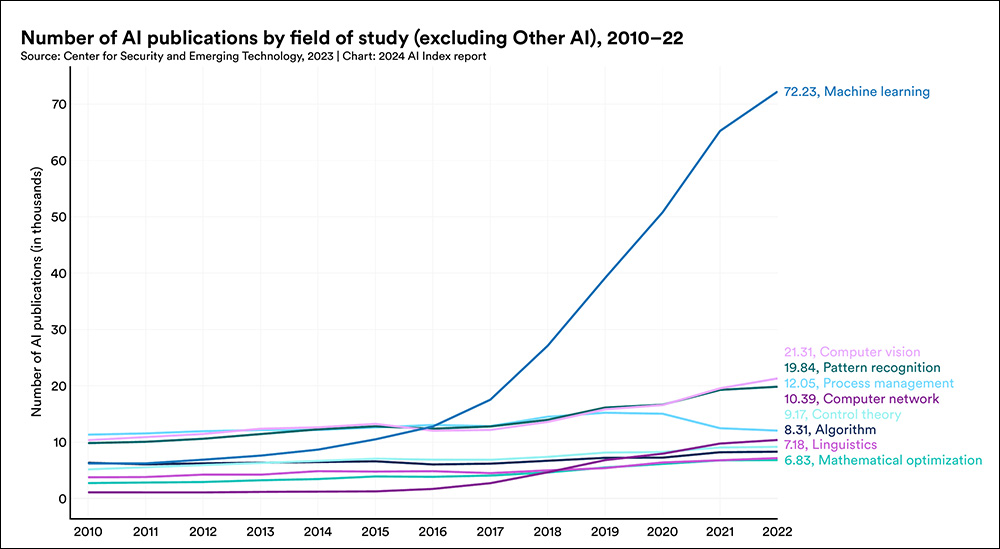

Die AI-Index 2024 von Stanford University betont, obwohl die Zahlen für 2024 noch nicht verfügbar sind, auch den bemerkenswerten Anstieg der Einreichungen von akademischen Papieren im Bereich des maschinellen Lernens in den letzten Jahren:

Mit Zahlen, die nicht für 2024 verfügbar sind, zeigt Stanfords Bericht dennoch dramatisch den Anstieg der Einreichungsvolumina für maschinelle Lernpapiere. Quelle: https://aiindex.stanford.edu/wp-content/uploads/2024/04/HAI_AI-Index-Report-2024_Chapter1.pdf

Diffusion>Mesh-Frameworks verbreiten sich

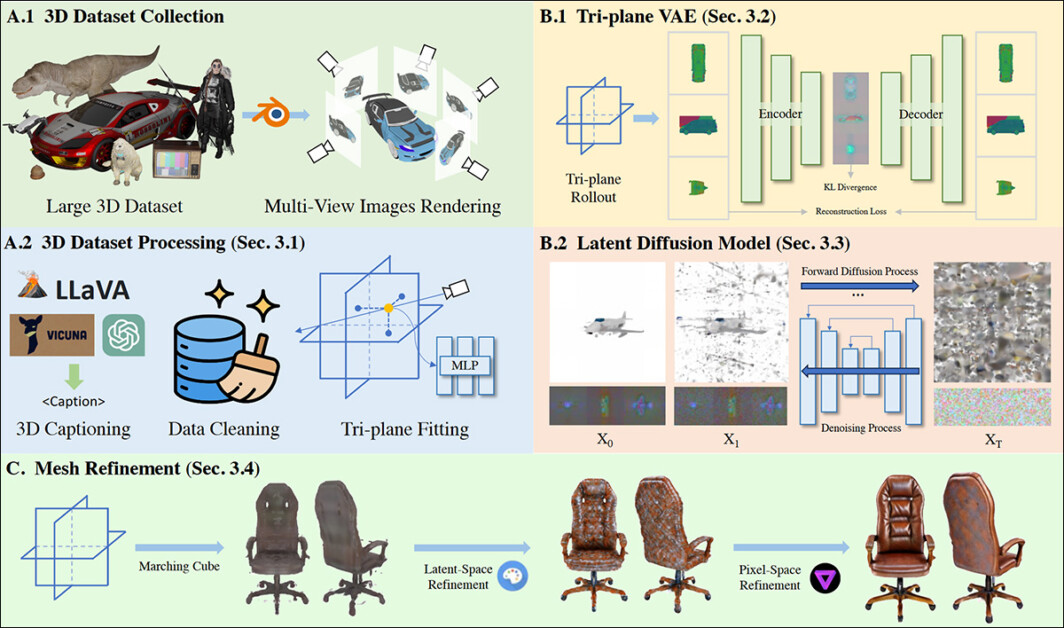

Ein anderer klarer Trend, der für mich erkennbar wurde, war ein großer Anstieg von Papieren, die die Nutzung von Latent-Diffusionsmodellen (LDMs) als Generatoren von meshbasierten, “traditionellen” CGI-Modellen beinhalten.

Projekte dieser Art umfassen Tencents InstantMesh3D, 3Dtopia, Diffusion2, V3D, MVEdit und GIMDiffusion, unter einer Vielzahl von ähnlichen Angeboten.

Mesh-Erzeugung und -Verfeinerung über einen Diffusions-basierten Prozess in 3Dtopia. Quelle: https://arxiv.org/pdf/2403.02234

Dieser aufkommende Forschungsstrang könnte als stillschweigende Anerkennung der anhaltenden Unüberwindlichkeit von generativen Systemen wie Diffusionsmodellen angesehen werden, die nur zwei Jahre zuvor als potenzieller Ersatz für alle Systeme, die Diffusion>Mesh-Modelle nun zu bevölkern suchen, gehandelt wurden; die Diffusion auf die Rolle eines Werkzeugs in Technologien und Workflows zurückführend, die seit über 30 Jahren existieren.

Stability.ai, der Ursprung des Open-Source-Stable-Diffusion-Modells, hat gerade Stable Zero123 veröffentlicht, das unter anderem eine Neural-Radiance-Fields (NeRF)-Interpretation eines von KI generierten Bildes als Brücke zur Erstellung eines expliziten, meshbasierten CGI-Modells verwenden kann, das in CGI-Arenen wie Unity, in Videospielen, erweiterter Realität und in anderen Plattformen verwendet werden kann, die explizite 3D-Koordinaten erfordern, im Gegensatz zu den impliziten (versteckten) Koordinaten von kontinuierlichen Funktionen.

Klicken Sie, um abzuspielen. Bilder, die in Stable Diffusion generiert werden, können in rationale CGI-Netze umgewandelt werden. Hier sehen wir das Ergebnis eines Bild->CGI-Workflows mit Stable Zero 123. Quelle: https://www.youtube.com/watch?v=RxsssDD48Xc

3D-Semantik

Der generative KI-Bereich unterscheidet zwischen 2D- und 3D-Systemimplementierungen von Vision und generativen Systemen. Zum Beispiel Facial-Landmarking-Frameworks, obwohl sie 3D-Objekte (Gesichter) in allen Fällen darstellen, berechnen nicht unbedingt adressierbare 3D-Koordinaten.

Das beliebte FANAlign-System, das weithin in 2017-Deepfake-Architekturen (und anderen) verwendet wird, kann sowohl diese Ansätze aufnehmen:

Oben werden 2D-Landmarken auf der Grundlage allein erkannter Gesichtsmerkmale und -linien erzeugt. Unten werden sie in 3D-X/Y/Z-Raum rationalisiert. Quelle: https://github.com/1adrianb/face-alignment

Also, genau wie “Deepfake” zu einem mehrdeutigen und entwendeten Begriff geworden ist, ist “3D” ebenfalls zu einem verwirrenden Begriff in der Computer-Vision-Forschung geworden.

Für Verbraucher hat es typischerweise stereo-fähige Medien (wie Filme, bei denen der Zuschauer spezielle Brillen tragen muss) bedeutet; für visuelle Effekt-Praktiker und Modelleure stellt es den Unterschied zwischen 2D-Kunst (wie Konzeptskizzen) und meshbasierten Modellen dar, die in einem “3D-Programm” wie Maya oder Cinema4D manipuliert werden können.

Aber in der Computer-Vision bedeutet es einfach, dass ein kartesisches Koordinatensystem irgendwo im latenten Raum des Modells existiert – nicht, dass es notwendigerweise von einem Benutzer adressiert oder direkt manipuliert werden kann; zumindest nicht ohne Drittanbieter-Interpretations-CGI-Systeme wie 3DMM oder FLAME.

Daher ist die Vorstellung von Diffusion>3D ungenau; nicht nur kann jedes Bild (einschließlich eines echten Fotos) als Eingabe verwendet werden, um ein generatives CGI-Modell zu erzeugen, sondern der weniger mehrdeutige Begriff “Mesh” ist angemessener.

Allerdings wird die Mehrdeutigkeit dadurch verschlimmert, dass Diffusion benötigt wird, um das Quellfoto in ein Mesh umzuwandeln, in der Mehrheit der aufkommenden Projekte. Eine bessere Beschreibung könnte Bild-zu-Mesh sein, während Bild>Diffusion>Mesh eine noch genauere Beschreibung ist.

Aber das ist ein harter Verkauf in einem Vorstandsmeeting oder in einer Pressemitteilung, die darauf abzielt, Investoren zu gewinnen.

Beweise für architektonische Sackgassen

Selbst im Vergleich zu 2023 zeigt die letzte Jahre Papiere eine wachsende Verzweiflung bei der Beseitigung der harten praktischen Grenzen der diffusionsbasierten Generierung.

Das wichtigste Hindernis bleibt die Erzeugung von narrativ und zeitlich konsistenten Videos und die Aufrechterhaltung eines konsistenten Aussehens von Charakteren und Objekten – nicht nur über verschiedene Video-Clips hinweg, sondern auch über die kurze Laufzeit eines einzigen generierten Video-Clips.

Die letzte epochale Innovation in der diffusionsbasierten Synthese war die Einführung von LoRA im Jahr 2022. Während neuere Systeme wie Flux einige der Outlier-Probleme verbessert haben, wie die frühere Unfähigkeit von Stable Diffusion, Textinhalte in einem generierten Bild wiederzugeben, und die allgemeine Bildqualität verbessert wurde, waren die meisten Papiere, die ich 2024 studierte, im Wesentlichen nur das Essen auf dem Teller neu anordnend.

Diese Sackgassen sind bereits zuvor aufgetreten, mit Generative Adversarial Networks (GANs) und mit Neural Radiance Fields (NeRF), die beide nicht ihren anfänglichen Anschein erfüllt haben – und beide, die zunehmend in konventionelleren Systemen eingesetzt werden (wie die Verwendung von NeRF in Stable Zero 123, siehe oben). Dies scheint auch mit Diffusionsmodellen zu passieren.

Gaussian-Splatting-Forschung ändert die Richtung

Es schien Ende 2023, als ob die Rasterisierungsmethode 3D-Gaussian-Splatting (3DGS), die als medizinische Bildgebungs-Technik in den frühen 1990er Jahren debütierte, plötzlich die autoencoder-basierten Systeme der menschlichen Bildsynthese-Herausforderungen (wie Gesichtssimulation und -rekonstruktion sowie Identitätsübertragung) überholen würde.

Das ASH-Papier von 2023 versprach vollständige 3DGS-Menschen, während Gaussian-Avatars eine massiv verbesserte Detailgenauigkeit (im Vergleich zu Autoencoder- und anderen konkurrierenden Methoden) boten, zusammen mit beeindruckender Cross-Reenactment.

In diesem Jahr jedoch war die Anzahl der Durchbrüche in der 3DGS-Menschsynthese relativ gering; die meisten Papiere, die sich mit diesem Problem befassten, waren entweder abgeleitet von den oben genannten Arbeiten oder konnten ihre Fähigkeiten nicht übertreffen.

Stattdessen lag der Schwerpunkt auf 3DGS auf der Verbesserung ihrer grundlegenden architektonischen Machbarkeit, was zu einer Reihe von Papieren führte, die verbesserte 3DGS-Außenumgebungen anbieten. Besondere Aufmerksamkeit wurde der Simultaneous Localization and Mapping (SLAM) 3DGS-Ansätzen gewidmet, in Projekten wie Gaussian Splatting SLAM, Splat-SLAM, Gaussian-SLAM, DROID-Splat, unter vielen anderen.

Diese Projekte, die die menschliche Bildsynthese fortsetzten oder erweiterten, umfassten MIGS, GEM, EVA, OccFusion, FAGhead, HumanSplat, GGHead, HGM und Topo4D. Obwohl es noch andere gibt, konnten none dieser Arbeiten den anfänglichen Einfluss der Papiere, die Ende 2023 erschienen, erreichen.

Die “Weinstein-Ära” der Testproben ist im (langsamen) Niedergang

Forschung aus Südostasien im Allgemeinen (und China im Besonderen) enthält oft Testbeispiele, die problematisch sind, um sie in einer Übersichtsarbeit zu veröffentlichen, da sie Material enthalten, das ein bisschen “scharf” ist.

Ob dies daran liegt, dass Forscher in diesem Teil der Welt versuchen, Aufmerksamkeit für ihre Arbeit zu erregen, ist unklar; aber in den letzten 18 Monaten haben eine zunehmende Anzahl von Papieren über generative KI (Bild- und/oder Video) auf young und leicht bekleidete Frauen und Mädchen in Projektbeispielen zurückgegriffen. Grenzwertige NSFW-Beispiele dafür sind UniAnimate, ControlNext und sogar sehr “trockene” Papiere wie Evaluating Motion Consistency by Fréchet Video Motion Distance (FVMD).

Dies folgt den allgemeinen Trends von Subreddits und anderen Communities, die sich um Latent-Diffusionsmodelle (LDMs) gesammelt haben, wo Rule 34 immer noch sehr präsent ist.

Celebrity-Face-Off

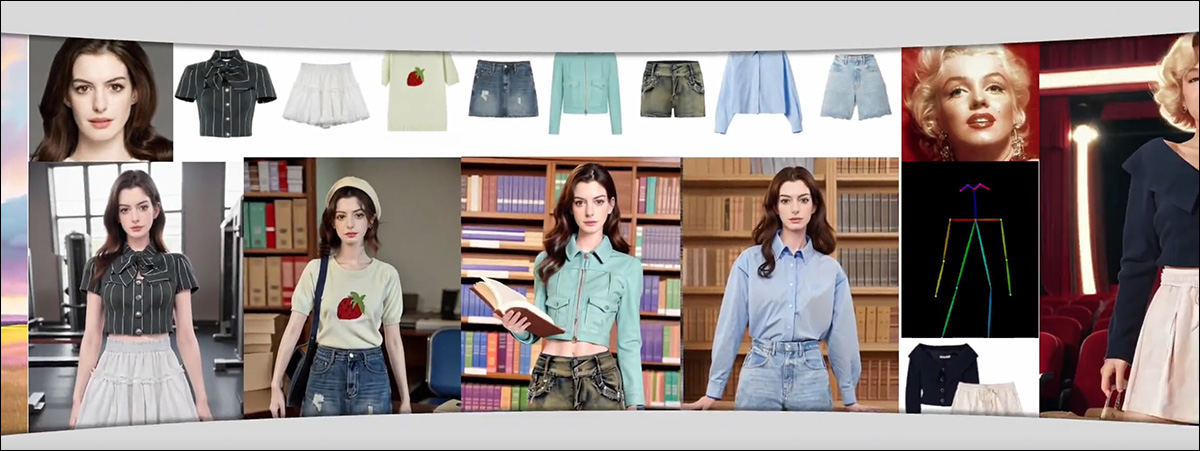

Diese Art von unangemessenen Beispielen überschneidet sich mit der wachsenden Erkenntnis, dass KI-Prozesse nicht willkürlich Prominenten-Ähnlichkeiten ausbeuten sollten – insbesondere in Studien, die unkritisch Beispiele verwenden, die attraktive Prominente, oft weiblich, darstellen und sie in fragwürdigen Kontexten platzieren.

Ein Beispiel ist AnyDressing, das neben sehr jungen, anime-ähnlichen weiblichen Charakteren auch die Identitäten von Klassik-Prominenten wie Marilyn Monroe und aktuellen wie Ann Hathaway (die diese Art von Nutzung sehr lautstark verurteilt hat) liberal verwendet.

Willkürliche Verwendung von aktuellen und “klassischen” Prominenten ist immer noch ziemlich häufig in Papieren aus Südostasien, obwohl diese Praxis langsam abnimmt. Quelle: https://crayon-shinchan.github.io/AnyDressing/

In westlichen Papieren ist diese spezifische Praxis im Laufe des Jahres 2024 deutlich im Rückgang begriffen, angeführt von den größeren Veröffentlichungen von FAANG und anderen hochrangigen Forschungseinrichtungen wie OpenAI. Kritisch bewusst für die potenzielle zukünftige Rechtsverfolgung, scheinen diese großen Konzerne zunehmend nicht bereit, auch nur fiktive photorealistische Menschen darzustellen.

Obwohl die Systeme, die sie entwickeln (wie Imagen und Veo2), offensichtlich in der Lage sind, solche Ausgaben zu erzeugen, tendieren die Beispiele von westlichen generativen KI-Projekten nun zu “süßen”, disneyfizierten und extrem “sicheren” Bildern und Videos.

Trotz der Ankündigung von Imagens Fähigkeit, “photorealistische” Ausgaben zu erzeugen, sind die von Google Research beworbenen Beispiele typischerweise fantastisch, “familienfreundlich” – photorealistische Menschen werden sorgfältig vermieden oder nur minimal bereitgestellt. Quelle: https://imagen.research.google/

Gesichtswäsche

In der westlichen CV-Literatur ist dieser unredliche Ansatz besonders deutlich bei Anpassungssystemen – Methoden, die in der Lage sind, konsistente Ähnlichkeiten einer bestimmten Person über mehrere Beispiele hinweg zu erzeugen (d. h. wie LoRA und die ältere DreamBooth).

Beispiele umfassen orthogonale visuelle Einbettung, LoRA-Composer, Google’s InstructBooth und viele mehr.

Google’s InstructBooth dreht den Süßigkeitsfaktor auf 11, obwohl die Geschichte nahelegt, dass Benutzer eher an der Erstellung von photorealistischen Menschen als an flauschigen oder pelzigen Charakteren interessiert sind. Quelle: https://sites.google.com/view/instructbooth

Die Leichtigkeit, mit der solche Systeme (wie LoRAs) von Heimanwendern mit relativ bescheidenem Hardware erstellt werden können, hat zu einer Explosion von frei verfügbaren Prominenten-Modellen auf dem civit.ai-Domain und in der Community geführt. Eine solche illegale Verwendung bleibt durch die Open-Sourcing von Architekturen wie Stable Diffusion und Flux möglich.

Obwohl es oft möglich ist, die Sicherheitsfunktionen von generativen Text-Bild- (T2I-) und Text-Video- (T2V-) Systemen zu umgehen, um Material zu erzeugen, das durch die Nutzungsbedingungen einer Plattform verboten ist, schließt sich die Lücke zwischen den eingeschränkten Fähigkeiten der besten Systeme (wie RunwayML und Sora) und den unbegrenzten Fähigkeiten der nur leistungsfähigen Systeme (wie Stable Video Diffusion, CogVideo und lokale Bereitstellungen von Hunyuan) nicht wirklich, wie viele glauben.

Vielmehr drohen diese proprietären und Open-Source-Systeme, gleichermaßen nutzlos zu werden: teure und hyperskalierbare T2V-Systeme könnten aufgrund von Befürchtungen vor Rechtsverfolgung übermäßig eingeschränkt werden, während der Mangel an Lizenzinfrastruktur und Datenüberwachung in Open-Source-Systemen sie möglicherweise vollständig vom Markt ausschließen könnte, wenn strengere Vorschriften in Kraft treten.

Erstveröffentlicht am Dienstag, 24. Dezember 2024