网络安全

为什么对抗性图像攻击不是笑话

利用精心设计的对抗性图像攻击图像识别系统已经被认为是在过去五年中一个有趣但微不足道的概念验证。然而,来自澳大利亚的新研究表明,商业人工智能项目中对流行图像数据集的随意使用可能会产生一个持久的新安全问题。

这两年来,阿德莱德大学的一组学者一直试图解释关于人工智能图像识别系统未来的一件非常重要的事情。

这是一个现在很难(且非常昂贵)解决的问题,而且一旦图像识别研究的当前趋势在5-10年内完全开发成商业化和工业化的部署,将会非常昂贵地解决。

在我们深入探讨之前,让我们来看看一朵花被分类为巴拉克·奥巴马总统的例子,这是该团队在项目页面上发布的六个视频之一:

来源:https://www.youtube.com/watch?v=Klepca1Ny3c

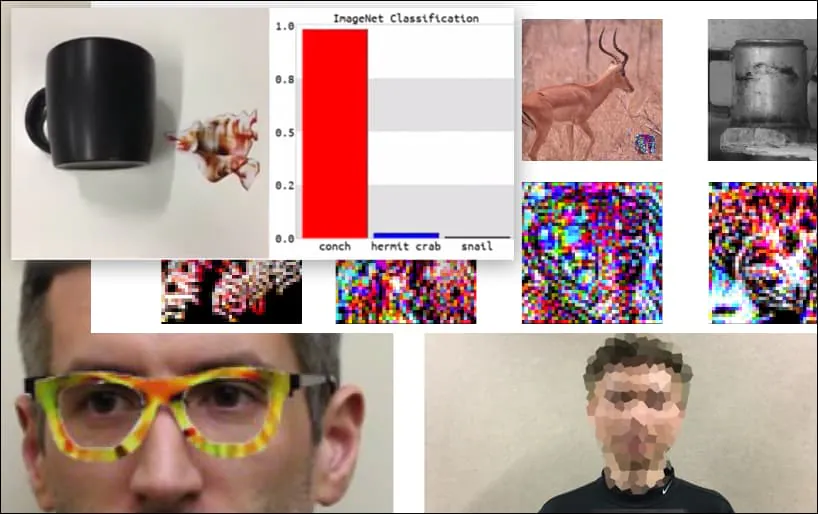

在上面的图像中,一个面部识别系统明显知道如何识别巴拉克·奥巴马,但被欺骗成80%的把握认为一个匿名人士拿着一张精心制作的、打印的对抗性图像的花也是巴拉克·奥巴马。该系统甚至不在乎“假面”在对象的胸部,而不是在他的肩膀上。

虽然研究人员能够通过生成一个连贯的图像(一朵花)而不是通常的随机噪音来实现这种身份捕获,这似乎是一件令人印象深刻的事情,但这种愚蠢的利用似乎在计算机视觉的安全研究中经常出现。例如,2016年那些奇怪的图案眼镜,可以欺骗面部识别,或专门设计的对抗性图像,可以尝试重写路标。

如果您感兴趣,正在被攻击的卷积神经网络(CNN)模型是VGGFace(VGG-16),它是在哥伦比亚大学的PubFig数据集上训练的。研究人员开发的其他攻击样本使用了不同的资源和组合。

键盘被重新分类为海螺,在WideResNet50模型上的ImageNet中。研究人员还确保模型没有偏向海螺。请访问https://www.youtube.com/watch?v=dhTTjjrxIcU查看完整视频和更多演示

图像识别作为新兴攻击向量

研究人员概述和说明的众多攻击并不是针对特定数据集或使用它们的特定机器学习架构的批评。它们也不能通过切换数据集或模型、重新训练模型或其他“简单”的补救措施来轻松防御,这些措施使得机器学习从业者嘲笑这种偶发性的恶作剧。

相反,阿德莱德团队的利用说明了当前图像识别人工智能开发的整个架构中的一个中心弱点;一个可能使许多未来图像识别系统容易受到攻击者的操纵,并使任何随后的防御措施处于被动地位的弱点。

想象一下最新的对抗性攻击图像(例如上面的花朵)被添加为“零日漏洞”到未来的安全系统中,就像当前的反恶意软件和防病毒框架每天更新其病毒定义一样。

新型对抗性图像攻击的可能性将是无穷无尽的,因为系统的基础架构没有预料到下游的问题,就像互联网、千年虫和比萨斜塔一样。

那么,我们又是如何为这一切做准备的?

获取攻击数据

像上面“花朵”示例这样的对抗性图像是通过访问训练计算机模型的图像数据集来生成的。你不需要“特权”访问训练数据(或模型架构),因为最流行的数据集(和许多训练模型)在一个强大的和不断更新的torrent场景中广泛可用。

例如,计算机视觉数据集的庞然大物ImageNet,在torrent中可用,绕过了其通常的限制,并提供了重要的次要元素,例如验证集。

来源:https://academictorrents.com

如果您拥有数据,则可以(如阿德莱德研究人员观察到的)有效地“逆向工程”任何流行的数据集,例如CityScapes或CIFAR。

在PubFig数据集的例子中,该数据集使得“奥巴马花”示例成为可能,哥伦比亚大学已经解决了图像数据集再分发的版权问题的日益增长的趋势,通过指导研究人员如何重现数据集,方法是通过策划的链接,而不是直接提供编译,观察到“这似乎是其他大型基于Web的数据库正在发展的方式”。

在大多数情况下,这是没有必要的:Kaggle估计,计算机视觉中最受欢迎的十个图像数据集是:CIFAR-10和CIFAR-100(两个可直接下载);CALTECH-101和256(两个可用,并且目前可作为torrent);MNIST(官方可用,也在torrent中);ImageNet(见上文);Pascal VOC(可用,也在torrent中);MS COCO(可用,也在torrent中);Sports-1M(可用);和YouTube-8M(可用)。

这种可用性也代表了更广泛的计算机视觉图像数据集,因为在“发表或灭亡”的开源开发文化中,晦涩难懂就是死亡。

无论如何,这个问题的加剧是由于以下几个因素:可管理的新数据集的稀缺性,图像集开发的高成本,对“老套”的依赖,以及倾向于简单地适应旧的数据集。

对抗性图像攻击方法的典型批评

机器学习工程师对最新对抗性图像攻击技术有效性的最频繁和最持久的批评是,该攻击是特定于特定的数据集、特定的模型或两者;它不能“推广”到其他系统;因此,它只代表着一个微不足道的威胁。

第二个最常见的抱怨是,对抗性图像攻击是“白盒”,这意味着您需要直接访问训练环境或数据。这确实是在大多数情况下不太可能的场景——例如,如果您想利用伦敦大都会警察的面部识别系统的训练过程,您需要侵入NEC,无论是通过控制台还是斧头。

流行计算机视觉数据集的长期“DNA”

关于第一个批评,我们应该考虑到,不仅仅是计算机视觉数据集中只有一小部分主导了行业的各个部门,每年(即ImageNet用于多种类型的对象,CityScapes用于驾驶场景,和FFHQ用于面部识别);还应该考虑到,它们是简单的注释图像数据,因此是“平台无关”和高度可转移的。

根据其功能,任何计算机视觉训练架构都将在ImageNet数据集中找到某些对象和类的一些特征。一些架构可能会找到比其他架构更多的特征,或者比其他架构建立更多有用的连接,但所有架构都应该找到至少最高级别的特征:

正是这些“高级”特征区分并“指纹”一个数据集,并且是可靠的“钩子”,可以挂载一个长期的对抗性图像攻击方法,可以跨越不同的系统,并随着“旧”数据集的传播而增长,因为它在新的研究和产品中被传播。

一个更复杂的架构将产生更准确和更详细的识别、特征和类:

然而,对抗性攻击生成器越多地依赖于这些较低特征(例如“年轻的白人男性”而不是“面部”),它在跨越或以后架构中就越不有效,这些架构使用不同版本的原始数据集——例如一个子集或过滤集,在原始数据集中有很多图像不在其中:

对“零化”预训练模型的对抗性攻击

如果您只是下载一个预训练模型,该模型最初是在一个非常流行的数据集上训练的,然后给它完全新的数据会怎样?

该模型已经在(例如)ImageNet上训练过,现在只剩下权重,这些权重可能需要数周或数月的训练时间,现在已经准备好帮助您识别与原始(现在缺失的)数据中存在的对象类似的事物。

这些权重很有价值。没有数据或权重,您基本上只有一个空架构,没有数据。您将不得不从头开始训练它,这将花费大量时间和计算资源,就像原始作者一样(可能是在比您更有能力的硬件和更大的预算上)。

问题是权重已经相当成熟且具有弹性。虽然它们在训练中会有所适应,但它们将像在原始数据上一样在您的新数据上表现,产生特征和类,这些特征和类可以被对抗性攻击系统所利用。

从长远来看,这也保留了十二年或更久的计算机视觉数据集的“DNA”,这些数据集可能已经通过开源工作和商业化部署经历了显著的演变——即使原始训练数据在项目开始时已经完全丢弃。其中一些商业化部署可能不会在几年内发生。

无需白盒

关于第二个常见批评,对抗性图像攻击系统,新论文的作者发现,他们用精心制作的图像(例如花朵)欺骗识别系统的能力在多个架构中是高度可转移的。

虽然观察到他们的“通用自然对抗补丁”(TnT)方法是第一个使用可识别的图像(而不是随机扰动噪声)来欺骗图像识别系统的,但作者们也指出:

“[TnTs]对多个最先进的分类器都有效,包括在ImageNet数据集的大规模视觉识别任务中使用的WideResNet50,以及在PubFig数据集的面部识别任务中使用的VGG-face模型,在目标和非目标攻击中。”

“TnTs可以具备:i)与特洛伊攻击方法中使用的触发器相同的自然主义;ii)对其他网络的通用性和可转移性。”

“这引发了人们对已经部署的DNN和未来DNN部署的安全和安全问题的担忧,在那里攻击者可以使用不显眼的自然外观的物体补丁来误导神经网络系统,而无需篡改模型并冒着被发现的风险。”

作者建议,传统的对抗措施,例如降低网络的清洁准确率,可能会在理论上提供一些对TnT补丁的防御,但“TnTs仍然可以成功绕过这种SOTA可证明的防御方法,大多数防御系统都能达到0%的鲁棒性”。

可能的其他解决方案包括联邦学习,在那里贡献图像的来源受到保护,以及可以直接在训练时“加密”数据的新方法,例如南京航空航天大学最近提出的一个。

即使在那些情况下,训练真正新图像数据也很重要——现在,计算机视觉中最流行的数据集的图像和相关注释已经如此深深地嵌入在世界各地的开发周期中,以至于它们更像软件,而不是数据;这些软件通常在几年内没有显著更新。

结论

对抗性图像攻击不仅是由开源机器学习实践使可能,也是由企业人工智能开发文化使可能的,这种文化出于以下几个原因倾向于重用成熟的计算机视觉数据集:它们已经被证明是有效的;它们比从头开始更便宜;它们由学术界和行业的先驱思想和组织维护和更新,这些组织拥有大量资金和人员,这些资源对于单个公司来说是难以复制的。

此外,在许多情况下,数据不是原始的(与CityScapes不同),图像是在最近的隐私和数据收集实践争议之前收集的,这使得这些旧数据集处于一种可能看起来像公司“安全港”的半合法状态。

TnT攻击!通用自然对抗补丁对抗深度神经网络系统由阿德莱德大学的Bao Gia Doan、Minhui Xue、Ehsan Abbasnejad、Damith C. Ranasinghe以及鲁特格斯大学计算机科学系的Shiqing Ma共同撰写。

更新于2021年12月1日,7:06 GMT + 2 – 更正了一个拼写错误。