Anderson 视角

虚拟试穿新衣服通过 AI

一种 AI 模型现在可以将单张照片和服装图像转换为一个人穿着新服装的移动视频,避免了旧的两步系统中常见的故障。

虚拟试穿(VTON)类别是在计算机视觉研究中最有资金支持和最丰富的追求之一——主要是因为,可以从每年发布的频繁的行业/学术合作中看出,这个目标得到了时尚行业的重金支持:

从论文“Image-Based Virtual Try-On: A Survey”中,展示了人体表示类型的例子,以及即使是基本图像也必须经过的虚拟试穿(VTON)的某些过滤和精炼阶段。来源 –

有很多变体的目标,例如 从人体图像中提取服装,和 容纳更丰满的身材。一些基于图像的系统已经在商业上实施,例如 veesual.ai、wanna.fashion 和 fashn.ai。

对于视频,Google Labs 的实验性 Doppl 应用 尝试了这种功能,于 去年夏天 发布:

请点击播放如果视频不自动播放。来自废弃的 Google Doppl 视频试穿项目的片段。 来源

然而,Doppl 在 2026 年 4 月关闭,收到了 冷淡的反应,现在将用户引导至公司的图像仅试穿服务 †:

Google 的图像仅试穿程序,从公司的废弃 Doppl 平台引导用户。来源 –

虽然有一些平台提供虚拟试穿视频,但似乎没有一个与实际的商店有关;它们都是“边缘”和“可疑”的产品。

虽然研究领域有很多有趣的尝试,但它们传统上是复杂的架构,难以实现低延迟和高质量:

请点击播放如果视频不自动播放。来自 2024 年 Fashion-VDM 项目的“头部”服装转移示例。 来源

事实是,服装适应真实人体的任务而不扭曲服装或人体,同时保持某种有用的演示动作(它 准确地 显示产品的背面,当人转身时),是当前技术的重大挑战。

Vanast

这是一个来自韩国的新论文尝试解决这个挑战,使用一个新颖的和完全集成的解决方案来解析服装 + 人体 + 动作:

请点击播放如果视频不自动播放。来自 Vanast 项目的补充材料网站的示例。 来源

新系统,称为 Vanast,利用一个自定义数据集,包含三个必要因素的整合和编排:服装;人体;和动作:

点击播放。 来自 Vanast 项目网站的更多示例。

系统利用了多种框架,例如 Flux、Qwen 和 ChatGPT,来生成一个“三元组”数据集,能够告知端到端的架构:

从新论文中,生成和训练使用的数据点示例。来源 –

新论文的标题是 Vanast: Virtual Try-On with Human Image Animation via Synthetic Triplet Supervision,来自首尔国立大学的四位研究人员。还有一个视频丰富的 项目网站。

方法

作者在这项工作中的明确目标是将三个上述方面整合到一个单阶段框架中——不仅因为这个过程是离散的,而且因为它给了各种方面更多机会在训练期间交织和相互作用,以期实现更具凝聚力的生成:

Vanast 结合单个人照片、独立的服装图像和运动参考视频,生成一个移动序列,其中同一个人穿着新服装,姿势指导确保一致的运动,同时在帧之间保留身份和服装细节。

为了实现这一点,系统需要服装项目的图像;一个人穿着不同服装的照片;一个定义人体应该如何移动的运动参考视频;和一个描述动作和设置的文本提示;并生成一个完整的视频序列,其中同一个人似乎穿着新服装,同时遵循施加的运动,帧之间保持视觉一致性。

与将穿衣和动画分成不同的阶段(这是大多数类似先前工作的方法)不同,Vanast 在单个过程中同时处理服装、身份和运动,允许这些元素在生成期间相互作用,减少了早期方法中出现的不匹配和不稳定。

数据集

该项目的训练基于一对一的人体图像、对应的服装项目和一个人穿着这些服装移动的视频,使用 以前的架构 提取运动,以提供稳定的姿势指导。

由于没有公开可用的数据集满足项目的要求,因此从(未指定)在线购物平台中收集了数据,提供了一个具有多样化服装的视频缓存。然而,任务需要一个人 穿着多套服装 的视频,这在野外数据中很少见,这就需要创建 合成数据。

三个阶段的过程包括从视频中选择合适的候选帧,通过 Qwen2.5-VL 视觉语言模型(VLM)处理,并评估其适用性(即无遮挡,主题在正确位置等);并创建适当的 修复 掩码来隔离受影响的区域——这(按照以前的工作 PERSE)是由现在非常流行的 SDXL 扩散模型处理的。

Vanast 流水线的概述,其中人体图像、目标服装图像和运动指导视频被编码和处理在一个统一的视频扩散模型中。系统生成一个动画,保留身份,遵循姿势序列,并应用目标服装,同时合成三元组生成支持训练,并且双模块设计将动画与服装转移分开,以保持一致性。

在第三阶段,Qwen 再次执行任务,以根据性别对图像进行分类,并且流行的 Flux 图像扩散框架随后被用于创建图像中服装的修改(因为 Flux 能够合并多个输入元素)。修复文本提示由 ChatGPT(版本未指定)策划。

为了进一步增加姿势和背景的多样性,引入了一个管道来从野外视频中构建训练三元组,使用 HumanVid 数据集。相同的过程被用于生成保留身份的人体图像。

由于这些视频中没有独立的服装图像,因此直接从视频中合成服装图像。从每个视频中采样帧,并使用 Qwen 来评分它们的正面可见性,然后根据全身可见性、图像清晰度、最小遮挡、照明质量和整体构图选择最合适的候选帧。

然后使用 SegFormer 提取上衣区域,并移除背景以隔离服装。

为了避免 位置偏差,服装区域在其边界框内随机移动,并且 Qwen 再次被用于过滤掉不可靠的分割。这一过程产生了合成的服装图像,配对了运动和身份,允许从非结构化的视频数据中大规模构建三元组,同时提高了在各种现实世界条件下的稳健性。

架构

引入了一个双模块架构来解决那些试图融合所有条件的先前方法中看到的缓慢 收敛 和弱控制平衡的问题。该方法利用了 Wan 的文本到视频扩散变换器,并且还借鉴了 VACE 项目(见下文)。

模型被分成一个 人体动画模块(HAM),处理来自人体和姿势输入的运动和身份;和一个 服装转移模块(GTM),处理来自服装图像的服装。两者共享对主干的访问,同时以分布式、级联的方式集成特征,以提高条件。

训练是通过 冻结 主干并仅优化 HAM 和 GTM 参数来完成的,并且在特征集成期间平衡了它们的贡献。来自合成三元组数据集的输入被转换为 潜在表示,使用 WAN 的变分自编码器(VAE)。

运动感知上下文是通过组合人体和姿势信息来构建的,而服装特征则被单独处理,并通过投影到令牌嵌入中对齐。

模型还被扩展以支持 服装插值。在这里,两个服装的表示被组合以生成平滑的过渡,允许在不需要额外优化的情况下在服装项目之间进行一致和连贯的混合。

数据和测试

模型在 9,135 个视频上进行了训练,长度从三到十秒不等,来源于上述“购物中心网站”;作者自己的生成数据集;和 HumanVid 数据集。

从这些中,建立了两个评估数据集:“互联网数据集”,包含来自商场的视频和产品图像;和阿里巴巴的 ViViD 数据集的官方 测试拆分。

由于 ViViD 数据缺少面部(见上面的视频示例,这在虚拟试穿文献中非常常见),因此通过 Flux 出画 添加了面部。

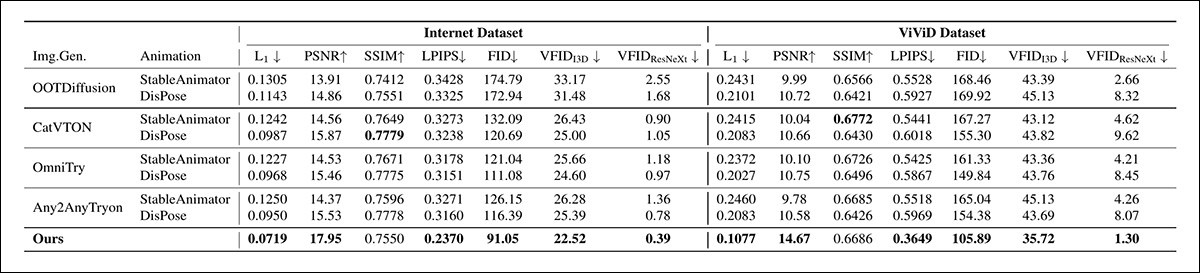

使用的指标是 L1 损失;峰值信噪比(PSNR);结构相似性指数(SSIM);学习的感知图像补丁相似性(LPIPS);弗雷歇特感知距离(FID);和 弗雷歇特视频距离††(FVD)

测试的服装转移系统包括 OOTDiffusion;CatVTON;OmniTry;和 Any2AnyTryon。测试的主体到图像生成模型包括 VisualCloze;MOSAIC;和 ByteDance 的 UNO。

对于第二阶段的人体图像动画,StableAnimator 和 DisPose 框架被使用。

在一个更有限的背景下(因为它不直接支持目标),VACE 也被测试了,并且有一些努力来平衡缺失的功能:

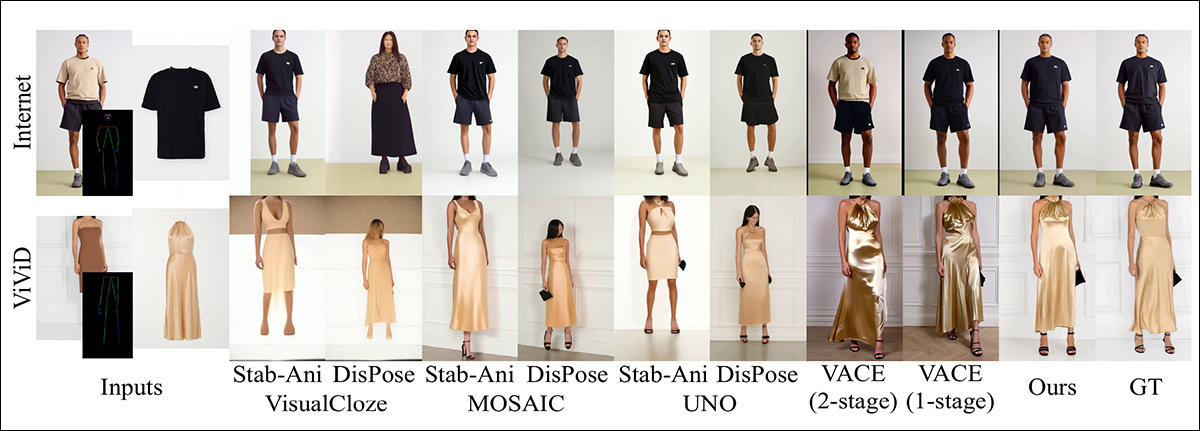

在互联网和 ViViD 数据集上,使用主体到图像和动画模型的组合进行的量化比较,其中提出的方法在所有报告的指标中实现了最佳性能。粗体值表示每列的最高分。

作者指出:

“[我们的] 模型在所有指标中实现了与主体到图像生成模型和动画模型的组合相比的最佳性能。 ”

“进一步的定性结果 [如下所示] 确认了我们的方法产生了最准确的姿势跟踪和服装转移,同时比所有基于主体到图像的基线更忠实地保留了身份。 ”

在互联网和 ViViD 数据集上,与主体到图像和动画基线的定性比较,其中作者声称,提出的方法提供了更准确的姿势对齐和服装转移,同时比 VisualCloze、MOSAIC、UNO 和 VACE 更一致地保留了身份。

对于第二类测试,测试了图像虚拟试穿和动画模型的组合,新工作再次实现了最高分:

在互联网和 ViViD 数据集上,与图像基于虚拟试穿和动画模型的组合进行的量化比较,其中提出的方法在所有指标中实现了最佳的整体性能,SSIM 仍然与最强的基线相似。粗体值表示最高分。

作者补充说:

“定性比较 [如下所示] 表明我们的结果在所有图像虚拟试穿基线中最接近真实值。 ”

使用由 VTON 模型和动画模型组合而成的基线进行的定性测试。

结论

尽管 Vanast 项目实现了一个离散的端到端解决方案,但论文中关于训练和推理资源要求的缺乏细节表明,这可能不是最敏捷或最灵活的解决方案。事实上,挑战本身即使在非优化系统中也极其困难——更不用说在需要低延迟和可扩展性/投资回报率的商业部署中。

虚拟试穿是人工智能“月球任务”目标之一,在这种情况下,当前的最先进技术状态,如通过各种标题和精心挑选的结果所体现的那样,掩盖了任务的实际困难,这可能最终会通过比变换器更晚、更轻的技术来解决。

† 仅在美国提供,许多其他地区被地理阻塞,如果不是全部。

†† 作者指的是“VFID”,但仅链接到 ViViD 论文,这在我看来没有理由,因为我有有限的时间来跟踪它。 我假设他们实际上是指弗雷歇特视频距离(FVD),并且也没有足够的时间。 请联系我进行必要的更正。

首次发布于 2026 年 4 月 8 日星期三