人工智能

Amazon Mechanical Turk 的缺陷可能威胁自然语言生成系统

马萨诸塞大学阿默斯特分校的一项新研究将英语教师与Amazon Mechanical Turk上的众包工人对自然语言生成(NLG)系统的输出进行了比较,得出结论,AMT工人中的宽松标准和“游戏化”任务可能阻碍了该领域的发展。

该报告对AMT的工业规模的廉价外包对开放式NLG评估任务可能导致该领域的次优结果和算法得出了一系列批评的结论。

研究人员还编制了一份45篇关于开放式文本生成的论文清单,这些论文使用了AMT,并发现“绝大多数”论文没有报告使用亚马逊众包服务的关键细节,使得难以复制这些论文的发现。

血汗工厂劳动

该报告批评了亚马逊Mechanical Turk的血汗工厂性质,以及(可能受预算限制的)学术项目通过使用(和引用)AMT作为有效和一致的研究资源而给AMT增加了可信度。作者指出:

‘虽然AMT是一个方便且廉价的解决方案,但我们观察到,工人之间的高方差、糟糕的校准和认知要求高的任务可能导致研究人员得出误导性的科学结论(例如,人类撰写的文本“更差”于GPT-2的)。’

该报告责怪游戏而不是玩家,研究人员观察到:

‘[众包]工人经常被低薪,这不仅损害了研究的质量,也损害了这些众包工人赚取足够生活费的能力。’

该论文,题为使用Mechanical Turk评估开放式文本生成的危险,进一步得出结论,应该使用“专家评估者”(如语言教师和语言学家)来评估开放式人工NLG内容,即使AMT更便宜。

测试任务

在比较AMT的性能与更不受时间限制的专家读者时,研究人员花费了144美元用于实际用于比较测试的AMT服务(尽管更多的钱被花在了“不可用的”结果上——见下文),要求随机的“土耳其人”评估200个文本中的一个,分为人类创建的文本内容和人工生成的文本。

让专业教师完成同样的工作花费了187.50美元,并通过雇用Upwork自由职业者复制任务来确认他们的优异表现(与AMT工人相比),额外花费了262.50美元。

每个任务由四个评估标准组成:语法(‘故事片段的文本语法正确性如何?’);连贯性(‘故事片段中的句子如何融合在一起?’);可喜欢性(‘你觉得故事片段有多么可享受?’);相关性(‘故事片段与提示有多相关?’)。

生成文本

为了获得NLG材料用于测试,研究人员使用了Facebook AI Research的2018年分层神经故事生成数据集,该数据集由303,358个英语故事组成,这些故事由非常受欢迎的(1500万+用户)r/writingprompts子版块的用户撰写,这些故事是由单句“提示”“种子”的,类似于当前的文本到图像生成实践——当然,还有开放式自然语言生成系统。

从数据集中随机选择了200个提示,并通过使用Hugging-Face Transformers 库的中等大小的GPT-2模型传递。因此,从相同的提示中获得了两组结果:Reddit用户撰写的讨论性文章和GPT-2生成的文本。

为了防止同一AMT工人多次判断同一个故事,研究人员每个示例都征求了三个AMT工人的判断。与实验有关的英语语言能力(见文章末尾)以及不包括低努力工人的结果(见下面的“短时间”),这增加了在AMT上总共花费的金额,约为1,500美元。

为了创造一个公平的竞争环境,所有测试都在周一至周五的上午11:00-11:30(太平洋标准时间)进行。

结果和结论

该研究涵盖了很多领域,但关键点是:

短时间

该论文发现,亚马逊报告的平均任务时间为360秒,但实际工作时间仅为22秒,中位工作时间仅为13秒——即使是复制任务的最快英语老师也需要四倍的时间。

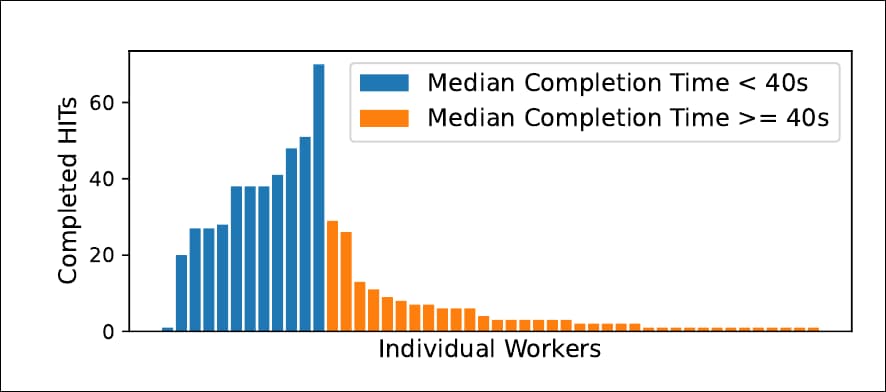

从研究的第二天开始:个别工人(橙色)花在每个任务上的时间明显少于更高薪的教师和(稍后)更高薪的Upwork承包商。 来源:https://arxiv.org/pdf/2109.06835.pdf

由于AMT不限制单个工人可以接受的Human Intelligence Tasks(HITs)数量,因此出现了AMT的“大佬”,他们以完成高数量的任务而闻名(在一个实验中),并以此来赚取利润。为了弥补同一工人接受的HITs,研究人员测量了连续提交的HITs之间的时间,比较每个HIT的开始和结束时间。这样,AMT报告的WorkTimeInSeconds与实际花在任务上的时间之间的差距就变得明显了。

由于这样的工作无法在这些缩短的时间框架内完成,研究人员不得不进行补偿:

‘由于不可能在短短13秒内仔细阅读一个段落长度的故事并评估所有四个属性,我们测量了过滤掉花费时间太少的工人对平均评分的影响…具体来说,我们删除了工人中位时间低于40秒(这是一个很低的标准)的判断,并发现大约42%的评分被过滤掉(在所有实验中范围从20%-72%)。’

该论文认为,AMT中实际工作时间的错误报告是一个主要问题,通常被使用AMT服务的研究人员忽略。

需要手把手指导

研究结果进一步表明,AMT工人无法可靠地区分人类撰写的文本和机器撰写的文本,除非他们同时看到两种文本,这将有效地破坏典型的评估场景(读者应该能够根据单个文本样本做出判断,“真实”或人工生成的)。

轻率接受低质量人工文本

AMT工人一致地将低质量的GPT基于人工文本评为与人类撰写的高质量、连贯文本一样,相比之下,英语教师很容易区分质量的差异。

无准备时间,无背景

进入正确的心态以评估真实性这样的抽象任务并不自然;英语教师需要20个任务来使他们的感知适应评估环境,而AMT工人通常根本没有“定向时间”,从而降低了他们的输入质量。

游戏系统

该报告声称,AMT工人在单个任务上花费的总时间被同时接受多个任务的工人所膨胀,这些工人在浏览器的不同标签页中运行任务,而不是专注于一个任务的记录时间。

国家来源很重要

AMT的默认设置不根据工人的国家来源进行筛选,该报告指出之前的工作,表明AMT工人使用VPN来绕过地理限制,使非英语母语者可以伪装成英语母语者(在一个将工人的母语与基于IP的地理位置等同的系统中)。

因此,研究人员重新运行了AMT的评估测试,并使用过滤器限制潜在的工人为非英语国家,发现“非英语国家的工人评估连贯性、相关性和语法…低于同样合格的英语国家的工人”。

该报告得出结论:

‘[专家]评估者,如语言学家或语言教师,应该在可能的情况下使用,因为他们已经接受了评估书面文本的培训,而且这并不贵…’

发布于2021年9月16日 – 更新于2021年12月18日:添加标签