Anderson 视角

AI 模型更偏爱人类写作而非 AI 生成的写作

根据新的研究,ChatGPT 和类似的模型现在明显偏向于它们认为是由人类撰写的文本,即使这种信念是错误的。仅仅称文本为“人造”的标签就能让 AI 模型偏向于它,并且,具有讽刺意味的是,它们可能是从我们身上学到了这种偏见。

真实性、来源和共享的人类经验可能在 AI 对创意写作领域的冲击中发挥着比目前为止显现的更大的作用:在普林斯顿进行的一项新研究中进行的测试发现,一系列主要的封闭和开源语言模型,包括 ChatGPT,都偏爱它们认为是“人生成”的文本。

即使写作样本的标签被反转,AI 模型和人类参与者仍继续批评 AI 写的文本,重复他们在正确标签时所做的相同批评。

研究人员认为,部分原因可能是人类对生成性 AI 日益增长的敌意,这似乎每天都表现出新的和有趣的事件,可能正在反馈到 AI 系统本身中。注意到 AI 比人类更讨厌 AI 写作的程度,他们指出*:

‘我们测试的 13 个 AI 模型表现出 34.3 个百分点的偏见,与人类的 13.7 个百分点相比,使它们比我们的人类评估者更容易受到归属线索的影响 2.5 倍。

‘这种放大是有道理的,一旦我们认识到当代模型是通过强化学习从人类反馈(RLHF)进行偏好训练的评估器。这种训练明确地教导模型将人类判断作为它们的黄金标准,有效地安装了一个学习的可靠性先验。

‘模型学会了通过推断人类偏好来获得奖励,创造出一种拍马屁的行为,他们重复预期的用户态度,而不是提供独立的评估。

这些发现适用于创意写作领域,研究人员使用一位著名的法国作家的故事作为数据样本;它们表明,人类对 AI 的偏见可能最终超过大型语言模型(LLM)可以输出的语言构建的任何量化改进,并且“AI”标签可能正在成为“不真实的”、“替代的”和甚至“二等的”含义,在这个领域。

许多原因都集中在文化实践和使用上:这篇论文指出,创造力通常被描述为新颖性、价值和典型性,即看起来有多么“新鲜”;它被专家“欣赏”多少;以及它如何适应其类别。当一个段落被标记为人写的时,熟悉的流派特征被视为有价值;当被标记为AI 生成时,相同的特征被驳回为不原创的。

实际上,揭示来源会提示对作品价值的重新评估,这受到关于如何制作它的假设的影响。一旦 AI 作者身份被披露,读者就会本能地拒绝输出背后可能存在个体发现或意图的可能性。

这篇论文指出*:

‘在大多数艺术中,没有“足够创新的”黄金标准,使得来源线索成为强大的引导,可以改变哪个标准感觉最突出:纪律严明的工艺或显眼的新颖性,易用性或难度。

‘因为观察者经常从产品中推断出过程,来源线索不仅影响对某物的判断,还影响它是如何制作的:保守的举动可以被归功于人类的工艺,但被驳回为“仅仅是生成”的模型’。

十三个模型,包括 ChatGPT、Claude、Gemini 和 Mistral 的变体,参加了测试,所有模型都对故事进行了更为有利的评分,当被告知它们是人写的时,LLM 比人类表现出更大的偏见。

AI 模型可能吸收了对其自身输出的偏见的想法提出了关于这种偏见起源的问题。由于 AI 写作并不总是容易识别,任何在训练期间形成的负面关联可能源于明确标记的示例,无论是通过新闻报道还是主流出版物中的自我声明的 AI 生成文章。

这篇题为每个人都更喜欢人类作家,包括 AI的新论文来自普林斯顿大学数字人文中心的两位作者。这项工作伴随着一个相关的数据发布,位于 Zenodo(在论文中引用了一个 GitHub 发布,但在撰写本文时存储库不可用)。

方法

为了探索归属如何影响和形成人们对风格和创造力的看法,作者使用了风格练习,这是一部 1947 年的古怪作品,由雷蒙德·奎诺(Raymond Queneau)撰写,他用 99 种不同的风格重写了一个简单的轶事。这个故事讲述了一个男人登上一辆公交车,与另一个乘客争论,后来从一个朋友那里得到了时尚建议。

虽然它源自文学,但这种结构预示了现代语言模型中的提示式转换,在那里用户请求以特定的语气、声音或语体重写文本。这个过程曾经被称为跨风格化——一个现在在 AI 研究中以风格转移的背景下重现的框架。

从奎诺作品的流行英语译本中,选择了 30 个保留叙事同时涵盖广泛风格范围的练习。这些练习包括受限制的形式,如亚历山大体和唇语,语体转换,如高尚或辱骂,叙事转换,如倒退和犹豫,以及涉及匙倾、拟声和狗拉丁等的游戏性变形:

[…]

为了产生每个选定风格的 AI 作者对应物,研究人员使用了故意最小化的提示。每个模型都收到了奎诺轶事的最简单版本(开头的练习符号),以及一个简短的指令,要求以特定的风格重写它,例如将故事重写为科幻版本。这种方法允许提示反映奎诺原创转换的精神,同时仍允许模型自由解释风格。

双重视角

作者进行的第一个研究使用 GPT-4o 生成所有 30 个风格变体,因为当时它是最先进的模型。使用单个模型可以确保输出的一致性,有助于隔离归属标签的影响,这是研究旨在测试的。

输出没有编辑风格或语气,除了诸如这是重写的版本这样的框架残余。

在第二项研究中,生成过程在 13 个大型语言模型中重复:Qwen 2.5 72B Instruct、Mistral Nemo、Mistral Medium 3、Llama 4 Maverick、Llama 3.3 70B Instruct、Gemini 2.5 Flash、GPT-4o Mini、GPT-4o、GPT-3.5 Turbo Instruct、DeepSeek RI (0528)、DeepSeek Chat v3 (0324)、Cohere Command R (08-2024)、Claude Sonnet 4 和 Claude 3.5 Haiku。

每个模型都收到了相同的指令,并为每个选定的风格生成了自己的版本,总共生成了 420 个重写的故事。这使得研究人员能够测试归属效应是否在不同 AI 作者中保持一致,而不是与单个模型绑定。

数据和测试

研究人员向不同的人群展示了相同的故事对,但改变了标签,以查看作者名称对意见的影响程度:一组人看不到任何作者名称,只看到“A”和“B”标签。第二组人看到了正确的名称,其中一个版本被标记为“人写的”,另一个版本被标记为“GPT-4o”。

第三组人看到了标签被交换的版本,其中“AI”故事被标记为“人写的”,而“人写的”版本被标记为“AI”:

[…]

研究 1

研究人员将 30 个创建的风格分成较小的集合,每个研究参与者只看到五种风格,每种风格在所有三个标签设置下进行测试。

每位参与者只看到一种标签设置:盲组看不到任何关于 AI 的提及,而其他组看到正确或反转的作者标签。组分配、故事顺序和左右放置都被随机化。

AI 模型经过相同的过程,收到相同的风格和标签的混合,并且每次测试都重复三次,以确保结果的一致性,从而可以比较人类和 AI 对作者标签的反应。

第二项研究使用了与之前相同的三个标签设置,但扩大了测试范围,包括所有 420 个由前面提到的 14 个不同 LLM 模型生成的故事。每个模型在每个标签条件下评估每个故事,产生每个模型 1,260 个决策,总共 17,596 个有效评估:

[…]

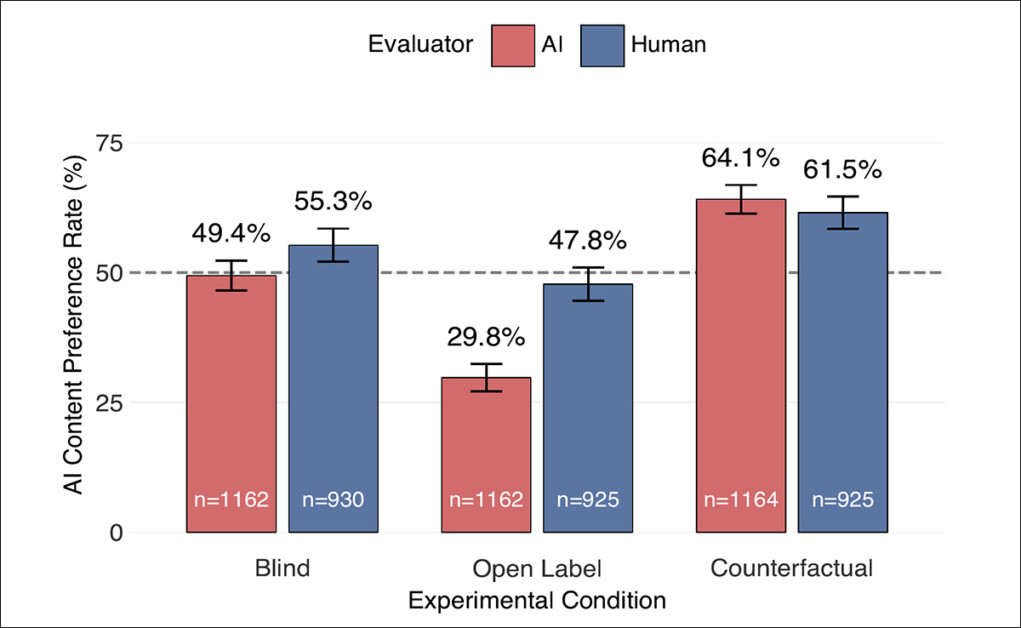

在所有 13 个模型中,模式都符合人类的偏见,但更为强烈:当没有标签时,AI 系统几乎均等地评估人写的和 AI 写的故事,选择 AI 文本的比例为 49.4%;当显示 AI 标签时,这种偏好大幅下降到 29.8%,显示出对承认的 AI 工作的明显贬值;当相同的文本被标记为人写的时,偏好上升到 64.1%。

标签条件之间的差异为 34.3%,这意味着 AI 模型在标签被交换时比人类更改变了它们的偏好。另外,模型在重复运行中表现出高度的一致性,证实偏见是稳定的,而不是随机的。

为了检查偏见是否是由标签的措辞而不是谁写的文本引起的,研究人员进行了两个额外的测试:一个使用使 AI 听起来更令人印象深刻的标签,另一个使用中立术语,如“AI 作者”和“人作者”。

两者仍然显示出相同的偏见,即使 AI 模型每次都产生相同的答案,偏见仍然存在,表明偏见是由标签类型(“人”或“AI”)引起的,而不是由确切的词语使用引起的。

研究 2

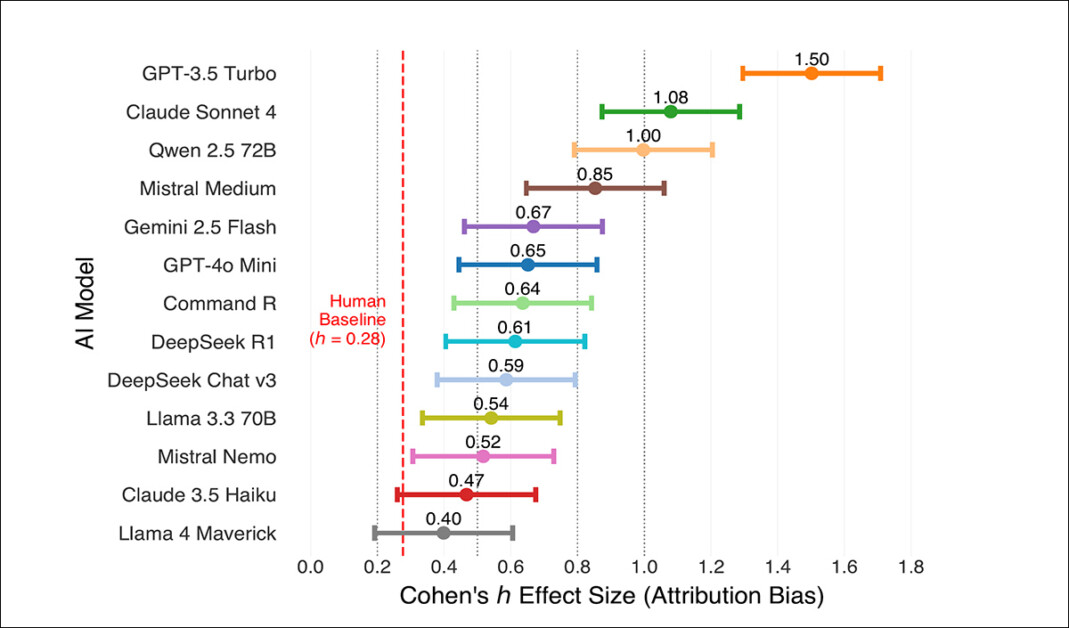

第二项研究发现,所有 13 个 AI 模型都表现出相同的偏爱人类的偏见,无论其架构或提供者如何:

[…]

每个模型都更喜欢被标记为人写的故事,比人类表现出更强的效果。即使去掉最极端的案例,平均偏见仍然是人类版本的两倍多,表明这种效果不是一个模型中的故障,而是 LLM 的一个共享特征。

结论

尽管这篇论文指出,早期研究已经表明,AI 可以产生与人类作品相当,甚至更好的写作,但作者强调,在文学中,作者身份和真实性的价值是一种根深蒂固的传统:

‘当 GPT-4o Mini 在 AI 归属标签下驳回 Queneau 的“创造性和幽默”的方法时,将其描述为“夸张的”,而在人写的归属标签下却赞扬相同的特征,这意味着这些标签触发了关于没有真实的心理过程发生的假设。

‘来源线索将过程偷偷地带入了本来可能只是产品判断的领域:“仅仅是生成”在人类工匠(被视为熟练的工艺)中是可以接受的,但在模型(被视为算法重组)中是可疑的。

LLM 还不够可靠,无法进行无监督的基于事实的研究,尽管仔细的监督仍然可以使它们富有成效,但基于 LLM 的创意写作可能面临更不确定的未来,如果 AI 生成的创作作品由于更广泛的公众不赞同 AI 对人类领域的侵犯而被污名化,而不是基于文学价值。

这类研究的发现受到公司和个人用户是否愿意诚实地承认 AI 对其输出的贡献的态度的影响。在某些情况下,拒绝承认此类使用可能更多地与企业版权盗窃有关,而不是担心公众是否会接受 AI 生成的创作作品。

然而,关于版权的法律、财务和政治解决方案是可能的(尽管非常具有挑战性)。但是,让人们喜欢没有单一相关人类思想驱动的创作 AI 工作——这可能是一个更艰难的前景。

* 请参阅源论文以获取删除的内联引用。如有必要,这些将被包含在文章中。

最初发布于 2025 年 10 月 13 日,星期一