Anderson 视角

给语言模型一个“真实度旋钮”

真实还是健谈:选择一个。一个新的训练方法允许用户告诉AI聊天机器人应该有多“事实”,将准确性变成一个可以调高或调低的旋钮。

美国和中国之间的新研究合作为几乎所有AI聊天机器人用户提供了他们会欣赏的东西:一个虚拟的“旋钮”,告诉机器人是否应该是“啰嗦”或“真实”的

该系统是通过对微调一个Mistral-7B模型在合成数据上创建的,以便在模型上印制“真实度”模式。经过此次修改,Mistral模型能够控制答案中的事实数量;用户给出的“真实度”值越高,答案越短,但越可靠。

在较低的设置中,聊天机器人的答案变成了论文作者所说的“信息量”,即它会给出更长的答案并包含更多的事实;但其中一些事实可能是幻想的。

用于训练系统的合成数据使用维基百科作为测试域的参考:关于人的现实生活中的传记事实。无论是否认为维基百科应该是权威的来源,这项工作的价值在于设计任何可以限制大型语言模型(LLM)天生的强迫的系统,即使它没有任何答案也要给出答案。

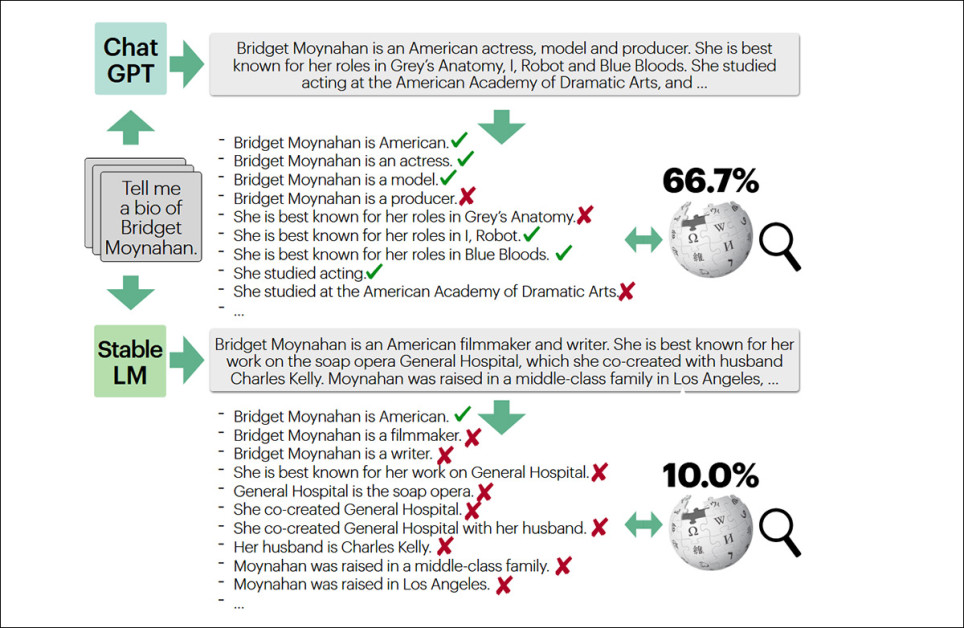

一个来自FactScore项目的示例,该项目为我们在这里审查的论文提供了数据集的策划,使用维基百科作为传记详细信息的参考权威。 来源

作者指出,高保真度的环境,例如医疗和法律领域,需要保守和可靠的事实输出,而许多其他类型的用户需要更灵活和创造性的解释性输出(例如,论文写作和学术分析等)。

他们观察到*:

‘[当前] LLM提供没有内置机制来控制这种权衡。

‘虽然用户可能会尝试使用提示来指导模型的行为,例如“更事实”,我们发现前沿模型在这种任务中并不可靠地调整其输出以响应此类提示。 ‘

‘在 FactScore上,我们发现现成的模型通常无法满足甚至中等至严格的目标。这一差距激发了一个可控的替代方案,允许用户请求特定的事实性水平,并使模型相应地调整其响应.’

仅事实

为了理解这篇论文和它提供的解决方案,需要回顾一下“信息量”的定义。作者指出,一个“信息量”响应的量化等于“输出中支持的内容量,测量为验证的原子语句的数量,归一化为输出长度”。

在其他地方,论文更简单地指出,信息量是“输出中的原子事实总数,无论是否正确”。

此外,研究人员指出,LLM倾向于在事实准确性和主观猜测之间徘徊,这是一种非常人性的特征,并且被不同的科学研究记录*:

‘[LLM的知识]是不均匀可靠的:一些陈述是强有力的支持,而其他的则是推测性的、过时的或不确定的。因此,生成需要决定说多少和如何谨慎地说,创造了事实精度和信息量之间的紧张关系。 ‘

‘人类做出类似的选择:从高可靠性的事实开始并 添加 较低置信度 细节仅当被要求时才添加。’

虽然实验仅在中型Mistral模型上进行,但所应用的原理应该可以在各种规模和平台上起作用,因为它涉及对数据的新颖量化,作为LLM内部模式的补充;并且这种修正并不特定于架构。

这篇新论文的标题是按需事实性:控制文本生成中的事实性-信息量权衡,来自七位来自哥伦比亚大学、纽约大学和纽约大学上海分校的研究人员。

方法和数据

论文中提出的新方法被称为事实性控制生成(FCG),并引入了一个虚拟旋钮,允许用户指定他们希望聊天机器人答案有多准确。 ‘本质上,’论文指出,‘FCG通过一个可控的“旋钮”提高模型的真实性’。

模型接受用户的问题和期望的真实度水平,然后生成一个响应,仅包含它认为足够可靠的信息,同时尝试在该置信度约束内尽可能详细。

使用(上面链接的)FactScore系统,样本查询的分段输出被评估为准确性,即事实性遵守性:

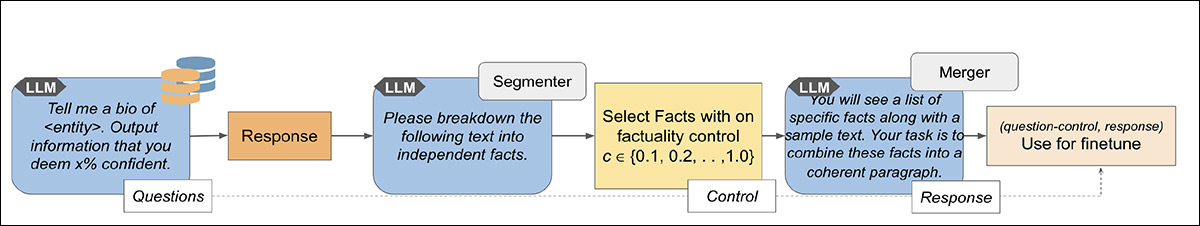

FCG的训练数据流水线:语言模型生成一个初始答案,分解为原子事实,按置信度排名,并丢弃最不可靠的直到达到所需的真实度。 来源

由于没有现有的数据集符合FCG的要求,作者通过让GPT-4†语言模型首先生成一个无约束的答案,然后剥去“最低置信度”的事实,直到响应达到给定的准确性级别,创建了一个合成数据集。

以前的工作表明,仅在真实数据上训练可能会使模型变得更不事实,因为它会阻止它们提供任何额外的细节。因此,FCG训练示例进行了最小的编辑,保留了模型自己的措辞和节奏,同时削减足够的内容以满足所需的目标置信度。

通过将此编辑过程应用于从10%到100%的严格阈值的置信度级别范围,创建了一个合成数据集,其中每个问题都与多个过滤后的响应配对。

在每个版本中,只有模型认为足够可靠以满足请求的真实度级别的事实被保留;这些示例然后用作监督微调的训练数据。

最终数据集由3,302个(问题,控制,响应)三元组组成,用于训练,和396个用于验证,由450个用于训练和50个用于开发的500个实体构建。另外,183个不同的实体用于测试。

训练和测试

作者对Mistral-7B-Instruct-v0.2 LLM模型进行了微调,学习率为(3e-6、1e-5、3e-5),训练30个epoch,批大小为256(n.b.训练硬件未指定)。

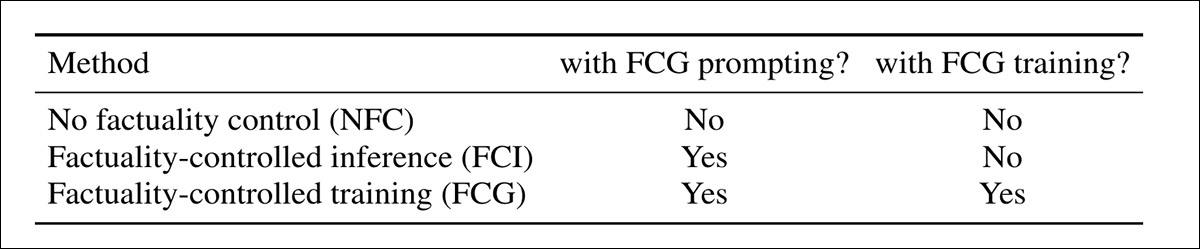

FCG与两个基线进行了比较。第一个是无事实性控制(NFC),其中模型仅被提示请求,例如告诉我X的传记,没有提到准确性或置信度。这个版本反映了LLM的默认行为,没有任何过滤或约束的机制。

第二种方法称为事实性控制推理(FCI),使用相同的置信度级别提示,但没有微调。例如,模型可能被提示为‘输出你认为90%可信的信息’。在这种情况下,指令类似于训练中使用的指令,但模型没有先前的接触到此类约束:

比较了三种测试方法:无控制的基线;使用事实性提示但无训练的版本;以及学习遵循准确性设置的完全训练模型,通过接触过滤数据实现。

最初,测试了事实性遵守性:

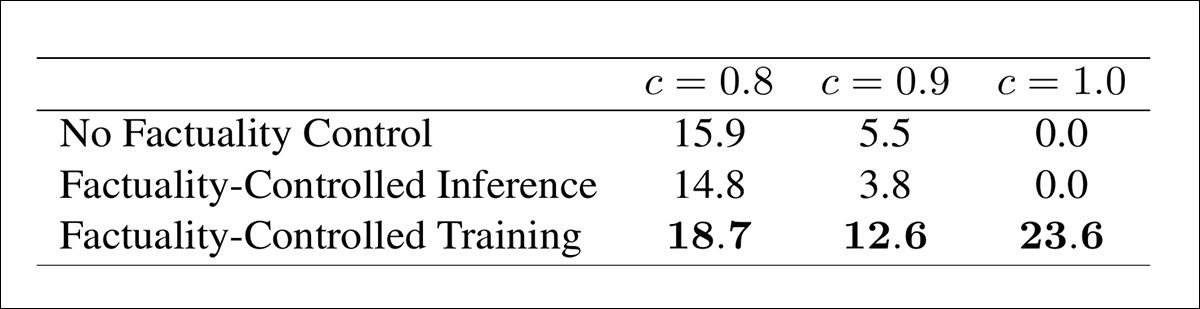

三个目标置信度级别的性能。只有完全训练的模型能够一致地满足目标,并且在所有方面都优于两个基线,特别是在更高的阈值。

当测试了80%、90%和100%的真实度阈值时,只有微调的模型能够始终满足目标。令人惊讶的是,简单地添加置信度指令而不训练模型来遵循它们,并没有帮助。在某些情况下,它甚至使事情变得更糟;例如,仅有3.8%的输出来自提示模型,满足90%的阈值,相比之下,没有任何指令的版本为5.5%:

这表明,作者断言,基础Mistral-7B模型无法以有用的方式解释诸如’90%自信’的提示,并且额外的指令可能甚至会破坏其通常的输出。

相比之下,训练模型可靠地响应控制信号,产生18.7%的符合80%的输出,12.6%的符合90%的输出,和23.6%的符合100%的输出;并且它证明是唯一能够生成完全事实答案的方法:

‘这些改进表明,事实性控制的能力确实可以通过监督训练来灌输。FCG模型已经学会调整其内容,并且只包括它认为足够可信的内容,而现成的模型无法有效地利用控制信号。’

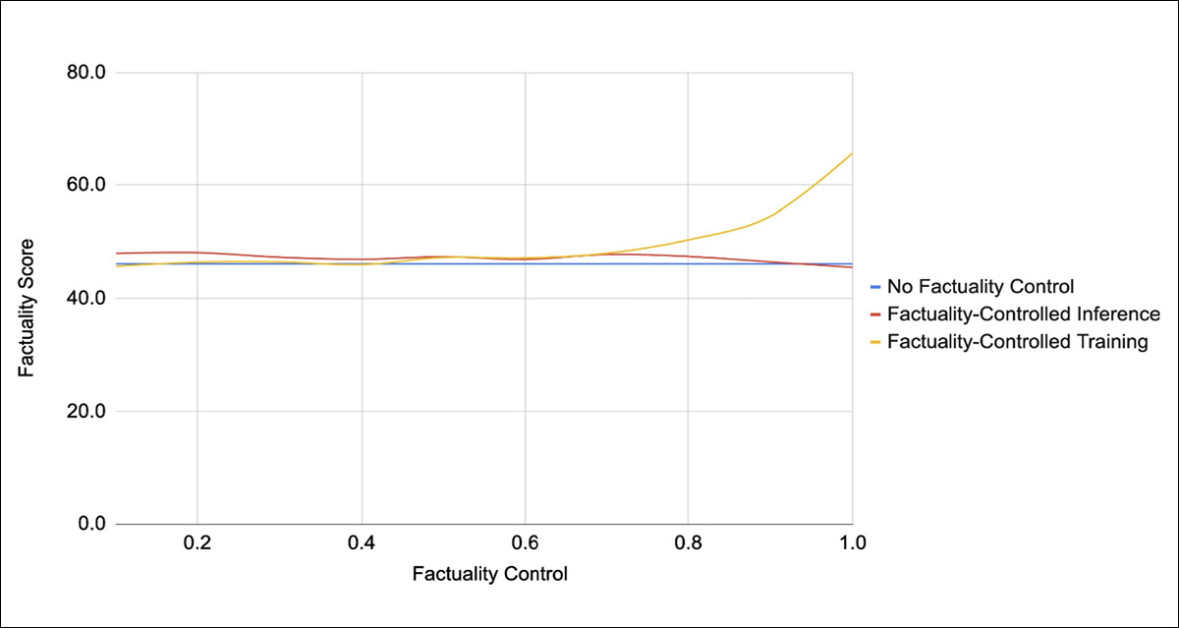

在一个单独的测试中,旨在确认模型已经学会解释控制信号,研究人员检查了请求更高真实度设置时平均事实性的响应是否会增加。

在训练之前,没有出现这种模式,但之后,结果显示了一种稳定的上升趋势,较高的请求置信度产生了更准确的响应:

随着目标真实度设置的增加,微调模型产生了越来越事实的输出作为响应,而基线模型在同一范围内没有表现出一致的变化。

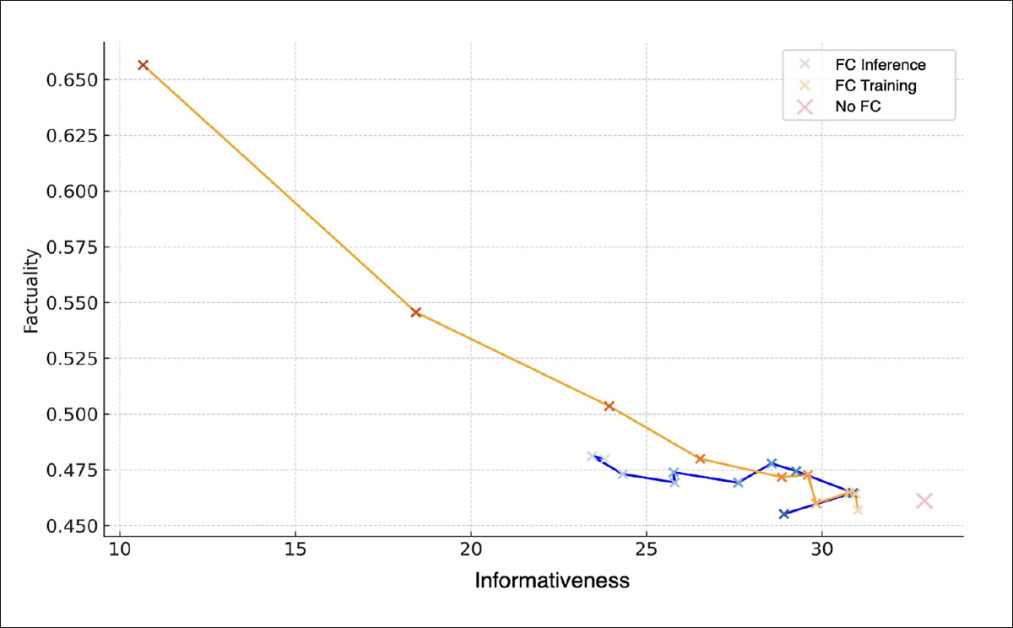

还检查了真实度与“丰富度”的权衡。输出不仅按准确性评分,还按在增加的真实度要求下保留的经过验证的信息量进行评分。如图所示,FCG模型在大多数级别上都优于两个基线:

三个方法之间的事实性与信息量权衡图。微调模型在可比准确性级别上比两个基线更好地平衡了真实度和细节,并且在最高设置时,仍然是唯一能够产生不为空的完全验证响应的方法。

在大约90%的目标准确性下,FCG保留的内容比任何其他方法都多,并且在整个置信度设置范围内,没有基线产生了一致更好的结果。

差异在最严格的设置中最为明显,在那里FCG继续产生非零的信息量,而带有提示的基线被迫删除一切。相比之下,训练模型能够重塑其输出以保留它认为完全可靠的事实,避免了影响其他模型的沉默。

通过直接约束事实性,同时优化信息量以包含尽可能多的可靠内容来实现。较高的设置只保留可信的陈述;较低的设置允许更多推测性的细节,增加长度但降低准确性。

作者得出结论:

‘[当]一个高事实性约束存在时,模型优先考虑事实可验证的陈述,同时仍包括尽可能多的相关信息。相反,模型有自由包含更广泛的细节,包括一些不太可验证或更推测性的细节,从而导致更高的信息量(提到的事实更多),但以牺牲一些准确性为代价。 ‘

‘这种行为符合我们的训练数据设计:因为我们总是删除最少必要的事实,模型学会了“如果你必须是x%的事实,丢弃最不确定的细节,但保留其他所有内容”。 ‘

论文以希望这种新方法将被尝试在更大规模的模型上,并应用于更复杂的任务等可能的未来工作扩展而结束。

结论

这里提供的解决方案解决了最新一代大型语言模型中最严重和最常见的缺陷之一——它们倾向于优先考虑健谈而不是准确性,似乎只是为了“继续对话”,并自信地将过时或完全虚构的信息呈现为事实。

对于ChatGPT用户,任何不以“搜索网络”小部件的简要出现为前奏的自信答案要么来自模型的知识截止日期,要么可能是幻想而不是事实。

然而,网络搜索会增加延迟和LLM主机的运行成本,并且,如任何用户所知,网络搜索是有选择地运行的;或者是在用户的请求下;或者作为可能会产生额外令牌费用的“特殊设置”。

尽管如此,这些内部经济可能会对LLM查询在某些领域或某些类型的查询中产生关键影响。任何可以强加与输出准确性相关的模式的方法都是受欢迎的研究。

* 我将作者的内联引用转换为超链接。

† 未给出完整的版本号。

首次发布于2026年2月6日。在接下来的五分钟内修改了一个重复的词。