ШІ 101

Що таке навчання з підкріпленням?

Що таке навчання з підкріпленням?

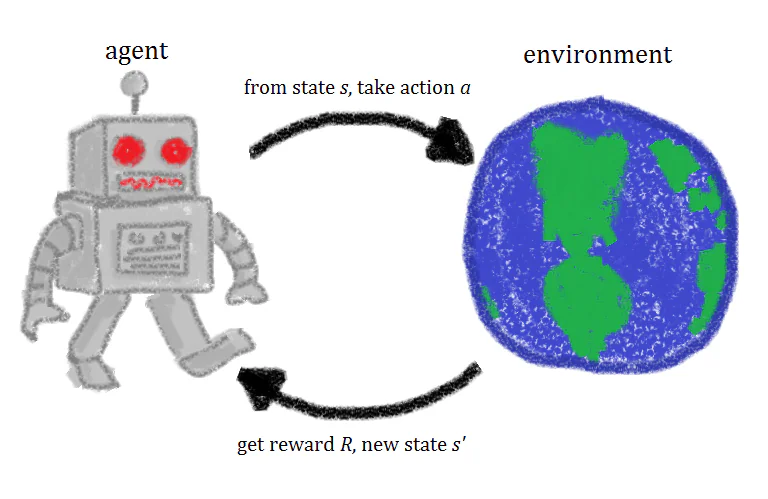

Простіше кажучи, навчання з підкріпленням — це техніка машинного навчання, яка передбачає тренування агента штучного інтелекту через повторення дій та пов’язаних з ними винагород. Агент навчання з підкріпленням експериментує в середовищі, виконуючи дії та отримуючи винагороду за правильні дії. З часом агент вчиться виконувати дії, які максимізують його винагороду. Це швидке визначення навчання з підкріпленням, але детальніше розгляд концепцій, що стоять за ним, допоможе отримати краще, більш інтуїтивне розуміння. Термін “навчання з підкріпленням” запозичений з концепції підкріплення в психології. Тому давайте на мить розберемося з психологічною концепцією підкріплення. У психологічному сенсі термін “підкріплення” означає щось, що підвищує ймовірність виникнення певної реакції/дії. Ця концепція підкріплення є центральною ідеєю теорії оперантного обумовлення, спочатку запропонованої психологом Б.Ф. Скіннером. У цьому контексті підкріпленням є все, що змушує частоту заданої поведінки зростати. Якщо розглядати можливі підкріплення для людей, це можуть бути такі речі, як похвала, підвищення на роботі, цукерки та розважальні заходи. У традиційному, психологічному сенсі існує два типи підкріплення. Це позитивне підкріплення та негативне підкріплення. Позитивне підкріплення — це додавання чогось для посилення поведінки, наприклад, дати собаці ласощі, коли вона добре себе поводить. Негативне підкріплення передбачає усунення стимулу для виклику поведінки, наприклад, вимкнення гучних звуків, щоб виманити боязку кішку.

Позитивне та негативне підкріплення

Позитивне підкріплення підвищує частоту поведінки, тоді як негативне підкріплення знижує її частоту. Загалом, позитивне підкріплення є найпоширенішим типом підкріплення, що використовується в навчанні з підкріпленням, оскільки воно допомагає моделям максимізувати продуктивність у певному завданні. Не лише це, але позитивне підкріплення веде модель до більш стійких змін, змін, які можуть стати послідовними шаблонами та зберігатися протягом тривалого часу. На противагу цьому, хоча негативне підкріплення також робить поведінку більш ймовірною, воно використовується для підтримки мінімального стандарту продуктивності, а не для досягнення максимальної продуктивності моделі. Негативне підкріплення в навчанні з підкріпленням може допомогти забезпечити, щоб модель уникала небажаних дій, але воно не може справді змусити модель досліджувати бажані дії.

Тренування агента з підкріпленням

Коли агент навчання з підкріпленням тренується, використовуються чотири різні компоненти або стани: початкові стани (Стан 0), новий стан (Стан 1), дії та винагороди. Уявіть, що ми тренуємо агента з підкріпленням грати в платформер, де мета ШІ — дістатися до кінця рівня, рухаючись праворуч по екрану. Початковий стан гри береться з середовища, тобто перший кадр гри аналізується та передається моделі. На основі цієї інформації модель має вирішити, яку дію виконати. На початкових етапах тренування ці дії є випадковими, але в міру підкріплення моделі певні дії ставатимуть більш поширеними. Після виконання дії середовище гри оновлюється та створюється новий стан або кадр. Якщо дія, виконана агентом, призвела до бажаного результату, скажімо, у цьому випадку агент ще живий і не був уражений ворогом, агент отримує певну винагороду, і він з більшою ймовірністю повторить те саме в майбутньому. Ця базова система постійно циклічно повторюється, знову і знову, і кожного разу агент намагається дещо більше навчитися та максимізувати свою винагороду.

Епізодичні та безперервні завдання

Завдання навчання з підкріпленням зазвичай можна віднести до однієї з двох категорій: епізодичні завдання та безперервні завдання. Епізодичні завдання виконують цикл навчання/тренування та покращують свою продуктивність, поки не буде виконано певні кінцеві критерії та тренування не буде завершено. У грі це може бути досягнення кінця рівня або падіння в пастку, наприклад, на шипи. На противагу цьому, безперервні завдання не мають критеріїв завершення, по суті, продовжуючи тренуватися вічно, поки інженер не вирішить завершити тренування.

Метод Монте-Карло та метод тимчасових різниць

Існує два основні способи навчання або тренування агента навчання з підкріпленням. У підході Монте-Карло винагороди доставляються агенту (його рахунок оновлюється) лише в кінці епізоду тренування. Іншими словами, модель дізнається, наскільки добре вона працювала, лише коли досягається умова завершення. Потім вона може використати цю інформацію для оновлення, і коли розпочнеться наступний раунд тренування, вона реагуватиме відповідно до нової інформації. Метод тимчасових різниць відрізняється від методу Монте-Карло тим, що оцінка цінності або оцінка рахунку оновлюється протягом епізоду тренування. Як тільки модель переходить до наступного часового кроку, значення оновлюються.

Дослідження та використання

Тренування агента навчання з підкріпленням — це балансування, що включає збалансування двох різних метрик: дослідження та використання. Дослідження — це акт збору більшої інформації про навколишнє середовище, тоді як використання — це застосування вже відомої інформації про середовище для отримання балів винагороди. Якщо агент лише досліджує і ніколи не використовує середовище, бажані дії ніколи не будуть виконані. З іншого боку, якщо агент лише використовує і ніколи не досліджує, агент навчиться виконувати лише одну дію і не відкриє інші можливі стратегії отримання винагороди. Тому балансування між дослідженням і використанням є критично важливим при створенні агента навчання з підкріпленням.

Сфери застосування навчання з підкріпленням

Навчання з підкріпленням може використовуватися в найрізноманітніших ролях, і воно найкраще підходить для додатків, де завдання вимагають автоматизації. Автоматизація завдань, які мають виконувати промислові роботи, — це одна з областей, де навчання з підкріпленням виявляється корисним. Навчання з підкріпленням також можна використовувати для таких проблем, як текстовий майнінг, створюючи моделі, здатні підсумовувати довгі тексти. Дослідники також експериментують із використанням навчання з підкріпленням у сфері охорони здоров’я, де агенти з підкріпленням виконують такі завдання, як оптимізація політик лікування. Навчання з підкріпленням також може використовуватися для адаптації навчальних матеріалів для студентів.

Підсумок про навчання з підкріпленням

Навчання з підкріпленням — це потужний метод створення агентів ШІ, який може призводити до вражаючих, а іноді й несподіваних результатів. Тренування агента за допомогою навчання з підкріпленням може бути складним і важким, оскільки воно потребує багатьох ітерацій тренування та тонкого балансу дихотомії дослідження/використання. Однак, якщо воно успішне, агент, створений за допомогою навчання з підкріпленням, може виконувати складні завдання в найрізноманітніших середовищах.