Andersons Blickwinkel

KIs Verfolgung von Schönheit

Ein neues künstliches Intelligenz-System zur Bewertung von Schönheit bewertet, wie attraktiv Gesichter erscheinen, während es schneller trainiert als typische Deep-Learning-Modelle, was groß angelegte automatisierte Schönheitsbewertung praktischer machen könnte.

Facial Beauty Prediction (FBP) ist ein großes Geschäft und ein ziemlich starker Strang in der Forschungsliteratur. Obwohl es praktisch jedes Gebot hinter der Bekämpfung von Vorurteilen in künstlicher Intelligenz und maschinellen Lernpraktiken bricht und obwohl es auf viele Weise die Objektivierung und Reduktionismus in algorithmischen Wahrnehmungen von Frauen unterstützt, zieht es dennoch das Interesse mehrerer multibillionenschwerer Branchen auf sich, die meisten davon direkt auf Frauen gerichtet, wie z.B. Kosmetik, kosmetische Gesichtschirurgie, Livestreaming und Mode, um nur einige zu nennen:

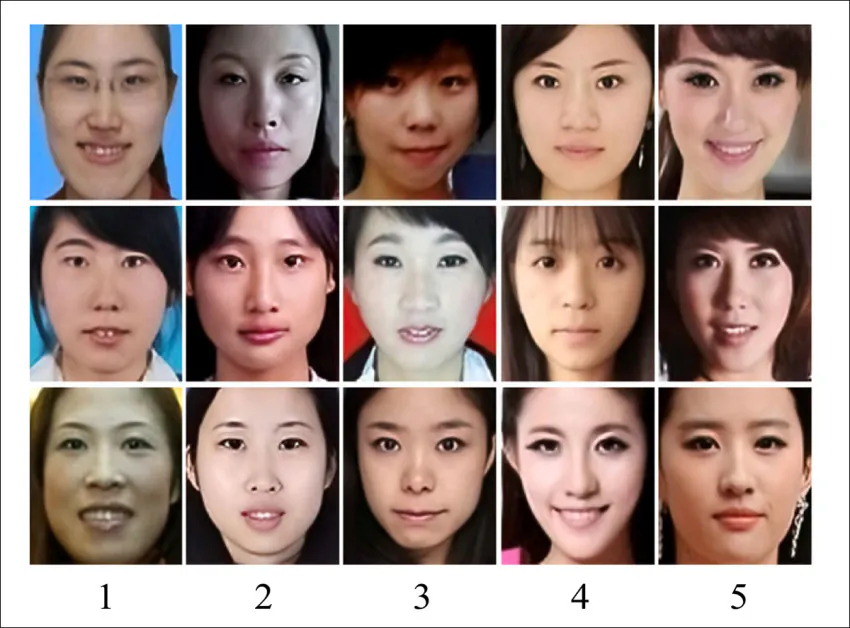

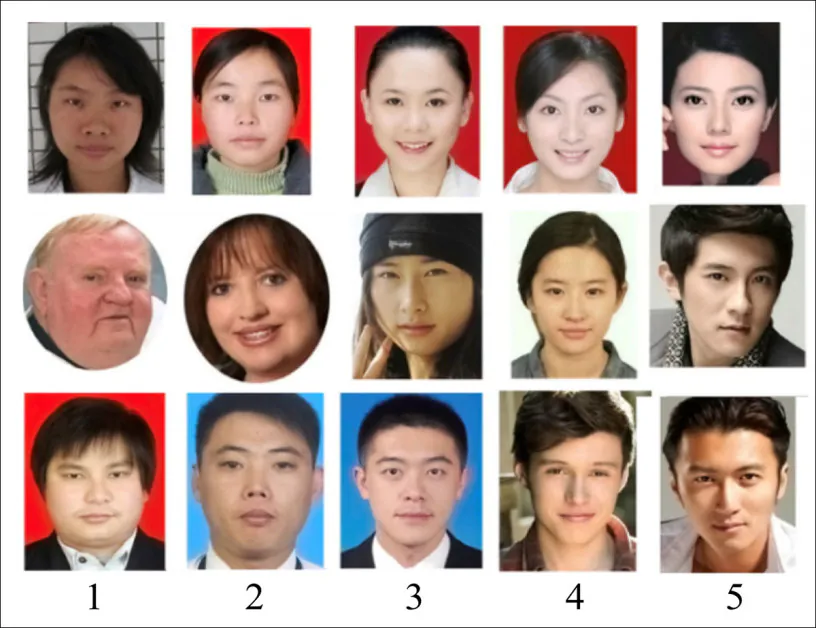

Frauen, die von 1-5 bewertet werden, aus dem Paper ‘Asian Female Facial Beauty Prediction Using Deep Neural Networks via Transfer Learning and Multi-Channel Feature Fusion’. Quelle

Jenseits dieser offensichtlichen weiblichen Geschäftszentren haben Werbung und mehrere andere Branchen, einschließlich Unterhaltung und Verlagswesen, bemerkenswerte Anteile an der Erforschung dessen, was sowohl Männer als auch Frauen als ‘attraktiv’ empfinden, notwendigerweise auf kultureller Basis.

Die Tatsache, dass aggregierte Wahrnehmungen von Schönheit über Regionen variieren, bedeutet, dass keine definitive global anwendbare Datensätze erhalten werden können und dass neue Forschung entweder parochial bleiben oder sich auf ‘hochrangige’ Methoden konzentrieren muss, die auf verschiedene kulturelle Daten angewendet werden können.

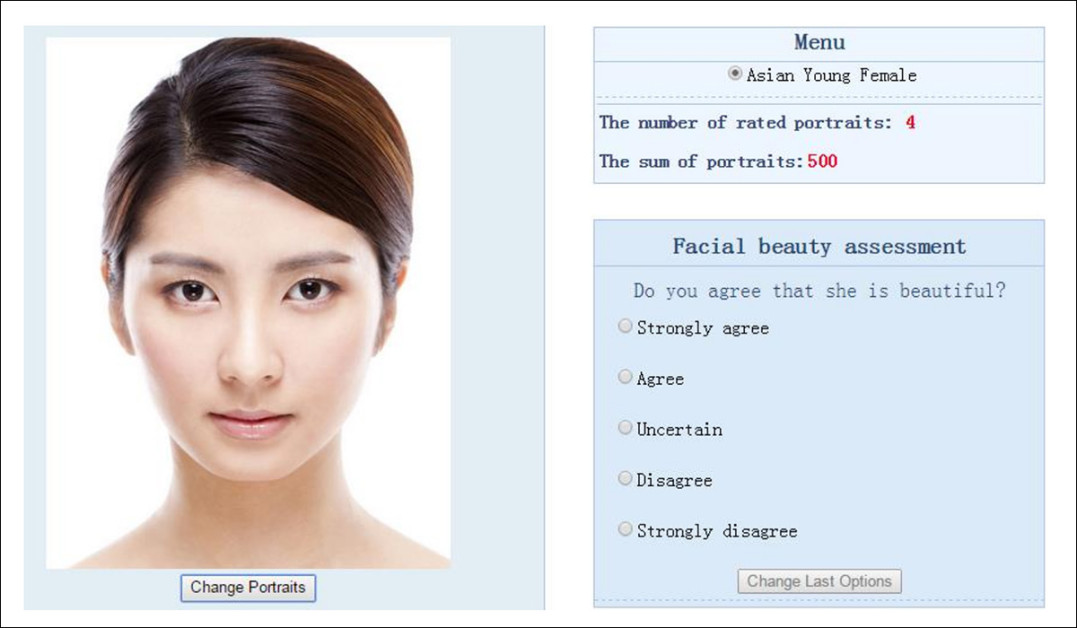

Eine Schnittstelle für ein Gesichtsbewertungssystem für das 2015 SCUT-FBP-Projekt. Quelle

Oftmals ist die geografische Lage nicht die einzige Einschränkung, da Datensätze, die auf Attraktivität fokussiert sind, Schwierigkeiten haben können, gleiche Wirksamkeit über Geschlechter hinweg zu bieten oder wurden möglicherweise mit einem bestimmten Anwendungsziel im Sinn curatiert – und dies kann die Verwendung der Sammlung in anderen Bereichen einschränken.

Zum Beispiel berichtete ich 2025 über die Entwicklung eines relativ groß angelegten (100.000+ Identitäten) Datensatzes, um Attraktivität in Live-Streams zu bewerten, dessen enge Standards möglicherweise eine bemerkenswerte Anpassung an umfassendere Projekte benötigen, trotz des enormen Aufwands hinter der Initiative.

Gesichtsrendition

Wie aus den Links und Bildern oben ersichtlich, operieren asiatische Forschungseinrichtungen oft nicht unter den gleichen kulturellen Einschränkungen wie ihre westlichen Pendants, die sich schwer tun würden, es zu wagen, eine wissenschaftliche Illustration zu veröffentlichen, die fünf westliche Frauen von der wenigsten bis zur attraktivsten bewertet, wie wir es in der oben illustrierten Studie sehen:

Es könnte argumentiert werden, dass, wo asiatische Systeme dieser Art in der Öffentlichkeit als effektiv bewiesen werden, ohne Angst vor lokaler Kritik, westliche Interessen diese Forschung in proprietäre, private Implementierungen adaptieren oder verwenden können. Die Aufgabe der ‘Bewertung von Frauen’ wird in diesem Szenario an einen Ort ausgelagert, an dem sie ohne Kritik verfolgt werden kann.

Ob dies häufig ist oder ob weniger öffentlichkeitswirksame westliche Äquivalentsysteme tendenziell abseits offener Zusammenarbeit und öffentlicher Überwachung entwickelt werden, es ist vernünftig anzunehmen, dass das Ziel von globalem Interesse ist, aufgrund der großen Anzahl von professionellen Sektoren, die von genauen Bewertungen von Attraktivität profitieren können.

Überleben des Stärkeren

Es mag scheinen, dass massive web-scrapable Corpora wie Tik Tok, Instagram und YouTube hervorragende Schiedsrichter der Schönheit sein würden, indem sie Follower, Likes und Traffic mit Attraktivität korrelieren, da dies eine gemeinsame und vernünftige Assoziation (obwohl mit einigen Ausnahmen) ist.

Ebenso werden bestehende Sammlungen – wie ImageNet und LAION –, die Schauspieler und Modelle enthalten, die ‘an die Spitze’ gestiegen sind, typischerweise attraktive Individuen enthalten (obwohl oft mit zu vielen Datenpunkten von zu wenigen Menschen), was es ermöglicht, breitere kulturelle Mechanismen als Proxy für Attraktivität zu verwenden.

Jedoch berücksichtigt dies nicht die wechselnden Geschmack in dem, was Menschen über die Zeit (geschweige denn geografisch) als attraktiv empfinden. Daher sind wiederum hochrangige und datenagnostische Systeme erforderlich, nicht individuelle und spezifische Sammlungen oder Kuratierungen, die versagen werden, sich verändernden Geschmackern anzupassen.

Kombinierte Haut

Der neueste akademische Beitrag, der diese Herausforderungen angeht, kommt aus China, wo Transfer Learning und Broad Learning System (BLS) kombiniert werden, um den langjährigen Kompromiss zwischen Genauigkeit und Rechenkosten anzugehen.

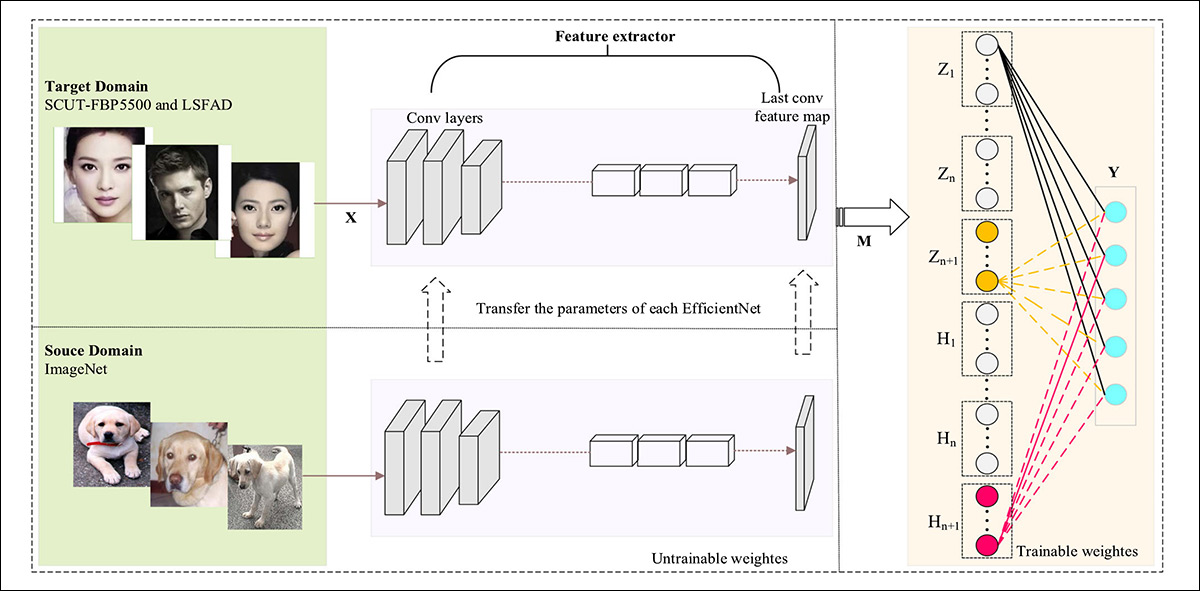

Konventionelle neuronale Netze erreichen starke Ergebnisse nur mit intensivem Training, während leichtere Systeme wie BLS schnell trainieren, aber Schwierigkeiten haben, genügend Details zu erfassen. Die neue Arbeit überbrückt diese Lücke, indem sie ein vorgebildetes visuelles Modell verwendet, um Gesichtsmerkmale zu extrahieren, die dann an ein schnelles BLS-basiertes System für die Bewertung übergeben werden, wodurch Merkmale wiederverwendet werden können, anstatt von Grund auf gelernt zu werden, während das Training effizient bleibt:

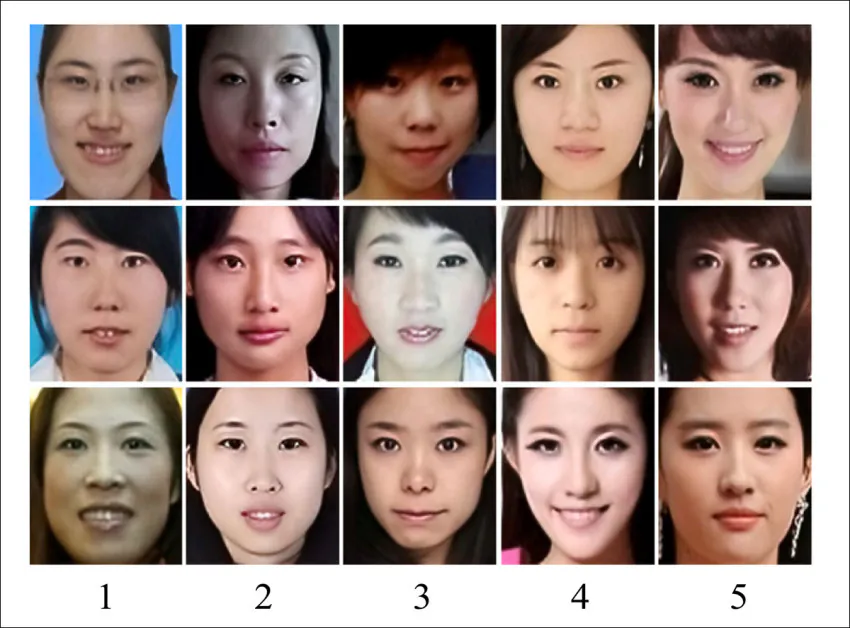

Beispielbilder aus dem LSAFBD-Datensatz, die weibliche Gesichter nach menschlich zugewiesenen Schönheitswerten von 1 bis 5 gruppieren. Quelle

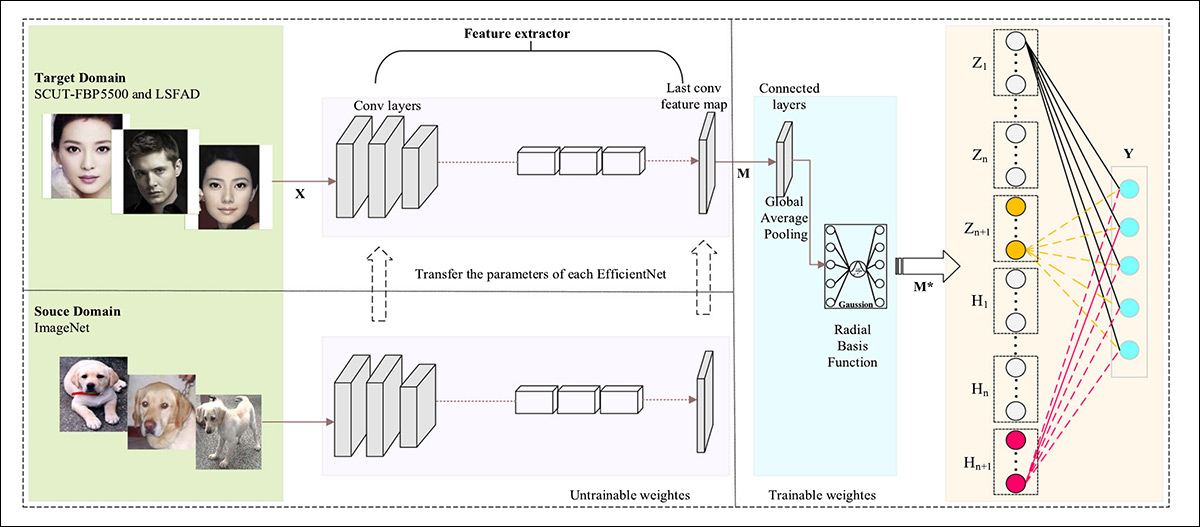

Die erste der beiden Varianten, E-BLS, kombiniert EfficientNet-basiertes Transfer Learning mit BLS, extrahiert detaillierte visuelle Merkmale aus einem Gesicht und übergeben sie dann an BLS, was eine endgültige Vorhersage beinhaltet, die das Training eines vollen tiefen neuronalen Netzes von Grund auf vermeidet:

Architekturschema für das E-BLS-Modell.

EfficientNet, das auf ImageNet-1k vorgebildet wurde und größtenteils unverändert blieb, wandelt jedes Eingabebild in einen kompakten Satz von Feature-Werten um, die das Gesicht in einer strukturierten Weise beschreiben, während BLS diese Werte verarbeitet und sie durch ein Netzwerk einfacher, zufällig verbundener Knoten transformiert und kombiniert, bevor es die endgültige Attraktivitätsbewertung produziert.

Da BLS nicht auf tief geschichtete Strukturen angewiesen ist, kann E-BLS durch Hinzufügen von mehr Knoten aktualisiert werden, anstatt das gesamte System neu zu trainieren. Dies hält das Training schnell und erleichtert es, das Modell zu verbessern, wenn neue Daten eingeführt werden.

Die zweite der beiden Varianten, ER-BLS, baut auf E-BLS auf, indem sie eine zusätzliche Verarbeitungsstufe zwischen dem EfficientNet-Feature-Extractor und BLS einfügt, mit dem Ziel, die extrahierten Merkmale vor der Verwendung für die Vorhersage zu verbessern:

Architektur des ER-BLS-Modells.

Anstatt die rohen EfficientNet-Features direkt in BLS zu übergeben, verarbeitet ER-BLS sie zuerst durch eine Verfeinerungsebene, die die Daten standardisiert und umformt, was hilft, Rauschen zu reduzieren und die Merkmale konsistenter über verschiedene Bilder hinweg zu machen. Dieser Schritt ist darauf ausgelegt, die Fähigkeit des Systems zu verbessern, sich auf veränderte Bedingungen anzupassen, insbesondere wenn Gesichter in Beleuchtung, Pose oder anderen visuellen Bedingungen variieren, die ansonsten Instabilität in die Vorhersagen einführen können.

Die verfeinerten Merkmale werden dann in die gleiche BLS-Struktur wie in E-BLS eingespeist, wo Feature-Knoten und Verbesserungsknoten die Informationen transformieren und kombinieren, um die endgültige Attraktivitätsbewertung zu produzieren.

Methode

Das oben erwähnte Broad Learning System ist eine leichte Alternative zu tiefen neuronalen Netzen, die das Stapeln mehrerer Schichten vermeidet und stattdessen das Lernen über eine breite Menge einfacherer Verbindungen verteilt, was es ermöglicht, Modelle schnell zu trainieren – aber normalerweise auf Kosten feinerer visueller Details.

Die erste der beiden Varianten, E-BLS, kombiniert EfficientNet-basiertes Transfer Learning mit BLS, extrahiert detaillierte visuelle Merkmale aus einem Gesicht und übergeben sie dann an BLS, was eine endgültige Vorhersage beinhaltet, die das Training eines vollen tiefen neuronalen Netzes von Grund auf vermeidet:

Architekturschema für das E-BLS-Modell.

EfficientNet, das auf ImageNet-1k vorgebildet wurde und größtenteils unverändert blieb, wandelt jedes Eingabebild in einen kompakten Satz von Feature-Werten um, die das Gesicht in einer strukturierten Weise beschreiben, während BLS diese Werte verarbeitet und sie durch ein Netzwerk einfacher, zufällig verbundener Knoten transformiert und kombiniert, bevor es die endgültige Attraktivitätsbewertung produziert.

Da BLS nicht auf tief geschichtete Strukturen angewiesen ist, kann E-BLS durch Hinzufügen von mehr Knoten aktualisiert werden, anstatt das gesamte System neu zu trainieren. Dies hält das Training schnell und erleichtert es, das Modell zu verbessern, wenn neue Daten eingeführt werden.

Die zweite der beiden Varianten, ER-BLS, baut auf E-BLS auf, indem sie eine zusätzliche Verarbeitungsstufe zwischen dem EfficientNet-Feature-Extractor und BLS einfügt, mit dem Ziel, die extrahierten Merkmale vor der Verwendung für die Vorhersage zu verbessern:

Architektur des ER-BLS-Modells.

Anstatt die rohen EfficientNet-Features direkt in BLS zu übergeben, verarbeitet ER-BLS sie zuerst durch eine Verfeinerungsebene, die die Daten standardisiert und umformt, was hilft, Rauschen zu reduzieren und die Merkmale konsistenter über verschiedene Bilder hinweg zu machen. Dieser Schritt ist darauf ausgelegt, die Fähigkeit des Systems zu verbessern, sich auf veränderte Bedingungen anzupassen, insbesondere wenn Gesichter in Beleuchtung, Pose oder anderen visuellen Bedingungen variieren, die ansonsten Instabilität in die Vorhersagen einführen können.

Die verfeinerten Merkmale werden dann in die gleiche BLS-Struktur wie in E-BLS eingespeist, wo Feature-Knoten und Verbesserungsknoten die Informationen transformieren und kombinieren, um die endgültige Attraktivitätsbewertung zu produzieren.

Daten und Tests

Um ihre Methode zu testen, nutzten die Autoren den SCUT-FBP5500-Datensatz, eine Gesichtsschönheitsvorhersagesammlung der South China University, die 5.500 Frontalgesichtsbilder mit 350x350px-Auflösung enthält, mit diversen Rassen, Geschlechtern und Altersgruppen:

Beispielbilder aus dem SCUT-FBP5500-Datensatz, die von 1 (wenig attraktiv) bis 5 (sehr attraktiv) bewertet werden.

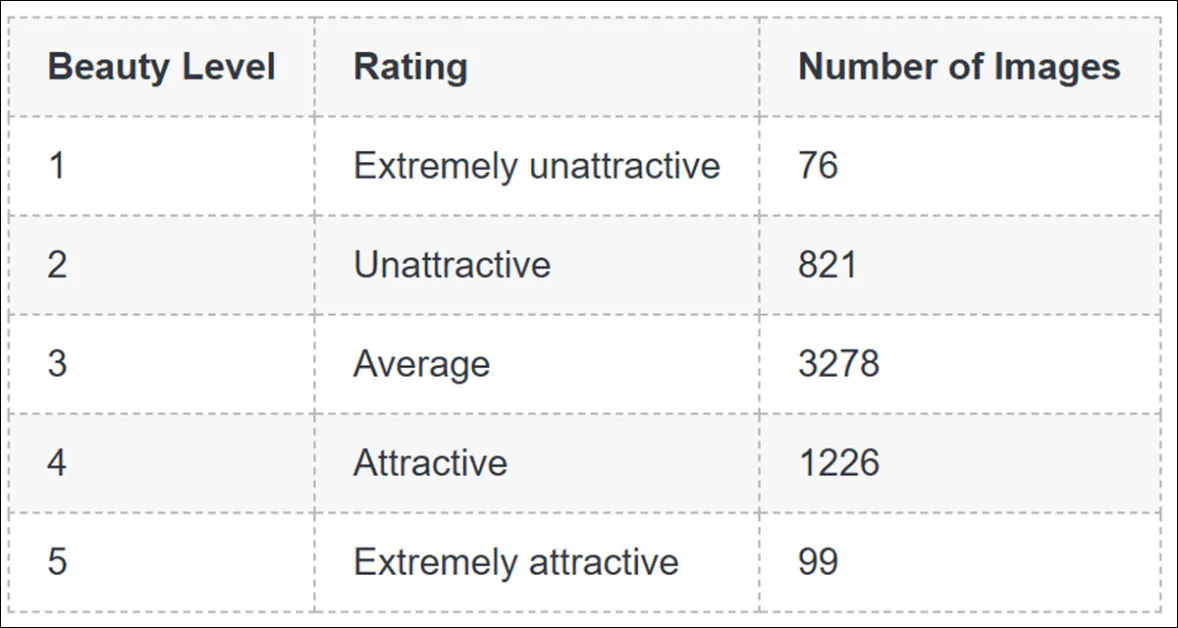

Jedes Bild wurde von 60 Freiwilligen mit einem Schönheitswert auf einer Skala von 1-5 bewertet, von extrem unattraktiv (1) bis extrem attraktiv (5):

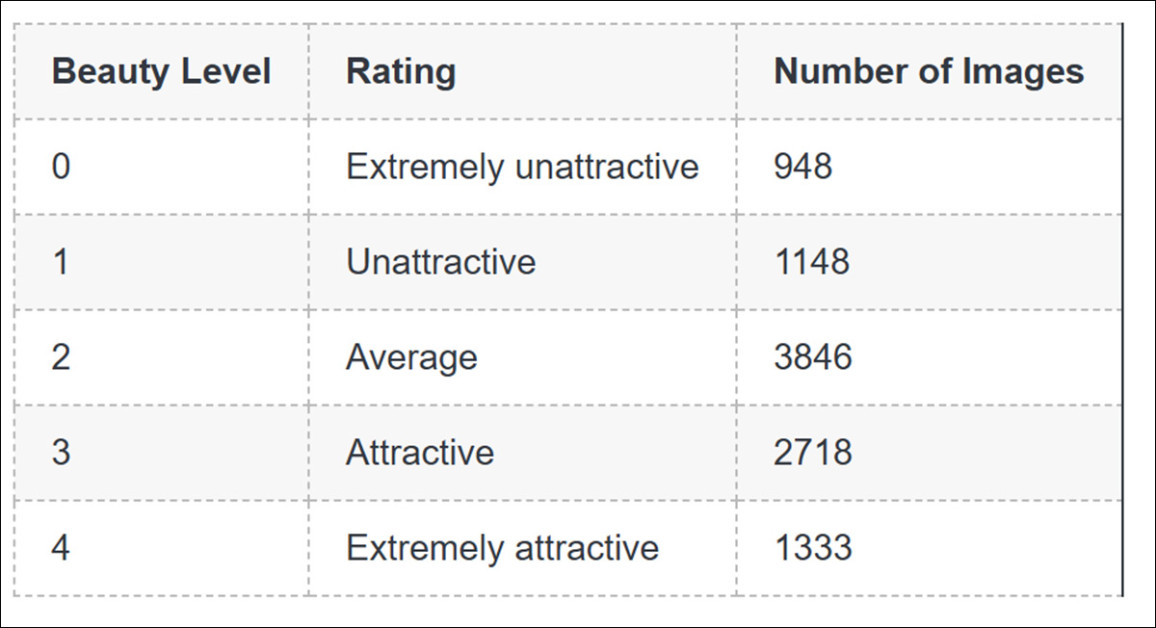

Die Aufteilung der Proportionen der Bilder nach Schönheitsbewertung.

Der andere verwendete Datensatz war die Large-Scale Asian Female Beauty Dataset (LSAFBD)-Sammlung, eine von den Autoren selbst kuratierte Sammlung.

Beispielbilder aus dem LSAFBD-Datensatz, die von 1 (wenig attraktiv) bis 5 (sehr attraktiv) bewertet werden.

Die Sammlung besteht aus 80.000 unbewerteten Bildern mit 144x144px-Auflösung, mit Variationen in Pose und Hintergrund sowie Alter. Diese wurden von 75 Freiwilligen für die gleichen Kriterien wie der vorherige Datensatz bewertet, diesmal auf einer Skala von 0-4:

Die Aufteilung für den LSAFBD-Datensatz.

Jeder Datensatz wurde in Trainings- und Testsegmente im Verhältnis 8/20 aufgeteilt, und Cross-Validation wurde verwendet, um die Ergebnisse über Läufe hinweg zu stabilisieren. Der BLS-Teil wurde durch die Anzahl der Feature-Fenster, die Anzahl der Knoten pro Fenster und die Anzahl der Verbesserungsknoten konfiguriert, wobei Hyperopt verwendet wurde, um effektive Kombinationen zu suchen.

Um eine Basislinie zu etablieren, wurde ein Standard-BLS-Modell unter identischen Bedingungen trainiert, wonach eine Reihe von Transfer-Learning-Modellen eingeführt wurde, einschließlich ResNet50, Inception-V3, DenseNet121, InceptionResNetV2, EfficientNetB7, MobileNetV2, NASNet und Xception – alle wurden mit ImageNet-1k-Gewichten initialisiert und mit ihren letzten Schichten entfroren trainiert.

Das Training verwendete eine Lernrate von 0,001 (die bei Stillstand des Fortschritts reduziert wurde) und eine Batch-Größe von 16, über 50 Epochen hinweg, wobei Regularisierung und ReLu-Aktivierung überall angewendet wurden.

Die Leistung wurde unter Verwendung von Genauigkeit und Pearson-Korrelation sowie der gesamten Trainingszeit bewertet, wobei die Ergebnisse über fünf Läufe hinweg gemittelt wurden.

Die Autoren berichten, dass die Trainingsumgebung aus einem Intel-i7-3,6-GHz-Prozessor und 64 GB RAM auf einem ‘Desktop-Computer’ bestand:

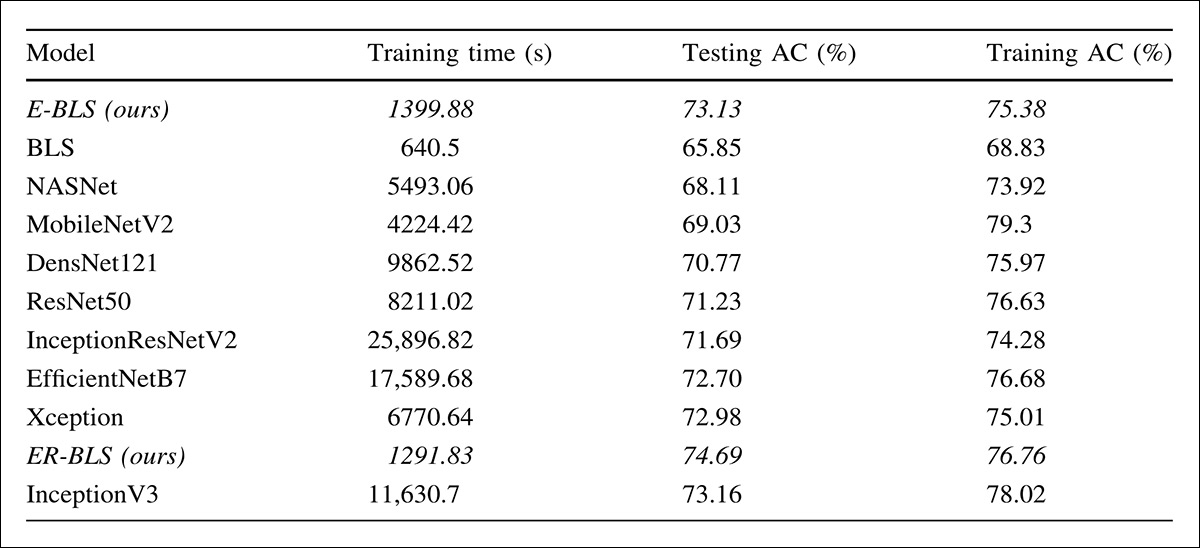

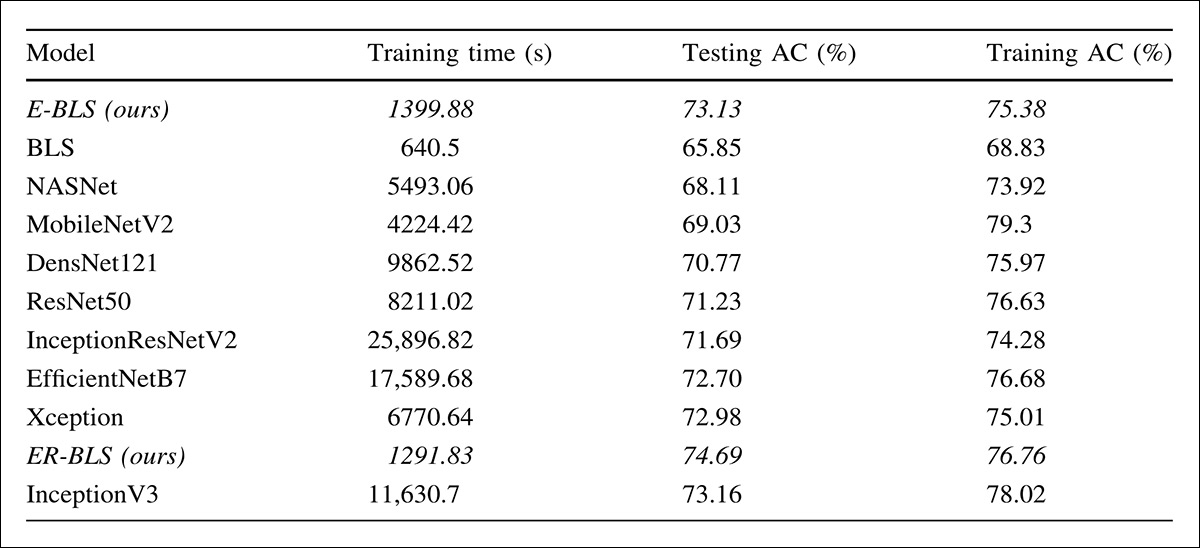

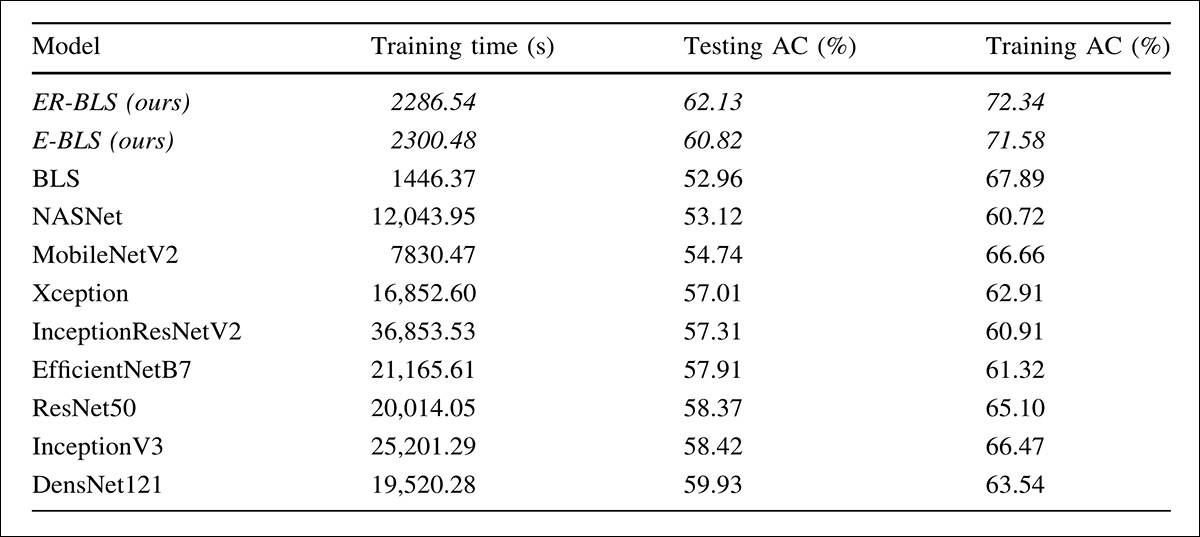

Leistungsvergleich auf SCUT-FBP5500, bei dem E-BLS und ER-BLS eine wettbewerbsfähige Genauigkeit gegenüber tiefen CNN-Modellen wie ResNet50, EfficientNetB7, InceptionV3 und Xception erreichen, während sie wesentlich weniger Trainingszeit benötigen – was die Effizienzgewinne der Kombination von Transfer Learning mit einem Broad Learning System unterstreicht.

Die Ergebnisse zeigten, dass E-BLS die Genauigkeit von 65,85 % auf 73,13 % verbesserte, während ER-BLS 74,69 % erreichte und alle verglichenen Modelle übertraf. Die Trainingszeit blieb deutlich niedriger als bei tiefen CNNs, bei etwa 1.300 Sekunden, im Vergleich zu mehreren Tausend bis über 25.000 Sekunden.

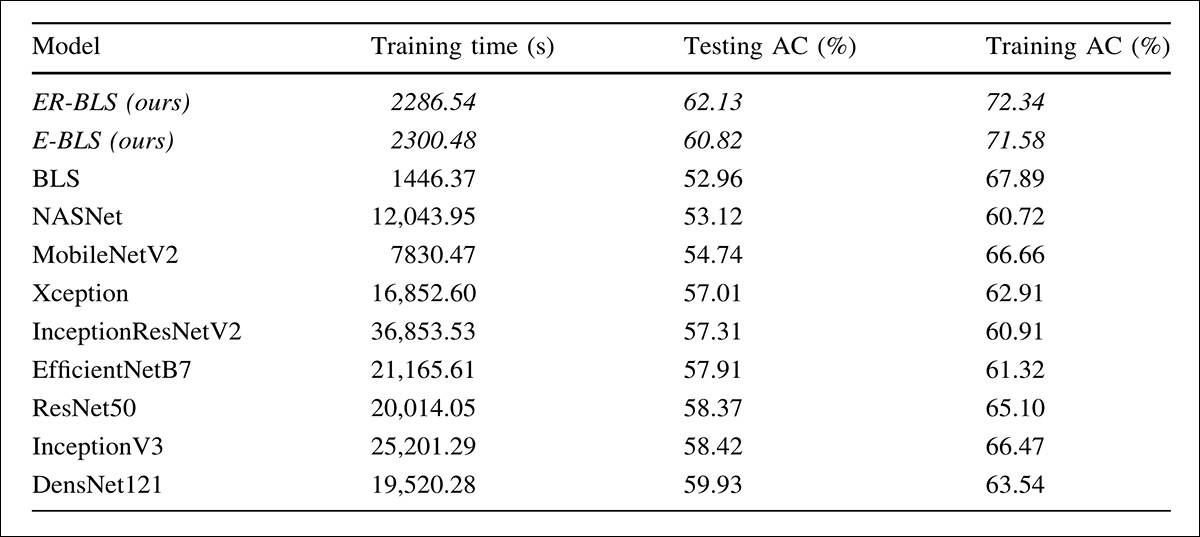

Für die Tests auf LSAFBD zeigten die Ergebnisse, dass E-BLS die Genauigkeit gegenüber dem einfachen BLS verbesserte, während ER-BLS die höchste Genauigkeit unter allen verglichenen Methoden erreichte:

Leistung auf LSAFBD, bei dem ER-BLS und E-BLS eine höhere Genauigkeit als alle Baseline- und Transfer-Learning-Modelle erreichen, während sie nur einen Bruchteil ihrer Trainingszeit benötigen, was einen konsistenten Vorteil in der Effizienz ohne Kompromisse bei der Vorhersagequalität zeigt.

Beide Varianten behielten eine wesentlich niedrigere Trainingszeit als tiefe CNN-Modelle, was auf einen effizienteren Ausgleich zwischen Leistung und Rechenkosten hinweist.

Schlussfolgerung

Dies ist in gewisser Weise eine ‘Rückkehr’ zur Publikation, wie durch die Verwendung von vor dem Boom favorisierten Methoden wie CNNs und durch die Verwendung der niedrigsten Trainingsausrüstung, die ich in einem neuen Paper in vielen Jahren gesehen habe, deutlich wird.

Trotzdem beschäftigt es sich mit einem überraschend widerstandsfähigen Ziel in der Computer-Vision; einem, das stark mit menschlicher Erfahrung und subjektiver Interpretation verbunden ist und das ein Schema erfordert, das über die ästhetischen Trends des Moments hinausgeht und eine wirklich widerstandsfähige Pipeline für die Aufgabe liefern kann.

Erstveröffentlicht am Donnerstag, 19. März 2026