Andersons Blickwinkel

Auf der Suche nach ‘Eulen und Eidechsen’ im Publikum eines Werbetreibenden

Da der Online-Werbebereich voraussichtlich 740,3 Milliarden USD im Jahr 2023 ausgegeben hat, ist es leicht verständlich, warum Werbeunternehmen erhebliche Ressourcen in diese spezielle Strang der Computer-Vision-Forschung investieren.

Obwohl die Branche abgeschlossen und schützend ist, veröffentlicht sie gelegentlich Studien, die auf fortgeschrittenere proprietäre Arbeiten in Gesichts- und Blickrichtungserkennung hinweisen – einschließlich Alterserkennung, die für demografische Analysestatistiken von zentraler Bedeutung ist:

Die Schätzung des Alters in einem Werbe-Kontext ist für Werbetreibende von Interesse, die möglicherweise eine bestimmte Altersdemografie ansprechen. In diesem experimentellen Beispiel der automatischen Altersschätzung wird das Alter des Künstlers Bob Dylan über die Jahre hinweg verfolgt. Quelle: https://arxiv.org/pdf/1906.03625

Diese Studien, die selten in öffentlichen Repositorien wie Arxiv erscheinen, verwenden rechtmäßig rekrutierte Teilnehmer als Grundlage für eine AI-gesteuerte Analyse, die darauf abzielt, zu bestimmen, in welchem Ausmaß und auf welche Weise der Zuschauer mit einer Anzeige interagiert.

Dlibs Histogramm der orientierten Gradienten (HoG) wird oft in Gesichtsschätzungssystemen verwendet. Quelle: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

Tierischer Instinkt

In diesem Zusammenhang ist die Werbeindustrie natürlich daran interessiert, falsche Positivergebnisse (Gelegenheiten, bei denen ein Analyse-System die Aktionen eines Subjekts falsch interpretiert) zu bestimmen und klare Kriterien für den Fall festzulegen, in dem die Person, die ihre Werbespots ansieht, nicht vollständig mit dem Inhalt interagiert.

Was die werbeorientierte Bildschirmwerbung betrifft, konzentrieren sich die Studien auf zwei Probleme in zwei Umgebungen. Die Umgebungen sind ‘Desktop’ oder ‘Mobile’, von denen jede besondere Merkmale aufweist, die spezielle Nachverfolgungslösungen erfordern; und die Probleme – aus Sicht des Werbetreibenden – werden durch Eulenverhalten und Eidechsenverhalten repräsentiert – die Neigung der Zuschauer, nicht vollständig auf eine Anzeige zu achten, die vor ihnen ist.

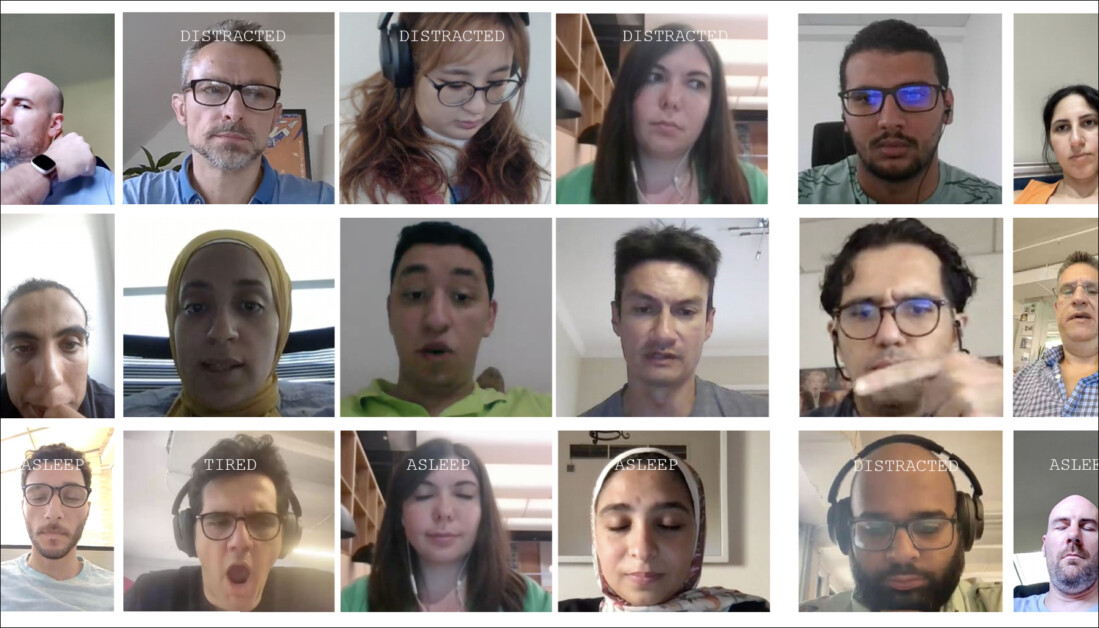

Beispiele für ‘Eulen’- und ‘Eidechsen’-Verhalten in einem Subjekt eines Werbeforschungsprojekts. Quelle: https://arxiv.org/pdf/1508.04028

Wenn Sie weg von der beabsichtigten Anzeige mit Ihrem ganzen Kopf schauen, ist dies ‘Eulenverhalten’; wenn Ihre Kopfhaltung statisch ist, aber Ihre Augen von der Bildschirm abirren, ist dies ‘Eidechsenverhalten’. In Bezug auf Analysen und Tests neuer Anzeigen unter kontrollierten Bedingungen sind diese wesentliche Aktionen für ein System, um sie erfassen zu können.

Ein neues Papier von SmartEyes Affectiva-Übernahme behandelt diese Fragen und bietet eine Architektur, die mehrere bestehende Frameworks nutzt, um einen kombinierten und verketteten Merkmalsatz über alle erforderlichen Bedingungen und möglichen Reaktionen bereitzustellen – und um zu bestimmen, ob ein Zuschauer gelangweilt, engagiert oder auf irgendeine Weise von dem Inhalt entfernt ist, den der Werbetreibende ihm zeigen möchte.

Beispiele für wahre und falsche Positivergebnisse, die vom neuen Aufmerksamkeitssystem für verschiedene Ablenkungssignale erkannt wurden, getrennt für Desktop- und Mobile-Geräte. Quelle: https://arxiv.org/pdf/2504.06237

Die Autoren erklären:

‘Begrenzte Forschung hat sich mit der Überwachung der Aufmerksamkeit während Online-Anzeigen beschäftigt. Während diese Studien sich auf die Schätzung der Kopfhaltung oder Blickrichtung konzentrierten, um Fälle von abgelenktem Blick zu identifizieren, vernachlässigen sie wichtige Parameter wie Gerätetyp (Desktop oder Mobile), Kameraposition relativ zum Bildschirm und Bildschirmgröße. Diese Faktoren beeinflussen die Aufmerksamkeitserkennung erheblich.

‘In diesem Papier schlagen wir eine Architektur für die Aufmerksamkeitserkennung vor, die die Erkennung verschiedener Ablenkungen umfasst, einschließlich des Eulen- und Eidechsenverhaltens des Blicks außerhalb des Bildschirms, des Sprechens, der Schläfrigkeit (durch Gähnen und verlängerte Augenschließung) und des Verlassens des Bildschirms.

‘Im Gegensatz zu früheren Ansätzen integriert unsere Methode gerätespezifische Merkmale wie Gerätetyp, Kameraposition, Bildschirmgröße (für Desktops) und Kameraneigung (für Mobile-Geräte) mit der Roh-Blickschätzung, um die Genauigkeit der Aufmerksamkeitserkennung zu verbessern.’

Die neue Arbeit trägt den Titel Überwachung der Zuschauer-Aufmerksamkeit während Online-Anzeigen und stammt von vier Forschern bei Affectiva.

Methode und Daten

Hauptsächlich aufgrund der Geheimhaltung und des geschlossenen Charakters solcher Systeme vergleicht die neue Studie den Ansatz der Autoren nicht direkt mit Konkurrenten, sondern präsentiert ihre Ergebnisse ausschließlich als Ablationsstudien; auch hält sich die Studie nicht an das übliche Format der Computer-Vision-Literatur. Daher werden wir uns die Forschung ansehen, wie sie präsentiert wird.

Die Autoren betonen, dass nur eine begrenzte Anzahl von Studien sich speziell mit der Aufmerksamkeitserkennung im Kontext von Online-Anzeigen beschäftigt hat. Im AFFDEX SDK, das eine Echtzeit-Multi-Face-Erkennung bietet, wird die Aufmerksamkeit allein aus der Kopfhaltung abgeleitet, wobei Teilnehmer als unaufmerksam gelabelt werden, wenn ihre Kopfwinkel einen definierten Schwellenwert überschreiten.

Ein Beispiel aus dem AFFDEX SDK, einem Affectiva-System, das auf die Kopfhaltung als Indikator für die Aufmerksamkeit setzt. Quelle: https://www.youtube.com/watch?v=c2CWb5jHmbY

In der 2019-Kollaboration Automatische Messung der visuellen Aufmerksamkeit für Videoinhalte mithilfe von Deep Learning wurde ein Datensatz von etwa 28.000 Teilnehmern erstellt, der für verschiedene unaufmerksame Verhaltensweisen annotiert wurde, einschließlich Blick abwenden, Augen schließen oder unbeachtete Aktivitäten, und ein CNN-LSTM-Modell trainiert, um die Aufmerksamkeit aus dem Gesichtsausdruck über die Zeit zu erkennen.

Aus dem 2019er-Papier, ein Beispiel, das die vorhergesagten Aufmerksamkeitszustände für einen Zuschauer zeigt, der Videoinhalte ansieht. Quelle: https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

Allerdings bemerken die Autoren, dass diese früheren Bemühungen nicht für Geräte-spezifische Faktoren wie den Gerätetyp (Desktop oder Mobile) oder die Bildschirmgröße berücksichtigt haben; auch haben sie die Kameraposition nicht berücksichtigt. Darüber hinaus konzentriert sich das AFFDEX-System ausschließlich auf die Erkennung von Blickablenkung und vernachlässigt andere Ablenkungsquellen, während die 2019er-Arbeit versucht, ein breiteres Spektrum von Verhaltensweisen zu erkennen – aber ihre Verwendung eines einzelnen, flachen CNN könnte, so das Papier, für diese Aufgabe unzureichend gewesen sein.

Die Autoren bemerken, dass einige der bekanntesten Forschungen in diesem Bereich nicht für Werbetests optimiert sind, die andere Anforderungen haben als Bereiche wie das Fahren oder die Bildung – wo Kameraposition und -kalibrierung normalerweise im Voraus festgelegt sind und stattdessen auf unkalierte Einrichtungen setzen und innerhalb des begrenzten Blickwinkels von Desktop- und Mobile-Geräten operieren.

Daher haben sie eine Architektur für die Erkennung der Zuschauer-Aufmerksamkeit während Online-Anzeigen entwickelt, die zwei kommerzielle Toolkits nutzt: AFFDEX 2.0 und SmartEye SDK.

Beispiele für Gesichtsanalyse aus AFFDEX 2.0. Quelle: https://arxiv.org/pdf/2202.12059

Diese vorherigen Arbeiten extrahieren niedrigstufige Merkmale wie Gesichtsausdrücke, Kopfhaltung und Blickrichtung. Diese werden dann in höherstufige Indikatoren umgewandelt, wobei jeder Ablenkungstyp von einem separaten binären Klassifizierer gehandhabt wird, der auf seinem eigenen Datensatz für unabhängige Optimierung und Bewertung trainiert wird.

Datensätze: Blick

Die Autoren verwendeten vier Datensätze, um das Aufmerksamkeitserkennungssystem zu trainieren und zu bewerten: drei konzentrierten sich auf Blickverhalten, Sprechen und Gähnen; und ein vierter, der aus realen Werbetestsitzungen bestand, die eine Mischung von Ablenkungstypen enthielten.

Aufgrund der spezifischen Anforderungen der Arbeit wurden benutzerdefinierte Datensätze für jede dieser Kategorien erstellt. Alle curatierten Datensätze stammten aus einem proprietären Repository mit Millionen von aufgezeichneten Sitzungen von Teilnehmern, die Anzeigen ansahen, in häuslichen oder Arbeitsumgebungen, mit einer webbasierten Einrichtung und mit informierter Zustimmung – und aufgrund der Einschränkungen dieser Zustimmungsvereinbarungen erklären die Autoren, dass die Datensätze für die neue Arbeit nicht öffentlich zugänglich gemacht werden können.

Um den Blick-Datensatz zu erstellen, wurden die Teilnehmer aufgefordert, einem sich bewegenden Punkt auf verschiedenen Punkten des Bildschirms zu folgen, einschließlich der Ränder, und dann vom Bildschirm wegzusehen, in vier Richtungen (nach oben, nach unten, nach links und nach rechts), wobei die Sequenz drei Mal wiederholt wurde. Auf diese Weise wurde die Beziehung zwischen Erfassung und Abdeckung hergestellt:

Bildschirmfotos, die den Blickvideo-Stimulus auf (a) Desktop- und (b) Mobile-Geräten zeigen. Die ersten und dritten Frames zeigen Anweisungen, um einem sich bewegenden Punkt zu folgen, während die zweiten und vierten die Teilnehmer auffordern, vom Bildschirm wegzusehen.

Die sich bewegenden Punkte wurden als aufmerksam und die außerhalb des Bildschirms liegenden Segmente als unaufmerksam markiert, was einen markierten Datensatz von sowohl positiven als auch negativen Beispielen ergab.

Jedes Video dauerte etwa 160 Sekunden, wobei separate Versionen für Desktop- und Mobile-Plattformen erstellt wurden, jeweils mit Auflösungen von 1920×1080 und 608×1080.

Insgesamt wurden 609 Videos gesammelt, darunter 322 Desktop- und 287 Mobile-Aufnahmen. Die Labels wurden automatisch auf der Grundlage des Videoinhalts angewendet, und der Datensatz geteilt in 158 Trainingsbeispiele und 451 für die Tests.

Datensätze: Sprechen

In diesem Zusammenhang ist eines der Kriterien, die ‘Unaufmerksamkeit’ definieren, wenn eine Person länger als eine Sekunde spricht (was ein momentanes Kommentar oder sogar ein Husten sein könnte).

Da die kontrollierte Umgebung weder Audio aufzeichnet noch analysiert, wird das Sprechen durch die Beobachtung der inneren Bewegung der geschätzten Gesichtsmerkmale abgeleitet. Daher erstellten die Autoren einen Datensatz, der ausschließlich auf visuellen Eingaben basiert, aus ihrem internen Repository und teilten ihn in zwei Teile: der erste Teil enthielt etwa 5.500 Videos, die von drei Annotatoren jeweils als sprechend oder nicht sprechend manuell beschriftet wurden (davon wurden 4.400 für die Trainings- und Validierung und 1.100 für die Tests verwendet).

Der zweite Teil umfasste 16.000 Sitzungen, die automatisch basierend auf der Sitzungsart beschriftet wurden: 10.500 zeigten Teilnehmer, die stumm Anzeigen ansahen, und 5.500 zeigten Teilnehmer, die ihre Meinung über Marken äußerten.

Datensätze: Gähnen

Obwohl es einige ‘Gähn’-Datensätze gibt, einschließlich YawDD und Driver Fatigue, behaupten die Autoren, dass keine davon für Werbetestszenarien geeignet sind, da sie entweder simulierte Gähnen oder Gesichtsverzerrungen enthalten, die mit Angst oder anderen, nicht gähnenden Aktionen verwechselt werden könnten.

Daher verwendeten die Autoren 735 Videos aus ihrem internen Bestand, wobei sie Sitzungen auswählten, die wahrscheinlich ein Kieferabsenken von mehr als einer Sekunde enthielten. Jedes Video wurde von drei Annotatoren manuell als aktives oder inaktives Gähnen beschriftet. Nur 2,6 Prozent der Frames enthielten aktives Gähnen, was die Klassenungleichheit unterstreicht, und der Datensatz wurde in 670 Trainingsvideos und 65 für die Tests aufgeteilt.

Datensätze: Ablenkung

Der Ablenkungs-Datensatz wurde ebenfalls aus dem internen Repository der Autoren gezogen, in dem Teilnehmer tatsächliche Anzeigen ohne zugewiesene Aufgaben ansahen. Insgesamt wurden 520 Sitzungen (193 auf Mobile- und 327 auf Desktop-Geräten) zufällig ausgewählt und von drei Annotatoren manuell als aufmerksam oder unaufmerksam beschriftet.

Unauffälliges Verhalten umfasste Blick außerhalb des Bildschirms, Sprechen, Schläfrigkeit und unbeachtete Bildschirme. Die Sitzungen umfassten verschiedene Regionen weltweit, wobei Desktop-Aufnahmen häufiger waren, aufgrund der flexiblen Webcam-Positionierung.

Aufmerksamkeitsmodelle

Das vorgeschlagene Aufmerksamkeitsmodell verarbeitet niedrigstufige visuelle Merkmale, nämlich Gesichtsausdrücke; Kopfhaltung; und Blickrichtung – extrahiert durch die oben genannten AFFDEX 2.0 und SmartEye SDK.

Diese werden dann in höherstufige Indikatoren umgewandelt, wobei jeder Ablenkungstyp von einem separaten binären Klassifizierer gehandhabt wird, der auf seinem eigenen Datensatz für unabhängige Optimierung und Bewertung trainiert wird.

Schema für das vorgeschlagene Überwachungssystem.

Das Blick-Modell bestimmt, ob der Zuschauer auf oder vom Bildschirm schaut, indem es normalisierte Blickkoordinaten verwendet, wobei separate Kalibrierungen für Desktop- und Mobile-Geräte verwendet werden. Dieser Prozess wird durch eine lineare Support-Vektor-Maschine (SVM) unterstützt, die auf räumlichen und zeitlichen Merkmalen trainiert wird und ein Speicherfenster integriert, um schnelle Blickbewegungen zu glätten.

Um Sprechen ohne Audio zu erkennen, verwendete das System Mundregionen und ein 3D-CNN, das auf konversationellen und nicht-konversationellen Videosegmenten trainiert wurde. Labels wurden basierend auf der Sitzungsart zugewiesen, wobei zeitliche Glättung die falschen Positivergebnisse reduzierte, die durch kurze Mundbewegungen entstehen können.

Gähnen wurde mithilfe von Vollgesichtsbildern erkannt, um breitere Gesichtsbewegungen zu erfassen, wobei ein 3D-CNN auf manuell beschrifteten Frames trainiert wurde (obwohl die Aufgabe durch das seltene Auftreten von Gähnen in natürlichen Szenen und durch seine Ähnlichkeit mit anderen Ausdrücken erschwert wurde).

Bildschirmverlassen wurde durch das Fehlen eines Gesichts oder einer extremen Kopfhaltung erkannt, wobei Vorhersagen durch einen Entscheidungsbaum gemacht wurden.

Endgültiger Aufmerksamkeitszustand wurde mithilfe einer festen Regel bestimmt: Wenn ein Modul Unaufmerksamkeit erkannte, wurde der Zuschauer als unaufmerksam markiert – ein Ansatz, der die Empfindlichkeit priorisiert und separat für Desktop- und Mobile-Kontexte justiert wurde.

Tests

Wie bereits erwähnt, folgen die Tests einem ablativen Ansatz, bei dem Komponenten entfernt und die Auswirkung auf das Ergebnis vermerkt werden.

Verschiedene Kategorien von wahrgenommener Unaufmerksamkeit, die in der Studie identifiziert wurden.

Das Blickmodell erkannte außerhalb des Bildschirms liegendes Verhalten durch drei wichtige Schritte: Normalisierung der Roh-Blickschätzungen, Feinabstimmung der Ausgabe und Schätzung der Bildschirmgröße für Desktop-Geräte.

Um die Bedeutung jeder Komponente zu verstehen, entfernten die Autoren sie einzeln und bewerteten die Leistung auf 226 Desktop- und 225 Mobile-Videos, die aus zwei Datensätzen gezogen wurden. Die Ergebnisse, gemessen durch G-Mittelwert und F1-Werte, sind unten aufgeführt:

Ergebnisse, die die Leistung des vollständigen Blickmodells sowie Versionen mit entfernten Verarbeitungsschritten zeigen.

In jedem Fall verringerte sich die Leistung, wenn ein Schritt entfernt wurde. Die Normalisierung erwies sich insbesondere auf Desktop-Geräten als besonders wertvoll, wo die Kameraposition variabler ist als auf Mobile-Geräten.

Die Studie bewertete auch, wie visuelle Merkmale die Vorhersage der Mobilkameraneigung beeinflussten: Gesichtsposition, Kopfhaltung und Augenblick erreichten 0,75, 0,74 und 0,60, während ihre Kombination 0,91 erreichte, was – so die Autoren – den Vorteil der Integration mehrerer Hinweise unterstreicht.

Das Sprechen-Modell, das auf vertikaler Lippenabstand trainiert wurde, erreichte eine ROC-AUC von 0,97 auf dem manuell beschrifteten Testset und 0,96 auf dem größeren automatisch beschrifteten Datensatz, was eine konsistente Leistung in beiden Fällen zeigt.

Das Gähnen-Modell erreichte eine ROC-AUC von 96,6 Prozent unter Verwendung des Mundaspektverhältnisses allein, was sich auf 97,5 Prozent verbesserte, wenn es mit Aktionseinheits-Vorhersagen von AFFDEX 2.0 kombiniert wurde.

Das Modell für das Verlassen des Bildschirms klassifizierte Momente als unaufmerksam, wenn sowohl AFFDEX 2.0 als auch SmartEye für mehr als eine Sekunde kein Gesicht erkennen konnten. Um dies zu bewerten, annotierten die Autoren alle solchen ‘kein Gesicht’-Ereignisse im realen Ablenkungs-Datensatz manuell und identifizierten die zugrunde liegende Ursache jeder Aktivierung. Zweideutige Fälle (wie Kamera-Blockierung oder Video-Verzerrung) wurden von der Analyse ausgeschlossen.

Wie in der Ergebnistabelle unten gezeigt, waren nur 27 Prozent der ‘kein Gesicht’-Aktivierungen auf Benutzer zurückzuführen, die den Bildschirm physisch verließen.

Verschiedene Gründe, die für das Fehlen eines Gesichts in bestimmten Fällen ermittelt wurden.

Das Papier erklärt:

‘Trotzdem wurden unbeachtete Bildschirme nur in 27 Prozent der Fälle ausgelöst, die das ‘kein Gesicht’-Signal auslösten, wurde es für andere Gründe ausgelöst, die auf Unaufmerksamkeit hindeuten, wie Teilnehmer, die mit einem extremen Winkel vom Bildschirm wegschauen, übermäßige Bewegungen ausführen oder ihr Gesicht erheblich mit einem Objekt/Händen verdecken.’

In dem letzten der quantitativen Tests bewerteten die Autoren, wie das progressiv Hinzufügen verschiedener Ablenkungssignale – außerhalb des Bildschirms liegendes Verhalten (durch Blick und Kopfhaltung), Schläfrigkeit, Sprechen und unbeachtete Bildschirme – die Gesamtleistung ihres Aufmerksamkeitsmodells beeinflusste.

Die Tests wurden auf zwei Datensätzen durchgeführt: dem realen Ablenkungs-Datensatz und einem Test-Teilmenge des Blick-Datensatzes. G-Mittelwert- und F1-Werte wurden verwendet, um die Leistung zu messen (obwohl Schläfrigkeit und Sprechen aus dem Blick-Datensatz-Test ausgeschlossen wurden, da sie in diesem Kontext nur begrenzt relevant waren).

Wie unten gezeigt, verbesserte sich die Aufmerksamkeitserkennung konsistent, wenn mehr Ablenkungstypen hinzugefügt wurden, wobei außerhalb des Bildschirms liegendes Verhalten den stärksten Basiswert bot.

Die Auswirkung des Hinzufügens verschiedener Ablenkungssignale zur Architektur.

Über diese Ergebnisse erklärt das Papier:

‘Erstens können wir aus den Ergebnissen schließen, dass die Integration aller Ablenkungssignale zu einer verbesserten Aufmerksamkeitserkennung beiträgt.

‘Zweitens ist die Verbesserung der Aufmerksamkeitserkennung konsistent über Desktop- und Mobile-Geräte hinweg. Drittens zeigen die mobilen Sitzungen im realen Datensatz erhebliche Kopfbewegungen beim Wegschauen, die leicht zu erkennen sind, was zu einer besseren Leistung auf Mobile-Geräten im Vergleich zu Desktop-Geräten führt. Viertens hat das Hinzufügen des Schläfrigkeitssignals eine relativ geringe Verbesserung im Vergleich zu anderen Signalen, da es normalerweise selten auftritt.

‘Schließlich hat das unbeachtete-Bildschirm-Signal eine relativ größere Verbesserung auf Mobile-Geräten im Vergleich zu Desktop-Geräten, da Mobile-Geräte leicht unbeachtet gelassen werden können.’

Die Autoren verglichen ihr Modell auch mit AFFDEX 1.0, einem früheren System, das in Werbetests verwendet wurde – und sogar die Kopfbasierte Blickerkennung des aktuellen Modells übertraf AFFDEX 1.0 auf beiden Gerätetypen:

‘Diese Verbesserung ist das Ergebnis der Integration von Kopfbewegungen in beiden yaw- und pitch-Richtungen sowie der Normalisierung der Kopfhaltung, um geringe Änderungen zu berücksichtigen. Die deutlichen Kopfbewegungen im realen mobilen Datensatz haben dazu geführt, dass unser Kopfmodell ähnlich wie AFFDEX 1.0 performt.’

Die Autoren schließen das Papier mit einer (vielleicht eher oberflächlichen) qualitativen Testrunde ab, die unten gezeigt wird.

Beispiele für Ausgaben des Aufmerksamkeitsmodells auf Desktop- und Mobile-Geräten, wobei jede Zeile Beispiele für wahre und falsche Positivergebnisse für verschiedene Ablenkungstypen zeigt.

Die Autoren erklären:

‘Die Ergebnisse zeigen, dass unser Modell verschiedene Ablenkungen in unkontrollierten Umgebungen effektiv erkennen kann. Es kann jedoch gelegentlich falsche Positivergebnisse in bestimmten Randfällen liefern, wie z.B. starkes Neigen des Kopfes bei gleichzeitigem Blick auf den Bildschirm, einige Mundverdeckungen, übermäßig verschwommene Augen oder stark verdunkelte Gesichtsbilder. ‘

Schlussfolgerung

Obwohl die Ergebnisse einen gemessenen, aber bedeutungsvollen Fortschritt gegenüber früheren Arbeiten darstellen, liegt der tiefere Wert der Studie in dem Blick, den sie in den anhaltenden Drang nach Zugang zum internen Zustand des Zuschauers bietet. Obwohl die Daten mit Zustimmung gesammelt wurden, weist die Methodik auf zukünftige Rahmenbedingungen hin, die über strukturierte, marktorientierte Umgebungen hinausgehen könnten.

Diese eher paranoide Schlussfolgerung wird durch die abgeschlossene, eingeschränkte und streng geschützte Natur dieser speziellen Forschungsrichtung noch verstärkt.

* Meine Umwandlung der Inline-Zitate der Autoren in Hyperlinks.

Erstveröffentlichung am Mittwoch, den 9. April 2025