人工智能

难以捉摸的“深度伪造”定义

一项来自德国的引人入胜的新研究批评了欧盟人工智能法案(EU AI Act)中“深度伪造”(deepfake)一词的定义过于模糊,特别是在数字图像操纵的背景下。作者认为,法案强调内容类似于真实人物或事件,但可能看起来是假的,这一定义缺乏明确性。

他们还指出,法案中关于“标准编辑”(即假设对图像进行的轻微AI辅助修改)的例外没有考虑到AI在消费者应用中的普遍影响以及艺术惯例的主观性,这些惯例在AI出现之前就已经存在。

关于这些问题的立法不够明确,会产生两个主要风险:一是“寒蝉效应”,即法律的广泛解释范围会扼杀创新和新系统的采用;二是“违法效应”,即法律被视为过度或不相关而被忽视。

在任何情况下,模糊的法律实际上将建立实际法律定义的责任转嫁给未来法院判决——这是立法中的一个谨慎和规避风险的方法。

基于AI的图像操纵技术仍然明显领先于立法解决它们的能力。例如,论文观察到一个值得注意的例子是“场景优化器”(Scene Optimizer)功能,它集成在最近的三星相机中,可以用AI驱动的“精细”图像替换用户拍摄的月亮图像(一个具有挑战性的主题):

<img class=" wp-image-210152" src="https://www.unite.ai/wp-content/uploads/2024/12/samsung-moon-photo.jpg" alt="左上,新论文中真实用户拍摄的月亮图像,与左边的三星增强版本自动创建的Scene Optimizer相比;右边,三星官方对此过程的插图;下左,Reddit用户u/ibreakphotos的例子,显示(左)故意模糊的月亮图像和(右)三星重新想象的图像——尽管源图像不是真正的月亮,而是一个监视器的图像。来源(从左上开始):https://arxiv.org/pdf/2412.09961;https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/;https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

在上面的图像左下角,我们看到两张月亮图像。左边的图像是Reddit用户拍摄的,图像被用户故意模糊和降低分辨率。

右边的图像是用三星相机拍摄的,具有AI驱动的后处理功能。相机已经自动“增强”了识别出的“月亮”对象,即使它不是真正的月亮。

论文对谷歌最近智能手机中集成的“最佳拍摄”(Best Take)功能提出更深刻的批评——一个有争议的AI功能,它编辑组照片的“最佳”部分,扫描多个秒的摄影序列,以便必要时可以向前或向后移动微笑,并且没有人被显示在眨眼的中间。

论文认为,这种合成过程有可能歪曲事件:

‘在典型的组照设置中,平均观众可能仍然会认为生成的照片是真实的。插入的微笑在照片被拍摄的几秒钟内存在。’

‘另一方面,最佳拍摄功能的10秒时间框架足以改变情绪。一个人可能已经停止微笑,而其他人则在嘲笑他。’

‘因此,我们假设这种组照可能构成一个深度伪造。’

新论文题为《什么构成了深度伪造?在欧盟AI法案下合法处理和操纵之间的模糊界线》,由图宾根大学和萨尔兰大学的计算法学实验室的两位研究人员撰写。

旧技巧

操纵时间在摄影中远比消费级AI更古老。论文作者指出,存在许多更古老的技术,可以被认为是“不真实的”,例如将多个连续图像连接成一个高动态范围(HDR)照片,或一个“拼接”的全景照片。

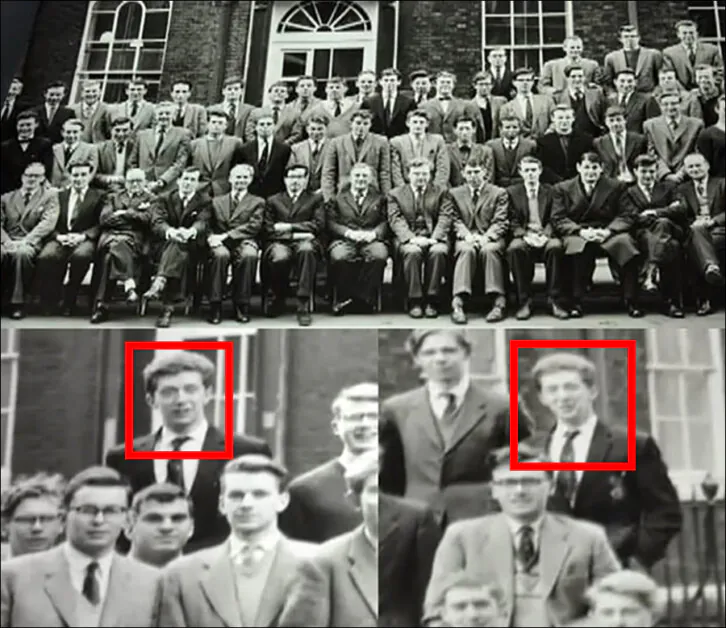

事实上,一些最古老、最有趣的摄影伪造品都是由学生通过跑到学校团体照的另一端,在特制的全景相机前面——这些相机曾经用于体育和学校团体摄影——而创造出来的,使得学生可以在同一张图像中出现两次:

在团体照中欺骗全景相机的诱惑对于许多学生来说太大了,他们愿意冒着被叫到校长办公室的风险来“克隆”自己在学校照片中。 来源:https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

除非您以RAW模式拍摄,否则基本上将相机镜头传感器转储到一个非常大的文件中,没有任何解释,否则您的数字照片可能不是完全真实的。相机系统通常会应用“改进”算法,例如图像锐化和白平衡,默认情况下会这样做——并且自消费级数字摄影的起源以来就一直如此。

论文作者认为,即使这些较旧的数字照片增强技术也不代表“现实”,因为这些方法的设计目的是使照片更令人愉悦,而不是更“真实”。

研究表明,欧盟AI法案,即使在后来的修正案中(例如参考资料123-27),将所有摄影输出置于一个不适合摄影产生的背景的证据框架中,而不是(名义上的)客观性安全摄像头或法医摄影。大多数由AI法案解决的图像更可能源自制造商和在线平台积极促进创意照片解释的背景,包括使用AI。

研究人员建议,照片“从来都不是现实的客观描绘”。诸如相机位置、所选的景深和照明选择等因素都会使摄影变得非常主观。

论文观察到,常规的“清理”任务——例如从一个整体上拍摄的场景中删除传感器灰尘或不想要的电线——在AI兴起之前只被半自动化:用户必须手动选择一个区域或启动一个过程来实现他们期望的结果。

今天,这些操作通常由用户的文本提示触发,尤其是在Photoshop等工具中。在消费级别上,这些功能越来越多地在没有用户输入的情况下自动化——这似乎被制造商和平台视为“显然理想”的结果。

“深度伪造”的含义被稀释

围绕AI修改和AI生成图像的立法面临的一个核心挑战是“深度伪造”一词的模糊性。在过去两年中,其含义已经显著扩展。

最初,这些术语仅适用于来自基于自动编码器的系统(如DeepFaceLab和FaceSwap)的视频输出,这些系统源自2017年末在Reddit上发布的匿名代码。

从2022年开始,潜在扩散模型(LDMs)的出现,例如稳定扩散和Flux,以及文本到视频系统,例如Sora,也可以实现身份交换和定制,具有提高的分辨率、多样性和保真度。现在可以创建扩散模型,以描绘名人和政客。由于“深度伪造”一词已经成为媒体制作人的头条宝藏,因此它被扩展以涵盖这些系统。

后来,在媒体和研究文献中,这个术语也包括了基于文本的模仿。到这一点,“深度伪造”的原始含义已经基本丢失,而其扩展含义不断演变,日益被稀释。

但是,由于这个词语如此具有煽动性和凝聚力,并且已经成为一个强大的政治和媒体焦点,因此放弃它是不可行的。它吸引了网站的读者,研究人员的资金,并引起了政客的关注。这种词汇上的模糊性是这项新研究的主要焦点。

正如作者所观察到的,欧盟AI法案第3(60)条概述了定义“深度伪造”的四个条件。

1:真月

首先,内容必须是生成或操纵的,即使用AI从头创建(生成)或从现有数据修改(操纵)。论文强调了区分“可接受”的图像编辑结果和操纵性深度伪造的困难,因为数字照片在任何情况下都不是现实的真实表现。

论文认为,三星生成的月亮图像可以被认为是真实的,因为月亮不太可能改变外观,而且AI生成的内容经过训练可以生成真实的月亮图像,因此可能是准确的。

然而,作者们也指出,由于三星系统已被证明可以在源图像不是月亮本身的情况下生成“增强”的月亮图像,因此这将被视为“深度伪造”。

将这种特定功能的不同用例全部列出是不切实际的。因此,定义的负担似乎再次转移到法院。

2:文本伪造

其次,内容必须是图像、音频或视频的形式。文本内容虽然受其他透明度义务的约束,但在AI法案下不被视为深度伪造。这一点在新研究中没有详细讨论,尽管它可能对视觉深度伪造的有效性产生重大影响(见下文)。

3:现实世界问题

第三,内容必须类似于现实中的人物、物体、地点、实体或事件。这一条件与现实世界建立了联系,意味着纯粹虚构的图像,即使是照片般逼真的,也不符合深度伪造的定义。欧盟AI法案第134条强调了“类似”的方面,添加了“显著”一词(这似乎是对后续法律判决的让步)。

作者们引用了早期工作,考虑到AI生成的面部是否需要属于真实的人,或者是否只需要与真实的人足够相似,以满足这一定义。

例如,如果一系列照片逼真地描绘了政治家唐纳德·特朗普,但图像(或附加文本)没有具体提到他,我们如何确定这些图像是为了模仿他?是通过面部识别?用户调查?法官的“常识”定义?

回到“文本伪造”问题(见上文),文字通常构成了视觉深度伪造行为的重要部分。例如,可以取一张(未修改的)“人A”的图像或视频,并在字幕或社交媒体帖子中说这张图像是“人B”的(假设这两个人相似)。

在这种情况下,不需要AI,结果可能非常有效——但这种低科技方法是否也构成了“深度伪造”?

4:修饰,重塑

最后,内容必须看起来真实或真诚。这一条件强调了人类观众的感知。内容如果只被算法识别为代表真实的人或物体,而不是被人类识别的,则不被视为深度伪造。

在3(60)条中的所有条件中,这一条件最明显地推迟到后来的法院判决,因为它不允许通过技术或机械手段进行任何解释。

很明显,在这种主观规定上达成共识存在一些固有的困难。作者指出,不同的人和不同类型的人(例如儿童和成年人)可能以不同的方式倾向于相信特定的深度伪造。

作者进一步指出,像Photoshop这样的工具的高级AI功能挑战了“深度伪造”的传统定义。虽然这些系统可能包含基本的保护措施,以防止有争议或禁止的内容,但它们极大地扩展了“修饰”的概念。用户现在可以以非常令人信服和照片般逼真的方式添加或删除物体,达到专业水平的真实性,从而重新定义图像操纵的界限。

作者指出:

‘我们认为,AI法案中对深度伪造的当前定义和相应的义务还不够明确,以应对深度伪造带来的挑战。通过分析数字照片从相机传感器到数字编辑功能的生命周期,我们发现:’

‘(1)深度伪造在欧盟AI法案中没有明确定义。定义留下了太多关于什么是深度伪造的空间。’

‘(2)不清楚如何将Google的“最佳拍摄”功能等编辑功能视为透明度义务的例外。’

‘(3)对实质性编辑内容的例外引发了人们对什么构成了内容的实质性编辑以及这种编辑是否必须被自然人察觉到的疑问。’

例外

欧盟AI法案包含作者认为可以非常宽松的例外。他们指出,第50(2)条为大多数原始源图像未被修改的案例提供了例外。

作者指出:

‘在数字音频、图像和视频的情况下,第50(2)条中“内容”的含义是什么?例如,在图像的情况下,我们是否需要考虑像素空间或人类可感知的视觉空间?像素空间中的实质性操作可能不会改变人类的感知,另一方面,像素空间的小扰动可能会显著改变感知。’

研究人员提供了一个例子,即在一个人指向某人的照片中添加一把手枪。通过添加手枪,改变的图像仅为5%;然而,改变的部分的语义意义是显著的。因此,似乎这一例外没有考虑到任何“常识”理解,即一个小细节可以对图像的整体意义产生重大影响。

第50(2)条还允许对“标准编辑”的辅助功能进行例外。由于该法案没有定义“标准编辑”的含义,因此作者观察到,即使像Google的最佳拍摄功能这样的极端后处理功能,也似乎受到这一例外的保护。

结论

这项新工作的既定目标是鼓励围绕深度伪造监管的跨学科研究,并作为计算机科学家和法律学者之间新对话的起点。

然而,这篇论文本身在几个地方陷入了循环论证:它经常使用“深度伪造”一词,好像其含义是自明的,同时批评欧盟AI法案未能定义什么构成了深度伪造。

首次发布于2024年12月16日,星期一