思想领袖

实用可防御LLM输出的游戏规则

大多数企业GenAI部署中存在一个潜在的假设:如果输出看起来正确,那么它就是正确的。在低风险环境中,这是一个合理的捷径。在受监管的行业中,例如医疗保健、金融、制药和质量保证,这是一个潜在的责任。

当LLM输出影响临床决策、财务记录或合规文件时,流畅性不再是可靠性的代理。 当审计员、监管机构或法律团队询问使用了什么数据、应用了什么规则以及谁批准了它时,“模型说了”不是任何人可以签署的答案。

这是大多数GenAI团队没有设计的问责_gap_. 这是如何关闭它的。

为什么“看起来正确”是错误的标准

传统的AI评估关注准确性、延迟和成本。这些很重要。但是在受监管的环境中,引入了一个其他轴不能替代的第四个轴:可审计性。

欧盟AI法案现已生效,要求高风险AI系统在其整个生命周期中维护技术文档、跟踪日志和人类监督的证据。 FDA关于AI在药物和生物制剂开发中的首份指导草案也表明了生命科学领域的相同方向。这些框架不根据流畅性评级。它们需要可以被重构、检查和辩护的系统。

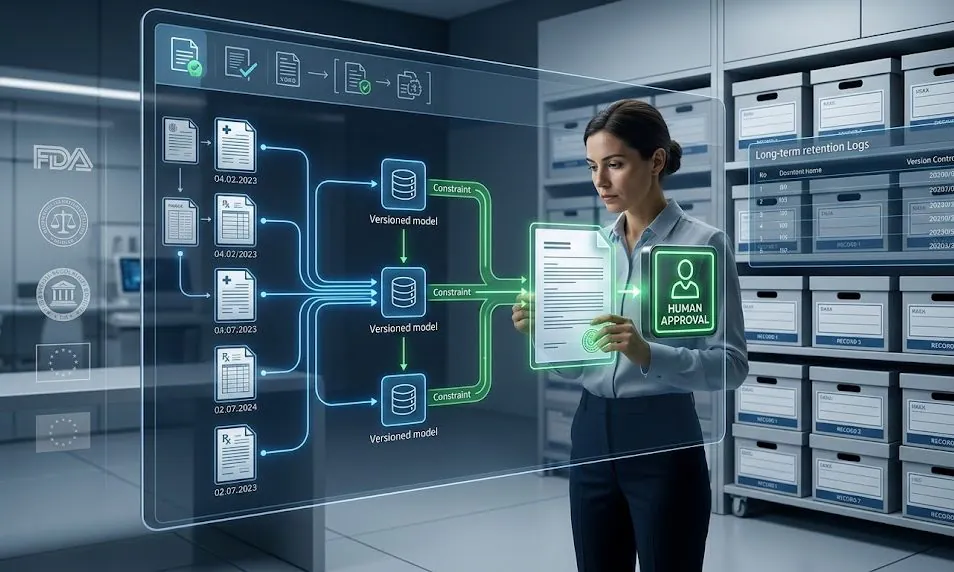

一个可防御的LLM输出是可以通过可验证的证据链追溯的:它从哪里获取数据、什么约束塑造了它、谁审查了它以及什么被保留用于未来检查。没有这种链,即使正确的输出也是不可防御的。

这重新定义了什么是“生产就绪”实际上意味着在受监管的环境中AI。

审计准备GenAI的四大支柱

构建可防御的LLM系统归结为四个工程要求。它们不是抽象原则 – 它们是基础设施决策,决定您的系统是否可以经受审查。

1. 证源:控制模型获取信息的来源

企业AI中最常见的故障模式也是最不显眼的:模型从一般知识或松散定义的数据源中获取信息。当没有受控的知识边界时,输出无法追溯到任何可审计的源,重构变得不可能。

一个实用的解决方案是建立一个批准的知识边界:版本化、所有权文档和数据集,系统被明确允许使用。每个答案都应带有最低证据包:源标识符,版本和有效日期,检索日志显示什么被查询和选择,以及内联引用。一个有用的操作规则:没有引用,就没有声明。

这将系统从基于内存的生成转换为基于证据的推理。当有人需要重构特定的输出几周或几个月后生成时,这个区别变得至关重要。

2. 约束:用受控行为替换即兴发挥

LLM的设计目的是令人信服的。没有约束,它们会优化可信度,而在受监管的上下文中,可信度就是风险所在。

约束是将概率文本生成器转换为有界执行组件的机制。在实践中,这意味着:

- 源绑定生成:每个声明都需要批准的、版本化的源。没有源就没有答案 – 只有拒绝或升级。

- 结构化输出模式:响应遵循定义的格式,机器和审计员可以验证,而不仅仅是阅读。

- 信任边界执行:检索的内容被视为输入,直接解决了可能破坏安全性和可审计性的提示注入风险。

- 最小特权访问:模型仅与其真正需要的数据和工具交互,保持审计跟踪清晰。

约束不是合规的复选框。它们是决定系统是否可以被审计的架构决策。

3. 审查:使人类监督成为正式的控制层

在受监管的AI中,人类审查不能是临时的。它需要风险分层(更高风险的输出触发更严格的验证)和事件驱动,当模型置信度低、源缺失或异常被检测到时激活。

欧盟AI法案明确要求,人类能够解释、覆盖和停止AI驱动的决策,在高风险使用场景中。满足该要求意味着审查记录需要捕获谁批准了输出、在什么条件下以及以什么级别的审查。“有人检查了它”不是控制。一个记录的、时间戳的审查记录是。

这将审查从手动QA提升到正式的治理层,这正是监管机构开始对其的处理方式。

4. 保留:使问责制持久

没有日志,就没有审计跟踪。没有审计跟踪,问责制是理论上的。

同时,保留所有内容会带来自己的风险,特别是在敏感的健康或财务数据受到像GDPR或HIPAA这样的框架的最小化要求时。

实用的方法是分层模型。始终存储模型和版本元数据、源标识符、策略决策和时间戳。根据风险分类有选择地存储交互内容(提示、输出和完整跟踪),并应用适当的编辑和访问控制。目标是使输出能够在不过度收集数据的情况下重构。

实践中的应用

考虑一下这如何应用于生命科学领域,CFR 21 Part 11要求电子记录是可归属的、可读的、同时的、原始的和准确的。生成监管文档的LLM必须满足所有五个标准 – 不仅仅是产生可读的文本。

在这种情况下,四大支柱不是可选的增强功能。它们是合规系统的最低标准。证源确保输出是可归属的和原始的。约束确保它保持在定义的边界内。审查确保它是同时的,具有人类的监督。保留确保它是可读的和可检查的。

同样的逻辑也适用于金融服务领域,MiFID II要求记录决策和决策背后的理由,以及医疗保健领域,临床决策支持系统面临着日益严格的可解释性和偏见审查。

更大的转变

GenAI正在从实验转向运营基础设施。这一转变提高了可接受系统的标准。

一个有用的输出不再足够。组织需要可以在审查下解释、追溯和辩护的输出,因为AI被要求做出真正有后果的事情。

从一开始就设计为可防御的团队将能够安全地扩展AI并保持监管信任。那些不这样做的团队最终会面临同样的时刻:一次审计,关于特定输出的一个直接问题,以及没有什么可展示的。

构建审计准备好的AI不是关于减慢速度。这是关于构建能够经久不衰的东西。