Anderson 视角

像1999年一样流式传输AI头像

新的研究提出了一种方法,可以流式传输逼真的3D头像,这些头像几乎可以立即出现,并可以实时细化,而不是强迫用户等待大量下载完成。

在很多方面,生成式AI和AI辅助渲染系统的巨大资源需求使得消费者准备好接受二十年前的技术;仅在2023年,一台笔记本电脑或台式机的64GB RAM配置似乎是过度的;现在,随着RAM和/或CPU卸载的日益流行,64GB对于本地AI需求来说已经相当谦逊;而这些曾经平凡且价格合理的PC组件继续以火箭般的价格上涨,因为公司难以满足AI服务的需求。

AI和其过程以及环境的规模和贪婪通常超过消费级硬件,即使运行“精简”的本地模型,如GGUF版本,也会给平均系统带来很大的压力。

甚至基于文本的AI服务,如ChatGPT,也会在客户端和服务器端受到显著的压力。因此,当AI被要求在实时提供在线多媒体体验时,我们可以合理地预期会有一些严重的折衷,包括延迟和/或质量——类似于互联网早期与流媒体媒体的斗争,以及RealPlayer和QuickTime的令人讨厌的动画“缓冲”图标。

上一次多媒体和网络问题在用户体验中造成摩擦时,消费级硬件仍在通过摩尔定律演进,几乎每年都在指数级提高,即使操作系统、网络和其他支持基础设施也在不断演进以满足需求;而在过去的十年里,消费技术的能力已经超过了多媒体的需求(也许甚至到了需要激发以维持销售的程度)。

但这种本地能力的过剩可能很快就会结束,因为本地硬件变得低配和更昂贵,而AI基于服务需要更高的服务器端和本地资源。

领先一步

在宽带互联网时代之前,甚至在最早的可用流媒体视频之前,网页用户已经习惯于图像逐渐变得清晰,因为渐进式JPEG允许带宽受限的用户观看下载的图像形成,有时非常缓慢,因为更多的图像数据被加载到本地。

现在,似乎我们可能会经历类似的体验,使用AI辅助的高斯斑点头像:

点击播放。 来自新的ProgressiveAvatars项目,比较流式传输高斯头像。左边,较旧的GaussianAvatars项目慢慢获取新数据,但在数据构建时看起来很糟糕;右边,Progressive Avatars版本也慢慢构建细节,但以一种智能的方式,即使从一开始就能给出基本的人类外观。 来源

上面我们看到两种基于高斯斑点的头像——一种人类表示,部分由非AI渲染技术实现,例如早期1990年代的技术,并结合了现代方法,例如FLAME参数化人体模型和AI基于训练方法:

在上面的视频中,我们可以看到传统的高斯斑点头像实现方式在等待数据加载时看起来相当糟糕。相比之下,中国的一个新实现,称为ProgressiveAvatars,可以更优雅地解决这个问题,首先呈现一个非警报的人类图像。

作者声称,他们的方法是首次真正“流式传输”高斯头像,并且也是首次以渐进方式进行,这种方式可以优雅地构建图像,并且可以优先考虑最重要的区域,例如眼睛和嘴唇,以便头像可以变得对话式,即使只部分加载:

点击播放。 来自ProgressiveAvatars项目网站,注意力感知加载的插图。

在此之前,之前的尝试中使用了一种“细节级别”(LOD)方法来精简“GSplat”头像,类似于视频游戏优化,其中成功ively更详细的版本的人会根据他们占据的视口或查看者注意力而加载。

当然,这需要大量的冗余“备用”头像,作者将他们的方法框定为一个更理性的系统。这种方法的含义是,也允许对GSplat人物(即自定义)进行更改,而无需将这些更改传播到各种LOD“双胞胎”链中。

新兴领域

如果这看起来像是一个小众问题,那么流媒体视频在早期也是如此,当时让最早的插件工作被委托给了附近的书呆子。此外,基于AI的流媒体表示的潜力不仅限于人类头像,还包括城市生成、游戏和3D基于的几乎任何在线领域,例如虚拟试穿,用于服装购物:

点击播放。 来自2024年项目的粗略看未来在线“试穿”。其他项目旨在添加运动和交互性——这些是流媒体和管理的要求。 来源

就像LOD基于方法一样,主要被视频游戏所利用,许多其他考虑因素曾经是游戏开发的专属领域,可能会转移到基于斑点的表示中。例如,大多数这些早期GSplat出场都描绘了一个单个人类,但是许多情况下将需要多个人类,以及环境特征和氛围——一个需要高性能的“优先级”系统来确定流媒体数据需要优先考虑哪里,以便让查看者保持在场景中。

新论文的标题是ProgressiveAvatars:渐进式动画3D高斯头像,来自中国科学技术大学的三个研究人员。

方法

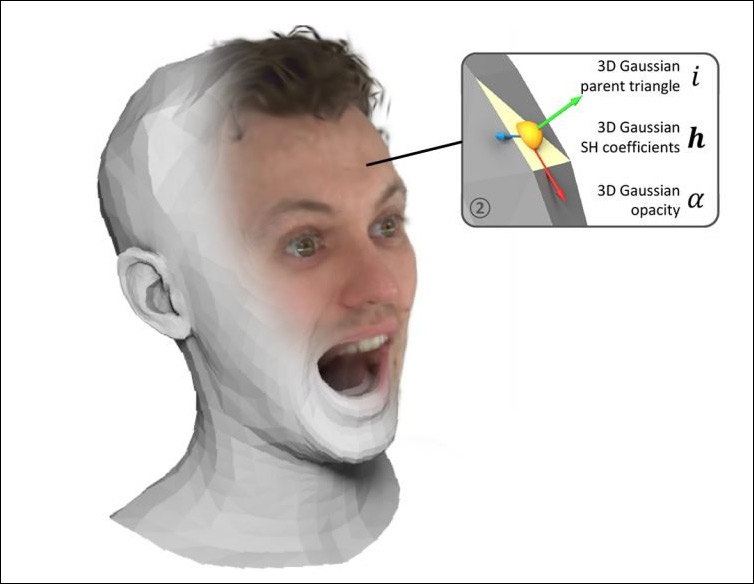

该方法最初利用人的头部视频。对于每一帧,一个标准的FLAME参数化面部模型被拟合,以便形状和表情随时间变化,而底层网格结构保持不变。由于基础拓扑结构不会改变,一个稳定的FLAME模板可以被重用和改进,而不是在每一刻从头开始重建,如同在类似的前期工作中:

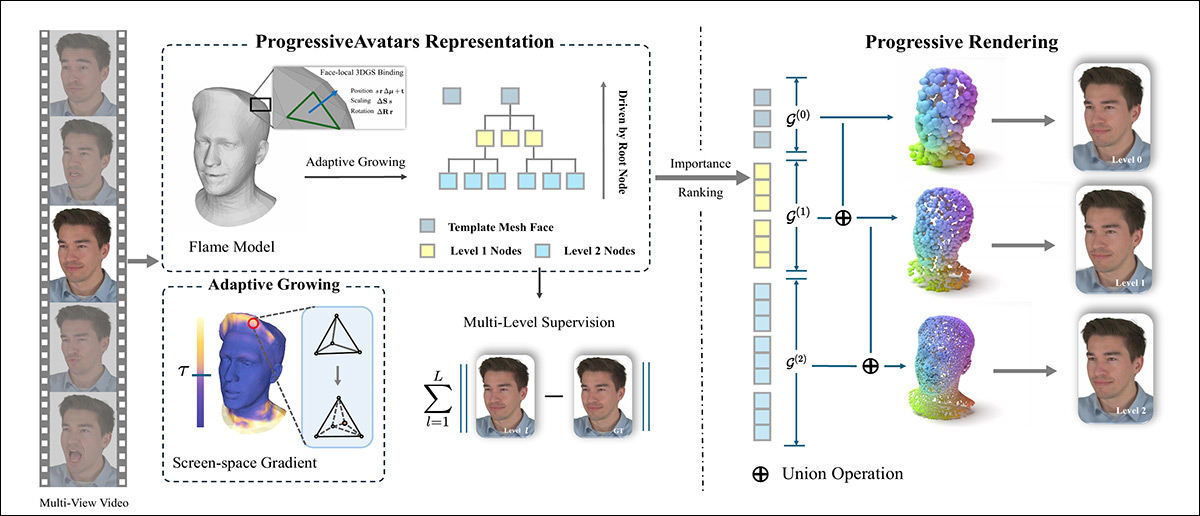

头部视频首先与跟踪的FLAME网格匹配,然后在每个面部附加3D高斯体,并在屏幕空间梯度指示缺失细节的地方进行分层增长。在训练期间,这种自适应的细分构建了一个多级表示,在多视图监督下,并在推理期间,根据每个面的重要性评分确定哪些高斯体首先被流式传输,允许头像快速出现并渐进式地细化,因为更高的细节级别被添加。

在这个基础结构上,细节被分层添加;表面被隐式地划分为一个层次结构,并且小的三维高斯体被附加到每个细节级别的面部。

虽然初始的较粗略的层次捕捉到了整体的头部形状和运动,随后的更细的层次提供了皱纹、细微的变形和高频纹理。然后使用可微分的高斯光栅器从这些高斯体渲染图像,并在多视图真实图像下训练,以便头像学会复制真实的人的外观。

在训练期间,这个层次结构会自动增长:需要更多细节的区域会被进一步细分,受屏幕空间信号的指导,以便计算努力集中在查看者的眼球最可能注意到错误的地方。

在推理期间,这个层次结构使得渐进式流式传输成为可能,其中头像的粗略版本可以首先被显示,然后,当额外的层被加载时,新的高斯体可以被添加,而不改变已经显示的内容,使得头像可以快速出现,并随着更多数据到达而变得更清晰和更详细。

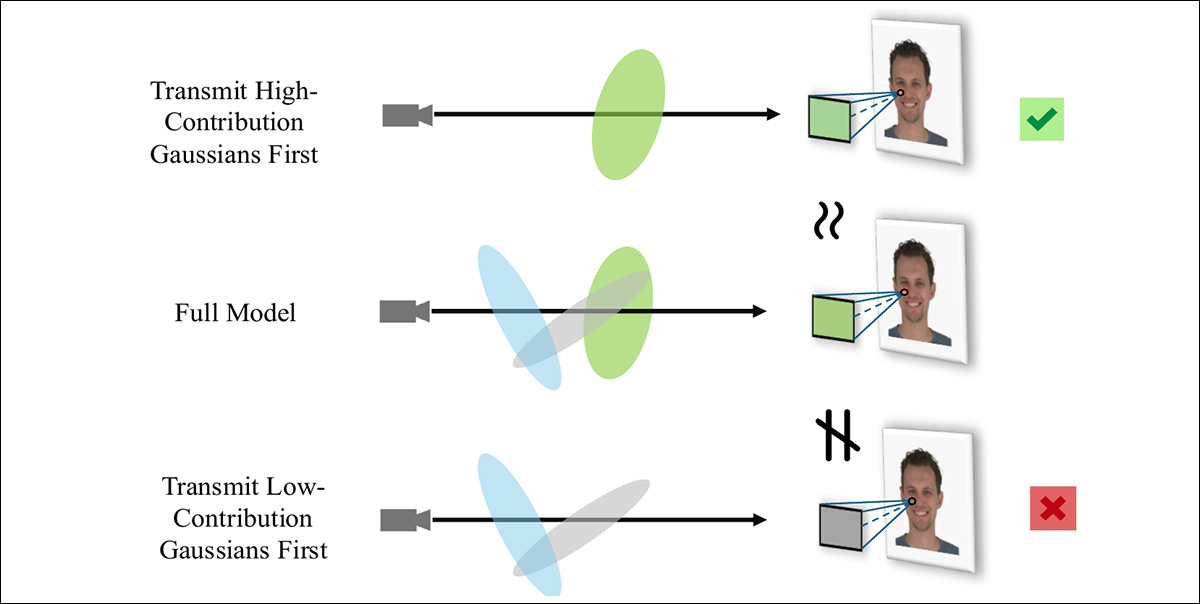

作者观察到,整个系统取决于传入数据的优先级:

当所有给定级别的高斯体都可用时,完整的模型以最大保真度渲染;但是,在流式传输期间,首先发送贡献最大的高斯体允许早期的部分结果与最终图像非常接近,而首先传输贡献最小的高斯体会扭曲色彩平衡并强调次要组件。

数据和测试

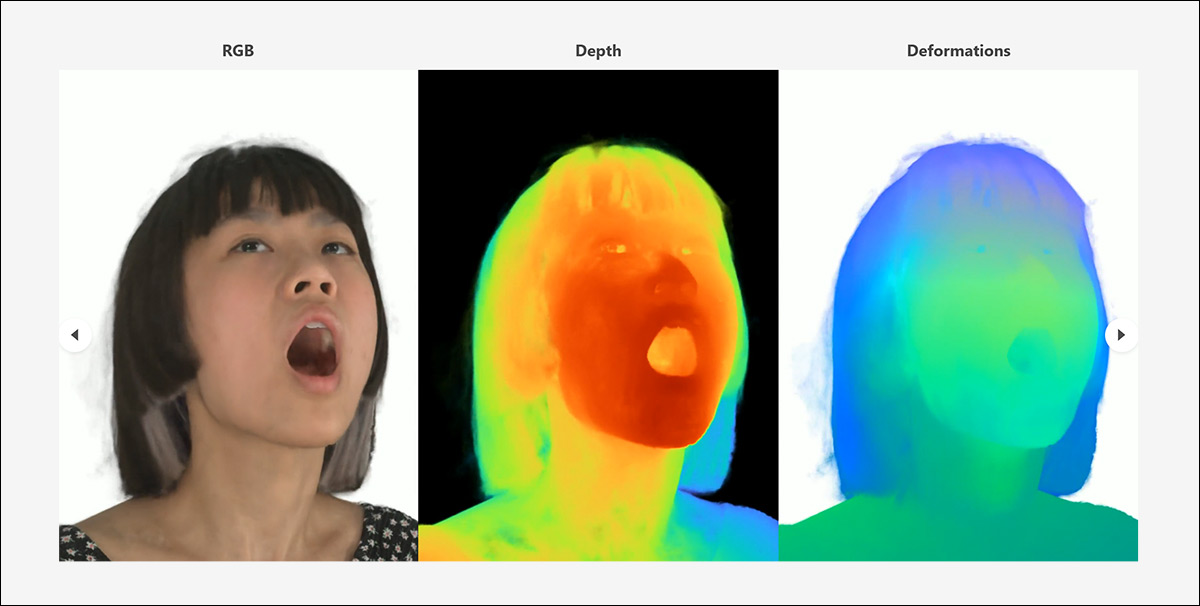

为了测试,新的方法在NeRSemble数据集上进行了评估,该数据集包含每个主题的多视图视频,具有校准的参数:

ProgressiveAvatars测试中使用的NeRSemble数据集的不同主题解释示例。 来源

与原始GaussianAvatars方法一致,图像被下采样到802x550px,生成前景掩码,并采用原始项目的训练/测试分割。

Adam优化器用于参数更新,所有学习率为1×10-2。训练运行了60,000次迭代,每2,000次迭代,层次结构会自动扩展。

最初,作者测试了重构和动画——将平面视频转换为3D感知(x/y/x)系统的任务,使用FLAME的规范CGI表示作为锚定网格。对于此任务,所有基线都从头开始训练,竞争框架测试了上述GaussianAvatars和PointAvatar。

对于这些测试,使用的指标是峰值信噪比(PSNR)、结构相似性指数(SSIM)和学习感知图像补丁相似性(LPIPS):

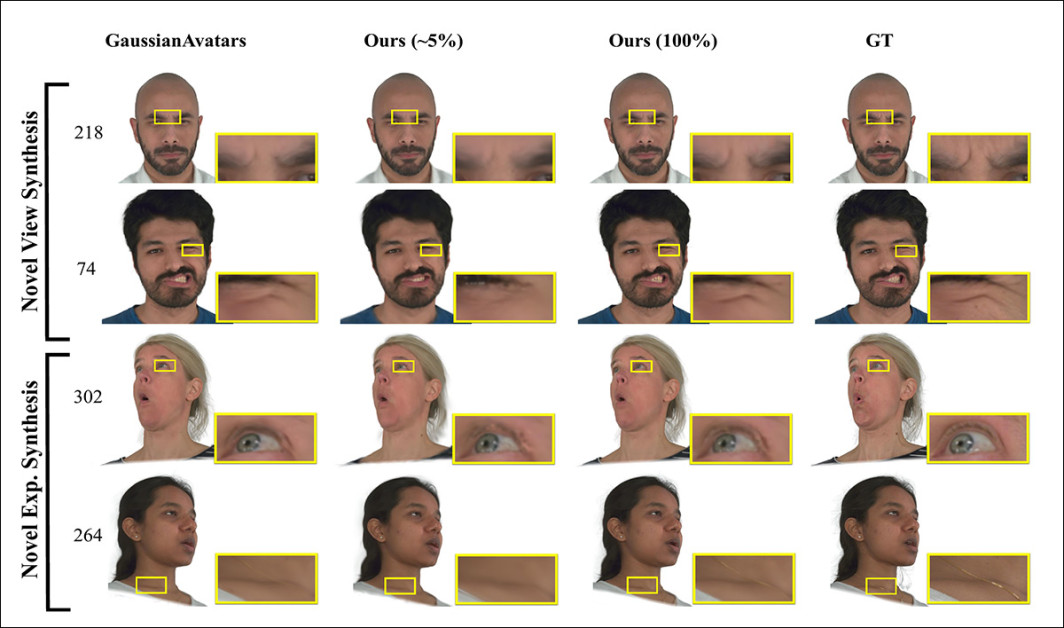

在新视图和新表情合成中进行的定性比较。基线GaussianAvatars在眼睛、皱纹和皮肤纹理周围的细节方面挣扎,而所提出方法已经在大约五%的传输数据中保留了关键的面部结构,并随着更多高斯体的流式传输而收敛到接近真实图像和参考图像(真实图像)。

关于这些结果,作者断言:

‘[我们的]方法在几个区域重构了更清晰的细节,特别是在颈部、肩部和衣服周围。这些区域在FLAME模板中相对于高显著性面部区域(例如周围眼区域)而言被粗略地划分。

‘因此,之前的方法通常为这些区域分配太少的3D高斯体,以忠实地捕捉它们的细节。相比之下,我们的自适应生长策略增加了高斯体的数量,并仅在需要时改进层次结构,使得分配对FLAME的非均匀划分不敏感。’

作者进一步指出,他们的方法与最先进的方法相当,仅需5%的带宽就可以获得可用的头像:

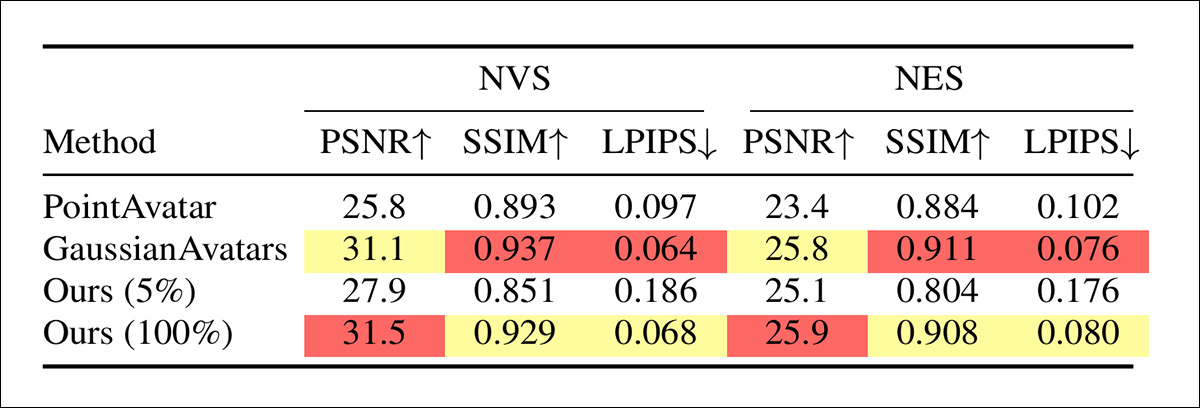

在新视图合成和新表情合成中使用PSNR、SSIM和LPIPS进行的定量比较。在两个任务中,所提出方法在完全传输时获得最高的PSNR,并在感知度量中与GaussianAvatars竞争,而5%的设置说明了在极端带宽约束下的质量权衡。

接下来,研究人员测试了渐进式渲染本身。这是在NVIDIA RTX 4090上进行的,具有24Gb的VRAM,在550x802px的分辨率下。作者指出,在这种情况下,25%的预算将使用所有“级别1”的高斯体,以及“级别2”的高斯体的一个子集,这给出了高斯体组的详细信息,以及较低的组号基本上构建了基础画布:

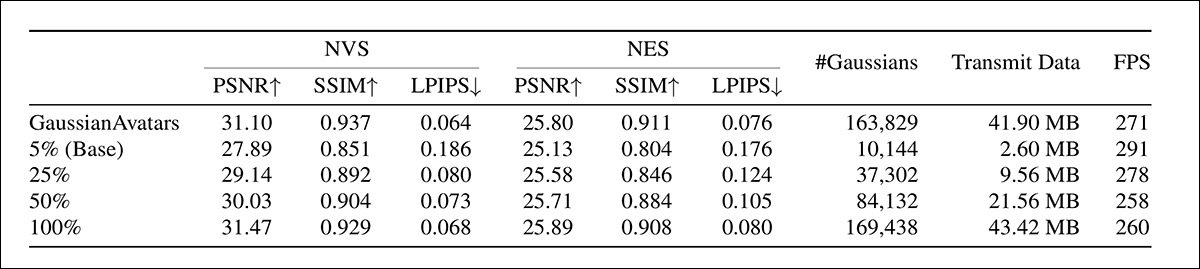

在不同传输预算下,新视图和新表情合成的性能,显示质量随着更多高斯体和数据的流式传输而稳步提高,同时在RTX 4090上保持实时速度。

作者评论说:

‘仅传输2.60 MB(5%预算),头像已经具有合理的质量。随着更高级别的高斯体被流式传输,细节结构,如衬衫按钮、牙齿和头发,逐渐变得清晰,同时保持时间稳定性。

‘在100%传输时,我们的方法实现了与最先进方法相当的渲染质量。值得注意的是,帧率没有显著下降,可能是因为3DGS工作量尚未饱和GPU。’

然而,作者指出,在多用户VR场景中,3D高斯体的数量将迅速增长到GPU光栅化成为瓶颈的程度。在这些更重的场景中,所提出方法提供了一个优势,允许系统在原始数量和视觉质量之间进行权衡,从而减轻负载而不会使渲染崩溃。

虽然这篇论文没有详细说明,但项目网站上有额外的测试比较,包括MeGA混合网格-高斯头像项目:

点击播放。 项目网站上的补充视频之一,这个视频比较了新方法在新视图合成方面的表现。

结论

高斯斑点可能会或可能不会经久不衰,或者甚至被记住更多关于交互式流媒体的黎明:AI驱动或AI辅助的3D感知代表体验,包括视频聊天、虚拟购物、路线导航和各种娱乐应用。可能会有其他技术或方法获胜,或者GSplat证明是最可靠的AI视频表示。

如果没有其他东西,这篇有趣的新论文预示了这个新领域的范围,同时也提醒我们,也许是怀旧地,回忆起过去带宽受限的互联网。

* 通过“3D”,我指的是不需要特殊眼镜的那种体验,而是指多媒体内容具有某种X/Y/Z坐标的理解。

首次发布于2026年3月18日星期三