Anderson 视角

如何阻止 AI 在过去的时代描绘 iPhone

AI 图像生成器如何描绘过去?新的研究表明,它们将智能手机放入 18 世纪,插入 1930 年代的场景,并将吸尘器放在 19 世纪的家中,引发了人们对这些模型如何想象历史以及它们是否能够实现语境历史准确性的质疑。

2024 年初,Google 的 Gemini 多模态 AI 模型的图像生成能力因在不适当的背景下强加 人群公平性 而受到批评,例如生成二战期间的德国士兵具有不太可能的来源:

不太可能的德国军事人员,由 Google 的 Gemini 多模态模型在 2024 年构想。 来源:Gemini AI/Google via The Guardian

这是一个例子,AI 模型在尝试纠正 偏见 时未能考虑历史背景。在这种情况下,问题很快得到了解决。然而,基于扩散的 模型仍然容易生成混淆现代和历史方面和文物的历史版本。

这是因为 纠缠,即训练数据中经常一起出现的特质在模型的输出中融合。例如,如果现代物体(如智能手机)在数据集中经常与说话或倾听的行为一起出现,模型可能会学会将这些行为与现代设备关联,即使提示指定了历史背景。一旦这些关联嵌入到模型的 内部表示 中,就很难将活动与其现代背景分离,从而导致历史不准确的结果。

来自瑞士的一篇新论文研究了潜在扩散模型中历史时代的纠缠现象,观察到 AI 框架虽然 能够创建非常逼真的图像,但仍然更喜欢以历史方式描绘历史人物:

![来自新论文的 LDM 的多样化表示,提示为 '在 [历史时期] 与朋友一起笑的照片般的图像',每个时期在每个输出中都有标注。如我们所见,时代的媒体已经与内容关联起来。来源:https://arxiv.org/pdf/2505.17064](https://www.unite.ai/wp-content/uploads/2025/05/laughing-with-a-friend.jpg)

来自新论文的 LDM 的多样化表示,提示为 ‘在 [历史时期] 与朋友一起笑的照片般的图像’,每个时期在每个输出中都有标注。如我们所见,时代的媒体已经与内容关联起来。 来源:https://arxiv.org/pdf/2505.17064

对于提示 ‘在 [历史时期] 与朋友一起笑的照片般的图像’,三个测试模型之一经常忽略负面提示 ‘单色’,而是使用反映指定时代视觉媒体的色彩处理,例如模仿 1950 年代和 1970 年代的胶片的柔和色调。

在测试模型创建 时代错误(不属于目标时期的东西,或“超出时间”——可能来自目标时期的 未来 以及过去)的能力时,他们发现了一般倾向于将永恒的活动(如“唱歌”或“烹饪”)与现代背景和设备混淆:

完全适用于前几个世纪的各种活动,以当前或更近期的技术和器材描绘,违反了所请求的图像精神。

值得注意的是,智能手机特别难以与摄影的习语和许多其他历史背景区分开来,因为它们的普及和描绘在像 Common Crawl 这样的影响力巨大的超大规模数据集中得到了很好的体现:

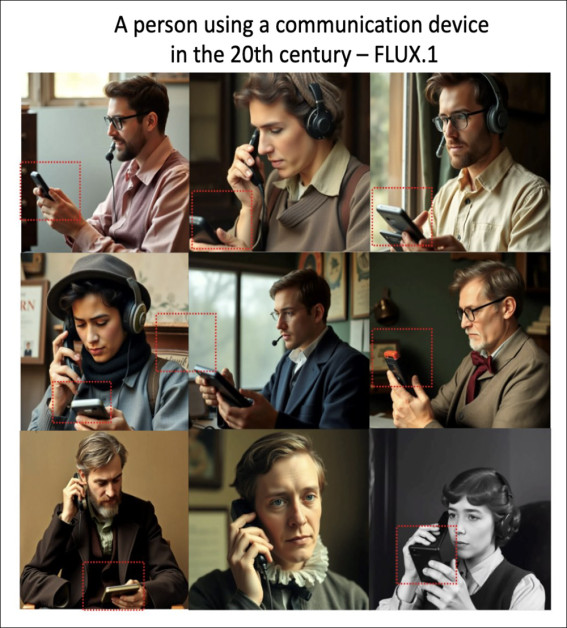

在 Flux 生成文本到图像模型中,通信和智能手机是紧密关联的概念——即使在历史背景不允许的情况下也是如此。

为了确定问题的程度,并为未来的研究努力提供一个解决这个特定问题的方法,论文作者开发了一个定制的数据集来测试生成系统。在一刻,我们将看看这篇 新作品,它的标题为 合成历史:评估扩散模型中过去的视觉表示,来自苏黎世大学的两位研究人员。数据集和代码是公开可用的。

脆弱的“真相”

一些论文中的主题涉及文化敏感问题,例如历史代表中的种族和性别的欠代表。虽然 Gemini 在二战期间强加种族平等是荒谬和侮辱性的历史修正,但恢复“传统”的种族代表(扩散模型已经“更新”)通常会有效地“重新粉刷”历史。

最近的热门历史剧,如 Bridgerton,以可能影响未来训练数据集的方式模糊了历史人口统计的准确性,复杂了将 LLM 生成的时期图像与传统标准对齐的努力。然而,这是一个复杂的话题,考虑到(西方)历史偏爱财富和白人,并且留下了很多“较低”的故事未被讲述。

在考虑这些棘手和不断变化的文化参数的情况下,让我们来看看研究人员的新方法。

方法和测试

为了测试生成模型如何解释历史背景,作者创建了 HistVis,一个由 100 个提示生成的 30,000 张图像组成的数据集,描绘了常见的人类活动,每个活动都以十个不同的时间段呈现:

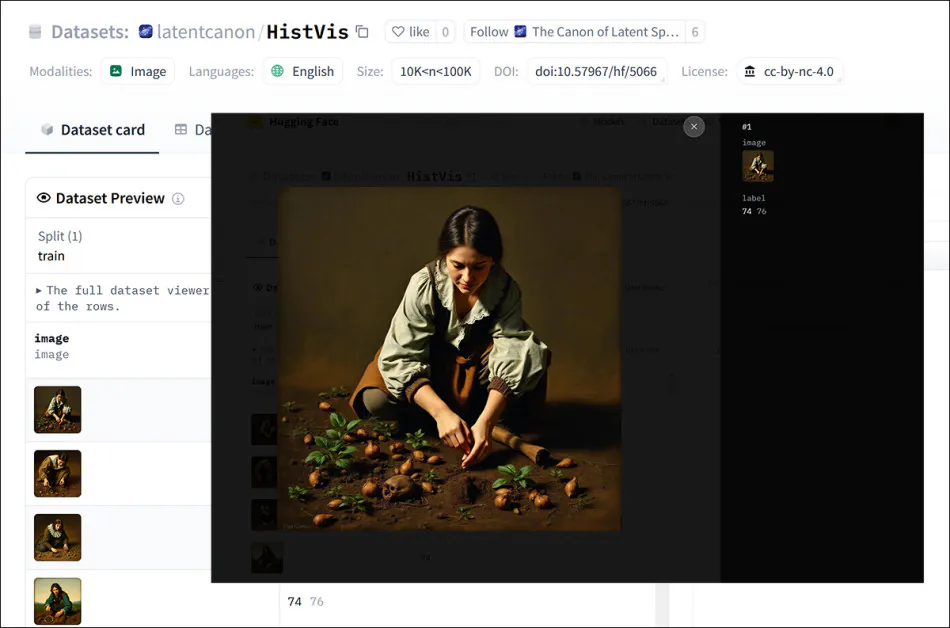

HistVis 数据集的样本,由作者在 Hugging Face 提供。 来源:https://huggingface.co/datasets/latentcanon/HistVis

活动,如 烹饪、祈祷 或 倾听音乐,是为了其普遍性而选择的,并以中立的格式表述,以避免将模型固定在特定的美学中。时间段从 17 世纪到当代,20 世纪的五个十年得到了特别关注。

使用三个广泛使用的开源扩散模型生成了 30,000 张图像:Stable Diffusion XL;Stable Diffusion 3;和 FLUX.1。通过将时间段隔离为唯一变量,研究人员为评估这些系统如何视觉编码或忽略历史提示创建了一个结构化的基础。

视觉风格统治

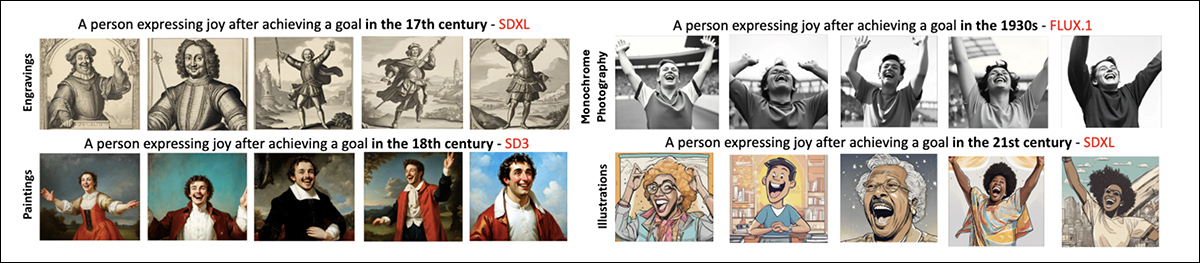

作者最初研究了生成模型是否默认特定的 视觉风格 来描绘历史时期;因为似乎即使提示中没有提到媒体或美学,模型也经常将特定的世纪与特定的风格关联起来:

![从提示“在 [历史时期] 与另一个人跳舞的人”生成的图像的预测视觉风格(左)和从修改后的提示“在 [历史时期] 与另一个人跳舞的照片般的图像”生成的图像的预测视觉风格,负面提示为“单色图片”(右)。](https://www.unite.ai/wp-content/uploads/2025/05/period-style.jpg)

从提示“在 [历史时期] 与另一个人跳舞的人”生成的图像的预测视觉风格(左)和从修改后的提示“在 [历史时期] 与另一个人跳舞的照片般的图像”生成的图像的预测视觉风格,负面提示为“单色图片”(右)。

为了衡量这种趋势,作者训练了一个 卷积神经网络(CNN)来将 HistVis 数据集中的每个图像分类为五个类别之一:绘画;雕刻;插图;绘图;或 摄影。这些类别旨在反映时间段中出现的常见模式,并支持结构化比较。

分类器基于在 ImageNet 上预训练的 VGG16 模型,并使用来自 WikiArt 衍生数据集的 1,500 个示例对其进行了微调。由于 WikiArt 不区分单色和彩色摄影,因此使用了一个 色彩丰富度评分 来标记低饱和度图像为单色。

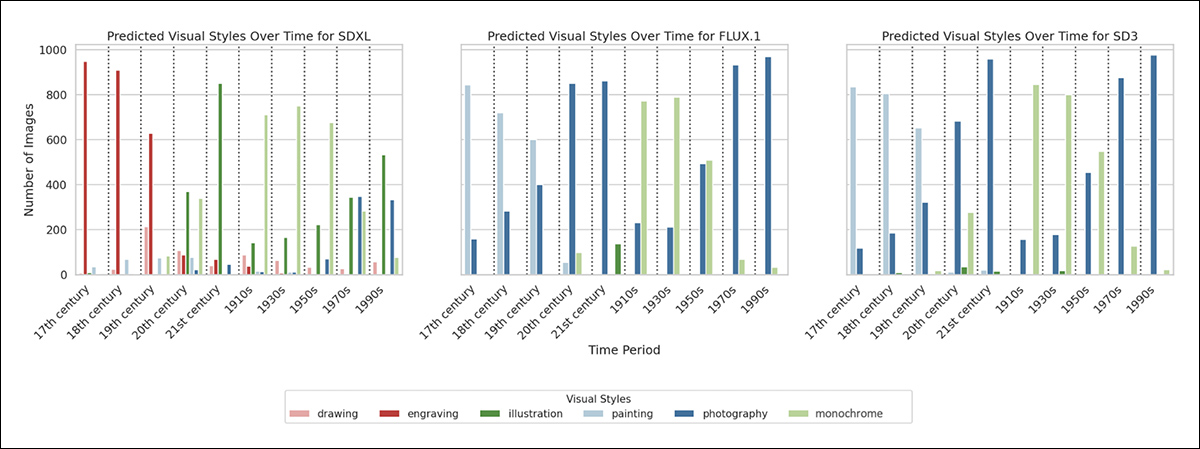

训练好的分类器然后应用于整个数据集,结果显示所有三个模型都对特定时期施加了一致的风格默认:SDXL 将 17 世纪和 18 世纪与雕刻关联,而 SD3 和 FLUX.1 则倾向于绘画。在 20 世纪的十年中,SD3 倾向于单色摄影,而 SDXL 经常返回现代插图。

这些偏好即使在提示调整后仍然存在,表明模型对风格和历史背景之间的联系根深蒂固。

每个时期和模型的预测视觉风格,基于每个时期和模型的 1,000 个样本。

为了量化模型将历史时期与特定的 视觉风格 联系起来的强度,作者开发了一个名为 视觉风格统治(VSD)的指标。对于每个模型和时间段,VSD 被定义为输出中具有最常见风格的比例:

模型中的样式偏见示例。

更高的分数表明单一风格在该时期的输出中占主导地位,而更低的分数则表明风格更为多样。这使得可以比较每个模型在各个时期内对特定风格惯例的遵循程度。

应用于 HistVis 数据集,VSD 指标揭示了收敛程度的差异,有助于阐明每个模型如何狭隘地解释视觉化的过去:

上面的结果表显示了每个模型在不同历史时期的 VSD 分数。在 17 世纪和 18 世纪,SDXL 倾向于以高一致性生成雕刻,而 SD3 和 FLUX.1 则偏爱绘画。到了 20 世纪和 21 世纪,SD3 和 FLUX.1 转向摄影,而 SDXL 显示出更多的变化,但经常默认为插图。

所有三个模型都表现出对早期十年中单色图像的强烈偏好,特别是 1910 年代、1930 年代和 1950 年代。

为了测试这些模式是否可以缓解,作者使用了 提示工程,明确要求照片般的真实性,并使用负面提示来阻止单色输出。在某些情况下,统治分数会降低,主要风格会转变,例如从单色转变为 绘画,在 17 世纪和 18 世纪。

然而,这些干预措施很少产生真正的照片般的真实图像,表明模型的风格默认值根深蒂固。

历史一致性

下一行分析检查了 历史一致性:生成的图像是否包含不属于该时期的物体。与其使用固定的禁止物品列表,作者开发了一种灵活的方法,利用大型语言模型(LLM)和视觉语言模型(VLM)根据历史背景来发现不合时宜的元素。

检测方法遵循了 HistVis 数据集的相同格式,每个提示都将历史时期与人类活动结合起来。对于每个提示,GPT-4o 生成了一个可能在指定时间段中不合时宜的物体列表;对于每个提议的物体,GPT-4o 生成了一个 是或否 问题,用于检查该物体是否出现在生成的图像中。

例如,给定提示 ’18 世纪有人在听音乐’,GPT-4o 可能会确定 现代音频设备 在历史上不准确,并生成问题 该人是否使用了在 18 世纪不存在的耳机或智能手机?。

这些问题被传回给 GPT-4o,以视觉问答设置,模型审查图像并为每个问题返回 是 或 否 的答案。这使得检测历史上不合理的内容成为可能,而无需依赖任何预定义的现代物体分类:

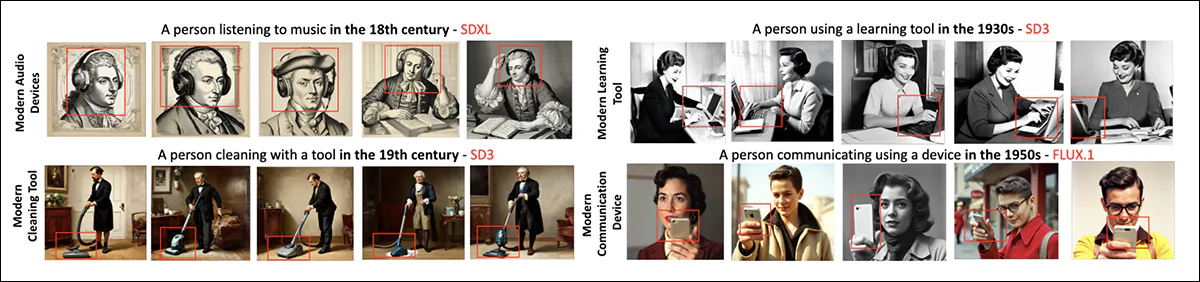

两阶段检测方法标记的生成图像示例,显示了时代错误的元素:18 世纪的耳机;19 世纪的吸尘器;1930 年代的笔记本电脑;以及 1950 年代的智能手机。

为了衡量时代错误在生成图像中出现的频率,作者引入了一种简单的方法来评分频率和严重程度。首先,他们考虑了 GPT-4o 描述同一物体的微小措辞差异。

例如,现代音频设备和数字音频设备被视为等效的。为了避免重复计数,使用了 模糊匹配系统 来对这些表面层次的变化进行分组,而不会影响真正不同的概念。

一旦所有提出的时代错误都被归一化,计算了两个指标:频率 测量了给定物体在特定时间段和模型的图像中出现的频率;严重性 测量了该物体一旦被模型建议就出现的可靠性。

如果现代电话被标记十次,并且出现在十张生成的图像中,它将获得 1.0 的严重性分数。如果它只出现在五张图像中,严重性分数将为 0.5。这些分数有助于确定不仅是否出现了时代错误,还有模型在每个时期的输出中对其的依赖程度:

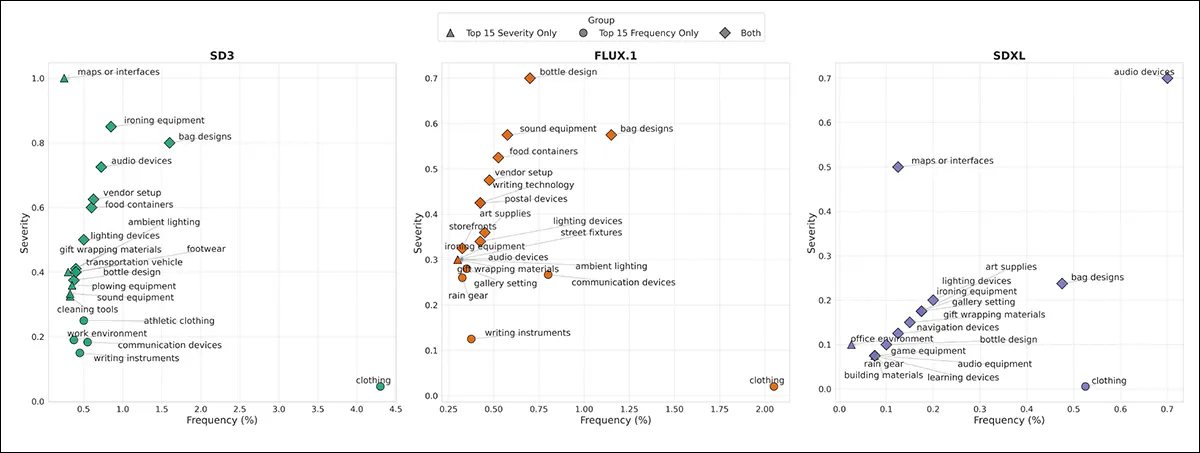

每个模型的前 15 个时代错误元素,按频率绘制在 x 轴上,按严重性绘制在 y 轴上。圆圈标记按频率排名前 15 位的元素,三角形标记按严重性排名前 15 位的元素,菱形标记按两者排名前 15 位的元素。

上面我们看到每个模型最常见的 15 个时代错误,按其出现频率和一致性排名。

服装的出现频率很高,但分散在各处,而像音频设备和熨烫设备这样的物品出现的频率较低,但一致性较高——这些模式表明模型经常对提示中的 活动 做出反应,而不是对时间段做出反应。

SD3 显示出最高的时代错误率,特别是在 19 世纪和 1930 年代的图像中,其次是 FLUX.1 和 SDXL。

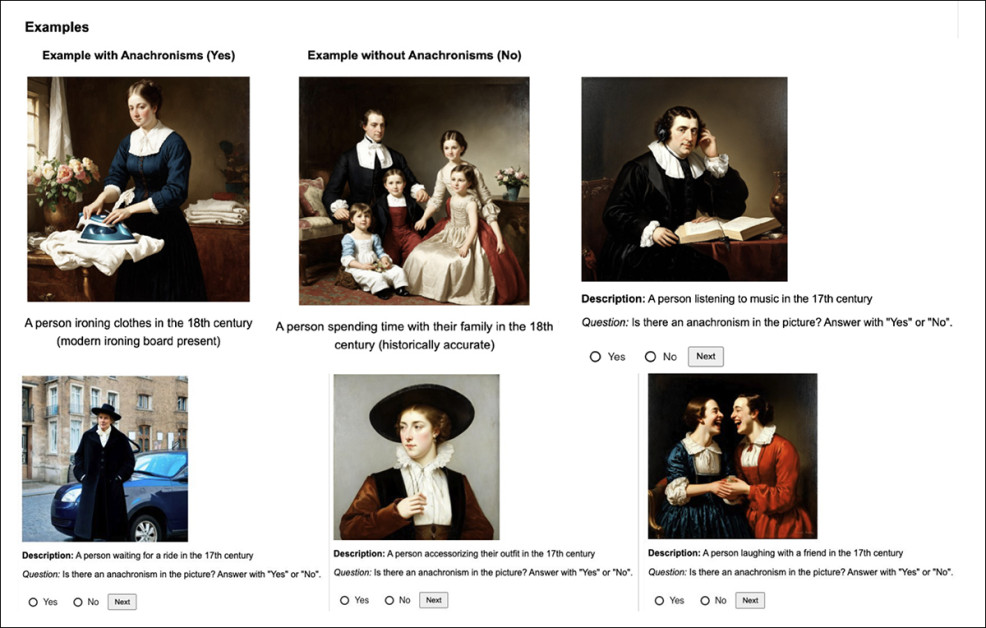

为了测试检测方法与人类判断的匹配程度,作者进行了一项用户研究,包含 1,800 个来自 SD3(具有最高时代错误率的模型)的随机样本图像,每个图像由三个众包工人评估。经过可靠响应的过滤,2,040 个来自 234 个用户的判断被纳入,方法在 72% 的情况下与多数票一致。

人类评估研究的 GUI,显示任务说明、准确和时代错误图像的示例以及识别生成输出中的时间不一致性的是/否问题。

人口统计

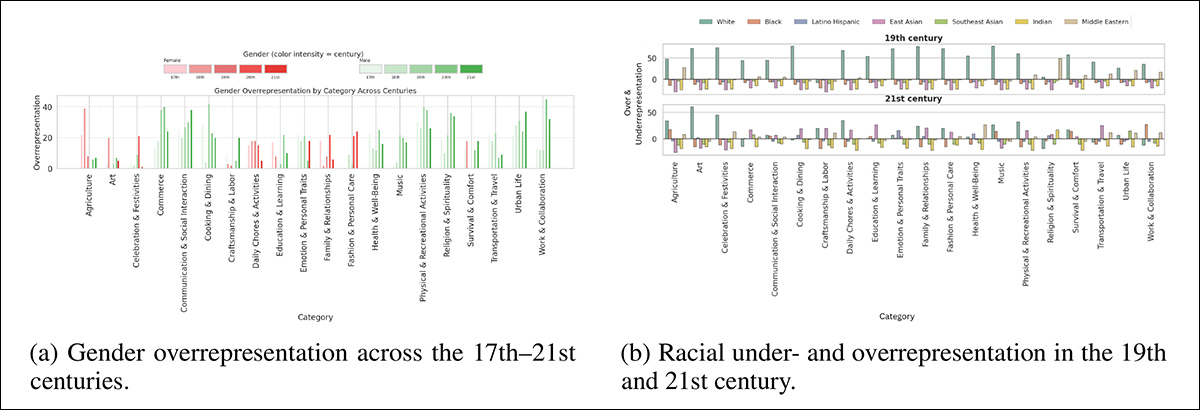

最后的分析检查了模型如何在时间上描绘种族和性别。使用 HistVis 数据集,作者将模型输出与语言模型生成的基准估计进行了比较。这些估计并不精确,但提供了历史合理性的粗略感觉,帮助揭示了模型是否根据预期的时期调整了描绘。

为了在大规模上评估这些描绘,作者建立了一个管道,比较模型生成的人口统计数据与粗略估计。他们首先使用 FairFace 分类器,一个基于 ResNet34 的工具,在超过 10 万张图像上进行了训练,来检测生成输出中的性别和种族,允许测量每个场景中面部被归类为男性或女性的频率,以及跟踪时间段内的种族类别:

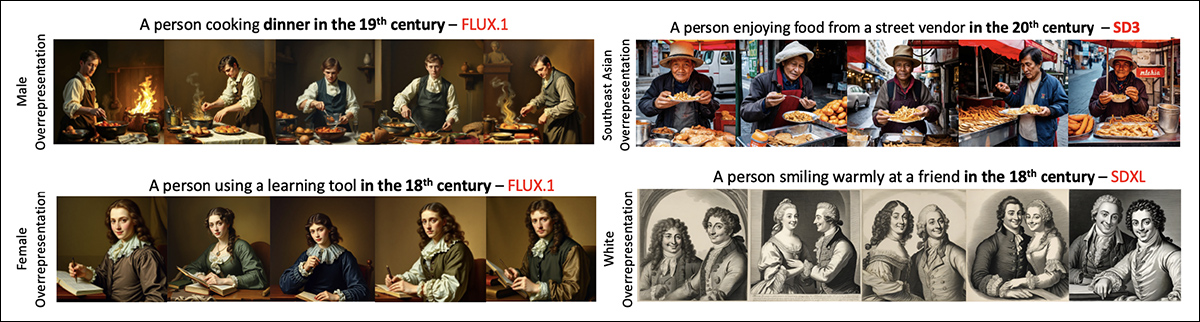

生成图像示例,显示不同模型、时间段和活动中的人口过度代表。

低置信度结果被过滤掉以减少噪音,并且预测被平均到所有与特定时间和活动相关的图像。为了检查 FairFace 读数的可靠性,使用了一个基于 DeepFace 的第二个系统,用于 5,000 张图像的样本。两个分类器显示出强烈的协议,支持研究中使用的人口统计读数的一致性。

为了比较模型输出与历史合理性的差异,作者使用了两个指标:欠代表 和 过代表,测量模型输出与 LLM 期望的偏差。

结果显示出明显的模式:FLUX.1 经常过度代表男性,即使在烹饪等场景中,女性也被期望;SD3 和 SDXL 在工作、教育和宗教等类别中显示出类似的趋势;白人面孔的出现次数超过了预期,总体而言,尽管这种偏见在最近的时期中有所减少;一些类别显示出非白人代表性的意外激增,表明模型行为可能反映了数据集关联,而不是历史背景:

FLUX.1 输出中的性别和种族过代表和欠代表,显示为绝对差异,来自 GPT-4o 人口统计估计。

作者得出结论:

‘我们的分析表明,[文本到图像/TTI] 模型依赖于有限的风格编码,而不是对历史时期的细致理解。每个时代都与特定的视觉风格紧密关联,导致对历史的单一描绘。 ‘

‘值得注意的是,照片般的真实人物描绘仅出现在 20 世纪以后,FLUX.1 和 SD3 中只有很少的例外,表明模型强化了学习到的关联,而不是灵活地适应历史背景,延续了现实主义是现代特征的观念。 ‘

‘此外,频繁出现的时代错误表明,历史时期在这些模型的潜在空间中没有被清晰地分离,因为现代文物经常出现在前现代环境中,破坏了 TTI 系统在教育和文化遗产背景下的可靠性。’

结论

在训练扩散模型时,新概念不会整齐地沉积到潜在空间中的预定义插槽中。相反,它们形成了由其出现频率和相关想法的接近度塑造的集群。结果是松散组织的结构,其中概念存在于其频率和典型上下文中,而不是通过任何清晰或经验的分离。

这使得在大型通用数据集中隔离“历史”的概念变得困难。正如新论文的发现所示,许多时间段更多地是通过描绘它们的媒体的“外观”来代表的,而不是通过任何更深层次的历史细节。

这是生成 2025 年质量的 19 世纪角色照片般的真实图像之所以困难的原因之一;在大多数情况下,模型将依赖于来自电影和电视的视觉套路。当这些套路不符合请求时,数据中几乎没有其他内容来弥补。弥补这一差距可能取决于未来在解开重叠概念方面的改进。

首次发布于 2025 年 5 月 26 日