人工智能

2024 年计算机视觉文献趋势的个人观察

我已经连续关注计算机视觉(CV)和图像合成研究领域大约五年了,所以随着时间的推移,趋势变得明显,每年都会转向新的方向。

因此,随着 2024 年的结束,我认为有必要审视一下 Arxiv 提交中的新兴或演变的特征,在计算机视觉和模式识别部分。这些观察虽然是基于数百小时的研究经验,但严格来说只是个人经验。

东亚的持续崛起

到 2023 年底,我已经注意到“语音合成”类别的大部分文献都是来自中国和其他东亚地区。到 2024 年底,我必须观察到(虽然是基于个人经验),这种情况现在也适用于图像和视频合成研究领域。

这并不意味着中国和邻近国家一定总是输出最好的工作(事实上,有一些证据表明相反的情况),也不考虑到中国(和西方)可能有一些最有趣和最强大的新系统是专有的,并且不在研究文献中。

但这表明东亚在数量上超过了西方。这种说法的价值取决于你相信“爱迪生式的坚持”的可行性,这种方法通常在面对不可逾越的障碍时是无效的。

在生成式 AI 中,有很多这样的障碍,不容易知道哪些可以通过现有架构来解决,哪些需要从零开始重新考虑。

虽然东亚的研究人员似乎生产了更多的计算机视觉论文,但我注意到“弗兰肯斯坦”式项目的频率增加——这些项目是将以前的工作结合起来,同时添加有限的架构新颖性(或可能只是不同类型的数据)。

今年,东亚(主要是中国或中国参与的合作)条目似乎更多的是由数量驱动而不是质量驱动,这显著增加了已经过度订阅的领域中的信噪比。

同时,东亚的论文也更多地吸引了我的注意和赞赏。所以,如果这是一场数字游戏,那么它并没有失败——但也不是廉价的。

提交量的增加

跨所有来源国家,2024 年的论文数量已经明显增加。

最受欢迎的出版日在一年中不断变化;目前是星期二,当时计算机视觉和模式识别部分的提交数量经常在单日达到 300-350 个,在“峰值”期间(5 月至 8 月和 10 月至 12 月,即会议季和“年度配额截止日期”季节)。

除了我自己的经验之外,Arxiv 本身报告了 2024 年 10 月的提交量创下了新的记录,总共有 6000 个新提交,而计算机视觉部分是机器学习部分之后提交最多的部分。

然而,由于 Arxiv 的机器学习部分经常被用作“额外”或聚合的超类别,这表明计算机视觉和模式识别实际上是提交最多的类别。

Arxiv 的统计数据确实显示计算机科学(CS)是提交量最大的领域:

计算机科学(CS)在过去五年中主导了 Arxiv 的提交统计。 来源:https://info.arxiv.org/about/reports/submission_category_by_year.html

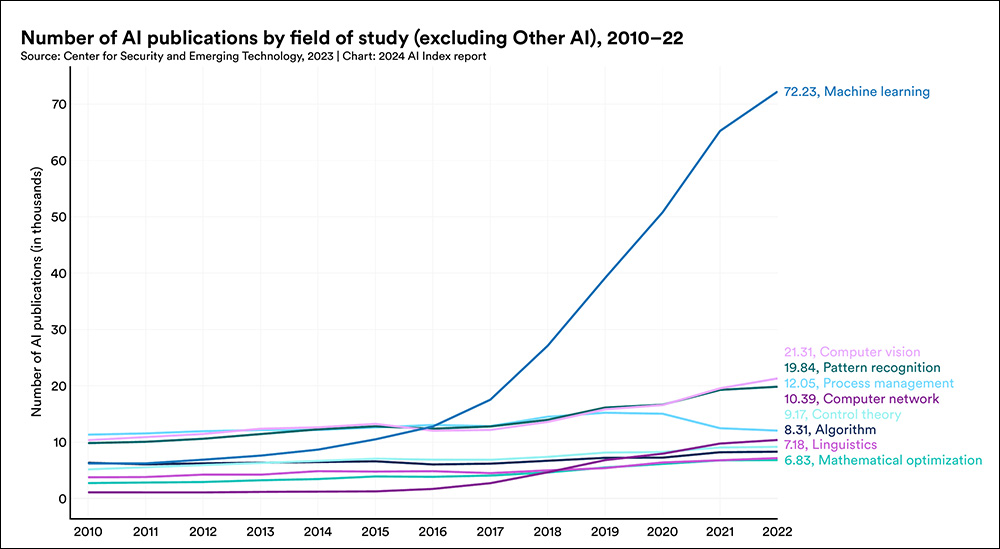

斯坦福大学的 2024 年 AI 指数报告,尽管无法报告最新的统计数据,但也强调了近年来围绕机器学习的学术论文提交量的显著增加:

虽然没有 2024 年的数据,斯坦福大学的报告仍然戏剧性地展示了机器学习论文提交量的增加。 来源:https://aiindex.stanford.edu/wp-content/uploads/2024/04/HAI_AI-Index-Report-2024_Chapter1.pdf

扩散 > 网格框架的普及

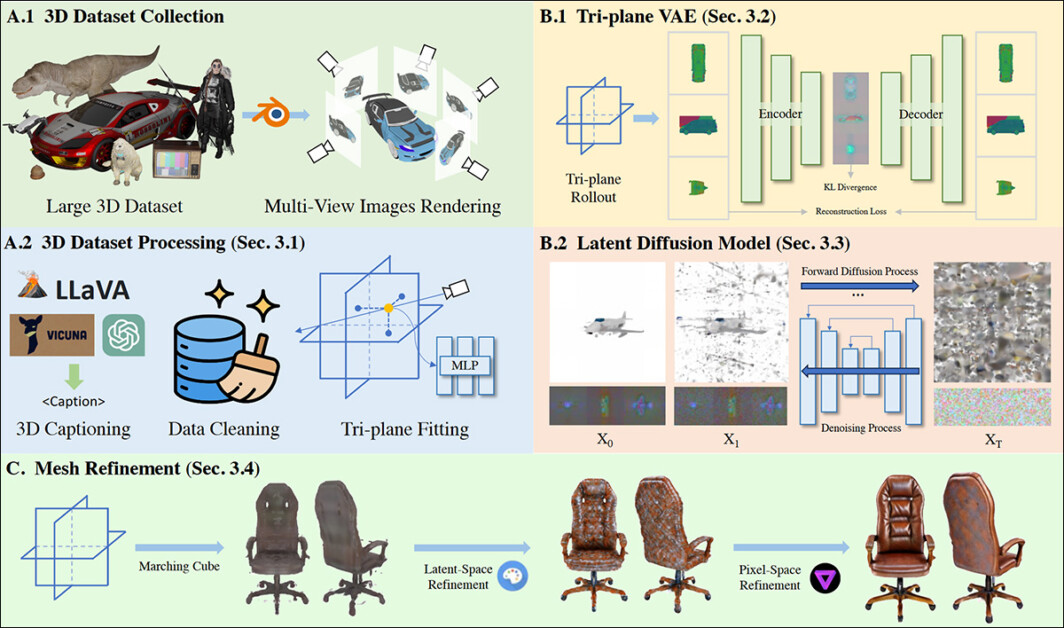

另一个明显的趋势是,利用潜在扩散模型(LDMs)作为生成网格基的“传统”CGI 模型的生成器的论文数量大幅增加。

这些项目包括腾讯的 InstantMesh3D,3Dtopia,Diffusion²,V3D,MVEdit 和 GIMDiffusion 等。

3Dtopia 中通过扩散过程的网格生成和细化。 来源:https://arxiv.org/pdf/2403.02234

这种新兴的研究方向可以被视为对生成系统(如扩散模型)不可逾越的难题的隐晦承认,这些难题仅仅两年前还被誉为可能取代所有系统的潜在替代品;现在,扩散模型被降级为工具,用于三十年或更久以前的技术和工作流程。

Stability.ai,开源 Stable Diffusion 模型的创造者,刚刚发布了 Stable Zero123,可以使用神经辐射场(NeRF)来解释 AI 生成的图像,并将其用作创建可以在 Unity、视频游戏、增强现实和其他需要显式 3D 坐标的平台中使用的网格基的 CGI 模型的桥梁。

点击播放。 使用 Stable Zero 123 的图像 > CGI 工作流程生成的图像。 来源:https://www.youtube.com/watch?v=RxsssDD48Xc

3D 语义

生成 AI 空间区分 2D 和 3D 系统实现的视觉和生成系统。例如,面部标志框架,虽然在所有情况下都表示 3D 对象(面部),但并非所有框架都计算可寻址的 3D 坐标。

流行的 FANAlign 系统,可以适应这两种方法:

上面,2D 标志基于识别的面部线条和特征生成。下面,它们被合理化为 3D X/Y/Z 空间。 来源:https://github.com/1adrianb/face-alignment

所以,就像“深度伪造”已经成为一个模糊和被劫持的术语一样,“3D”也同样在计算机视觉研究中变得模糊。

对于消费者来说,它通常意味着立体启用媒体(例如需要特殊眼镜的电影);对于视觉效果从业者和建模师来说,它提供了 2D 艺术作品(例如概念草图)和可以在“3D 程序”(如 Maya 或 Cinema4D)中操作的网格基模型之间的区别。

但在计算机视觉中,它只意味着模型的潜在空间中存在一个笛卡尔坐标系统——不意味着它可以被用户直接寻址或操作;至少,不需要第三方解释性 CGI 基础系统(如 3DMM 或 FLAME)。

因此,“扩散 > 3D”的概念是不准确的;不仅可以使用任何类型的图像(包括真实照片)作为输入来生成网格基的 CGI 模型,而且“网格”这个术语更为合适。

然而,为了加剧模糊性,大多数新兴项目都需要扩散来解释源图像为网格。所以,一个更好的描述可能是“图像到网格”,而“图像 > 扩散 > 网格”是一个更准确的描述。

但是,这在董事会议或为吸引投资者而设计的公关发布中是一个难以销售的概念。

建筑瓶颈的证据

即使与 2023 年相比,过去 12 个月的论文也表现出了一种日益增长的绝望感,试图去除基于扩散的生成的实际限制。

主要的绊脚石仍然是生成叙事和时间一致的视频,以及保持角色和物体的一致外观——不仅在不同视频片段之间,而且甚至在单个生成视频片段的短时间内。

基于扩散的合成的最后一次重大创新是 2022 年的 LoRA 的出现。虽然像 Flux 这样的新系统在一些异常问题上有所改进,例如 Stable Diffusion 以前的无法复制图像中的文本内容,整体图像质量也已提高,但我在 2024 年研究的大多数论文基本上只是在原地打转。

这些瓶颈以前也曾出现过,例如生成对抗网络(GANs)和神经辐射场(NeRF),它们最初看起来很有前途,但最终都未能实现预期——现在,它们正被越来越多地应用于更传统的系统中(例如 NeRF 在 Stable Zero 123 中的使用,见上文)。这种情况似乎也正在发生在扩散模型中。

高斯斑点研究的转变

似乎 3D 高斯斑点(3DGS)技术,这是一种最初用于医疗成像的光栅化方法,已经准备好在 2023 年末突然超越基于自动编码器的系统,成为人像合成挑战(例如面部模拟和重现,以及身份转移)的主流方法。

2023 年的 ASH 论文承诺提供全身 3DGS 人像,而高斯_avatar_ 提供了大量改进的细节(与自动编码器和其他竞争方法相比),以及令人印象深刻的跨重演。

然而,今年相比之下却缺乏这样的突破性时刻;大多数处理这个问题的论文要么是上述工作的衍生品,要么未能超越它们的能力。

相反,3DGS 的重点是改进其基本架构的可行性,导致了一大批论文致力于改进 3DGS 外部环境。特别是,对同时定位和映射(SLAM)3DGS 方法给予了关注,例如 Gaussian Splatting SLAM、Splat-SLAM、Gaussian-SLAM、DROID-Splat 等项目。

那些尝试继续或扩展斑点基的人像合成的项目包括 MIGS、GEM、EVA、OccFusion、FAGhead、HumanSplat、GGHead、HGM 和 Topo4D。虽然还有其他项目,但这些都没有达到 2023 年末出现的论文的最初影响。

“威斯坦时代”的测试样本正在缓慢衰落

来自东南亚(尤其是中国)的研究通常以测试样本为特色,这些样本在审查文章中可能存在问题,因为它们包含了一些“辣”的内容。

无论这是否是因为该地区的研究科学家试图吸引人们对其输出的关注,这是有争议的;但在过去的 18 个月里,越来越多的论文围绕生成式 AI(图像和/或视频),默认使用年轻和衣着暴露的女性和女孩作为项目示例。这些示例包括 UniAnimate、ControlNext,甚至像 Evaluating Motion Consistency by Fréchet Video Motion Distance(FVMD)这样的非常“干燥”的论文。

这遵循了潜在扩散模型(LDMs)周围的子版块和其他社区的趋势,在这些社区中,规则 34 仍然非常有效。

名人面对面

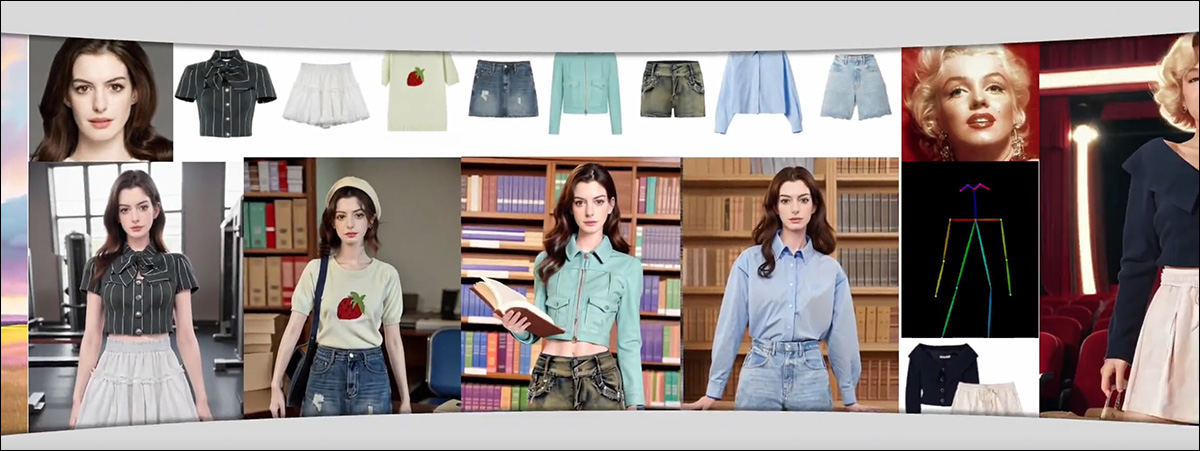

这种类型的不当示例与日益增长的认识重叠,即 AI 过程不应任意利用名人肖像——特别是在研究中不加批判地使用以名人为特色的示例,通常是女性,并将她们置于值得怀疑的背景中。

一个例子是 AnyDressing,它除了以非常年轻的动漫风格女性角色为特色外,还大量使用经典名人(如玛丽莲·梦露)的身份和当前的名人(如安·海瑟薇),后者已经对此类使用公开表示反对。

东南亚论文中仍然很常见的当前和“经典”名人的任意使用,尽管这种做法正在缓慢衰落。 来源:https://crayon-shinchan.github.io/AnyDressing/

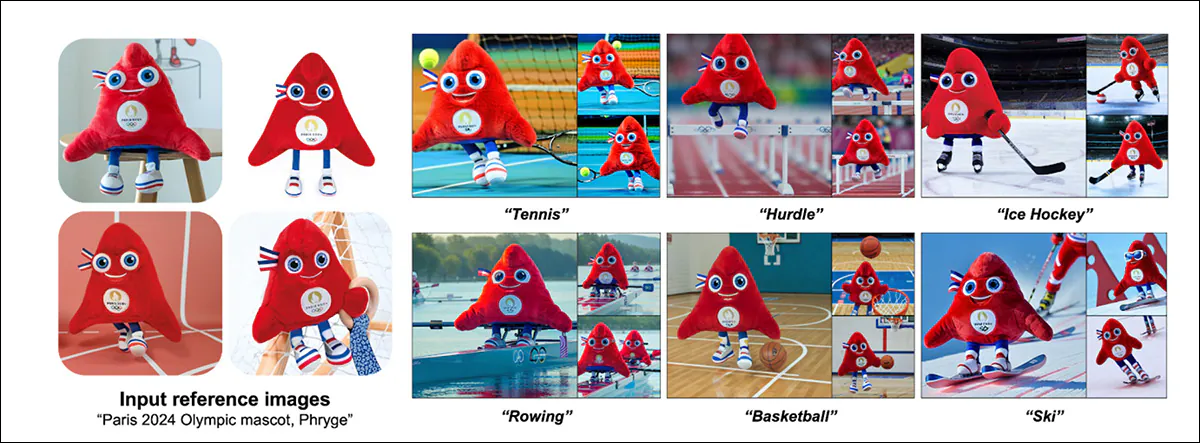

在西方论文中,这种特定的做法在整个 2024 年中一直在衰落,领先的发布来自 FAANG 和其他高级研究机构,如 OpenAI。由于对潜在诉讼的担忧,这些大型企业玩家似乎越来越不愿意代表甚至虚构的逼真人物。

虽然他们创建的系统(如 Imagen 和 Veo2)显然能够产生这样的输出,但西方生成式 AI 项目的示例现在趋向于“可爱的”,迪士尼风格的和极其“安全”的图像和视频。

尽管 Imagen 拥有创建“逼真”输出的能力,但 Google Research 推广的样本通常是幻想的,“家庭”风格的——逼真的人类被仔细避免,或提供最少的示例。 来源:https://imagen.research.google/

面部清洗

在西方 CV 文献中,这种不真诚的方法特别体现在定制系统中——这些方法能够在多个示例中创建特定人物的一致外貌(即 LoRA 和旧的 DreamBooth)。

示例包括正交视觉嵌入,LoRA-Composer,Google 的 InstructBooth,以及更多。

Google 的 InstructBooth 将可爱度提升到 11 倍,尽管历史表明用户更感兴趣于创建逼真的人类而不是毛绒或可爱的角色。 来源:https://sites.google.com/view/instructbooth

然而,“可爱的示例”的崛起也出现在其他 CV 和合成研究领域,例如 Comp4D、V3D、DesignEdit、UniEdit、FaceChain(它在 GitHub 页面上承认更现实的用户期望)、DPG-T2I 等项目中。

使用 LoRAs 等系统的易用性,使得家庭用户可以使用相对 MODEST 的硬件轻松创建名人模型,这导致了 civit.ai 域和社区中可自由下载的名人模型的激增。这种非法使用仍然可以通过 Stable Diffusion 和 Flux 等架构的开源实现来实现。

尽管可以通过绕过平台的使用条款来突破生成式文本到图像(T2I)和文本到视频(T2V)系统的限制,但最好的系统(如 RunwayML 和 Sora)和仅仅是可行的系统(如 Stable Video Diffusion、CogVideo 和 Hunyuan 的本地部署)之间的差距并没有真正缩小。

相反,这些专有和开源系统都有可能变得同样无用:昂贵的大规模 T2V 系统可能由于诉讼恐惧而变得过度受限,而开源系统中缺乏许可基础设施和数据集监督可能会在更严格的法规生效时将它们完全排除在市场之外。

首次发布于 2024 年 12 月 24 日,星期二