Anderson 视角

当 AI 的角色扩展时,Vibe 编码会受到影响

一项新研究发现,当人类提供指令时,Vibe 编码会改善,但当 AI 执行时,会下降,最佳的混合设置是让人类处于首要位置,AI 作为仲裁者或法官。

来自美国的新研究考察了当 AI 系统被允许控制 Vibe 编码 而不是简单地执行人类指令时会发生什么,发现当大型语言模型(LLM)承担更大的方向角色时,结果几乎总是更差。

虽然研究人员使用 OpenAI 的 GPT-5 作为人类/AI 协作实验的框架,但他们后来确认,Anthropic 的 Claude Opus 4.5 和 Google Gemini 3 Pro 也受到了相同的性能下降曲线的影响,表明“即使有限的人类参与也能稳定地提高性能”:

‘人类提供了独特有效的高级指导,跨越迭代,而 AI 指导往往导致性能崩溃。另外,我们发现仔细分配角色,保持人类在方向上的领导,而将评估任务交给 AI,可以提高混合性能。’

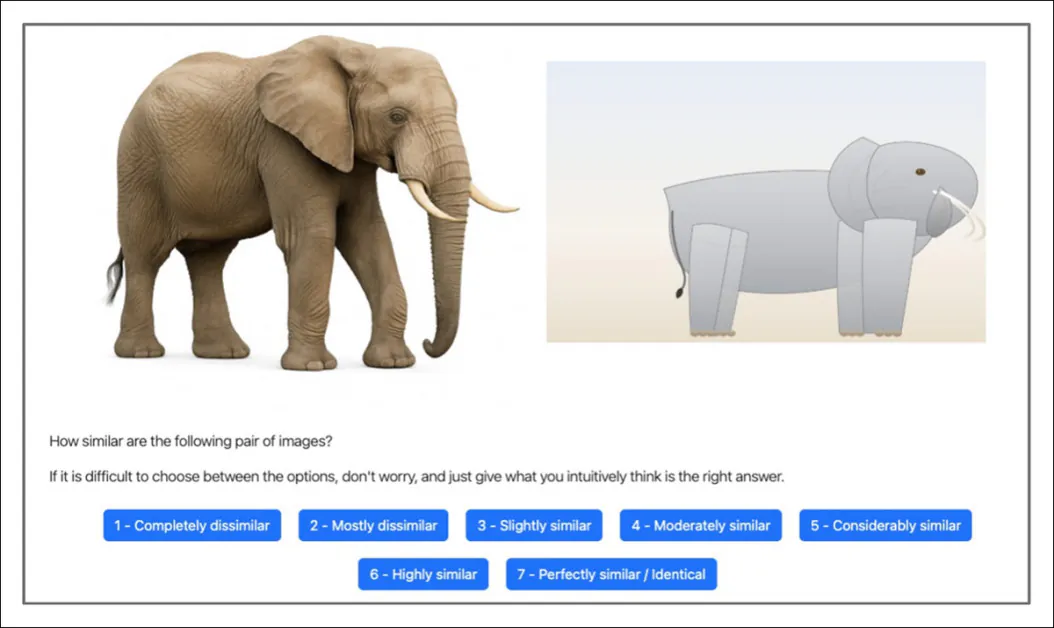

为了提供一个一致的测试,可以由人类和 AI 平等地评估,一个受控的实验框架围绕着一个迭代编码任务建立,该任务需要使用可缩放矢量图形(SVG)重现一个参考图像——该图像中包含一张猫、狗、老虎、鸟、象、企鹅、鲨鱼、斑马、长颈鹿或熊猫的照片,并将其与原始图像进行比较:

人类和 AI 参与者都被展示了一张参考图像和 AI 生成的 SVG 重建,并被要求在七点量表上评估两者之间的相似度。 来源

在每个回合中,一个代理提供高级自然语言指令来指导代码生成器,而另一个代理决定是否保留新版本或恢复到之前的版本——这是一个结构化的循环,模仿了真正的协作工作流程。

在 16 个实验中,涉及 604 名参与者和数千次 API 调用,完全由人类领导的测试回合与完全由 AI 领导的回合进行了比较,在其他条件保持相同的情况下。

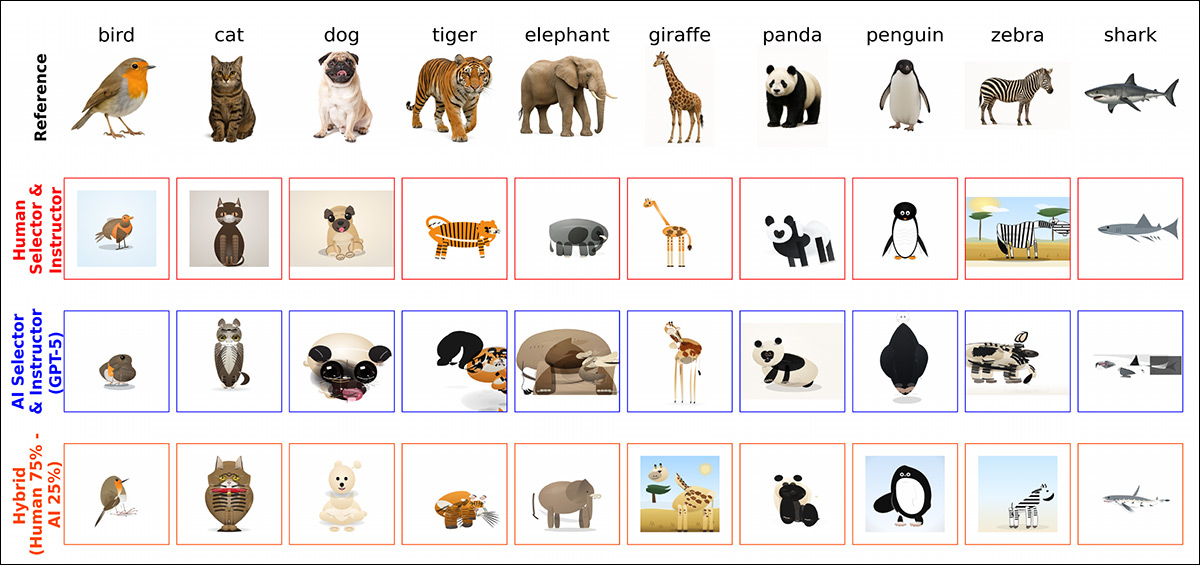

不同人类/AI 协作百分比和类型的解决方案(来自源论文中的更大插图,我们将读者指向该论文)。

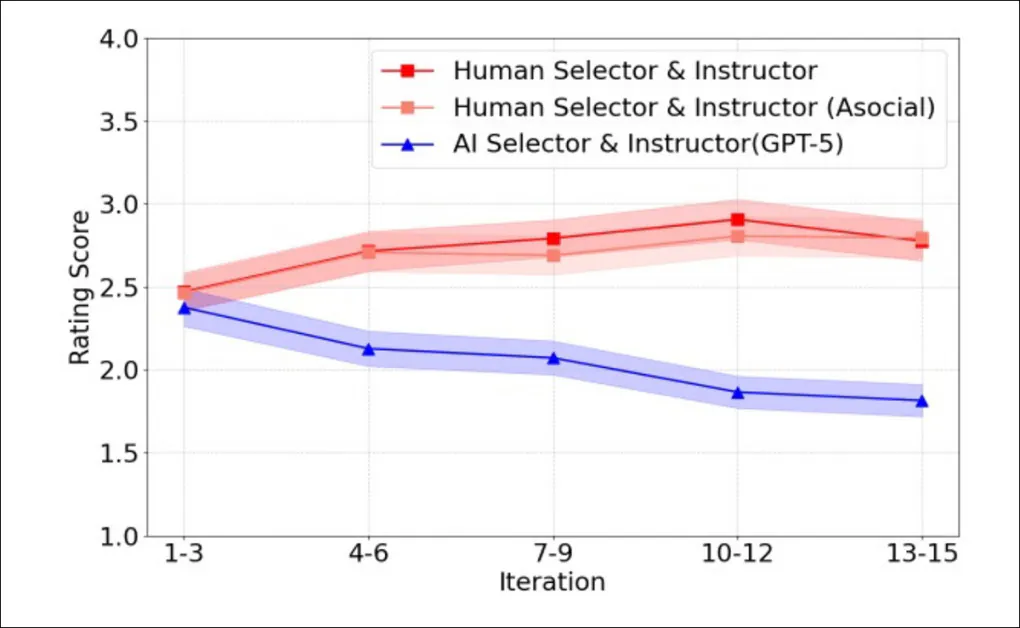

虽然人类和 AI 在测试的基线开始时表现相似,但随着时间的推移,他们的轨迹分歧:当人类提供指令并做出选择决定时,相似度评分在迭代中增加,稳步累积改进;但当 AI 系统填充两个角色时,性能没有表现出一致的改进,反而经常随着轮次的进行而下降——即使使用相同的底层模型进行代码生成,并且 AI 拥有与人类参与者相同的信息。

冗长效应

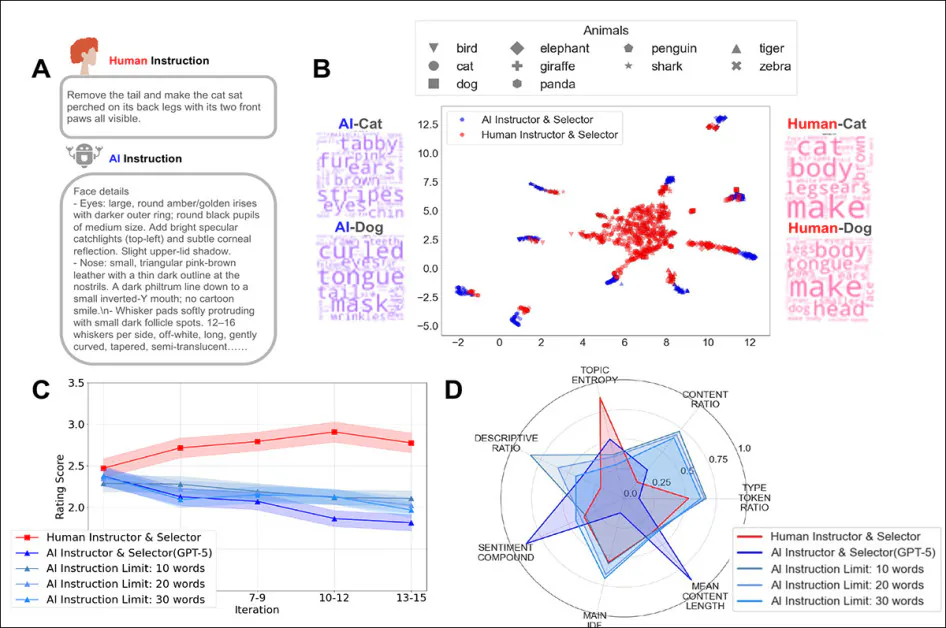

结果还表明,人类指令通常简短且面向行动,关注下一步要在当前图像中改变什么;相反,AI 指令要长得多且描述详细(这是为 GPT-5 参数化 的一个因素),描述视觉属性而不是优先考虑增量更正。

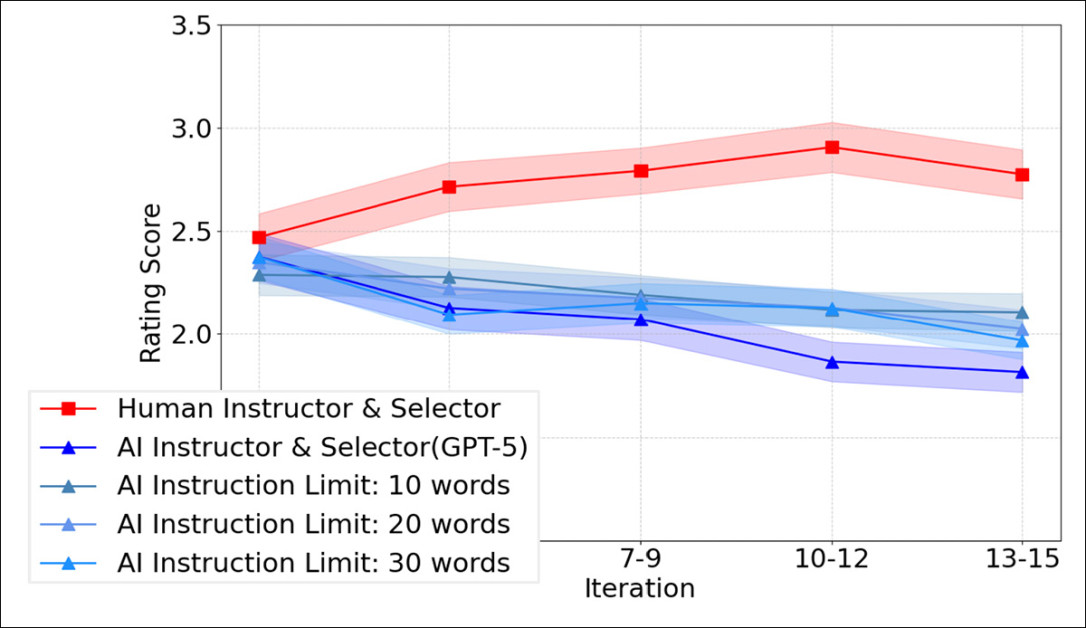

但是,如下图所示,强加严格的单词限制于 AI 指令并没有逆转这种模式;即使被限制在 10、20 或 30 个单词内,AI 领导链仍然未能随着时间的推移而改进:

迭代中的人类领导回合与完全 AI 领导回合和 AI 领导回合的相似度评分比较,限制在 10、20 或 30 个单词的指令中。显然,缩短 AI 提示并不能防止当 AI 指导两个指令和选择时观察到的迭代性能下降。

混合实验使模式更加明显,表明添加一点人类参与就能改善结果,相比之下完全由 AI 领导的设置;然而,随着 AI 指导份额的增加,性能通常会下降。

当角色被分开时,评估和选择可以在相对较少的质量损失的情况下交给 AI;但用 AI 指导取代人类的高级指令会导致明显的性能下降,表明最重要的不是谁 生成代码,而是谁 设置和维持方向 在迭代中。

作者得出结论:

‘在多个实验中,人类领导的编码一致地随着迭代次数的增加而改进,而 AI 领导的编码往往会崩溃,尽管它们拥有相同的信息和类似的执行能力。 ‘

‘这表明了当今 AI 系统在维持一致的高级方向方面的关键困难,跨越了重复的交互,这是成功的 Vibe 编码所必需的。’

新论文 题为 为什么人类指导在协作 Vibe 编码中很重要,由七位研究人员共同撰写,分别来自康奈尔大学、普林斯顿大学、麻省理工学院和纽约大学。

方法

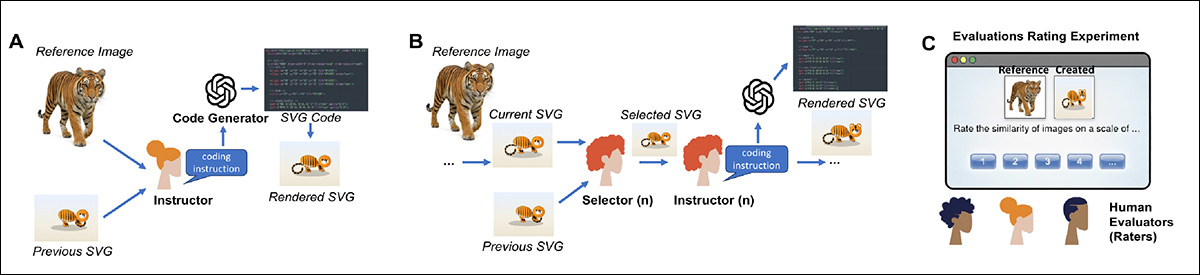

对于实验,人类教练查看一个 GPT-5 生成的动物参考照片,以及最新的关联 SVG 模仿尝试。然后,它编写自然语言指令来指导代码生成器朝着更接近匹配的方向发展。

因此,生成器每轮都会产生一个新的 SVG,从而为测试指导的累积效果创建一个迭代循环。

目标是十个 GPT-5 生成的动物图像,涵盖了各种形状和质地,以便改进或错误可以轻松检测到:

研究中使用的 Vibe 编码工作流程的模式。在 A) 中,人类教练查看参考图像和迄今为止生成的最佳 SVG,并编写自然语言指令,供代码生成器在生成下一个 SVG 时遵循;在 B) 中,人类选择器比较新 SVG 和前一个 SVG,并选择哪个版本更好地匹配参考图像,然后将所选 SVG 转发到下一轮指令;在 C) 中,独立的人类评估者评估每个生成的 SVG 与其参考图像的相似度,提供用于评估整体性能的评分。

一个人类选择器比较每个新生成的 SVG 与前一个 SVG,并接受或拒绝它,这使得该过程在轮次中与参考图像保持一致。

为了衡量 质量,独立的人类评估者根据生成的 SVG 与其参考图像的相似度对其进行评分。跨 16 个实验,120 人产生了 4,800 个评分。

所有实验都在 PsyNet 框架上运行,该框架是一种门户,旨在容纳人类和 AI 系统之间的结构化交互。

该研究将招募 604 名英语母语者,参加测试,测试将消耗 4,800 个用于代码生成的 API 调用和 5,327 个用于指令的 API 调用。虽然 GPT-5 是主要使用的模型,但还使用 Claude Opus 4.5 和 Gemini 3 Pro 进行了较小的比较批处理,每个批处理处理 280 个查询。

结果

运行了 30 轮 Vibe 编码,每轮由 15 个核心参考图像的编辑组成。为此,选择了 45 名人类参与者,每人在十次迭代中同时担任选择器和教练,在“人类领导”的回合中。

在每个回合中,同一参与者首先在当前和前一个 SVG 之间做出选择,然后编写下一轮指令。

第二个版本的测试用 GPT 5 的 API 调用替换了这些人类决策,同时保持设置的其他部分不变。在所有情况下,教练和选择器角色都以纯语言提示代码生成器。

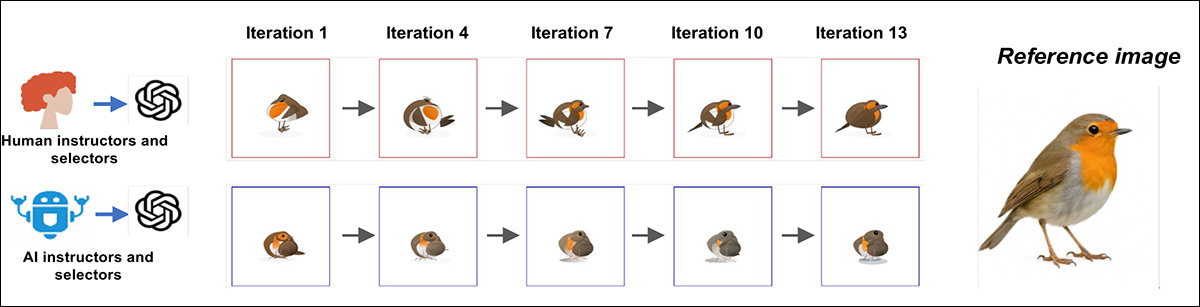

一个代表性的多轮 Vibe 编码示例展示了该过程如何随着时间的推移而分歧;当人类同时担任选择器和教练时,SVG 输出在迭代中稳步改进,随着每个回合的进行而越来越接近参考图像:

一个人参考图像在人类领导(上)和 AI 领导(下)Vibe 编码下的进展,显示人类在两个角色中的稳步改进和 AI 处理时的停滞或漂移。

相反,在 AI 领导版本中,早期回合有时会捕捉到关键的视觉特征,但后续尝试未能在这些收益基础上继续改进,有时甚至会偏离目标:

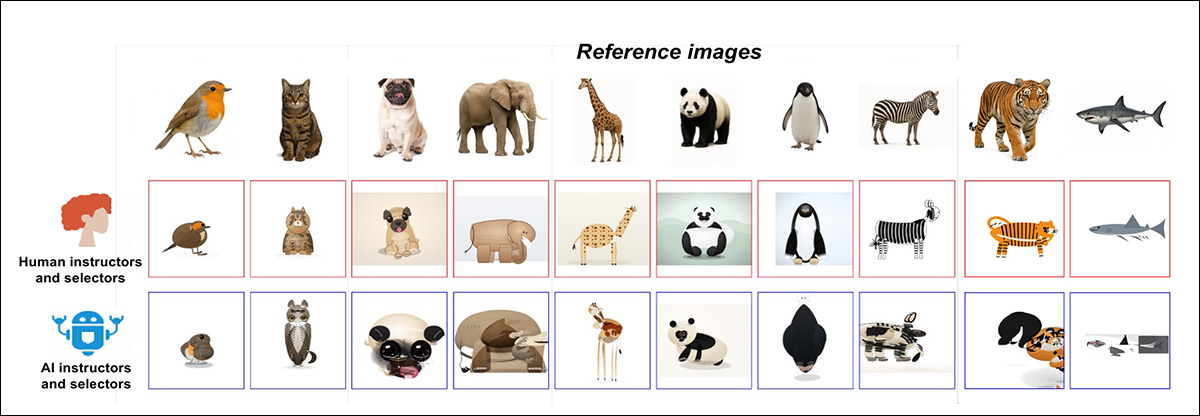

最终迭代的最终输出,比较人类领导(上行)和 AI 领导(下行)链,跨越相同的参考图像集。人类领导结果更接近原始动物,而 AI 领导结果显示出明显的失真或关键特征的丢失。

为了量化出现的趋势,最后的图像被展示给独立的人类评估者,并根据与参考图像的相似度进行评分。在早期回合中,人类领导和 AI 领导运行的评分大致相同;但到第 15 个回合时,差异就很明显,人类选择的图像被评为更接近目标。

人类领导和 AI 领导 Vibe 编码的平均相似度评分,显示当人类同时担任选择器和教练时,稳步改进,而当两个角色都由 GPT 5 处理时,会逐渐下降。

为了确保出现的趋势不是多个人类参与者集体努力的结果,研究人员招募了十名额外的人,每人单独运行三个回合——结果以相同的方式稳步改进,表明收益并非集体努力的偶然。

大局

然而,如果 GPT-5 自己评估输出,会不会承认人类结果更好?人类和 AI 评分通常朝同一方向移动,因此模型可以区分好坏,但一致地将 AI 生成的图像评为 高于人类评分。

‘具体来说,我们询问了 AI 代理是否会承认自己的输出比人类生成的输出更差,或者是否偏爱自己的创作,这将表明潜在的对齐问题。’

事实证明,确实存在对齐问题:

‘AI 评估者为 AI 生成的输出分配了更高的评分。这些发现表明,观察到的性能差异可能源于人类和 AI 之间的表示不一致。’

在检查人类和 AI 如何措辞指导时,差异变得明显:

人类和 AI 在编码任务中给出指令的比较。’A’ 显示人类编写简短、直接的指令,而 AI 编写长、详细的描述。’B’ 映射指令,显示人类提示聚集在一起,而 AI 提示根据动物分开。’C’ 跟踪限制 AI 指令长度对其随时间推移的糟糕结果没有影响;’D’ 说明人类在即使施加单词限制时也比 AI 提供更多样化和平衡的指导。

人类指令往往简短且切中要点,提供可以在目标上普遍应用的清晰编辑。另一方面,AI 指令密集而详细,通常充满了关于阴影、纹理、照明或解剖学细节的描述——这些描述可能在孤立中有意义,但无法为模型提供有用的下一步(这对于那些熟悉 LLMs 的人来说是熟悉的,例如 上下文长度问题,即在项目开发和增长时保持“大局”的能力)。

为了查看减少冗长是否能改善性能,GPT-5 被限制在每条指令 10、20 或 30 个单词内;但是,即使这些压缩的指令也未能显示任何改善(见上图右下角)。

联合努力

为了测试人类和 AI 共享 控制权时会发生什么,研究人员运行了具有不同人类和 AI 输入混合的编码任务,从 主要是人类 到 主要是 AI。

每个混合设置都优于完全 AI 控制,因此,即使是一小部分人类指导也能改善结果:

具有不同人类/AI 混合的混合编码设置。 (A) 显示人类和 AI 如何在每个编码步骤中轮流担任教练和选择器; (B) 显示更多的人类参与导致更高质量的结果,而更多的 AI 输入降低了评分; (C) 描绘了最终输出质量的稳定下降,随着人类参与的份额减少,确认更一致的人类方向产生了更好的结果。

随着 AI 承担更多流程,性能会下降,最佳结果出现在人类领导大多数回合,而最差结果出现在 AI 领导大多数回合时。这些混合设置都无法随着新回合的增加而持续改进,表明人类方向在稳定和一致时效果最佳,而不是偶尔的。

角色逆转

该研究还探讨了在此类任务中谁做什么是否重要,并测试了这一点。

修订后的练习涉及两个任务:一个参与者将指示如何更改图像,另一个将选择一个更喜欢的版本。

当两个任务都由人类完成时,质量得到维持;但当人类提供指令且 无人 选择版本时,质量会变差:

Vibe 编码中角色划分的测试。 (A) 移除选择器角色会导致性能变差,即使人类提供指令; (B) 用 AI 替换人类选择器会略微降低质量,但不如完全跳过选择那么严重。

当 AI 负责时,跳过选择步骤没有区别,因为其输出在两种情况下都保持一致;但当人类提供指令且 AI 选择结果时,质量保持接近于全人类设置。

相反,当 AI 提供指令且人类选择输出时,会导致 更弱 的结果,表明人类创造性指导仍然至关重要,而选择选项的任务可以在没有太大损失的情况下交给 AI。

该论文得出结论:

‘创意生成和指令是人类的关键贡献,而评估和选择通常可以委托给 AI 而不会损害性能。 ‘

‘这表明混合系统的实际设计原则:人类应设定方向,而 AI 可以支持评估和执行。’

结论

仍然需要等待,看看改进和/或增加的上下文窗口将如何影响 LLM 在此类任务中的性能。改善和/或增加上下文窗口的那一天可能是人类-AI 协作的日常烦恼的庆祝和警告,因为 AI 正在努力解决的这个问题,可能是 人。

然而,作者的工作也清楚地表明,人类和 AI 之间存在 固有 和关键的质量 质量 分歧,这可能最终由消费者决定是一个不可替代的人类概念。

* 我将作者的内联引用转换为超链接。

首次发布于 2026 年 2 月 13 日星期五