Штучний інтелект

RigNeRF: Новий метод Deepfakes, який використовує нейронні поля радіанції

Нова дослідницька робота, розроблена в Adobe, пропонує перший життєздатний і ефективний метод deepfakes на основі нейронних полів радіанції (NeRF) – можливо, перша справжня інновація в архітектурі або підході за останні п’ять років з моменту появи deepfakes у 2017 році.

Метод, названий RigNeRF, використовує 3D-моделі морфування обличчя (3DMM) як проміжний шар інструментальності між бажаним входом (тобто ідентичністю, яку потрібно імпонувати в NeRF-рендер) і нейронним простором, метод, який широко采用ли останніми роками підходи синтезу обличчя з використанням генеративних суперницьких мереж (GAN), жодна з яких ще не продемонструвала функціональних та корисних рамок для заміни обличчя у відео.

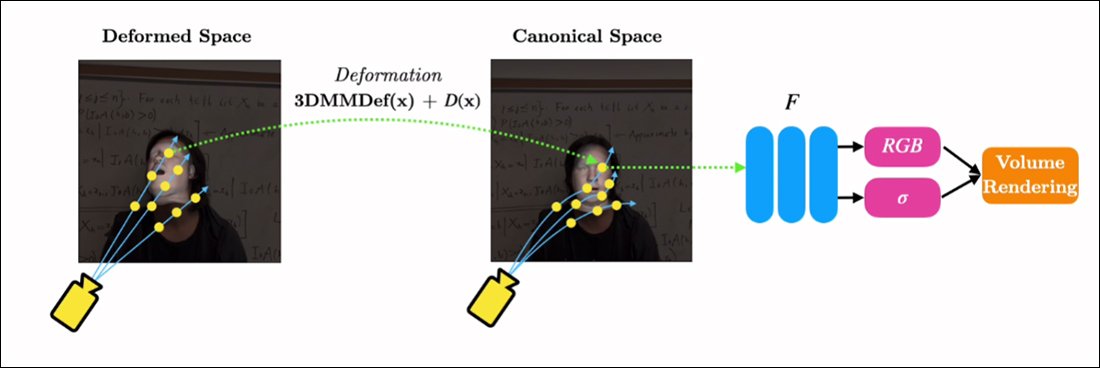

На відміну від традиційних відео deepfakes, жоден з рухомого контенту, зображеного тут, не є ‘реальним’, а радше це досліджуваний нейронний простір, який був навчений на короткому відео. Праворуч ми бачимо 3D-модель морфування обличчя (3DMM), яка діє як інтерфейс між бажаними маніпуляціями (‘усміхатися’, ‘дивитися наліво’, ‘дивитися вгору’ тощо) і зазвичай недоступними параметрами візуалізації нейронного поля радіанції. Для високоякісної версії цього кліпу, а також інших прикладів, див. сторінку проекту, або вбудовані відео в кінці цієї статті. Джерело: https://shahrukhathar.github.io/2022/06/06/RigNeRF.html

3D-моделі морфування обличчя (3DMM) є ефективно моделями обличчя CGI, параметри яких можна адаптувати до більш абстрактних систем синтезу зображень, таких як NeRF і GAN, які в іншому випадку важко контролювати.

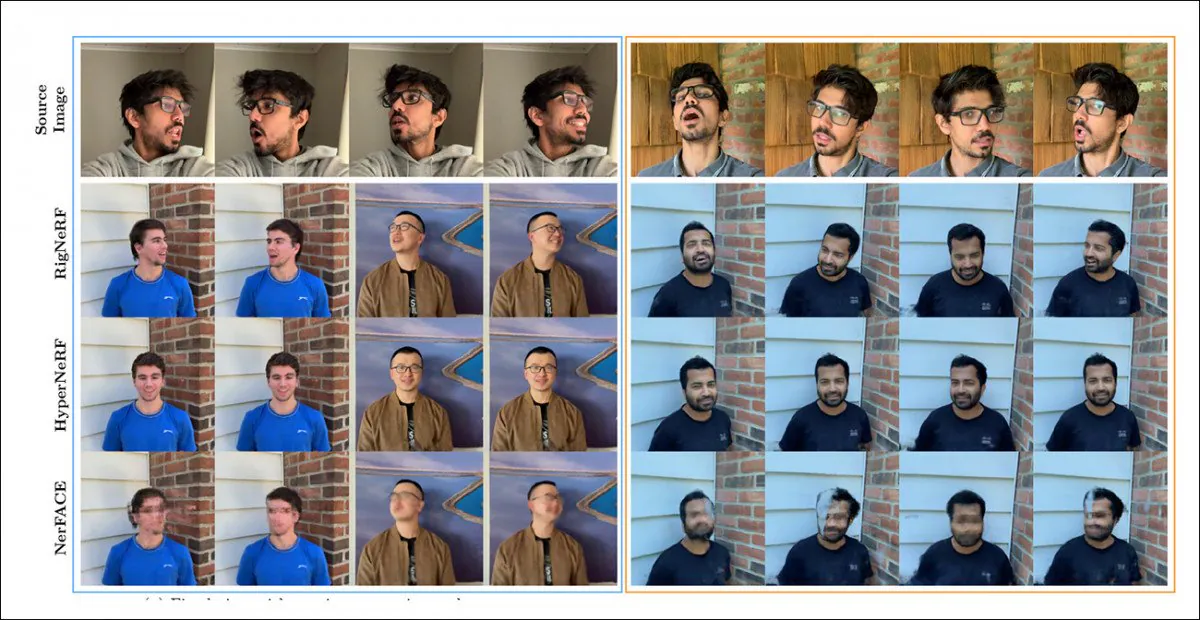

Що ви бачите на зображенні вище (середнє зображення, чоловік у синій сорочці), а також зображенні прямо під ним (ліве зображення, чоловік у синій сорочці), не є ‘реальним’ відео, у яке було вставлено невеликий шматок ‘фальшивого’ обличчя, а радше повністю синтезованою сценою, яка існує лише як об’ємний нейронний рендер – включаючи тіло і фон:

У прикладі прямо вище реальне відео праворуч (жінка у червоному платьї) використовується для ‘маріонетки’ захопленої ідентичності (чоловік у синій сорочці) ліворуч через RigNeRF, який (автори стверджують) є першим системою на основі NeRF, яка досягла розділення пози та виразу, а також能够 виконувати нові синтези виду.

Чоловічу фігуру ліворуч на зображенні вище було ‘захоплено’ з 70-секундного відео, знятого на смартфоні, і вхідні дані (включаючи всю інформацію про сцену) були згодом навчені на 4 V100 GPU, щоб отримати сцену.

Оскільки 3D-моделі морфування обличчя (3DMM) також доступні як цілісні параметричні моделі CGI (а не тільки моделі обличчя), RigNeRF потенційно відкриває можливість повністю тіла deepfakes, де реальне людське рух, текстура та вираз передаються до параметричного шару CGI, який потім перекладає дію та вираз у візуалізовані середовища та відео NeRF.

Що стосується RigNeRF – чи кваліфікується він як метод deepfakes у поточному сенсі, яким розуміють цей термін заголовки? Чи це просто ще один напівхромий аутсайдер до DeepFaceLab та інших трудомістких, 2017-річних автоенкодерних систем deepfakes?

Дослідники нової статті незрівнянні щодо цього питання:

‘Будучи методом, який здатний оживляти обличчя, RigNeRF схильний до зловживання злим акторам для генерації deep-fakes.’

Нова стаття називається RigNeRF: Повністю керований нейронний 3D-портрет, і походить від ShahRukh Atha з Університету Стоні-Брук, стажера в Adobe під час розробки RigNeRF, та чотирьох інших авторів з Adobe Research.

Поза автоенкодерними deepfakes

Більшість вірусних deepfakes, які захопили заголовки за останні кілька років, виробляються автоенкодерними системами, отриманими з коду, який був опублікований на забороненому р/deepfakes subreddit у 2017 році – хоча й не раніше, ніж був скопійований на GitHub, де він зараз був форкнутий більше тисячі разів, не в останню чергу в популярну (хоча спірну) DeepFaceLab розподіл, і також проект FaceSwap.

Окрім GAN і NeRF, автоенкодерні рамки також експериментували з 3D-моделями морфування обличчя (3DMM) як ‘директорами’ для покращення рамок синтезу обличчя. Прикладом цього є проект HifiFace з липня 2021 року. Однак жодна корисна чи популярна ініціатива не здається розвиненою з цього підходу на сьогодні.

Дані для сцен RigNeRF отримуються шляхом захоплення коротких відео на смартфоні. Для проекту дослідники використовували iPhone XR або iPhone 12 для всіх експериментів. Для першої половини захоплення суб’єкт проситься виконувати широкий спектр виразів обличчя та мови, зберігаючи голову нерухомо, поки камера рухається навколо нього.

Для другої половини захоплення камера зберігає фіксовану позицію, тоді як суб’єкт повинен рухати головою, виражаючи широкий спектр виразів. Результатом є 40-70 секунд відео (приблизно 1200-2100 кадрів), яке становить весь набір даних, який буде використаний для навчання моделі.

Зменшення збору даних

На відміну від цього, автоенкодерні системи, такі як DeepFaceLab, вимагають відносно трудомісткого збору та кураторства тисяч різноманітних фотографій, часто взятих з відео на YouTube та інших соціальних мереж, а також з фільмів (у випадку deepfakes знаменитостей).

Результатом є навчені автоенкодерні моделі, які часто призначені для використання в різноманітних ситуаціях. Однак найбільш ретельні ‘deepfakes знаменитостей’ можуть навчати цілі моделі з нуля для одного відео, незважаючи на те, що навчання може тривати тиждень або більше.

Незважаючи на попередню ноту від дослідників нової статті, ‘лоскутне’ та широко зібране набори даних, які живлять AI-порнографію, а також популярні відео на YouTube/TikTok ‘deepfake перезаписи’, здаються малоймовірними для отримання прийнятних та послідовних результатів у системі deepfakes, такій як RigNeRF, яка має сценарій-специфічний метод. З огляду на обмеження на захоплення даних, викладені в новій роботі, це може виявитися додатковим захистом проти випадкового порушення ідентичності злим deepfakers.

Адаптація NeRF до відео deepfakes

NeRF є фотограмметричним методом, у якому невелика кількість джерельних зображень, знятих з різних точок зору, збираються в досліджуваний 3D нейронний простір. Цей підхід прийшов до провідної позиції на початку цього року, коли NVIDIA представила свою Instant NeRF систему, здатну скоротити витратний час навчання для NeRF до хвилин або навіть секунд:

Instant NeRF. Джерело: https://www.youtube.com/watch?v=DJ2hcC1orc4

Результатом є нейронне поле радіанції сцени, яке є статичним середовищем, яке можна дослідити, але яке важко редагувати. Дослідники відзначають, що дві попередні ініціативи на основі NeRF – HyperNeRF + E/P і NerFACE – зробили спробу синтезу відео обличчя, і (очевидно, для цілей повноти та ретельності) встановили RigNeRF проти цих двох рамок у тестовому раунді:

Ясна порівняльна характеристика між RigNeRF, HyperNeRF і NerFACE. Див. пов’язані джерельні відео та PDF для високоякісних версій. Статичне джерело зображення: https://arxiv.org/pdf/2012.03065.pdf

Однак у цьому випадку результати, які схвалюють RigNeRF, є досить аномальними, з двох причин: по-перше, автори відзначають, що ‘немає існуючої роботи для яблуко-до-яблука порівняння’; по-друге, це змусило обмежити можливості RigNeRF, щоб至少 частково збігатися з більш обмеженою функціональністю попередніх систем.

Оскільки результати не є інкрементним покращенням попередніх робіт, а радше представляють ‘прорив’ у редакції та корисності NeRF, ми залишимо тестовий раунд окремо, і натомість побачимо, що RigNeRF робить інакше, ніж його попередники.

Об’єднані сили

Основним обмеженням NerFACE, яке може створювати контроль пози/виразу в середовищі NeRF, є те, що воно припускає, що джерельне відео буде зняте з статичної камери. Це фактично означає, що воно не може генерувати нові види, які виходять за межі його обмежень захоплення. Це створює систему, яка може створювати ‘рухомі портрети’, але яка не підходить для відео deepfakes.

HyperNeRF, з іншого боку, хоча і може генерувати нові та гіперреалістичні види, не має жодної інструментальності, яка дозволяє йому змінювати позу голови чи вираз обличчя, що знову не призводить до жодного конкурента для автоенкодерних deepfakes.

RigNeRF може об’єднати ці дві ізольовані функції, створюючи ‘канонічний простір’, базовий рівень, від якого можуть бути здійснені відхилення та деформації через вхід від модуля 3DMM.

Створення ‘канонічного простору’ (без пози, без виразу), на якому можуть діяти деформації (тобто пози та вирази), вироблені через модуль 3DMM.

Оскільки система 3DMM не буде точно збігатися з захопленим суб’єктом, важливо компенсувати це в процесі. RigNeRF досягає цього за допомогою поля деформації перед тим, як розрахувати його з багатошаровим перцептроном (MLP), отриманим з джерельного відео.

Параметри камери, необхідні для розрахунку деформацій, отримуються через COLMAP, тоді як параметри виразу та форми для кожного кадру отримуються з DECA.

Позиціонування далі оптимізується через підгонку орієнтирів і параметрів камери COLMAP, і, через обмеження обчислювальних ресурсів, вихідне відео масштабується до роздільної здатності 256×256 для навчання (це процес масштабування, обмежений апаратним забезпеченням, який також переслідує сцену автоенкодерних deepfakes).

Після цього мережа деформації навчається на чотирьох V100 – потужному апаратному забезпеченні, яке малоймовірно буде доступне для випадкових ентузіастів (однак, де навчання моделей машинного навчання стосується, часто можна торгувати потужністю за час, і просто прийняти, що навчання моделі буде займати дні або навіть тижні).

Нарешті, дослідники заявляють:

‘На відміну від інших методів, RigNeRF, завдяки використанню модуля деформації 3DMM, здатний моделювати позу голови, вираз обличчя та повну 3D-сцену портрета з високою вірогідністю, тим самим даючи краще реконструкції з чіткими деталями.’

Див. вбудовані відео нижче для подальших деталей та результатів відео.

Перша публікація 15 червня 2022 року.