Погляд Anderson

Штучне розділення веб-пошуку на три різні реальності

Нові дослідження показують, що Google тепер використовує три різні системи інформації всередині своєї пошукової імперії, з регулярним пошуком, оглядами штучного інтелекту та Gemini, всі з яких віддають перевагу різним джерелам, рейтингам та вмісту.

Редукціонізм панує. За останні дванадцять місяців, ‘Дайте мені погуглити це для вас’ мем був витіснений новим ‘Дайте мені підсумувати той пошук Google для вас’ трендом, в якому огляди штучного інтелекту у результатах пошуку все частіше позбавляють читачів від клікання на посилання пошуку (аргументно де-факто позбавляючи джерела фінансування у процесі), конденсуючи весь результат пошуку в кілька згенерованих абзаців.

Хтось міг би подумати, що основні знання, що виникають, і вибір сайтів, з яких можна отримати ці знання, будуть відносно схожими для всіх трьох найпопулярніших методів пошуку інформації в Інтернеті: у традиційному веб-пошуку; у оглядах штучного інтелекту (AIOs), які тепер очолюють більшість результатів веб-пошуку; і через зростаюче використання LLM, таких як ChatGPT, як веб-оракули (з або без зовнішніх викликів RAG).

Однак, недавні дослідження в США показують, що це, на диво, далеко не так; і що навіть всередині власної тріади оракулів Google – SERPS*, оглядів штучного інтелекту та прямої взаємодії з серією LLM Gemini – існують суттєві та цікаві розбіжності для кожного маршруту.

Тристоронній розкол

У ясному та обширному новому дослідженні, озаглавленому Як штучний інтелект порушує пошук: Емпіричне дослідження пошукової системи Google, Gemini та оглядів штучного інтелекту, шість дослідників з Нью-Джерсі Інституту технологій описують способи, якими три методи пошуку розходяться, і пропонують деякі можливі теорії для цих розколів у підході.

Дослідження показує:

‘[По-перше, ми] виявили, що для 51,5% представницьких запитів реальних користувачів оглядів штучного інтелекту генеруються та відображаються над органічними результатами пошуку. Спірні питання часто призводять до оглядів штучного інтелекту.

‘По-друге, ми показуємо, що джерела, які повертаються, суттєво різні для кожного пошукового двигуна (<0,2 середньої схожості Джаккарда). Традиційний пошук Google значно частіше повертає інформацію з популярних або інституційних сайтів уряду чи освіти, тоді як пошукові двигуни на основі штучного інтелекту значно частіше повертають вміст, що належить Google.

‘Третє, ми спостерігаємо, що сайти, які блокують веб-краулер штучного інтелекту Google, значно менше ймовірно повертаються оглядами штучного інтелекту, незважаючи на доступ до вмісту.’

Оскільки дослідження є смузібордом з цікавих відкриттів, а не підкоряється звичайній лінійній та методичній роботі, ми розглянемо ці відкриття ближче, а також деякі інші з них.

Старий ‘Два-Один’

Одним з багатьох цікавих відкриттів у дослідженні є те, що оглядів штучного інтелекту Google tendенсії до придушення для раптових подій, оскільки найперші та найбільш доступні джерела можуть не бути найбільш точними.

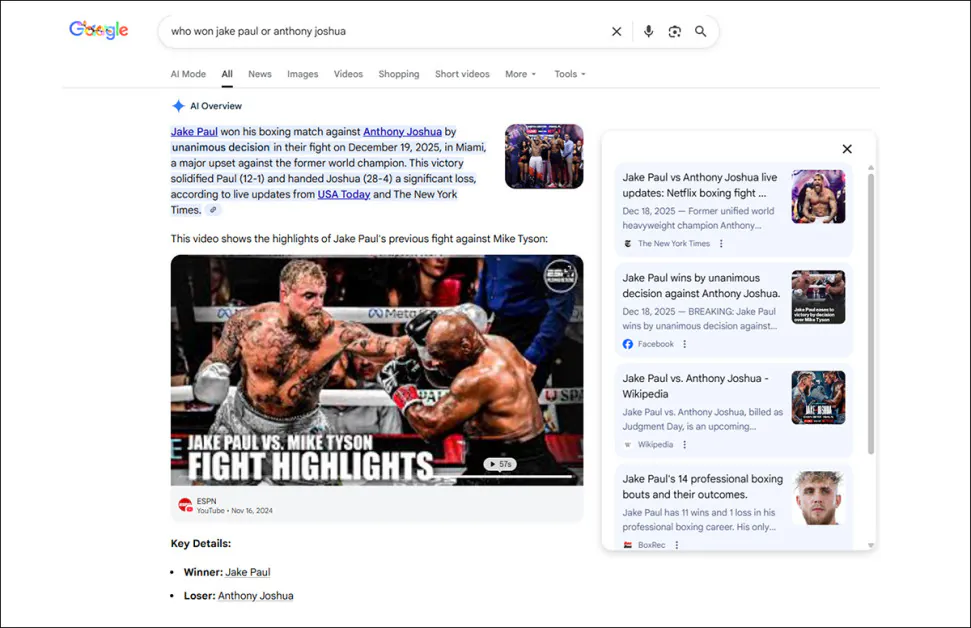

Ця система не завжди працює: у прикладі, який відмітили дослідники, огляд штучного інтелекту Google щодо результату боксерського матчу приписував перемогу неправильному боксеру, хоча єдиним джерелом, яке заявило про цей (неправильний) результат, був сатиричний спортивний канал на Facebook:

Одна з причин, чому оглядів штучного інтелекту Google уникують часу-критичних підсумків, полягає в тому, що рання інформація може бути неповною або зовсім неточною. У цьому випадку боксер Джейк Пол насправді програв матч. Джерело

Автори відмічають, що оглядів штучного інтелекту tendенсії до появи, коли подія є принаймні п’ять днів старою, що кваліфікує це як аномалію – але тим не менше, одну, яку дослідники були досить легко викликати.

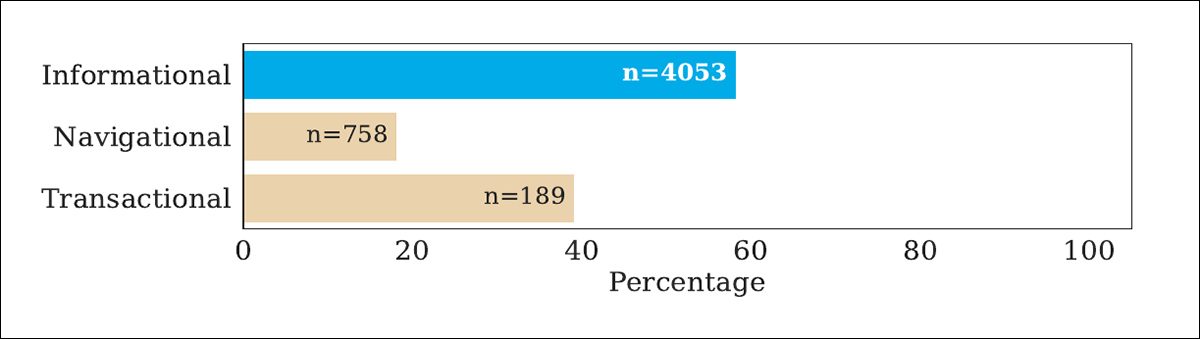

Оглядів штучного інтелекту tendенсії до генерації, коли запит завершувався знаком питання, і що інтент запиту був фактором у тому, чи буде представлений огляд штучного інтелекту:

Відсоток випадків, коли був згенерований огляд штучного інтелекту під час одного з раундів тестування дослідників. Тут ‘інформаційний’ вказує на прямий запит, який tendенсії до генерації оглядів штучного інтелекту більше, ніж будь-який інший тип взаємодії.

Крім того, дослідження стверджує, що триваліші запити tendенсії до генерації оглядів штучного інтелекту замість просто результатів пошуку, хоча автори ще не пропонують теорію, щоб пояснити це.

Поділене королівство

Можливо, найбільш дивовижним результатом нового дослідження є відносно малий перехрест результатів якості/типу між трьома пошуковими платформами Google.

Дослідження повторно показує, що регулярний пошук Google, оглядів штучного інтелекту та Gemini (LLM) повертають суттєво різні джерела для одного й того ж запиту, з низькими показниками схожості, які свідчать про три конкуруючі логіки пошуку всередині однієї компанії, тоді як користувачі могли б припустити, що у Google є один авторитетний індекс і одна філософія рейтингу:

Даже всередині екосистеми Google перехрест між традиційним пошуком, оглядами штучного інтелекту та Gemini виявився досить малим, з тим самим запитом, який часто повертав суттєво різні списки джерел залежно від того, якою системою Google оброблявся запит. У цьому порівнянні ми бачимо, як близько три системи збігалися одна з одною протягом тисяч запитів пошуку, від тем шопінгу та дебатів до місцевих пошуків та загальних знань, з нижчими показниками, які свідчать про меншу згоду між джерелами, обраними.

Відносно цього розділу свого аналізу автори стверджують†:

‘[Таблиця вище] представляє середню схожість між списком джерел, повернутих оглядами штучного інтелекту, Gemini та традиційним SERP для кожного запиту в наборі даних.

‘Головний висновок полягає в тому, що незалежно від підмножини запиту та якої пари пошукових двигунів порівнюється, повернуті списки є несхожими, незважаючи на те, що всі три були розроблені Google.’

Дослідники далі стверджують, що жоден пошуковий метод, який вони протестували, не мав зміщеного рейтингу (RBO) вище 0,27, що є дуже низьким показником. Вони відмічають далі, що Amazon Retail та локалізовані запити (тобто, ‘магазини поруч зі мною’) мали найнижчу схожість серед пошукових методів.

Вони приписують низьку згоду фундаментальній ‘несумісності між пошуковими двигунами’, відмічаючи, що ні випадковість, ні будь-який інший очевидний фактор не можуть бути зроблені, щоб пояснити цю десинхронізацію.

Одне інтуїтивне пояснення, можливо, полягає в тому, що точки тренування даних призначені ранг в дуже іншому спосіб, ніж методи, які Google розробила для PageRank та його наступників за останні два десятиліття. Крім того, якщо алгоритм пошукової системи Google має секретну програму, то такий тип втручання або ‘ігри’, досить важко постійно реалізовувати в дифузійних штучних інтелектах, таких як Gemini (навіть через фільтрацію, системні запити та інші методи коригування, які застосовуються до комерційних моделей).

Самообслуговування..?

Деякі сайти або категорії сайтів, здається, були вплинути адвентом оглядів штучного інтелекту та поширенням пошукових систем на основі LLM у традиційний простір пошуку – як негативно, так і позитивно, залежно від випадку:

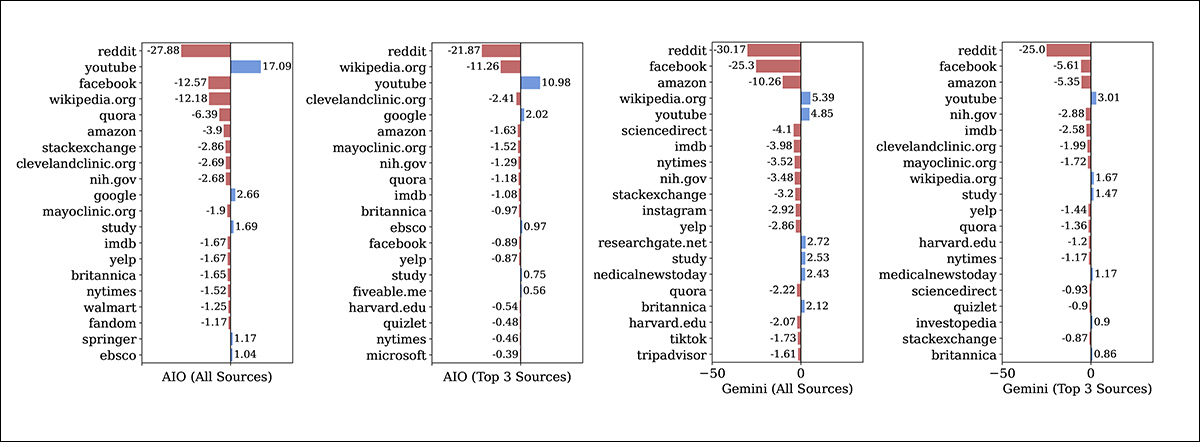

У порівнянні з традиційним пошуком Google, оглядів штучного інтелекту та Gemini обидва знижували цитування багатьох великих сайтів, одночасно збільшуючи видимість для меншої кількості вибраних доменів. YouTube став одним з найбільших бенефіціарів обох систем, тоді як Reddit, Вікіпедія, Facebook та багато інституційних джерел з’являлися рідше в генерації оглядів штучного інтелекту.

Автори відмічають, що деякі несподівані переваги виникають серед трьох методів під час тестування:

‘У нас є три основні висновки з [графіків вище]. По-перше, великі та відомі сайти є найбільш вплинутими (і позитивно, і негативно). Це інтуїтивно, оскільки великі сайти мають репутацію та різноманітність вмісту, щоб бути актуальними для багатьох різних запитів.

‘По-друге, абсолютна більшість цих сайтів отримують менше загальних та менше топ-трьох цитувань з пошуковими системами на основі штучного інтелекту (показані червоними барами та негативними числами в [графіках вище]). Це свідчить про те, що пошукові системи на основі штучного інтелекту tendенсії до джерел інформації з більш нішевих джерел, ніж традиційні пошукові двигуни.

‘По-третє, оглядів штучного інтелекту Google віддають перевагу сайтам Google (тобто, доменам google.com та youtube.com).

‘Gemini також віддає перевагу YouTube у порівнянні з традиційним пошуком Google, але абсолютна різниця менша.’

Блокатори..?

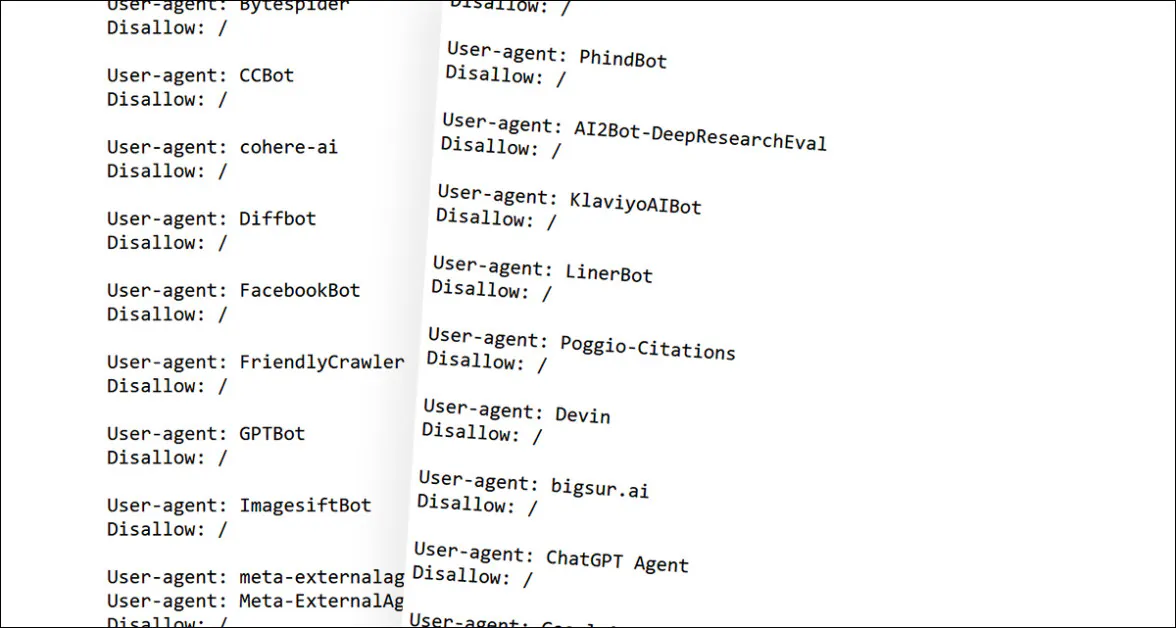

Дослідження також показало, що видавці, які блокують веб-краулер штучного інтелекту Google – автоматизований веб-бот, який скрапує дані з вашого сайту, якщо ви не скажете йому не робити цього за допомогою файлу robots.txt – tendенсії до появи менше в оглядів штучного інтелекту.

Це може здатися очевидним самозлікуванням, але насправді Google заявило публічно, що вміст з платформ, які блокують веб-краулер штучного інтелекту, не буде запобігати появі в оглядів штучного інтелекту; скоріше, видавці просто не будуть мати свій вміст скрапований, кураторований та виконаний наступний раунд тренування для Gemini та інших проектів штучного інтелекту Google.

Однак, це не був висновок, до якого прийшли дослідники, які виявили, що популярні видавці, які забороняють веб-краулер штучного інтелекту, дуже рідко цитувалися Gemini, як у LLM, так і в більш легкій версії результатів пошуку. ‘Ефектно заборонені’ видавці були повідомлені в дослідженні як NYTimes, CNN, BBC, ScienceDirect, Reuters, Wiley, Nature, ESPN, Business Insider, CNBC, NPR, WIRED, USA Today, NBC News, Genius, National Geographic, The Conversation, U.S. News & World Report, Scientific American, Consumer Reports та STAT.

Деякі з блокувань скрапування штучного інтелекту, здійснених видавцями, переліченими вище. Але чи призвело це до більш широкого цензурування з боку Google?

Автори стверджують:

‘У наших аналізах найбільш вплинутих доменів ми виявили, що 21 популярний [видавець] (які повертаються для принаймні 20 унікальних запитів як пошуком Google, так і оглядами штучного інтелекту) ніколи не цитувалися Gemini.

‘Деякі популярні соціальні медіа (Facebook, Instagram, Tiktok) та сайти відгуків (IMDb, Yelp, Tripadvisor) також отримали нуль цитувань від Gemini. Після подальшого дослідження ми виявили, що всі ці сайти блокують бота Google-Extended у своїх файлах robots.txt.’

Якщо це відкриття виявиться підтвердженим в інших місцях та постійним, можна припустити, що ці компанії потенційно піддаються тиску з боку Google до капітуляції та співробітництва зі своїми операціями штучного інтелекту через часткове виключення з списків. На перший погляд, результати здаються каральними – але потім відкриття нового дослідження більше свідчать про хаос, ніж про попередню думку; тому єдиним розумним коментарем, який можна зробити, є те, що ці результати виглядають поверхнево ‘злісними’, незалежно від того, що насправді їх викликає.

Висновок

Висновок Це ясне дослідження, яке є справжнім зіп-бомбою, чий десяти сторінок текст розгортається в майже повну каскаду додаткових відкриттів. Оскільки у нас було час розглянути тільки невелику частину цих відкриттів, я рекомендую джерельний PDF навіть пасивному читачеві (рідка подія).

Хоча ‘жовтий’ настрій міг би кинути багато негативних інтерпретацій на відкриття авторів, робота найкраще розглядається як свідчення глобального лідера технологій, який намагається отримати та зберегти лідерство у сфері пошуку на основі штучного інтелекту, використовуючи високо-контрастні платформи, які розвивалися в дуже різних обставинах та епохах.

Під час того, як у дослідженні розглядаються три методи пошуку, справжня суперечка полягає між традиційними результатами пошукової системи, ранжованими за власними методами, та різко-контрастними розподільчими методами вибору, які домінують у кураторстві даних та тренуванні штучного інтелекту.

Штучний інтелект, як у 1999

До появи Google, було можливим ‘іграти’ результати пошуку за допомогою простої кількості, і в цьому спосіб можна було часто досягти першої сторінки SERPS за мінімальних (часто автоматизованих) зусиль. Ця ‘гра з числами’ була ефективно припинена близько 2002 року більш складним та секретним алгоритмом ранжування пошукової системи Google. Але оскільки ставки були значними, високий обсяг та низькякісний вміст ніколи не зникав у будь-якому значному сенсі.

Отже, до часу, коли гіпермасштабні колекції, такі як Common Crawl, поклали основу сучасної революції штучного інтелекту, домінування даних було призначено для того, щоб бути домінованим ступенем, у якому автоматизовані процеси могли фільтрувати та ранжувати якість вхідних даних, і (значно менше) ступенем, у якому були доступні гроші, щоб платити людям за ранжування цих даних.

Було багато поганого або низькякісного вмісту у цих величезних та недискримінаційних колекціях; вмісту, який не містив огиди, лайки, расові тропи чи будь-які інші речі, які досить легко фільтрувати з тренувальних наборів даних – але який був все-таки самозаключеним та об’ємним, як і результати інтернет-пошуку близько 1999-2001 років.

Оскільки ці процеси індукції даних все ще не ідеальні, дуже важко навіть для Google змусити штучний інтелект діяти у бізнес-like манері, оскільки рішення Gemini щодо PageRank-стилю диктуються не інженерами-політиками Google, а недосконалим розумінням того, як гіпермасштабні дані перетворюються у розподіли даних та латентні вкладення під час тренування моделі штучного інтелекту.

* Сторінки результатів пошукової системи.

† Акцент авторів, не мій. Однак, я замінив жирний шрифт на курсив, оскільки курсивний акцент не працює добре у цитатах, які вже в основному курсивні.

Перше опубліковано середу, 13 травня 2026