ความปลอดภัยไซเบอร์

ทำไมการโจมตีรูปภาพที่เป็นอันตรายจึงไม่ใช่เรื่องตลก

การโจมตีระบบการรับรู้ภาพด้วยรูปภาพที่สร้างขึ้นอย่างรอบคอบได้รับการพิจารณาว่าเป็นเรื่องตลกแต่ไม่มีนัยสำคัญเป็นเวลาประมาณห้าปี แต่การวิจัยใหม่จากออสเตรเลียชี้ให้เห็นว่าการใช้รูปภาพที่มีชื่อเสียงสูงสำหรับโครงการ AI 상업อาจสร้างปัญหาความปลอดภัยที่ยั่งยืนใหม่

เป็นเวลาหลายปีที่แล้วทีมนักวิชาการจากมหาวิทยาลัยแห่งหนึ่งในออสเตรเลียได้พยายามอธิบายบางสิ่งที่สำคัญมากเกี่ยวกับอนาคตของระบบการรับรู้ภาพที่ใช้ AI

เป็นสิ่งที่จะยาก (และแพงมาก) ที่จะแก้ไข ทันที และซึ่งจะไม่ยอมรับได้ในการแก้ไขเมื่อแนวโน้มในปัจจุบันในการวิจัยการรับรู้ภาพได้ถูกพัฒนาเป็นการใช้งานเชิงพาณิชย์และอุตสาหกรรมใน 5-10 ปีข้างหน้า

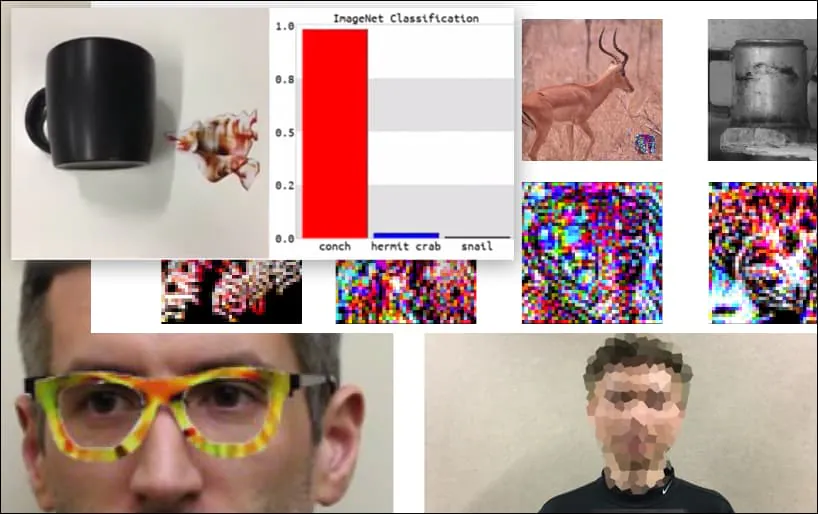

ก่อนที่เราจะเข้าไปดูรายละเอียด ลองดูรูปดอกไม้ที่ถูกจำแนกเป็นประธานาธิบดีบารัค โอบามา จากหนึ่งในหกวิดีที่ทีมได้เผยแพร่บน หน้าโครงการ:

Source: https://www.youtube.com/watch?v=Klepca1Ny3c

ในรูปด้านบน ระบบการรับรู้ใบหน้าที่รู้จักบารัค โอบามาได้ถูกหลอกให้เชื่อว่าชายที่ไม่ระบุชื่อที่ถือรูปภาพที่สร้างขึ้นเป็นอันตรายของดอกไม้คือบารัค โอบามาด้วยความมั่นใจ 80% ระบบไม่สนใจว่า ‘ใบหน้าปลอม’ อยู่บนหน้าอกของชายคนนั้นแทนที่จะเป็นบนไหล่

แม้ว่าจะน่าประทับใจที่นักวิจัยสามารถทำสิ่งนี้ได้โดยการสร้างรูปภาพที่สอดคล้องกัน (ดอกไม้) แทนที่จะเป็นเพียงเสียงรบกวนแบบสุ่ม แต่ดูเหมือนว่าข้อบกพร่องที่น่าหัวเราะแบบนี้จะเกิดขึ้นบ่อยๆ ในการวิจัยด้านความปลอดภัยเกี่ยวกับการมองเห็นของคอมพิวเตอร์ ตัวอย่างเช่น แว่นตาที่มีลวดลายแปลกๆ ที่สามารถหลอกระบบการรับรู้ใบหน้า ในปี 2016 หรือรูปภาพที่สร้างขึ้นเป็นอันตรายที่ พยายามเขียนซ้ำป้ายถนน

หากคุณสนใจ โมเดล Convolutional Neural Network (CNN) ที่ถูกโจมตีในตัวอย่างด้านบนคือ VGGFace (VGG-16) ที่ได้รับการฝึกฝนจากชุดข้อมูล PubFig ของมหาวิทยาลัยโคลัมเบีย ตัวอย่างการโจมตีอื่นๆ ที่พัฒนาขึ้นโดยนักวิจัยใช้ทรัพยากรที่แตกต่างกันในหลายๆ การผสมผสาน

คีย์บอร์ดถูกจำแนกเป็นปะการัง ในโมเดล WideResNet50 บน ImageNet นักวิจัยยังได้รับรองว่าโมเดลไม่มีความลำเอียงต่อปะการัง ดูวิดีโอที่สมบูรณ์สำหรับการแสดงสาธิตเพิ่มเติมที่ https://www.youtube.com/watch?v=dhTTjjrxIcU

การรับรู้ภาพเป็นเวกเตอร์การโจมตีที่เกิดขึ้นใหม่

การโจมตีที่น่าประทับใจหลายครั้งที่นักวิจัยอธิบายและแสดงให้เห็นไม่ใช่การวิพากษ์วิจารณ์ฐานข้อมูลหรือโครงสร้างพื้นฐานการเรียนรู้ของเครื่องเฉพาะ และไม่สามารถป้องกันได้ด้วยการเปลี่ยนฐานข้อมูลหรือโมเดล การฝึกโมเดลใหม่ หรือวิธีการ ‘ง่ายๆ’ อื่นๆ ที่ทำให้ผู้ปฏิบัติงาน ML หัวเราะเยาะการแสดงสาธิตที่ไม่สม่ำเสมอแบบนี้

แต่การโจมตีของทีมจากอเดลایدแสดงให้เห็นถึง จุดอ่อนที่สำคัญ ในโครงสร้างพื้นฐานทั้งหมดของการวิจัยและพัฒนา AI การรับรู้ภาพ ซึ่งอาจทำให้ระบบการรับรู้ภาพหลายระบบในอนาคตตกอยู่ในความเสี่ยงต่อการโจมตีจากผู้โจมตี และทำให้มาตรการป้องกันที่ตามมาอยู่ในตำแหน่งที่ไม่มีทางออก

ลองนึกถึงรูปภาพที่สร้างขึ้นเป็นอันตรายล่าสุด (เช่น ดอกไม้ด้านบน) ที่ถูกเพิ่มเป็น ‘การโจมตีแบบ zero-day’ ในระบบความปลอดภัยในอนาคต เช่นเดียวกับวิธีการป้องกันไวรัสและแอนตี้ไวรัสในปัจจุบันที่อัปเดตคำจำกัดความของไวรัสทุกวัน

ความเป็นไปได้ในการโจมตีรูปภาพที่สร้างขึ้นเป็นอันตรายใหม่ๆ จะไม่มีที่สิ้นสุด เนื่องจากระบบไม่ได้คาดการณ์ปัญหาในอนาคต เช่นเดียวกับที่เกิดขึ้นกับ อินเทอร์เน็ต บั๊กปี 2000 และ หอศิลป์ปิซา

ในทางใด เรากำลังสร้างฉากสำหรับสิ่งนี้

การรับข้อมูลสำหรับการโจมตี

รูปภาพที่สร้างขึ้นเป็นอันตราย เช่น ตัวอย่าง ‘ดอกไม้’ ด้านบน จะถูกสร้างขึ้นโดยการเข้าถึงชุดข้อมูลที่ใช้ในการฝึกโมเดล คุณไม่จำเป็นต้องมีการเข้าถึง ‘สิทธิพิเศษ’ ข้อมูลการฝึก (หรือโครงสร้างพื้นฐานแบบจำลอง) เนื่องจากชุดข้อมูลที่ได้รับความนิยมสูงสุด (และแบบจำลองที่ฝึกแล้วหลายแบบ) มีให้ใช้ฟรีในระบบการแบ่งปันไฟล์ที่มีการอัปเดตอย่างต่อเนื่อง

ตัวอย่างเช่น ImageNet ซึ่งเป็นยักษ์ใหญ่ของชุดข้อมูลการมองเห็นของคอมพิวเตอร์ สามารถ ดาวน์โหลดได้ ในทุกๆ การวนซ้ำ โดยไม่ต้องมีข้อจำกัดที่กำหนดไว้ตามปกติ และทำให้สามารถเข้าถึงองค์ประกอบสำคัญ เช่น ชุดตรวจสอบ

Source: https://academictorrents.com

หากคุณมีข้อมูล คุณสามารถ ‘ถอยกลับ’ ชุดข้อมูลที่ได้รับความนิยมใดๆ (เช่น CityScapes หรือ CIFAR) ได้อย่างมีประสิทธิภาพ

ในกรณีของ PubFig ซึ่งเป็นชุดข้อมูลที่ทำให้เกิด ‘ดอกไม้ของโอบามา’ ในตัวอย่างก่อนหน้า มหาวิทยาลัยโคลัมเบียได้กล่าวถึงแนวโน้มที่เพิ่มขึ้นเกี่ยวกับปัญหาลิขสิทธิ์ในการกระจายชุดข้อมูลภาพ โดยแนะนำให้นักวิจัย สร้าง ชุดข้อมูลขึ้นมาใหม่ผ่านลิงก์ที่คัดเลือกมาอย่างดี แทนที่จะทำให้ชุดข้อมูลที่รวบรวมไว้แล้วสามารถเข้าถึงได้โดยตรง โดยสังเกตว่า ‘ดูเหมือนว่านี่จะเป็นวิธีที่ฐานข้อมูลขนาดใหญ่บนเว็บอื่นๆ กำลังพัฒนา’

ในกรณีส่วนใหญ่ สิ่งนี้ไม่จำเป็น: Kaggle ประมาณการ ว่าชุดข้อมูลภาพที่ได้รับความนิยมสูงสุด 10 อันดับแรกในด้านการมองเห็นของคอมพิวเตอร์ ได้แก่ CIFAR-10 และ CIFAR-100 (ทั้งสอง ดาวน์โหลดได้); CALTECH-101 และ 256 (ทั้งสองสามารถเข้าถึงได้ และทั้งสองสามารถดาวน์โหลดได้); MNIST (มีให้ใช้ และยังสามารถดาวน์โหลดได้); ImageNet (ดูข้างบน); Pascal VOC (มีให้ใช้ และยังสามารถดาวน์โหลดได้); MS COCO (มีให้ใช้ และยังสามารถดาวน์โหลดได้); Sports-1M (มีให้ใช้); และ YouTube-8M (มีให้ใช้)

ความพร้อมใช้งานนี้ยังสะท้อนถึงชุดข้อมูลการมองเห็นของคอมพิวเตอร์ที่มีอยู่ในวงกว้างอีกด้วย เนื่องจากความไม่ค่อยมีใครรู้จักเป็นความตายในカルチャーการพัฒนาที่เปิดกว้าง ‘เผยแพร่หรือตาย’

ในกรณีใดๆ ความไม่เพียงพอของ ชุดข้อมูลที่จัดการได้ใหม่ๆ ต้นทุนสูงในการพัฒนาชุดข้อมูลภาพ ความพึ่งพาชุดข้อมูล ‘เก่า’ และความพยายามในการ ปรับชุดข้อมูลเก่าให้เหมาะสม ทั้งหมดนี้ยังทำให้ปัญหาในงานวิจัยใหม่ของอเดลайдรุนแรงขึ้น

คำวิพากษ์วิจารณ์ทั่วไปเกี่ยวกับวิธีการโจมตีรูปภาพที่สร้างขึ้นเป็นอันตราย

คำวิพากษ์วิจารณ์ที่บ่อยที่สุดและยืนยาวที่สุดของวิศวกรการเรียนรู้ของเครื่องต่อประสิทธิผลของเทคนิคการโจมตีรูปภาพที่สร้างขึ้นเป็นอันตรายล่าสุดคือการโจมตี เฉพาะสำหรับชุดข้อมูลหรือแบบจำลองเฉพาะ หรือทั้งสองอย่าง และไม่สามารถ ‘สร้างแบบจำลอง’ ให้กับระบบอื่นๆ ได้ และดังนั้นจึงเป็นภัยคุกคามที่ไม่สำคัญ

คำวิพากษ์วิจารณ์ที่บ่อยที่สุดเป็นอันดับสองคือการโจมตีรูปภาพที่สร้างขึ้นเป็นอันตรายเป็น ‘กล่องขาว’ หมายความว่าคุณจะต้องมีการเข้าถึงโดยตรงไปยังสภาพแวดล้อมการฝึกหรือข้อมูล ซึ่งเป็นสถานการณ์ที่ไม่น่าเป็นไปได้ในส่วนใหญ่ของกรณี ตัวอย่างเช่น หากคุณต้องการใช้ประโยชน์จากกระบวนการฝึกสำหรับระบบการรับรู้ใบหน้าของ ตำรวจนครลอนดอน คุณจะต้องแฮก NEC โดยใช้เครื่องมือหรือ斧

‘DNA’ ยาว期ของชุดข้อมูลการมองเห็นที่ได้รับความนิยม

เกี่ยวกับคำวิพากษ์วิจารณ์แรก เราควรพิจารณาไม่เพียงแต่ว่าชุดข้อมูลการมองเห็นของคอมพิวเตอร์เพียงไม่กี่ชุดเท่านั้นที่ครอบงำอุตสาหกรรมในแต่ละภาคต่อปี (เช่น ImageNet สำหรับวัตถุหลายประเภท CityScapes สำหรับฉากการขับ และ FFHQ สำหรับการรับรู้ใบหน้า) แต่ยังรวมถึงข้อเท็จจริงที่ว่าชุดข้อมูลเหล่านี้เป็นข้อมูลภาพที่มีแอนโนเตชันอย่างง่าย และสามารถโอนย้ายได้สูง

ขึ้นอยู่กับความสามารถใดๆ โครงสร้างพื้นฐานการฝึกการมองเห็นของคอมพิวเตอร์จะพบ บาง ลักษณะของวัตถุและคลาสในชุดข้อมูล ImageNet บางโครงสร้างอาจพบคุณลักษณะมากกว่าหรือสร้างการเชื่อมต่อที่มีประโยชน์มากกว่า แต่ ทั้งหมดนั้น ควรพบคุณลักษณะระดับสูงสุด:

คุณลักษณะระดับสูงสุดเหล่านี้เป็นตัวกำหนดและ ‘ลายนิ้วมือ’ ของชุดข้อมูล และเป็น ‘ก勾’ ที่เชื่อถือได้ในการสร้างวิธีการโจมตีรูปภาพที่สร้างขึ้นเป็นอันตรายที่ยาวนานซึ่งสามารถข้ามระบบต่างๆ และเติบโตพร้อมกับ ‘ชุดข้อมูลเก่า’ เมื่อชุดข้อมูลนั้นถูกส่งต่อในงานวิจัยและผลิตภัณฑ์ใหม่ๆ

โครงสร้างพื้นฐานที่ซับซ้อนมากขึ้นจะสร้างการระบุและคุณลักษณะที่แม่นยำและละเอียดมากขึ้น:

อย่างไรก็ตาม การโจมตีรูปภาพที่สร้างขึ้นเป็นอันตรายจะไม่มีประสิทธิภาพมากนักในการข้ามโครงสร้างพื้นฐานหรือชุดข้อมูลที่แตกต่างกัน – เช่น ชุดย่อยหรือชุดข้อมูลที่กรองแล้ว ซึ่งหลายๆ ภาพจากชุดข้อมูลดั้งเดิมไม่มีอยู่:

การโจมตีรูปภาพที่สร้างขึ้นเป็นอันตรายต่อแบบจำลอง ‘zeroed’ ที่ได้รับการฝึกฝนแล้ว

สิ่งใดเกี่ยวกับกรณีที่คุณเพียงดาวน์โหลดแบบจำลองที่ได้รับการฝึกฝนแล้วซึ่งฝึกฝนจากชุดข้อมูลที่มีชื่อเสียงสูง และให้ข้อมูลใหม่แก่แบบจำลอง?

แบบจำลองได้รับการฝึกฝนจาก (เช่น) ImageNet แล้ว และที่เหลืออยู่คือ น้ำหนัก ซึ่งอาจใช้เวลาหลายสัปดาห์หรือหลายเดือนในการฝึกฝน และพร้อมที่จะช่วยให้คุณระบุวัตถุที่คล้ายกับวัตถุในข้อมูลดั้งเดิม (ที่ไม่มีอยู่แล้ว)

เมื่อข้อมูลดั้งเดิมถูกลบออกจากโครงสร้างพื้นฐานการฝึก นี่คือ ‘ความโน้มเอียง’ ของแบบจำลองในการจำแนกวัตถุในลักษณะที่ได้เรียนรู้มา ซึ่งโดยพื้นฐานแล้วจะทำให้ ‘ลายเซ็น’ เดิมๆ เกิดขึ้นอีกครั้งและตกอยู่ในความเสี่ยงต่อการโจมตีรูปภาพที่สร้างขึ้นเป็นอันตรายแบบเดิมๆ

น้ำหนักเหล่านี้มีค่า แม้ว่าจะปรับให้เข้ากับการฝึกฝนใหม่ แต่ก็จะแสดงพฤติกรรมที่คล้ายกันในข้อมูลใหม่เช่นเดียวกับที่ทำในข้อมูลดั้งเดิม โดยสร้างคุณลักษณะที่ระบบการโจมตีรูปภาพที่สร้างขึ้นเป็นอันตรายสามารถใช้ประโยชน์ได้

ในระยะยาว สิ่งนี้ยังช่วยรักษา ‘DNA’ ของชุดข้อมูลการมองเห็นที่มีอายุ 12 ปีหรือมากกว่านั้น และอาจผ่านการเปลี่ยนแปลงที่สำคัญตั้งแต่ความพยายามที่เปิดกว้างไปจนถึงการนำไปใช้ในเชิงพาณิชย์ – แม้ว่าข้อมูลการฝึกดั้งเดิมจะถูกทิ้งไปที่จุดเริ่มต้นของโครงการก็ตาม บางการนำไปใช้ในเชิงพาณิชย์อาจไม่เกิดขึ้นในอีกหลายปี

ไม่ต้องการกล่องขาว

เกี่ยวกับคำวิพากษ์วิจารณ์ที่สองที่พบบ่อยที่สุดเกี่ยวกับระบบการโจมตีรูปภาพที่สร้างขึ้นเป็นอันตราย ผู้เขียนของงานวิจัยใหม่พบว่าความสามารถในการหลอกระบบการรับรู้ด้วยรูปภาพที่สร้างขึ้นเป็นอันตรายมีความสามารถในการถ่ายโอนข้ามหลายโครงสร้างพื้นฐาน

ในขณะที่สังเกตว่าวิธีการ ‘Universal NaTuralistic adversarial paTches’ (TnT) ของพวกเขาเป็นวิธีแรกที่ใช้รูปภาพที่รู้จัก (แทนที่จะเป็นเสียงรบกวนแบบสุ่ม) เพื่อหลอกระบบการรับรู้ภาพ ผู้เขียนยังระบุด้วยว่า:

‘[TnTs] มีประสิทธิภาพต่อแบบจำลองที่ใช้กันอย่างแพร่หลายตั้งแต่ WideResNet50 ในงานการรับรู้ภาพขนาดใหญ่ของ ImageNet ไปจนถึงแบบจำลอง VGG-face ในงานการรับรู้ใบหน้าของ PubFig ในทั้ง การโจมตีแบบมุ่งเป้า และ การโจมตีแบบไม่มุ่งเป้า‘

‘TnTs สามารถมี: i) ความเป็นธรรมชาติที่สามารถทำได้ [ด้วย] กับกระตุ้นที่ใช้ในวิธีการโจมตีแบบทรอย adversarial examples และ ii) การสร้างแบบจำลองและความสามารถในการถ่ายโอนไปยังเครือข่ายอื่นๆ

‘สิ่งนี้ทำให้เกิดความกังวลเกี่ยวกับความปลอดภัยและความปลอดภัยเกี่ยวกับ DNN ที่ได้รับการติดตั้งแล้วและ DNN ที่จะถูกติดตั้งในอนาคต โดยผู้โจมตีสามารถใช้ปะการังที่ดูเป็นธรรมชาติและไม่ดึงดูดความสนใจเพื่อหลอกลวงระบบการรับรู้ของประสาทเทียมโดยไม่ต้องแทรกแซงแบบจำลองและเสี่ยงต่อการค้นพบ’

ผู้เขียนชี้ให้เห็นว่ามาตรการป้องกันที่เป็นมาตรฐาน เช่น การลดความถูกต้องของ Clean Acc. ของเครือข่าย อาจให้การป้องกันบางอย่างต่อ TnT patches ได้ แต่ ‘TnTs ยังคงสามารถหลบหลีกการป้องกันที่พิสูจน์ได้เหล่านี้ด้วยวิธีการป้องกันที่ได้รับการพิสูจน์แล้ว โดยส่วนใหญ่ระบบที่ป้องกันจะบรรลุ 0% ความแข็งแกร่ง’

วิธีแก้ปัญหาที่เป็นไปได้อื่นๆ รวมถึง การเรียนรู้แบบกระจาย โดยที่ต้นกำเนิดของภาพที่มีส่วนร่วมได้รับการคุ้มครอง และแนวทางใหม่ที่สามารถ ‘เข้ารหัส’ ข้อมูลในขณะฝึกฝนได้ เช่น แนวทางที่ แนะนำ โดยมหาวิทยาลัยการบินและอวกาศนานกิง

แม้ในกรณีเหล่านั้น จะเป็นสิ่งสำคัญที่จะต้องฝึกฝนจาก ใหม่ ข้อมูลภาพจริงๆ – ในขณะนี้ ภาพและแอนโนเตชันที่เกี่ยวข้องในชุดข้อมูล CV ที่ได้รับความนิยมสูงสุดมีแนวโน้มที่จะเหมือนกับซอฟต์แวร์มากกว่าข้อมูล ซึ่งมักจะไม่ได้รับการอัปเดตอย่างมีนัยสำคัญในหลายปี

สรุป

การโจมตีรูปภาพที่สร้างขึ้นเป็นอันตรายได้รับการอำนวยความสะดวกไม่เพียงแต่จากการปฏิบัติงานแบบเปิดกว้างเท่านั้น แต่ยังรวมถึงカルチャ์การพัฒนาอุตสาหกรรม AI ที่มีแรงจูงใจในการใช้ซ้ำชุดข้อมูลการมองเห็นที่ได้รับการยอมรับอย่างดีสำหรับหลายๆ เหตุผล: พวกมันถูกพิสูจน์แล้วว่ามีประสิทธิผล พวกมันถูกกว่าการเริ่มต้นจากศูนย์ และพวกมันถูกบำรุงรักษาและอัปเดตโดยจิตใจและองค์กรแนวหน้าในด้านวิชาการและอุตสาหกรรม โดยระดับการสนับสนุนทุนที่จะยากสำหรับบริษัทเดียวที่จะทำซ้ำ

นอกจากนี้ ในหลายกรณีที่ข้อมูลไม่ใช่ของต้นฉบับ (ไม่เหมือน CityScapes) ภาพถูกเก็บเกี่ยวก่อนที่จะมีการถกเถียงเรื่องความเป็นส่วนตัวและการรวบรวมข้อมูล ซึ่งทำให้ชุดข้อมูลเก่าเหล่านี้อยู่ในสถานะ พื้นที่สีเทา ที่อาจดูเหมือน ‘ท่าเรือที่ปลอดภัย’ จากมุมมองของบริษัท

TnT Attacks! Universal Naturalistic Adversarial Patches Against Deep Neural Network Systems เป็นผลงานร่วมของ Bao Gia Doan, Minhui Xue, Ehsan Abbasnejad, Damith C. Ranasinghe จาก University of Adelaide ร่วมกับ Shiqing Ma จาก Department of Computer Science, Rutgers University.

อัปเดต 1 ธันวาคม 2021, 7:06 น. GMT+2 – แก้ไขข้อผิดพลาด