ปัญญาประดิษฐ์

ภาษาที่สร้างโดย AI เริ่มปนเปื้อนในเอกสารวิทยาศาสตร์

นักวิจัยจากฝรั่งเศสและรัสเซียได้ตีพิมพ์ผลการศึกษาที่บ่งชี้ว่าการใช้เครื่องมือสร้างข้อความแบบสุ่มที่ขับเคลื่อนด้วย AI เช่น GPT-3 ทำให้เกิด ‘ภาษาที่บิดเบี้ยว’ การอ้างอิงเอกสารที่ไม่มีอยู่จริง และการนำภาพมาใช้ใหม่โดยไม่ได้รับเครดิตในช่องทางที่เคารพในการตีพิมพ์เอกสารวิทยาศาสตร์ใหม่ๆ

อาจเป็นเรื่องที่น่ากังวลที่สุดคือว่าเอกสารที่ศึกษานั้นยังประกอบด้วยเนื้อหาทางวิทยาศาสตร์ที่ไม่ถูกต้องหรือไม่สามารถทำซ้ำได้ โดยนำเสนอเป็นผลมาจากการวิจัยเชิงวัตถุและระบบ ซึ่งบ่งชี้ว่าโมเดลภาษาเชิงสร้างสรรค์ถูกใช้ไม่เพียงแต่เพื่อเพิ่มทักษะภาษาอังกฤษที่จำกัดของผู้เขียนเอกสารเท่านั้น แต่ยังถูกใช้ในการทำงานหนัก (และทำได้ไม่ดี) ที่เกี่ยวข้องด้วย

รายงาน รายงาน ที่มีชื่อเรื่องว่า Tortured phrases: A dubious writing style emerging in science ได้รับการรวบรวมโดยนักวิจัยจากภาควิชาวิทยาการคอมพิวเตอร์ มหาวิทยาลัย تولูซ และ Alexander Magazinov นักวิจัยจาก Yandex ซึ่งปัจจุบันอยู่ที่มหาวิทยาลัยเทลอาวีฟ

การศึกษานี้มุ่งเน้นไปที่การเติบโตของเอกสารวิทยาศาสตร์ที่ไม่มี意义ซึ่งสร้างโดย AI ในวารสาร Microprocessors and Microsystems ของ Elsevier

By Any Other Name

โมเดลภาษาที่ใช้การเรียนรู้แบบอัตโนมัติ เช่น GPT-3 ได้รับการฝึกฝนจากปริมาณข้อมูลสูง และได้รับการออกแบบมาเพื่อสรุป ย่อหน้า รวมและตีความข้อมูลที่มีส่วนร่วมเพื่อสร้างโมเดลภาษาที่สามารถสร้างภาษาและรูปแบบการเขียนที่เป็นธรรมชาติได้ ในขณะเดียวกันก็ยังคงเจตนาเดิมของข้อมูลที่ใช้ในการฝึกฝน

เนื่องจากเฟรมเวิร์กเหล่านี้มักถูกลงโทษที่ขั้นตอนการฝึกฝนสำหรับการให้ข้อมูลที่ไม่ได้ถูกดูดซับหรือไม่ได้รับการยอมรับ จึงพยายามหาคำศัพท์ที่เป็นไปได้ – แม้กระทั่งสำหรับวลีที่เป็นที่ยอมรับแล้ว

การนำเสนอทางวิทยาศาสตร์ที่ดูเหมือนจะถูกสร้างหรือช่วยเหลือโดย AI ที่นักวิจัยพบ ได้แก่ จำนวนการพยายามที่ล้มเหลวในการหาคำศัพท์ที่สร้างสรรค์สำหรับวลีที่ทราบในภาคการเรียนรู้ของเครื่องจักร:

deep neural network: ‘โครงข่ายประสาทเทียมลึก’

artificial neural network: ‘โครงข่ายประสาทเทียม (ปลอม | ปลอมแปลง)’

mobile network: ‘โครงข่ายเคลื่อนที่’

network attack: ‘การโจมตีโครงข่าย (การซุ่มโจมตี | การโจมตี)’

network connection: ‘การเชื่อมต่อโครงข่าย’

big data: ‘ข้อมูลขนาดใหญ่ (ใหญ่ | ใหญ่มาก | ใหญ่มาก | ใหญ่มาก)’

data warehouse: ‘คลังข้อมูล (คลัง | ศูนย์กระจายสินค้า)’

artificial intelligence (AI): ‘ปัญญาประดิษฐ์ (ปลอม | สร้างโดยมนุษย์)’

high performance computing: ‘การคำนวณประสิทธิภาพสูง’

fog/mist/cloud computing: ‘การคำนวณเมฆ’

graphics processing unit (GPU): ‘หน่วยประมวลผลกราฟฟิก’

central processing unit (CPU): ‘หน่วยประมวลผลกลาง’

workflow engine: ‘เครื่องยนต์กระบวนการทำงาน’

face recognition: ‘การรู้จำใบหน้า’

voice recognition: ‘การรู้จำเสียง’

mean square error: ‘ค่าเฉลี่ยของส่วนต่างกำลังสอง’

mean absolute error: ‘ค่าเฉลี่ยของส่วนต่างสัมบูรณ์’

signal to noise: ‘(สัญญาณ | สัญญาณเตือน | สัญญาณเตือน | สัญญาณเตือน) ต่อสัญญาณรบกวน’

global parameters: ‘พารามิเตอร์ระดับโลก’

random access: ‘การเข้าถึงแบบสุ่ม’

random forest: ‘ป่าแบบสุ่ม’

random value: ‘ค่าแบบสุ่ม’

ant colony: ‘อาณานิคมมด’

ant colony: ‘อาณานิคมมด (รัฐ | จังหวัด | เขต | ภูมิภาค | การตั้งถิ่นฐาน)’

remaining energy: ‘พลังงานที่เหลือ’

kinetic energy: ‘พลังงานจลน์’

naïve Bayes: ‘(เชื่อถือ | ไร้เดียงสา | เชื่อถือ) Bayes’

personal digital assistant (PDA): ‘ผู้ช่วยดิจิทัลส่วนบุคคล’

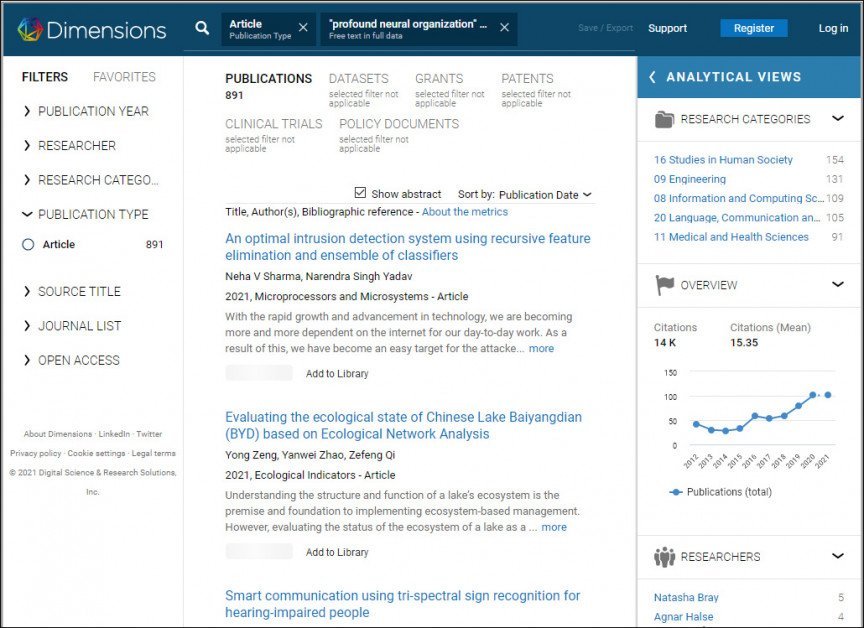

ในเดือนพฤษภาคม 2021 นักวิจัยได้ทำการค้นหาเครื่องมือค้นหาทางวิชาการ Dimensions เพื่อค้นหาภาษาที่บิดเบี้ยวและอัตโนมัติ โดยเลือกที่จะไม่รวมวลีที่ถูกต้อง เช่น ‘ข้อมูลขนาดใหญ่’ (ซึ่งเป็นวลีที่ถูกต้อง และไม่ใช่การพยายามหาคำศัพท์ที่สร้างสรรค์สำหรับ ‘big data’) ในขณะนั้น พวกเขาพบว่า Microprocessors and Microsystems มีจำนวนการเกิดขึ้นของการแปลที่ไม่ถูกต้องสูงสุด

ปัจจุบันยังคงสามารถค้นหา (archive snapshot, 15/07/2021) เอกสารวิทยาศาสตร์จำนวนหนึ่งสำหรับวลีที่ไม่มี意义 เช่น ‘โครงข่ายประสาทเทียมลึก’ (เช่น ‘deep neural network’) และอื่นๆ ในรายการด้านบนให้ผลลัพธ์ที่คล้ายกัน

ผลการค้นหา ‘โครงข่ายประสาทเทียมลึก’ (‘deep neural network’) ที่ Dimensions Source: https://app.dimensions.ai/

วารสาร Microprocessors ก่อตั้งขึ้นในปี 1976 และเปลี่ยนชื่อเป็น Microprocessors and Microsystems สองปีต่อมา

A Growth of Nonsense Language

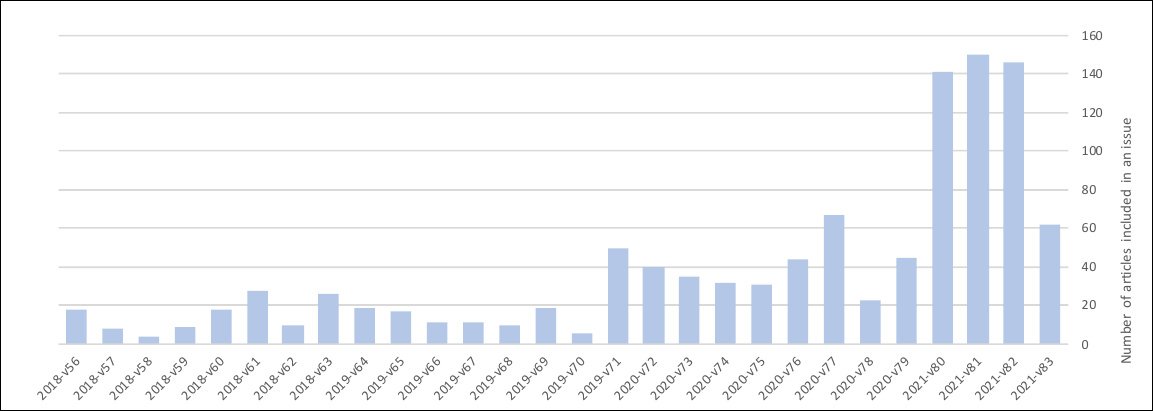

นักวิจัยศึกษาช่วงเวลาครอบคลุมเดือนกุมภาพันธ์ 2018 ถึงเดือนมิถุนายน 2021 และพบว่ามีการเพิ่มขึ้นของการยื่นเอกสารในช่วงสองปีที่ผ่านมา และโดยเฉพาะในช่วง 6-8 เดือนที่ผ่านมา:

สหสัมพันธ์หรือสาเหตุ? การเพิ่มขึ้นของการยื่นเอกสารในวารสาร Microprocessors and Microsystems ดูเหมือนจะเกิดขึ้นพร้อมกับการเติบโตของ ‘ภาษาที่ไม่มี意义’ และการแปลที่ไม่ถูกต้องในเอกสารที่ดูเหมือนจะถูกต้อง Source: https://arxiv.org/pdf/2107.06751.pdf

ชุดข้อมูลสุดท้ายที่รวบรวมโดยผู้ร่วมให้ข้อมูลประกอบด้วยเอกสารเต็มจำนวน 1,078 รายการซึ่งได้รับจากสมาชิกภาพ Elsevier ของมหาวิทยาลัย تولูซ

Diminishing Editorial Oversight for Chinese Scientific Papers

เอกสารระบุว่าช่วงเวลาที่ให้สำหรับการประเมินโดยผู้เขียนของการยื่นเอกสารที่มีปัญหาได้รับการย่อให้เล็กลงอย่างมากในเดือนพฤษภาคม 2021 โดยลดลงเหลือต่ำกว่า 40 วัน ซึ่งเป็นการลดลงหกเท่าของเวลาที่ใช้ในการทบทวนโดยผู้ทรงคุณวุฒิ ซึ่งเห็นได้ชัดตั้งแต่เดือนกุมภาพันธ์ 2021

จำนวนเอกสารที่มีปัญหามากที่สุดมาจากผู้เขียนที่มีสังกัดในจีนแผ่นดินใหญ่: จากเอกสาร 404 รายการที่ได้รับการยอมรับภายใน 30 วัน 97.5% มีสังกัดจีน ในทางกลับกัน ในกรณีที่กระบวนการบรรณาธิการใช้เวลาเกิน 40 วัน (615 เอกสาร) เอกสารที่มีสังกัดจีนคิดเป็นเพียง 9.5% ของหมวดหมู่นั้น – ความไม่สมดุลสิบเท่า

รายงานนี้ให้เหตุผลว่าการรั่วไหลของเอกสารที่มีปัญหาเกิดจากข้อบกพร่องในกระบวนการบรรณาธิการ และอาจเป็นเพราะขาดทรัพยากรในการเผชิญกับการยื่นเอกสารที่เพิ่มขึ้น

นักวิจัยสันนิษฐานว่าโมเดลภาษาเชิงสร้างสรรค์แบบ GPT และเฟรมเวิร์กการสร้างภาษาอื่นๆ ได้รับการใช้เพื่อสร้างข้อความในเอกสารที่มีปัญหา แต่การสรุปแหล่งที่มาของโมเดลการสร้างภาษาทำให้ยากต่อการพิสูจน์ และหลักฐานหลักอยู่ที่การประเมินความเป็นไปได้ของการแปลที่ไม่จำเป็นและไม่ถูกต้อง และการตรวจสอบความสอดคล้องเชิงตรรกะของการยื่นเอกสารอย่างรอบคอบ

นักวิจัยยังพบว่าโมเดลภาษาเชิงสร้างสรรค์ที่พวกเขาคิดว่าเป็นสาเหตุของการหลั่งไหลของเอกสารที่ไม่มีประโยชน์สามารถไม่เพียงแต่สร้างข้อความที่มีปัญหา แต่ยังสามารถรับรู้และระบุพวกมันอย่างเป็นระบบในลักษณะเดียวกับที่นักวิจัยทำด้วยตนเอง การศึกษานี้ให้รายละเอียดเกี่ยวกับการนำไปใช้โดยใช้ GPT-2 และเสนอเฟรมเวิร์กสำหรับระบบในอนาคตในการระบุเอกสารวิทยาศาสตร์ที่มีปัญหา

การเกิดขึ้นของการยื่นเอกสารที่ ‘ปนเปื้อน’ มีจำนวนมากในวารสาร Elsevier (72.1%) เมื่อเทียบกับวารสารอื่นๆ ที่ศึกษา (13.6% สูงสุด)

Not Just Semantics

นักวิจัยเน้นย้ำว่าหลายวารสารที่มีปัญหาไม่ได้ใช้ภาษาที่ไม่ถูกต้องเท่านั้น แต่ยังมีคำสั่งทางวิทยาศาสตร์ที่ไม่ถูกต้อง ซึ่งบ่งชี้ว่าโมเดลภาษาเชิงสร้างสรรค์ไม่ได้ถูกใช้เพียงเพื่อปรับปรุงทักษะภาษาที่จำกัดของผู้เขียน แต่อาจถูกใช้ในการสร้างทฤษฎีและข้อมูลหลักในเอกสารด้วย

ในกรณีอื่นๆ นักวิจัยเสนอว่ามีการ ‘สังเคราะห์ใหม่’ หรือ ‘การหมุน’ ของงานก่อนหน้าที่ดีกว่าเพื่อตอบสนองความกดดันในการตีพิมพ์ผลงานวิจัยอย่างต่อเนื่อง และอาจเพื่อปรับปรุงอันดับชาติในการวิจัย AI ผ่านปริมาณที่สูง

เนื้อหาที่ไม่มี意义ในเอกสารที่ยื่น ในกรณีนี้ นักวิจัยพบว่าข้อความได้รับการดัดแปลงจากบทความ EDN โดยที่ภาพประกอบยังถูกนำมาใช้โดยไม่ได้รับเครดิต การเขียนข้อความใหม่ในครั้งนี้ทำให้ข้อความไม่มีความหมาย

การวิเคราะห์เอกสารที่ยื่นหลายฉบับ นักวิจัยพบว่ามีประโยคที่ไม่สามารถอนุมานความหมายได้ การอ้างอิงเอกสารที่ไม่มีอยู่จริง การอ้างอิงตัวแปรและทฤษฎีในสมการที่ไม่ได้ปรากฏในเอกสารสนับสนุน (บ่งชี้ว่ามีการสร้างข้อความโดยอาศัยภาษาหรือ ‘การหลอกลวง’ ของข้อมูลที่ดูเหมือนจริง) และการนำภาพมาใช้ใหม่โดยไม่ได้รับเครดิต (ซึ่งนักวิจัยวิพากษ์วิจารณ์ไม่ใช่จากมุมมองของลิขสิทธิ์ แต่เป็นตัวบ่งชี้ถึงการขาดความเข้มงวดทางวิทยาศาสตร์)

Citation Failures

การอ้างอิงที่ตั้งใจจะสนับสนุนข้อโต้แย้งในเอกสารวิทยาศาสตร์พบว่าในหลายกรณีที่มีปัญหา ‘ไม่ถูกต้องหรือไม่เกี่ยวข้องกับการตีพิมพ์’

นอกจากนี้ การอ้างอิงถึง ‘งานที่เกี่ยวข้อง’ มักจะรวมถึงผู้เขียนที่นักวิจัยเชื่อว่าถูก ‘สร้างขึ้น’ โดยระบบ GPT-แบบ

Wandering Attention

ข้อบกพร่องอีกประการหนึ่งของโมเดลภาษาที่มีประสิทธิภาพสูง เช่น GPT-3 คือความสามารถในการสูญเสียความสนใจในระหว่างการอภิปรายที่ยาวนาน นักวิจัยพบว่าเอกสารที่มีปัญหาหลายฉบับมีการนำเสนอหัวข้อที่ไม่เคยกลับมาพูดถึงอีกหลังจากที่กล่าวถึงในตอนต้นหรือในบันทึกย่อ

พวกเขายังเสนอว่ากรณีที่เลวร้ายที่สุดเกิดขึ้นจากการเดินทางของข้อความต้นฉบับผ่านเครื่องมือแปลหลายครั้ง โดยแต่ละครั้งบิดเบือนความหมายมากขึ้น

Sources and Reasons

ในการพยายามเข้าใจสาเหตุของปรากฏการณ์นี้ ผู้เขียนรายงานเสนอตัวเลือกหลายประการ: ว่าเนื้อหาจากร้านพิมพ์เอกสารอาจถูกนำมาใช้เป็นวัสดุแหล่งที่มา ซึ่งนำไปสู่ความไม่ถูกต้องตั้งแต่เนิ่นๆ ในกระบวนการที่จะนำไปสู่ความไม่ถูกต้องเพิ่มเติม; ว่าเครื่องมือการหมุนบทความ เช่น Spinbot ถูกใช้เพื่อปกปิดการลอกเลียนแบบ; และว่าแรงกดดันที่จะเผยแพร่ผลงานวิจัยอย่างต่อเนื่องทำให้นักวิจัยที่มีทรัพยากรไม่เพียงพอใช้ระบบ GPT-3 เพื่อเพิ่มหรือสร้างเอกสารวิจัยใหม่ๆ

นักวิจัยสรุปด้วยการเรียกร้องให้มีการกำกับดูแลและมาตรฐานที่ดีขึ้นในพื้นที่การตีพิมพ์ทางวิชาการที่ดูเหมือนจะกลายเป็นอาหารสำหรับเนื้อหาของตัวเอง – ระบบการเรียนรู้ของเครื่องจักร พวกเขายังขอร้องให้ Elsevier และผู้จัดพิมพ์อื่นๆ นำกระบวนการตรวจสอบและทบทวนที่เข้มงวดมากขึ้น และวิพากษ์วิจารณ์มาตรฐานและแนวปฏิบัติปัจจุบันในเรื่องนี้ โดยเสนอว่า ‘การหลอกลวงด้วยข้อความสังเคราะห์เป็นภัยคุกคามต่อความซื่อสัตย์ของเอกสารวิทยาศาสตร์’