サイバーセキュリティ

アドバーサリアル画像攻撃は冗談ではありません

画像認識システムに対するアドバーサリアル画像攻撃は、過去5年間で面白いが実用的ではないと考えられてきました。しかし、オーストラリアの新しい研究によると、商用AIプロジェクトで非常に人気のある画像データセットを使用することは、耐久性のある新しいセキュリティ問題を生み出す可能性があります。

2年間、アデレード大学の学者グループは、AIベースの画像認識システムの将来について非常に重要なことを説明しようとしてきました。

それは現在(そして将来5~10年以内に画像認識研究が商業化・工業化されたときに)非常に困難(そして非常に高価)なものです。

詳しく説明する前に、アデレード大学のチームが公開した6つのビデオの1つから、バラがバラク・オバマ大統領として分類される様子をご覧ください:

Source: https://www.youtube.com/watch?v=Klepca1Ny3c

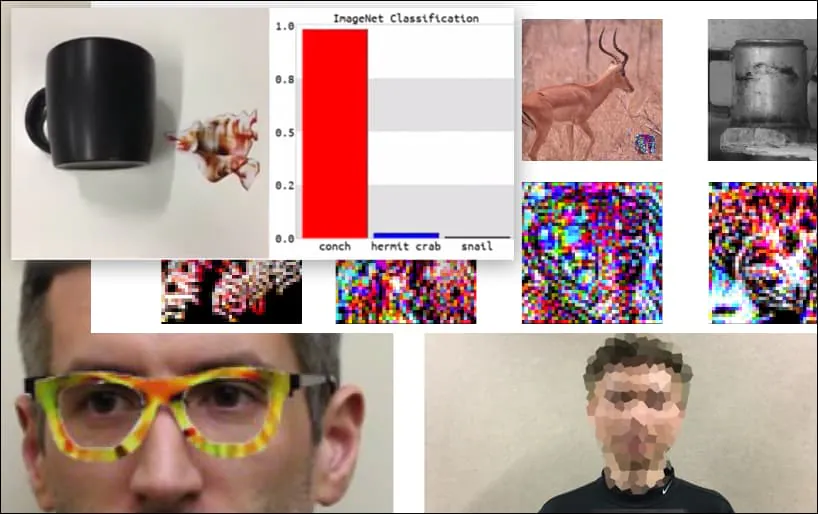

上記の画像では、バラク・オバマを認識することができる顔認識システムは、匿名化された男性が印刷されたアドバーサリアル画像の花を持っていることを80%の確率でバラク・オバマであると判断します。システムは、偽の顔が男性の胸にあることではなく、肩にあることに気付かないようです。

研究者がランダムなノイズではなく、整合的な画像(バラ)を生成してアイデンティティをキャプチャすることに成功したことは印象的ですが、このような愚かなエクスプロイトは、コンピュータビジョンのセキュリティ研究で頻繁に発生するようです。例えば、2016年に顔認識を欺くことができた奇妙なパターンの眼鏡、または道路標識の意味を変更しようとする特別に設計されたアドバーサリアル画像などです。

興味がある場合は、上記の例で攻撃されているConvolutional Neural Network(CNN)モデルはVGGFace(VGG-16)であり、コロンビア大学のPubFigデータセットでトレーニングされています。他の攻撃サンプルは、さまざまなリソースをさまざまな組み合わせで使用しています。

WideResNet50モデルでキーボードがコンチとして分類される。研究者は、モデルがコンチに偏りがないことを確認しています。https://www.youtube.com/watch?v=dhTTjjrxIcUでフルビデオをご覧ください。

画像認識としての新しい攻撃ベクトル

研究者が概説し、示した多くの印象的な攻撃は、特定のデータセットや特定のマシンラーニングアーキテクチャに対する批判ではありません。これらは、データセットやモデルを切り替えることで、モデルを再トレーニングすることで、またはその他の「簡単」な解決策で容易に防御できるものではありません。

それどころか、アデレードのチームのエクスプロイトは、画像認識AI開発の全体的な現在のアーキテクチャの中央的な弱点を示しています。この弱点は、将来的に多くの画像認識システムを攻撃者による容易な操作や、後の防御措置の後ろ足に置く可能性があります。

将来のセキュリティシステムに最新のアドバーサリアル攻撃画像(上記の花の画像など)を「ゼロデイ・エクスプロイト」として追加することを想像してください。現在のアンチマルウェアやアンチウイルスフレームワークが毎日ウイルス定義を更新するのと同様にです。

新しいアドバーサリアル画像攻撃の可能性は尽きません。なぜなら、システムの基礎アーキテクチャは、ダウンストリームの問題を予測していなかったからです。インターネットやミレニアム・バグ、ピサの斜塔などと同様にです。

では、どのようにしてこのような状況を準備していますか?

攻撃のためのデータの取得

上記の「花」の例のように、アドバーサリアル画像は、コンピュータモデルをトレーニングした画像データセットにアクセスすることで生成されます。トレーニングデータ(またはモデルアーキテクチャ)に「特権」アクセスする必要はありません。最も人気のあるデータセット(および多くのトレーニング済みモデル)は、強力で常に更新されるトレントシーンで広く利用可能です。

例えば、コンピュータビジョンのデータセットの巨人であるImageNetは、トレントで利用可能です。通常の制限を回避し、重要な二次要素であるバリデーションセットを利用できます。

Source: https://academictorrents.com

データがあれば、人気のデータセット(例:CityScapesやCIFAR)を「逆工学」できます。

PubFigデータセットの場合、コロンビア大学は、画像データセットの再配布に関する著作権問題の増加に対処するために、研究者にデータセットを再現する方法を指示しています。「これは、他の多くの大規模なWebベースのデータベースが進化しているように見えます。」

ほとんどの場合、これは必要ありません。Kaggleは、コンピュータビジョンで最も人気のある10の画像データセットを推定しています。CIFAR-10とCIFAR-100(両方とも直接ダウンロード可能);CALTECH-101と256(両方とも利用可能で、現在トレントで利用可能);MNIST(公式に利用可能、トレントでも利用可能);ImageNet(上記参照);Pascal VOC(利用可能、トレントでも利用可能);MS COCO(利用可能、トレントでも利用可能);Sports-1M(利用可能);およびYouTube-8M(利用可能)。

この利用可能性は、コンピュータビジョンの画像データセットのより広い範囲を代表しています。なぜなら、オープンソース開発文化では、不明瞭性は死を意味するからです。

アドバーサリアル画像攻撃方法に対する典型的な批判

マシンラーニングエンジニアがアドバーサリアル画像攻撃技術の有効性に対して最も頻繁に、そして最も根強く批判するのは、その攻撃が特定のデータセット、特定のモデル、またはその両方に特有であるということです。つまり、それは他のシステムに「汎用化」できないということです。したがって、それはただのごく普通の脅威を表しています。

2番目に頻繁な批判は、アドバーサリアル画像攻撃が「ホワイトボックス」であるということです。つまり、トレーニング環境またはデータに直接アクセスする必要があるということです。これは、ほとんどの場合、非常にありそうにないシナリオです。例えば、ロンドンのメトロポリタン警察の顔認識システムを利用する場合、NECにハッキングする必要があります。

人気のコンピュータビジョンデータセットの長期的な「DNA」

最初の批判については、画像認識業界を支配するコンピュータビジョンデータセットが年間でごくわずかであること、またこれらのデータセットがプラットフォームに依存しないこと、そして移植可能であることを考慮する必要があります(例:ImageNetはオブジェクト認識、CityScapesは運転シーン、FFHQは顔認識)。

また、コンピュータビジョントレーニングアーキテクチャは、ImageNetデータセットのオブジェクトやクラスのいくつかの特徴を見つけるでしょう。いくつかのアーキテクチャは他のアーキテクチャよりも多くの特徴を見つけるかもしれませんが、すべてのアーキテクチャは少なくとも最上位レベルの特徴を見つけるでしょう。

これらの「最上位レベルの」特徴がデータセットを区別し、「指紋」付けし、長期的なアドバーサリアル画像攻撃方法論を構築するための信頼できる「フック」を提供します。この方法論は、さまざまなシステムを跨ぎ、古いデータセットとともに成長する可能性があります。

より洗練されたアーキテクチャは、より正確で詳細な識別、特徴、クラスを生成します。

しかし、アドバーサリアル攻撃ジェネレーターがこれらの「下位」特徴(例:「若いカウカーゼス男性」ではなく「顔」)に依存するほど、効果は低くなります。特に、オリジナルのデータセットのバージョンが異なるアーキテクチャ(例:サブセットまたはフィルタリングされたセット)では、オリジナルのデータセットの多くの画像が存在しません。

「ゼロ化」された、事前にトレーニングされたモデルのアドバーサリアル攻撃

事前にトレーニングされたモデルをダウンロードし、完全に新しいデータを与える場合にはどうなるでしょうか?

モデルはすでに(例えば)ImageNetでトレーニングされており、残っているのは重みです。これらは、週や月を要してトレーニングされたもので、現在は新しいデータでオブジェクトを識別するのに役立ちます。

トレーニングアーキテクチャから元のデータを削除すると、モデルの「先入観」が残ります。モデルの「先入観」は、元のデータセットで学習した方法でオブジェクトを分類する方法で動作します。これにより、多くの元の「シグネチャ」が再形成され、再び同じ古いアドバーサリアル画像攻撃方法に対して脆弱になります。

これらの重みは貴重です。データまたは重みのいずれかがなければ、基本的に空のアーキテクチャで、データはありません。トレーニングからやり直す必要があります。そうすれば、時間と計算リソースが大量に必要になります。オリジナルの著者が行ったように、多くの場合、より強力なハードウェアとより高い予算で行う必要があります。

問題は、重みがすでにかなり形成され、頑健であるということです。トレーニング中に多少適応するでしょうが、新しいデータに対しては、オリジナルのデータに対してと同様の方法で動作するでしょう。アドバーサリアル攻撃システムが再び「フック」することができる、特徴的な特徴を生成するでしょう。

長期的には、これも、世界中の開発サイクルに埋め込まれている12年以上前のコンピュータビジョンデータセットの「DNA」を保存します。オープンソースの取り組みから商業化された展開まで、注目すべき進化を経て、最初のトレーニングデータは完全に放棄されたかもしれません。商業化されたいくつかの展開はまだ発生していません。

ホワイトボックスは不要

アドバーサリアル画像攻撃システムに対する2番目に一般的な批判については、新しい論文の著者は、花の画像で識別システムを欺く能力が、多くのアーキテクチャに転送可能であることを発見しました。

彼らが「Universal NaTuralistic adversarial paTches」(TnT)方法は、画像認識システムを欺くために認識可能な画像(ランダムなノイズではなく)を使用する最初のものであることを観察しながらも、著者は次のように述べています。

‘[TnTs]は、WideResNet50を含む多くの最先端のクラシファイアに対して有効であり、ImageNetデータセットのLarge-Scale Visual RecognitionタスクとPubFigデータセットの顔認識タスクの両方で、ターゲットおよび非ターゲット攻撃の両方で有効です。

‘TnTsは、トロイの木馬攻撃方法で使用されるトリガーと同等の自然さを実現でき、およびアドバーサリアルな例の汎用性と他のネットワークへの転送可能性を持ちます。

‘これは、すでに展開されているDNNと、将来のDNN展開について、安全性とセキュリティに関する懸念を引き起こします。攻撃者は、神経ネットワークシステムを欺くために、目立たない自然なオブジェクトパッチを使用できます。モデルを改変したり、発見されるリスクを冒したりする必要はありません。 ‘

著者は、従来の対策であるネットワークのクリーン精度の低下は、TnTパッチに対する一部の防御を提供する可能性があると示唆していますが、‘TnTsは、多くの防御システムが0%のロバストネスを達成するSOTA provable防御方法を回避できます。 ‘

可能な他の解決策としては、フェデレーテッドラーニングが挙げられます。ここでは、画像の出所が保護されます。また、南京航空航天大学によって最近提案されたように、トレーニング時にデータを「暗号化」する新しいアプローチもあります。

これらの場合でも、真正に「新しい」画像データでトレーニングすることが重要です。現在、コンピュータビジョンの最も人気のあるデータセットの画像と注釈は、開発サイクルに埋め込まれており、数年間更新されていません。ソフトウェアのように動作し、数年前に大幅に更新されていません。

結論

アドバーサリアル画像攻撃は、オープンソースのマシンラーニングの慣行によってのみ可能になるのではなく、企業のAI開発文化によっても可能になることがあります。この文化は、既に確立されたコンピュータビジョンデータセットを商用AIプロジェクトで再利用することを促しています。なぜなら、これらのデータセットはすでに効果的であることが証明されており、ゼロから始めるよりもはるかに安価であり、学術界と業界の第一人者によって維持および更新されているからです。

さらに、多くの場合、データがオリジナルの場合(CityScapesとは異なり)、画像は最近のプライバシーとデータ収集慣行に関する論争の前に収集されたため、これらの古いデータセットは、会社の観点から見ると「安全な港」と見なされる可能性のある半ば合法的な地獄にあります。

TnT Attacks! Universal Naturalistic Adversarial Patches Against Deep Neural Network Systemsは、アデレード大学のBao Gia Doan、Minhui Xue、Ehsan Abbasnejad、Damith C. Ranasinghe、そしてラトガース大学のコンピューターサイエンス学部のShiqing Maによって共同執筆されています。

2021年12月1日7:06 GMT+2に更新 – タイポを修正しました。