Andersons Blickwinkel

Forschung legt nahe, dass ChatGPT eine hohe Glaubwürdigkeit als Nachrichtenanbieter hat

Neue Forschung legt nahe, dass ChatGPTs Fakten-Überprüfungs-Labels Likes, Shares und sogar vertrauenswürdige Nachrichtenmarken übertrumpfen, wenn es darum geht, zu formen, was Menschen glauben und online teilen möchten.

Eine neue Studie mit 1.000 Teilnehmern hat ergeben, dass ChatGPT, wenn es eine Glaubwürdigkeitsbewertung für politische Nachrichten abgibt, oft das ändert, was Menschen glauben, und ob sie sie teilen möchten – unabhängig von ihren anfänglichen politischen Ansichten. Traditionelle Einflussfaktoren wie Likes oder Shares hatten wenig Auswirkung, aber das Urteil der KI formte stark, wie vertrauenswürdig die Nachrichten erschienen:

![Aus dem neuen Papier, eine Illustration, wie Menschen eine Nachrichtenüberschrift bewerten, basierend auf drei interagierenden Hinweisen: ob die Geschichte mit ihrer politischen Identität übereinstimmt; wie viel Engagement sie auf sozialen Medien hat; und die Glaubwürdigkeitssignale, die von Institutionen oder KI-Systemen bereitgestellt werden. Diese Einflüsse kombinieren sich, um sowohl die wahrgenommene Genauigkeit als auch die Wahrscheinlichkeit zu formen, den Inhalt zu teilen. [ Quelle ] https://arxiv.org/pdf/2511.02370](https://www.unite.ai/wp-content/uploads/2025/11/figure-1.jpg)

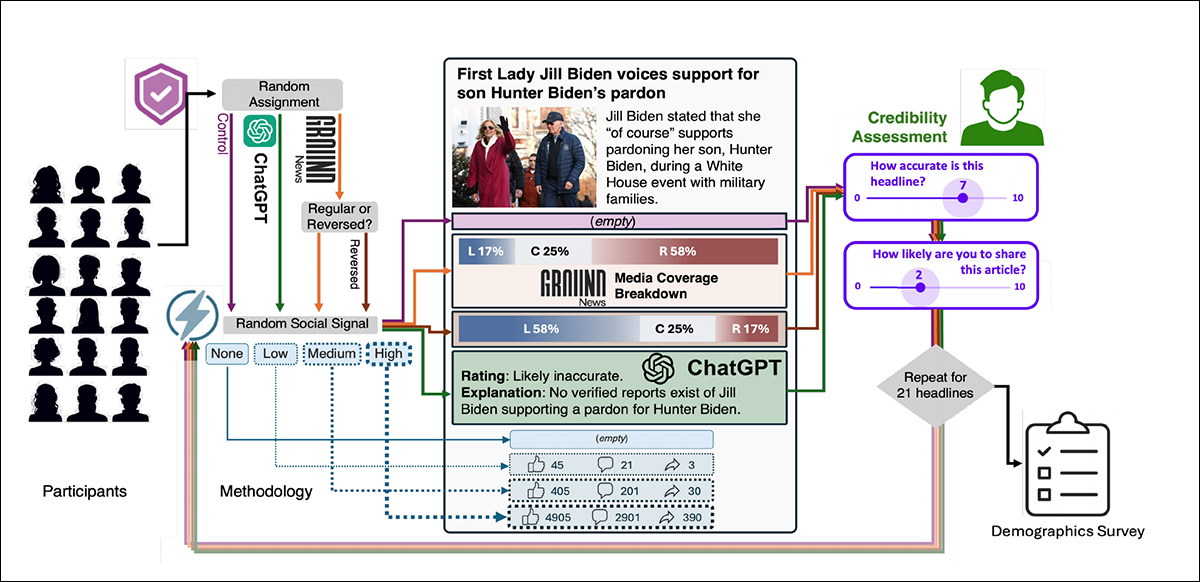

Aus dem neuen Papier, eine Illustration, wie Menschen eine Nachrichtenüberschrift bewerten, basierend auf drei interagierenden Hinweisen: ob die Geschichte mit ihrer politischen Identität übereinstimmt; wie viel Engagement sie auf sozialen Medien hat; und die Glaubwürdigkeitssignale, die von Institutionen oder KI-Systemen bereitgestellt werden. Diese Einflüsse kombinieren sich, um sowohl die wahrgenommene Genauigkeit als auch die Wahrscheinlichkeit zu formen, den Inhalt zu teilen. Quelle

Das Ausmaß, in dem KI-Zusammenfassungen als glaubwürdige Nachrichtenquellen angesehen werden, ist vielleicht eines der wichtigsten Themen in den Medien für viele Jahre, nicht zuletzt, weil Googles KI-Zusammenfassungen den Verkehr von den meisten großen Online-Medien im Jahr 2025 abgezogen haben, mit keiner Gewissheit, wohin dieser Machtwechsel langfristig oder sogar mittelfristig führen könnte.

Die Autoren der neuen Arbeit stellen fest:

‘Diese Ergebnisse unterstreichen sowohl das Potenzial als auch das Risiko algorithmischer Rückkopplung bei der Gestaltung des öffentlichen Verständnisses. KI-generierte Hinweise können helfen, Vorurteile zu mindern und die Glaubwürdigkeitsdiskriminierung zu verbessern, aber ihre Auswirkungen variieren je nach politischer Identität und bergen ethische Risiken im Zusammenhang mit Überabhängigkeit […]

‘…Der übermäßige Einfluss von ChatGPT unterstreicht einen kritischen Kompromiss: während persuasiv, kann KI-Rückkopplung kritisches Denken verdrängen, wenn sie nicht sorgfältig formuliert wird.’

Die Autoren schlagen vor, dass zukünftige Forschung sich auf verbesserte KI-Glaubwürdigkeitsinterventionen konzentrieren sollte, die unabhängiger und unterstützender bekannter Fakten sind, und sie bemerken, dass dies besonders wichtig ist in Themen, die polarisierend sind.

Neben dem offensichtlichen Aufstieg von ChatGPT als “Autorität” und dem unerwartet geringen Einfluss von Sharing-Signalen in den Tests (den die Autoren möglicherweise auf die slightly sterile Testbedingungen zurückführen), gibt es ein weiteres interessantes Ergebnis aus den Tests der Forscher im Zusammenhang mit Demografie und Geschlecht:

‘Frauen und rassisch minorisierte Teilnehmer (insbesondere schwarze und latine Benutzer) reagierten positiver auf KI-basiertes Feedback als auf institutionelle Labels.’

Die neue Arbeit trägt den Titel KI-Glaubwürdigkeitssignale übertrumpfen Institutionen und Engagement bei der Gestaltung der Nachrichtenwahrnehmung in sozialen Medien und stammt von drei Forschern der University of Notre Dame.

Lassen Sie uns einen genaueren Blick auf die Methoden und Schlussfolgerungen der Studie werfen.

Methode

Vier Hypothesen wurden getestet: dass Menschen Überschriften als genauer bewerten, wenn diese ihre politischen Ansichten widerspiegeln; dass KI-generierte Glaubwürdigkeitsbewertungen einflussreicher sind als Signale von etablierten Institutionen; dass Überschriften mit hohem Engagement (d. h. gemessen an Likes, Shares oder Kommentaren) als vertrauenswürdiger angesehen werden; und dass Benutzer tendenziell das Urteil der KI über die Genauigkeit einer Überschrift akzeptieren, auch wenn es im Widerspruch zu ihren eigenen Überzeugungen steht.

Die Teilnehmer der Studie wurden von der Prolific-Plattform rekrutiert und mussten fließend Englisch sprechen sowie regelmäßige Nachrichtenkonsumanten sein; und ein Zufallsverfahren sicherte, dass die Teilnehmer eine Vielfalt an rassischen und geschlechtsspezifischen Perspektiven vertraten.

Im Experiment* wurden die Teilnehmer in vier Gruppen aufgeteilt, von denen jede eine andere Art von Feedback neben den Nachrichtenüberschriften zu sehen bekam.

In der ersten Gruppe (der Kontroll-Bedingung) wurde keine zusätzliche Information über die Glaubwürdigkeit der Überschrift gegeben; in der zweiten Gruppe wurden Überschriften mit einer Voreingenommenheitsbewertung von GroundNews versehen, einem Dienst, der Nachrichtenquellen als links-, mittig- oder rechtsorientiert klassifiziert.

Eine dritte Gruppe sah dieselben GroundNews-Labels, aber absichtlich umgedreht, um zu testen, ob Benutzer die Verzerrung erkennen würden.

Die endgültige Gruppe wurde mit Glaubwürdigkeitsbewertungen von ChatGPT versehen, die eine kurze Erklärung und eine Bewertung wie ‘wahrscheinlich ungenau’ anboten:

Konzeptuelles Schema für das Experiment: jedem Teilnehmer wurden politische Überschriften mit verschiedenen Kombinationen von Glaubwürdigkeitslabels und sozialen Engagement-Signalen gezeigt. Antworten wurden gesammelt, wie genau jede Überschrift erschien und wie wahrscheinlich es war, dass sie geteilt wurde, wobei die gesamte Sequenz über 21 Elemente wiederholt wurde.

Daten und Tests

Jeder Teilnehmer wurde einer Sequenz von 21 politischen Nachrichtenüberschriften gezeigt. Für jede Überschrift wurde das Maß an sozialem Engagement variiert; manchmal zeigte es keine Likes oder Shares, manchmal viele. Diese Engagement-Signale wurden randomisiert, um feste Muster zu vermeiden.

Die Überschriften selbst stammten aus einer Mischung politischer Perspektiven und wurden als linksorientiert, rechtsorientiert oder mittig markiert.

Nach jeder Überschrift wurden die Teilnehmer gefragt, wie genau sie sie hielten, und ob sie sie teilen würden. Da jeder Teilnehmer bereits seine eigene politische Zugehörigkeit angegeben hatte, konnte analysiert werden, ob Überschriften von der gleichen Seite des politischen Spektrums höher bewertet wurden.

Teilnehmer bewerteten jede Überschrift zweimal: einmal für die Genauigkeit und einmal für die Wahrscheinlichkeit, sie zu teilen, wobei ihre Antworten auf einer Skala von 0-10 gemessen wurden.

Die Forscher kombinierten diese Antworten mit zusätzlichen Daten: demografische und medienbezogene Informationen von jedem Teilnehmer; politische Markierungen für jede Überschrift; die Art der Glaubwürdigkeitssignale, die gezeigt wurden; und das Maß an sozialem Engagement, das zugewiesen wurde.

Einfluss der politischen Identität

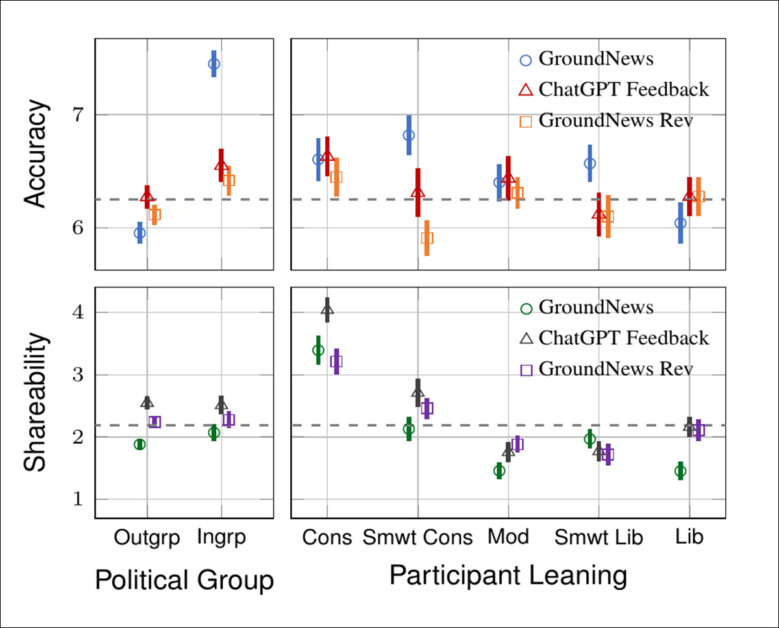

Im ersten Test, der untersuchte, ob Menschen Überschriften als genauer bewerten, wenn die politische Haltung der Überschrift ihrer eigenen Ansicht entspricht, zeigten die Ergebnisse an, dass Teilnehmer eher Überschriften glaubten, die ihrer politischen Ansicht entsprachen – aber dass dies von der Gruppe abhängig war.

Moderate zeigten die stärkste Voreingenommenheit gegenüber ihrer eigenen Seite, während Liberale und Konservative eher Überschriften aus dem politischen Zentrum vertrauten; und insgesamt wurden neutrale Überschriften als genauer bewertet als links- oder rechtsorientierte.

Eine Illustration, wie Genauigkeits- und Teilbarkeitsbewertungen je nach politischer Haltung der Überschrift und der politischen Zugehörigkeit des Teilnehmers variierten. Moderate waren am wahrscheinlichsten, ‘eigene’ Überschriften als genauer zu bewerten, während Liberale und Konservative Überschriften aus dem politischen Zentrum bevorzugten. Das Teilen folgte einem ähnlichen Muster, mit begrenzter Voreingenommenheit außerhalb der moderaten Gruppe.

In den Ergebnissen dieses ersten Experiments wurde ein mäßiger Voreingenommenheitseffekt auf die Teilbarkeit gefunden; aber nur für Moderate, die eher Überschriften mit politischer Ausrichtung (d. h. neutral) teilten. Liberale und Konservative zeigten keine solche Tendenz.

Die Analyse der Varianz (ANOVA), eine Methode, um Unterschiede zwischen Gruppen zu erkennen, zeigte, dass die Ausrichtung die Teilbarkeit nur dann beeinflusste, wenn sie mit der politischen Identität interagierte. Glaubwürdigkeit und Teilbarkeit waren verknüpft, aber nur Moderate zeigten ein klares Muster in beiden.

Institutionelle vs. KI-Glaubwürdigkeit

Der nächste Test fragte, ob Menschen KI-Bewertungen mehr vertrauen als traditionelle Quellen wie Nachrichten-Bewertungs-Websites – insbesondere, wenn die Bewertungen möglicherweise im Widerspruch zu ihren politischen Ansichten stehen:

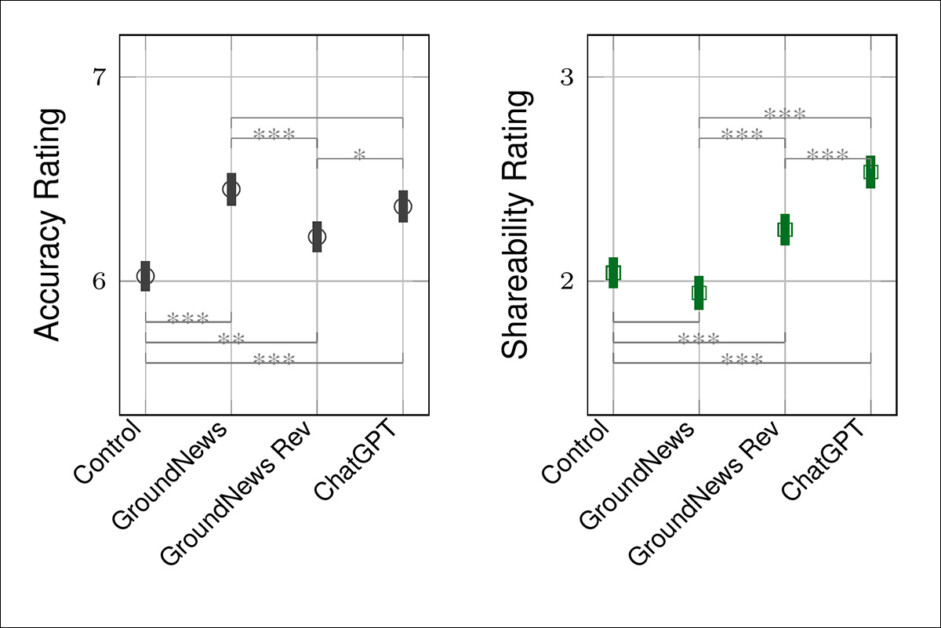

Glaubwürdigkeits- und Teilbarkeitsbewertungen über Feedback-Quellen: alle drei Signale erhöhten die Genauigkeit im Vergleich zur Kontrolle, wobei GroundNews die höchsten Bewertungen erzielte. Allerdings erzeugte ChatGPT die größten Gewinne bei der Teilbarkeit, was darauf hindeutet, dass es einen breiteren persuasiven Einfluss hatte. Fehlerbalken zeigen 95%-Konfidenzintervalle, und Sternchen markieren signifikante Paarunterschiede.

Alle Feedback-Signale erhöhten die wahrgenommene Genauigkeit; aber GroundNews war am effektivsten, wenn es mit den politischen Ansichten des Benutzers übereinstimmte.

ChatGPT erhöhte die Genauigkeitsbewertungen überall, was darauf hindeutet, dass es als neutraler angesehen wurde. Konservative waren weniger von GroundNews beeinflusst, reagierten aber auf ChatGPT ähnlich wie andere Gruppen:

Hier können wir die Auswirkungen von ChatGPT-Feedback auf die wahrgenommene Genauigkeit sehen. Die Ergebnisse zeigen, dass das Vertrauen in institutionelle Signale von der Ausrichtung abhängt, während das Vertrauen in algorithmische Signale nicht. ChatGPT erhöhte sowohl die Glaubwürdigkeit als auch die Teilbarkeit über alle Gruppen – insbesondere für Konservative.

Soziale Metriken haben wenig Einfluss

Die dritte Analyse testete, ob sichtbare soziale Engagement-Signale wie Likes, Shares und Kommentare die Glaubwürdigkeit oder Teilbarkeit durch soziales Beweis erhöhen würden; aber kein solcher Effekt wurde beobachtet.

Tests fanden heraus, dass Engagement-Levels wie Likes oder Shares wenig Auswirkung auf die wahrgenommene Genauigkeit hatten und nur einen schwachen, unzuverlässigen Effekt auf die wahrgenommene Teilbarkeit; im Gegensatz zu algorithmischen oder institutionellen Signalen schienen diese sozialen Signale die Urteile in diesem Setting nicht zu beeinflussen, aus den im Artikel genannten Gründen.

KI-Feedback beeinflusst, was Menschen vertrauen

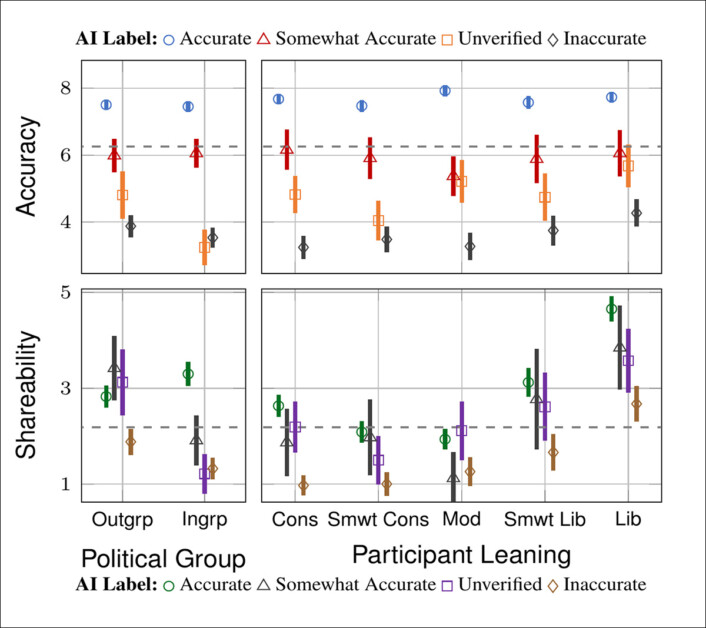

Der vierte und letzte Test überprüfte, ob Benutzer ihre Glaubwürdigkeits- und Teilbarkeitsurteile anpassen würden, um auf KI-generierte Labels zu reagieren: genau; eher genau; unbestätigt; oder ungenau, alle von ChatGPT zugewiesen:

Teilnehmer reagierten stark auf KI-generierte Glaubwürdigkeitslabels. Genauigkeitsbewertungen stiegen oder fielen im Einklang mit ChatGPTs Feedback, wobei die größten Effekte bei Überschriften mit den Labels genau oder ungenau zu sehen waren:

ChatGPT-Feedback beeinflusste sowohl die Genauigkeits- als auch die Teilbarkeitsbewertungen. Oben: Genauigkeitsbewertungen stiegen mit positiveren Labels, insbesondere wenn Überschriften als ‘genau’ markiert waren, und fielen, wenn sie als ‘ungenau’ markiert waren. Unten: Die Teilbarkeit folgte einem ähnlichen Muster, zeigte aber eine größere Variation zwischen den Gruppen: Liberale reagierten am stärksten auf negative Hinweise, während Konservative gemäßigtere Verschiebungen zeigten.

Die politische Identität formte diese Effekte, wobei Benutzer ChatGPT mehr vertrauten, wenn dessen Feedback mit ihren eigenen Ansichten übereinstimmte.

Das Teilen folgte einem ähnlichen Muster: Überschriften, die als genau markiert waren, wurden am häufigsten geteilt, insbesondere unter mehrdeutigen Labels wie eher genau.

Diese Ergebnisse, so das Papier, legen nahe, dass KI-Feedback das Benutzerverhalten beeinflussen kann; und dass es auch das Risiko birgt, parteipolitische Spaltungen zu verstärken oder kritisches Denken zu behindern.

Wer vertraut KI am meisten?

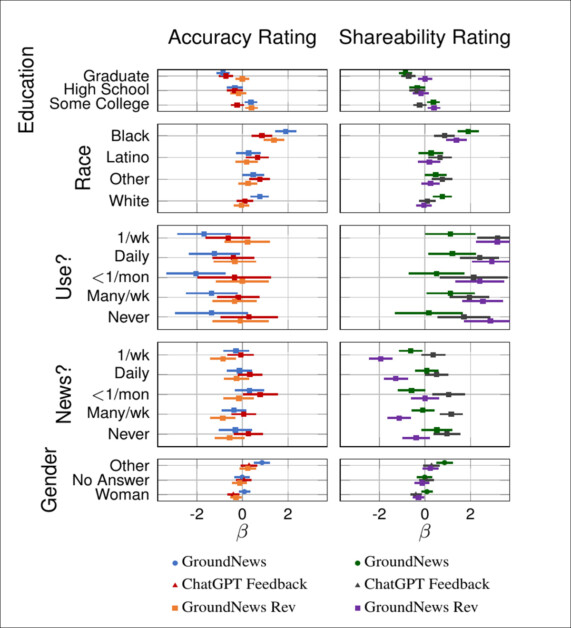

Eine Nachanalyse untersuchte, wie Benutzer-Demografie auf Glaubwürdigkeitslabels reagierte. ChatGPTs Feedback erhöhte die Genauigkeitsbewertungen insgesamt, aber der Effekt war schwächer bei hochgebildeten Benutzern und häufigen sozialen Medien-Konsumenten, die mehr Skepsis zeigten.

Diese Gruppen reagierten negativ auf GroundNews- und umgekehrte Hinweise, was, so das Papier, darauf hindeutet, dass offene Voreingenommenheitsmarker medienkompetentere Benutzer alienieren könnten.

Im Gegensatz dazu reagierten Frauen und rassisch minorisierte Teilnehmer, insbesondere schwarze und lateinamerikanische Benutzer, positiver auf ChatGPT als auf institutionelle Signale:

Demografische Reaktionen auf Feedback-Typen, wobei jedes Panel zeigt, wie eine bestimmte Gruppe auf verschiedene Glaubwürdigkeitssignale reagiert. ChatGPTs Bewertungen hatten den stärksten und konsequentesten Einfluss auf die Genauigkeit, während die Effekte auf das Teilen weniger einheitlich waren, mit Variationen nach Rasse, Geschlecht und Mediengebrauch.

Das Teilen folgte diesem Spalt, wobei GroundNews die Teilbarkeit am stärksten bei sozialen Medien-Nutzern und Nachrichten-Junkies reduzierte, während ChatGPTs Effekte gemischt waren, sogar die Teilbarkeit in einigen Gruppen erhöhte, wobei Graduierte besonders auf alle Feedback-Typen reagierten.

Die Autoren folgern:

‘Diese Ergebnisse haben direkte Auswirkungen auf die Gestaltung von Glaubwürdigkeitsinterventionen in soziotechnischen Systemen. Benutzer werden zunehmend von algorithmischem Feedback beeinflusst, das institutionelle Hinweise überlagern und parteipolitische Voreingenommenheit mildern kann – aber auch das Risiko birgt, Überabhängigkeit zu fördern.

‘Institutionelle Signale bleiben für einige Benutzer wirksam, aber ihre Wirkung nimmt in politisch polarisierten oder [niedrigem Vertrauen] Umgebungen ab. Währenddessen hatten Engagement-Metriken wie Likes und Shares wenig persuasiven Wert, wenn sie ohne sozialen Kontext präsentiert wurden.

‘Um eine gerechte und informierte Nachrichtenbewertung zu unterstützen, müssen KI-getriebene Interventionen transparent, erklärend und darauf ausgelegt sein, die Benutzeragentur zu stärken.

‘Zukünftige Arbeiten sollten diese Mechanismen in mehr ökologisch gültigen Umgebungen untersuchen, alternative KI-Glaubwürdigkeitsrahmen auswerten und adaptive Systeme entwickeln, die kritisches Engagement über politisch diverse Zielgruppen fördern.’

Schlussfolgerung

Angesichts der Tendenz aller aktuellen generativen KI-Systeme, zu halluzinieren und die Wahrheit zu verzerren, ist es möglicherweise von einiger Besorgnis, dass die rasante Adoption (auch wenn sie ein wenig abnimmt) von ChatGPT auch einen enormen Sprung des Glaubens darstellt, dass die Architekturen solcher Systeme weder rechtfertigen noch unterstützen können.

Ein Problem beim Vertrauen in die Darstellung von Nachrichten durch KI ist das Fehlen effektiver Systeme, die Nachrichtenquellen als ‘politisch affiniert’ oder tendenziell zu einem oder anderen Ende des politischen Spektrums neigend identifizieren können.

Sogar unter den renommiertesten Quellen der vierten Gewalt ist die Auswahl dessen, was und was nicht abgedeckt wird, an sich eine politische Aussage. Weder ChatGPT noch seine Pendants sind derzeit in der Lage, diese Schichten interpretativer Voreingenommenheit zu navigieren, und das Thema selbst lädt eher zu Diskussionen als zu soliden Schlussfolgerungen ein.

Ein weiteres Problem ist, dass Systeme dieser Art auf der Szene erschienen sind, in einer der polarisierendsten und spaltendsten Perioden der menschlichen Geschichte in 80 Jahren, und zu einem Zeitpunkt, an dem die Gesellschaft am meisten bereit ist, ‘alternative Stimmen’ zu hören – wie eine völlig neue Gattung von Technologie, die als unerlässlicher Filter der Weltwahrheit beworben wird, anstatt das zu sein, was sie tatsächlich ist: ein Prädiktor statistischer Wahrscheinlichkeiten, der mit großen Mengen an parteipolitischer Information gefüttert wird.

* Details davon haben die Autoren online verfügbar gemacht (siehe Quellenpapier, Fuß der Seite 2, für URLs). Allerdings erfordert diese Daten eine Registrierung, um sie anzusehen, und da ich dies nicht weiter verfolgte, kann ich nicht bestätigen, dass sie vollständig ohne Zahlung und/oder bestimmte Arten von Anmeldeinformationen angesehen werden können.

Erstveröffentlichung am Mittwoch, den 5. November 2025