Künstliche Intelligenz

MagicDance: Realistische Erzeugung von menschlichen Tanzvideos

Computer Vision ist eines der am häufigsten diskutierten Felder in der AI-Industrie, dank seiner potenziellen Anwendungen in einer breiten Palette von Echtzeit-Aufgaben. In den letzten Jahren haben sich Computer-Vision-Frameworks rapide weiterentwickelt, und moderne Modelle sind nun in der Lage, Gesichtsmerkmale, Objekte und vieles mehr in Echtzeit-Szenarien zu analysieren. Trotz dieser Fähigkeiten bleibt die Übertragung von menschlichen Bewegungen eine große Herausforderung für Computer-Vision-Modelle. Diese Aufgabe beinhaltet die Neuzuweisung von Gesichts- und Körperbewegungen von einem Quellbild oder -video zu einem Zielbild oder -video. Die Übertragung von menschlichen Bewegungen wird in Computer-Vision-Modellen weit verbreitet für die Stilisierung von Bildern oder Videos, die Bearbeitung von Multimedia-Inhalten, die digitale Synthese von Menschen und sogar die Erzeugung von Daten für wahrnehmungsbezogene Frameworks verwendet.

In diesem Artikel konzentrieren wir uns auf MagicDance, ein diffusionbasiertes Modell, das darauf abzielt, die Übertragung von menschlichen Bewegungen zu revolutionieren. Das MagicDance-Framework zielt speziell darauf ab, 2D-menschliche Gesichtsausdrücke und Bewegungen auf anspruchsvolle menschliche Tanzvideos zu übertragen. Sein Ziel ist es, neue Pose-Sequenz-getriebene Tanzvideos für bestimmte Ziel-Identitäten zu erzeugen, während die ursprüngliche Identität beibehalten wird. Das MagicDance-Framework verwendet eine zweistufige Trainingsstrategie, die sich auf die Entflechtung von menschlichen Bewegungen und Erscheinungsmerkmalen wie Hautfarbe, Gesichtsausdrücken und Kleidung konzentriert. Wir werden das MagicDance-Framework untersuchen, seine Architektur, Funktionalität und Leistung im Vergleich zu anderen State-of-the-Art-Modellen für die Übertragung von menschlichen Bewegungen. Lassen Sie uns eintauchen.

MagicDance : Realistische Übertragung von menschlichen Bewegungen

Wie bereits erwähnt, ist die Übertragung von menschlichen Bewegungen eine der komplexesten Aufgaben im Bereich Computer Vision, aufgrund der enormen Komplexität, die mit der Übertragung von menschlichen Bewegungen und Ausdrücken von einem Quellbild oder -video zu einem Zielbild oder -video verbunden ist. Traditionell haben Computer-Vision-Frameworks die Übertragung von menschlichen Bewegungen durch das Training von generativen Modellen wie GAN oder Generative Adversarial Networks auf Ziel-Datensätzen für Gesichtsausdrücke und Körperhaltungen erreicht. Obwohl das Training und die Verwendung von generativen Modellen in einigen Fällen zufriedenstellende Ergebnisse liefern, leiden sie in der Regel unter zwei großen Einschränkungen.

- Sie verlassen sich stark auf eine Bildverformungskomponente, als Ergebnis dessen kämpfen sie oft darum, Körperteile zu interpolieren, die im Quellbild unsichtbar sind, entweder aufgrund einer Perspektivenänderung oder Selbstverdeckung.

- Sie können nicht verallgemeinern auf andere Bilder, die extern bezogen werden, was ihre Anwendungen insbesondere in Echtzeit-Szenarien im Freien einschränkt.

Moderne Diffusionsmodelle haben außergewöhnliche Bildgenerierungsfähigkeiten unter verschiedenen Bedingungen demonstriert, und Diffusionsmodelle sind nun in der Lage, leistungsstarke visuelle Effekte in einer Reihe von Downstream-Aufgaben wie Videoerzeugung und Bildausfüllung durch das Lernen von Web-Skala-Bild-Datensätzen zu präsentieren. Aufgrund ihrer Fähigkeiten könnten Diffusionsmodelle eine ideale Wahl für die Übertragung von menschlichen Bewegungen sein. Obwohl Diffusionsmodelle für die Übertragung von menschlichen Bewegungen implementiert werden können, haben sie einige Einschränkungen, entweder in Bezug auf die Qualität des generierten Inhalts oder in Bezug auf die Identitätserhaltung oder leiden unter zeitlichen Inkonsistenzen als Ergebnis von Modell-Design- und Trainingsstrategie-Einschränkungen. Darüber hinaus demonstrieren diffusionbasierte Modelle keinen signifikanten Vorteil gegenüber GAN-Frameworks in Bezug auf Verallgemeinerbarkeit.

Um die Hürden zu überwinden, die von Diffusions- und GAN-basierten Frameworks bei der Übertragung von menschlichen Bewegungen auferlegt werden, haben Entwickler MagicDance eingeführt, ein neues Framework, das darauf abzielt, das Potenzial von Diffusions-Frameworks für die Übertragung von menschlichen Bewegungen auszunutzen und einen beispiellosen Grad an Identitätserhaltung, überlegene visuelle Qualität und Domänen-Verallgemeinerbarkeit zu demonstrieren. Im Kern besteht die grundlegende Konzeption des MagicDance-Frameworks darin, das Problem in zwei Stufen zu unterteilen: Erscheinungskontrolle und Bewegungskontrolle, zwei Fähigkeiten, die von Bild-Diffusions-Frameworks erforderlich sind, um genaue Bewegungsübertragungsergebnisse zu liefern.

Das obige Bild gibt einen kurzen Überblick über das MagicDance-Framework, und wie es zu sehen ist, verwendet das Framework das Stable Diffusion-Modell, und setzt auch zwei zusätzliche Komponenten ein: Erscheinungskontrollmodell und Pose-ControlNet, wobei das erste Erscheinungsleitfaden für das SD-Modell von einem Referenzbild über Aufmerksamkeit bereitstellt, während das zweite Ausdrucks-/Pose-Leitfaden für das Diffusionsmodell von einem bedingten Bild oder Video bereitstellt. Das Framework verwendet auch eine mehrstufige Trainingsstrategie, um diese Submodule effektiv zu lernen, um Pose-Kontrolle und Erscheinung zu entflechten.

Zusammenfassend ist das MagicDance-Framework ein

- Neues und effektives Framework, das aus Erscheinungs-entflechteter Pose-Kontrolle und Erscheinungskontroll-Prätraining besteht.

- Das MagicDance-Framework ist in der Lage, realistische menschliche Gesichtsausdrücke und menschliche Bewegungen unter der Kontrolle von Pose-Bedingungen und Referenzbildern oder -videos zu erzeugen.

- Das MagicDance-Framework zielt darauf ab, Erscheinungskonsistente menschliche Inhalte zu erzeugen, indem es ein Multi-Source-Aufmerksamkeitsmodul einführt, das genaue Leitfäden für das Stable Diffusion UNet-Framework bietet.

- Das MagicDance-Framework kann auch als bequeme Erweiterung oder Plug-in für das Stable Diffusion-Framework verwendet werden und stellt die Kompatibilität mit bestehenden Modellgewichten sicher, da es keine zusätzliche Feinabstimmung der Parameter erfordert.

Darüber hinaus zeigt das MagicDance-Framework außergewöhnliche Verallgemeinerungsfähigkeiten für sowohl Erscheinung als auch Bewegung.

- Erscheinungsverallgemeinerung: Das MagicDance-Framework zeigt überlegene Fähigkeiten bei der Erzeugung vielfältiger Erscheinungen.

- Bewegungsverallgemeinerung: Das MagicDance-Framework verfügt auch über die Fähigkeit, eine breite Palette von Bewegungen zu erzeugen.

MagicDance : Ziele und Architektur

Für ein gegebenes Referenzbild, entweder von einem realen Menschen oder einem stilisierten Bild, besteht das primäre Ziel des MagicDance-Frameworks darin, ein Ausgabebild oder ein Ausgabevideo zu erzeugen, das auf den Eingaben und den Pose-Eingaben {P, F} bedingt ist, wobei P die menschliche Pose-Skelett und F die Gesichtsmerkmale darstellt. Das erzeugte Ausgabebild oder -video sollte in der Lage sein, die Erscheinung und Identität der beteiligten Menschen zu erhalten, sowie die Hintergrundinhalte im Referenzbild, während es die Pose und Ausdrücke beibehält, die durch die Pose-Eingaben definiert sind.

Architektur

Während des Trainings wird das MagicDance-Framework als Frame-Rekonstruktionsaufgabe trainiert, um den Ground-Truth mit dem Referenzbild und der Pose-Eingabe aus dem gleichen Referenzvideo zu rekonstruieren. Während des Testens, um die Bewegungsübertragung zu erreichen, werden die Pose-Eingabe und das Referenzbild aus verschiedenen Quellen bezogen.

Die Gesamtsystemarchitektur des MagicDance-Frameworks kann in vier Kategorien unterteilt werden: Vorläufige Phase, Erscheinungskontroll-Prätraining, Erscheinungs-entflechtete Pose-Kontrolle und Bewegungsmodul.

Vorläufige Phase

Latente Diffusionsmodelle oder LDM stellen einzigartig konzipierte Diffusionsmodelle dar, die innerhalb des latenten Raums durch die Verwendung eines Autoencoders arbeiten, und das Stable Diffusion-Framework ist ein bemerkenswertes Beispiel für LDMs, das einen Vektor-Quantifizierten-Variational-Autoencoder und eine temporale U-Net-Architektur verwendet. Das Stable Diffusion-Modell verwendet einen CLIP-basierten Transformer als Text-Encoder, um Text-Eingaben zu verarbeiten, indem es Text-Eingaben in Embeddings umwandelt. Die Trainingsphase des Stable Diffusion-Frameworks legt dem Modell eine Text-Bedingung und ein Eingabebild vor, wobei der Prozess die Kodierung des Bildes in eine latente Repräsentation beinhaltet und es einer vordefinierten Sequenz von Diffusions-Schritten unterzieht, die durch eine Gauß-Methode gesteuert werden. Die resultierende Sequenz ergibt eine verrauschte latente Repräsentation, die eine Standard-Normalverteilung liefert, wobei das primäre Lernziel des Stable Diffusion-Frameworks darin besteht, die verrauschten latenten Repräsentationen iterativ in latente Repräsentationen zu entrauschen.

Erscheinungskontroll-Prätraining

Ein großes Problem mit dem ursprünglichen ControlNet-Framework ist seine Unfähigkeit, die Erscheinung unter räumlich variierenden Bewegungen konsistent zu kontrollieren, obwohl es tendenziell Bilder mit Posen erzeugt, die denen im Eingabebild ähneln, wobei die Gesamterscheinung hauptsächlich durch textuelle Eingaben beeinflusst wird. Obwohl diese Methode funktioniert, ist sie nicht für die Bewegungsübertragung geeignet, bei der es sich nicht um textuelle Eingaben, sondern um das Referenzbild handelt, das als primäre Quelle für Erscheinungsinformationen dient.

Das Erscheinungskontroll-Prätraining-Modul im MagicDance-Framework ist als Hilfszweig konzipiert, um Leitfäden für die Erscheinungskontrolle in einer schichtweisen Ansatz zu bieten. Anstatt sich auf textuelle Eingaben zu verlassen, konzentriert sich das gesamte Modul darauf, die Erscheinungsattribute aus dem Referenzbild zu nutzen, mit dem Ziel, die Fähigkeit des Frameworks zu verbessern, die Erscheinungsmerkmale genau zu erzeugen, insbesondere in Szenarien mit komplexen Bewegungsdynamiken. Darüber hinaus ist nur das Erscheinungskontrollmodell während des Erscheinungskontroll-Prätrainings trainierbar.

Erscheinungs-entflechtete Pose-Kontrolle

Eine naive Lösung, um die Pose im Ausgabebild zu kontrollieren, besteht darin, das vorgebildete ControlNet-Modell direkt mit dem vorgebildeten Erscheinungskontrollmodell zu integrieren, ohne es fein zu justieren. Allerdings kann diese Integration dazu führen, dass das Framework Schwierigkeiten hat, die Erscheinung unabhängig von der Pose zu kontrollieren, was zu einer Diskrepanz zwischen den Eingabe-Posen und den erzeugten Posen führen kann. Um diese Diskrepanz zu überwinden, feinjustiert das MagicDance-Framework das Pose-ControlNet-Modell gemeinsam mit dem vorgebildeten Erscheinungskontrollmodell.

Bewegungsmodul

Wenn sie zusammenarbeiten, können die Erscheinungs-entflechtete Pose-Kontrolle und das Erscheinungskontrollmodell eine genaue und effektive Bild-zu-Bewegungs-Übertragung erreichen, obwohl dies zu zeitlichen Inkonsistenzen führen kann. Um die zeitliche Konsistenz zu gewährleisten, integriert das Framework ein zusätzliches Bewegungsmodul in die primäre Stable Diffusion UNet-Architektur.

MagicDance : Prätraining und Datensätze

Für das Prätraining verwendet das MagicDance-Framework einen TikTok-Datensatz, der über 350 Tanzvideos von unterschiedlicher Länge zwischen 10 und 15 Sekunden enthält, die eine einzelne Person beim Tanzen zeigen, wobei die Mehrheit dieser Videos das Gesicht und den Oberkörper der Person enthält. Das MagicDance-Framework extrahiert jedes einzelne Video mit 30 FPS und führt OpenPose auf jedem Frame individuell aus, um die Pose-Skelett, Hand-Posen und Gesichtsmerkmale zu inferieren.

Für das Prätraining wird das Erscheinungskontrollmodell mit einem Batch-Größe von 64 auf 8 NVIDIA A100-GPUs für 10.000 Schritte mit einer Bildgröße von 512 x 512 vorab trainiert, gefolgt von einer gemeinsamen Feinjustierung der Pose-Kontrolle und Erscheinungskontroll-Modelle mit einem Batch-Größe von 16 für 20.000 Schritte. Während des Trainings sampelt das MagicDance-Framework zwei Frames zufällig als Ziel und Referenz, wobei die Bilder an der gleichen Position mit der gleichen Höhe beschnitten werden. Während der Auswertung beschränkt das Modell das Bild zentral, anstatt es zufällig zu beschränken.

MagicDance : Ergebnisse

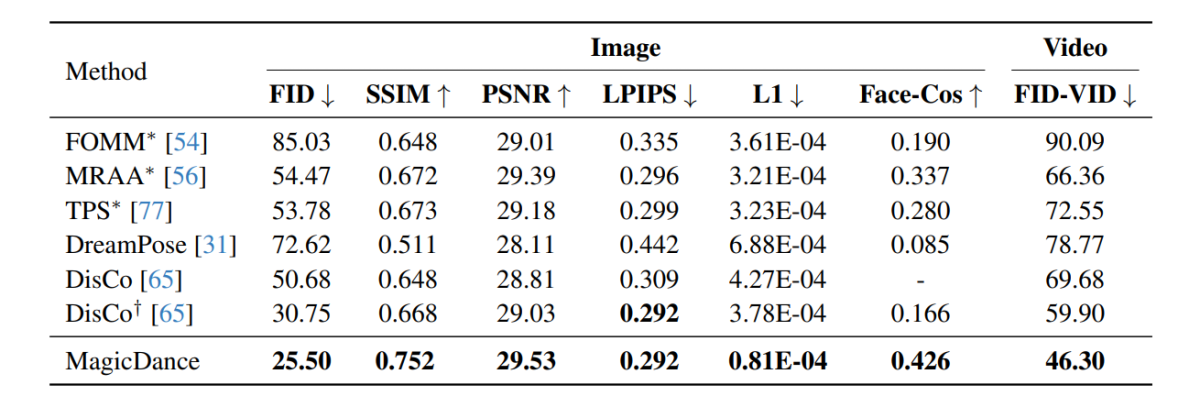

Die experimentellen Ergebnisse, die mit dem MagicDance-Framework durchgeführt wurden, werden im folgenden Bild demonstriert, und wie es zu sehen ist, übertrifft das MagicDance-Framework bestehende Frameworks wie Disco und DreamPose bei der Übertragung von menschlichen Bewegungen in allen Metriken. Frameworks, die einen “*” vor ihrem Namen haben, verwenden das Zielbild direkt als Eingabe und enthalten mehr Informationen als die anderen Frameworks.

Es ist interessant zu beachten, dass das MagicDance-Framework einen Face-Cos-Wert von 0,426 erreicht, was eine Verbesserung von 156,62 % gegenüber dem Disco-Framework darstellt und nahezu eine 400 % Steigerung im Vergleich zum DreamPose-Framework. Die Ergebnisse zeigen die robuste Fähigkeit des MagicDance-Frameworks, Identitätsinformationen zu erhalten, und der sichtbare Leistungsanstieg zeigt die Überlegenheit des MagicDance-Frameworks gegenüber bestehenden State-of-the-Art-Methoden.

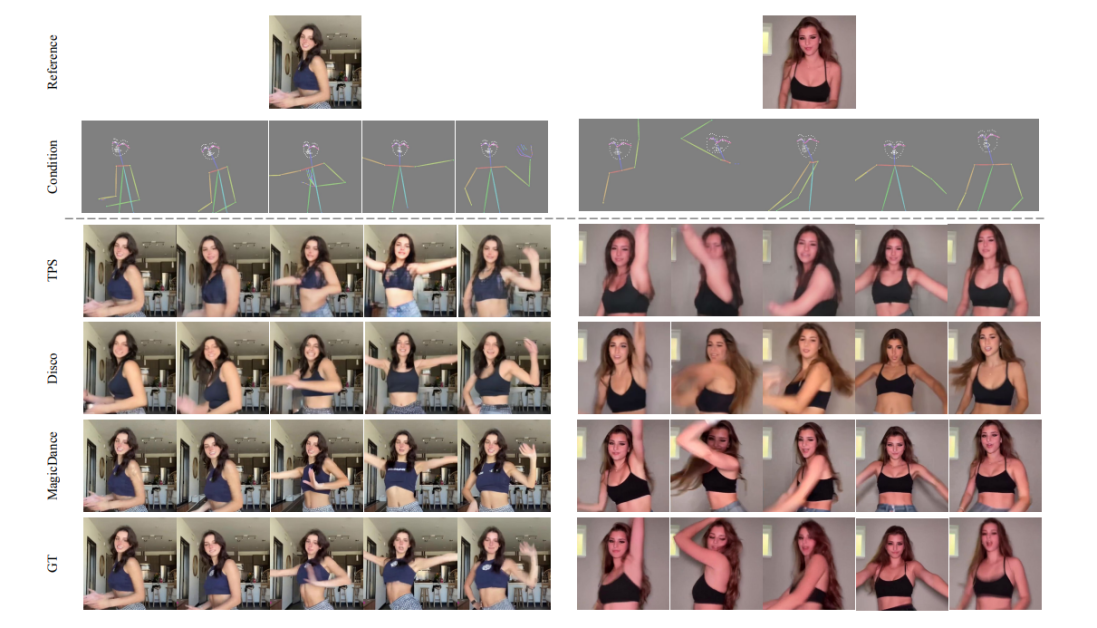

Die folgenden Bilder vergleichen die Qualität der menschlichen Videoerzeugung zwischen dem MagicDance-, Disco- und TPS-Framework. Wie zu sehen ist, leiden die Ergebnisse, die von den GT-, Disco- und TPS-Frameworks erzeugt werden, unter inkonsistenten menschlichen Pose-Identitäten und Gesichtsausdrücken.

Darüber hinaus zeigt das folgende Bild die Visualisierung der Gesichtsausdrucks- und menschlichen Pose-Übertragung auf dem TikTok-Datensatz, wobei das MagicDance-Framework in der Lage ist, realistische und lebendige Ausdrücke und Bewegungen unter verschiedenen Gesichtsmerkmalen und Pose-Skelett-Eingaben zu erzeugen, während es die Identitätsinformationen aus dem Referenz-Eingabebild genau erhält.

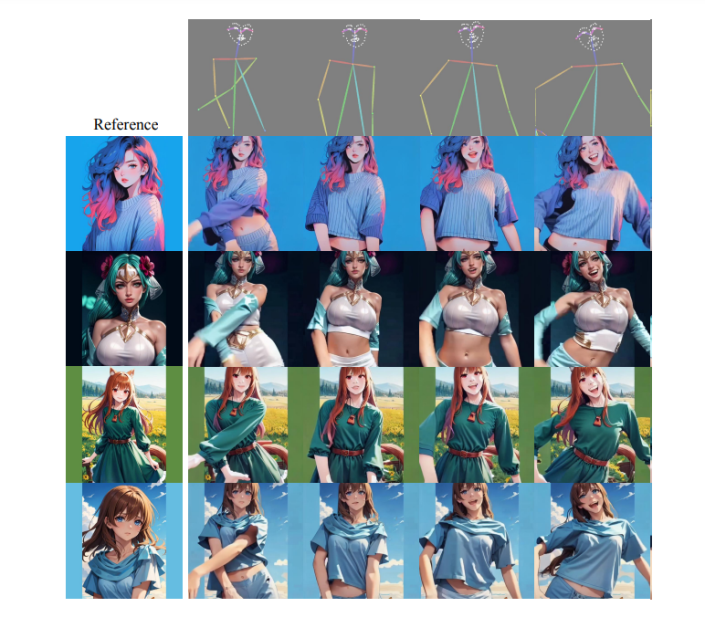

Es ist erwähnenswert, dass das MagicDance-Framework außergewöhnliche Verallgemeinerungsfähigkeiten für Referenzbilder außerhalb des Bereichs mit unbekannten Posen und Stilen aufweist, mit beeindruckender Erscheinungskontrolle, sogar ohne zusätzliche Feinjustierung auf dem Ziel-Bereich, wobei die Ergebnisse im folgenden Bild demonstriert werden.

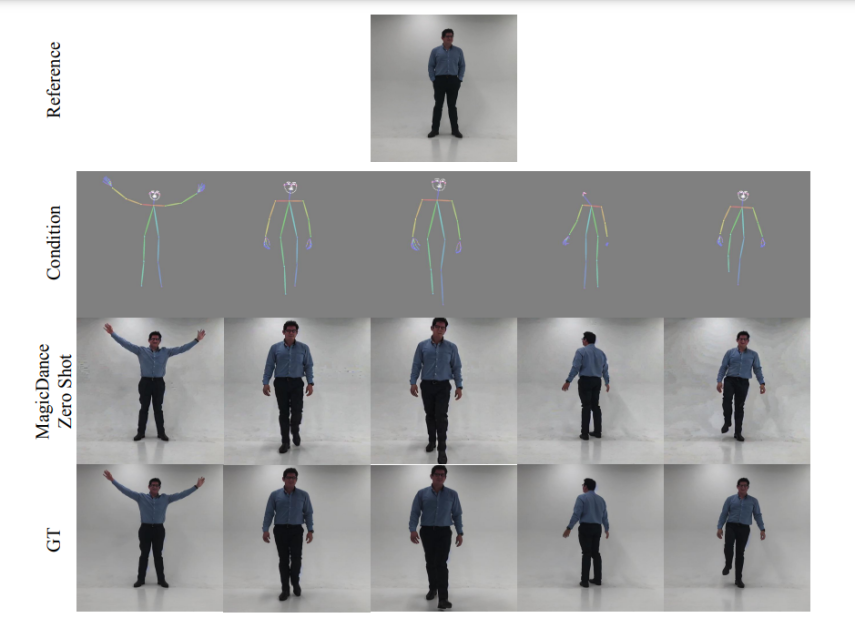

Die folgenden Bilder demonstrieren die Visualisierungsfähigkeiten des MagicDance-Frameworks in Bezug auf die Gesichtsausdrucks-Übertragung und die Null-Shot-menschliche Bewegung. Wie zu sehen ist, verallgemeinert das MagicDance-Framework perfekt auf menschliche Bewegungen im Freien.

MagicDance : Einschränkungen

OpenPose ist eine wesentliche Komponente des MagicDance-Frameworks, da es eine entscheidende Rolle bei der Pose-Kontrolle spielt und die Qualität und zeitliche Konsistenz der erzeugten Bilder erheblich beeinflusst. Allerdings hat das MagicDance-Framework immer noch Schwierigkeiten, Gesichtsmerkmale und Pose-Skelette genau zu erkennen, insbesondere wenn die Objekte in den Bildern teilweise sichtbar sind oder sich schnell bewegen. Diese Probleme können zu Artefakten im erzeugten Bild führen.

Schlussfolgerung

In diesem Artikel haben wir über MagicDance gesprochen, ein diffusionbasiertes Modell, das darauf abzielt, die Übertragung von menschlichen Bewegungen zu revolutionieren. Das MagicDance-Framework versucht, 2D-menschliche Gesichtsausdrücke und Bewegungen auf anspruchsvolle menschliche Tanzvideos zu übertragen, mit dem spezifischen Ziel, neue Pose-Sequenz-getriebene menschliche Tanzvideos für bestimmte Ziel-Identitäten zu erzeugen, während die Identität konstant bleibt. Das MagicDance-Framework ist eine zweistufige Trainingsstrategie für die Entflechtung von menschlichen Bewegungen und Erscheinungsmerkmalen wie Hautfarbe, Gesichtsausdrücken und Kleidung.

MagicDance ist ein neuer Ansatz, um realistische menschliche Videoerzeugung zu ermöglichen, indem es Gesichts- und Bewegungsausdruck-Übertragung integriert und konsistente Animation im Freien ermöglicht, ohne dass eine weitere Feinjustierung erforderlich ist, was eine signifikante Verbesserung gegenüber bestehenden Methoden darstellt. Darüber hinaus zeigt das MagicDance-Framework außergewöhnliche Verallgemeinerungsfähigkeiten für komplexe Bewegungssequenzen und vielfältige menschliche Identitäten, wodurch das MagicDance-Framework als führender Kandidat im Bereich der AI-gestützten Bewegungsübertragung und Videoerzeugung etabliert wird.