Künstliche Intelligenz

Deepfake-Erkennung verfolgt neues Terrain: Latente Diffusionsmodelle und GANs

Meinung

Die Forschungsgemeinschaft zur Erkennung von Deepfakes, die seit Ende 2017 fast ausschließlich mit dem Autoencoder-Framework beschäftigt war, das zu dieser Zeit mit so viel öffentlichem Erstaunen (und Entsetzen) debütierte, hat begonnen, sich für weniger stagnante Architekturen zu interessieren, darunter latente Diffusionsmodelle wie DALL-E 2 und Stable Diffusion, sowie die Ausgabe von Generative Adversarial Networks (GANs). Zum Beispiel veröffentlichte die UC Berkeley im Juni die Ergebnisse ihrer Forschung zur Entwicklung eines Detektors für die Ausgabe von DALL-E 2.

Was dieses wachsende Interesse zu treiben scheint, ist der plötzliche evolutionäre Sprung in der Fähigkeit und Verfügbarkeit von latenten Diffusionsmodellen im Jahr 2022, mit der Closed-Source- und Limited-Access-Veröffentlichung von DALL-E 2 im Frühjahr, gefolgt von der sensationellen Open-Sourcing von Stable Diffusion durch stability.ai im Spätsommer.

GANs wurden auch längere Zeit in diesem Zusammenhang studiert, wenn auch weniger intensiv, da es sehr schwierig ist, sie für überzeugende und aufwändige Video-basierte Nachbildungen von Personen zu verwenden; zumindest im Vergleich zu den inzwischen altgedienten Autoencoder-Paketen wie FaceSwap und DeepFaceLab – und dem letzteren Live-Streaming-Vetter, DeepFaceLive.

Bewegte Bilder

In beiden Fällen scheint der auslösende Faktor die Aussicht auf einen anschließenden Entwicklungssprint für Video-Synthese zu sein. Der Beginn des Oktobers – und die große Konferenzsaison 2022 – war geprägt von einer Lawine plötzlicher und unerwarteter Lösungen für verschiedene langjährige Video-Synthese-Probleme: Kaum hatte Facebook Beispiele seiner eigenen Text-zu-Video-Plattform veröffentlicht, als Google Research die anfängliche Begeisterung mit der Ankündigung seiner neuen Imagen-to-Video-T2V-Architektur übertönte, die in der Lage ist, High-Resolution-Footage (zwar nur über ein 7-Schichten-Netz von Upscalern) auszugeben.

Wenn Sie glauben, dass solche Dinge in Dreiergruppen kommen, betrachten Sie auch stability.ai’s geheimnisvolles Versprechen, dass “Video kommt” zu Stable Diffusion, offensichtlich später in diesem Jahr, während Stable-Diffusion-Co-Entwickler Runway ein ähnliches Versprechen gemacht hat, obwohl es unklar ist, ob sie sich auf dasselbe System beziehen. Die Discord-Nachricht von Stability-CEO Emad Mostaque versprach auch ‘Audio, Video [und] 3D’.

Was mit einem unverhofften Angebot von mehreren neuen Audio-Generierungsframeworks (einige basieren auf latenter Diffusion) und einem neuen Diffusionsmodell, das authentische Charakterbewegungen erzeugen kann, beginnt die Idee, dass “statische” Frameworks wie GANs und Diffusern endlich ihre Position als unterstützende Adjunkte zu externen Animationsframeworks einnehmen, an Fahrt zu gewinnen.

In Kürze scheint es wahrscheinlich, dass die behinderte Welt der autoencoder-basierten Video-Deepfakes, die nur effektiv den zentralen Teil eines Gesichts ersetzen können, bis zu diesem Zeitpunkt im nächsten Jahr von einer neuen Generation von diffusionsbasierten Deepfake-fähigen Technologien übertroffen werden könnte – beliebte, Open-Source-Ansätze mit dem Potenzial, nicht nur ganze Körper, sondern ganze Szenen photorealistisch zu fälschen.

Deshalb beginnt vielleicht die Anti-Deepfake-Forschungsgemeinschaft, Bildsynthese ernst zu nehmen und zu erkennen, dass sie mehr als nur die Generierung von falschen LinkedIn-Profilfotos dienen könnte; und dass, wenn all ihre undurchdringlichen latenten Räume in Bezug auf temporale Bewegung nur dazu in der Lage sind, als großartiger Texture-Renderer zu agieren, das möglicherweise mehr als genug sein könnte.

Blade Runner

Die beiden neuesten Arbeiten, die sich mit latenten Diffusions- bzw. GAN-basierten Deepfake-Erkennung befassen, sind DE-FAKE: Erkennung und Zuordnung von gefälschten Bildern, die durch Text-zu-Bild-Diffusionsmodelle erzeugt wurden, eine Zusammenarbeit zwischen dem CISPA Helmholtz-Zentrum für Informationssicherheit und Salesforce; und BLADERUNNER: Schnellmaßnahme für synthetische (künstlich erzeugte) StyleGAN-Gesichter, von Adam Dorian Wong am MIT’s Lincoln Laboratory.

Bevor es seine neue Methode erläutert, nimmt sich die letztere Arbeit die Zeit, um vorherige Ansätze zur Bestimmung, ob ein Bild von einem GAN (die Arbeit befasst sich speziell mit der NVIDIA-StyleGAN-Familie) generiert wurde oder nicht, zu untersuchen.

Die “Brady-Bunch”-Methode – vielleicht ein sinnloser Verweis für jeden, der in den 1970er Jahren nicht fernsah oder die Filmadaptionen der 1990er Jahre verpasst hat – identifiziert GAN-gefälschtes Material anhand der festen Positionen, die bestimmte Teile eines GAN-Gesichts einnehmen, aufgrund der mechanischen und schematischen Natur des “Produktionsprozesses”.

Die ‘Brady-Bunch’-Methode, die in einem Webcast des SANS-Instituts 2022 propagiert wurde: Ein GAN-basierter Gesichtsgenerator wird eine unglaubwürdig einheitliche Platzierung bestimmter Gesichtszüge durchführen, was den Ursprung des Fotos in bestimmten Fällen verrät. Quelle: https://arxiv.org/ftp/arxiv/papers/2210/2210.06587.pdf

Ein weiterer nützlicher bekannter Hinweis ist StyleGANs häufige Unfähigkeit, mehrere Gesichter (erstes Bild unten) zu rendern, wenn notwendig, sowie seine mangelnde Begabung für Accessoire-Koordination (Mittelbild unten) und eine Neigung, eine Haarlinie als Startpunkt für eine improvisierte Mütze zu verwenden (drittes Bild unten).

Die dritte Methode, auf die der Forscher hinweist, ist Foto-Überlagerung (ein Beispiel dafür kann in unserem Artikel aus August über die AI-gestützte Diagnose von psychischen Erkrankungen gesehen werden), die kompositorische “Bild-Überlagerungs”-Software wie die CombineZ-Serie verwendet, um mehrere Bilder zu einem einzigen Bild zu verbinden, oft zugrunde liegende Gemeinsamkeiten in der Struktur aufdeckend – ein potenzieller Hinweis auf Synthese.

Die in der neuen Arbeit vorgeschlagene Architektur trägt den Titel (möglicherweise gegen alle SEO-Ratschläge) Blade Runner, der sich auf den Voight-Kampff-Test bezieht, der bestimmt, ob die Antagonisten in der Science-Fiction-Saga “falsch” sind oder nicht.

Die Pipeline besteht aus zwei Phasen, von denen die erste der PapersPlease-Analyser ist, der Daten von bekannten GAN-Gesichts-Websites wie thispersondoesnotexist.com oder generierten Fotos auswerten kann.

Obwohl eine abgespeckte Version des Codes auf GitHub (siehe unten) eingesehen werden kann, werden nur wenige Details zu diesem Modul bereitgestellt, außer dass OpenCV und DLIB verwendet werden, um Gesichter in dem gesammelten Material zu umreißen und zu erkennen.

Das zweite Modul ist der AmongUs-Detektor. Das System ist darauf ausgelegt, koordinierte Augenplatzierung in Fotos zu suchen, ein anhaltendes Merkmal von StyleGANs Gesichtsausgabe, typisiert in dem oben beschriebenen “Brady-Bunch”-Szenario.

Gesichtspunkte-Anmerkungen via der Intelligent Behaviour Understanding Group (IBUG), deren Gesichts-Landmark-Plotting-Code im Blade-Runner-Paket verwendet wird.

AmongUs basiert auf vorab trainierten Landmarken, die auf den bekannten “Brady-Bunch”-Koordinaten von PapersPlease basieren, und ist für die Verwendung gegen live, webfähige Beispiele von StyleGAN-basierten Gesichtsbildern bestimmt.

Blade Runner, so schlägt der Autor vor, ist eine Plug-and-Play-Lösung, die für Unternehmen oder Organisationen gedacht ist, die nicht über die Ressourcen verfügen, um eigene Lösungen für die Art der Deepfake-Erkennung zu entwickeln, mit der es sich hier beschäftigt; und eine “Zwischenlösung, um Zeit für dauerhaftere Gegenmaßnahmen zu gewinnen”.

In der Tat gibt es in diesem so volatilen und schnell wachsenden Sicherheitssektor derzeit nicht viele maßgeschneiderte oder von Cloud-Anbietern bereitgestellte Lösungen, auf die ein unterressourcetes Unternehmen mit Zuversicht zurückgreifen kann.

Obwohl Blade Runner gegen brillengetragene StyleGAN-gefälschte Personen schlecht abschneidet, ist dies ein relativ allgemeines Problem bei ähnlichen Systemen, die darauf angewiesen sind, Augenumrisse als Kernpunkte von Bezugswerten zu bewerten, die in solchen Fällen verdeckt sind.

Eine reduzierte Version von Blade Runner wurde open source auf GitHub veröffentlicht. Eine umfangreichere proprietäre Version existiert, die mehrere Fotos verarbeiten kann, im Gegensatz zu der Open-Source-Version, die nur ein Foto pro Operation verarbeiten kann. Der Autor beabsichtigt, er sagt, die GitHub-Version auf denselben Standard zu aktualisieren, sobald Zeit dafür ist. Er räumt auch ein, dass StyleGAN wahrscheinlich über seine bekannten oder aktuellen Schwächen hinauswachsen wird, und die Software wird sich entsprechend weiterentwickeln müssen.

DE-FAKE

Die DE-FAKE-Architektur zielt nicht nur darauf ab, eine “universelle Erkennung” für von Text-zu-Bild-Diffusionsmodellen erzeugte Bilder zu erreichen, sondern auch eine Methode bereitzustellen, um zu bestimmen, welches latentes Diffusionsmodell (LD) das Bild erzeugt hat.

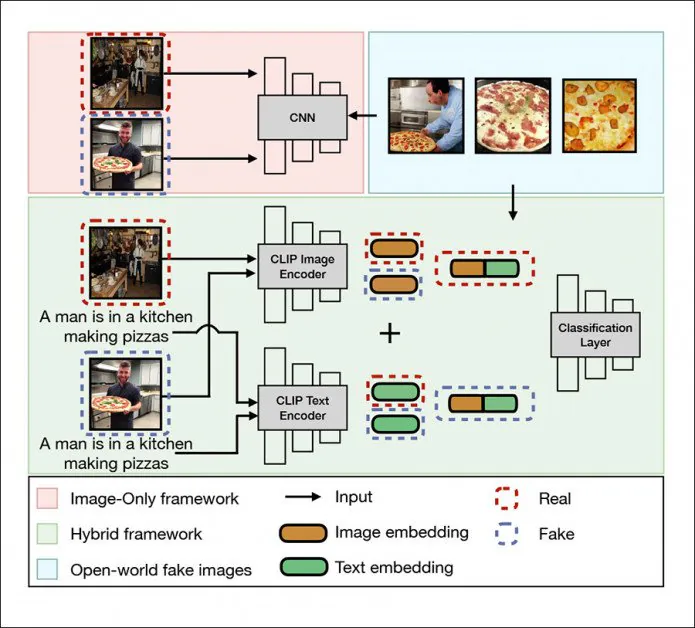

Das universelle Erkennungsframework in DE-FAKE behandelt lokale Bilder, ein Hybridframework (grün) und offene Weltbilder (blau). Quelle: http://export.arxiv.org/pdf/2210.06998

Um ehrlich zu sein, ist dies im Moment eine ziemlich einfache Aufgabe, da alle beliebten LD-Modelle – ob geschlossen oder Open Source – bemerkenswerte unterscheidbare Merkmale aufweisen.

Zusätzlich teilen sie alle einige gemeinsame Schwächen, wie eine Neigung, Köpfe abzuschneiden, weil der willkürliche Weg, auf dem nicht quadratische Web-Scraping-Bilder in die riesigen Datensätze aufgenommen werden, die Systeme wie DALL-E 2, Stable Diffusion und MidJourney antreiben:

Latente Diffusionsmodelle, wie alle Computer-Vision-Modelle, erfordern quadratische Eingabe; aber das aggregierte Web-Scraping, das den LAION5B-Datensatz speist, bietet keine “Luxus-Extras” wie die Fähigkeit, Gesichter (oder irgendetwas anderes) zu erkennen und zu fokussieren, und schneidet Bilder stattdessen brutal ab, anstatt sie auszupaddden (was das gesamte Quellbild beibehalten, aber in niedrigerer Auflösung würde). Quellen: https://blog.novelai.net/novelai-improvements-on-stable-diffusion-e10d38db82ac und Stable Diffusion.

DE-FAKE soll algorithmusunabhängig sein, ein lang gehegter Wunsch der Autoencoder-Anti-Deepfake-Forscher, und im Moment ein ziemlich erreichbares Ziel im Hinblick auf LD-Systeme.

Die Architektur verwendet OpenAIs Contrastive Language-Image Pretraining (CLIP) multimodales Bibliothek – ein wesentliches Element in Stable Diffusion und schnell zum Herzstück der neuen Welle von Bild-/Video-Synthese-Systemen werdend – als Mittel, um Einbettungen aus “gefälschten” LD-Bildern zu extrahieren und einen Klassifikator auf den beobachteten Mustern und Klassen zu trainieren.

In einer eher “black-box”-Szenario, in dem die PNG-Chunks, die Informationen über den Generierungsprozess enthalten, längst durch Upload-Prozesse und aus anderen Gründen entfernt wurden, verwenden die Forscher das Salesforce BLIP-Framework (auch ein Bestandteil in mindestens einer Distribution von Stable Diffusion) um die Bilder “blind” auf die wahrscheinliche semantische Struktur der Prompts, die sie erzeugt haben, zu befragen.

Die Forscher verwendeten Stable Diffusion, Latent Diffusion (selbst ein diskretes Produkt), GLIDE und DALL-E 2, um ein Trainings- und Testdatensatz mit MSCOCO und Flickr30k zu erstellen.

Normalerweise würden wir uns ausführlich mit den Ergebnissen der Forscher-Experimente für ein neues Framework auseinandersetzen; aber in Wahrheit scheinen die Ergebnisse von DE-FAKE eher als zukünftiger Benchmark für spätere Iterationen und ähnliche Projekte geeignet zu sein, als als sinnvoller Maßstab für den Erfolg des Projekts, angesichts der volatilen Umgebung, in der es operiert, und dass das System, gegen das es in den Tests des Papiers antritt, fast drei Jahre alt ist – aus einer Zeit, als die Bildsynthese-Szene noch wirklich im Entstehen war.

Links: das vorherige Framework, das 2019 entstand, schneidet vorhersehbar schlechter gegen DE-FAKE (rechts) in den vier getesteten LD-Systemen ab.

Die Ergebnisse des Teams sind überwältigend positiv aus zwei Gründen: Es gibt kaum vorherige Arbeiten, mit denen sie verglichen werden kann (und keine, die einen fairen Vergleich bietet, d. h. die die bloßen zwölf Wochen seit der Veröffentlichung von Stable Diffusion als Open Source abdeckt).

Zweitens, wie oben erwähnt, obwohl das LD-Bildsynthese-Feld mit exponentieller Geschwindigkeit entwickelt wird, watermarkt die Ausgabeinhalte der aktuellen Angebote effektiv sich selbst durch ihre eigene strukturelle (und sehr vorhersehbare) Mängel und Eigenheiten – viele davon wahrscheinlich im Falle von Stable Diffusion durch die Veröffentlichung des besseren 1,5-Checkpoints (d. h. des 4-GB-Trainingsmodells, das das System antreibt) behoben zu werden.

Gleichzeitig hat Stability bereits angekündigt, dass es einen klaren Fahrplan für V2 und V3 des Systems hat. Angesichts der spektakulären Ereignisse der letzten drei Monate ist jede corporate Trägheit aufseiten von OpenAI und anderen Mitbewerbern im Bildsynthese-Bereich wahrscheinlich verflogen, was bedeutet, dass wir auch in dem Closed-Source-Bildsynthese-Bereich einen ähnlich schnellen Fortschritt erwarten können.

Erstveröffentlicht am 14. Oktober 2022.