Künstliche Intelligenz

Ist DALL-E 2 nur “Dinge zusammenkleben” ohne ihre Beziehungen zu verstehen?

Ein neues Forschungspapier der Harvard University legt nahe, dass OpenAIs text-to-image-Framework DALL-E 2, das für Schlagzeilen sorgte, erhebliche Schwierigkeiten hat, auch nur kinderleichte Beziehungen zwischen den Elementen zu reproduzieren, die es in synthetisierten Fotos zusammenfügt, trotz der atemberaubenden Raffinesse eines Großteils seiner Ausgabe.

Die Forscher führten eine Benutzerstudie mit 169 Teilnehmern durch, die über eine Crowdsourcing-Plattform rekrutiert wurden und denen DALL-E-2-Bilder auf der Grundlage der grundlegendsten menschlichen Prinzipien der Beziehungssemantik zusammen mit den Text-Prompts, die sie erstellt hatten, präsentiert wurden. Als sie gefragt wurden, ob die Prompts und die Bilder zusammenhängen, wurden weniger als 22 % der Bilder als relevant für ihre zugehörigen Prompts angesehen, was die sehr einfachen Beziehungen betrifft, die DALL-E 2 visualisieren sollte.

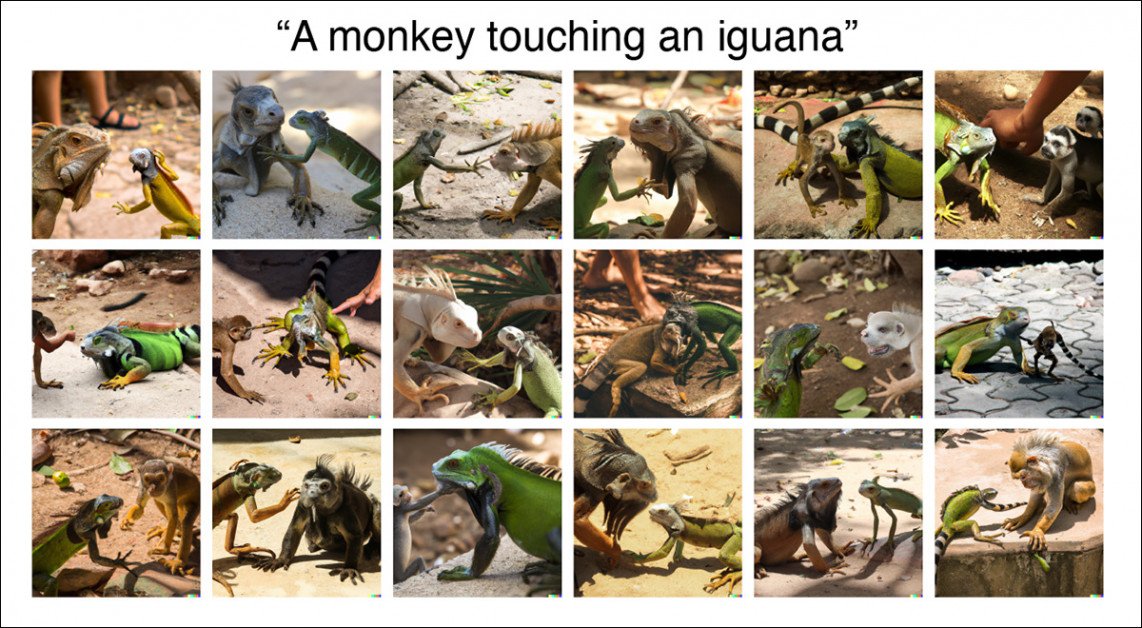

Ein Screenshot aus den für das neue Papier durchgeführten Tests. Die Teilnehmer wurden aufgefordert, alle Bilder auszuwählen, die dem Prompt entsprachen. Quelle: https://arxiv.org/pdf/2208.00005.pdf

Die Ergebnisse legen auch nahe, dass DALL-Es scheinbare Fähigkeit, disparate Elemente zu verbinden, abnehmen kann, wenn diese Elemente weniger wahrscheinlich sind, in den realen Trainingsdaten vorgekommen zu sein, die das System antreiben.

Zum Beispiel erzielten Bilder für den Prompt “Kind berührt eine Schüssel” eine Zustimmungsrate von 87 % (d. h. die Teilnehmer klickten auf die meisten Bilder als relevant für den Prompt), während ähnlich photorealistische Renderings von “einem Affen, der einen Leguan berührt” nur 11 % Zustimmung erzielten:

DALL-E hat Schwierigkeiten, das unwahrscheinliche Ereignis eines ‘Affen, der einen Leguan berührt’ darzustellen.

Im zweiten Beispiel bekommt DALL-E 2 häufig die Größe und sogar die Art falsch, vermutlich wegen des Mangels an realen Bildern, die dieses Ereignis darstellen. Im Gegensatz dazu ist es vernünftig, eine hohe Anzahl von Trainingsfotos im Zusammenhang mit Kindern und Essen zu erwarten, und dass diese Subdomäne/Klasse gut entwickelt ist.

DALL-Es Schwierigkeit, stark kontrastierende Bild-elemente zusammenzufügen, legt nahe, dass die Öffentlichkeit derzeit so sehr von den photorealistischen und breit interpretierbaren Fähigkeiten des Systems beeindruckt ist, dass sie noch nicht ein kritisches Auge für Fälle entwickelt hat, in denen das System effektiv nur “eine Sache stark auf eine andere geklebt hat”, wie in diesen Beispielen von der offiziellen DALL-E-2-Seite:

Kleben und Schneiden-Synthese, von den offiziellen Beispielen für DALL-E 2. Quelle: https://openai.com/dall-e-2/

Das neue Papier besagt*:

‘Relationales Verständnis ist ein grundlegender Bestandteil des menschlichen Intellekts, der sich früh in der Entwicklung manifestiert und schnell und automatisch in der Wahrnehmung berechnet wird.

‘DALL-E 2s Schwierigkeit mit sogar grundlegenden räumlichen Beziehungen (wie in, auf, unter) legt nahe, dass es, was auch immer es gelernt hat, noch nicht die Arten von Repräsentationen gelernt hat, die es Menschen ermöglichen, die Welt so flexibel und robust zu strukturieren.

‘Eine direkte Interpretation dieser Schwierigkeit ist, dass Systeme wie DALL-E 2 noch nicht die relationale Zusammensetzung haben.’

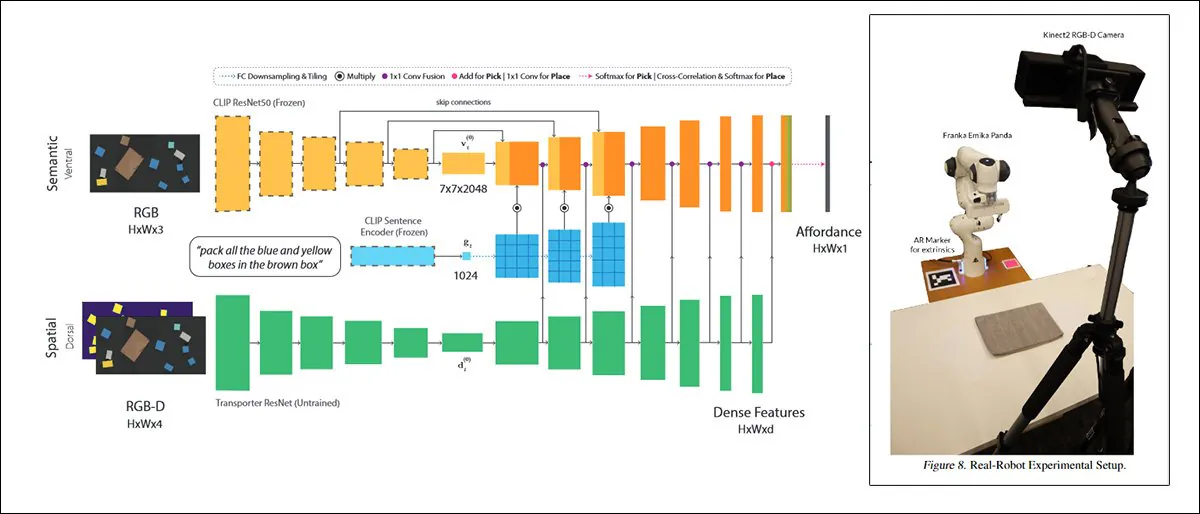

Die Autoren schlagen vor, dass textgesteuerte Bildgenerierungssysteme wie die DALL-E-Serie von der Nutzung von Algorithmen profitieren könnten, die in der Robotik üblich sind, die Identitäten und Beziehungen gleichzeitig modellieren, aufgrund der Notwendigkeit, dass der Agent tatsächlich mit der Umgebung interagiert, anstatt nur eine Mischung aus verschiedenen Elementen herzustellen.

Eine solche Herangehensweise, die als CLIPort bezeichnet wird, verwendet den gleichen CLIP-Mechanismus, der als Qualitätsbewertungselement in DALL-E 2 dient:

CLIPort, eine Zusammenarbeit zwischen der University of Washington und NVIDIA aus dem Jahr 2021, verwendet CLIP in einem so praktischen Kontext, dass die Systeme, die darauf trainiert werden, notwendigerweise ein Verständnis für physikalische Beziehungen entwickeln müssen. Quelle: https://arxiv.org/pdf/2109.12098.pdf

Die Autoren schlagen weiter vor, dass eine andere plausible Verbesserung darin bestehen könnte, die Architektur von Bildsynthesesystemen wie DALL-E so zu gestalten, dass sie in einer einzigen Rechenschicht multiplikative Effekte berücksichtigt, um die Beziehungen auf eine Weise zu berechnen, die von den Informationsverarbeitungskapazitäten biologischer Systeme inspiriert wird.

Das neue Papier trägt den Titel Testing Relational Understanding in Text-Guided Image Generation und stammt von Colin Conwell und Tomer D. Ullman vom Department of Psychology der Harvard University.

Jenseits der frühen Kritik

In einem Kommentar zur “Zauberei” hinter der Realität und Integrität von DALL-E 2s Ausgabe bemerken die Autoren frühere Arbeiten, die Mängel in DALL-E-ähnlichen generativen Bildsystemen gefunden haben.

Im Juni dieses Jahres wies die UoC Berkeley hin, dass DALL-E Schwierigkeiten hat, Reflexionen und Schatten zu handhaben; im gleichen Monat untersuchte eine Studie aus Korea die “Einzigartigkeit” und Originalität von DALL-E-2-ähnlichen Ausgaben mit kritischem Blick; eine vorläufige Analyse von DALL-E-2-Bildern, kurz nach dem Start, von NYU und der University of Texas, fand verschiedene Probleme mit Zusammensetzung und anderen wesentlichen Faktoren in DALL-E-2-Bildern; und letzten Monat bot eine gemeinsame Arbeit zwischen der University of Illinois und MIT Vorschläge für architektonische Verbesserungen solcher Systeme in Bezug auf Zusammensetzung an.

Die Forscher bemerken weiter, dass DALL-E-Luminarys wie Aditya Ramesh zugegeben haben, dass das Framework Probleme mit Bindung, relativer Größe, Text und anderen Herausforderungen hat.

Die Entwickler hinter Googles konkurrierendem Bildsynthesesystem Imagen haben auch DrawBench vorgeschlagen, ein neues Vergleichssystem, das die Bildgenauigkeit über Frameworks mit unterschiedlichen Metriken misst.

Stattdessen schlagen die Autoren des neuen Papiers vor, dass ein besseres Ergebnis erzielt werden könnte, indem man die menschliche Schätzung – anstatt internen, algorithmischen Metriken – gegen die resultierenden Bilder stellt, um festzustellen, wo die Schwächen liegen und was getan werden könnte, um sie zu mindern.

Die Studie

Um dies zu erreichen, basiert der neue Ansatz auf psychologischen Prinzipien und versucht, sich von dem aktuellen Interesse an Prompt-Engineering (das im Wesentlichen ein Zugeständnis an die Mängel von DALL-E 2 oder einem vergleichbaren System ist) zurückzuziehen, um die Einschränkungen zu untersuchen und möglicherweise anzugehen, die solche “Workarounds” notwendig machen.