提示工程

什么是 Chain-of-Thought (CoT) 提示?示例和优点

近年来,大型语言模型 (LLM) 在理解和生成类似人类的文本方面取得了显著的进步。这些模型,如 OpenAI 的 GPT 和 Anthropic 的 Claude,在广泛的自然语言处理任务中表现出色。然而,当涉及需要多步逻辑思考的复杂推理任务时,传统的提示方法往往不够。这就是 Chain-of-Thought (CoT) 提示的用武之地,它提供了一种强大的 提示工程 技术来提高大型语言模型的推理能力。

关键要点

- CoT 提示通过生成中间步骤来增强推理能力。

- 它将复杂问题分解为较小、可管理的子问题。

- 优点包括性能改善、可解释性和泛化能力。

- CoT 提示适用于算术、常识和符号推理。

- 它有可能对人工智能在各个领域产生重大影响。

什么是 Chain-of-Thought (CoT) 提示?

Chain-of-Thought 提示是一种旨在通过鼓励模型生成中间推理步骤来增强大型语言模型在复杂推理任务上的性能的技术。与传统的提示方法不同,传统方法通常提供一个提示并期待直接答案,CoT 提示将推理过程分解为一系列较小、相互连接的步骤。

其核心,CoT 提示涉及用一个问题或问题提示语言模型,然后指导它生成一条思维链 – 一系列中间推理步骤,导致最终答案。通过显式建模推理过程,CoT 提示使语言模型能够更有效地处理复杂推理任务。

CoT 提示的一个关键优势是,它允许语言模型将复杂问题分解为更易于管理的子问题。通过生成中间推理步骤,模型可以将整个推理任务分解为较小、更集中的步骤。这一方法有助于模型保持连贯性,并降低了失去推理过程的风险。

CoT 提示已在改善大型语言模型在各种复杂推理任务上的性能方面显示出希望,包括算术推理、常识推理和符号推理。通过利用中间推理步骤的力量,CoT 提示使语言模型能够对问题有更深入的理解,并生成更准确、更连贯的响应。

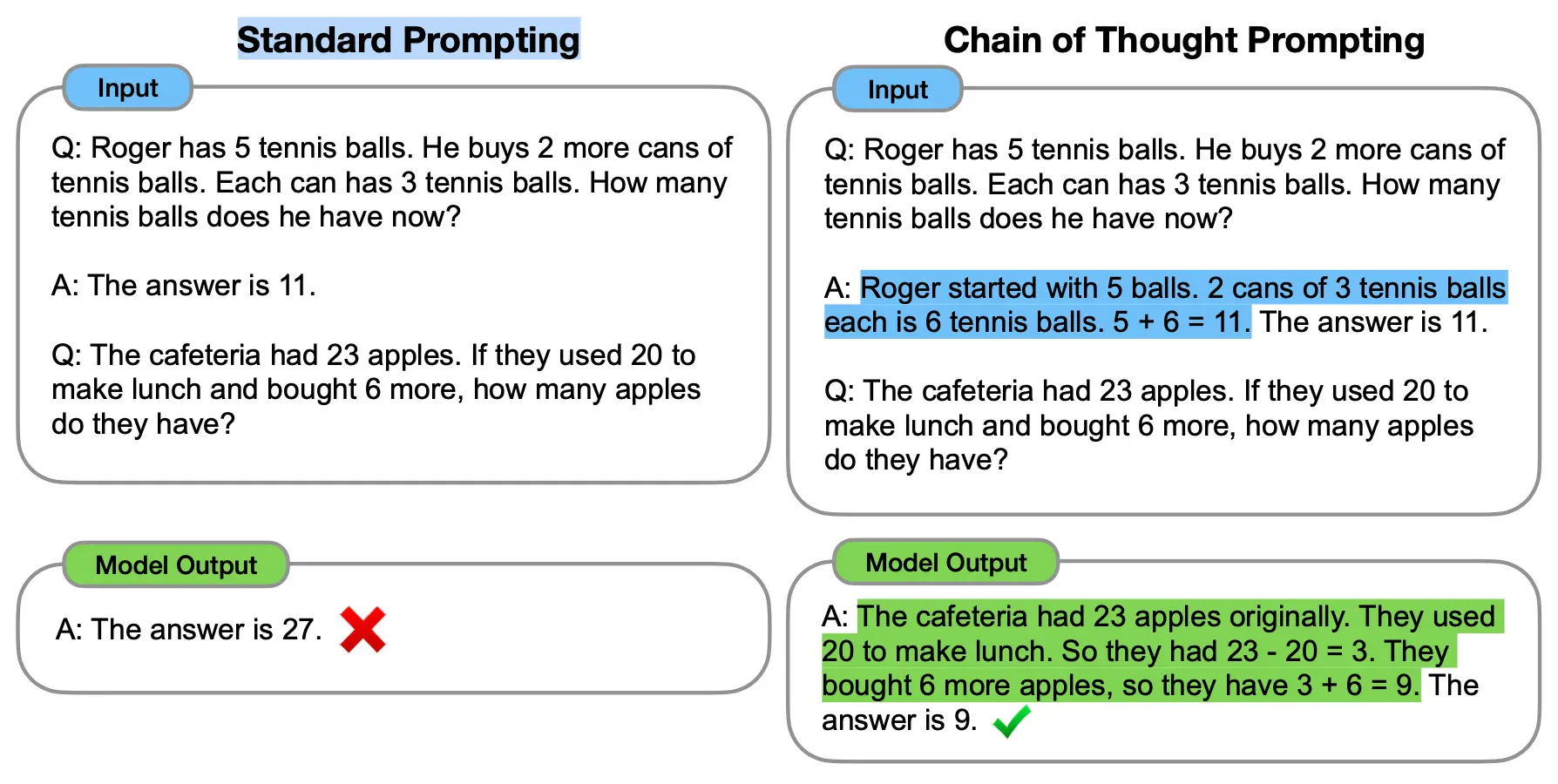

标准与 CoT 提示 (Wei et al., Google Research, Brain Team)

Chain-of-Thought 提示如何工作

CoT 提示通过生成一系列中间推理步骤来引导语言模型完成推理过程。与简单地提供提示并期待直接答案不同,CoT 提示鼓励模型将问题分解为较小、更易于管理的步骤。

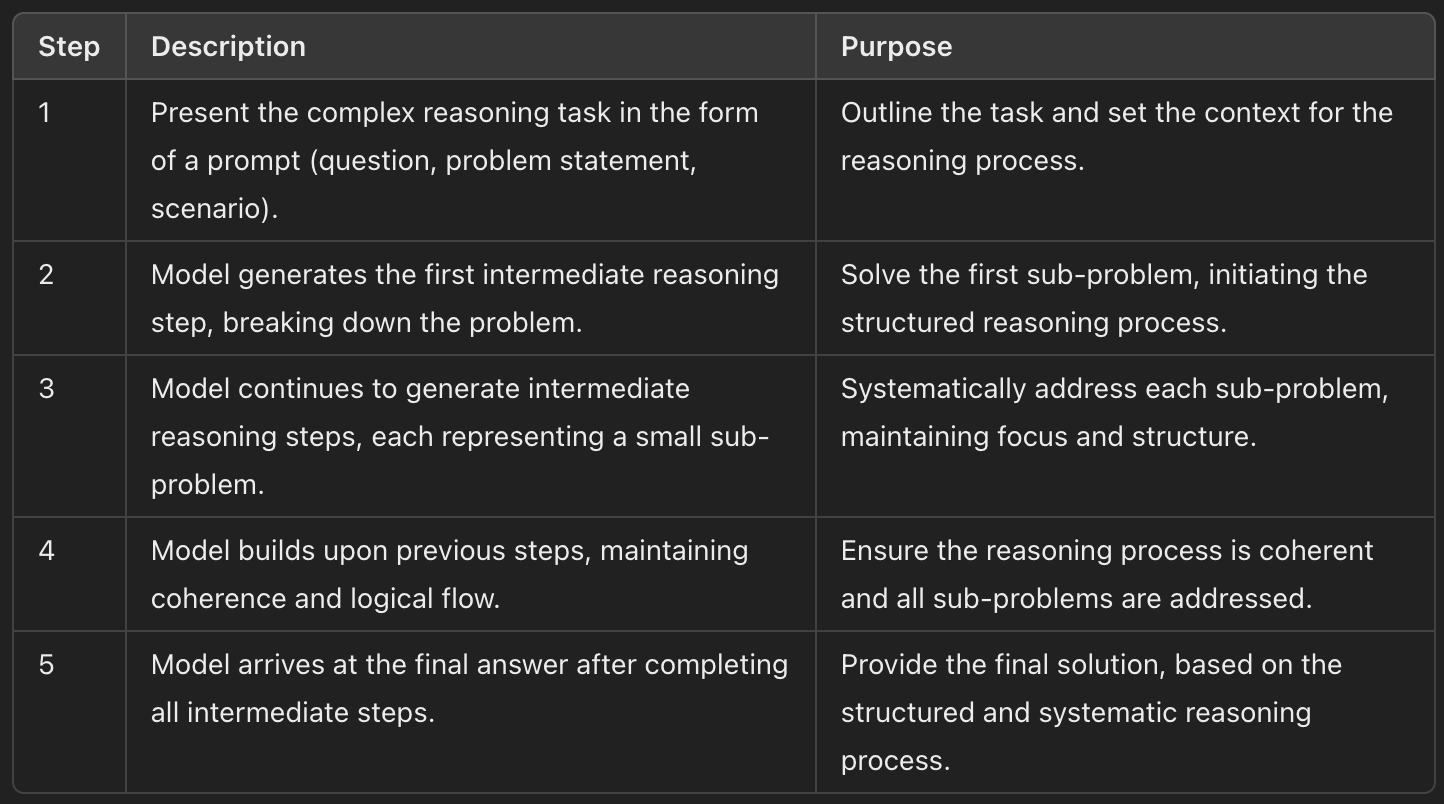

该过程从向语言模型提供一个提示开始,该提示概述了手头的复杂推理任务。该提示可以是问题、问题陈述或需要逻辑思考的场景。一旦提供了提示,模型就会生成一系列中间推理步骤,导致最终答案。

链中的每个中间推理步骤代表一个小的、集中的子问题,模型需要解决。通过生成这些步骤,模型可以以更结构化、更系统的方式处理整个推理任务。中间步骤允许模型保持连贯性,并跟踪推理过程,降低了失去焦点或生成不相关信息的风险。

当模型遍历思维链时,它会在前面的推理步骤的基础上,得出最终答案。链中的每个步骤都与前后步骤相连,形成逻辑推理流程。这种一步一步的方法使模型能够更有效地处理复杂推理任务,因为它可以一次集中于一个子问题,同时保持整个上下文。

CoT 提示中中间推理步骤的生成通常是通过精心设计的提示和训练技术来实现的。研究人员和从业者可以使用各种方法来鼓励模型产生思维链,例如提供一步一步推理的示例,使用特殊标记来指示每个推理步骤的开始和结束,或者在展示所需推理过程的数据集上微调模型。

5 步 CoT 提示过程

通过使用中间步骤引导语言模型完成推理过程,CoT 提示使模型能够更准确、更高效地解决复杂推理任务。推理过程的显式建模还增强了模型输出的可解释性,因为生成的思维链提供了模型如何得出其最终答案的见解。

Chain-of-Thought 提示的示例

CoT 提示已成功应用于各种复杂推理任务,展示了其在提高大型语言模型性能方面的有效性。

让我们探索一些 CoT 提示在不同领域的应用示例。

算术推理

CoT 提示最直接的应用之一是算术推理任务。通过生成中间推理步骤,CoT 提示可以帮助语言模型更准确地解决多步算术问题。

例如,考虑以下问题:

"如果 John 有 5 个苹果,Mary 有 John 的 3 倍苹果,Mary 有多少个苹果?"

使用 CoT 提示,语言模型可以生成以下思维链:

John 有 5 个苹果。Mary 有 John 的 3 倍苹果。要找到 Mary 的苹果数量,我们需要将 John 的苹果乘以 3。5 个苹果 × 3 = 15 个苹果因此,Mary 有 15 个苹果。

通过将问题分解为较小的步骤,CoT 提示使语言模型能够更有效地推理算术问题。

常识推理

CoT 提示也显示出在处理常识推理任务的潜力,这些任务需要对日常知识和逻辑思考有深刻的理解。

例如,考虑以下问题:

"如果一个人对狗过敏,他们的朋友邀请他们去一个有狗的房子,应该怎么办?"

使用 CoT 提示,语言模型可能会生成以下思维链:

这个人对狗过敏。朋友的房子里有狗。靠近狗可能会触发这个人的过敏反应。为了避免过敏反应,这个人应该拒绝邀请。这个人可以建议在其他地方与朋友见面。

通过生成中间推理步骤,CoT 提示使语言模型能够更清楚地展示其对情况的理解,并提供逻辑解决方案。

符号推理

CoT 提示也已应用于符号推理任务,这涉及操作和推理抽象符号和概念。

例如,考虑以下问题:

"如果 A 意味着 B,B 意味着 C,那么 A 意味着 C 吗?"

使用 CoT 提示,语言模型可以生成以下思维链:

A 意味着 B 意味着如果 A 为真,则 B 也必须为真。B 意味着 C 意味着如果 B 为真,则 C 也必须为真。如果 A 为真,则 B 为真 (来自步骤 1)。如果 B 为真,则 C 为真 (来自步骤 2)。因此,如果 A 为真,则 C 也必须为真。所以,A 意味着 C。

通过生成中间推理步骤,CoT 提示使语言模型能够更有效地处理抽象符号推理任务。

这些示例展示了 CoT 提示在不同领域提高大型语言模型在复杂推理任务上的性能方面的多功能性和有效性。通过显式建模推理过程中的中间步骤,CoT 提示增强了模型处理具有挑战性的问题和生成更准确、更连贯的响应的能力。

Chain-of-Thought 提示的优点

Chain-of-Thought 提示在增强大型语言模型的推理能力方面提供了几个显著的优点。让我们探索一些关键优势:

复杂推理任务的性能改善

CoT 提示的主要优点之一是其能够提高语言模型在复杂推理任务上的性能。通过生成中间推理步骤,CoT 提示使模型能够将复杂问题分解为更易于管理的子问题。这种一步一步的方法使模型能够保持焦点和连贯性,导致结果更准确、更可靠。

研究表明,使用 CoT 提示训练的语言模型在广泛的复杂推理任务上始终优于使用传统提示方法训练的模型。显式建模推理过程中的中间步骤已被证明是一种强大的提高模型处理具有挑战性的问题能力的技术。

推理过程的可解释性增强

CoT 提示的另一个显著优点是其能够增强推理过程的可解释性。通过生成思维链,语言模型提供了一个清晰、透明的解释,说明它如何得出其最终答案。这种一步一步的推理过程分解使用户能够理解模型的思维过程,并评估其结论的有效性。

CoT 提示提供的可解释性在推理过程本身很重要的领域(如教育环境或需要可解释人工智能的系统)尤其有价值。通过提供对模型推理的洞察,CoT 提示促进了对大型语言模型使用的信任和问责。

推广到各种推理任务的潜力

CoT 提示已展示出其推广到广泛推理任务的潜力。虽然该技术已成功应用于特定领域,如算术推理、常识推理和符号推理,但 CoT 提示的基本原理可以扩展到其他类型的复杂推理任务。

生成中间推理步骤的能力是一种可以在不同问题领域应用的基本技能。通过在展示所需推理过程的数据集上微调语言模型,CoT 提示可以适应处理新型推理任务,扩大其适用性和影响力。

促进更强大的 AI 系统的开发

CoT 提示在促进更强大、更智能的 AI 系统的开发中发挥着至关重要的作用。通过提高大型语言模型的推理能力,CoT 提示有助于创建能够处理复杂问题、表现出更高水平理解的 AI 系统。

随着 AI 系统变得更加复杂,并在各个领域部署,执行复杂推理任务的能力变得越来越重要。CoT 提示提供了一种强大的工具,用于增强这些系统的推理技能,使它们能够处理更具挑战性的问题并做出更明智的决定。

快速总结

CoT 提示是一种强大的技术,通过生成中间推理步骤来增强大型语言模型的推理能力。通过将复杂问题分解为较小、更易于管理的子问题,CoT 提示使模型能够更有效地处理具有挑战性的推理任务。这种方法提高了性能、增强了可解释性,并促进了更强大的 AI 系统的开发。

FAQ

Chain-of-Thought 提示 (CoT) 如何工作?

CoT 提示通过生成一系列中间推理步骤来引导语言模型完成推理过程,将复杂问题分解为较小、更易于管理的子问题。

使用 Chain-of-Thought 提示的好处是什么?

CoT 提示的好处包括复杂推理任务的性能改善、推理过程的可解释性增强、推广到各种推理任务的潜力,以及促进更强大的 AI 系统的开发。

可以使用 Chain-of-Thought 提示改进哪些任务?

可以使用 CoT 提示改进的任务示例包括算术推理、常识推理、符号推理和其他需要多步逻辑思考的复杂推理任务。