人工智能

自注意力引导:提高扩散模型的样本质量

扩散噪声模型是生成式人工智能框架,通过迭代去噪过程从噪声中合成图像。它们因其出色的图像生成能力和多样性而受到赞誉,这在很大程度上归功于基于文本或类别的条件引导方法,包括分类器引导和无分类器引导。这些模型在创建多样化、高质量的图像方面取得了显著的成功。最近的研究表明,类似类别字幕和标签的引导技术在提高这些模型生成的图像质量方面起着至关重要的作用。

然而,扩散模型和引导方法在某些外部条件下存在局限性。分类器自由引导(CFG)方法使用标签丢弃,增加了训练过程的复杂性,而分类器引导(CG)方法需要额外的分类器训练。两种方法都受到对外部条件的依赖的限制,这限制了它们的潜力并将它们局限于条件设置。

为了解决这些局限性,开发人员已经提出了一种更为通用的扩散引导方法,称为自注意力引导(SAG)。这种方法利用扩散模型的中间样本的信息来生成图像。我们将在本文中探讨SAG,讨论其工作原理、方法和与当前最先进的框架和管道的结果比较。

自注意力引导:提高扩散模型的样本质量

去噪扩散模型(DDM)因其能够通过迭代去噪过程从噪声中创建图像而受到欢迎。这些模型的图像合成能力在很大程度上归功于所使用的扩散引导方法。尽管它们具有优势,但扩散模型和基于引导的方法面临着增加复杂性和计算成本等挑战。

为了克服当前的局限性,开发人员引入了自注意力引导方法,这是一种更为通用的扩散引导公式,不依赖于扩散引导的外部信息,从而实现了一种条件自由和灵活的方法来引导扩散框架。自注意力引导方法最终有助于提高传统扩散引导方法的适用性,使其能够应用于有或没有外部要求的场景。

自注意力引导基于通用公式的简单原理和内部信息包含在中间样本中可以作为引导的假设。基于此原理,SAG方法首先引入模糊引导,一种简单直接的解决方案,用于提高样本质量。模糊引导旨在利用高斯模糊的良好属性,通过自然地去除细节来从中间样本中去除信息,并使用高斯模糊作为结果来引导预测,以增加图像与输入信息的相关性。虽然模糊引导方法可以在中等引导规模上提高样本质量,但它难以在大引导规模上复制结果,因为它经常引入整个区域的结构模糊性。因此,模糊引导方法难以将原始输入与降级输入的预测对齐。

为了提高模糊引导方法在更大引导规模上的稳定性和有效性,自注意力引导方法尝试利用扩散模型的自注意力机制,因为现代扩散模型已经在其架构中包含了自注意力机制。

假设自注意力对于捕捉核心的显著信息至关重要,自注意力引导方法使用扩散模型的自注意力图来对包含显著信息的区域进行对抗性模糊,并在此过程中使用所需的残差信息来引导扩散模型。然后,该方法利用注意力图在扩散模型的反向过程中来提高图像质量,并使用自条件来减少伪影,而无需额外的训练或外部信息。

总而言之,自注意力引导方法

- 是一种新颖的方法,使用扩散框架的内部自注意力图来提高生成样本图像的质量,而无需任何额外的训练或依赖外部条件。

- SAG方法尝试将条件引导方法推广为条件自由方法,可以与任何扩散模型集成,而无需额外的资源或外部条件,从而提高引导框架的适用性。

- SAG方法还尝试展示其与现有条件方法和框架的正交能力,从而通过与其他方法和模型的灵活集成来提高性能。

继续讨论,自注意力引导方法从相关框架的发现中学习,包括去噪扩散模型、采样引导、生成式人工智能自注意力方法和扩散模型的内部表示。然而,在其核心,自注意力引导方法实现了从DDPM或去噪扩散概率模型、分类器引导、分类器自由引导和扩散框架中的自注意力中获得的见解。我们将在下一节中详细讨论这些内容。

自注意力引导:初步、方法和架构

去噪扩散概率模型或DDPM

DDPM或去噪扩散概率模型是一种使用迭代去噪过程来从白噪声中恢复图像的模型。传统上,DDPM模型在一个时间步长内接收输入图像和方差时间表,以使用称为马尔可夫过程的正向过程来获得图像。

分类器和分类器自由引导与GAN实现

GAN或生成对抗网络具有独特的多样性与保真度的权衡,为了将GAN框架的这种能力带到扩散模型中,自注意力引导框架提出使用一种分类器引导方法,使用额外的分类器。相反,也可以实现分类器自由引导方法,不使用额外的分类器来实现相同的结果。虽然该方法可以实现所需的结果,但它在计算上仍然不可行,因为它需要额外的标签,并且将框架限制为需要额外条件(如文本或类别)和额外训练细节的条件扩散模型,这增加了模型的复杂性。

扩散引导的泛化

虽然分类器和分类器自由引导方法可以实现所需的结果,并有助于扩散模型的条件生成,但它们依赖于额外的输入。对于任何给定的时间步长,扩散模型的输入由一个泛化条件和一个没有泛化条件的扰动样本组成。此外,泛化条件包括扰动样本中的内部信息或外部条件,甚至两者兼而有之。所得到的引导是使用一个假想的回归器来预测泛化条件而制定的。

使用自注意力图提高图像质量

泛化扩散引导意味着可以通过从扰动样本中的泛化条件中提取显著信息来为扩散模型的反向过程提供引导。基于此,自注意力引导方法有效地捕捉反向过程中的显著信息,同时限制了预训练扩散模型中由于离群问题而带来的风险。

模糊引导

自注意力引导中的模糊引导基于高斯模糊,一种线性滤波方法,其中输入信号与高斯滤波器卷积以生成输出。随着标准偏差的增加,高斯模糊减少输入信号中的细节,通过平滑它们以趋近于常数,结果在局部上不可区分输入信号。此外,实验表明输入信号和高斯模糊输出信号之间存在信息不平衡,其中输出信号包含更多的细节信息。

基于此学习,自注意力引导框架引入模糊引导,一种技术,故意从扩散过程中的中间重构中排除信息,而是使用此信息来引导其预测,以增加图像与输入信息的相关性。模糊引导本质上使原始预测更远地偏离模糊输入预测。此外,高斯模糊的良好属性防止输出信号与原始信号显著偏离,具有中等偏差。简单来说,图像中自然发生模糊,使高斯模糊成为更适合应用于预训练扩散模型的方法。

在自注意力引导管道中,输入信号首先使用高斯滤波器进行模糊,然后与额外的噪声一起扩散以产生输出信号。通过这样做,SAG管道减轻了模糊的副作用,即减少高斯噪声,并使引导依赖于内容而不是随机噪声。虽然模糊引导在中等引导规模上可以实现令人满意的结果,但它难以在现有模型的大引导规模上复制结果,因为它容易产生嘈杂的结果,如下图所示。

这些结果可能是由于模糊引导在框架中引入的结构模糊性所致,使SAG管道难以将原始输入的预测与降级输入对齐,结果产生嘈杂的输出。

自注意力机制

如前所述,扩散模型通常具有内置的自注意力组件,这是扩散模型框架中更为重要的组件之一。自注意力机制是在扩散模型的核心实现的,它允许模型在生成过程中关注输入的显著部分,如下图所示,顶行为高频掩码,底行为最终生成图像的自注意力掩码。

所提出的自注意力引导方法建立在同样的原理上,并利用扩散模型中的自注意力图的能力。总体而言,自注意力引导方法模糊输入信号中被扩散模型关注的区域,或者说,隐藏被扩散模型关注的区域的信息。此外,自注意力引导的输出信号包含输入信号的完整区域,这意味着它不会导致输入的结构模糊性,并解决了全局模糊的问题。然后,管道通过对自注意力图进行全局平均池化(GAP)来聚合自注意力图以匹配输入信号的维度,并对最近邻进行上采样。

自注意力引导:实验和结果

为了评估其性能,自注意力引导管道使用8个Nvidia GeForce RTX 3090 GPU进行采样,并建立在预训练的IDDPM、ADM和稳定扩散框架之上。

无条件生成与自注意力引导

为了衡量SAG管道在无条件模型上的有效性,并展示其不具备分类器引导和分类器自由引导方法的条件自由属性,SAG管道在5万个样本上运行在无条件预训练的框架上。

如图所示,SAG管道的实现提高了无条件输入的FID、sFID和IS指标,同时降低了召回值。此外,SAG管道的实施在以下图像中表现出明显的改善,顶部图像是ADM和稳定扩散框架的结果,而底部图像是ADM和稳定扩散框架与SAG管道的结果。

有条件生成与SAG

SAG管道在现有框架中实现了异常的结果,并且SAG管道能够实现条件无关性,这使得SAG管道可以用于有条件生成。

稳定扩散与自注意力引导

尽管原始稳定扩散框架可以生成高质量的图像,但将稳定扩散框架与自注意力引导管道集成可以显著提高结果。为了评估其影响,开发人员使用空提示和每个图像对的随机种子进行稳定扩散,并使用500对图像(有或没有自注意力引导)进行人工评估。结果如下图所示。

此外,SAG的实施可以增强稳定扩散框架的能力,因为将分类器自由引导与自注意力引导相结合可以扩大稳定扩散模型的文本到图像合成范围。此外,带有自注意力引导的稳定扩散模型生成的图像质量更高,伪影更少,得益于SAG管道的自条件作用,如下图所示。

当前限制

虽然自注意力引导管道的实施可以显著提高生成图像的质量,但它仍有一些限制。

一个主要限制是与分类器引导和分类器自由引导的正交性。如图所示,SAG的实施可以提高FID评分和预测评分,这意味着SAG管道包含一个可以与传统引导方法同时使用的正交组件。

然而,它仍需要扩散模型以特定的方式进行训练,这增加了复杂性和计算成本。

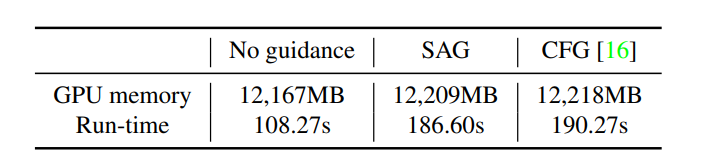

此外,自注意力引导的实施不会增加内存或时间消耗,这表明SAG中操作(如掩码和模糊)带来的开销可以忽略不计。然而,它仍增加了计算成本,因为它比无引导方法多了一个步骤。

最后的思考

在本文中,我们讨论了自注意力引导,一种新颖的引导方法,使用扩散模型内部的信息来生成高质量的图像。自注意力引导基于通用公式的简单原理和内部信息包含在中间样本中的假设。自注意力引导管道是一种条件自由和训练自由的方法,可以应用于各种扩散模型,并使用自条件来减少生成图像中的伪影,同时提高整体质量。