人工智能

RigNeRF:一种使用神经辐射场的新型Deepfakes方法

新的研究成果是在Adobe开发的,提供了第一个基于神经辐射场(NeRF)的可行且有效的Deepfakes方法——这是自2017年Deepfakes出现以来五年来首次真正的创新成果。

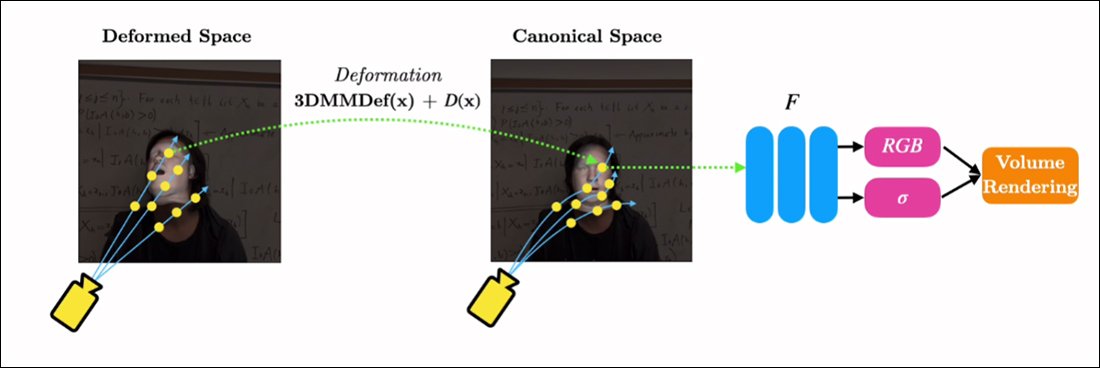

该方法被称为RigNeRF,使用3D可变形面部模型(3DMMs)作为中间层,位于所需输入(即要强加于NeRF渲染的身份)和神经空间之间。这种方法已被广泛采用,尤其是在最近几年中被生成对抗网络(GAN)面部合成方法采用,但这些方法尚未产生功能性和有用的面部替换框架用于视频。

与传统的Deepfakes视频不同,图中移动的内容都不是“真实”的,而是一个可探索的神经空间,训练于简短的视频。右侧我们看到3D可变形面部模型(3DMM)作为接口,位于所需操作(“微笑”、“向左看”、“向上看”等)和通常难以控制的NeRF可视化参数之间。有关此剪辑的高分辨率版本以及其他示例,请参阅项目页面,或本文末尾的嵌入式视频。来源:https://shahrukhathar.github.io/2022/06/06/RigNeRF.html

3DMMs本质上是面部的CGI模型,其参数可以适应更抽象的图像合成系统,例如NeRF和GAN,这些系统通常难以控制。

您在上面的图像中看到的内容(中间图像,蓝衬衫的男人),以及下面的图像(左侧图像,蓝衬衫的男人),不是一个“真实”的视频,其中嵌入了一个“假”的面部,而是一个完全合成的场景,仅作为体积神经渲染存在,包括身体和背景:

在上面的示例中,右侧的真实视频(红衣女士)用于通过RigNeRF“操纵”左侧捕获的身份(蓝衬衫的男人),据作者称,这是第一个实现姿势和表情分离的NeRF系统,同时能够执行新视图合成。

左侧的男性人物是从70秒的智能手机视频中“捕获”的,输入数据(包括整个场景信息)随后在4个V100 GPU上训练以获得场景。

由于3DMM风格的参数化骨架也可以作为整个身体的参数化CGI代理(而不仅仅是面部骨架),RigNeRF可能开启了全身Deepfakes的可能性,即真实的人体运动、纹理和表情传递到基于CGI的参数化层,然后将操作和表情转换为渲染的NeRF环境和视频。

至于RigNeRF——它是否符合当前的Deepfakes方法?或者它只是DeepFaceLab和其他2017年时代的半残缺的自动编码Deepfakes系统的又一个也许?

新论文的研究人员对此点是明确的:

‘作为一种能够重新动画面部的方法,RigNeRF容易被不良行为者滥用以生成Deepfakes。’

新论文题为RigNeRF:完全可控的神经3D肖像,由Stonybrook大学的ShahRukh Atha和四位Adobe Research的作者共同完成。

超越基于自动编码器的Deepfakes

过去几年中占据头条的Deepfakes大多是由自动编码器系统生成的,这些系统源自2017年在r/deepfakes子版块发布的代码——尽管在被禁之前,它已经被复制到GitHub,并且目前已经被分叉超过一千次,包括流行的(尽管存在争议)DeepFaceLab和FaceSwap项目。

除了GAN和NeRF外,自动编码器框架也尝试使用3DMM作为面部合成框架的“指导”。一个例子是2021年7月的HifiFace项目。然而,似乎没有可用的或流行的计划从这种方法发展而来。

RigNeRF场景的数据通过捕获短暂的智能手机视频获得。对于该项目,研究人员使用iPhone XR或iPhone 12进行所有实验。对于捕获的第一部分,受试者被要求在保持头部静止的同时进行一系列面部表情和说话,同时相机在他们周围移动。

对于捕获的第二部分,相机保持固定位置,而受试者必须在表达一系列表情的同时移动他们的头部。所产生的40-70秒的视频(约1200-2100帧)代表了将用于训练模型的整个数据集。

减少数据收集

相比之下,自动编码器系统(如DeepFaceLab)需要收集和整理大量多样化的照片,通常来自YouTube视频和其他社交媒体渠道,以及电影(在名人Deepfakes的情况下)。

所训练的自动编码器模型通常旨在用于各种情况。然而,最细致的“名人”Deepfakes可能会为单个视频从头开始训练整个模型,尽管训练可能需要一周或更长时间。

尽管新论文的研究人员发出了警告,似乎那些为AI色情和流行的YouTube/TikTok“Deepfakes重演”提供动力的“拼凑”和广泛组装的数据集不太可能在RigNeRF这样的Deepfakes系统中产生可接受和一致的结果,该系统具有特定于场景的方法。考虑到新工作中概述的数据捕获限制,这可能在一定程度上成为防止身份被恶意Deepfakes滥用的额外保障。

将NeRF适应于Deepfake视频

NeRF是一种基于摄影测量的方法,其中从各种视角拍摄的少数源图像被组装成可探索的3D神经空间。这种方法在今年早些时候因NVIDIA推出了其Instant NeRF系统而受到关注,该系统能够将NeRF的训练时间缩短到几分钟甚至几秒钟:

Instant NeRF. 来源:https://www.youtube.com/watch?v=DJ2hcC1orc4

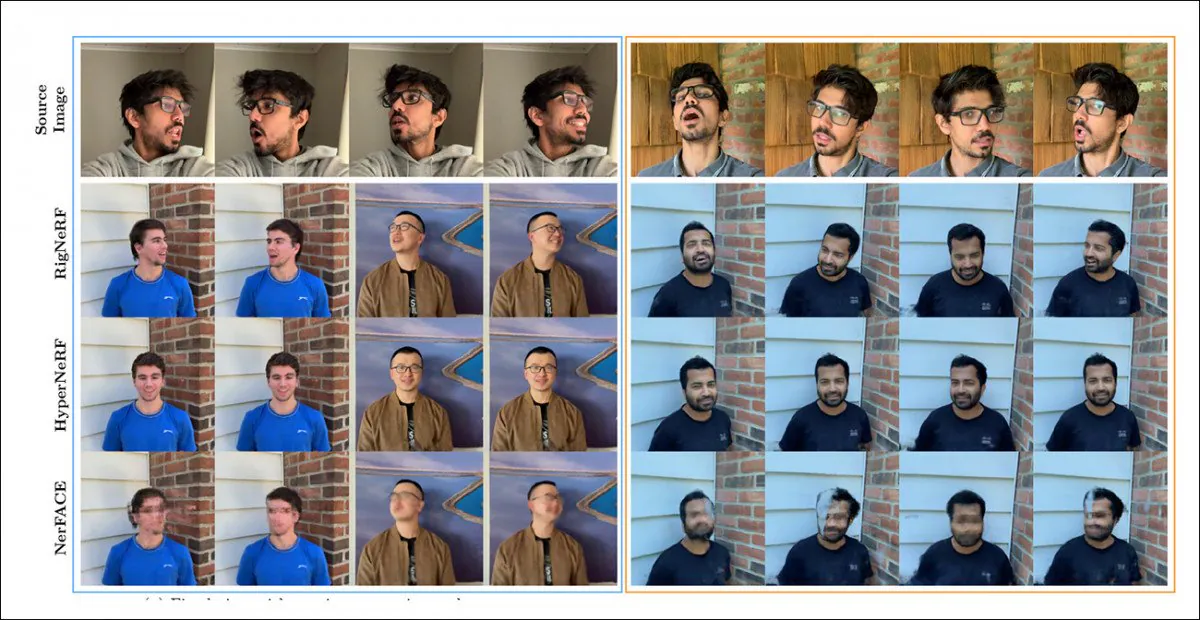

所产生的NeRF场景本质上是一个静态环境,可以被探索,但很难编辑。研究人员指出,两个之前的基于NeRF的计划——HyperNeRF + E/P和NerFACE——尝试了面部视频合成,并(显然是为了完整性和勤勉)将RigNeRF与这两个框架进行了比较:

RigNeRF、HyperNeRF和NerFACE之间的定性比较。请参阅链接的源视频和PDF以获取更高质量的版本。 静态图像来源:https://arxiv.org/pdf/2012.03065.pdf

然而,在这种情况下,结果偏向RigNeRF,有两个原因:首先,作者观察到“没有现有的工作可以进行苹果与苹果的比较”;其次,这需要限制RigNeRF的功能,以便至少部分匹配先前系统的更受限制的功能。

由于结果不是对先前工作的渐进式改进,而是NeRF可编辑性和实用性的“突破”,我们将测试回合放在一边,而是看看RigNeRF与其前辈有什么不同。

综合优势

NerFACE的主要限制是,它假设源视频将使用静态相机拍摄。这意味着它无法产生超出其捕获限制的新视图。这种系统可以创建“移动肖像”,但不适合Deepfakes风格的视频。

另一方面,HyperNeRF可以生成新颖和超现实的视图,但它没有任何机制可以改变头部姿势或面部表情,这也不能成为基于自动编码器的Deepfakes的竞争对手。

RigNeRF能够通过创建一个“规范空间”来结合这两个独立的功能,这是一个默认的基准,从中可以通过3DMM模块的输入执行偏差和变形。

创建一个“规范空间”(无姿势,无表情),3DMM产生的变形(即姿势和表情)可以作用于此空间。

由于3DMM系统不会与捕获的主题完全匹配,因此在此过程中需要补偿。RigNeRF通过从源视频中派生的多层感知器(MLP)计算的变形场先验来实现这一点。

用于计算变形的相机参数是通过COLMAP获得的,而每个帧的表情和形状参数是通过DECA获得的。

定位进一步通过特征点拟合和COLMAP的相机参数优化,并由于计算资源限制,训练的视频输出被下采样到256×256分辨率(这是一个困扰自动编码器Deepfakes场景的硬件约束过程)。

之后,变形网络在四个V100上训练——这是一个不太可能在普通爱好者手中的强大硬件(然而,在机器学习训练中,通常可以用时间换取空间,只需接受模型训练将需要数天甚至数周)。

总之,研究人员指出:

‘与其他方法相比,RigNeRF由于使用了3DMM引导的变形模块,能够以高保真度模拟头部姿势、面部表情和完整的3D肖像,因此能够产生更好的重建结果,具有清晰的细节。’

请参阅下面的嵌入式视频以获取更多详细信息和结果视频。

https://www.youtube.com/watch?v=q-SdWAfhVSM

https://www.youtube.com/watch?v=mEuqGy1ZlMA

最初发布于2022年6月15日。