Anderson 视角

研究表明ChatGPT作为新闻提供者具有较高的可信度

新研究表明,ChatGPT的事实核查标签在塑造人们对在线新闻的信任和分享意愿方面比点赞、分享和甚至可靠的新闻品牌更有影响力。

一项针对1000人的新研究发现,当ChatGPT为政治新闻提供可信度评分时,它经常改变人们的信任和分享意愿,无论他们的初始政治观点如何。传统的影响因素,如点赞或分享,几乎没有影响,但AI的判断对新闻的可信度产生了强烈的影响:

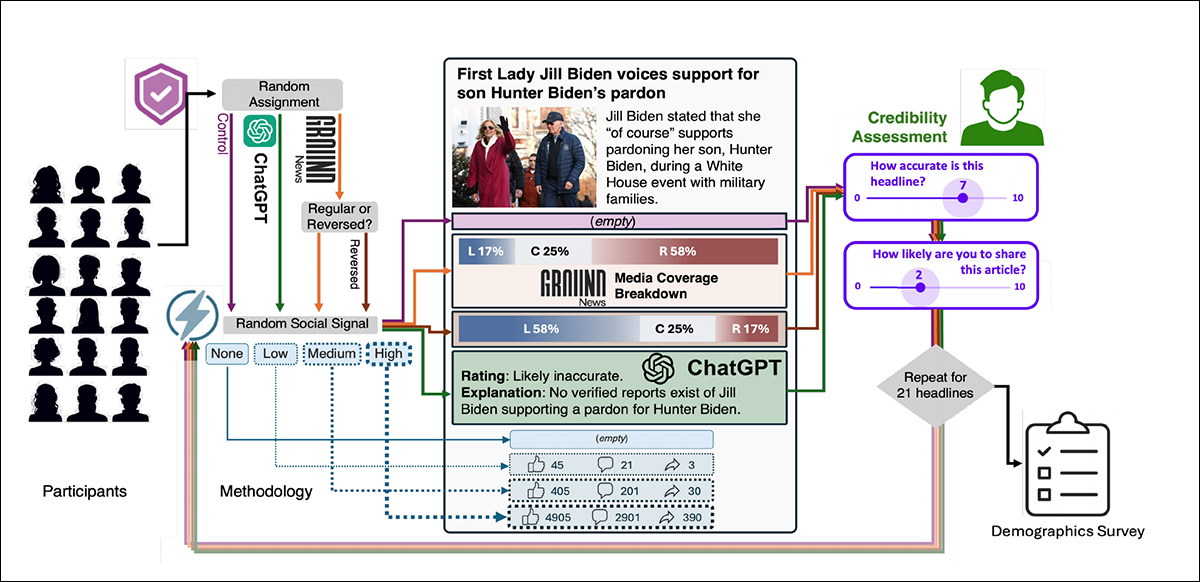

![来自新论文的图,展示了人们如何根据三个相互作用的线索评估新闻标题:新闻是否符合他们的政治身份;新闻在社交媒体上的参与度;以及机构或AI系统提供的可信度信号。这些影响因素结合起来,塑造了新闻的可信度和分享可能性。 [ Source ] https://arxiv.org/pdf/2511.02370](https://www.unite.ai/wp-content/uploads/2025/11/figure-1.jpg)

来自新论文的图,展示了人们如何根据三个相互作用的线索评估新闻标题:新闻是否符合他们的政治身份;新闻在社交媒体上的参与度;以及机构或AI系统提供的可信度信号。这些影响因素结合起来,塑造了新闻的可信度和分享可能性。 Source

AI摘要被视为可信新闻来源的程度可能是媒体领域近年来最重要的话题之一,尤其是因为谷歌的AI摘要在2025年将大部分流量从主要在线媒体渠道中转移走,没有明确的迹象表明这种权力转移将在长期或中期内走向何方。

新研究的作者表示:

‘这些发现凸显了算法反馈在塑造公众理解方面的潜力和风险。AI生成的线索可以帮助减轻偏见和增强可信度辨别能力,但其影响因政治身份而异,并带有过度依赖的道德风险[…]’

‘…ChatGPT的过度影响凸显了一个关键的权衡:虽然说服力强,但如果不仔细构建,AI反馈可能会取代批判性思维。’

作者建议,未来的研究应重点关注改进AI可信度干预措施,使其更加独立和支持已知事实,他们观察到,这在两极化话题中尤为重要。

除了ChatGPT作为“权威”的明显崛起和测试中分享信号的意外低影响(作者认为可能是由于略微单调的测试条件)之外,研究人员的测试结果中还有另一个有趣的结果,与人口统计和性别有关:

‘女性和种族少数群体(尤其是黑人和拉丁裔用户)对AI反馈的反应比对机构标签的反应更积极。’

这项新研究的标题是《AI可信度信号在社交媒体上超越机构和参与度,塑造新闻认知》,由诺特丹大学的三位研究人员完成。

让我们更详细地了解这篇论文的方法和结论。

方法

测试了四个假设:人们会将反映他们政治观点的新闻标题评为更准确;AI生成的可信度评分将比来自成熟机构的信号更有影响力;具有高参与度(即通过点赞、分享或评论衡量)的新闻标题将被视为更可靠;以及用户将接受AI关于新闻标题准确性的判断,即使它与他们自己的信念相冲突。

研究参与者来自Prolific平台,需要精通英语,并且是新闻的常规消费者;随机化过程确保参与者代表了不同种族和性别的多样化观点。

在实验中,参与者被分为四组,每组都显示了不同类型的反馈,旁边是新闻标题。

第一组(控制条件)没有提供任何额外的信息来说明标题的可信度;第二组的标题带有来自GroundNews的偏见评级,该服务将新闻来源分类为左倾、中心或右倾。

第三组看到相同的GroundNews标签,但故意翻转,以测试用户是否会检测到扭曲。

最后一组被显示了ChatGPT撰写的可信度评估,提供了简要的解释和评级,例如‘可能不准确’:

实验的概念图:每位参与者被显示带有不同可信度标签和社交参与信号的政治新闻标题。收集了每个标题似乎准确和可能被分享的响应,整个序列在21个项目中重复。

数据和测试

每位参与者被显示了一系列21个政治新闻标题。每个标题的社交参与度都有所不同;有时显示没有点赞或分享,有时显示很多。这些参与信号被随机化,以避免固定的模式。

新闻标题来自不同的政治观点,被标记为左倾、右倾或中立。

在每个标题之后,参与者被问及他们认为标题有多准确,以及他们是否愿意分享它。由于每位参与者已经声明了自己的政治归属,因此可以分析标题是否因政治观点而被评为更有利。

参与者对每个标题进行了两次评分:一次是标题的准确度,另一次是分享的可能性,评分使用0-10的量表进行测量。

研究人员然后将这些答案与额外的数据结合起来:每位参与者的人口统计和媒体使用信息;每个标题的政治标签;显示的可信度信号类型;以及分配的社交参与度。

政治身份的影响

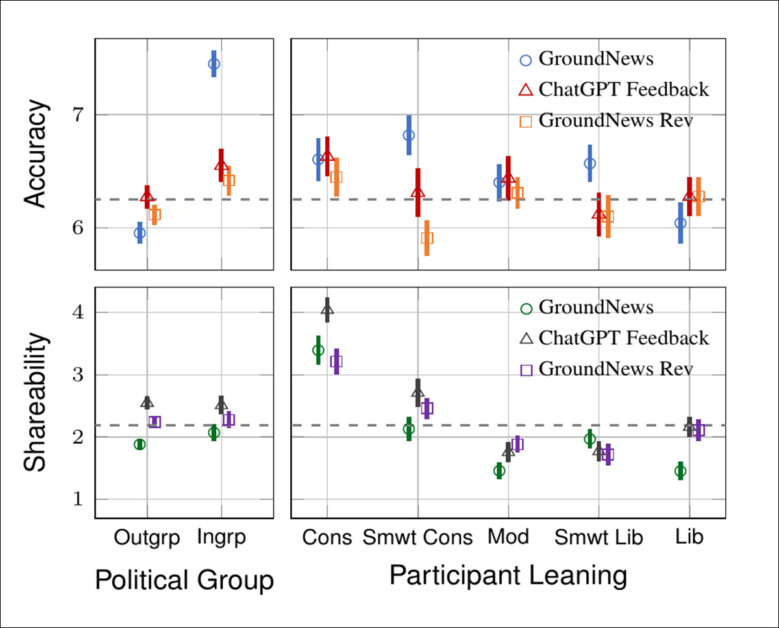

在第一个测试中,研究人员探讨了人们是否更倾向于评为准确的标题是否与他们自己的政治观点一致,结果表明参与者更倾向于相信与他们自己的政治观点一致的标题——但这取决于组。

温和派表现出最强的偏见,倾向于相信自己的政治观点;自由派和保守派倾向于相信中立标题;总体而言,中立标题被评为比左倾或右倾标题更准确。

标题的准确性和分享性评分如何根据标题的政治立场和参与者的政治归属而变化。温和派最有可能评为自己的政治观点一致的标题为准确,而自由派和保守派则更倾向于相信中立标题。分享行为遵循类似的模式,温和派以外的群体中偏见有限。

在这一结果中,发现温和派在分享性方面有一个适度的偏见;但自由派和保守派没有表现出这种倾向。

方差分析(ANOVA)显示,标题的政治立场仅当与政治身份相互作用时才会影响分享性。可信度和分享性相关,但仅温和派表现出明确的模式。

机构与AI可信度

下一个测试询问了人们是否比传统来源(如新闻评级网站)更信任AI评级,特别是当评级可能与他们的政治观点相冲突时:

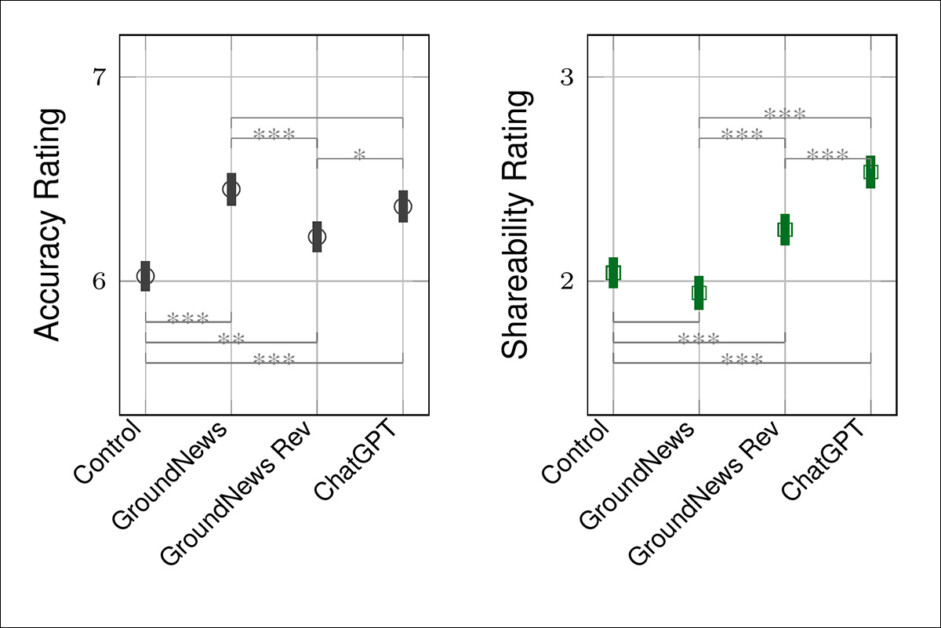

不同反馈来源的可信度和分享性评分:所有三个信号都增加了准确性评分,GroundNews产生了最高的评分,但ChatGPT在分享性方面产生了更大的影响,表明其具有更广泛的说服力。错误条显示95%的置信区间,星号标记显著的成对差异。

所有反馈都增加了感知到的准确性;但当GroundNews与用户的政治观点一致时,其效果最显著。

ChatGPT提高了准确性评分,表明它被视为更中立的。保守派对GroundNews的反应较少,但对ChatGPT的反应与其他群体相似:

这里我们可以看到ChatGPT反馈对感知准确性的影响。结果表明,机构信号的信任取决于一致性,而算法信号的信任则不依赖于一致性。ChatGPT提高了可信度和分享性评分,尤其是对于保守派。

社交指标的影响有限

第三个分析测试了社交参与度信号(如点赞、分享和评论)是否会通过社会证明的方式提高可信度或分享性;但没有观察到这种效果。

测试发现,参与度水平(如点赞或分享)对标题的准确性没有真正的影响,只对分享性产生了微弱、不可靠的影响;与算法或机构信号不同,这些社交信号在此环境中似乎没有影响判断。

AI反馈影响可信度

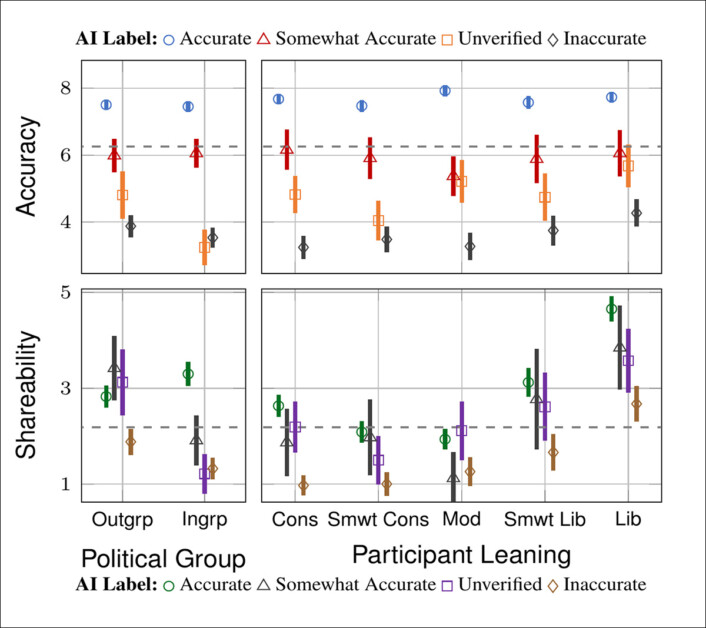

第四个也是最后一个实验测试了用户是否会根据AI生成的标签调整他们的可信度和分享判断:准确;部分准确;未经验证;或不准确,所有这些都由ChatGPT分配。

参与者对AI生成的可信度标签做出了强烈的反应。准确性评分随着ChatGPT的反馈而上升或下降,最大影响出现在标题被标记为准确或不准确时:

ChatGPT反馈影响准确性和分享性评分。上:准确性评分随着更积极的标签而上升,特别是当标题被标记为’准确’时,并在被标记为’不准确’时下降。下:分享性评分遵循类似的模式,但在组间表现出更大的变异:自由派对负面提示做出了最强烈的反应,而保守派则表现出更微妙的变化。

政治身份塑造了这些影响,用户在ChatGPT的反馈与他们自己的观点一致时更信任ChatGPT。

分享行为遵循类似的模式:同一政治派别的标题被标记为准确的标题被分享最多,尤其是在模糊的标签(如部分准确)下。

这些结果表明,AI反馈可以改变用户行为;同时也存在加剧党派分歧或阻碍批判性思维的风险。

谁最信任AI?

后续分析检查了用户人口统计如何影响对可信度标签的反应。ChatGPT的反馈提高了准确性评分,但这种影响在受过高等教育的用户和频繁的社交媒体使用者中较弱,他们表现出更大的怀疑态度。

这些群体对GroundNews和反转提示做出了负面的反应,表明,论文提出,明显的偏见标记可能会疏远更有媒体素养的用户。

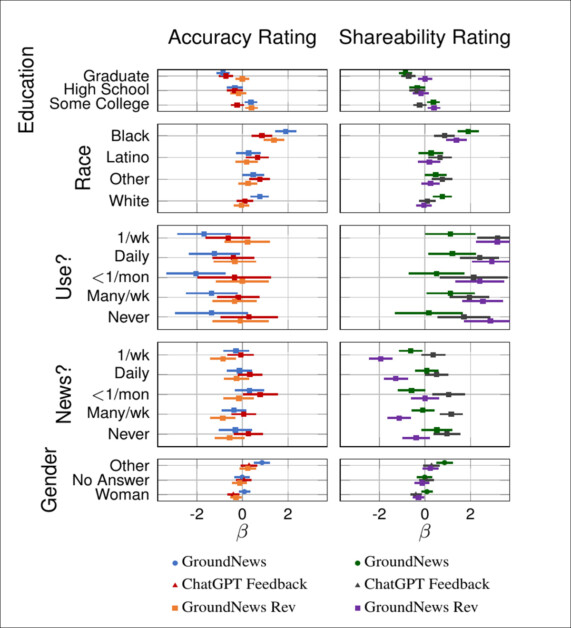

相比之下,女性和种族少数群体,尤其是黑人和拉丁裔用户,对ChatGPT的反应比对机构信号更积极:

不同群体对不同可信度信号的反应。ChatGPT的评分对准确性有最强和最一致的影响,而分享性评分的影响则不那么一致,根据种族、性别和媒体使用情况而有所不同。

分享行为也反映了这种分歧:GroundNews在社交媒体用户和新闻爱好者中最明显地降低了分享性,而ChatGPT的影响则更为混合,甚至在某些群体中提高了分享性,尤其是研究生学历的用户对所有反馈类型都非常敏感。

作者总结道:

‘这些发现对社会技术系统中的可信度干预措施的设计具有直接的影响。用户越来越受到算法反馈的影响,这可以覆盖机构信号并缓解党派偏见——但也存在过度依赖的风险。’

‘机构信号仍然对某些用户有效,但其影响力在两极分化或[低信任]环境中减弱。同时,参与度指标(如点赞和分享)基本被忽略,表明在没有社会背景的情况下,其说服价值降低。’

‘为了支持公平和明智的新闻评估,AI驱动的干预措施必须是透明的、可解释的,并旨在增强用户代理性。’

‘未来的工作应该在更生态有效的环境中检查这些机制,评估替代的AI可信度框架,并开发适应性系统,以促进批判性参与,面向政治多样化的受众。’

结论

鉴于所有当前的生成式AI系统都倾向于产生幻觉和扭曲真相,ChatGPT的广泛采用(即使它在欧洲的付费订阅正在停滞)代表了对这些系统的架构既无法证明也无法支持的巨大信任飞跃。

相信AI的新闻表现形式存在的一个问题是缺乏有效的系统来将新闻来源归类为“政治上偏向”的或倾向于政治光谱的某一端。

即使在最可靠的第四权媒体来源中,选择报道什么和不报道什么本身就是一个政治声明。ChatGPT或其同类产品目前无法在这些解释偏见层面上导航。

另一个问题是,这类系统出现在人类历史上80年来最两极分化和充满分歧的时期,并且正值社会最愿意倾听“另类声音”的时候——比如一个全新的技术类型,被吹捧为世界真相的必要过滤器,而实际上它只是一个统计概率的预测器,依赖于大量的有偏见的信息。

* 详细信息可以在网上找到(请参阅来源论文,第2页底部的URL)。但是,这些数据需要注册才能查看,我没有进一步确认是否可以完全免费查看,因此无法确认是否需要付费和/或特定类型的凭证。

首次发布于2025年11月5日星期三