合作伙伴

英飞凌科技和d-Matrix合作开发低延迟AI基础设施

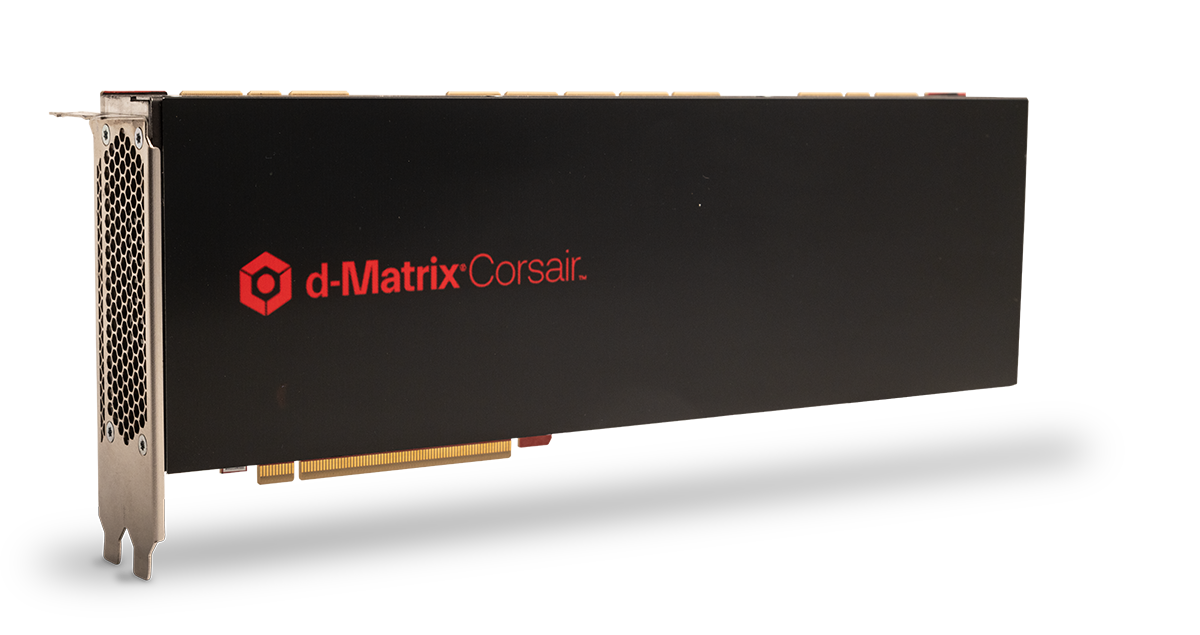

英飞凌科技已宣布与d-Matrix合作,共同提高AI推理系统在现代数据中心中的性能和能效。该合作伙伴关系的重点是d-Matrix的Corsair AI推理加速器平台和英飞凌的OptiMOS双相电源模块,这些模块旨在支持交互式AI工作负载的高密度计算环境。

该公告突出了AI硬件行业内日益增长的转变。过去几年,基础设施的繁荣主要集中在训练越来越大的AI模型,但现在该行业正在迅速扩展到推理——即在聊天机器人、代理AI系统、副驾驶、搜索、财务分析和医疗决策支持等实际应用中运行模型的过程。这些工作负载对硬件提出不同的要求,特别是在延迟、响应速度和功耗方面。

为什么AI推理成为硬件的主要战场

AI推理已成为AI基础设施市场增长最快的领域之一,因为交互式AI系统需要在毫秒内做出响应,而不是几秒钟。d-Matrix一直将Corsair定位为这些工作负载,强调了超低延迟和能效推理对于大型语言模型和AI代理的重要性。

根据d-Matrix的说法,Corsair的设计目的是减少内存瓶颈,这通常会减慢生成式AI推理的速度。该公司声称,该平台可以显著降低延迟并提高传统GPU中心的推理系统的吞吐量,特别是对于交互式应用程序。

与英飞凌的合作解决了另一个日益重要的挑战:电源供应。

随着AI服务器的密度不断增加,高效地向加速器供电已成为基础设施扩展的限制因素。英飞凌的OptiMOS TDM2254xx模块旨在用于垂直电源交付架构,以帮助降低电气损失并提高紧凑服务器系统内的电源密度。

向实时AI系统的转变

两家公司将合作围绕“交互式AI”的兴起进行合作,即推理系统必须连续生成输出,延迟极低。这包括对话式AI、AI代理、实时推理系统以及需要从大型语言模型中快速生成令牌的应用程序。

d-Matrix的创始人和CEO Sid Sheth表示,Corsair的架构是专门为子2毫秒令牌延迟而设计的,这一指标随着企业将AI系统从实验转移到面向客户的环境中而变得越来越重要。

更广泛的AI行业也开始认识到,推理基础设施可能会与训练基础设施有所不同。虽然GPU集群主导了生成式AI扩张的第一阶段,但推理越来越多地奖励优化了内存带宽、延迟、网络和能效而非原始计算能力的架构。

能效成为AI扩展的核心

面临的最大约束之一是电力需求。AI推理工作负载可以在数百万个请求中连续运行,使得操作效率对于部署成本至关重要。

英飞凌一直在通过基于硅、碳化硅(SiC)和氮化镓(GaN)的半导体技术积极扩大其在AI基础设施中的地位。该公司越来越多地专注于为AI加速器和服务器基础设施提供电源交付层。

与d-Matrix的合作反映了半导体公司如何与AI加速器初创公司日益紧密地整合在一起,因为该行业正在寻找传统GPU重型架构的替代方案。

AI基础设施正在超越传统GPU

合作伙伴关系也出现在AI硬件实验浪潮中。越来越多的初创公司正在开发专门针对推理、以内存为中心的计算或AI网络的专用加速器。

d-Matrix通过其在计算内存技术和为生成式AI量身定制的低延迟推理系统上进行了区分。该公司还扩大了其基础设施战略,超出了单独的加速器芯片,最近强调了网络、可组合基础设施和推理集群的全系统优化。

随着AI应用变得越来越具代理性和交互性,基础设施提供商预计将在降低延迟、降低能耗和提高整个数据中心堆栈的系统级效率方面投入更多精力,而不是仅仅关注原始处理能力。